El ángulo de Anderson

Reducir las alucinaciones de imágenes de IA exagerándolas

Los modelos de visión de estilo ChatGPT suelen alucinar elementos que no pertenecen a una imagen. Un nuevo método reduce estos errores mostrando al modelo versiones exageradas de sus propias alucinaciones, basadas en subtítulos, y luego pidiéndole que lo intente de nuevo. Este enfoque no requiere reentrenamiento ni datos adicionales, y puede aplicarse a una amplia gama de modelos y tipos de modelos.

Una nueva publicación de China ofrece una visión interesante del molesto y persistente problema de alucinaciones en imágenes y vídeos generados por IA: elementos que claramente no deberían estar en la imagen, según la solicitud y la entrada del usuario.

En esencia, el sistema toma una imagen y permite que el modelo la describa, como de costumbre; luego convierte ese título en una nueva imagen Usando un modelo de texto a imagen, cualquier objeto o detalle adicional en esta segunda imagen será una representación directa de las alucinaciones iniciales del modelo. Luego, al comparar la imagen original con la generada, el sistema evita que el modelo cometa esos errores la próxima vez que lo intente.

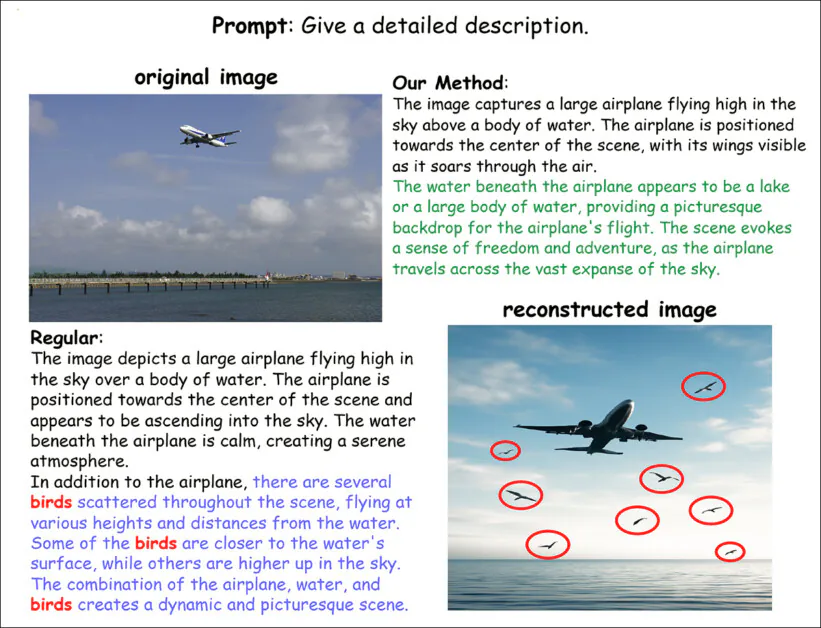

Una ilustración de cómo el nuevo método identifica y reduce las alucinaciones en los pies de foto. El modelo regular describe aves que no existen en la imagen original, lo que da lugar a una imagen reconstruida que las incluye. Estos errores están marcados en rojo. En cambio, el método propuesto evita estos detalles inventados, manteniendo el pie de foto específico y fluido. Fuente: https://arxiv.org/pdf/2509.21997

El método comienza mostrando al modelo imágenes reales y pidiéndole que las describa, incluyendo algunas descripciones que presentan objetos o detalles que son no realmente presenteEstos subtítulos alucinados se utilizan para generar imágenes sintéticas que facilitan la detección de errores. Al comparar las imágenes reales con las generadas, el sistema aprende qué patrones internos del modelo tienden a producir contenido ficticio.

Una vez identificados estos patrones de error, se pueden almacenar y utilizar posteriormente. Cuando el modelo recibe una nueva imagen, el sistema ajusta sus señales internas durante el subtitulado. Alejándolo de los patrones conocidos que causan alucinacionesEsto funciona en una sola pasada y no requiere datos adicionales, reentrenamiento ni generación de nuevas imágenes en el momento de la prueba.

La telaraña enredada

En el ejemplo que se muestra arriba, del documento, podemos ver que enredo Es probable que sea responsable de embellecer la imagen de entrada con "pájaros", aunque la primera imagen parezca no contener pájaros.

El entrelazamiento ocurre cuando un modelo insiste en asociar ciertos conceptos con otros, simplemente porque dos (o más) conceptos tienden a aparecer juntos con frecuencia en la distribución de datos original con la que se entrenó el modelo. En este caso, el modelo puede haber visto muchas imágenes de aviones+pájaros, lo que provoca una asociación que no se aplica a la imagen en cuestión, pero que, sin embargo, se entromete en el título derivado.

Aunque el entrelazamiento se puede mitigar al detener el entrenamiento antes (lo que, en general, hace que el modelo sea lo más flexible y adaptable posible), esto también reduce el detalle y la resolución de todos los conceptos entrenados, dejando al entrenador del modelo con el eterno dilema: ¿crear un modelo que sea muy flexible y desenredado; o crear un modelo que sea más poderosamente generativo, pero también más propenso a producir alucinaciones "asociadas"?

Si la calidad de los subtítulos y la atención al detalle en la curación de los datos originales para un modelo generativo hubieran sido mejores de lo que la logística suele permitir, los subtítulos para todas las imágenes de origen tendrían información detallada cada objeto en cada imagen, de modo que el modelo entrenado pudiera haberles asignado entradas discretas y desenredadas en su espacio latente.

Tal como están las cosas, la práctica egoísta de Subtítulos SEO, combinado con el hecho de que ad hoc raspado web a hiperescala permanece La mejor fuente para entrenar modelos generativos verdaderamente potentes significa que los títulos de las imágenes tienden a quedar muy por debajo de este estándar:

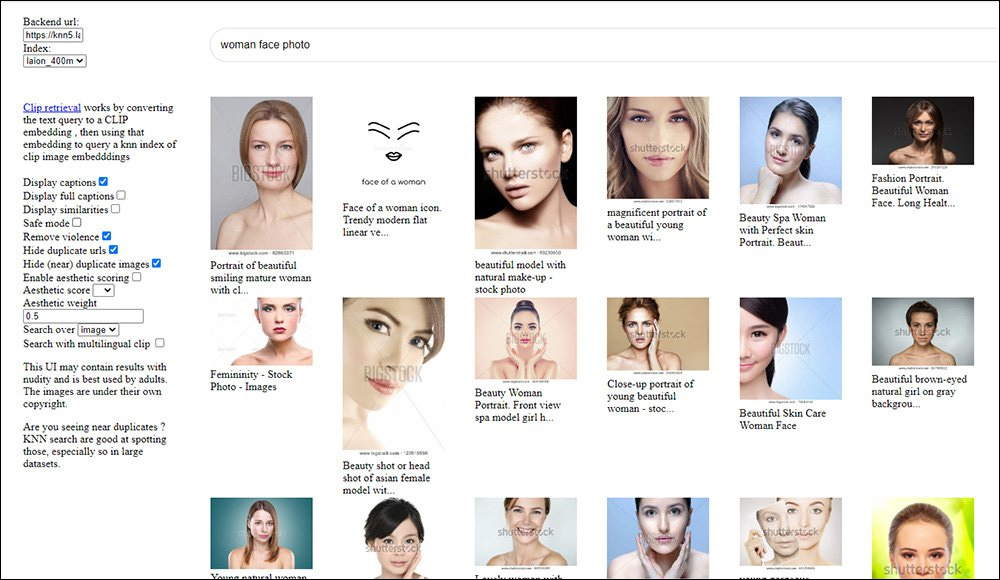

Una ilustración de cómo los subtítulos deficientes limitan la utilidad de las imágenes LAION para entrenar modelos como Stable Diffusion. Muchas etiquetas de texto son superficiales, imprecisas o están optimizadas para SEO en lugar de ofrecer una descripción precisa, lo que dificulta que el modelo aprenda conceptos visuales detallados, como los rasgos faciales. (La fuente original era https://rom1504.github.io/, ahora descontinuada).

Por lo tanto, dado que es poco probable que alguna vez sea posible encontrar una solución fundamental, la reducción de las alucinaciones LLM/VLM mediante soluciones alternativas y compromisos se ha convertido ahora en una fuerte subcorriente en la literatura.

La nueva técnica china revelada esta semana, afirman los autores, fue probada en una variedad de arquitecturas en diversas condiciones y podría indicar una forma útil de reducir la "contaminación por alucinaciones".

Ellos dicen:

'Experimentos exhaustivos en múltiples puntos de referencia muestran que nuestro método reduce significativamente las alucinaciones en los niveles de objeto, atributo y relación, al tiempo que preserva en gran medida el recuerdo y la riqueza de los títulos'.

El sitio nuevo documento se titula Exponer alucinaciones para suprimirlas: Edición de representación VLM con anclajes generativos, y proviene de tres investigadores de la Universidad de Ciencia y Tecnología de China y la Universidad de Nanjing.

Método

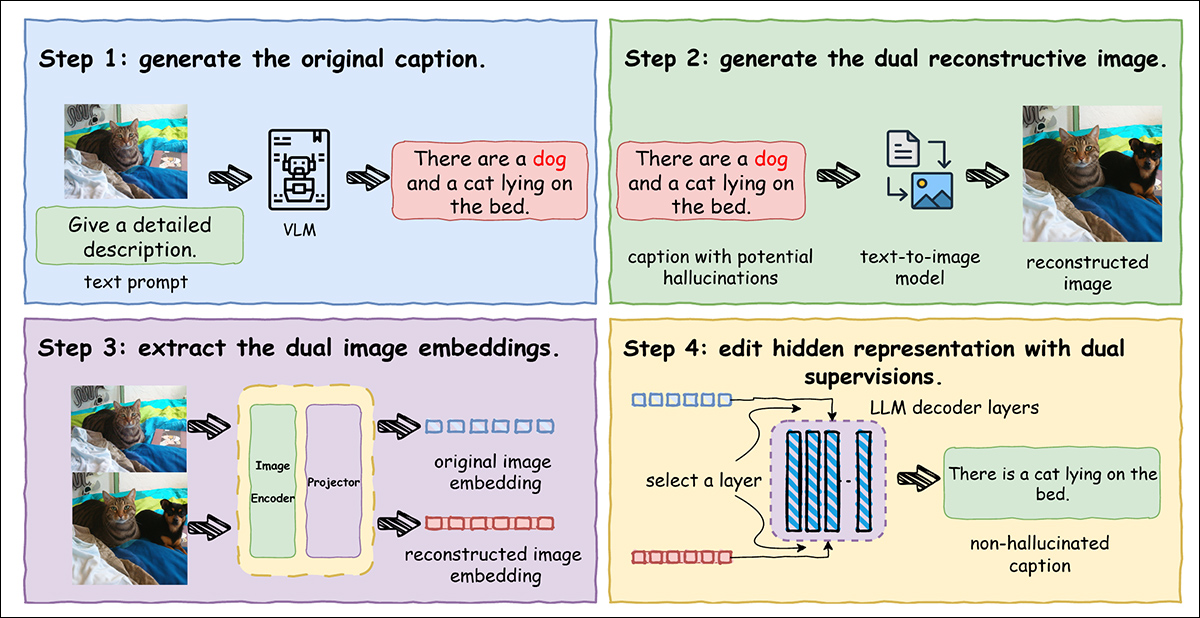

Los autores han ideado un proceso integral, que se muestra a continuación, diseñado para exponer y suprimir las alucinaciones en los títulos de las imágenes:

Ilustración del proceso completo. Un modelo de visión y lenguaje genera primero un subtítulo a partir de la imagen de entrada, que puede incluir contenido alucinógeno. Este subtítulo se utiliza para generar una imagen reconstruida mediante un modelo de texto a imagen, lo que facilita la detección de alucinaciones. Se extraen las incrustaciones de las imágenes originales y reconstruidas y se utilizan para guiar los ajustes dentro del decodificador, lo que ayuda al modelo a suprimir los detalles alucinógenos y, al mismo tiempo, preservar la calidad del subtítulo.

A partir de una imagen de entrada real, un modelo de visión y lenguaje genera un texto descriptivo que puede contener objetos o relaciones ficticias. Este texto se introduce en un generador de texto a imagen para crear una imagen reconstruida que muestra exactamente lo que describe. Al comparar esta imagen reconstruida con la original, el contenido inventado se hace evidente y medible, convirtiendo los errores sutiles del texto en diferencias visibles que el sistema puede identificar y reducir.

Para evitar que el modelo "invente" detalles, el sistema compara dos versiones de la misma imagen: la original y una reconstruida a partir del pie de foto. Cada imagen se convierte en una imagen compacta. incrustación que captura su contenido.

La imagen original actúa como una referencia fiable, mientras que la reconstruida resalta dónde pudieron haberse infiltrado alucinaciones. Al ajustar sus representaciones internas para acercarse a la original y alejarse de la reconstruida, el modelo aprende a corregirse automáticamente. Dado que este proceso no depende de reglas ajustadas manualmente ni de datos externos, se mantiene completamente... auto supervisado.

El documento dice:

Las alucinaciones en los MLLM son intrínsecamente difíciles de detectar porque están lingüísticamente bien formadas y a menudo son indistinguibles de las descripciones textuales fieles. La discrepancia no radica en la plausibilidad del lenguaje, sino en la falta de coincidencia con la evidencia visual, a la que el propio modelo suele ser insensible.

'Para abordar esto, introducimos un mecanismo de exposición a alucinaciones que aprovecha la reconstrucción generativa para convertir inconsistencias implícitas en señales explícitas y observables.'

Dada una imagen de entrada y su título, el sistema utiliza el FLUX.1-dev Modelo de texto a imagen para recrear una imagen solo a partir del pie de foto. Esta imagen recreada tiende a exagerar el significado del pie de foto, haciendo más evidentes los detalles falsos. Estos errores amplificados sirven como señales útiles que ayudan al modelo a reconocer y corregir sus propios errores.

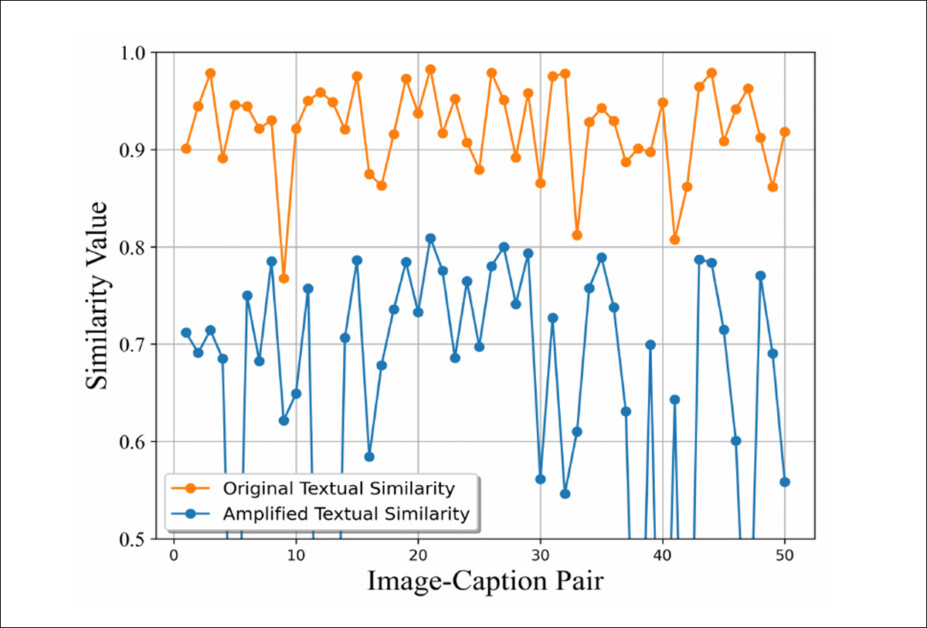

Para probar su método, los autores inyectaron alucinaciones en los subtítulos y utilizaron el modelo de texto a imagen para generar imágenes reconstruidas. Estas imágenes fueron subtituladas nuevamente por LLaVA, y la similitud semántica entre los subtítulos originales y los alucinados se evaluó:

Una ilustración de cómo el mecanismo de amplificación de las alucinaciones hace visibles los errores sutiles. Cada punto muestra la similitud entre los subtítulos de las imágenes originales y reconstruidas para un par de imágenes. La línea naranja representa la similitud medida directamente entre los subtítulos originales y alucinados, que se mantiene alta y oculta pequeños errores; la línea azul representa la similitud tras la reconstrucción, que disminuye drásticamente, lo que demuestra que el proceso convierte las alucinaciones ocultas en marcadores semánticos claros que pueden detectarse y corregirse.

La similitud disminuye drásticamente después de la reconstrucción, lo que demuestra que el proceso hace que los errores sutiles sean más detectables.

Datos y Pruebas

Para validar la eficacia del nuevo método se utilizaron tres parámetros de referencia adecuados: Evaluación de alucinaciones con subtítulos y relevancia de la imagen (PRESIDENTE); Evaluación MLLM punto de referencia (MME); y Evaluación de sondeo de objetos basada en agrupamiento (PAPA).

Del documento publicado en CHAIR: ejemplos de objetos alucinados generados por dos sistemas de subtítulos líderes, TopDown y NBT, donde cada modelo inventa elementos visuales que no están realmente presentes en la imagen, como computadoras portátiles, lavabos o tablas de surf. Fuente: https://arxiv.org/pdf/1809.02156

Métricas estándar como tasa de alucinaciones or recordar Puede ser engañoso, ya que un modelo podría evitar las alucinaciones simplemente produciendo subtítulos breves o vagos. Para tener en cuenta la compensación entre el recuerdo y la alucinación, se utiliza una métrica combinada llamada Alucinación y recuerdo Se utilizó (HAR@β), que califica los subtítulos en función de su precisión e integridad, y que permite ajustar el equilibrio dependiendo de si es más importante evitar errores o incluir más detalles.

Se utilizó POPE para evaluar las alucinaciones de objetos sensibles al contexto y MME para evaluar las alucinaciones a nivel de atributo, ambas enmarcadas como tareas de juicio de Sí o No.

Se realizaron experimentos en diversos conjuntos de datos representativos, utilizando el modelo Flux mencionado anteriormente y el LLaVA-v1.5-7B variante. Los conjuntos de datos empleados fueron Microsoft COCO; A-OKVQA; y GQA.

Se realizó una edición latente para la segunda capa de los modelos, de acuerdo con trabajos previos relacionados, mientras que los hiperparámetros y la temperatura fueron consistentes en todos los modelos.

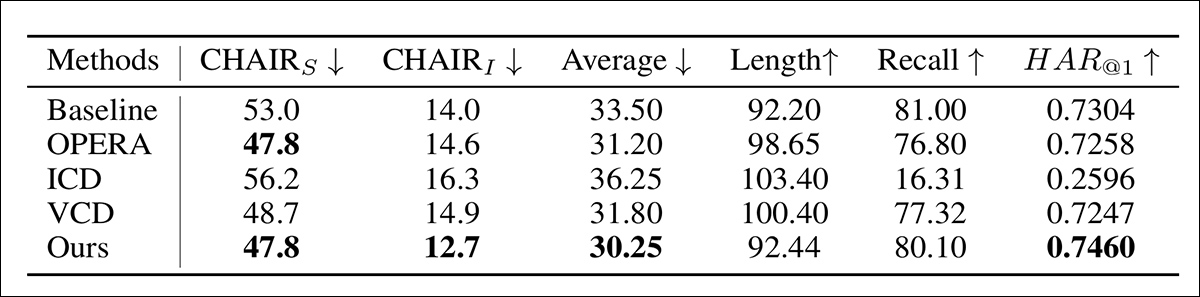

Los resultados iniciales del proyecto CHAIR se presentan a continuación*:

Rendimiento en el parámetro de referencia CHAIR para la mitigación de alucinaciones, evaluado utilizando múltiples métricas.

De estos resultados los autores comentan:

'[Nuestro método supera consistentemente a otras líneas de base tanto en CHAIRS y SILLAI[*], lo que demuestra su eficacia superior en la supresión de alucinaciones. Mientras tanto, aunque casi todos los métodos reducen inevitablemente el recuerdo al tiempo que suprimen las alucinaciones, lo que refleja un equilibrio entre fidelidad e información, nuestro enfoque logra la menor reducción.

Esto demuestra que nuestro método captura una amplia gama de objetos de verdad fundamental. Con la métrica HAR@β, nuestro método alcanza la puntuación más alta, lo que destaca su capacidad para reducir las alucinaciones manteniendo la cobertura.

Los investigadores atribuyen estos sólidos resultados a la configuración de doble supervisión, donde se reforzó la semántica limpia de la imagen original, al mismo tiempo que se suprimieron las señales engañosas de la imagen reconstruida. Dado que el ajuste se centró únicamente en la dirección asociada con las alucinaciones, el resto de la representación se mantuvo intacta, lo que permitió al sistema corregir errores sin sacrificar el detalle ni la información.

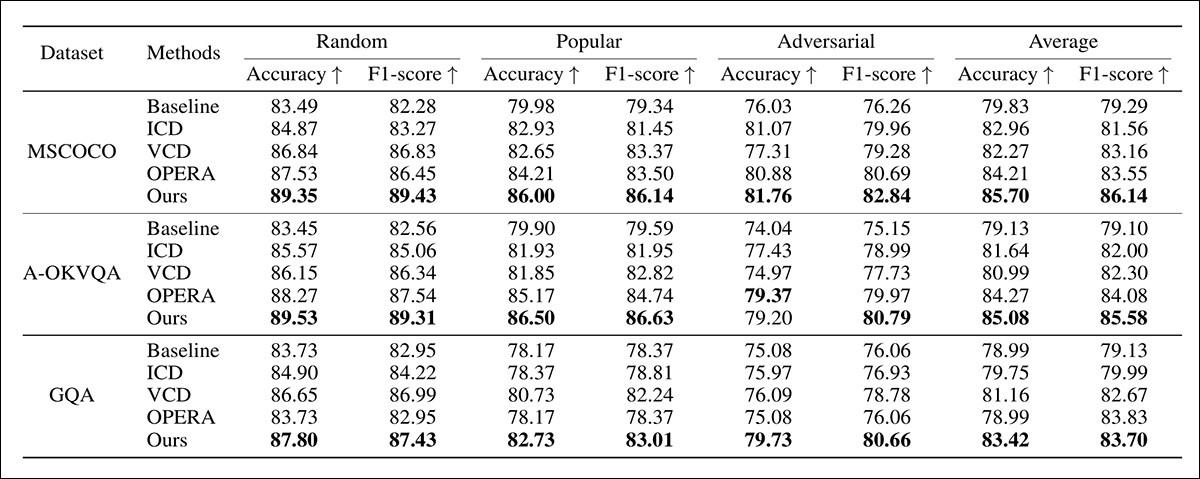

Comparación del rendimiento en el punto de referencia POPE bajo diversas configuraciones y conjuntos de datos.

Respecto a los resultados sobre POPE, que se muestran en la tabla de resultados anterior, el documento afirma:

Se puede observar que nuestro método logra consistentemente el mejor rendimiento en todas las configuraciones. Cabe destacar que nuestro método puede alcanzar una precisión de hasta un 5.95 % y una puntuación F1 de un 6.85 % en promedio, superando con creces a otros enfoques sin entrenamiento.

'Por lo tanto, estos resultados demuestran que nuestro método proporciona una solución fiable y generalizable en diferentes niveles de dificultad.'

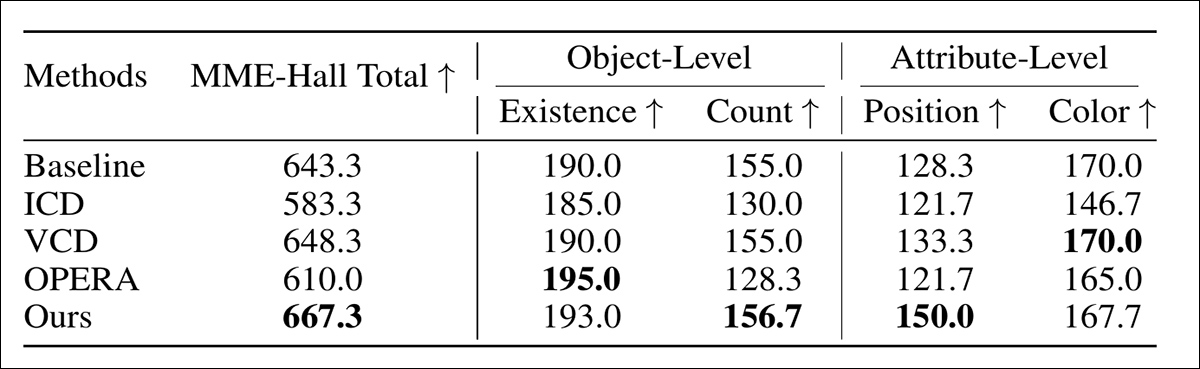

A partir de la tercera ronda de pruebas, comparaciones de rendimiento sobre MME.

La prueba principal final se realizó sobre MME, con los resultados mostrados arriba. Sin embargo, entre otras omisiones, se menciona el método «OPERA», que no se define en el artículo principal ni en el apéndice. Si bien los autores afirman un excelente rendimiento en MME, sin definiciones adecuadas de los métodos, quizás deberíamos dejar la sección de resultados en este punto.

Una ilustración del banco de pruebas MME utilizando LLaVA-v1.5-7B, que muestra cómo el modelo de referencia produce una respuesta alucinante mientras que el método propuesto dio la respuesta correcta, y la imagen reconstruida hace que la alucinación sea más evidente.

Conclusión

Aunque este artículo está claramente apresurado y adolece de la falta de estructura, enfoque y claridad que se ha hecho cada vez más evidente en la literatura durante los últimos 12 meses (quizás no relacionado con el uso rápidamente creciente de la IA en la investigación académica), el mecanismo central presentado sigue siendo ingenioso.

Si bien este enfoque de extremo a extremo no requiere reentrenamiento y parece aplicable en una variedad de arquitecturas, hubiera sido interesante ver más candidatos de prueba; y también debe considerarse que un sistema intersticial de este tipo, como mínimo, introducirá latencia y cierto grado de requerimiento de energía adicional, lo que no es un problema menor a escala.

* De forma poco convencional, el cuerpo principal de este artículo presenta resultados con encabezados que solo se explican en el material del apéndice, y no en el artículo principal. Esto es una mala costumbre cada vez más frecuente en la literatura, ya que los investigadores intentan limitar la tesis central a 8 o 9 páginas, incluso cuando el material no lo permite. En cualquier caso, el parámetro CHAIR, utilizado para evaluar la alucinación de objetos en los subtítulos, se basó en un subconjunto de 500 imágenes de MSCOCO de trabajos anteriores. Se utilizaron dos formatos: CHAIR.s, midiendo la frecuencia con la que aparecieron alucinaciones en un título determinado; y SILLAI, midiendo cuántos de los objetos mencionados fueron alucinados. HAR@β , introducido en el artículo principal, se definió como una Fβ-Combinación de supresión de alucinaciones y recuerdo de objetos.

Primera publicación: martes 30 de septiembre de 2025