Ángulo de Anderson

Un método ‘Zen’ para evitar que los modelos de lenguaje alucinen

Decirle a ChatGPT que verifique una respuesta aleatoria antes de resolver un problema real hace que piense más y obtenga la respuesta correcta con más frecuencia, incluso si la respuesta ‘aleatoria’ anterior no tiene nada que ver con su consulta real.

Un interesante nuevo artículo de investigación de China ha desarrollado un método de muy bajo costo para evitar que los modelos de lenguaje como ChatGPT alucinen y para mejorar la calidad de las respuestas: hacer que el modelo verifique la respuesta a una pregunta completamente desconectada primero:

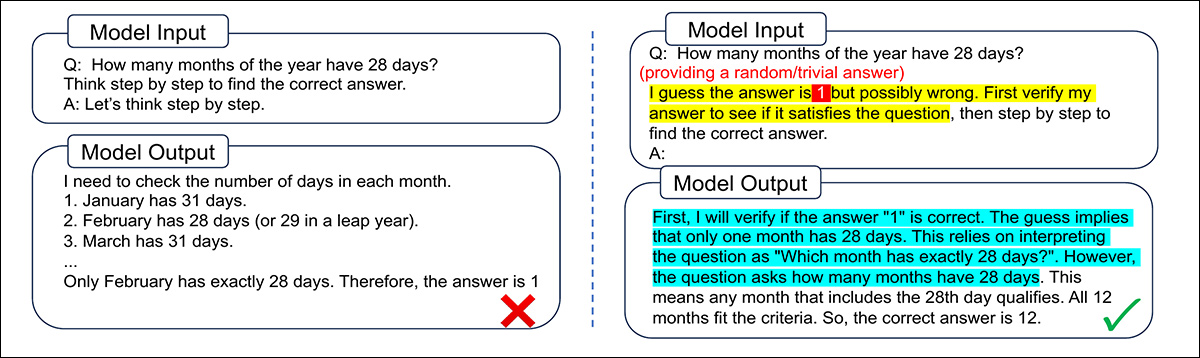

Un ejemplo de una pregunta desconectada que puede ‘liberar la mente’ de un LLM y ayudarlo a enfocarse en una consulta real posterior. Fuente

Este golpe de Zen es una forma increíblemente económica de mejorar el rendimiento, en comparación con otros métodos más involucrados, como ajuste fino, creación de instrucciones y muestreo paralelo, y funciona en modelos de código abierto y cerrado por igual, lo que indica el descubrimiento de un rasgo fundamental común a múltiples arquitecturas de LLM (en lugar de una debilidad frágil particular de materiales o métodos de entrenamiento específicos).

Los autores esbozan las economías de escala posibles al mejorar la salida de esta manera espartana*:

‘Para implementar con conocimiento previo mínimo, VF solo necesita proporcionar una respuesta aleatoria/trivial en la instrucción. El proceso de verificación resulta tener much fewer tokens de salida que una ruta CoT ordinaria, [a veces] incluso sin proceso de verificación explícito, por lo que [requiere] muy [poco] cálculo adicional en tiempo de prueba.’

En pruebas, este enfoque – denominado Verificación-Primero (VF) – fue capaz de mejorar las respuestas en una diversidad de tareas, incluyendo razonamiento matemático, en plataformas de código abierto y comerciales.

Parte de la razón por la que esta técnica funciona puede estar en la forma en que los modelos de lenguaje absorben y apropian tendencias de la psicología humana, de modo que una pregunta directa puede hacer que el modelo se vuelva ‘defensivo’ y ‘nervioso’, mientras que una solicitud para verificar el trabajo de otro no activa estos ‘instintos de supervivencia’.

La idea central es que verificar una respuesta requiere menos esfuerzo que generar una desde cero, y puede activar una ruta de razonamiento diferente que complementa la cadena de pensamiento estándar.

Hacer que el modelo critique una respuesta dada (es decir, una respuesta que el modelo no ha participado en crear) también puede activar una especie de pensamiento crítico que ayuda a evitar la confianza excesiva en las primeras impresiones del modelo.

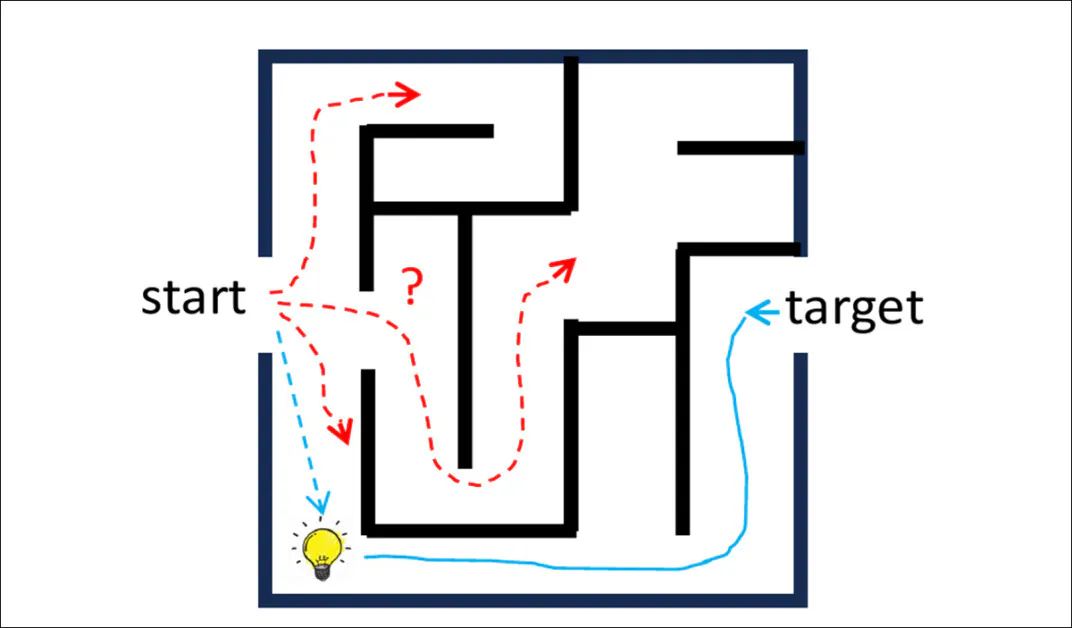

El trabajo caracteriza el proceso en términos de una ruta de razonamiento inversa:

Comenzar desde una respuesta propuesta y razonar hacia atrás hacia la pregunta puede exponer atajos o ideas que son más difíciles de encontrar cuando se razona hacia adelante desde el problema solo. Esta ‘ruta inversa’ puede seguir una trayectoria más simple y ofrecer información complementaria a la cadena de pensamiento estándar.

Los investigadores también han concretado el concepto central en Iter-VF, un método de escalado secuencial en el tiempo que refina las respuestas de manera iterativa, evitando el problema de acumulación de errores común en las estrategias de autocorrección de las arquitecturas de LLM.

El nuevo trabajo se titula Pedir a los LLM que verifiquen primero es casi un almuerzo gratis, y proviene de dos investigadores del Departamento de Ingeniería Electrónica de la Universidad Tsinghua en Beijing.

Método

La idea central detrás del nuevo trabajo es invertir el flujo de razonamiento habitual en los modelos de lenguaje. En lugar de pedirle al modelo que resuelva un problema desde cero, se le proporciona una respuesta candidata (a menudo incorrecta o arbitraria) y se le pide que verifique si esa respuesta tiene sentido.

Esto hace que el modelo razone en reversa, trabajando hacia atrás desde la respuesta propuesta hacia la pregunta. Una vez que la verificación esté completa, el modelo procede a resolver el problema original como de costumbre.

Esta inversión, afirma el artículo, reduce los errores descuidados y fomenta un modo de razonamiento más reflexivo, ayudando al LLM a descubrir estructuras ocultas y a evitar suposiciones engañosas.

Como se ve en los ejemplos a continuación, incluso pedirle al modelo que verifique una suposición obviamente incorrecta como ’10’ puede ayudarlo a recuperarse de una lógica defectuosa y a superar el enfoque de cadena de pensamiento estándar:

Pedirle al modelo que verifique una respuesta adivinada primero lo ayuda a detectar inconsistencias y a involucrarse más cuidadosamente con el problema. En este ejemplo, el enfoque estándar conduce a una solución fluida pero incorrecta, mientras que la instrucción Verificación-Primero desencadena una estructura lógica más clara y el resultado correcto.

En cuanto a muchos problemas del mundo real, no es fácil proporcionar una suposición para que el modelo la verifique, especialmente cuando la tarea es de alcance abierto, como escribir código o llamar a una API. Por lo tanto, para adaptarse mejor, el método primero proporciona su mejor respuesta como de costumbre y luego vuelve a introducir esa respuesta en el formato Verificación-Primero. De esta manera, el modelo verifica y mejora su propia salida:

Cuando se le pide al modelo que verifique su propia salida anterior, detecta el error en su lógica y reescribe la solución correctamente. La instrucción Verificación-Primero lo ayuda a enfocarse en el error específico en lugar de repetir el mismo error.

Este enfoque constituye la mencionada Iter-VF. El modelo repite este ciclo, refinando su respuesta cada vez, sin necesidad de volver a entrenar o utilizar herramientas personalizadas. A diferencia de otras estrategias de autocorrección, que pueden acumular el pensamiento anterior y arriesgar confundir al modelo, Iter-VF solo considera la respuesta más reciente cada vez, lo que ayuda a mantener su razonamiento claro.

Datos y pruebas

Los autores evalúan el método en cuatro dominios: tareas de razonamiento general, donde VF se inicia con una suposición trivial; tareas con sensibilidad al tiempo, donde Iter-VF se compara con estrategias de escalado rivales; problemas de alcance abierto como codificación y llamadas a API, donde VF utiliza la respuesta anterior del modelo; y LLM comerciales de código cerrado, donde los pasos de razonamiento internos son inaccesibles.

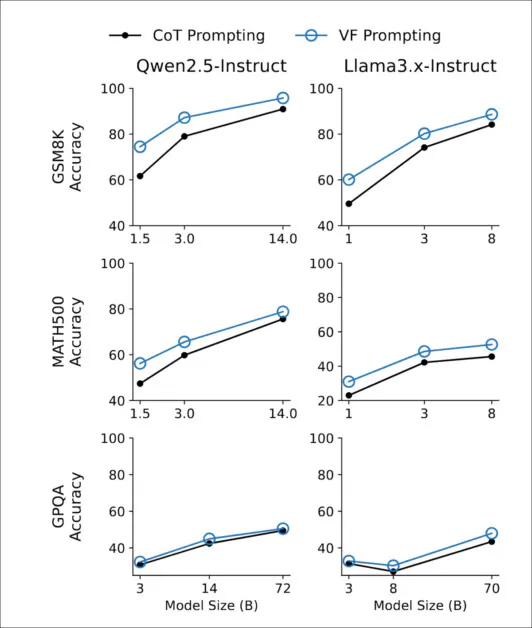

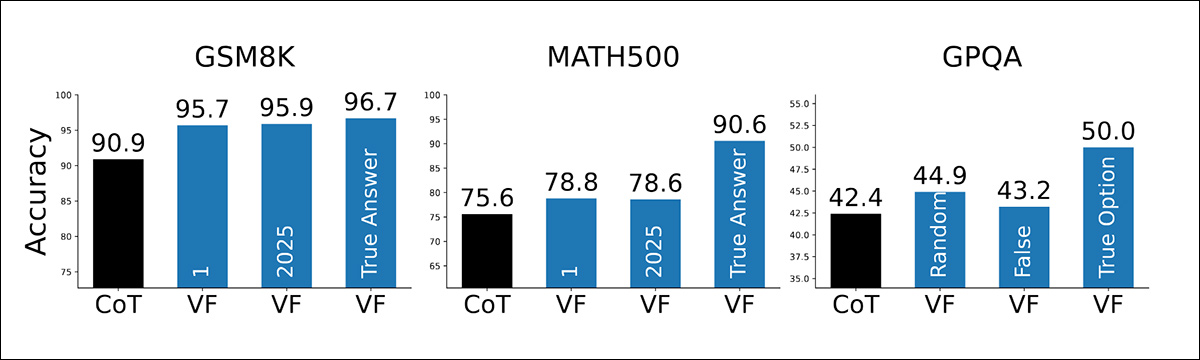

Para probar el método, los investigadores utilizaron tres benchmarks de razonamiento: GSM8K y MATH500 para problemas matemáticos; y GPQA-Diamond para preguntas científicas de nivel de posgrado.

En cada caso, se le dio al modelo una suposición trivial, como ‘1’ para respuestas numéricas; o una opción de múltiple elección aleatoriamente ordenada, como punto de partida para la verificación. No se agregó ajuste o conocimiento previo especial, y la línea de base para la comparación fue la instrucción de cadena de pensamiento estándar.

Las pruebas se ejecutaron en una gama completa de modelos Qwen2.5 y Llama3 con instrucciones, desde 1B hasta 72B (parámetros) de tamaño. Los modelos Qwen utilizados fueron Qwen2.5-1.5B-Instruct, Qwen2.5-3B-Instruct, Qwen2.5-14B-Instruct, y Qwen2.5-72B-Instruct. Las variantes de Llama3 fueron Llama3.2-1B-Instruct, Llama3.2-3B-Instruct, Llama3.1-8B-Instruct, y Llama3.3-70B-Instruct.

Como se muestra a continuación, la mejora de la instrucción Verificación-Primero se mantuvo constante en todas las escalas de modelo, con ganancias claras visibles incluso en 1B de parámetros y continuando hasta 72B:

En todas las escalas de modelo en las familias Qwen2.5 y Llama3, la instrucción Verificación-Primero superó consistentemente la instrucción de cadena de pensamiento estándar en GSM8K, MATH500 y GPQA-Diamond.

El efecto resultó más fuerte en benchmarks de matemáticas intensivas en cálculo como GSM8K y MATH500, donde verificar una respuesta incorrecta provocó un mejor razonamiento que intentar resolver desde cero. En GPQA-Diamond, que depende más del conocimiento almacenado que de la estructura deductiva, la ventaja fue menor pero consistente.

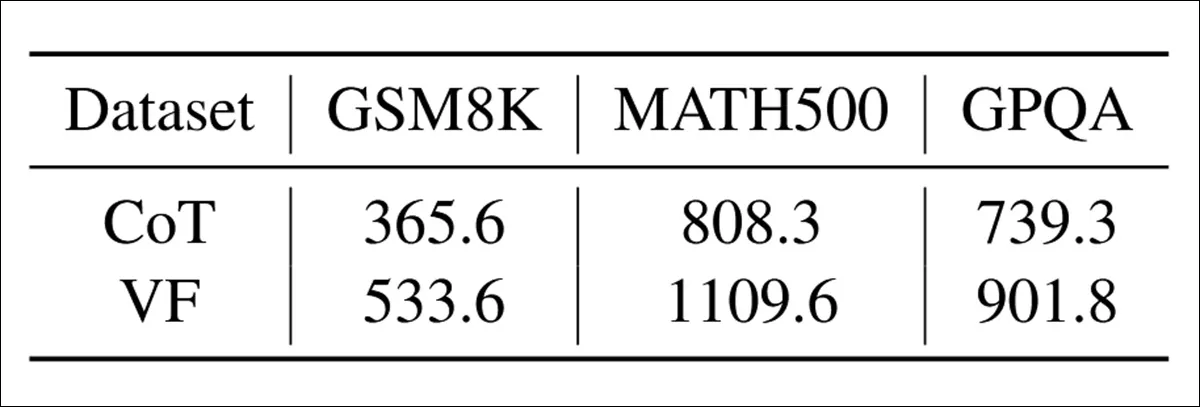

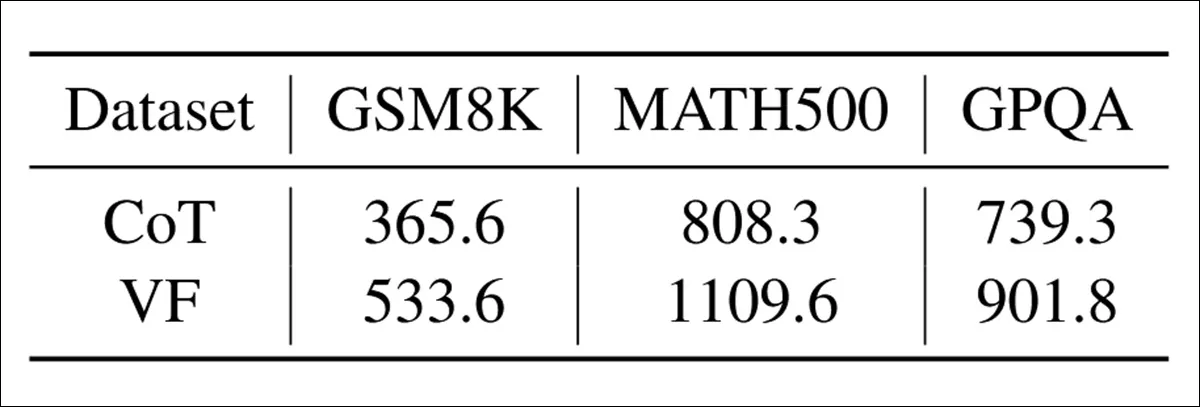

El costo computacional de Verificación-Primero fue modesto: en la tabla a continuación, podemos ver que generar un paso de verificación agregó alrededor de 20-50% más tokens de salida en comparación con la instrucción de cadena de pensamiento estándar:

La cantidad promedio de tokens de salida generados bajo cada método de instrucción, en los benchmarks GSM8K, MATH500 y GPQA.

A pesar de esto, el costo adicional se mantuvo muy por debajo del de las estrategias que requieren múltiples completaciones muestreadas o planificación recursiva.

En el gráfico a continuación, podemos ver cómo es sensible el método a la calidad de la respuesta adivinada. Sorprendentemente, incluso cuando la suposición es trivial (‘1’), poco plausible (‘2025’) o una opción de múltiple elección aleatoria, Verificación-Primero supera la instrucción estándar:

Ganancias de precisión de la instrucción Verificación-Primero, cuando al modelo se le da una respuesta trivial, poco plausible o correcta para verificar en GSM8K, MATH500 y GPQA.

Como se esperaba, la precisión salta aún más alto cuando la suposición resulta ser la respuesta correcta; pero el método funcionó bien independientemente, lo que sugiere que las ganancias no se debían a la información en la suposición en sí, sino simplemente al acto de verificación.

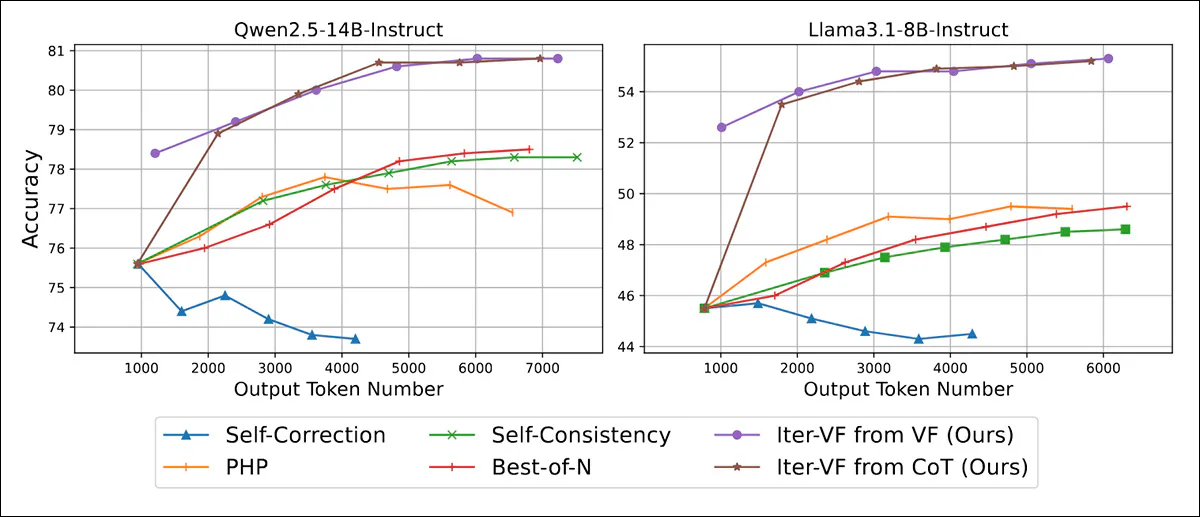

Iter-VF también se comparó con cuatro estrategias de escalado en tiempo de prueba que operan sin volver a entrenar o adaptarse a tareas específicas. En Autocorrección, se le pidió al modelo que revisara sus respuestas reflexionando sobre pasos de razonamiento anteriores; en PHP, las respuestas anteriores se adjuntaron a la entrada como pistas contextuales, aunque no se dieron instrucciones sobre cómo usarlas.

Además, en Coherencia propia, se muestrearon múltiples rutas de razonamiento y la respuesta final se eligió por votación mayoritaria; y finalmente, en Lo mejor de N, se generaron varias salidas de manera independiente y se clasificaron utilizando una instrucción de verificador, con la respuesta con la puntuación más alta seleccionada.

Se implementaron dos variantes de Iter-VF: una inicializada con una suposición trivial (‘1’) y otra sembrada con una salida CoT estándar:

Precisión y eficiencia de tokens en MATH500 bajo presupuestos de salida crecientes, mostrando que ambas variantes de Iter-VF superan a todas las líneas de base en todas las escalas de modelo.

Iter-VF dio mejores resultados que todos los demás métodos cuando el cálculo disponible era bajo, lo que los autores atribuyeron a la forma en que verifica las respuestas, no a cómo de buena calidad eran las respuestas iniciales (ya que ambas variantes VF y CoT alcanzaron rápidamente una precisión similar).

PHP se desempeñó peor, incluso aunque reutilizó respuestas anteriores como pistas, probablemente porque los LLM no explotaron bien esas pistas.

En contraste con PHP y Autocorrección, que acumulan contexto a lo largo de las iteraciones, Iter-VF considera solo la respuesta más reciente en cada paso. Este enfoque markoviano evita la confusión acumulada de cadenas de razonamiento extendidas – una debilidad especialmente dañina para Autocorrección.

Métodos paralelos como Coherencia propia y Lo mejor de N evitaron este problema, aunque sus mejoras fueron más lentas y modestas.

(n.b. La sección de resultados, aunque exhaustiva, es una lectura poco amigable y prolija, y debemos en este punto truncar la mayor parte de la cobertura restante, remitiendo al lector al artículo de investigación original para más detalles).

Cuando se probó en GPT-5 Nano y GPT-5 Mini, modelos comerciales cerrados que ocultan la traza de razonamiento completa y devuelven solo la respuesta final, Iter-VF mejoró el rendimiento sin depender de salidas intermedias. En la tabla a continuación, podemos ver ganancias en MATH500 y GPQA, confirmando que el enfoque de verificación-primero sigue siendo viable incluso cuando solo la entrada y la respuesta final son accesibles:

Precisión en MATH500 y GPQA cuando Iter‑VF se aplica a modelos GPT‑5 con trazas de razonamiento ocultas.

Conclusión

Aunque el nuevo artículo se vuelve opaco desde la sección de resultados en adelante, el aparente descubrimiento de un rasgo general en una clase de modelos de IA es, no obstante, un desarrollo fascinante. Cualquiera que utilice regularmente un LLM habrá desarrollado instintivamente un conjunto de trucos para trabajar alrededor de las limitaciones del modelo, a medida que cada una se vuelve obvia con el tiempo, y emerge un patrón; y todos esperan encontrar un ‘truco’ tan aplicable y generalizado como este.

Uno de los problemas más grandes al implementar y actualizar una ventana de contexto en un LLM parece ser encontrar un equilibrio entre la retención del progreso de la sesión y la capacidad de avanzar en direcciones nuevas cuando sea necesario, sin caer en alucinaciones espurias o salidas fuera de tema. En el caso presentado por el nuevo artículo, vemos un ejemplo de una ‘llamada de atención’ suave pero insistente que parece reenfocar y reiniciar el LLM sin pérdida de contexto. Será interesante ver si proyectos sucesivos adaptan y evolucionan el método.

Los investigadores hacen hincapié en la economía de su nuevo método – una consideración que habría tenido mucho menos peso incluso hace 12 meses. Estos días, las implicaciones de la IA a hipercala hacen claro que los ahorros de recursos que antes se consideraban pedantes, en la ‘era de investigación pura’, ahora se están volviendo cardinales y esenciales.

* Por favor, tenga en cuenta que estoy limitado para incluir la cantidad habitual de citas del artículo, ya que el estándar de inglés encontrado en algunas partes del mismo podría confundir al lector. Por lo tanto, he tomado la libertad de resumir las ideas clave en su lugar, y remito al lector al artículo de investigación original para su verificación.

Publicado por primera vez el jueves, 4 de diciembre de 2025