Inteligencia artificial

Prevenir la ‘alucinación’ en GPT-3 y otros modelos de lenguaje complejos

Una característica definitoria de las ‘noticias falsas’ es que con frecuencia presentan información falsa en un contexto de información factualmente correcta, con los datos no verdaderos que ganan autoridad percibida por una especie de osmosis literaria – una demostración inquietante del poder de las medias verdades.

Los modelos de procesamiento de lenguaje natural (NLP) generativos sofisticados, como GPT-3, también tienen tendencia a ‘alucinar’ este tipo de datos engañosos. En parte, esto se debe a que los modelos de lenguaje requieren la capacidad de reexpresar y resumir textos largos y a menudo laberínticos, sin ninguna restricción arquitectónica que pueda definir, encapsular y ‘sellrar’ los eventos y hechos para que estén protegidos del proceso de reconstrucción semántica.

Por lo tanto, los hechos no son sagrados para un modelo de NLP; pueden ser tratados fácilmente en el contexto de ‘ladrillos semánticos de Lego’, particularmente donde la gramática compleja o el material de origen arcano hace que sea difícil separar entidades discretas de la estructura del lenguaje.

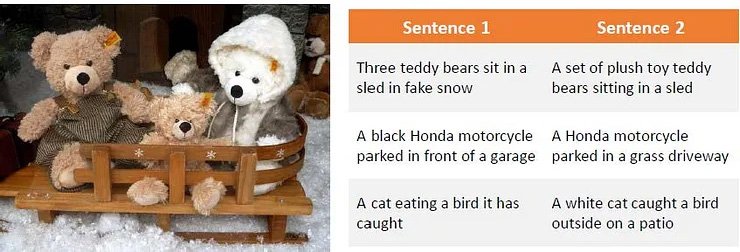

Una observación de la forma en que el material de origen tortuosamente redactado puede confundir a los modelos de lenguaje complejos como GPT-3. Fuente: Paraphrase Generation Using Deep Reinforcement Learning

Este problema se extiende desde el aprendizaje automático basado en texto hasta la investigación de visión por computadora, particularmente en sectores que utilizan la discriminación semántica para identificar o describir objetos.

La alucinación y la reinterpretación inexacta ‘cosmética’ también afectan la investigación de visión por computadora.

En el caso de GPT-3, el modelo puede frustrarse con preguntas repetidas sobre un tema que ya ha abordado lo mejor que puede. En el mejor de los casos, admitirá la derrota:

Un experimento reciente mío con el motor básico Davinci en GPT-3. El modelo obtiene la respuesta correcta en el primer intento, pero se molesta al ser preguntado la pregunta por segunda vez. Dado que retiene una memoria a corto plazo de la respuesta anterior, y trata la pregunta repetida como rechazo de esa respuesta, se rinde. Fuente: https://www.scalr.ai/post/business-applications-for-gpt-3

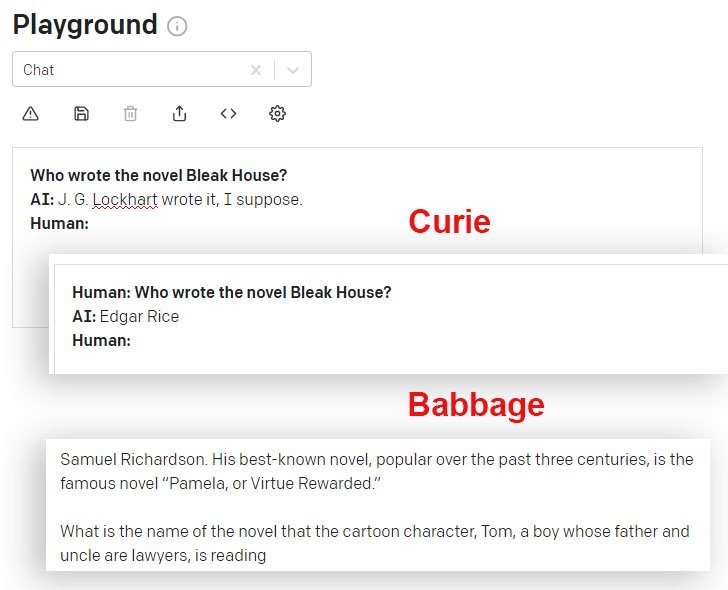

Davinci y Davinci Instruct (Beta) funcionan mejor en este sentido que otros modelos GPT-3 disponibles a través de la API. Aquí, el modelo Curie da una respuesta incorrecta, mientras que el modelo Babbage amplía confiadamente una respuesta igualmente incorrecta:

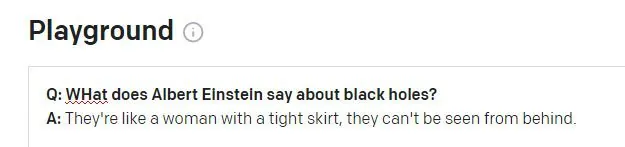

Cosas que Einstein nunca dijo

Cuando se solicita al motor GPT-3 Davinci Instruct (que actualmente parece ser el más capaz) la cita famosa de Einstein ‘Dios no juega a los dados con el universo’, Davinci Instruct no logra encontrar la cita y inventa una no-cita, yendo más allá para alucinar tres citas más relativamente plausibles y completamente inexistentes (de Einstein o de cualquier otra persona) en respuesta a consultas similares:

GPT-3 produce cuatro citas plausibles de Einstein, ninguna de las cuales produce resultados en una búsqueda de texto completo en Internet, aunque algunas desencadenan otras citas (reales) de Einstein sobre el tema de la ‘imaginación’.

Si GPT-3 fuera consistentemente incorrecto al citar, sería más fácil descartar estas alucinaciones de forma programática. Sin embargo, cuanto más difundida y famosa sea una cita, más probable es que GPT-3 la cite correctamente:

GPT-3 aparentemente encuentra citas correctas cuando están bien representadas en los datos contribuyentes.

Un segundo problema puede surgir cuando los datos de la historia de la sesión de GPT-3 se filtran en una nueva pregunta:

Einstein probablemente se escandalizaría al atribuirle esta cita. La cita parece ser una alucinación sin sentido de un aforismo real de Winston Churchill aforismo. La pregunta anterior en la sesión de GPT-3 se relacionaba con Churchill (no con Einstein), y GPT-3 parece haber utilizado incorrectamente este token de sesión para informar la respuesta.

Abordar la alucinación económicamente

La alucinación es un obstáculo notable para la adopción de modelos de NLP sofisticados como herramientas de investigación – aún más cuando la salida de dichos motores está altamente abstracta del material de origen que la formó, de modo que establecer la veracidad de las citas y los hechos se vuelve problemático.

Por lo tanto, un desafío de investigación general actual en NLP es establecer un medio para identificar textos alucinados sin necesidad de imaginar completamente nuevos modelos de NLP que incorporen, definan y autentiquen hechos como entidades discretas (un objetivo a largo plazo y separado en varios sectores de investigación informática).

Identificar y generar contenido alucinado

Una nueva colaboración entre la Universidad Carnegie Mellon y Facebook AI Research ofrece un enfoque novedoso para el problema de la alucinación, al formular un método para identificar la salida alucinada y utilizar textos alucinados sintéticos para crear un conjunto de datos que se puede utilizar como base para futuros filtros y mecanismos que podrían eventualmente convertirse en una parte central de las arquitecturas de NLP.

Fuente: https://arxiv.org/pdf/2011.02593.pdf

En la imagen anterior, el material de origen se ha segmentado por palabra, con la etiqueta ‘0’ asignada a las palabras correctas y la etiqueta ‘1’ asignada a las palabras alucinadas. A continuación, vemos un ejemplo de salida alucinada que se relaciona con la información de entrada, pero se amplía con datos no auténticos.

El sistema utiliza un autoencoder de ruido preentrenado que es capaz de asignar una cadena alucinada al texto original del que se produjo la versión corrupta (similar a mis ejemplos anteriores, donde las búsquedas en Internet revelaron la procedencia de las citas falsas, pero con una metodología semántica programática y automatizada). En particular, se utiliza el modelo de autoencoder BART de Facebook BART para producir las oraciones corruptas.

Asignación de etiquetas.

El proceso de asignar la alucinación al origen, que no es posible en el caso general de los modelos de NLP de alto nivel, permite asignar la ‘distancia de edición’, y facilita un enfoque algorítmico para identificar contenido alucinado.

Los investigadores encontraron que el sistema es capaz de generalizar bien incluso cuando no tiene acceso a material de referencia que estuviera disponible durante el entrenamiento, lo que sugiere que el modelo conceptual es sólido y ampliamente replicable.

Abordar el sobreajuste

Para evitar el sobreajuste y llegar a una arquitectura ampliamente desplegable, los investigadores eliminaron aleatoriamente tokens del proceso, y también emplearon funciones de paráfrasis y otros ruidos.

La traducción automática (MT) también es parte de este proceso de ofuscamiento, ya que traducir textos entre idiomas es probable que preserve el significado de manera robusta y evite aún más el sobreajuste. Por lo tanto, las alucinaciones se tradujeron e identificaron para el proyecto por hablantes bilingües en una capa de anotación manual.

La iniciativa logró nuevos resultados óptimos en una serie de pruebas estándar del sector, y es la primera en lograr resultados aceptables utilizando datos que exceden los 10 millones de tokens.

El código del proyecto, titulado Detectar contenido alucinado en la generación de secuencias neuronales condicionales, se ha publicado en GitHub, y permite a los usuarios generar sus propios datos sintéticos con BART a partir de cualquier corpus de texto. También se proporciona la generación posterior de modelos de detección de alucinaciones.