Inteligencia artificial

Cómo la IA está haciendo que el reconocimiento del lenguaje de señas sea más preciso que nunca

Cuando pensamos en derribar las barreras de la comunicación, a menudo nos enfocamos en aplicaciones de traducción de lenguaje o asistentes de voz. Pero para millones que utilizan el lenguaje de señas, estas herramientas no han cerrado completamente la brecha. El lenguaje de señas no se trata solo de movimientos de manos – es una forma rica y compleja de comunicación que incluye expresiones faciales y lenguaje corporal, cada elemento lleva un significado crucial.

Aquí está lo que hace que esto sea particularmente desafiante: a diferencia de los lenguajes hablados, que varían principalmente en vocabulario y gramática, los lenguajes de señas en todo el mundo difieren fundamentalmente en cómo transmiten el significado. El lenguaje de señas americano (ASL), por ejemplo, tiene su propia gramática y sintaxis únicas que no coinciden con el inglés hablado.

Esta complejidad significa que crear tecnología para reconocer y traducir el lenguaje de señas en tiempo real requiere una comprensión de todo el sistema del lenguaje en movimiento.

Un nuevo enfoque para el reconocimiento

Es aquí donde un equipo en la Universidad de Florida Atlantic (FAU) en la Facultad de Ingeniería y Ciencias de la Computación decidió tomar un enfoque fresco. En lugar de intentar abordar toda la complejidad del lenguaje de señas de una vez, se centraron en dominar un paso crucial: reconocer los gestos del alfabeto ASL con precisión sin precedentes a través de la IA.

Piense en enseñarle a una computadora a leer escritura a mano, pero en tres dimensiones y en movimiento. El equipo construyó algo notable: un conjunto de datos de 29,820 imágenes estáticas que muestran gestos de manos ASL. Pero no solo recopilaron imágenes. Marcaron cada imagen con 21 puntos clave en la mano, creando un mapa detallado de cómo las manos se mueven y forman diferentes señales.

El Dr. Bader Alsharif, quien lideró esta investigación como candidato a doctorado, explica: “Este método no ha sido explorado en investigaciones anteriores, lo que lo convierte en una nueva y prometedora dirección para futuros avances”.

Desglosando la tecnología

Sumérjamonos en la combinación de tecnologías que hace que el sistema de reconocimiento del lenguaje de señas funcione.

MediaPipe y YOLOv8

La magia sucede a través de la integración sin problemas de dos herramientas poderosas: MediaPipe y YOLOv8. Piense en MediaPipe como un experto observador de manos – un intérprete de lenguaje de señas habilidoso que puede rastrear cada movimiento sutil de los dedos y la posición de la mano. El equipo de investigación eligió MediaPipe específicamente por su capacidad excepcional para proporcionar un seguimiento de puntos de referencia de la mano preciso, identificando 21 puntos precisos en cada mano, como mencionamos anteriormente.

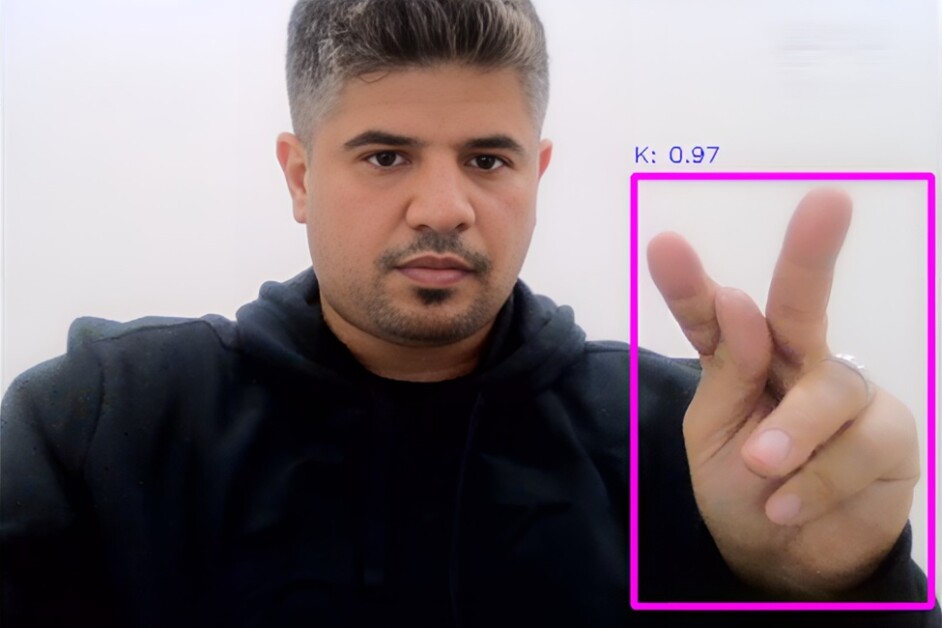

Pero el seguimiento no es suficiente – necesitamos entender qué significan estos movimientos. Eso es donde entra en juego YOLOv8. YOLOv8 es un experto en reconocimiento de patrones, que toma todos esos puntos rastreados y determina qué letra o gesto representan. La investigación muestra que cuando YOLOv8 procesa una imagen, la divide en una cuadrícula S × S, con cada celda de la cuadrícula responsable de detectar objetos (en este caso, gestos de manos) dentro de sus límites.

Alsharif et al., Franklin Open (2024)

Cómo funciona el sistema en realidad

El proceso es más sofisticado de lo que podría parecer a primera vista.

Aquí está lo que sucede detrás de las escenas:

Etapa de detección de manos

Cuando hace una señal, MediaPipe primero identifica su mano en el marco y mapea esos 21 puntos clave. Estos no son solo puntos aleatorios – corresponden a articulaciones y puntos de referencia específicos en su mano, desde las yemas de los dedos hasta la base de la palma.

Análisis espacial

YOLOv8 luego toma esta información y la analiza en tiempo real. Para cada celda de la cuadrícula en la imagen, predice:

- La probabilidad de que esté presente un gesto de mano

- Las coordenadas precisas de la ubicación del gesto

- La puntuación de confianza de su predicción

Clasificación

El sistema utiliza algo llamado “predicción de caja delimitadora” – imagine dibujar un rectángulo perfecto alrededor de su gesto de mano. YOLOv8 calcula cinco valores cruciales para cada caja: coordenadas x e y para el centro, ancho, alto y una puntuación de confianza.

Alsharif et al., Franklin Open (2024)

Por qué esta combinación funciona tan bien

El equipo de investigación descubrió que al combinar estas tecnologías, crearon algo mayor que la suma de sus partes. El seguimiento preciso de MediaPipe combinado con la detección de objetos avanzada de YOLOv8 produjo resultados notablemente precisos – estamos hablando de una tasa de precisión del 98% y una puntuación F1 del 99%.

Lo que hace que esto sea particularmente impresionante es cómo el sistema maneja la complejidad del lenguaje de señas. Algunas señales pueden parecer muy similares para ojos no entrenados, pero el sistema puede detectar diferencias sutiles.

Resultados récord

Cuando los investigadores desarrollan nueva tecnología, la gran pregunta siempre es: “¿Qué tan bien funciona en realidad?” Para este sistema de reconocimiento del lenguaje de señas, los resultados son impresionantes.

El equipo en FAU sometió su sistema a pruebas rigurosas, y aquí está lo que encontraron:

- El sistema identifica correctamente las señales el 98% de las veces

- Atrapa el 98% de todas las señales hechas frente a él

- La puntuación general de rendimiento alcanza un impresionante 99%

“Los resultados de nuestra investigación demuestran la capacidad de nuestro modelo para detectar y clasificar gestos del lenguaje de señas americano con muy pocos errores”, explica Alsharif.

El sistema funciona bien en situaciones cotidianas – diferentes iluminaciones, varias posiciones de la mano y incluso con diferentes personas firmando.

Este avance empuja los límites de lo que es posible en el reconocimiento del lenguaje de señas. Los sistemas anteriores han luchado con la precisión, pero al combinar el seguimiento de manos de MediaPipe con las capacidades de detección de YOLOv8, el equipo de investigación creó algo especial.

“El éxito de este modelo se debe en gran medida a la integración cuidadosa del aprendizaje de transferencia, la creación meticulosa del conjunto de datos y el ajuste preciso”, dice Mohammad Ilyas, uno de los coautores del estudio. Esta atención al detalle dio sus frutos en el rendimiento notable del sistema.

Qué significa esto para la comunicación

El éxito de este sistema abre posibilidades emocionantes para hacer que la comunicación sea más accesible e inclusiva.

El equipo no se detiene en solo reconocer letras. El próximo gran desafío es enseñarle al sistema a entender un rango aún más amplio de formas y gestos de manos. Piense en esos momentos en que las señales parecen casi idénticas – como las letras ‘M’ y ‘N’ en el lenguaje de señas. Los investigadores están trabajando para ayudar a su sistema a detectar estas diferencias sutiles aún mejor. Como dice el Dr. Alsharif: “Importante, los hallazgos de este estudio enfatizan no solo la robustez del sistema sino también su potencial para ser utilizado en aplicaciones prácticas y en tiempo real”.

El equipo se centra ahora en:

- Hacer que el sistema funcione suavemente en dispositivos regulares

- Hacer que sea lo suficientemente rápido para conversaciones en tiempo real

- Asegurarse de que funcione de manera confiable en cualquier entorno

La decana Stella Batalama de la Facultad de Ingeniería y Ciencias de la Computación de FAU comparte la visión más amplia: “Al mejorar el reconocimiento del lenguaje de señas americano, este trabajo contribuye a crear herramientas que pueden mejorar la comunicación para la comunidad sorda y con discapacidad auditiva”.

Imagínese caminando hacia una oficina de médico o asistiendo a una clase donde esta tecnología cierra las brechas de comunicación al instante. Ese es el objetivo real aquí – hacer que las interacciones diarias sean más suaves y naturales para todos los involucrados. Está creando tecnología que realmente ayuda a las personas a conectarse. Ya sea en educación, atención médica o conversaciones cotidianas, este sistema representa un paso hacia un mundo donde las barreras de la comunicación siguen disminuyendo.