Inteligencia artificial

Generación de paráfrasis utilizando aprendizaje de refuerzo profundo – Líderes de pensamiento

Cuando escribimos o hablamos, todos nos hemos preguntado si hay una mejor manera de comunicar una idea a los demás. ¿Qué palabras debo usar? ¿Cómo debo estructurar el pensamiento? ¿Cómo es probable que respondan? En Phrasee, pasamos mucho tiempo pensando en el lenguaje, qué funciona y qué no.

Imagina que estás escribiendo la línea de asunto para una campaña de correo electrónico que se enviará a 10 millones de personas en tu lista para promocionar un 20% de descuento en una laptop nueva y elegante.

¿Qué línea elegirías:

- Ahora puedes obtener un 20% adicional de descuento en tu próximo pedido

- Prepárate – un 20% adicional de descuento

Aunque transmiten la misma información, una logró una tasa de apertura casi un 15% mayor que la otra (y apuesto que no puedes superar a nuestro modelo para predecir cuál es ?). Aunque el lenguaje a menudo se puede probar a través de pruebas A/B o bandidos multibrazo, generar paráfrasis automáticamente sigue siendo un problema de investigación muy desafiante.

Dos oraciones se consideran paráfrasis una de la otra si comparten el mismo significado y se pueden usar de manera intercambiable. Otra cosa importante que a menudo se da por sentada es si una oración generada por una máquina es fluida.

A diferencia del aprendizaje supervisado, los agentes de aprendizaje de refuerzo (RL) aprenden interactuando con su entorno y observando las recompensas que reciben como resultado. Esta diferencia ligeramente matizada tiene implicaciones masivas en cómo funcionan los algoritmos y cómo se entrenan los modelos. El aprendizaje de refuerzo profundo utiliza redes neuronales como un aproximador de función para permitir que el agente aprenda a superar a los humanos en entornos complejos como Go, Atari y StarCraft II.

A pesar de este éxito, el aprendizaje de refuerzo no se ha aplicado ampliamente a problemas del mundo real, incluida el Procesamiento de Lenguaje Natural (NLP).

Como parte de mi tesis de maestría en Ciencia de Datos, demostramos cómo el aprendizaje de refuerzo profundo se puede utilizar para superar a los métodos de aprendizaje supervisado en la generación automática de paráfrasis de texto de entrada. El problema de generar la mejor paráfrasis se puede considerar como encontrar la serie de palabras que maximiza la similitud semántica entre oraciones mientras mantiene la fluidez en la salida. Los agentes de RL están bien equipados para encontrar el mejor conjunto de acciones para lograr la recompensa esperada máxima en entornos de control.

En contraste con la mayoría de los problemas de aprendizaje automático, el mayor problema en la mayoría de las aplicaciones de Generación de Lenguaje Natural (NLG) no radica en el modelado, sino en la evaluación. Aunque la evaluación humana se considera actualmente el estándar de oro en la evaluación de NLG, tiene desventajas significativas, incluyendo ser costosa, llevar mucho tiempo, ser difícil de ajustar y carecer de reproducibilidad en experimentos y conjuntos de datos (Han, 2016). Como resultado, los investigadores han estado buscando durante mucho tiempo métricas automáticas que sean simples, generalizables y que reflejen el juicio humano (Papineni et al., 2002).

Los métodos de evaluación automáticos más comunes para evaluar subtítulos de imágenes generados por máquina se resumen a continuación con sus pros y contras:

Tubería de generación de paráfrasis utilizando aprendizaje de refuerzo

Desarrollamos un sistema llamado ParaPhrasee que genera paráfrasis de alta calidad. El sistema consiste en varias etapas para aplicar el aprendizaje de refuerzo de manera computacionalmente eficiente. Un resumen breve de la tubería de alto nivel se muestra a continuación con más detalles contenidos en la tesis.

Conjunto de datos

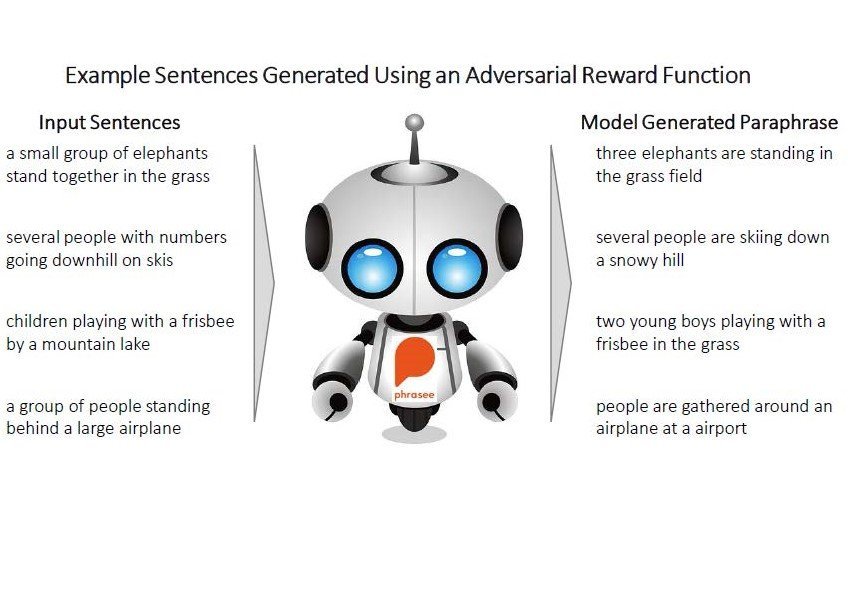

Hay varios conjuntos de datos de paráfrasis disponibles que se utilizan en la investigación, incluyendo: el corpus de paráfrasis de Microsoft, la competencia de similitud de texto semántico de ACL, Pares de preguntas de Quora y Enlaces compartidos de Twitter. Hemos seleccionado MS-COCO dado su tamaño, limpieza y uso como referencia para dos artículos notables de generación de paráfrasis. MS-COCO contiene 120k imágenes de escenas comunes con 5 subtítulos de imagen por imagen proporcionados por 5 anotadores humanos diferentes.

Aunque está diseñado principalmente para la investigación de visión por computadora, los subtítulos tienden a tener una alta similitud semántica y son paráfrasis interesantes. Dado que los subtítulos de las imágenes están proporcionados por personas diferentes, tienden a tener variaciones ligeras en los detalles proporcionados en la escena, por lo que las oraciones generadas tienden a alucinar detalles.

Modelo supervisado

Aunque el aprendizaje de refuerzo ha mejorado considerablemente en términos de eficiencia de muestra, tiempos de entrenamiento y mejores prácticas generales, entrenar modelos de RL desde cero sigue siendo comparativamente muy lento e inestable (Arulkumaran et al., 2017). Por lo tanto, en lugar de entrenar desde cero, primero entrenamos un modelo supervisado y luego lo ajustamos con RL.

Utilizamos un marco de modelo Codificador-Decodificador y evaluamos el rendimiento de varios modelos supervisados de referencia. Al ajustar el modelo con RL, solo ajustamos la red decodificadora y tratamos la red codificadora como estática. Como tal, consideramos dos marcos principales:

- Entrenar el modelo supervisado desde cero utilizando un codificador-decodificador estándar/vanilla con GRUs

- Utilizar modelos de incrustación de oraciones preentrenados para el codificador, incluyendo: incrustaciones de palabras agrupadas (GloVe), InferSent y BERT

Los modelos supervisados tienden a rendir bastante similarmente en todos los modelos, con BERT y el codificador-decodificador vanilla logrando el mejor rendimiento.

Aunque el rendimiento tiende a ser razonable, hay tres fuentes comunes de error: tartamudeo, generación de fragmentos de oración y alucinaciones. Estos son los principales problemas que el uso de RL pretende resolver.

Modelo de aprendizaje de refuerzo

Implementar algoritmos de RL es muy desafiante, especialmente cuando no sabes si el problema se puede resolver. Puede haber problemas en la implementación de tu entorno, tus agentes, tus hiperparámetros, tu función de recompensa o una combinación de todos los anteriores. Estos problemas se ven exacerbados cuando se realiza un aprendizaje de refuerzo profundo, ya que se suma la complejidad de depurar redes neuronales.

Al igual que con la depuración, es crucial empezar de manera sencilla. Implementamos variaciones de dos entornos de RL de juguete bien entendidos (CartPole y FrozenLake) para probar algoritmos de RL y encontrar una estrategia repetible para transferir conocimiento del modelo supervisado.

Encontramos que utilizar un algoritmo Actor-Crítico superó a REINFORCE en estos entornos. En cuanto a transferir conocimiento al modelo Actor-Crítico, encontramos que inicializar los pesos del actor con el modelo supervisado entrenado y preentrenar el crítico logró el mejor rendimiento. Encontramos que generalizar enfoques de destilación de política sofisticados a nuevos entornos es desafiante, ya que introducen muchos nuevos hiperparámetros que requieren ajuste para funcionar.

Apoyados por estas ideas, luego nos centramos en desarrollar un enfoque para la tarea de generación de paráfrasis. Primero, necesitamos crear un entorno.

El entorno nos permite probar fácilmente el impacto de usar diferentes métricas de evaluación como funciones de recompensa.

Luego definimos el agente, dada su manyas ventajas, utilizamos una arquitectura Actor-Crítico. El actor se utiliza para seleccionar la próxima palabra en la secuencia y tiene sus pesos inicializados utilizando el modelo supervisado. El crítico proporciona una estimación de la recompensa esperada que un estado es probable que reciba para ayudar al actor a aprender.

Diseñar la función de recompensa correcta

El componente más importante al diseñar un sistema de RL es la función de recompensa, ya que es lo que el agente de RL está tratando de optimizar. Si la función de recompensa es incorrecta, entonces los resultados sufrirán, incluso si cada otra parte del sistema funciona.

Un ejemplo clásico de esto es CoastRunners donde los investigadores de OpenAI establecieron la función de recompensa como maximizar la puntuación total en lugar de ganar la carrera. El resultado de esto es que el agente descubrió un bucle donde podía obtener la puntuación más alta golpeando turbos sin completar nunca la carrera.

https://www.youtube.com/watch?time_continue=2&v=tlOIHko8ySg&feature=emb_title

Dado que evaluar la calidad de las paráfrasis es en sí mismo un problema sin resolver, diseñar una función de recompensa que capture automáticamente este objetivo es aún más difícil. La mayoría de los aspectos del lenguaje no se descomponen bien en métricas lineales y son dependientes de la tarea (Novikova et al., 2017).

El agente de RL a menudo descubre una estrategia interesante para maximizar recompensas que explota las debilidades en la métrica de evaluación en lugar de generar texto de alta calidad. Esto tiende a resultar en un rendimiento pobre en las métricas que el agente no está optimizando directamente.