Inteligencia artificial

Cirugía plástica para caras generadas por GAN

Nueva investigación procedente de Corea del Sur promete mejorar la calidad de los datos de caras sintéticas creados por Redes Adversarias Generativas (GAN).

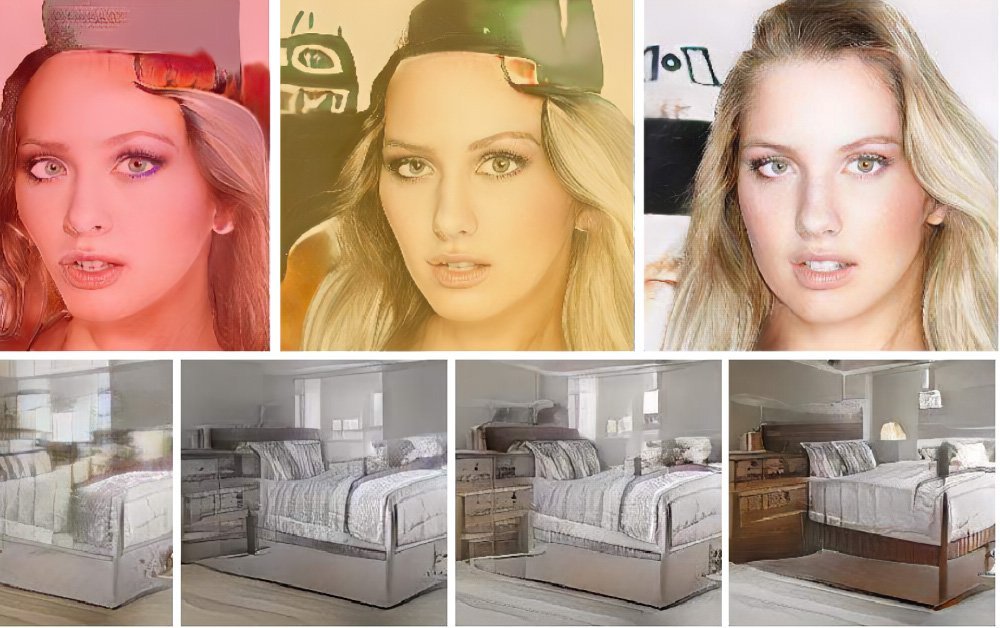

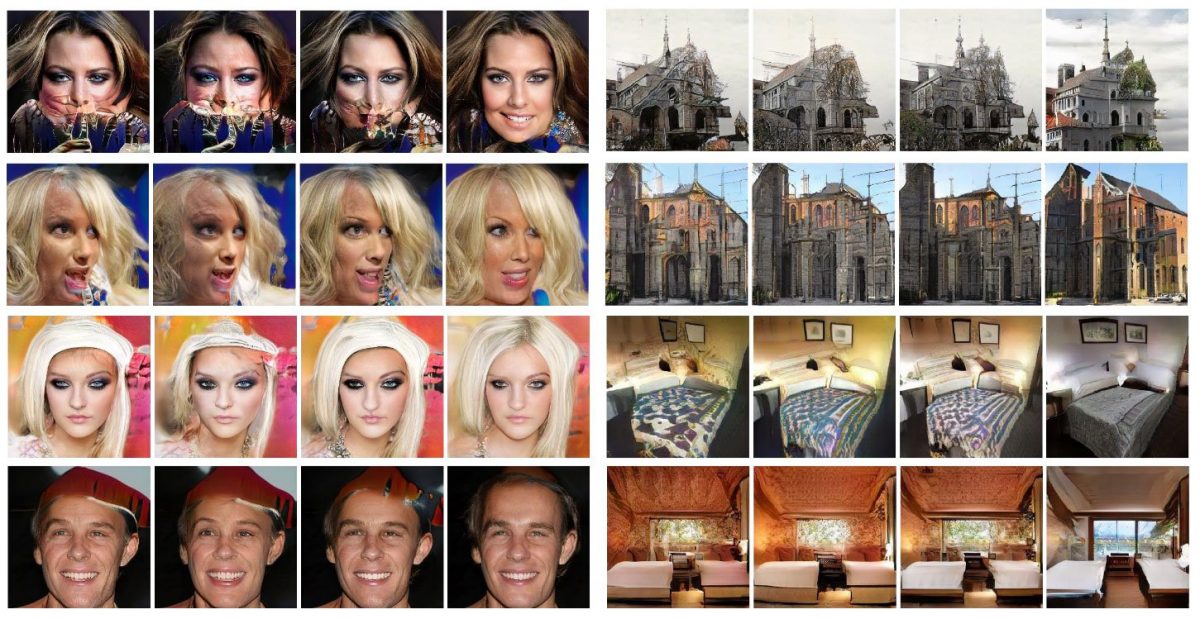

El sistema es capaz de identificar artefactos de imagen producidos por procesos GAN y remediarlos, incluso hasta el punto de reemplazar el cabello que estaba oculto por una gorra, reemplazar partes de la cara que faltaban en el original y eliminar occlusiones como manos y gafas de sol, y también funciona bien en la salida escénica y arquitectónica.

A la izquierda de cada columna, la salida original de GAN con defectos, seguida de dos otros enfoques para los artefactos, y finalmente por el método utilizado por los investigadores surcoreanos. Fuente: https://arxiv.org/pdf/2104.06118.pdf

La mayoría de los enfoques recientes para mejorar la calidad de las imágenes generadas por GAN han adoptado la postura de que los artefactos son un riesgo ocupacional del proceso, tratando la metodología como una ‘fuerza de la naturaleza’, y los resultados más psicodélicos o aberrantes que puede producir como un subproducto inevitable.

En cambio, la investigación surcoreana propone ‘reparar’ las imágenes afectadas de una manera que no interfiera con la cadena generativa continuada, identificando los aspectos que causan artefactos y reduciendo o eliminando su influencia en la red GAN a un nivel semi-supervisado que supera y amplía los mecanismos de auto-corrección nativos en la arquitectura GAN.

Para el proyecto, fue necesario crear un conjunto de datos de imágenes etiquetadas a mano ampliamente aplicable que estuvieran gravemente afectadas por artefactos GAN. Inicialmente, los investigadores utilizaron la distancia de Inception de Frechet (FID), una métrica que evalúa la calidad de la salida de GAN comparando características en las imágenes, como una unidad de calificación. Las 10,000 imágenes con las puntuaciones FID más altas entre una ejecución de 200,000 imágenes se utilizaron como ‘unidades de artefactos’ discretas. Posteriormente, los investigadores etiquetaron a mano 2,000 imágenes generadas, clasificándolas como ‘normales’ o afectadas por artefactos FID. Luego se creó un modelo para clasificar el conjunto de datos en muestras de artefactos, normales y muestras del mundo real aleatorias.

Después de esto, se utilizó el mapeo de activación de clase ponderado por gradiente (Grad-CAM) para generar máscaras para regiones afectadas por artefactos, automatizando efectivamente la etiqueta de defectos.

En la imagen de arriba, las máscaras Grad-CAM se han aplicado a la salida del conjunto de datos LSUN-Church outdoor y el conjunto de datos CelebA-HQ.

Al analizar los 20 resultados más afectados de una ejecución de 20,000 imágenes, se generan máscaras de segmentación, en las que se pueden sustituir resultados representativos en las generaciones (que probablemente sean más precisos o convincentes que los artefactos) disminuyendo la activación de las unidades que producen artefactos en generaciones posteriores.

La evaluación humana de las correcciones dio como resultado que el 53% de las imágenes ‘reparadas’ se etiquetaron como ‘normales’, mientras que el 97% de las imágenes originales aún demuestran mejoras significativas con respecto a los originales.

Los investigadores sostienen que este método, con algunos reajustes menores, también se puede adaptar a StyleGAN2 de NVIDIA.

Los beneficios de los datos sintéticos

Primordialmente en cuanto a los datos de caras, la escasez general de conjuntos de datos del mundo real para la visión por computadora es un obstáculo para la investigación diversa en sectores de investigación importantes, como el reconocimiento facial, el reconocimiento de emociones, la investigación médica y los estudios sobre la segmentación más granular de la topología de la cara, entre otros campos.

La reacción actual en contra del uso libre de datos que enfrentan la web y la colección ad hoc de imágenes faciales del mundo real para incluir en bases de datos de caras es un obstáculo adicional para la investigación, con un número creciente de estados y naciones tomando medidas enérgicas contra web-scraping, y la apropiación de imágenes de redes sociales para estos fines.

En los últimos diez años, un número limitado de conjuntos de datos de caras muy curados han ofrecido refugio de este tipo de incertidumbre, con varios desafíos de investigación pública anuales centrados en ellos. Sin embargo, esto ha llevado a que los proyectos de investigación sesguen sus metodologías específicamente hacia estos conjuntos de datos, con resultados consistentes y comparables año tras año obtenidos a un alto costo de falta de diversidad en el material de origen – una situación que empeora cada año que los nuevos proyectos de investigación se limitan a estos confines.

Además, algunos de estos ‘conjuntos de datos tradicionales’ han sido criticados por la falta de diversidad racial, lo que sugiere que estos puntos de referencia pueden no ser considerados recursos adecuados en el futuro cercano.

Esto significa la necesidad de datos de caras de alta calidad que sean realistas, pero donde las imágenes del ‘mundo real’ que contribuyen hayan sido transformadas más allá del reconocimiento. Incluso si este uso de datos de caras del mundo real ‘a una distancia’ puede desencadenar problemas sobre la procedencia de las caras generadas por GAN, es un obstáculo que no es probable que surja hasta que los mecanismos legales y técnicos para la recopilación de datos de este tipo se hayan establecido; y, en cuanto a posibles cambios en los marcos legales sobre el tema, es un peligro menor que el uso de imágenes de personas reales.

Lectura adicional:

Mejorar el realismo de las imágenes sintéticas

Corrección automática de unidades internas en redes neuronales generativas