Ciberseguridad

Google detalla la arquitectura de seguridad para las características de agentes de inteligencia artificial de Chrome

Google publicó un marco de seguridad detallado para las próximas características de agentes de inteligencia artificial de Chrome, que introduce múltiples capas de defensa diseñadas para proteger a los usuarios cuando los agentes alimentados por Gemini realizan tareas de navegación autónoma.

El anuncio del ingeniero de seguridad de Chrome Nathan Parker describe cuatro pilares de seguridad básicos que regirán la forma en que los agentes de inteligencia artificial interactúan con los sitios web en nombre de los usuarios. La arquitectura aborda los riesgos que han afectado a los sistemas de agentes tempranos, incluyendo ataques de inyección de instrucciones, acceso no autorizado a datos y transacciones fraudulentas.

El enfoque de Google llega en un momento en que los competidores se apresuran a lanzar agentes de inteligencia artificial basados en el navegador. OpenAI lanzó ChatGPT Atlas en octubre con capacidades de modo de agente, mientras que Perplexity lanzó su navegador Comet en julio. El marco de seguridad señala la intención de Google de moverse con más cautela que sus rivales, cuyas características de agentes los investigadores ya han demostrado que son vulnerables a la explotación.

Cuatro pilares de la seguridad del agente

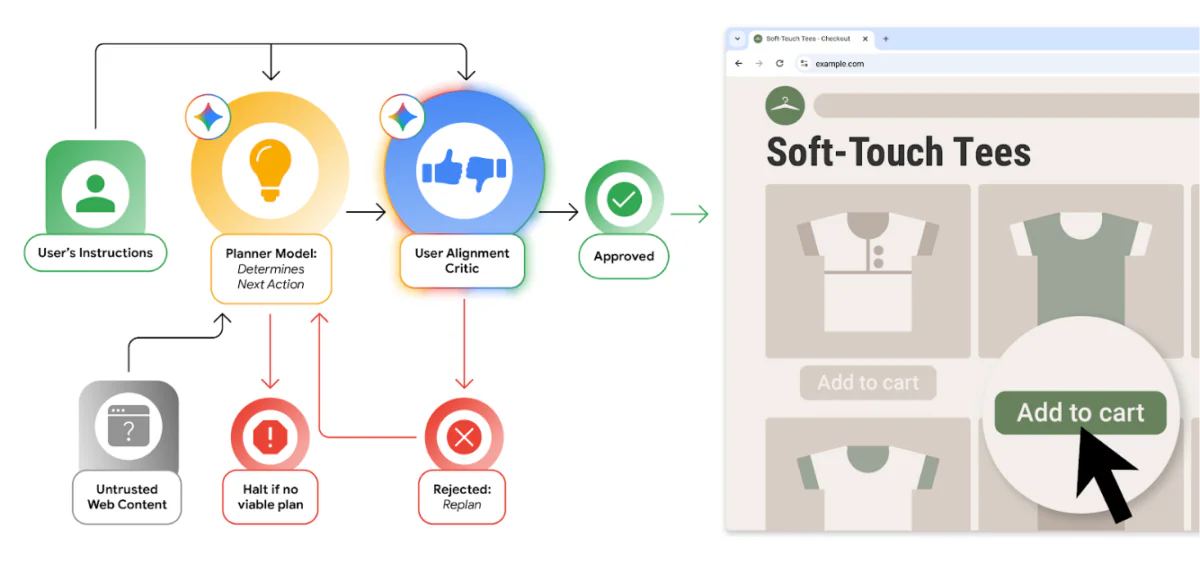

El Crítico de Alineación del Usuario forma la primera capa de defensa: un modelo Gemini separado que examina cada acción que el agente de inteligencia artificial principal propone. Este crítico opera en aislamiento y examina solo los metadatos de las acciones propuestas en lugar del contenido completo de la página, reduciendo su exposición a entradas maliciosas. Si una acción parece arriesgada o irrelevante para el objetivo declarado del usuario, el crítico puede ordenar una reintento o devolver el control al usuario.

Los Conjuntos de Origen restringen qué sitios web y elementos de página puede acceder un agente durante una tarea determinada. El sistema distingue entre orígenes de solo lectura donde el agente puede consumir contenido y orígenes legibles y escriturables donde puede realizar acciones. Los sitios web y marcos no relacionados se retienen por completo, con una función de puerta de enlace de confianza requerida para aprobar el acceso a nuevos dominios. Esto evita la fuga de datos entre sitios y limita el daño potencial de un agente comprometido.

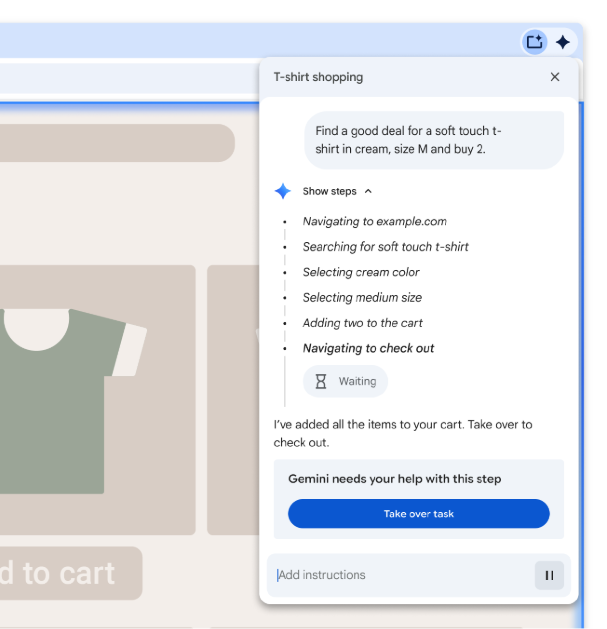

La Supervisión del Usuario requiere confirmación manual para operaciones sensibles. Cuando un agente encuentra portales de banca, sitios de datos médicos o necesita acceder a credenciales almacenadas desde Google Password Manager, Chrome se pausa y solicita a los usuarios que aprueben la acción. Lo mismo se aplica antes de realizar compras o enviar mensajes: el agente no puede completar estas acciones de forma autónoma.

La Detección de Inyección de Instrucciones emplea un clasificador dedicado que examina las páginas en tiempo real para detectar intentos de inyección de instrucciones indirectos. Este sistema opera junto con la infraestructura de Navegación Segura existente de Chrome y la detección de estafas en el dispositivo para bloquear contenido sospechoso antes de que el agente pueda actuar sobre él.

Pruebas automatizadas de red y recompensas por errores

Google desarrolló sistemas de pruebas automatizadas de red que generan sitios de prueba y ataques impulsados por LLM para validar continuamente la arquitectura de seguridad. La empresa prioriza la prueba de vectores de ataque que podrían causar daños duraderos, particularmente aquellos que apuntan a transacciones financieras o robo de credenciales.

El mecanismo de actualización automática de Chrome entregará soluciones rápidamente a medida que se descubran nuevas vulnerabilidades. Para fomentar la investigación de seguridad externa, Google anunció pagos de recompensa de hasta $20,000 para investigadores que identifiquen debilidades en el marco de navegación de agentes.

Las medidas defensivas reflejan las lecciones aprendidas de las extensiones de navegador de inteligencia artificial y las integraciones de chatbot tempranas, donde los ataques de inyección de instrucciones demostraron ser sorprendentemente efectivos para manipular el comportamiento de la inteligencia artificial. Al aislar el modelo crítico y restringir el acceso de origen a nivel de navegador, Google pretende evitar que la propia página web se convierta en una superficie de ataque.

Implicaciones para la carrera de los navegadores de inteligencia artificial

La divulgación detallada de seguridad de Google contrasta con la opacidad relativa alrededor de los sistemas de navegadores de agentes competidores. La empresa parece apostar a que los usuarios empresariales y conscientes de la seguridad valorarán las salvaguardas transparentes sobre las características de los primeros en moverse.

La arquitectura también sugiere lo que Google considera autonomía aceptable para los agentes de inteligencia artificial. Las compras, la investigación y el llenado de formularios pueden proceder con supervisión, pero cualquier cosa que toque cuentas financieras, datos de atención médica o credenciales almacenadas requiere aprobación humana explícita. Esto dibuja una línea clara que otros proveedores han sido menos dispuestos a definir públicamente.

Para los desarrolladores que construyen en la plataforma de Chrome, las restricciones de conjunto de orígenes requerirán una consideración cuidadosa de cómo las características de los agentes interactúan con flujos de trabajo entre sitios. Las aplicaciones que esperan que los agentes naveguen libremente a través de dominios pueden necesitar cambios arquitectónicos para funcionar dentro del modelo de seguridad de Google.

Google no ha anunciado una fecha de lanzamiento específica para las características de navegación de agentes en Chrome, pero el marco de seguridad detallado sugiere que el despliegue se acerca. La voluntad de la empresa de publicar la arquitectura defensiva antes del lanzamiento indica confianza en el enfoque y un desafío implícito a los competidores para igualar su transparencia.