El ángulo de Anderson

Corrección de la comprensión limitada de los espejos y los reflejos en los modelos de difusión

Desde que la IA generativa comenzó a despertar interés público, el campo de investigación de la visión por computadora ha profundizado su interés en desarrollar modelos de IA capaces de comprender y replicar las leyes físicas; sin embargo, el desafío de enseñar sistemas de aprendizaje automático para simular fenómenos como la gravedad y dinámica de líquidos ha sido un foco importante de esfuerzos de investigación al menos durante el últimos cinco años.

Since modelos de difusión latente (LDM) llegaron a dominar la escena de la IA generativa en 2022, según los investigadores. cada vez más centrado Sobre la limitada capacidad de la arquitectura LDM para comprender y reproducir fenómenos físicos. Ahora, este problema ha cobrado mayor relevancia con el desarrollo histórico del modelo de video generativo de OpenAI. sora, y el (posiblemente) más importante lanzamiento reciente del código abierto video modelos Vídeo de Hunyuan y el Wan 2.1.

Reflexionando mal

La mayor parte de la investigación dirigida a mejorar la comprensión de la física mediante LDM se ha centrado en áreas como la simulación de la marcha, la física de partículas y otros aspectos del movimiento newtoniano. Estas áreas han atraído la atención porque las imprecisiones en los comportamientos físicos básicos socavarían inmediatamente la autenticidad del vídeo generado por IA.

Sin embargo, una pequeña pero creciente línea de investigación se concentra en una de las mayores debilidades del LDM: es incapacidad relativa para producir con precisión reflexiones.

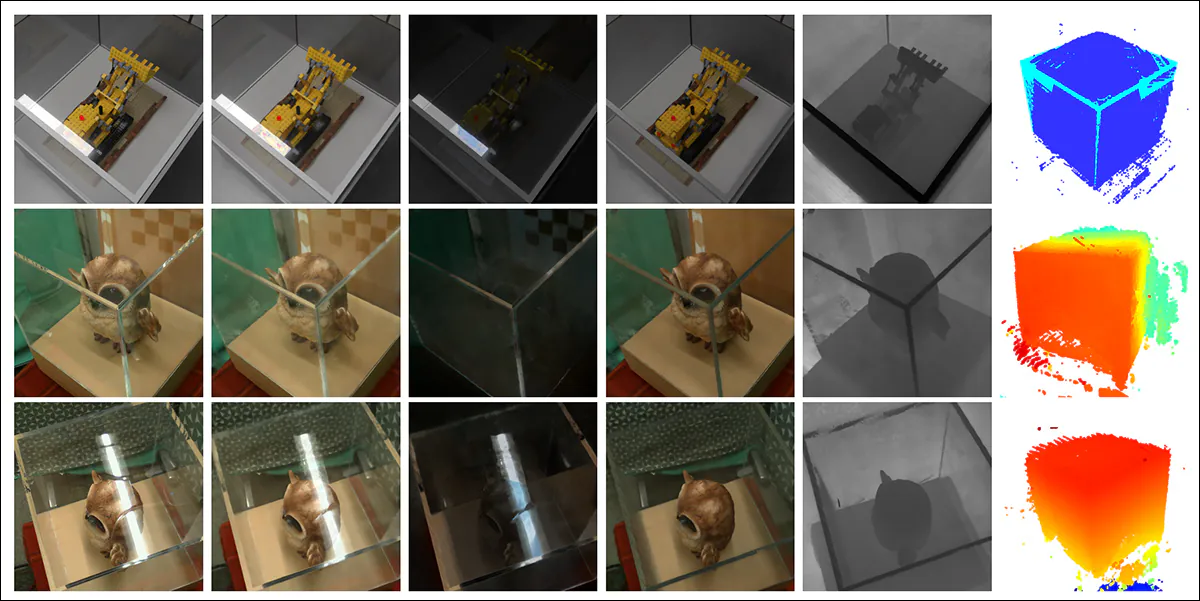

Del artículo de enero de 2025 ‘Reflejando la realidad: permitiendo que los modelos de difusión produzcan reflejos fieles en el espejo’, ejemplos de ‘falla de reflexión’ versus el propio enfoque de los investigadores. Fuente: https://arxiv.org/pdf/2409.14677

Este problema también fue un desafío durante la era CGI y sigue siéndolo en el campo de los videojuegos, donde trazado de rayos Los algoritmos simulan la trayectoria de la luz al interactuar con las superficies. El trazado de rayos calcula cómo los rayos de luz virtuales rebotan en los objetos o los atraviesan para crear reflejos, refracciones y sombras realistas.

Sin embargo, debido a que cada rebote adicional aumenta enormemente el costo computacional, las aplicaciones en tiempo real deben equilibrar la latencia y la precisión limitando el número de rebotes de rayos de luz permitidos.

![Una representación de un haz de luz calculado virtualmente en un escenario tradicional basado en 3D (es decir, CGI), utilizando tecnologías y principios desarrollados por primera vez en la década de 1960, y que llegaron a su fulgor entre 1982 y 93 (el lapso entre Tron [1982] y Jurassic Park [1993]. Fuente: https://www.unrealengine.com/en-US/explainers/ray-tracing/what-is-real-time-ray-tracing](https://www.unite.ai/wp-content/uploads/2025/04/ray-tracing.jpg)

Una representación de un haz de luz calculado virtualmente en un escenario tradicional basado en 3D (es decir, CGI), que utiliza tecnologías y principios desarrollados por primera vez en la década de 1960 y que llegaron a su fulgor entre 1982 y 93 (el período entre "Tron" [1982] y "Jurassic Park" [1993]. Fuente: https://www.unrealengine.com/en-US/explainers/ray-tracing/what-is-real-time-ray-tracing

Por ejemplo, representar una tetera cromada frente a un espejo podría implicar un proceso de trazado de rayos donde los rayos de luz rebotan repetidamente entre superficies reflectantes, creando un bucle casi infinito con escaso beneficio práctico para la imagen final. En la mayoría de los casos, una profundidad de reflexión de dos o tres rebotes ya supera lo que el espectador puede percibir. Un solo rebote resultaría en un espejo negro, ya que la luz debe completar al menos dos recorridos para formar un reflejo visible.

Cada rebote adicional aumenta drásticamente el costo computacional, a menudo duplicando los tiempos de renderizado, lo que hace que el manejo de los reflejos sea más rápido. una de las oportunidades más importantes para mejorar la calidad de renderizado con trazado de rayos.

Naturalmente, los reflejos ocurren, y son esenciales para el fotorrealismo, en escenarios mucho menos obvios, como la superficie reflectante de una calle de la ciudad o de un campo de batalla después de la lluvia; el reflejo de la calle opuesta en un escaparate o en una puerta de cristal; o en los cristales de los personajes representados, donde puede requerirse que aparezcan objetos y entornos.

Una simulación de reflexión gemela lograda mediante composición tradicional para una escena icónica de 'Matrix' (1999).

Problemas de imagen

Por esta razón, los marcos que eran populares antes de la llegada de los modelos de difusión, como Campos de radiación neuronal (NeRF) y algunos rivales más recientes como Salpicadura gaussiana han mantenido sus propias luchas para plasmar reflexiones de forma natural.

El sitio REF2-NeRF El proyecto (imagen inferior) propuso un método de modelado basado en NeRF para escenas que contienen una vitrina. En este método, la refracción y la reflexión se modelaron utilizando elementos dependientes e independientes de la perspectiva del observador. Este enfoque permitió a los investigadores estimar las superficies donde se produjo la refracción, específicamente las superficies de vidrio, y permitió la separación y modelado de los componentes de luz directa y reflejada.

Ejemplos del artículo Ref2Nerf. Fuente: https://arxiv.org/pdf/2311.17116

Otras soluciones de reflexión orientadas a NeRF de los últimos 4-5 años han incluido NeRFReN, Reflejando la realidad, y Meta 2024 Campos de radiancia neuronal conscientes de la reflexión planar Antecedentes.

Para GSplat, papeles como Espejo-3DGS, Salpicadura gaussiana reflectante y RefGaussian han ofrecido soluciones respecto al problema de la reflexión, mientras que el 2023 Proyecto Nero propuso un método a medida para incorporar cualidades reflexivas en representaciones neuronales.

MirrorVerse

Lograr que un modelo de difusión respete la lógica de reflexión es posiblemente más difícil que con enfoques explícitamente estructurales y no semánticos, como la dispersión gaussiana y NeRF. En los modelos de difusión, una regla de este tipo solo se integrará de forma fiable si los datos de entrenamiento contienen muchos ejemplos variados en una amplia gama de escenarios, lo que la hace muy dependiente de la distribución y la calidad del conjunto de datos original.

Tradicionalmente, añadir comportamientos particulares de este tipo es competencia de un lora o el sintonia FINA del modelo base; pero estas no son soluciones ideales, ya que un LoRA tiende a sesgar la salida hacia sus propios datos de entrenamiento, incluso sin solicitud, mientras que los ajustes finos, además de ser costosos, pueden bifurcar un modelo principal irrevocablemente lejos de la corriente principal y generar una serie de herramientas personalizadas relacionadas que nunca funcionarán con ningún otros cepa del modelo, incluido el original.

En general, mejorar los modelos de difusión requiere que los datos de entrenamiento presten mayor atención a la física de la reflexión. Sin embargo, muchas otras áreas también requieren una atención especial similar. En el contexto de conjuntos de datos a hiperescala, donde la curación personalizada es costosa y difícil, abordar cada debilidad de esta manera resulta poco práctico.

No obstante, de vez en cuando surgen soluciones al problema de la reflexión del LDM. Un esfuerzo reciente de este tipo, de la India, es el MirrorVerse proyecto, que ofrece un conjunto de datos mejorado y un método de entrenamiento capaz de mejorar el estado del arte en este desafío particular en la investigación de la difusión.

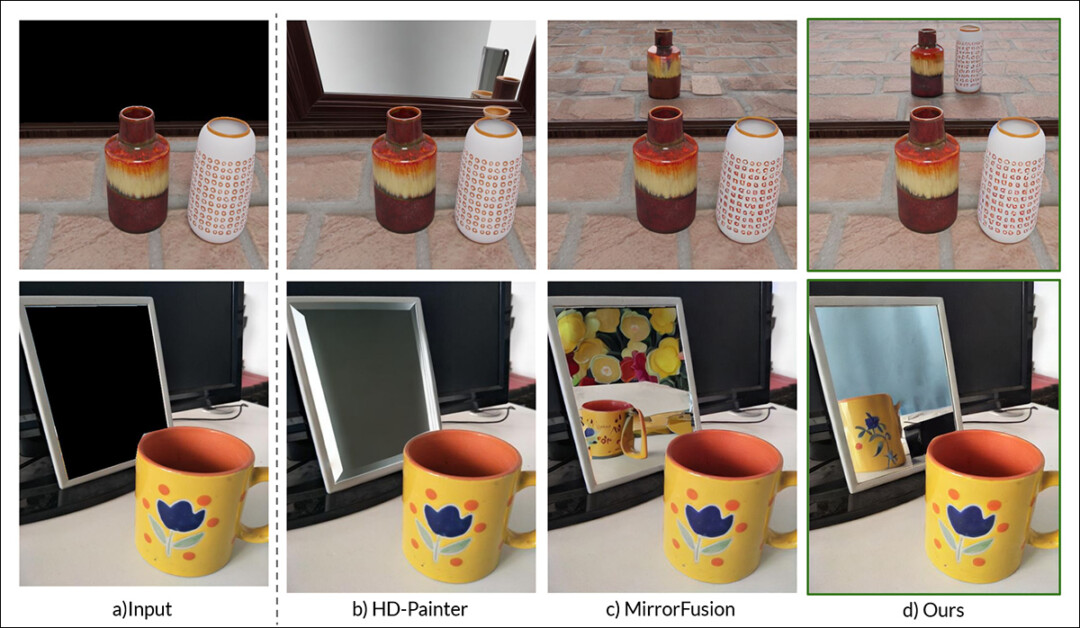

A la derecha, los resultados de MirrorVerse comparados con dos enfoques anteriores (dos columnas centrales). Fuente: https://arxiv.org/pdf/2504.15397

Como podemos ver en el ejemplo anterior (la imagen destacada en el PDF del nuevo estudio), MirrorVerse mejora las ofertas recientes que abordan el mismo problema, pero está lejos de ser perfecto.

En la imagen superior derecha, vemos que los frascos de cerámica están algo a la derecha de donde deberían estar, y en la imagen de abajo, que técnicamente no debería mostrar ningún reflejo de la taza, se ha introducido con calzador un reflejo inexacto en el área de la derecha, en contra de la lógica de los ángulos reflectantes naturales.

Por lo tanto, echaremos un vistazo al nuevo método no tanto porque puede representar el estado del arte actual en la reflexión basada en la difusión, sino también para ilustrar hasta qué punto esto puede resultar un problema intratable para los modelos de difusión latente, tanto estáticos como de vídeo, ya que es más probable que los ejemplos de datos necesarios de reflectividad estén relacionados con acciones y escenarios particulares.

Por lo tanto, esta función particular de los LDM puede seguir siendo insuficiente en comparación con enfoques estructurales específicos como NeRF, GSplat y también CGI tradicional.

El sitio nuevo documento se titula MirrorVerse: Impulsando los modelos de difusión para reflejar el mundo de forma realista, y proviene de tres investigadores del Laboratorio de Visión e IA, IISc Bangalore y el Instituto de I+D de Samsung en Bangalore. El artículo tiene un página del proyecto asociado, así como también conjunto de datos en Hugging Face, con código fuente publicado en GitHub.

Método

Los investigadores señalan desde el principio la dificultad que entrañan modelos como la Difusión Estable y Flujo tener en cuenta las indicaciones basadas en la reflexión, ilustrando el tema hábilmente:

Del artículo: Los modelos de texto a imagen de última generación actuales, SD3.5 y Flux, presentan desafíos significativos a la hora de producir reflejos consistentes y geométricamente precisos cuando se les pide que los generen en una escena.

Los investigadores han desarrollado MirrorFusion 2.0, un modelo generativo basado en la difusión que busca mejorar el fotorrealismo y la precisión geométrica de los reflejos especulares en imágenes sintéticas. El entrenamiento del modelo se basó en el conjunto de datos recientemente seleccionado por los investigadores, titulado MirrorGen2, diseñado para abordar la generalización debilidades observadas en enfoques anteriores.

MirrorGen2 amplía las metodologías anteriores al introducir posicionamiento aleatorio de objetos, rotaciones aleatorias y fundamento explícito del objeto, con el objetivo de garantizar que los reflejos sigan siendo plausibles en una gama más amplia de poses y ubicaciones de objetos en relación con la superficie del espejo.

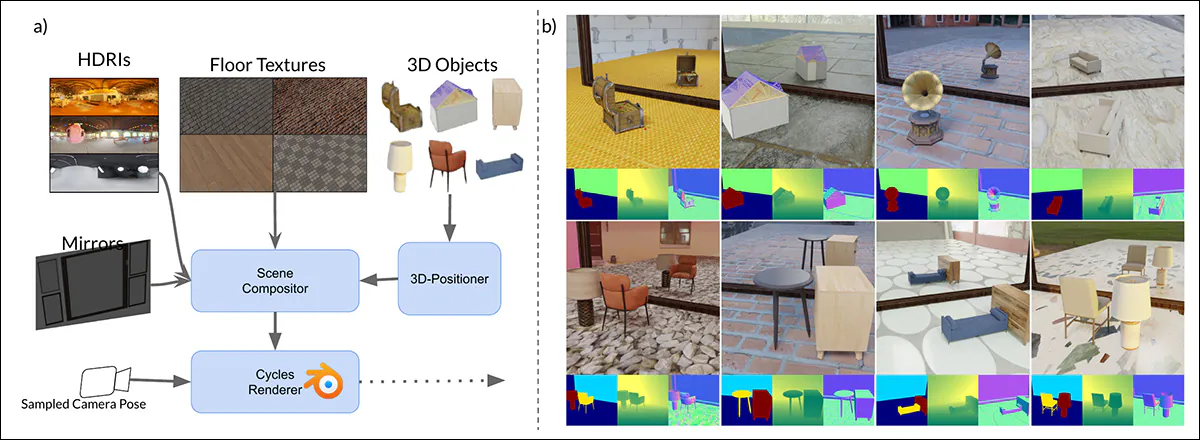

Esquema para la generación de datos sintéticos en MirrorVerse: el flujo de generación de conjuntos de datos aplicó mejoras clave mediante el posicionamiento, la rotación y la fijación aleatoria de objetos dentro de la escena mediante el Posicionador 3D. Los objetos también se emparejan en combinaciones semánticamente consistentes para simular relaciones espaciales complejas y oclusiones, lo que permite que el conjunto de datos capture interacciones más realistas en escenas con múltiples objetos.

Para fortalecer aún más la capacidad del modelo para manejar arreglos espaciales complejos, la tubería MirrorGen2 incorpora emparejado escenas de objetos, lo que permite que el sistema represente mejor las oclusiones y las interacciones entre múltiples elementos en entornos reflexivos.

El documento dice:

Las categorías se emparejan manualmente para garantizar la coherencia semántica; por ejemplo, emparejar una silla con una mesa. Durante el renderizado, tras posicionar y rotar el objeto principal, se muestrea y organiza un objeto adicional de la categoría emparejada para evitar solapamientos, garantizando así regiones espaciales diferenciadas dentro de la escena.

Con respecto a la conexión a tierra explícita de los objetos, aquí los autores se aseguraron de que los objetos generados estuvieran "anclados" a la tierra en los datos sintéticos de salida, en lugar de "flotar" de manera inapropiada, lo que puede ocurrir cuando los datos sintéticos se generan a escala o con métodos altamente automatizados.

Dado que la innovación del conjunto de datos es central para la novedad del artículo, procederemos antes de lo habitual a esta sección de la cobertura.

Datos y Pruebas

SynMirrorV2

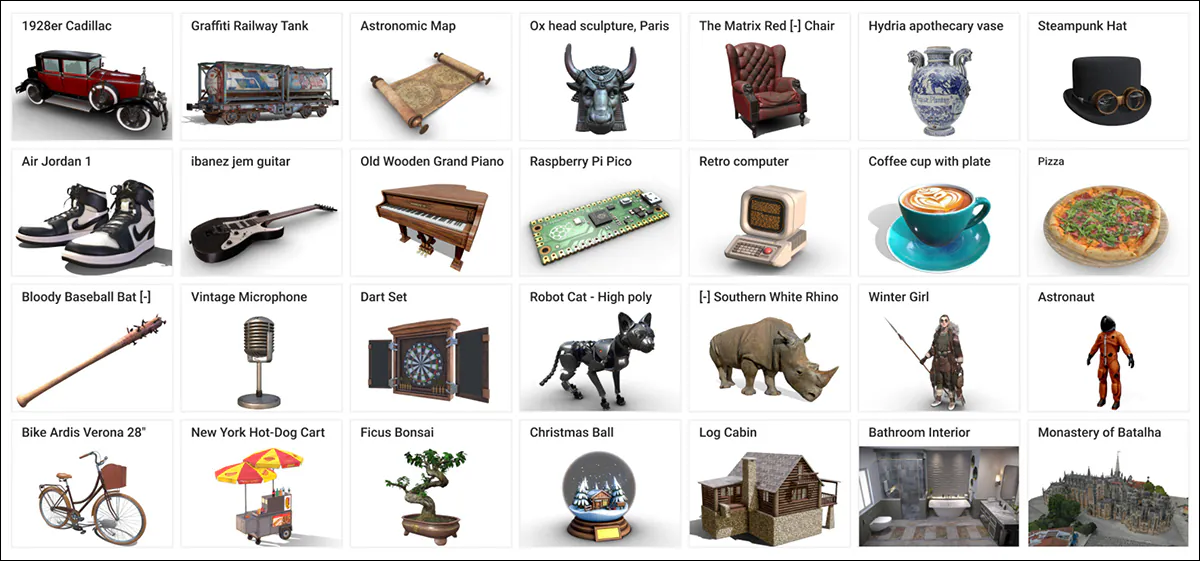

El conjunto de datos SynMirrorV2 de los investigadores fue concebido para mejorar la diversidad y el realismo de los datos de entrenamiento de reflexión de espejo, presentando objetos 3D provenientes de Objaverso y el Objetos de Amazon Berkeley Conjuntos de datos (ABO), con estas selecciones refinadas posteriormente a través de OBJETO 3DIT, así como el proceso de filtrado de la V1 Proyecto MirrorFusionPara eliminar activos de baja calidad, se obtuvo un conjunto refinado de 66,062 objetos.

Ejemplos del conjunto de datos Objaverse, utilizados en la creación del conjunto de datos seleccionado para el nuevo sistema. Fuente: https://arxiv.org/pdf/2212.08051

La construcción de la escena implicó colocar estos objetos sobre pisos texturizados. CC-Texturas y fondos HDRI de la PolyHaven Repositorio CGI, con espejos de pared completa o rectangulares altos. La iluminación se estandarizó con una luz de área ubicada por encima y detrás de los objetos, en un ángulo de cuarenta y cinco grados. Los objetos se escalaron para encajar en un cubo unitario y se posicionaron utilizando una intersección precalculada del espejo y la visión de la cámara. troncos truncados, garantizando visibilidad.

Se aplicaron rotaciones aleatorias alrededor del eje y, y se utilizó una técnica de conexión a tierra para evitar "artefactos flotantes".

Para simular escenas más complejas, el conjunto de datos también incorporó múltiples objetos organizados según emparejamientos semánticamente coherentes basados en categorías ABO. Se colocaron objetos secundarios para evitar la superposición, creando 3,140 escenas multiobjeto diseñadas para capturar diversas oclusiones y relaciones de profundidad.

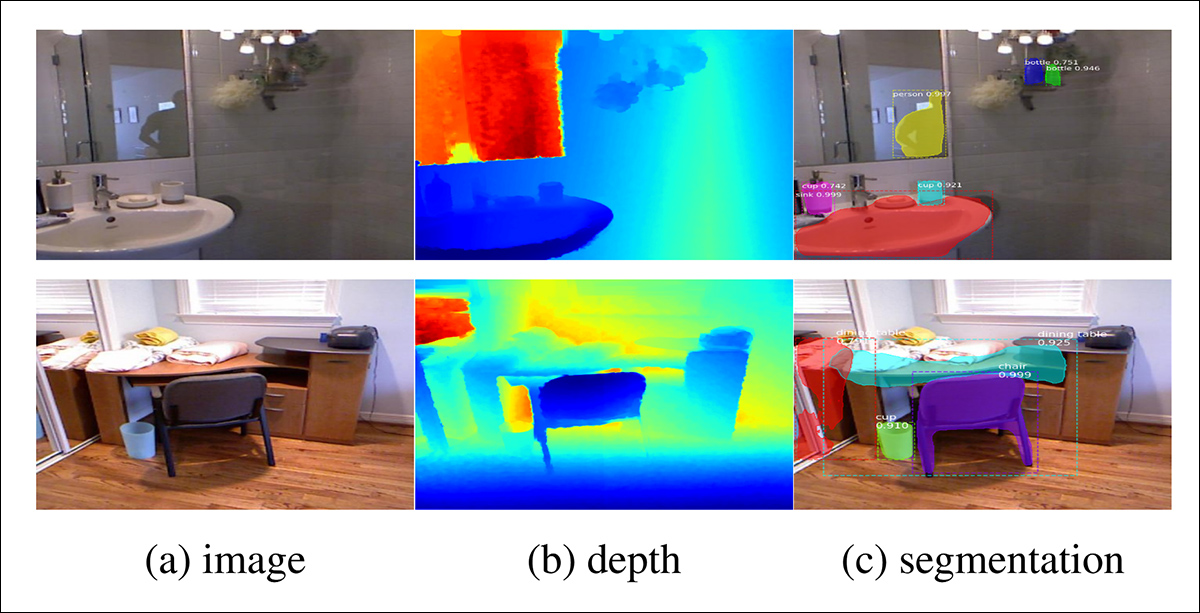

Ejemplos de vistas renderizadas del conjunto de datos de los autores que contienen múltiples (más de dos) objetos, con ilustraciones de segmentación de objetos y visualizaciones de mapas de profundidad que se muestran a continuación.

Proceso de entrenamiento

Reconociendo que el realismo sintético por sí solo era insuficiente para una generalización sólida a datos del mundo real, los investigadores desarrollaron un proceso de aprendizaje curricular de tres etapas para entrenar MirrorFusion 2.0.

En la Etapa 1, los autores inicializaron el pesos de ambas ramas de acondicionamiento y generación con la Difusión Estable v1.5 punto de control y ajustó el modelo en el entrenamiento de un solo objeto split del conjunto de datos SynMirrorV2. A diferencia de lo mencionado anteriormente Reflejando la realidad proyecto, los investigadores no freeze La rama de generación. Luego entrenaron el modelo durante 40,000 iteraciones.

En la Etapa 2, el modelo se ajustó para 10,000 iteraciones adicionales, en la división de entrenamiento de múltiples objetos de SynMirrorV2, con el fin de enseñar al sistema a manejar oclusiones y los arreglos espaciales más complejos que se encuentran en escenas realistas.

Finalmente, en la Etapa 3, se llevaron a cabo 10,000 XNUMX iteraciones adicionales de ajuste fino utilizando datos del mundo real de Conjunto de datos MSD, utilizando mapas de profundidad generados por el Matterport3D estimador de profundidad monocular.

Ejemplos del conjunto de datos MSD, con escenas del mundo real analizadas en mapas de profundidad y segmentación. Fuente: https://arxiv.org/pdf/1908.09101

Durante el entrenamiento, se omitieron las indicaciones de texto durante el 20 por ciento del tiempo de entrenamiento para alentar al modelo a hacer un uso óptimo de la información de profundidad disponible (es decir, un enfoque "enmascarado").

El entrenamiento se realizó en cuatro GPU NVIDIA A100 para todas las etapas (no se proporciona la especificación de VRAM, aunque habría sido de 40 GB u 80 GB por tarjeta). Se obtuvo una tasa de aprendizaje de 1e.-5 se utilizó en un tamaño de lote de 4 por GPU, bajo la AdánW optimizador.

Este esquema de entrenamiento aumentó progresivamente la dificultad de las tareas presentadas al modelo, comenzando con escenas sintéticas más simples y avanzando hacia composiciones más desafiantes, con la intención de desarrollar una transferibilidad robusta al mundo real.

Pruebas

Los autores evaluaron MirrorFusion 2.0 en comparación con la tecnología de punta anterior, MirrorFusion, que sirvió como base, y realizaron experimentos en el conjunto de datos MirrorBenchV2, cubriendo escenas de un solo objeto y de múltiples objetos.

Se realizaron pruebas cualitativas adicionales en muestras del conjunto de datos MSD y Objetos escaneados de Google Conjunto de datos (GSO).

La evaluación utilizó 2,991 imágenes de un solo objeto de las categorías visibles e invisibles, y 300 escenas de dos objetos de ABO. El rendimiento se midió utilizando Relación señal-ruido máxima (PSNR); Índice de similitud estructural (SSIM); y Similitud de parches de imágenes perceptuales aprendidas Puntuaciones (LPIPS) para evaluar la calidad de la reflexión en la región del espejo enmascarado. Similitud de CLIP Se utilizó para evaluar la alineación textual con las indicaciones de entrada.

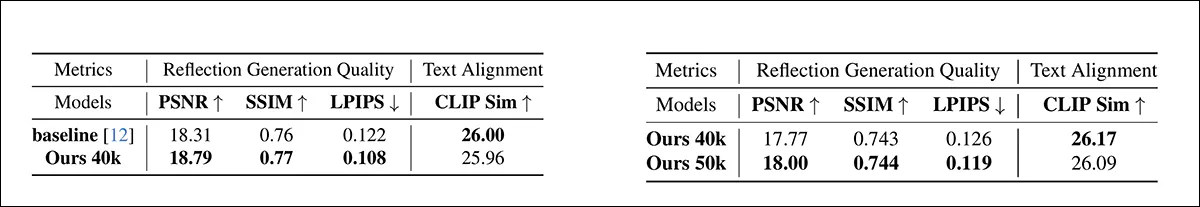

En las pruebas cuantitativas, los autores generaron imágenes utilizando cuatro semillas para una indicación específica y seleccionaron la imagen resultante con la mejor puntuación SSIM. Las dos tablas de resultados de las pruebas cuantitativas se muestran a continuación.

Izquierda: Resultados cuantitativos de la calidad de generación de reflejos de un solo objeto en la división de un solo objeto de MirrorBenchV2. MirrorFusion 2.0 superó el rendimiento de referencia; los mejores resultados se muestran en negrita. Derecha: Resultados cuantitativos de la calidad de generación de reflejos de múltiples objetos en la división de múltiples objetos de MirrorBenchV2. MirrorFusion 2.0 entrenado con múltiples objetos superó a la versión entrenada sin ellos; los mejores resultados se muestran en negrita.

Los autores comentan:

'[Los resultados] muestran que nuestro método supera al método de referencia y el ajuste en múltiples objetos mejora los resultados en escenas complejas.'

La mayor parte de los resultados, y aquellos enfatizados por los autores, se refieren a pruebas cualitativas. Debido al tamaño de estas ilustraciones, solo podemos reproducir parcialmente los ejemplos del artículo.

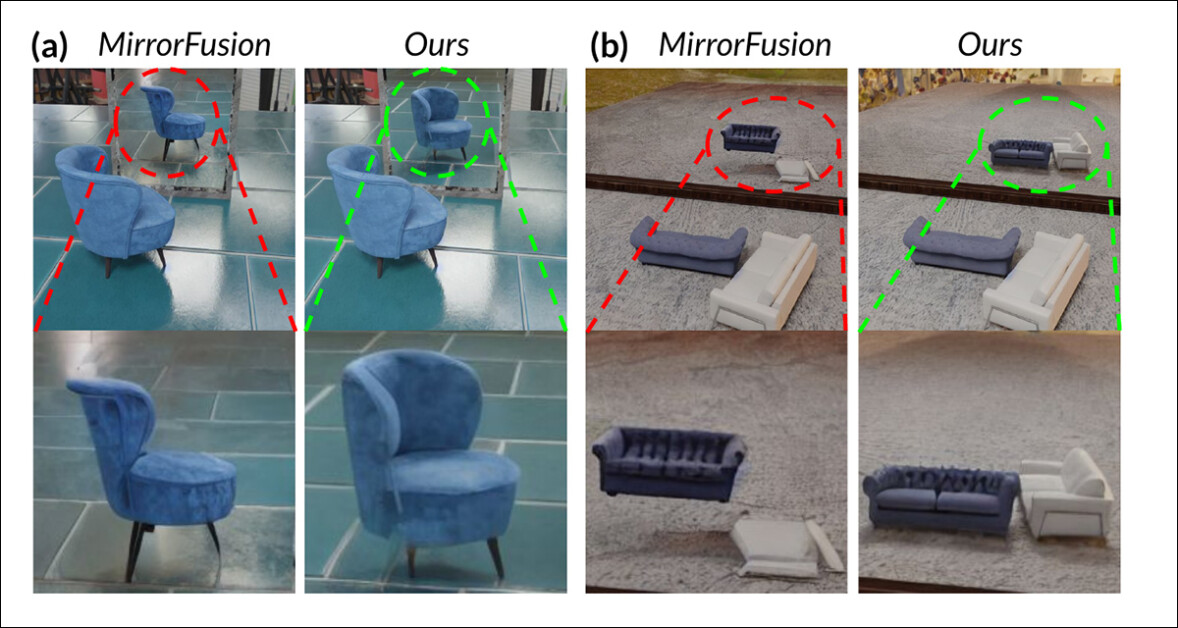

Comparación en MirrorBenchV2: la línea base no logró mantener reflejos precisos y consistencia espacial, mostrando una orientación incorrecta de la silla y reflejos distorsionados de múltiples objetos, mientras que (según afirman los autores) MirrorFusion 2.0 representa correctamente la silla y los sofás, con una posición, orientación y estructura precisas.

De estos resultados subjetivos, los investigadores opinan que el modelo base no representó con precisión la orientación de los objetos ni las relaciones espaciales en los reflejos, lo que a menudo produjo artefactos como rotación incorrecta y objetos flotantes. MirrorFusion 2.0, entrenado en SynMirrorV2, según los autores, conserva la orientación y el posicionamiento correctos de los objetos tanto en escenas de un solo objeto como en escenas con varios, lo que resulta en reflejos más realistas y coherentes.

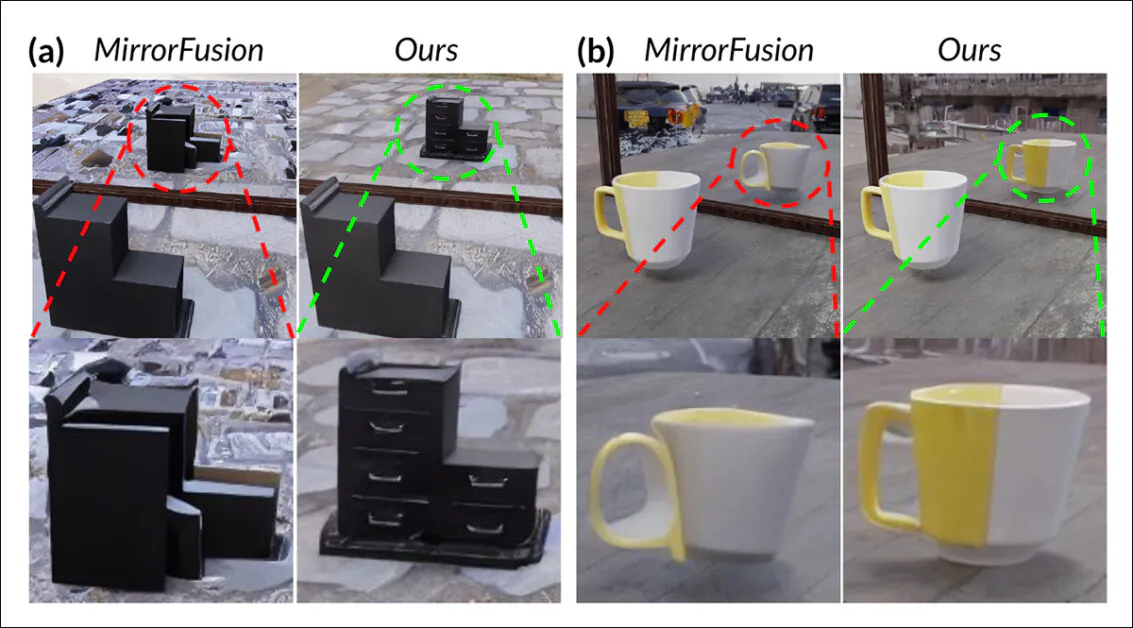

A continuación vemos los resultados cualitativos del conjunto de datos GSO antes mencionado:

Comparación con el conjunto de datos GSO. La línea base distorsiona la estructura del objeto y produce reflejos incompletos y distorsionados, mientras que MirrorFusion 2.0, según los autores, preserva la integridad espacial y genera geometría, color y detalle precisos, incluso en objetos fuera de distribución.

Aquí los autores comentan:

MirrorFusion 2.0 genera reflejos significativamente más precisos y realistas. Por ejemplo, en la Fig. 5 (a – arriba), MirrorFusion 2.0 refleja correctamente los tiradores del cajón (resaltados en verde), mientras que el modelo base produce un reflejo inverosímil (resaltado en rojo).

'De manera similar, para la “taza blanca y amarilla” de la Fig. 5 (b), MirrorFusion 2.0 ofrece una geometría convincente con artefactos mínimos, a diferencia de la línea base, que no logra capturar con precisión la geometría y la apariencia del objeto.'

La prueba cualitativa final se realizó contra el conjunto de datos MSD del mundo real antes mencionado (los resultados parciales se muestran a continuación):

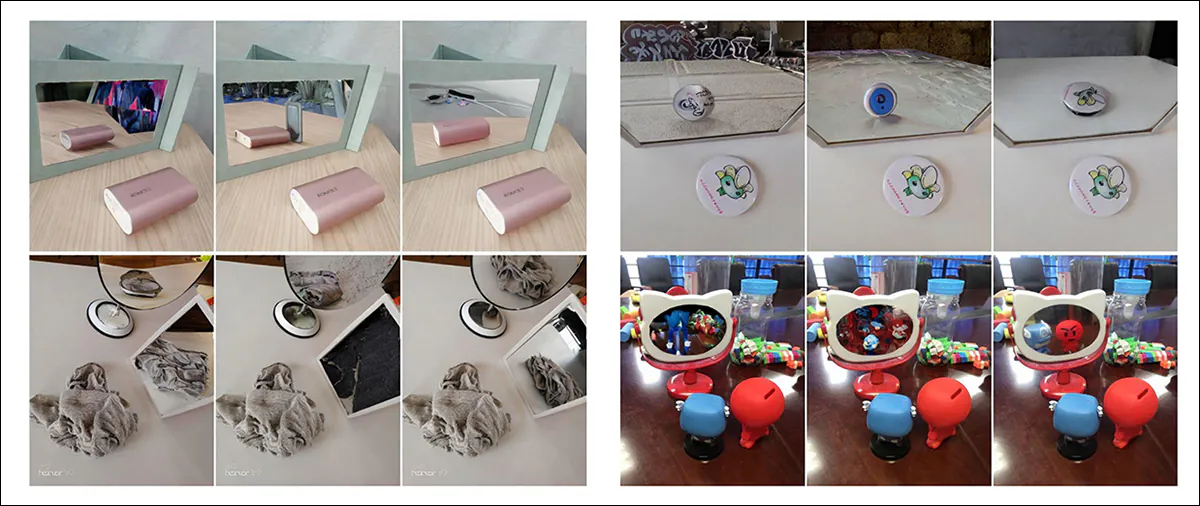

Resultados de escenas reales comparando MirrorFusion, MirrorFusion 2.0 y MirrorFusion 2.0, optimizados con el conjunto de datos MSD. Los autores afirman que MirrorFusion 2.0 captura detalles complejos de la escena con mayor precisión, incluyendo objetos desordenados sobre una mesa y la presencia de múltiples espejos en un entorno tridimensional. Aquí solo se muestran resultados parciales, debido a las dimensiones de los resultados del artículo original, al que remitimos al lector para obtener resultados completos y una mejor resolución.

Aquí, los autores observan que, si bien MirrorFusion 2.0 tuvo un buen rendimiento con datos de MirrorBenchV2 y GSO, inicialmente tuvo dificultades con escenas complejas del mundo real en el conjunto de datos MSD. El ajuste del modelo en un subconjunto de MSD mejoró su capacidad para gestionar entornos saturados y múltiples espejos, lo que resultó en reflexiones más coherentes y detalladas en la división de prueba retenida.

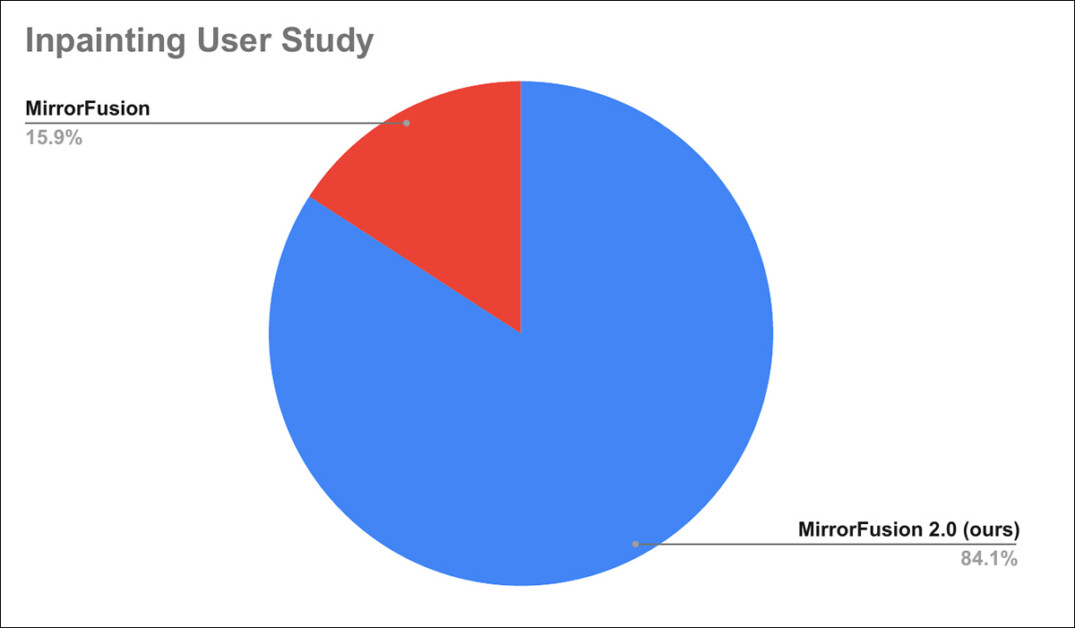

Además, se realizó un estudio de usuarios, donde se informó que el 84% de los usuarios preferían las generaciones de MirrorFusion 2.0 al método de referencia.

Resultados del estudio de usuarios.

Dado que los detalles del estudio de usuario se han relegado al apéndice del documento, remitimos al lector a dicho apéndice para obtener información específica sobre el estudio.

Conclusión

Si bien varios de los resultados presentados en el artículo representan mejoras impresionantes respecto al estado del arte, el estado del arte para este objetivo en particular es tan deficiente que incluso una solución agregada poco convincente puede triunfar con un mínimo esfuerzo. La arquitectura fundamental de un modelo de difusión impide el aprendizaje fiable y la demostración de una física consistente, por lo que el problema está mal planteado y, aparentemente, no se presta a una solución elegante.

Además, añadir datos a los modelos existentes ya es el método estándar para corregir las deficiencias en el rendimiento de LDM, con todas las desventajas mencionadas anteriormente. Es razonable suponer que si los futuros conjuntos de datos a gran escala prestaran más atención a la distribución (y anotación) de los puntos de datos relacionados con la reflexión, podríamos esperar que los modelos resultantes gestionaran mejor esta situación.

Pero lo mismo puede decirse de muchos otros problemas en la producción de LDM: ¿quién puede decir cuál de ellos merece más el esfuerzo y el dinero involucrados en el tipo de solución que los autores del nuevo artículo proponen aquí?

Primera publicación: lunes 28 de abril de 2025. Martes 29 de abril: se realizó corrección gramatical en los párrafos finales.