El ángulo de Anderson

Eliminar objetos y personas de un vídeo con IA

No, el niño no se queda en la imagen, si la IA tiene algo que ver con ello.

Eliminar personas y objetos de imágenes y videos es una sublínea popular de investigación en la literatura de IA centrada en VFX, con un número creciente de conjuntos de datos y marcos dedicados a abordar el desafío. El más reciente de ellos, del Instituto de Big Data de la Universidad de Fudan en China, es Efecto Borrar, un sistema de eliminación de objetos de vídeo "sensible a los efectos" que, según los autores, mejora notablemente el estado del arte en las pruebas:

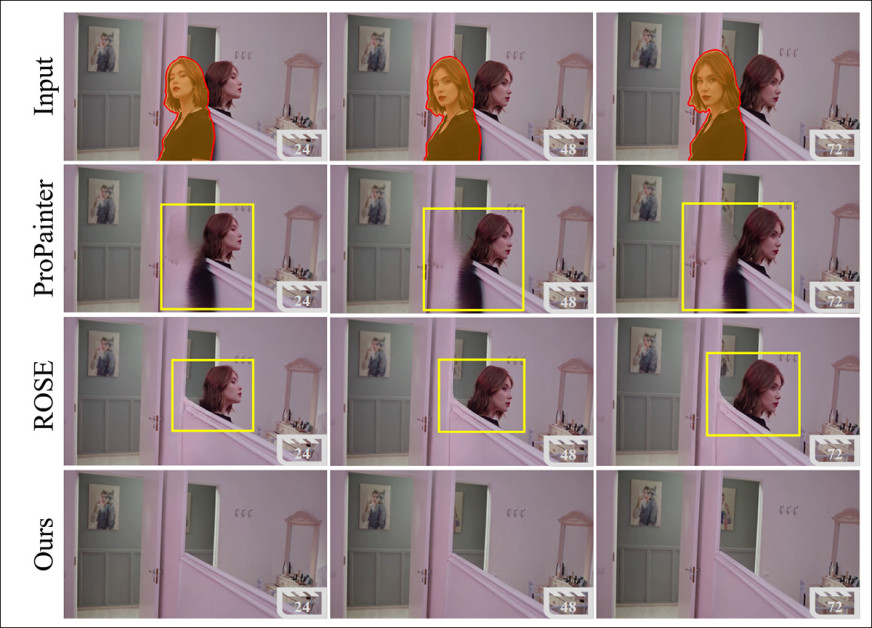

Recopilados a partir del material del sitio web del proyecto, ejemplos del método EffectErase (tenga en cuenta que, si bien proporcionamos un enlace, el sitio de origen contiene tantos videos de reproducción automática de alta resolución y no optimizados que pueden afectar la estabilidad de su navegador web. El video de YouTube adjunto es una referencia más sencilla y completa, y está integrado al final de este artículo). Fuente

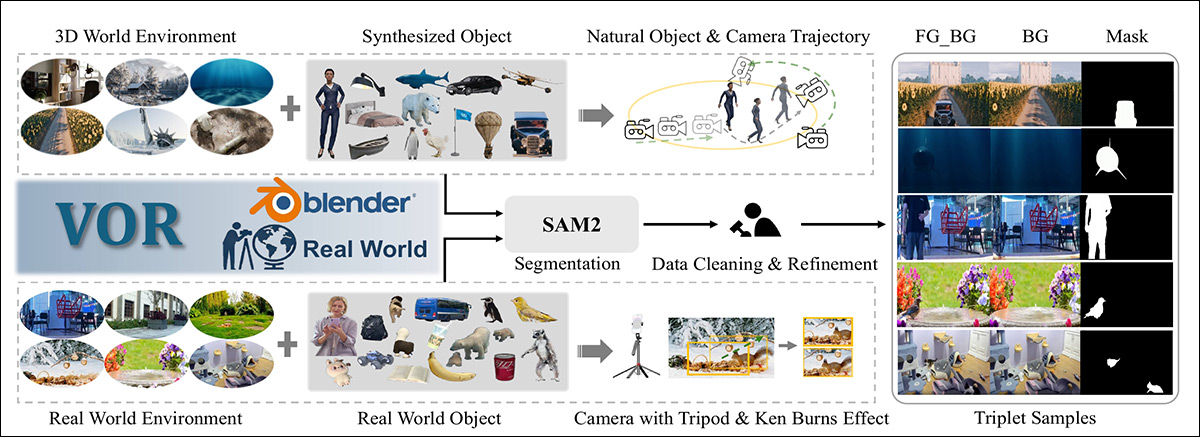

El nuevo trabajo implicó la creación/curación de un conjunto de datos seminovedoso que comprende casi 350 escenas originales del mundo real y también escenas sintetizadas (haciendo uso de repositorios públicos*), capturadas con equipos especializados o obtenidas y reutilizadas en un flujo de trabajo construido en torno al marco de código abierto Blender 3D.

El conjunto de datos híbrido de eliminación de objetos de vídeo (VOR) constituye la base para el Efecto Borrar La propia aplicación, que está construida sobre la Wan2.1 sistema de generación de vídeo. El sistema también define dos nuevos puntos de referencia relacionados: Evaluación VOR y el VOR Salvaje – respectivamente, para muestras con y sin verdad fundamental.

(Aunque el periódico tiene un sitio del proyecto adjuntoEstá bastante sobrecargado con múltiples vídeos de alta resolución y es difícil de cargar; así que, si le resulta difícil usar el sitio web del proyecto, consulte los fragmentos que he seleccionado en el vídeo incrustado arriba.

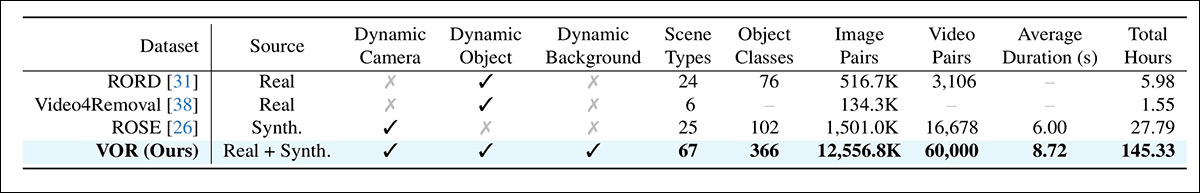

Una comparación de cantidades entre conjuntos de datos previos comparables, con respecto a la nueva oferta. Fuente

Los investigadores afirman que su método ofrece un rendimiento de vanguardia, tanto en métricas cuantitativas como en resultados cualitativos, según lo determinado mediante un estudio realizado con participantes humanos.

Señalan que los trabajos anteriores no siempre han logrado eliminar los efectos secundarios de un objeto, como las sombras y los reflejos, y que su conjunto de datos se ha creado cuidadosamente para subsanar esta deficiencia:

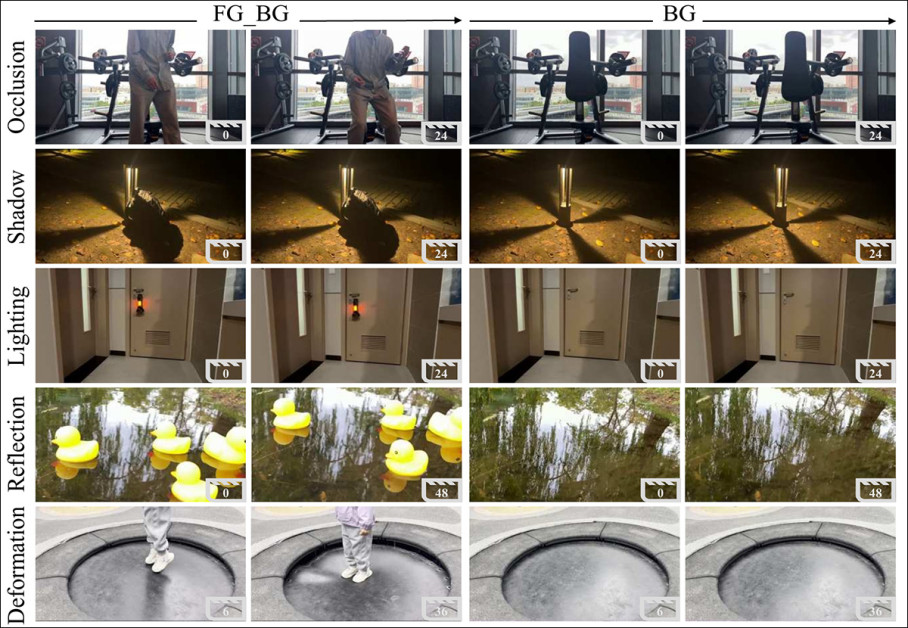

Ejemplos de enfoques anteriores que no tuvieron en cuenta otros factores además del objeto que se pretendía eliminar, como los indicios secundarios, por ejemplo, los reflejos y las sombras.

El sitio nuevo documento se titula EffectErase: Eliminación e inserción conjunta de objetos de vídeo para un borrado de efectos de alta calidad.y proviene de cuatro investigadores de la Facultad de Informática e Inteligencia Artificial de la Universidad de Fudan.

Método

El conjunto de datos VOR híbrido fue diseñado para abarcar una gama de escenarios lo suficientemente amplia como para cubrir todas las implicaciones de intentar eliminar a una persona u objeto de un vídeo:

Los fotogramas emparejados del conjunto de datos VOR ilustran cómo la eliminación de objetos debe ir más allá del sujeto visible y abarcar sus efectos inducidos. Ejemplos de esto muestran oclusión, sombra, cambios de iluminación, reflejos y deformación física, cada uno presentado como entrada (objeto presente) junto con el fondo limpio correspondiente después de la eliminación. Para ver más ejemplos, consulte el vídeo de YouTube que se incluye al final de este artículo.

Los cinco tipos representativos de "interferencia" que se abordarán son definidos por los autores como: oclusiónincluyendo varios tipos de vidrio y oclusión de humo; oscuridad; iluminación (por ejemplo, cuando un objeto que se va a retirar crea o altera la trayectoria de la luz); reflexión; y deformación (por ejemplo, la huella de un usuario en un cojín, que no debería sobrevivir a que la persona lo retire).

Proceso de construcción de conjuntos de datos para VOR, que combina escenas sintéticas generadas con Blender con capturas del mundo real. Los datos sintéticos se crean a partir de entornos 3D, objetos y trayectorias de cámara seleccionados, y metraje real grabado en diversas escenas, complementado con la técnica de movimiento Ken Burns. La segmentación SAM2 y el refinamiento manual producen tríos de vídeo alineados de primer plano y fondo con sus máscaras correspondientes.

Para obtener los datos originales del mundo real, los investigadores utilizaron cámaras fijas para grabar escenas "con" y "sin" elementos, abarcando una amplia gama de entornos, la hora del día y las condiciones climáticas.

Para los datos sintetizados, se renderizaron múltiples puntos de vista y se crearon escenarios con múltiples objetos, presentando tipos de movimiento de cámara deliberadamente complejos y desafiantes, como los que podrían ocurrir en grabaciones del mundo real; y los investigadores observan que este enfoque es más sofisticado y laborioso que el utilizado para otros casos similares. Eliminar objetos con efectos secundarios en vídeos (ROSE) conjunto de datos.

Para aumentar la diversidad de movimiento, el Efecto Ken Burns Se aplicó a pares de imágenes capturadas por la cámara, añadiendo paneos controlados, zooms y ligeros movimientos de cámara en mano según catorce reglas predefinidas, con cinco patrones de movimiento muestreados por par, manteniendo el recorte dentro del encuadre original.

La escala y la diversidad se ampliaron aún más combinando objetos sintéticos con múltiples configuraciones de cámara. Las máscaras se generaron colocando indicaciones de puntos manuales en fotogramas clave, propagando la segmentación con Segmentar cualquier cosa 2 (SAM2), limpiando y refinando los resultados, y ensamblando tripletes validados de primer plano, fondo y máscara para el entrenamiento.

La colección final consta de 145 horas de vídeo repartidas en 60,000 vídeos emparejados, reales y sintéticos, que abarcan 366 clases de objetos en 443 escenas.

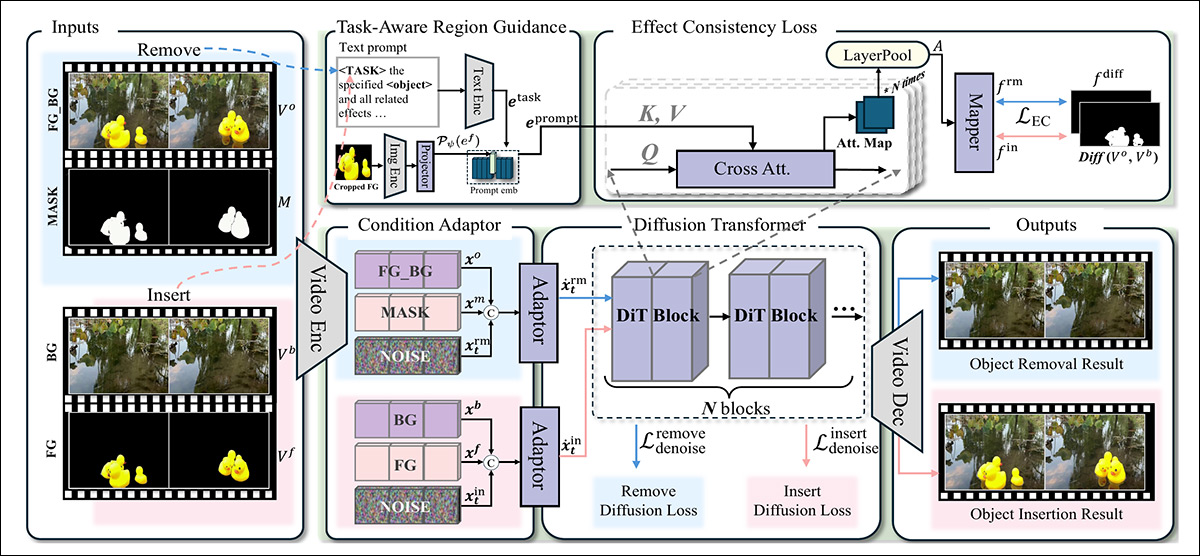

La propia red EffectErase ingiere material a través de un autocodificador variacional (VAE†), con la eliminación de ruido latente manejada por Wan2.1. Sobre esta red troncal, EffectErase opera Aprendizaje conjunto de extracción e inserción, que entrena ambas tareas juntas en las mismas regiones; Guía regional con reconocimiento de tareas (TARG), que utiliza tokens de objetos y tareas con atención cruzada modelar vínculos espaciotemporales entre objetos y sus efectos y permitir el cambio de tareas; y Pérdida de consistencia del efecto, que alinea las regiones de efecto alineadas entre las tareas de eliminación e inserción:

Esquema del marco EffectErase. Durante el entrenamiento, los vídeos emparejados se codifican en un espacio latente compartido, se fusionan con ruido y se procesan mediante un transformador de difusión guiado por una atención cruzada sensible a la tarea, mientras que una función de pérdida de consistencia de efectos alinea las regiones de eliminación e inserción para que ambas tareas se centren en la misma área.

Los procesos de extracción e inserción se entrenan conjuntamente, utilizando una estructura de difusión compartida, de modo que el modelo aprende a centrarse en las mismas regiones afectadas y en las mismas señales estructurales.

Los videos con objetos, videos solo de fondo y máscaras, primero se codifican en un espacio latentePosteriormente, se añade ruido para el entrenamiento de difusión, y el modelo aprende a recuperar representaciones limpias bajo la guía específica de la tarea. Un adaptador ligero fusiona las características ruidosas con condiciones de eliminación o inserción, lo que permite que ambas tareas compartan la supervisión, manteniendo al mismo tiempo el control.

Guía regional con reconocimiento de tareas crea una señal específica de la tarea combinando tokens de lenguaje con características visuales extraídas del objeto en primer plano, utilizando CLIP, reemplazando un token de objeto genérico con una representación incrustada derivada del contenido real de la imagen. Esta representación fusionada se inyecta en la estructura principal mediante atención cruzada, lo que permite al modelo rastrear cómo evoluciona un objeto y sus efectos visuales en el espacio y el tiempo, al tiempo que posibilita una conmutación flexible entre eliminación e inserción.

Pérdida de consistencia del efecto obliga a los procesos de eliminación e inserción a centrarse en las mismas áreas modificadas, ya que ambas tareas tratan sobre el mismo objeto y sus efectos visuales. Los mapas de atención de cada rama se combinan luego en mapas de región suave y se alinean con un mapa de diferencias calculado a partir de los vídeos del objeto y del fondo, de modo que se conservan cambios sutiles como la iluminación y las sombras. Este extra de Facilita la extracción de la guía de inserción y mantiene la coherencia en ambas tareas.

Datos y Pruebas

Los investigadores pusieron a prueba su método comparándolo con diversos métodos de relleno de imágenes, relleno de vídeo y eliminación de objetos: OmniPaint; Borrar objeto; vace; Borrador difuso; Pintor profesional; ROSE; y MiniMax-Removedor.

Wan2.1 fue ajustado con precisión lora† † utilizando el conjunto de datos VOR a una resolución de 832x480px. 81 fotogramas consecutivos (el límite efectivo para WAN, más allá de lo cual tienden a ocurrir errores) se muestrearon aleatoriamente para el entrenamiento, que tuvo lugar durante 129,000 iteraciones a una tamaño del lote de 8, en ocho GPU H100, cada una con 80 GB de VRAM. tasa de aprendizaje se estableció en 1×102, y Clasificación LoRA a 256.

El sitio ROSE-Benchmark La colección sintética fue el único conjunto de datos externo probado; los otros dos fueron Evaluación VOR, ANTES prueba del conjunto de datos splity VOR-Wild, un conjunto de prueba que comprende 195 vídeos reales extraídos de Internet, que presentan "objetos dinámicos".

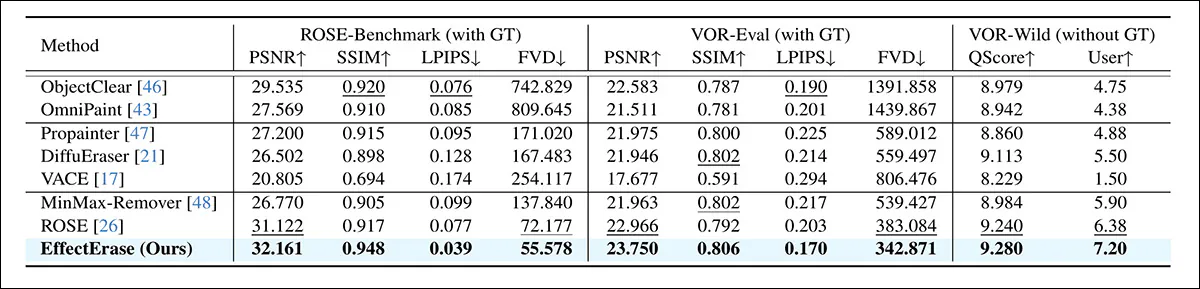

Las métricas utilizadas fueron Relación señal-ruido máxima (PSNR); Índice de similitud estructural (SIM); Similitud de parches de imágenes perceptuales aprendidas (LPIPS); y Distancia del vídeo de Fréchet (FVD). También se consideró un estudio de usuarios de 195 videos generados por VOR-Wild, teniendo en cuenta las calificaciones promedio de 20 voluntarios.

Además, los autores idearon puntuación Q, una métrica que aprovecha el Qwen-VL modelo multimodal, con el fin de evaluar la calidad de la salida de vídeo con objetos eliminados, en términos de artefactos residuales o eliminaciones ambientales no realizadas, como sombras y efectos de iluminación:

Comparación cuantitativa en los índices de referencia ROSE y VOR, donde los mejores y segundos mejores resultados se muestran en negrita y subrayados, respectivamente.

Respecto a estos resultados, los autores señalan:

Los métodos actuales de relleno de imágenes operan sobre fotogramas individuales utilizando modelos 2D sin modelado temporal y, por lo tanto, no logran mantener la consistencia temporal en los vídeos.

Los métodos recientes de relleno de vídeo no modelan explícitamente los efectos secundarios de los objetos, lo que da lugar a resultados de eliminación poco naturales. Los métodos existentes de eliminación de objetos en vídeo carecen de un modelado de correlación espaciotemporal entre el objeto y sus efectos secundarios, y, en consecuencia, suelen producir artefactos y rastros residuales de los objetos eliminados.

En general, EffectErase logra un rendimiento de vanguardia en todos los conjuntos de datos y métricas de evaluación. Obtiene las mejores puntuaciones en la métrica de calidad de vídeo FVD, lo que demuestra una suavidad temporal y una consistencia superiores en los vídeos generados.

«Nuestro método también obtiene las calificaciones más altas en QScore y en las opiniones de los usuarios, lo que demuestra aún más su eficacia para producir resultados de eliminación visualmente convincentes».

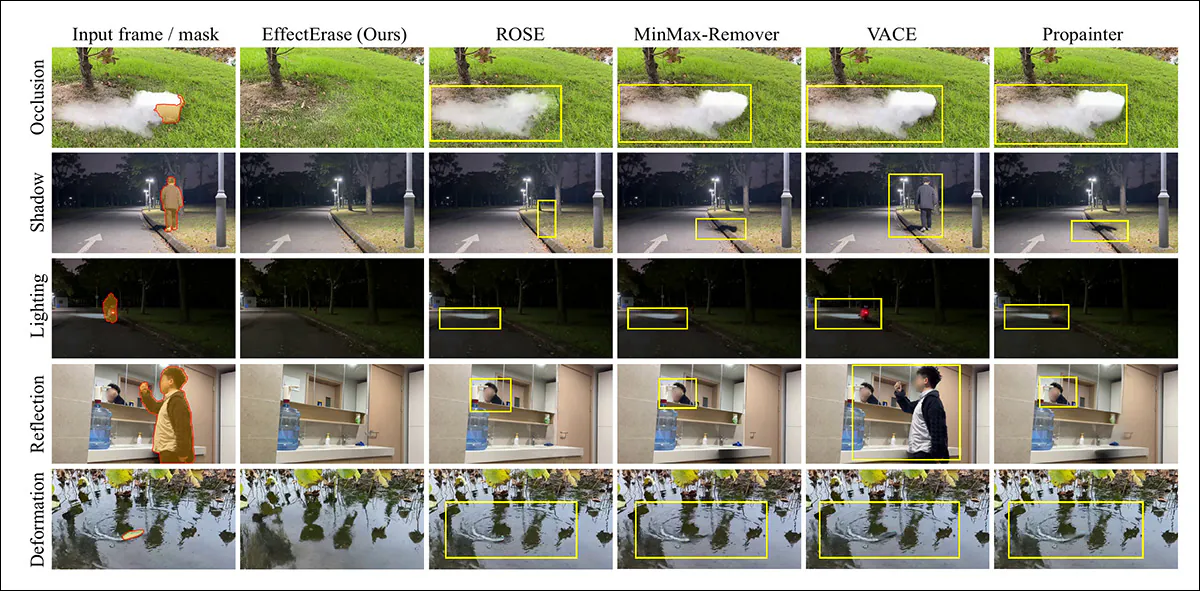

Para la evaluación cualitativa, los resultados estáticos se ofrecen en el documento (que se muestra) directamente debajo, así como los resultados en movimiento que están disponibles en el sitio del proyecto y el adjunto. Presentación de vídeo de YouTube:

Comparación cualitativa de VOR-Eval en casos de oclusión, sombra, iluminación, reflexión y deformación. Los métodos de relleno de imágenes tienen dificultades para eliminar los efectos fuera de la máscara, mientras que los modelos de eliminación suelen dejar artefactos visibles. EffectErase elimina tanto los objetos objetivo como sus efectos asociados de forma más limpia. Consulte el artículo original para obtener una mejor resolución y el sitio web del proyecto para ver ejemplos en vídeo.

También remitimos al lector a diversos ejemplos relacionados en el sitio web del proyecto, que se muestran a continuación, así como al vídeo oficial de YouTube que se incluye al final de este artículo:

Dele "click" para jugar. Comparación de ejemplo del sitio web del proyecto EffectErase. Para una mejor resolución (con las salvedades mencionadas) y más ejemplos, consulte el sitio web.

Los autores comentan:

Los métodos de relleno de vídeo suelen producir artefactos en las regiones enmascaradas y no logran eliminar por completo los efectos secundarios causados por los objetos eliminados. Los enfoques anteriores de eliminación de objetos, como ROSE y MinMax-Remover, funcionan bien para eliminar los objetos objetivo, pero aún presentan problemas con los efectos secundarios, especialmente en escenarios de oclusión, sombras, iluminación, reflexión y deformación.

«Por el contrario, EffectErase elimina eficazmente tanto los objetos objetivo como sus efectos asociados, lo que da como resultado un resultado limpio, coherente y de alta calidad».

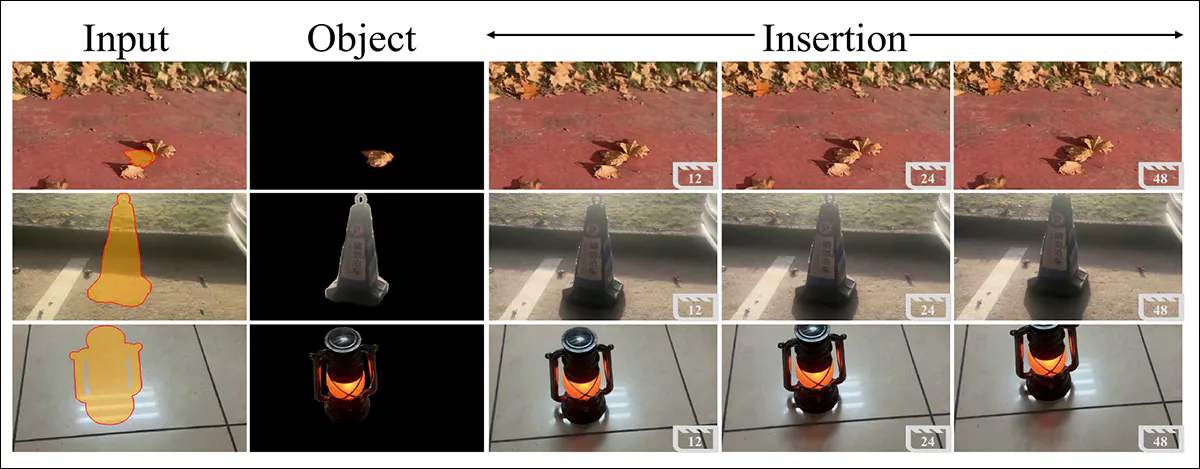

Para concluir, los investigadores observan que su método también puede adaptarse a tareas de inserción en lugar de extracción, sin necesidad de formación adicional:

Resultados de la inserción de objetos en vídeo. EffectErase inserta objetos conservando el contenido de fondo y generando efectos consistentes inducidos por los objetos, como sombras y reflejos, en todos los fotogramas.

Los resultados del vídeo de la tarea de inserción se pueden ver en el Vídeo de YouTube (con fecha y hora específicas) ejemplos (también insertados sin marcas de tiempo al final del artículo).

Conclusión

Un análisis de proyectos similares en la literatura revela que muchos aún esperan que los modelos de efectos visuales de propósito general puedan incorporar este tipo de funcionalidad en un modelo de "conjunto de herramientas" general diseñado para una variedad de efectos, en lugar de solo para esta tarea específica.

Sin embargo, siguiendo el principio de "todoterreno", parece razonable suponer que los sistemas especializados como EffectErase seguirán teniendo ventaja sobre los enfoques más generales; con la salvedad de que la brecha podría reducirse lo suficiente como para que la diferencia no justifique el esfuerzo adicional de entrenar un modelo específico.

* Cabría esperar, ante la creciente preocupación por la procedencia de la propiedad intelectual, que se citaran todas esas fuentes; pero si bien los materiales disponibles del nuevo trabajo indican la fuente de los modelos 3D, no pude encontrar dicha referencia.

† La referencia proporcionada parece ser una texto explicativo genérico Desde 2013, sin que se detalle el VAE específico.

† † Tomada del artículo, esta descripción es semánticamente poco clara, ya que el ajuste fino y LoRA son procesos diferentes con exigencias muy diferentes.

Publicado por primera vez el sábado 21 de marzo de 2026.