Inteligencia artificial

EAGLE: Explorando el Espacio de Diseño para Modelos de Lenguaje Grande Multimodal con una Mezcla de Codificadores

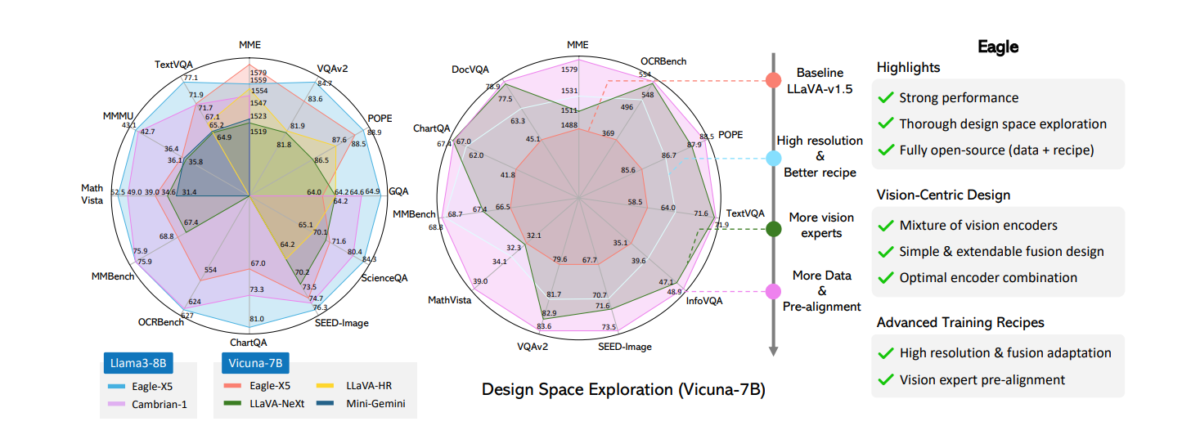

La capacidad de interpretar con precisión la información visual compleja es un enfoque crucial de los modelos de lenguaje grande multimodal (MLLMs). Los trabajos recientes muestran que la percepción visual mejorada reduce significativamente las alucinaciones y mejora el rendimiento en tareas sensibles a la resolución, como el reconocimiento óptico de caracteres y el análisis de documentos. Varios MLLMs recientes logran esto utilizando una mezcla de codificadores de visión. A pesar de su éxito, falta una comparación sistemática y estudios de ablation detallados que aborden aspectos críticos, como la selección de expertos y la integración de múltiples expertos en visión. Este artículo proporciona una exploración extensa del espacio de diseño para MLLMs utilizando una mezcla de codificadores de visión y resoluciones, el marco de Eagle que intenta explorar el espacio de diseño para modelos de lenguaje grande multimodal con una mezcla de codificadores. Los hallazgos revelan varios principios subyacentes comunes a varias estrategias existentes, lo que lleva a un enfoque de diseño eficaz y simplificado. Eagle descubre que simplemente concatenar tokens visuales de un conjunto de codificadores de visión complementarios es tan efectivo como arquitecturas de mezcla más complejas o estrategias. Además, Eagle introduce Pre-Alignment para bridar la brecha entre codificadores de visión enfocados y tokens de lenguaje, mejorando la coherencia del modelo. La familia resultante de MLLMs, Eagle, supera a otros modelos de código abierto líderes en las principales pruebas de MLLM.

El trabajo de Eagle está relacionado con el diseño general de la arquitectura de modelos de lenguaje grande multimodal (MLLMs). Además de la línea de investigación de código abierto representativa mencionada anteriormente, otras familias notables de MLLMs incluyen, pero no se limitan a, MiniGPT-4, Lynx, Otter, QwenVL, CogVLM, VILA, GPT-4V, Gemini y Llama 3.1. Dependiendo de cómo se integran las señales de visión en el modelo de lenguaje, los MLLMs se pueden categorizar ampliamente en modelos de “atención cruzada” y modelos de “ajuste de prefijo”. El primero inyecta información visual en diferentes capas de LLMs utilizando atención cruzada, mientras que el segundo trata los tokens visuales como parte de la secuencia de tokens de lenguaje y los apende directamente con incrustaciones de texto. El modelo de Eagle pertenece a la familia de ajuste de prefijo siguiendo una arquitectura multimodal al estilo de LLaVA.

El trabajo de Eagle está estrechamente relacionado con la investigación enfocada en mejorar los diseños de codificadores de visión para MLLMs. Los trabajos anteriores solían adoptar codificadores de visión preentrenados en tareas de alineación de visión-lenguaje como CLIP y EVA-CLIP. Se han propuesto codificadores de visión más fuertes, como SigLIP y InternVL, para mejorar las tareas de visión-lenguaje con mejores diseños, tamaños de modelo más grandes y recetas de entrenamiento más efectivas. Dado que los modelos a menudo se preentrenan en imágenes de baja resolución y pueden carecer de la capacidad de codificar detalles finos, a menudo se realiza una adaptación de resolución más alta para aumentar la resolución de entrada de MLLM. Además de la adaptación de resolución más alta, los modelos como LLaVA-NeXT, LLaVA-UHD, Monkey, InternLM-XComposer y InternVL utilizan mosaico o mosaico adaptativo para manejar la entrada de alta resolución, donde las imágenes se dividen en parches de baja resolución y se procesan por separado. Aunque la capacidad de manejar resoluciones más altas es posible al introducir expertos en visión adicionales, este enfoque difiere ligeramente de las técnicas de mosaico, aunque ambos son compatibles y se pueden combinar.

EAGLE: Utilizando una Mezcla de Codificadores para Explorar el Espacio de Diseño para MLLMs

El éxito de los modelos de lenguaje grande (LLMs) ha despertado un gran interés en habilitar sus capacidades de percepción visual, lo que les permite ver, entender y razonar en el mundo real. En el núcleo de estos modelos de lenguaje grande multimodal (MLLMs) se encuentra un diseño típico donde las imágenes se convierten en una serie de tokens visuales por los codificadores de visión y se apenden con las incrustaciones de texto. CLIP a menudo se elige como codificador de visión porque su representación visual está alineada con el espacio de texto mediante preentrenamiento en pares de imagen-texto. Dependiendo de las arquitecturas, las recetas de entrenamiento y la forma en que se inyectan los tokens visuales en el modelo de lenguaje, las familias notables de MLLMs incluyen Flamingo, BLIP, PaLI, PaLM-E y LLaVA. La mayoría de estos modelos mantienen resoluciones de entrada relativamente bajas debido a las limitaciones de los codificadores de visión preentrenados y la longitud de la secuencia de LLM. El trabajo de Eagle está estrechamente alineado con los modelos que utilizan múltiples codificadores de visión para una mejor percepción.

Por ejemplo, los modelos como Mousi y Brave fusionan tokens visuales de diferentes codificadores de visión concatenándolos a lo largo del canal o la dirección del token. RADIO introduce un método de destilación de múltiples maestros para unificar las capacidades de diferentes codificadores de visión en un solo modelo. MoAI, IVE y Prismer utilizan además la salida de expertos en visión, como OCR, detección o estimación de profundidad, para complementar información adicional para que los MLLMs generen respuestas. MoVA diseña una red de enrutamiento para asignar un modelo de visión óptimo basado en la imagen y las instrucciones dadas.

Los estudios recientes han demostrado que los diseños de codificadores de visión más fuertes son importantes para reducir las alucinaciones de MLLM y mejorar el rendimiento en tareas sensibles a la resolución como el reconocimiento óptico de caracteres (OCR). Varios trabajos se centran en mejorar la capacidad del codificador de visión, ya sea escalando el conjunto de datos de preentrenamiento y los parámetros o dividiendo las imágenes en parches de baja resolución. Sin embargo, estos enfoques a menudo introducen grandes demandas de recursos de entrenamiento. Una estrategia eficiente y poderosa es mezclar codificadores de visión preentrenados con diferentes tareas y resoluciones de entrada, ya sea fusionando codificadores de resolución más alta con el codificador CLIP, appending secuencialmente características de diferentes codificadores o adoptando estrategias de fusión y enrutamiento más complejas para maximizar los beneficios de los diferentes codificadores. Este enfoque de “mezcla de expertos en visión” ha demostrado ser efectivo, aunque todavía falta un estudio detallado de su espacio de diseño con ablation rigurosa, lo que motiva a Eagle a revisitar esta área. Las preguntas clave siguen siendo: ¿qué combinaciones de codificadores de visión elegir, cómo fusionar diferentes expertos y cómo ajustar las estrategias de entrenamiento con más codificadores de visión?

Para abordar estas preguntas, Eagle investiga sistemáticamente el espacio de diseño de la mezcla de codificadores de visión para una mejor percepción de MLLM. La exploración de este espacio de diseño implica los siguientes pasos: 1) Benchmarking varios codificadores de visión y búsqueda de adaptación de resolución más alta; 2) Realizando una comparación “manzana con manzana” entre estrategias de fusión de codificadores de visión; 3) Identificando progresivamente la combinación óptima de múltiples codificadores de visión; 4) Mejorando la pre-alineación de expertos en visión y la mezcla de datos. Los pasos de exploración se ilustran en la siguiente imagen.

El estudio de Eagle cubre el rendimiento de los codificadores de visión preentrenados en diferentes tareas y resoluciones, como alineación de visión-lenguaje, aprendizaje auto-supervisado, detección, segmentación y OCR. Utilizando un enfoque de ruleta, Eagle comienza con el codificador básico CLIP y agrega un experto adicional a la vez, seleccionando el experto que proporciona la mejor mejora en cada ronda.

Mientras que el trabajo de Eagle no es el primero en aprovechar múltiples codificadores de visión en MLLMs, el estudio sistemático conduce a varios hallazgos clave en este contexto:

- Desbloquear los codificadores de visión durante el entrenamiento de MLLM es importante. Esto es en contraste con modelos como LLaVA y otros que consideran múltiples codificadores de visión o maestros, donde congelar los codificadores de visión ha sido una práctica común.

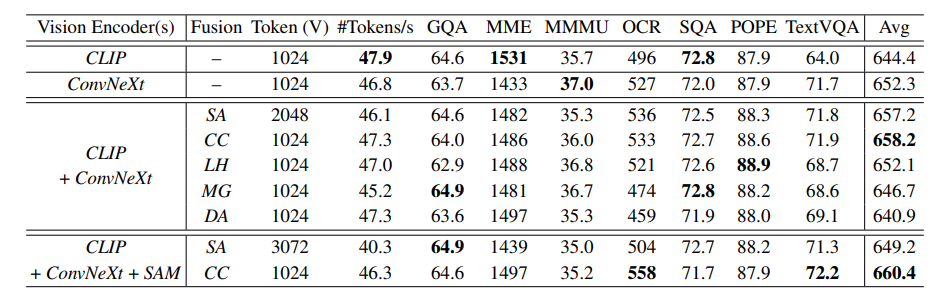

- Algunas estrategias de fusión propuestas recientemente no muestran ventajas significativas. En cambio, la concatenación de canal simple emerge como una estrategia de fusión competitiva y sencilla, ofreciendo la mejor eficiencia y rendimiento.

- Incorporar expertos en visión adicionales conduce a ganancias consistentes. Esto hace que sea una vía prometedora para mejorar sistemáticamente la percepción de MLLM, además de escalar los codificadores individuales. La mejora es particularmente pronunciada cuando los codificadores de visión están desbloqueados.

- La etapa de pre-alineación es clave. Eagle introduce una etapa de pre-alineación donde los expertos en visión no alineados con el texto se ajustan individualmente con un LLM congelado antes de ser entrenados juntos. Esta etapa mejora significativamente el rendimiento de MLLM bajo el diseño de mezcla de codificadores de visión.

Eagle: Metodología y Arquitectura

A diferencia de los métodos anteriores que se centran en nuevas estrategias de fusión o arquitecturas entre codificadores de visión, el objetivo de Eagle es identificar un diseño minimalista para fusionar diferentes codificadores de visión, respaldado por ablation detallada y eliminando cualquier componente innecesario. Como se muestra en la figura siguiente, Eagle comienza extendiendo el codificador básico CLIP a un conjunto de expertos en visión con diferentes arquitecturas, tareas de preentrenamiento y resoluciones. Con estos expertos, Eagle compara luego diferentes arquitecturas de fusión y métodos y explora cómo optimizar las estrategias de preentrenamiento con múltiples codificadores.

Finalmente, Eagle combina todos los hallazgos y extiende el enfoque a múltiples expertos en visión con resoluciones y conocimientos de dominio variables. Utilizando los mismos datos de preentrenamiento que LLaVA-1.5, que consisten en 595k pares de imagen-texto, Eagle pasa a la etapa de ajuste fino supervisado recopilando datos de una serie de tareas y convirtiéndolos en conversaciones multimodales, incluyendo LLaVA-1.5, Laion-GPT4V, ShareGPT-4V, DocVQA, synDog-EN, ChartQA, DVQA y AI2D, lo que resulta en 934k muestras.

El modelo se preentrena primero con pares de imagen-texto durante una época con un tamaño de lote de 256, donde el modelo completo está congelado y solo se actualiza la capa del proyector. En la segunda etapa, el modelo se ajusta en los datos de ajuste fino supervisado durante una época con un tamaño de lote de 128. Para esta exploración, Eagle emplea Vicuna-7B como el modelo de lenguaje subyacente. Las tasas de aprendizaje se establecen en 1e-3 para la primera etapa y 2e-5 para la segunda etapa.

Codificador CLIP Más Fuerte

Eagle comienza la exploración con el modelo CLIP, ya que se ha convertido en la elección principal para muchos MLLMs. Aunque los modelos CLIP son conocidos por mejorar las tareas multimodales, sus limitaciones también han sido bien documentadas. Por ejemplo, muchos MLLMs existentes tienden a utilizar las resoluciones preentrenadas de CLIP (como 224 × 224 o 336 × 336) como sus resoluciones de entrada. En estos casos, los codificadores a menudo luchan por capturar detalles finos importantes para tareas sensibles a la resolución como OCR y comprensión de documentos.

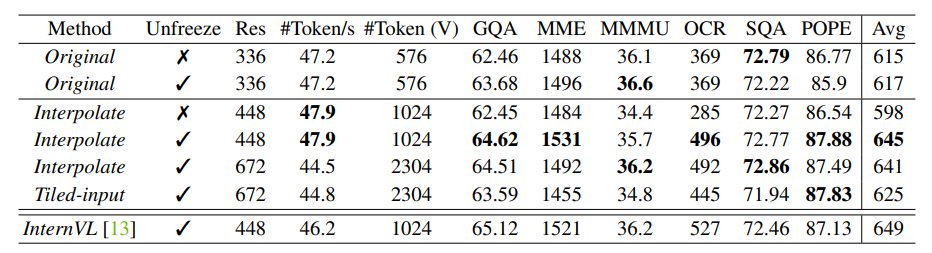

Para manejar el aumento de la resolución de entrada, un enfoque común es el mosaico, donde las imágenes de entrada se dividen en mosaicos y se codifican por separado. Otro método más simple es escalar directamente la resolución de entrada y interpolar las incrustaciones de posición del modelo de transformador de visión si es necesario. Eagle compara estos dos enfoques con codificadores de visión congelados y desbloqueados a través de diferentes resoluciones, con los resultados contenidos en la tabla anterior. Los hallazgos se pueden resumir de la siguiente manera:

- Desbloquear el codificador CLIP conduce a una mejora significativa cuando se interpola a una resolución de entrada de MLLM más alta que difiere de la resolución de preentrenamiento de CLIP, sin degradación del rendimiento cuando las resoluciones permanecen iguales.

- Congelar el codificador CLIP y adaptarlo directamente a una resolución de entrada de MLLM más alta perjudica significativamente el rendimiento.

- Entre las estrategias comparadas, interpolarse directamente a 448 × 448 con un codificador CLIP desbloqueado resulta ser efectivo y eficiente en términos de rendimiento y costo.

- El mejor codificador CLIP logra un rendimiento cercano a InternVL, a pesar de ser un modelo mucho más pequeño (300M vs. 6B) con menos datos de preentrenamiento.

Es importante destacar que CLIP-448 permite a Eagle igualar la configuración con LLaVA-HR y InternVL, donde los codificadores CLIP se adaptan de manera similar para tomar entrada de 448 × 448 y producir 1024 tokens de parche. Para una mayor investigación, Eagle sigue esta estrategia simple de escalar la resolución de entrada y desbloquear el codificador de visión durante el entrenamiento.

Eagle observa que las estrategias de fusión existentes, a pesar de sus variaciones de diseño, se pueden categorizar ampliamente de la siguiente manera:

- Agregar Secuencia: Agregar directamente los tokens visuales de diferentes partes traseras como una secuencia más larga.

- Concatenación de Canal: Concatenar los tokens visuales a lo largo de la dimensión del canal sin aumentar la longitud de la secuencia.

- LLaVA-HR: Inyectar características de alta resolución en tokens de visión de baja resolución utilizando un adaptador de mezcla de resolución.

- Mini-Gemini: Utilizar los tokens CLIP como consultas de baja resolución para atender a otro codificador de visión de alta resolución en ventanas locales co-localizadas.

- Atención Deformable: Una nueva línea de base introducida sobre Mini-Gemini, donde la atención de ventana vanilla se reemplaza con atención deformable.

En lugar de entrenar un proyector para alinear simultáneamente múltiples expertos en visión como en la estrategia de preentrenamiento original de LLaVA, primero se alinea la representación de cada experto individual con un modelo de lenguaje más pequeño (Vicuna-7B en la práctica) utilizando supervisión de predicción de token siguiente. Como se muestra en la figura a continuación, con pre-alineación, el proceso de entrenamiento completo consta de tres pasos: 1) entrenar cada experto en visión preentrenado con su propio proyector en datos SFT, mientras se mantiene el modelo de lenguaje congelado; 2) combinar todos los expertos en visión del primer paso y entrenar solo el proyector con datos de pares de imagen-texto; 3) entrenar el modelo completo en los datos SFT.

Eagle: Experimentos y Resultados

Después de desarrollar meticulosamente sus estrategias, Eagle ha establecido los siguientes principios para el modelo: (1) integrar más expertos en visión con una receta de entrenamiento optimizada; (2) combinar múltiples expertos en visión a través de concatenación de canal directa; (3) preentrenar los expertos en visión por separado a través de pre-alineación. En esta sección, para demostrar aún más las ventajas de los modelos de Eagle, se incorporan datos de entrenamiento adicionales y Eagle se compara con los MLLMs actuales de código abierto de vanguardia en varias tareas. Eagle utiliza Vicuna-v1.5-7B, Llama3-8B y Vicuna-v1.5-13B como los modelos de lenguaje. Para los codificadores de visión, basándose en los resultados de la Sección 2.6, los modelos de Eagle se denotan como Eagle-X4, que incluye cuatro codificadores de visión: CLIP, ConvNeXt, Pix2Struct y EVA-02, y Eagle-X5, que incluye un codificador de visión SAM adicional.

Tareas de Preguntas y Respuestas Visuales

Eagle compara la serie de modelos en tres pruebas de benchmark de Preguntas y Respuestas Visuales (VQA), incluyendo GQA, VQAv2 y VizWiz. Como se muestra en la tabla siguiente, Eagle-X5 logra un rendimiento de vanguardia en GQA y VQAv2, destacando las ventajas de incorporar expertos en visión adicionales.

Tareas de OCR y Comprensión de Gráficos

Para evaluar las capacidades de OCR, documento y comprensión de gráficos de Eagle, el modelo se evalúa en OCRBench, TextVQA y ChartQA. Como se muestra en la tabla anterior, Eagle supera significativamente a los competidores en TextVQA, beneficiándose de su arquitectura de alta resolución y la integración de diferentes codificadores de visión. Notablemente, Eagle mantiene un diseño sencillo, soportando hasta 1024 tokens sin requerir descomposición de mosaico compleja de imágenes.

La figura a continuación presenta ejemplos de casos de OCR y comprensión de documentos. Con adaptación de alta resolución y la inclusión de más expertos en visión, Eagle puede identificar texto pequeño dentro de las imágenes y extraer información con precisión según las instrucciones del usuario.

Para comprender mejor los beneficios de introducir expertos preentrenados en otras tareas de visión, la figura siguiente visualiza los resultados de un modelo con solo los codificadores de visión ConvNeXt y CLIP, en comparación con los resultados de Eagle-X5. Con el conjunto completo de codificadores de visión, el modelo corrige con éxito errores, demostrando que incluso cuando se equipa con codificadores de visión de alta resolución preentrenados en alineación de visión-lenguaje, las capacidades de Eagle se mejoran aún más al integrar expertos en visión adicionales preentrenados en tareas de visión diversas.

Evaluación de Benchmark Multimodal

Eagle se evalúa en siete pruebas de benchmark para MLLMs para demostrar sus capacidades desde diferentes perspectivas, incluyendo MME, MMBench, SEED, MathVista, MMMU, ScienceQA y POPE. Específicamente, MME, MMBench y SEED evalúan el rendimiento general en varias tareas del mundo real que involucran razonamiento, reconocimiento, conocimiento y OCR. MMMU se centra en problemas desafiantes de diversos dominios que requieren conocimientos de nivel universitario. POPE evalúa las alucinaciones visuales de los MLLMs. Las métricas utilizadas en esta evaluación se adhieren a la configuración predeterminada de estas pruebas de benchmark. Eagle informa la puntuación de percepción para MME, la división en_dev para MMBench, la división de imagen de SEED, la división de prueba-mini de MathVista, la división de val de MMMU, la puntuación F1 de POPE y la puntuación de imagen para ScienceQA, garantizando la alineación con las puntuaciones informadas de otros modelos.

Pensamientos Finales

En este artículo, hemos hablado sobre Eagle, un análisis en profundidad del espacio de diseño para integrar codificadores de visión en modelos de lenguaje grande multimodal. A diferencia de los trabajos anteriores que se centran en diseñar nuevos paradigmas de fusión, Eagle encuentra que las elecciones de diseño sistemáticas son importantes y descubre una serie de técnicas útiles. Paso a paso, Eagle optimiza la receta de entrenamiento de los codificadores de visión individuales, identifica un método de fusión extendible y eficiente y combina gradualmente los codificadores de visión con diferentes conocimientos de dominio. Los resultados destacan la importancia crítica de consideraciones básicas del espacio de diseño.