Inteligencia artificial

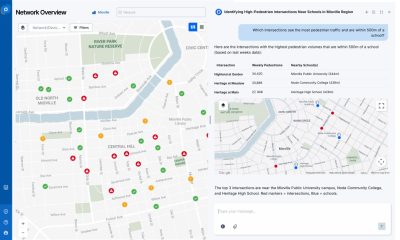

DeepSeek-V3 Presentado: Cómo el Diseño de IA Consciente del Hardware Reduce Costos y Mejora el Rendimiento

DeepSeek-V3 representa un avance en el desarrollo de IA rentable. Demuestra cómo el diseño inteligente de hardware y software puede ofrecer un rendimiento de última generación sin costos excesivos. Al entrenar con solo 2,048 NVIDIA H800 GPUs, este modelo logra resultados notables a través de enfoques innovadores como la Atención Latente Multicabezal para la eficiencia de memoria, la arquitectura de Mezcla de Expertos para la computación optimizada y el entrenamiento de precisión mixta FP8 que desbloquea el potencial del hardware. El modelo muestra que los equipos más pequeños pueden competir con las grandes empresas de tecnología a través de elecciones de diseño inteligentes en lugar de escalado por fuerza bruta.

El Desafío de la Escalabilidad de la IA

La industria de la IA enfrenta un problema fundamental. Los grandes modelos de lenguaje están creciendo y se vuelven más poderosos, pero también exigen enormes recursos computacionales que la mayoría de las organizaciones no pueden pagar. Las grandes empresas de tecnología como Google, Meta y OpenAI despliegan clústeres de entrenamiento con decenas o cientos de miles de GPUs, lo que hace que sea difícil para los equipos de investigación más pequeños y las startups competir.

Esta brecha de recursos amenaza con concentrar el desarrollo de la IA en manos de unas pocas grandes empresas de tecnología. Las leyes de escalabilidad que impulsan el progreso de la IA sugieren que los modelos más grandes con más datos de entrenamiento y potencia computacional conducen a un mejor rendimiento. Sin embargo, el crecimiento exponencial en los requisitos de hardware ha hecho que cada vez sea más difícil para los jugadores más pequeños competir en la carrera de la IA.

Los requisitos de memoria han surgido como otro desafío importante. Los grandes modelos de lenguaje necesitan recursos de memoria significativos, con una demanda que aumenta en más de 1000% por año. Mientras tanto, la capacidad de memoria de alta velocidad crece a un ritmo mucho más lento, típicamente menos de 50% anual. Esta discrepancia crea lo que los investigadores llaman el “muro de memoria de la IA“, donde la memoria se convierte en el factor limitante en lugar de la potencia computacional.

La situación se vuelve aún más compleja durante la inferencia, cuando los modelos sirven a usuarios reales. Las aplicaciones modernas de la IA a menudo involucran conversaciones de varios giros y contextos largos, que requieren mecanismos de caché poderosos que consumen una cantidad sustancial de memoria. Los enfoques tradicionales pueden abrumar rápidamente los recursos disponibles y hacer que la inferencia eficiente sea un desafío técnico y económico significativo.

El Enfoque Consciente del Hardware de DeepSeek-V3

DeepSeek-V3 está diseñado con la optimización del hardware en mente. En lugar de utilizar más hardware para escalar modelos grandes, DeepSeek se centró en crear diseños de modelos conscientes del hardware que optimicen la eficiencia dentro de las restricciones existentes. Este enfoque permite a DeepSeek lograr un rendimiento de última generación utilizando solo 2,048 NVIDIA H800 GPUs, una fracción de lo que normalmente requieren los competidores.

La idea clave detrás de DeepSeek-V3 es que los modelos de IA deben considerar las capacidades del hardware como un parámetro clave en el proceso de optimización. En lugar de diseñar modelos en aislamiento y luego descubrir cómo ejecutarlos de manera eficiente, DeepSeek se centró en construir un modelo de IA que incorpore una comprensión profunda del hardware en el que opera. Esta estrategia de codiseño significa que el modelo y el hardware trabajan juntos de manera eficiente, en lugar de tratar el hardware como una restricción fija.

El proyecto se basa en las ideas clave de los modelos DeepSeek anteriores, particularmente DeepSeek-V2, que introdujo innovaciones exitosas como DeepSeek-MoE y Atención Latente Multicabezal. Sin embargo, DeepSeek-V3 amplía estas ideas al integrar el entrenamiento de precisión mixta FP8 y desarrollar nuevas topologías de red que reducen los costos de infraestructura sin sacrificar el rendimiento.

Este enfoque consciente del hardware se aplica no solo al modelo, sino también a toda la infraestructura de entrenamiento. El equipo desarrolló una red de árbol graso de dos capas de Multi-Plano para reemplazar las topologías tradicionales de tres capas, lo que reduce significativamente los costos de networking del clúster. Estas innovaciones en la infraestructura demuestran cómo el diseño reflexivo puede lograr ahorros de costos importantes en toda la cadena de desarrollo de la IA.

Innovaciones Clave que Impulsan la Eficiencia

DeepSeek-V3 aporta varias mejoras que aumentan significativamente la eficiencia. Una de las innovaciones clave es el mecanismo de Atención Latente Multicabezal (MLA), que aborda el alto uso de memoria durante la inferencia. Los mecanismos de atención tradicionales requieren cachear vectores Clave y Valor para todas las cabezas de atención. Esto consume enormes cantidades de memoria a medida que las conversaciones se vuelven más largas.

MLA resuelve este problema al comprimir las representaciones de Clave-Valor de todas las cabezas de atención en un vector latente más pequeño utilizando una matriz de proyección entrenada con el modelo. Durante la inferencia, solo este vector latente comprimido necesita ser almacenado en caché, lo que reduce significativamente los requisitos de memoria. DeepSeek-V3 requiere solo 70 KB por token en comparación con 516 KB para LLaMA-3.1 405B y 327 KB para Qwen-2.5 72B1.

La arquitectura de Mezcla de Expertos proporciona otra ganancia de eficiencia crucial. En lugar de activar todo el modelo para cada cálculo, MoE activa selectivamente solo las redes de expertos más relevantes para cada entrada. Este enfoque mantiene la capacidad del modelo mientras reduce significativamente la computación real requerida para cada paso hacia adelante.

El entrenamiento de precisión mixta FP8 mejora aún más la eficiencia al cambiar de precisión de punto flotante de 16 bits a 8 bits. Esto reduce el consumo de memoria en un 50% mientras mantiene la calidad del entrenamiento. Esta innovación aborda directamente el muro de memoria de la IA al hacer un uso más eficiente de los recursos de hardware disponibles.

El Módulo de Predicción de Múltiples Tokens agrega otra capa de eficiencia durante la inferencia. En lugar de generar un token a la vez, este sistema puede predecir múltiples tokens futuros simultáneamente, lo que aumenta significativamente la velocidad de generación a través de la codificación especulativa. Este enfoque reduce el tiempo total necesario para generar respuestas, mejorando la experiencia del usuario mientras reduce los costos computacionales.

Lecciones Clave para la Industria

El éxito de DeepSeek-V3 proporciona varias lecciones clave para la industria de la IA en general. Muestra que la innovación en la eficiencia es tan importante como escalar el tamaño del modelo. El proyecto también destaca cómo el diseño cuidadoso de hardware y software puede superar los límites de recursos que de otro modo restringirían el desarrollo de la IA.

Este enfoque de diseño consciente del hardware podría cambiar la forma en que se desarrolla la IA. En lugar de ver el hardware como una limitación que hay que sortear, las organizaciones podrían tratarlo como un factor de diseño clave que da forma a la arquitectura del modelo desde el principio. Este cambio de mentalidad puede conducir a sistemas de IA más eficientes y rentables en toda la industria.

La efectividad de técnicas como MLA y el entrenamiento de precisión mixta FP8 sugiere que todavía hay un margen significativo para mejorar la eficiencia. A medida que el hardware continúa avanzando, surgirán nuevas oportunidades de optimización. Las organizaciones que aprovechen estas innovaciones estarán mejor preparadas para competir en un mundo con crecientes limitaciones de recursos.

Las innovaciones en la red de DeepSeek-V3 también enfatizan la importancia del diseño de la infraestructura. Si bien se centra mucho en las arquitecturas de los modelos y los métodos de entrenamiento, la infraestructura juega un papel crítico en la eficiencia y el costo generales. Las organizaciones que construyen sistemas de IA deben priorizar la optimización de la infraestructura junto con las mejoras del modelo.

El proyecto también demuestra el valor de la investigación abierta y la colaboración. Al compartir sus ideas y técnicas, el equipo DeepSeek contribuye al avance general de la IA mientras establece su posición como líderes en el desarrollo eficiente de la IA. Este enfoque beneficia a toda la industria al acelerar el progreso y reducir la duplicación de esfuerzos.

La Parte Inferior

DeepSeek-V3 es un paso importante hacia adelante en la inteligencia artificial. Muestra que el diseño cuidadoso puede ofrecer un rendimiento comparable, o mejor, que simplemente escalar los modelos. Al utilizar ideas como la Atención Latente Multicabezal, las capas de Mezcla de Expertos y el entrenamiento de precisión mixta FP8, el modelo alcanza resultados de última generación mientras reduce significativamente las necesidades de hardware. Este enfoque en la eficiencia del hardware da a los laboratorios y empresas más pequeños nuevas oportunidades de construir sistemas avanzados sin presupuestos enormes. A medida que la IA continúa desarrollándose, enfoques como los de DeepSeek-V3 se volverán cada vez más importantes para garantizar que el progreso sea sostenible y accesible. DeepSeek-3 también enseña una lección más amplia. Con elecciones de arquitectura inteligentes y una optimización ajustada, podemos construir una IA poderosa sin la necesidad de recursos y costos extensos. De esta manera, DeepSeek-V3 ofrece a toda la industria una ruta práctica hacia una IA rentable y más accesible que ayuda a muchas organizaciones y usuarios en todo el mundo.