División sintética

Deepfakes y clones de voz impulsan un aumento del 148% en las estafas de suplantación de identidad por IA

Unite.AI está comprometida con rigurosos estándares editoriales. Podemos recibir una compensación cuando hace clic en los enlaces a los productos que revisamos. Por favor vea nuestro divulgación de afiliados.

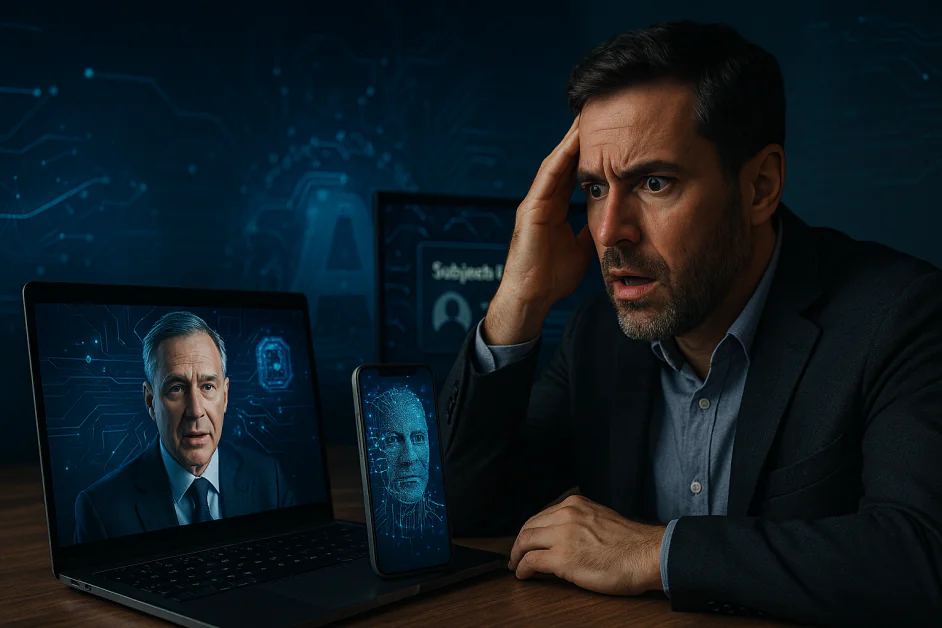

Tanto los profesionales de negocios como los consumidores se enfrentan a una nueva generación de estafadores dotados de inteligencia artificial. En una era donde ver es creer, los delincuentes están explotando la IA para potenciar sus viejas estrategias con trucos inquietantemente realistas. Casos recientes involucran desde videos deepfake hasta voces clonadas y correos electrónicos escritos por IA que se utilizan como arma para el fraude. El resultado es un aumento meteórico de las estafas de suplantación de identidad de alta tecnología: el Centro de Recursos contra el Robo de Identidad informa de una cifra asombrosa. Aumento del 148% en los casos de estafa por suplantación de identidad entre abril de 2024 y marzo de 2025Esta ola de estafas basadas en IA abarca sitios web empresariales falsos, agentes de atención al cliente que imitan a representantes reales de empresas mediante chatbots e incluso llamadas telefónicas clonadas. Estos esquemas son tan convincentes que incluso profesionales expertos han sido engañados, lo que ha provocado advertencias urgentes de expertos en ciberseguridad y las fuerzas del orden.

De hecho, el FBI ha dado la voz de alarma de que los ciberdelincuentes están... Utilizando la IA como arma para lanzar campañas de phishing altamente realistas y suplantaciones de identidad deepfakeEn lugar de los torpes correos electrónicos fraudulentos del pasado, los mensajes fraudulentos de hoy vienen pulidos a la perfección, a menudo gramaticalmente impecables y adaptados a víctimas específicas, mientras que deepfake El audio o el video pueden suplantar voces y rostros familiares en tiempo real. Estas tácticas de engaño impulsadas por IA explotan la confianza y crean una falsa sensación de urgencia, lo que aumenta la probabilidad de que las víctimas sean engañadas. Las consecuencias de ser víctima son graves, desde fraude financiero hasta violaciones de la privacidad y daños a la reputación, como se explica a continuación.

La rápida evolución de las estafas impulsadas por IA

Hace tan solo unos años, una llamada o correo electrónico fraudulento solía ser fácil de detectar por su redacción extraña o la baja calidad del audio. Ahora, los avances en IA han revolucionado el panorama. Mediante algoritmos de deepfake, los estafadores pueden generar videos y audios increíblemente realistas que simulan a personas reales, desde directores ejecutivos hasta seres queridos. Las herramientas de clonación de voz con IA pueden, con solo una breve muestra, crear una...gemelo digital” De la voz de alguien. Los estafadores han usado este truco para hacerse pasar por ejecutivos de empresas que dan órdenes o familiares que piden ayuda. Por ejemplo, un incidente reciente involucró a un estafador que clonó la voz de un nieto para convencer a una víctima mayor de que su nieto tenía problemas urgentes y necesitaba dinero rápido. En el ámbito corporativo, se han utilizado audios deepfake para suplantar a directores ejecutivos y autorizar transferencias bancarias fraudulentas. En un caso de 2024, los delincuentes atacaron al gigante publicitario WPP falsificando la voz de su director ejecutivo durante una reunión virtual, un engaño que, afortunadamente, se detectó a tiempo. Otras estafas de voz con IA han... Engañó con éxito al personal del banco y estafó a empresas financieras por millones de dólares., demostrando lo efectivas que pueden ser estas técnicas.

Más allá de la voz y el vídeo, la IA generativa se está utilizando para escribir phishing, Los mensajes y crean sitios web falsos con una precisión asombrosa. Los sofisticados correos electrónicos de phishing ahora llegan sin los errores tipográficos o la gramática incómoda que antes delataban a los estafadores. Los atacantes están aprovechando la IA para crear mensajes de phishing dirigidos que se leen como si los hubiera escrito un profesional, con gramática correcta y detalles personalizados, lo que aumenta la probabilidad de éxito en el engaño y el robo de datos. Al mismo tiempo, los delincuentes pueden crear sitios web comerciales falsificados que parecen inquietantemente legítimos. Estos sitios fraudulentos a menudo incluyen chatbots convincentes basados en IA y agentes de voz clonados que se hacen pasar por representantes reales de la empresa para engañar a las víctimas y que ingresen contraseñas, números de tarjetas de crédito u otra información confidencial. Suplantar la identidad de organizaciones de confianza es una estrategia común; el ITRC descubrió que Más de la mitad de las estafas de suplantación de identidad del año pasado involucraron estafadores que se hicieron pasar por empresas legítimas, y otro 21% fingió ser instituciones financieras.

Como una evolución adicional, algunos estafadores incluso están usando IA para fabricar “identidades sintéticasEsto implica combinar datos personales reales y falsos para crear una identidad ficticia que se hace pasar por una persona legítima. Con fotos de perfil generadas por IA y datos personales plausibles, los delincuentes pueden abrir cuentas bancarias o líneas de crédito bajo estas identidades sintéticas, cometiendo robo de identidad de forma sigilosa. En esencia, las identidades sintéticas combinan datos reales y falsos para parecer auténticas, lo que permite a los estafadores abrir cuentas o cometer robo de identidad. Esta táctica les permite eludir las comprobaciones de identidad tradicionales haciéndose pasar por una persona completamente nueva (pero falsa), lo que dificulta que los bancos o las agencias de crédito detecten el fraude.

Riesgos del mundo real: fraude, robo y daño a la reputación

Las implicaciones de estas estafas impulsadas por IA son graves y muy reales. Las víctimas pueden sufrir pérdidas financieras directas a medida que se desvía el dinero o se acumulan los cargos fraudulentos. También pueden enfrentarse al robo de información personal y al robo de identidad si los delincuentes recopilan y utilizan indebidamente sus datos. Una estafa de deepfake o suplantación de identidad exitosa puede vaciar cuentas bancarias, acumular deudas o secuestrar cuentas confidenciales antes de que la víctima se dé cuenta. Las autoridades advierten que estas tácticas sofisticadas ya están dando lugar a... Pérdidas financieras devastadoras y compromiso de datos confidencialesDe hecho, una vez que los estafadores logran acceder, ya sea mediante un correo electrónico ingeniosamente falsificado o una llamada de voz convincente, las consecuencias económicas y de privacidad pueden ser catastróficas.

Para las empresas, los riesgos son igualmente altos. Una estafa deepfake de CEO bien ejecutada puede engañar a los empleados para que inicien transferencias bancarias no autorizadas o divulguen información confidencial, lo que podría costarles a las empresas enormes sumas y problemas legales. Más allá del impacto financiero inmediato, las organizaciones también se arriesgan a dañar su reputación y la confianza de los clientes. Si se revela que un ejecutivo de una empresa fue suplantado o que su marca fue utilizada en una estafa, los clientes pueden desconfiar. Incluso cuando un intento de fraude se detecta a tiempo, la mera existencia de estas falsificaciones siembra confusión. Las empresas han tenido que advertir a clientes y empleados sobre las comunicaciones falsas que circulan en su nombre. Por ejemplo, WPP, la empresa de publicidad más grande del mundo, reveló que ha estado lidiando con sitios web y mensajes fraudulentos que suplantan la marca de la empresa y está trabajando con las autoridades para desmantelar a esos impostores.

Las personas también pueden sufrir daños duraderos a su reputación debido a las falsificaciones de IA. Un video o clip de audio convincentemente falsificado puede difundirse en línea y manchar la reputación de una persona antes de que se descubra la verdad. En un caso inquietante, un director de escuela en Baltimore fue suspendido tras la aparición de una grabación de audio donde hacía comentarios ofensivos, solo para que los investigadores descubrieran que se trataba de una falsificación profunda maliciosa generada por un colega. Estos incidentes ponen de relieve una realidad escalofriante: las mentiras generadas por IA no solo pueden robar dinero o datos, sino también difamar la reputación de una persona inocente. Tanto para figuras públicas como para ciudadanos particulares, la erosión de la confianza causada por deepfakes Es una seria preocupación. Cuando se puede obligar a cualquiera a decir o hacer cualquier cosa en video, se vuelve mucho más difícil confiar en lo que vemos y oímos, lo que socava la confianza en las comunicaciones legítimas.

Cómo reconocer y prevenir las estafas de IA

Aunque las estafas de IA son cada vez más sofisticadas, aún existen señales de alerta y medidas de protección que pueden ayudar a prevenir estos fraudes. Los expertos en seguridad recomiendan estar atentos a cualquier indicio de que algo no anda bien. A menudo, los estafadores crean una falsa sensación de urgencia; por ejemplo, una persona que llama (quizás haciéndose pasar por un jefe o un familiar) exige que se actúe de inmediato sobre un problema. Esta presión para omitir la verificación y "hacerlo ya" es una señal de alerta clásica. Las instituciones legítimas rara vez insisten en que se omitan todos los procedimientos estándar de inmediato. Si siente una urgencia excesiva, deténgase y verifique a través de un segundo canal antes de tomar cualquier medida.

Además, confía en tu instinto si una interacción de voz o video te parece extraña. Incluso las mejores tecnologías de deepfake a veces presentan fallos sutiles. Una voz clonada puede sonar anormalmente plana o robótica, y un video sintetizado por IA puede tener una sincronización labial ligeramente dispareja, una iluminación extraña o movimientos oculares poco naturales. De igual manera, presta atención a los correos electrónicos o mensajes de texto que parecen demasiado perfectos. Muchos mensajes de phishing generados por IA tienen un formato impecable y una gramática correcta (mucho mejor redactados que un correo electrónico humano promedio), pero pueden parecer extrañamente genéricos y carecer de detalles personales que un conocido o colega real incluiría. Esa paradoja de un mensaje con un lenguaje impecable pero un contenido impersonal puede ser una señal de alerta de que estás lidiando con una estafa creada por IA.

Otra señal de alerta importante es cualquier solicitud no solicitada de información confidencial o pago que llega por correo electrónico, mensaje de texto o una llamada telefónica inesperada. Tenga mucho cuidado con los mensajes que le piden contraseñas, códigos de acceso, números de la Seguridad Social u otros datos personales. Asimismo, solicitudes de pagos a través de métodos no convencionales —como transferencias de criptomonedas, tarjetas de débito prepagadas o códigos de tarjetas de regalo— son un sello distintivo de las estafas, ya que estas formas de pago son difíciles de rastrear o revertir una vez enviadas. Si alguien que dice ser de una empresa o agencia gubernamental de buena reputación te indica que pagues con Bitcoin o tarjetas de regalo, es casi seguro que se trata de un fraude. Siempre verifica la identidad del solicitante a través de los canales oficiales. Por ejemplo, si recibes un correo electrónico que parece ser de tu banco pidiéndote que actualices tu cuenta, no hagas clic en ningún enlace. En su lugar, llama al banco usando el número que aparece en el reverso de tu tarjeta de crédito o visita su sitio web verificado para confirmar. Las estafas de IA a menudo imitan a bancos, agencias gubernamentales o incluso a amigos y familiares, por lo que la verificación independiente es crucial. Una llamada de dos minutos puede evitarte un error costoso.

En términos de prevención, algunas medidas prácticas pueden reducir drásticamente el riesgo. Limite la información personal que comparte públicamente en línea: los estafadores extraen información de las redes sociales como su fecha de nacimiento, empleador o nombres de familiares para hacer que sus suplantaciones de identidad sean más creíbles. Cuanto menos exponga, con menos recursos tendrán que trabajar. Implemente una seguridad sólida en sus cuentas importantes: use autenticación multifactor (MFA) Siempre que esté disponible, de modo que, incluso si roban una contraseña, un ladrón necesite ese segundo código o confirmación para acceder. Actualizar regularmente el software y los dispositivos también es fundamental, ya que las actualizaciones suelen corregir vulnerabilidades de seguridad que los hackers explotan. Y considere usar un administrador de contraseñas para crear y almacenar contraseñas complejas y únicas; de esta manera, una vulneración de un sitio no expondrá las claves de toda su vida digital.

Las empresas deberían invertir en la formación de sus empleados y en la defensa técnica. La formación regular puede enseñar al personal a detectar intentos de phishing y deepfakes, reforzando así una cultura de "confianza, pero verificación". Al mismo tiempo, las herramientas modernas de seguridad del correo electrónico pueden filtrar muchos correos electrónicos de phishing antes de que lleguen a las bandejas de entrada. Las empresas también podrían establecer políticas estrictas para verificar cualquier solicitud de transferencia de fondos o intercambio de datos confidenciales; por ejemplo, exigiendo una segunda autorización o una confirmación telefónica con un número conocido. Estas medidas pueden frenar una estafa de IA, incluso si el contacto inicial engañó a alguien. En resumen, combinar la vigilancia humana con la tecnología de seguridad inteligente es la mejor fórmula para mantenerse a salvo.

Por muy cuidadoso que sea, es recomendable prepararse para la posibilidad de que algunos datos personales aún puedan verse comprometidos, ya sea por una filtración de datos, una contraseña filtrada o una estafa de IA que supere las defensas. Aquí es donde servicios de vigilancia y protección contra robo de identidad Puede proporcionar una red de seguridad adicional.

Reforzando las defensas con NordProtect

Una solución prometedora para la tranquilidad es utilizar un proveedor confiable servicio de protección de identidad que vigila el uso indebido de su información personal. Por ejemplo, NordVPNNordProtect ofrece un conjunto integral de protecciones diseñadas para la era de las estafas de IA. NordProtect Ofrece monitoreo continuo de la dark web, escaneando foros delictivos y volcados de datos para alertarte si se detecta que tus datos personales (como direcciones de correo electrónico, contraseñas o número de la Seguridad Social) circulan donde no deberían. También incluye rastreo de crédito e identidad: vigila tus archivos de crédito y registros públicos para detectar cualquier cambio repentino o nuevas cuentas que puedan indicar que alguien está usando tu identidad de forma fraudulenta. Los usuarios reciben alertas de seguridad instantáneas en cuanto se detecta una amenaza o actividad irregular, lo que permite actuar rápidamente para bloquear cuentas antes de que se produzcan daños.

Es importante destacar que servicios como NordProtect no solo monitorean, sino que también ayudan a responder. NordProtect ofrece soporte dedicado e incluso protección financiera para ayudar a las víctimas de delitos de identidad. De hecho, ofrece hasta $1 millón en cobertura de seguro de recuperación por robo de identidad, lo que ayuda a cubrir costos como honorarios legales o fondos robados en el peor de los casos. Este tipo de respaldo puede ser fundamental para recuperarse de las consecuencias de una estafa de IA. Al usar una solución como NordProtect, junto con buenos hábitos de seguridad, las personas y las empresas pueden fortalecer drásticamente su defensa contra las deepfakes y las estafas basadas en IA.

En conclusión, mantenerse a la vanguardia del fraude impulsado por IA requiere vigilancia y las herramientas adecuadas. El panorama de las estafas puede estar evolucionando a un ritmo vertiginoso con deepfakes, clones de voz e identidades sintéticas, pero la concienciación y la preparación pueden inclinar la balanza a favor de los defensores. Conocer las señales de alerta de estas nuevas estafas, practicar la verificación y el escepticismo, y aprovechar servicios de protección confiables como NordProtectPuedes reducir el riesgo de ser víctima. En un mundo donde la tecnología arma a los delincuentes, nunca ha sido tan crucial que los buenos también se protejan, y recordar que cuando algo no te parece bien, una buena dosis de duda es tu mejor aliado. Mantente informado, sé precavido y estarás en una buena posición para burlar incluso al estafador más astuto.