Ángulo de Anderson

La IA Prefiere Leer el Libro Que Ver la Pelicula

Es sorprendentemente difícil hacer que los modelos de IA vean y comenten contenido de video real, incluso si están diseñados para esta tarea. Están más interesados en la palabra escrita.

Si alguna vez has intentado subir un clip de video pequeño a ChatGPT, o a un modelo de visión/lenguaje popular similar, es posible que te hayas sorprendido al darte cuenta de que no pueden analizar realmente el video. Mientras que modelos como ChatGPT-4o+ son capaces de analizar individualmente los fotogramas – en forma de imágenes, como JPEG y PNG -, prefieren que el usuario extraiga sus propios fotogramas y los suba como imágenes (que están preparados para comentar).

En el caso de la serie GPT de OpenAI, se puede, de manera bastante laboriosa, extraer una ejecución completa de fotogramas de un clip de video y alimentarlos a ChatGPT, para fines como generar una pista de narrativa creada por IA para el video:

![Imágenes y código de un tutorial de OpenAI sobre el análisis de múltiples fotogramas extraídos con el fin de desarrollar un comentario generado por IA para un clip de video. [ Fuente ] https://cookbook.openai.com/examples/gpt_with_vision_for_video_understanding](https://www.unite.ai/wp-content/uploads/2025/10/openai-gpt-frame-parsing.jpg)

Imágenes y código de un tutorial de OpenAI sobre el análisis de múltiples fotogramas extraídos con el fin de desarrollar un comentario generado por IA para un clip de video. Fuente

Pero depende del usuario realizar la conversión de video a fotogramas, ya sea llamando a funciones en una rutina más grande, como en el ejemplo anterior, o extrayendo los fotogramas con FFMPEG o diversas soluciones de edición de video gratuitas y de pago.

En cierta medida, quizás en gran medida, las limitaciones en el análisis de video en productos de gran escala como ChatGPT se deben a uso de recursos: simplemente equipar una instancia de IA con una selección de los codecs de video más populares y comprometer recursos de cómputo con el proceso de extracción intensivo en disco y que puede bloquear la CPU no es una consideración menor, si cientos de millones de usuarios deciden comenzar a utilizar estas instalaciones todos los días.

Además, el análisis temporal puede pintar una imagen muy diferente que un solo fotograma (imagina a alguien que entra en una casa con buen humor y luego descubre un cuerpo); por lo tanto, considerar la “suma de comprobación” temporal completa de incluso un clip de video corto es una tarea exigente y intensiva en recursos – así como un área especializada de la literatura de investigación, por ejemplo, con el desarrollo continuo de marcos como Optical Flow – que esencialmente “despliega” una longitud de video para que pueda ser considerado y actuado como si fuera un documento estático:

![Los diagramas de flujo óptico resaltan cómo se rastrea el movimiento a través de los fotogramas en una secuencia de video, con vectores verdes que muestran la dirección y la intensidad del movimiento. Estos mapeos proporcionan la continuidad temporal necesaria para los VLM y también pueden servir como guías estructurales en flujos de trabajo de VFX. [ Fuente ] https://www.researchgate.net/figure/Optical-flow-field-vectors-shown-as-green-vectors-with-red-end-points-before-and-after_fig6_290181771](https://www.unite.ai/wp-content/uploads/2025/10/optical-flow.jpg)

Los diagramas de flujo óptico resaltan cómo se rastrea el movimiento a través de los fotogramas en una secuencia de video, con vectores verdes que muestran la dirección y la intensidad del movimiento. Estos mapeos proporcionan la continuidad temporal necesaria para los VLM y también pueden servir como guías estructurales en flujos de trabajo de VFX. Fuente

Conformándose con los Apuntes del Acantilado

No obstante, como modelos como Notebook LM de Google y las entradas más recientes de ChatGPT pueden leer metadatos asociados (es decir, contenido de texto incrustado que contextualiza el video de alguna manera), no prohíben la carga de archivos de video; y a veces, incluso intentarán interpretar un video que no tiene dichos datos.

En el siguiente caso, subí un clip aleatorio de 6 segundos de la película italiana La Mano de Dios (2021) a NotebookLM, asegurándome de que el clip no contenía texto útil, ni en los metadatos ni en el nombre del archivo.

NotebookLM procedió a elaborar material completamente ajeno al video*, completo con un podcast de cinco minutos de cabeza a cabeza sin sentido y no relacionado:

Un momento cotidiano en un clip de seis segundos de una película italiana es malinterpretado por NotebookLM. Fuente: Google NotebookLM

Aunque Notebook, al igual que ChatGPT, aceptará un video de YouTube como entrada, solo lo hará si el video cuenta con una anotación de texto interpretable y/o subtítulos (no subtítulos rasterizados que se han incrustado en el video).

De esta manera, el trabajo duro de mirar y escuchar el contenido del video y realizar una interpretación semántica del mismo (una necesidad legal para YouTube, debido a sus medidas de protección de derechos de autor, y su sistema de protección de identidad pendiente), se ha realizado con antelación después de la carga del usuario, y cuando el clip podía asignarse los recursos de procesamiento necesarios.

La interpretación real de video es costosa y agotadora, y, resulta que, incluso los modelos que han sido entrenados específicamente para realizar esta tarea prefieren leer texto que mirar realmente el video.

TL;DW

Esto, según un nuevo documento del Reino Unido de la Universidad de Bristol, titulado Un video no vale mil palabras, en el que los dos autores concluyen que los modelos de visión y lenguaje actuales (VLM) – modelos destinados a ser capaces de analizar video de una manera más esforzada, y a participar en preguntas y respuestas de video (VQA) – también se basan en la información basada en texto siempre que puedan.

Cuando se les dio tanto imágenes en movimiento como preguntas y respuestas múltiples, los autores del documento encontraron que los modelos generalmente basaron sus elecciones en patrones en el texto, en lugar de lo que sucedía en la pantalla – en muchos casos, actuando tan bien incluso cuando la pregunta se eliminó por completo.

En lo que parece ser una forma habitual de atajo o engaño, lo que más le importaba a la mayoría de los modelos era poder detectar patrones en las posibles respuestas; solo cuando la tarea se hizo más difícil, al agregar más opciones de respuesta, los IA comenzaron a prestar más atención al video.

Los autores dieron pruebas de VQA en una variedad de condiciones a seis modelos de VLM de longitudes de contexto diversas; y encontraron que los resultados indicaron la dependencia de los modelos en el texto sobre el contenido del video.

![Ejemplo del estudio que muestra cómo un modelo de análisis de video pondera lo que ve versus lo que lee. El clip muestra a una persona tejiendo bambú, pero el modelo asigna mucha más importancia al texto de la pregunta y la respuesta que a los fotogramas del video en sí. Los destacados en azul marcan los elementos que respaldan la respuesta elegida, mientras que los destacados en rojo marcan aquellos que la alejan en la dirección opuesta, ilustrando cómo la razonamiento del modelo se centra en la redacción en lugar de en las imágenes en movimiento. [ Fuente ] https://arxiv.org/pdf/2510.23253](https://www.unite.ai/wp-content/uploads/2025/10/evaluation.jpg)

Ejemplo del estudio que muestra cómo un modelo de análisis de video pondera lo que ve versus lo que lee. El clip muestra a una persona tejiendo bambú, pero el modelo asigna mucha más importancia al texto de la pregunta y la respuesta que a los fotogramas del video en sí. Los destacados en azul marcan los elementos que respaldan la respuesta elegida, mientras que los destacados en rojo marcan aquellos que la alejan en la dirección opuesta, ilustrando cómo la razonamiento del modelo se centra en la redacción en lugar de en las imágenes en movimiento. Fuente

Método

Para entender cuánto contribuye cada parte de la entrada (video, texto, etc.) a la decisión del modelo, el nuevo trabajo utiliza un método de teoría de juegos llamado Valores de Shapley. Originalmente diseñado para dividir equitativamente una participación entre jugadores en una coalición, los Valores de Shapley asignan crédito a cada “jugador” en función de su impacto individual.

En efecto, los “jugadores” en este escenario son los fotogramas del video o los componentes de texto (anotaciones, subtítulos, subtítulos, etc.) de una tarea de VQA; y el “pago” es la respuesta final del modelo. Al probar sistemáticamente qué sucede cuando cada parte se agrega o elimina, la técnica revela cuán importante fue ese elemento para llegar a la respuesta elegida.

En el caso del nuevo proyecto, para extender el método a través de múltiples tipos de datos, los Valores de Shapley se adaptaron para manejar modalidades mixtas, con componentes de video y texto tratados discretamente, y su influencia variable en las salidas de los modelos se midió, lo que revela si el contenido del video se estaba interpretando realmente o si se estaban utilizando pistas escritas como atajos.

Métricas

Se definieron dos métricas simples para comparar cuánto contribuía cada modalidad (es decir, video, pregunta o respuesta) a la decisión del modelo: Contribución de modalidad mide cuánto de la explicación total provino de cada tipo de entrada; aquí, todos los valores de Shapley disponibles se suman y la participación que pertenece a cada modalidad se calcula como un porcentaje del total.

En segundo lugar, Contribución por característica corrige el hecho de que algunas modalidades, como el video, contienen muchas más características que otras. En lugar de eso, se calcula el valor de Shapley promedio para cada característica, y esas medias se comparan para determinar qué modalidad tiene una influencia dominante.

Datos y pruebas

Los autores probaron el enfoque en seis modelos de VLM con una variedad de características diseñadas para garantizar que los principios de las pruebas fueran ampliamente aplicables y generalizables. Por lo tanto, los modelos se eligieron por diferentes longitudes de contexto, diferentes edades (es decir, cuánto tiempo ha pasado desde que se lanzó el marco) y diferentes configuraciones de arquitectura.

Los contendientes fueron FrozenBiLM; InternVideo; VideoLLaMA2; VideoLLaMA3; LLaVa-Video (que aprovecha Qwen2); y LongVA (también utilizando Qwen2).

Con el mismo objetivo de diversidad, los cuatro conjuntos de datos objetivo elegidos fueron EgoSchema, un conjunto de datos de VQA diseñado para ser imposible de completar sin ver completamente los videos asociados; HD-EPIC, un conjunto de datos centrado en la cocina que presenta algunos videos inusualmente largos; MVBench, un conjunto de datos curado de contribuciones de otros conjuntos de datos; y LVBench, que plantea preguntas de VQA para videos muy largos.

De estos, los autores idearon 60 preguntas – diez de cada tipo de pregunta.

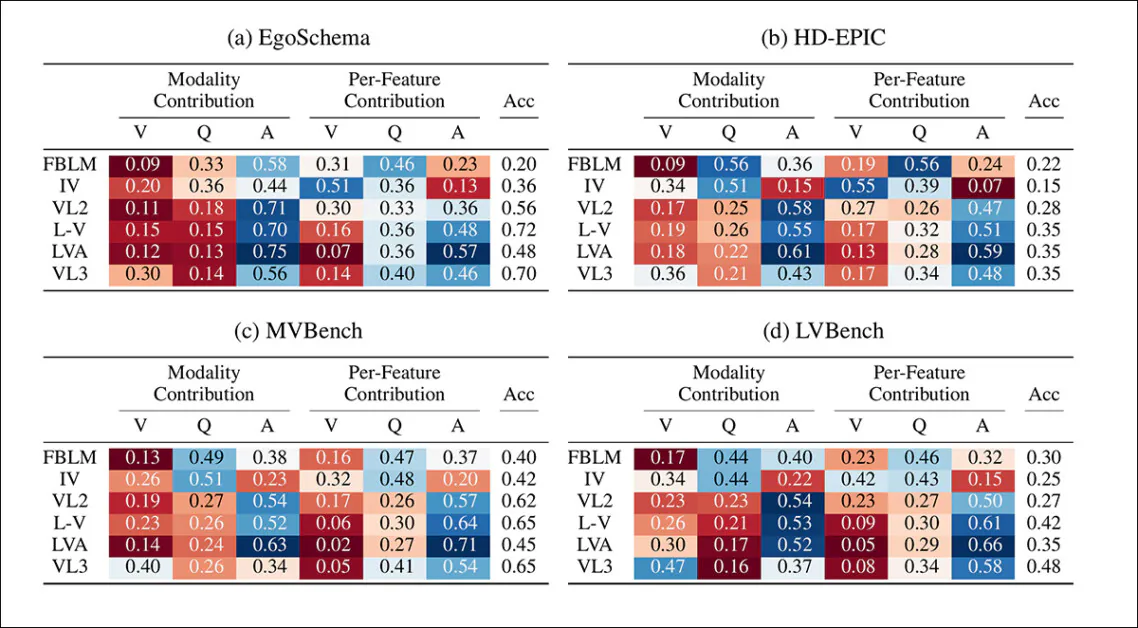

Las métricas de contribución hicieron claro que la mayoría de los modelos se basaban menos en el video que en el texto, especialmente cuando se juzgaba fotograma por fotograma. Incluso cuando el video hizo una aparición razonable en la contribución general, su influencia por característica fue a menudo mínima, lo que sugiere que aunque el modelo podría estar utilizando el video en agregado, estaba prestando poca atención a los fotogramas individuales. VideoLLaMA3 fue la principal excepción aquí, con una dependencia visual más pesada, especialmente en las secuencias más largas en LVBench:

Puntuaciones de contribución de modalidad (MC) y contribución por característica (PFC) en varios modelos y conjuntos de datos, que muestran el peso relativo de las entradas de video (V), pregunta (Q) y respuesta (A). Los colores más fríos indican contribuciones más fuertes; los colores más cálidos indican una influencia más débil o insignificante. En la mayoría de los ajustes, el lenguaje es claramente dominante, con el video a menudo marginado – especialmente en la influencia por fotograma.

En cuanto al texto, la pregunta tendió a ser más importante que la respuesta, particularmente en modelos más fuertes. Esto fue más obvio en conjuntos de datos como EgoSchema, donde las preguntas eran más largas y más naturalistas, mientras que las respuestas eran cortas y a veces esquemáticas. MVBench invirtió esto un poco, ya que su estructura de respuesta binaria infla la importancia aparente de los tokens de respuesta.

En todos los modelos y conjuntos de datos, la visión se marginó consistentemente, con el lenguaje haciendo la mayor parte del trabajo pesado.

El documento establece:

[Para] modelos de contexto largo, el video muestra contribuciones muy reducidas, lo que significa que por fotograma los valores de Shapley son mucho más pequeños que sus contrapartes de características de texto.

‘El video como modalidad en su conjunto sigue siendo claramente muy relevante, pero esto es evidencia de que los valores de Shapley de sus fotogramas individuales están más centrados alrededor de cero, y que la atención del modelo a ellos es mucho menos guiada que para el texto.’

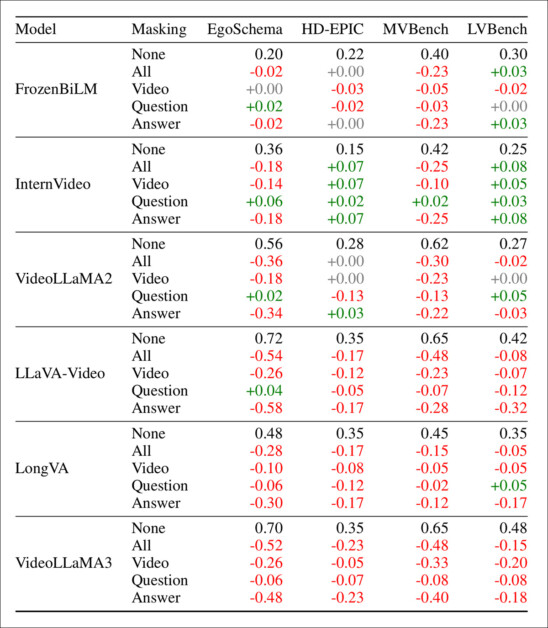

Para probar cómo cada parte de la entrada (video, texto, etc.) contribuye a la precisión del modelo, los investigadores realizaron pruebas adicionales utilizando enmascaramiento – ocultando deliberadamente una o más partes de la entrada y viendo cuánto cambia la precisión del modelo como resultado.

Si el rendimiento disminuye significativamente cuando se elimina una entrada en particular, esa entrada probablemente es importante; si el modelo actúa más o menos de la misma manera, sugiere que la pieza que faltaba no se utilizó en gran medida. En este sentido, las pruebas de enmascaramiento son una especie de estudio de ablación iterativo.

Impacto en el rendimiento del enmascaramiento de entradas de video, pregunta o respuesta en cuatro benchmarks de VQA. Las puntuaciones muestran el cambio desde la línea de base sin enmascarar. Rojo significa menor precisión, verde significa mayor precisión. Los modelos a menudo conservaron puntuaciones altas sin video, pero perdieron más cuando se eliminó la respuesta (texto). La pregunta podía enmascararse con un efecto mínimo.

Los resultados (visualizados arriba) indican que las respuestas (respuestas de texto en los datos de opción múltiple) llevan el peso más importante en todo el tablero. Enmascarar la respuesta generalmente causó la mayor disminución en la precisión, a menudo reduciendo los modelos a un rendimiento casi aleatorio.

Sin embargo, enmascarar la pregunta generalmente tuvo mucho menos efecto, lo que apoya el hallazgo anterior de que los modelos a menudo subestiman la pregunta.

En algunos casos, la precisión incluso mejoró cuando se eliminó la pregunta, lo que implica que los modelos a veces solo estaban emparejando respuestas con pistas visuales o textuales en lugar de evaluar adecuadamente la pregunta.

Los modelos también variaron en su dependencia del video: algunos mantuvieron una precisión razonable sin él, lo que confirmó aún más la contribución limitada de las características del video en la mayoría de los entornos actuales.

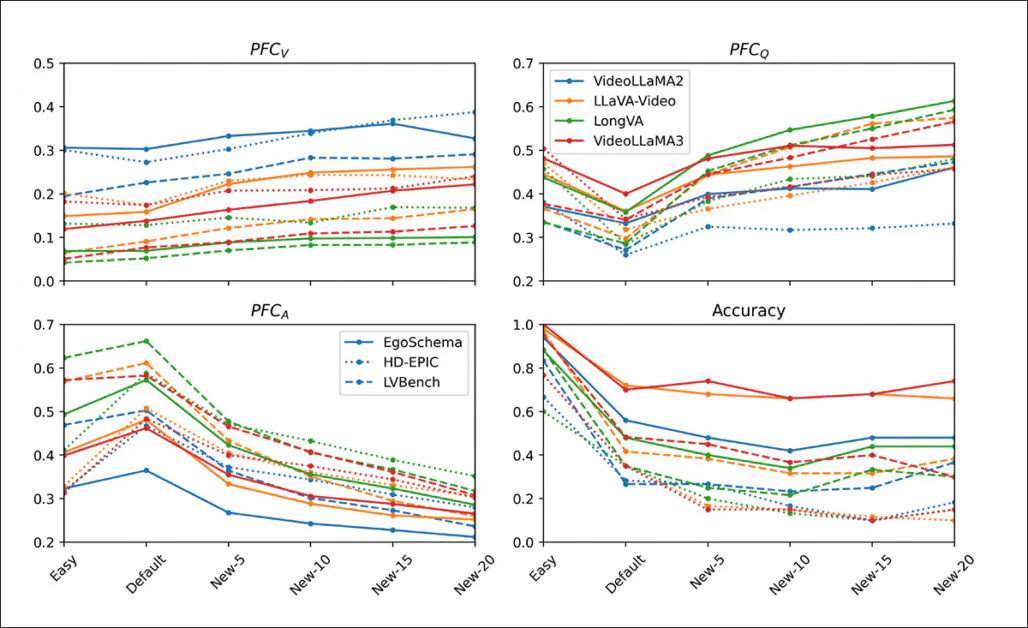

Los autores probaron posteriormente si los modelos podían ser forzados a depender del video al agregar respuestas incorrectas adicionales a las opciones de opción múltiple.

Cuando los distractores eran fáciles y se reciclaron de otras preguntas, el rendimiento mejoró, ya que los modelos emparejaron patrones de texto sin mucha razón. Pero con diez o más respuestas no relacionadas, comenzaron a depender más del video y la pregunta:

Contribución por característica y precisión para las entradas de video, pregunta y respuesta, a medida que se agregan respuestas incorrectas a cada prueba de VQA, que muestra que aumentar la cantidad de distractores reduce la dominancia del texto y aumenta la influencia relativa de las características visuales y de la pregunta.

Para VideoLLaMA3, enmascarar el video redujo la precisión en un 40% en EgoSchema y un 15% en LVBench, lo que indica que un simple aumento en el recuento de respuestas puede cambiar los modelos de atajos de texto a una razón multimodal genuina.

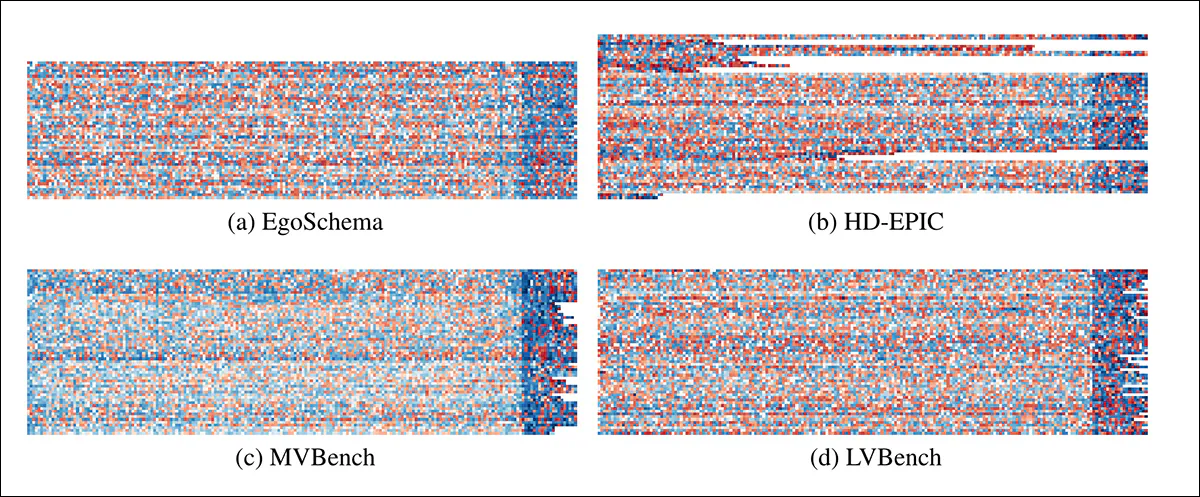

Los investigadores también exploraron cómo se distribuye la atribución a través de las entradas, y a continuación se muestran mapas de calor de los valores de Shapley para cada entrada del modelo:

Mapas de calor de los valores de Shapley para cuatro conjuntos de datos, donde cada fila muestra una tupla de VQA, y cada columna una característica individual. Las características del video aparecen a la izquierda, seguidas del texto. Los valores mucho más fuertes en las regiones de texto (rojo) confirman que los modelos se basan mucho más en el lenguaje que en el video.

Al comentar sobre los resultados anteriores, los autores declaran:

‘Los valores de Shapley son mucho más grandes hacia el lado derecho de cada mapa de calor, que representan las atribuciones de la pregunta y la respuesta. Este límite claro es donde terminan los fotogramas del video y comienzan las características del texto, lo que demuestra que la contribución de la modalidad del video es mucho menor que la pregunta/respuesta. ‘

En resumen, en todos los conjuntos de datos, los valores son mucho más fuertes hacia el extremo del texto del espectro, lo que indica firmemente que los modelos se basan mucho más en el lenguaje que en las pistas visuales. Incluso cuando el video se usa, la contribución se distribuye finamente a través de muchos fotogramas, a menudo sin un patrón consistente.

A continuación, se muestra un ejemplo anotado de EgoSchema. Se seleccionaron los 16 fotogramas más “importantes” utilizando los valores de Shapley y se colorearon según su influencia, con azul que indica una contribución positiva y rojo una negativa:

Atribuciones de Shapley para un ejemplo de EgoSchema, que muestra las 16 características más influyentes y todas las entradas de texto. Las contribuciones del video son mínimas en comparación con el texto, que domina la razón del modelo. Los azules y rojos indican influencia positiva y negativa en la respuesta seleccionada.

Conclusión

Cualquiera que haya participado en edición de video o análisis de video ya sabrá lo intensivo en recursos que son estos procesos, y entenderá por qué las empresas que analizan millones de solicitudes de IA al día no pueden permitirse el lujo de permitir procesos de edición y interpretación de video ad hoc y dirigidos por el usuario.

Una cosa que hay que recordar en este sentido es que casi todas las interfaces de API de IA que intentarás (con la posible excepción de una nueva y efímera demostración en apoyo de una nueva investigación científica) están tratando de cumplir los deseos de los usuarios al nivel más bajo posible de gasto de recursos.

Eso significa confiar en los metadatos existentes de los datos proporcionados por el usuario o RAG de recuperación, si es posible; y extraer (si es absolutamente necesario) metadatos para formatos más parseables como PDF, documentos y imágenes individuales.

Lo que no está en la mesa es ejecutar su archivo de video cargado a través de CLIP o la última versión de YOLO, o a través de cualquier VLM que pueda identificar realmente qué hay en los fotogramas y comprender qué está sucediendo en el video proporcionado, teniendo en cuenta la temporalidad.

Sin embargo, esto no significa que los fenómenos que el documento actual documenta necesariamente procedan de enfoques arquitectónicos parsimoniosos. Los autores observan que el texto domina los paradigmas de entrenamiento multimodal actuales en cualquier caso, lo que indica que el “lenguaje visual” es menos desarrollado, menos importante o informativo dentro de un contexto multimodal, o (al menos por ahora) menos bien entendido,

* Interesantemente, el material que NotebookLM vino con parece ser completamente original o no indexado por Google, ya que no puedo encontrar resultados de búsqueda que podrían haberse colado en los datos de entrenamiento y haber provocado esta salida.

Publicado por primera vez el viernes 31 de octubre de 2025; editado 14:20 para formato