Líderes de opinión

La personalidad de su IA es tan importante como su CI — y hará o deshará la implementación empresarial

La mayoría de las empresas aún eligen modelos de IA en función de los benchmarks. En la práctica, eso rara vez determina si esos sistemas realmente funcionan.

Hasta ahora, la mayoría de las conversaciones sobre modelos de lenguaje grande en entornos empresariales han sido dominadas por benchmarks. Los equipos se inclinan hacia el rendimiento medible, como cuál es el modelo más inteligente, el más fuerte en codificación, el más preciso en resumen o en razonamiento matemático.

Pero a medida que los equipos comienzan a ir más allá de la fase de experimentación y se sumergen en la implementación real a gran escala, otros factores importantes, que están siendo pasados por alto por la mayoría de los CEOs, pronto probarán ser igual de cruciales para el éxito de una empresa.

<h2-La capacidad de contratación de la IA

La inteligencia y la capacidad analítica brutos son obviamente importantes, pero la variable más subestimada en la implementación de IA empresarial es la personalidad. La personalidad, en el contexto de los modelos de lenguaje grande, se refiere a la voz, el tono y el comportamiento consistentes que un modelo transmite a través de las interacciones. Es lo que hace que una IA se sienta coherente y confiable.

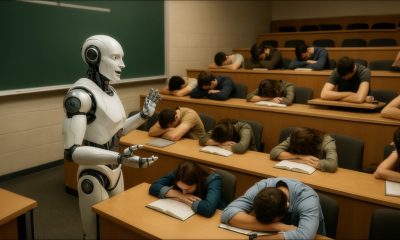

Al implementar la IA, las empresas necesitan adoptar el mismo enfoque que cuando contratan a un empleado humano: evaluar no solo cómo completa un modelo una tarea, sino también su actitud hacia el trabajo, cómo se comunica y cómo se adapta al flujo de trabajo más grande.

La capacidad de un modelo para mantener la coherencia, responder adecuadamente y manejar matices en diferentes contextos puede tener un impacto significativo en los resultados comerciales. Un AI técnicamente brillante que responde lentamente, cambia de tono o maneja mal las interacciones matizadas puede ser mal aplicado por las empresas, frustrando a los usuarios, disminuyendo el compromiso y reduciendo en última instancia la eficacia de la IA y el éxito de la empresa.

Esto es especialmente importante en industrias como el soporte al cliente, el alcance político o las comunicaciones internas, ya que los cambios sutiles en el tono o la redacción entre respuestas pueden causar confusión, erosionar la confianza y reducir el compromiso general. Al igual que con los humanos, no hay un solo modelo soñado que supere a la competencia en todas las categorías. Algunos modelos son mejores para realizar tareas analíticas como la codificación o las matemáticas, mientras que otros funcionan mucho mejor en la escritura conversacional y la resumen de reuniones.

Pero un desafío para los equipos que construyen sobre estos sistemas es que estas características no son fijas.

Un objetivo en movimiento

El panorama de la IA está evolucionando más rápido de lo que la mayoría de las organizaciones pueden seguir. Se lanzan nuevas versiones con frecuencia y las características de rendimiento pueden cambiar de una actualización a la siguiente. La serie de modelos Gemini de Google es un ejemplo reciente.

Gemini 2.0 Pro se lanzó en febrero de 2025 y fue inmediatamente presentado como el modelo insignia para los desarrolladores y las empresas que lo utilizan para la codificación y las solicitudes complejas en todo el mundo.

Venía con lo que, en ese momento, era la ventana de contexto más grande que Google había ofrecido, con dos millones de tokens, lo que le daba la capacidad de analizar y comprender vastas cantidades de información de una vez, mientras también podía utilizar herramientas como Google Search e incluso escribir código.

Para los equipos que construyen sistemas que necesitan procesar grandes volúmenes de datos rápidamente y con precisión, parecía la elección clara. Pero dentro de solo unas semanas, Google lanzó Gemini 2.5 Pro, que inmediatamente superó a su predecesor con mejoras en la codificación, las matemáticas y la ciencia.

De la noche a la mañana, el modelo que había sido la mejor opción en el mercado ya estaba siendo superado menos de dos meses después de su lanzamiento. Pero los adoptantes tempranos notaron de inmediato que los cambios no eran solo incrementales o analíticos: la personalidad de Gemini había cambiado por completo de la noche a la mañana. Varios desarrolladores llegaron a decir que el AI estaba actuando como si hubiera sido “lobotomizado” después de su actualización.

Se quejaron de que el AI parecía estar, literalmente, “volviéndose más tonto” — produciendo respuestas más lentas, salidas menos coherentes y mostrando inconsistencias en cómo manejaba las solicitudes que anteriormente no tenía problemas y las tareas que una vez parecían fluidas ahora se volvieron rígidas.

Y este es el punto en el que la estrategia de una empresa alrededor de la implementación de la IA comienza a cambiar fundamentalmente.

Más allá de los benchmarks

Sobre el papel, Gemini 2.5 Pro debería haber sido el claro ganador con sus vastas mejoras en capacidad y seguridad.

Pero en la práctica, esos cambios alteraron por completo la confiabilidad del modelo, su comportamiento, cómo respondía a las solicitudes y, a su vez, enviaron a los equipos que habían gastado una fortuna y pasado innumerables horas construyendo alrededor de estos sistemas de regreso al punto de partida si las nuevas capacidades del modelo no se alineaban con su canalización existente.

Incluso los pequeños cambios en el comportamiento pueden interrumpir los sistemas construidos alrededor de la coherencia y la previsibilidad. Esto crea un riesgo operativo real si una empresa está estrechamente vinculada a un solo modelo, ya que cualquier actualización puede introducir inestabilidad inmediata en los equipos que confían en estos sistemas.

Para combatir esto, muchas empresas con visión de futuro han comenzado a implementar una estrategia de multi-modelo donde están enrutando diferentes tareas a los modelos mejor adaptados para ellos, en lugar de confiar en un solo modelo para manejar todo.

Este enfoque no solo mejora el rendimiento adaptado a cada tarea, sino que también reduce el riesgo asociado con la implementación de la IA, porque si un modelo se degrada después de una actualización, no arrastrará con él todo el sistema que depende de él, ya que hay copias de seguridad disponibles.

Simplemente, la personalidad y la confiabilidad de la IA son tan importantes como su inteligencia bruta cuando se trata de aplicar el modelo en un entorno de trabajo para completar varias tareas. Este cambio en la forma de pensar representa un cambio fundamental en cómo las empresas ya no solo compran una “herramienta más inteligente”, sino que también están construyendo y gestionando un sistema de infraestructura digital completo.

Para que las empresas no solo sobrevivan, sino que prosperen en el panorama empresarial actual, los equipos necesitan establecer canalizaciones que puedan cambiar entre diferentes modelos dependiendo de la tarea y monitorear constantemente cómo las actualizaciones afectan tanto el rendimiento como la calidad de la interacción.

En última instancia, los modelos en sí seguirán evolucionando a un ritmo que es difícil de igualar. Pero las empresas que planifican el cambio, construyen redundancia y tratan a la IA como una herramienta y un compañero de equipo serán las que conviertan estos cambios rápidos en una ventaja competitiva.