El ángulo de Anderson

Los modelos de IA prefieren la escritura humana a la generada por IA

Según una nueva investigación, ChatGPT y modelos similares muestran ahora un claro sesgo hacia el texto que creen que fue escrito por humanos, incluso cuando esa creencia es errónea. El simple hecho de llamar al texto «creado por humanos» predispone a los modelos de IA a favorecerlo e, irónicamente, podrían estar aprendiendo este prejuicio de nosotros.

Las nociones de autenticidad, procedencia y experiencia humana compartida pueden tener un papel más importante en la IA. asalto en el sector de la escritura creativa de lo que se ha visto hasta ahora: pruebas realizadas para un nuevo estudio en Princeton han descubierto que una serie de importantes modelos de lenguaje de código abierto y cerrado, incluido ChatGPT, prefieren lo que creen que son textos "generados por humanos".

Incluso cuando se invirtieron las etiquetas de las muestras de escritura, tanto los modelos de IA como los participantes humanos continuaron encontrando fallas en el texto escrito por IA, haciéndose eco de las mismas críticas que habían hecho cuando estaba etiquetado correctamente.

Los investigadores creen que parte de la razón puede ser la creciente hostilidad humana hacia la IA generativa, que parece manifestarse eventos nuevos e interesantes Cada día, podrían retroalimentar los propios sistemas de IA. Al observar hasta qué punto la IA detesta la escritura de IA, incluso más que los humanos, afirman*:

'Los 13 modelos de IA que probamos demostraron un sesgo de 34.3 puntos porcentuales en comparación con los 13.7 puntos porcentuales de los humanos, lo que los hace 2.5 veces más susceptibles a las señales de atribución que nuestros evaluadores humanos.

Esta amplificación cobra sentido una vez que reconocemos que los modelos contemporáneos son evaluadores entrenados en preferencias. El entrenamiento de alineación mediante el Aprendizaje por Refuerzo a partir de la Retroalimentación Humana (RLHF) enseña explícitamente a los modelos a considerar los juicios humanos como su estándar de oro, lo que establece de forma efectiva una confiabilidad aprendida [previa].

'Los modelos aprenden que respetar las preferencias humanas tiene recompensa, lo que genera adulación al repetir las actitudes esperadas de los usuarios en lugar de proporcionar una evaluación independiente.'

Los hallazgos se aplican al campo de la escritura creativa; los investigadores utilizaron historias de un distinguido autor francés como muestras de datos, e indican que el prejuicio humano contra la IA puede, en última instancia, superar cualquier mejora cuantitativa en la construcción del lenguaje que los Grandes Modelos del Lenguaje (LLM) pueden producir a medida que evolucionan, y que la etiqueta "IA" tal vez esté llegando a significar "inauténtico", "ersatz" e incluso "de segunda clase" en este dominio.

Muchas de las razones se centran en la práctica y el uso cultural: el artículo indica que la creatividad a menudo se describe en términos de novedad, valor y tipicidad, es decir, cómo nueva algo parece; cuánto es apreciado por los expertos; y qué tan bien encaja en su categoría. Cuando un pasaje se etiqueta como escrito por humanosLos rasgos de género familiares se recompensan como valiosos; cuando se etiquetan como Generado por IA, los mismos rasgos son descartados por no ser originales.

En efecto, revelar la fuente provoca una reevaluación del mérito de la obra, condicionada por suposiciones sobre su creación. Una vez que se revela la autoría de la IA, los lectores... rechazar instintivamente la posibilidad de descubrimiento individual o intención detrás del resultado.

El documento dice*:

'En la mayoría de las artes, no hay un estándar de oro para lo “suficientemente creativo”, lo que hace que las señales de procedencia sean indicadores poderosos que pueden cambiar qué criterio parece más relevante: artesanía disciplinada o novedad notable, accesibilidad o dificultad.

'Dado que los observadores a menudo infieren el proceso a partir del producto, la procedencia impulsa los juicios sobre cómo se hizo algo, así como sobre lo que es: las medidas conservadoras pueden atribuirse a la artesanía de un ser humano, pero descartarse como "mera generación" de un modelo'.

Trece modelos, incluidas variantes de ChatGPT, Claude, Gemini y Mistral, participaron junto a lectores humanos, y todos calificaron las historias de manera más favorable cuando se les dijo que habían sido creadas por humanos, y los LLM mostraron más sesgo que los humanos.

La idea de que los modelos de IA puedan haber absorbido un prejuicio contra su propio resultado plantea interrogantes sobre el origen de dicho sesgo. Dado que la escritura de IA no siempre es fácil de identificar, cualquier asociación negativa formada durante el entrenamiento probablemente provenga de ejemplos etiquetados explícitamente, ya sea a través de cobertura de noticias de contenido de IA, o autodeclarado Artículos generados mediante IA en publicaciones convencionales.

El sitio nuevo documento se titula Todo el mundo prefiere a los escritores humanos, incluida la IA., y proviene de dos escritores del Centro de Humanidades Digitales de Princeton. El trabajo está acompañado por una publicación de datos relacionada en Zenodo (con una versión de GitHub citada en el documento, pero el repo (no activo al momento de escribir).

Método

Para explorar cómo la atribución afecta y forma las percepciones del estilo y la creatividad, los autores utilizaron Ejercicios de estiloUna excéntrica obra de 1947 de Raymond Queneau que reescribe una simple anécdota con 99 estilos diferentes. La historia sigue a un hombre que sube a un autobús, discute con otro pasajero y luego recibe consejos de moda de un amigo.

Aunque de origen literario, esta estructura anticipa las transformaciones basadas en indicaciones en los modelos lingüísticos modernos, donde los usuarios solicitan reescrituras en tonos, voces o registros específicos. Este proceso fue una vez doblado transestilización – un enfoque que ahora se refleja en la investigación sobre IA en el contexto de Transferencia de estiloMientras que la mayoría de los métodos computacionales apuntan a cambios funcionales como cambios de sentimiento o desintoxicación, las reescrituras de Queneau apuntan a un contraste estilístico notable.

De una traducción popular al inglés de la obra de Queneau, se seleccionaron treinta ejercicios que preservaban la narrativa a la vez que abarcaban una amplia gama estilística. Estos incluían formas restringidas como alejandrinos y el lipogramas, cambios de registro como noble, or abusivo, cambios narrativos como retrógrado y el vacilación, y distorsiones lúdicas que incluyen cucharerismos, onomatopeyas o latín canino:

Ejemplos del estudio que muestran cómo GPT-4 reescribió las historias de Queneau en diferentes estilos literarios, combinados con las descripciones de estilo que los evaluadores humanos y de IA vieron durante las pruebas. Fuente: https://arxiv.org/pdf/2510.08831

Como los experimentos de Queneau son difíciles de clasificar, estas categorías son sólo agrupaciones aproximadas, con la intención no de probar la reconocibilidad o la conformidad con el género, sino más bien de crear diversas condiciones bajo las cuales los lectores (humanos) y los modelos puedan revelar sus sesgos.

Para producir contrapartes creadas por IA para cada estilo seleccionado, los investigadores utilizaron indicaciones deliberadamente mínimas. A cada modelo se le presentó la versión más simple de la anécdota de Queneau (el ejercicio inicial, Calificación), junto con una breve instrucción para reescribirlo en un estilo específico, como Reescribir la historia como una versión de ciencia ficción.Este enfoque permitió crear indicaciones que reflejaran el espíritu de las transformaciones originales de Queneau, al tiempo que permitían al modelo interpretar el estilo libremente.

Double Vision

El primer estudio realizado por los autores utilizó GPT-4o para generar las treinta variantes de estilo, ya que era el modelo más avanzado disponible en ese momento. El uso de un solo modelo garantizó resultados consistentes, lo que ayudó a aislar el efecto de las etiquetas de atribución, que el estudio buscaba evaluar.

Los resultados no fueron editados en cuanto a estilo o tono, aparte de enmarcar elementos innecesarios como Aquí está la versión reescrita..

En el segundo estudio, el proceso de generación se repitió en trece grandes modelos de lenguaje: Instrucción Qwen 2.5 72B, Nemo Mistral, Mistral Medium 3, Llama 4 Maverick, Llama 3.3 70B Instrucción, Géminis 2.5 Flash, GPT-4o Mini, GPT-4o, Instrucción turbo GPT-3.5, Búsqueda profunda RI (0528), Chat de DeepSeek v3 (0324), Coherencia Comando R (08-2024), Soneto de Claude 4 y Claude 3.5 Haiku.

Cada modelo recibió las mismas instrucciones y produjo sus propias versiones de los treinta ejercicios, lo que dio como resultado un total de 420 historias reescritas. Esto permitió a los investigadores comprobar si los efectos de atribución se mantenían entre diferentes autores de IA, en lugar de estar ligados a un solo modelo.

Datos y Pruebas

Los investigadores mostraron los mismos pares de historias a diferentes grupos de personas, pero modificaron las etiquetas para ver cuánto influía el nombre del autor en las opiniones: un grupo no vio ningún nombre de autor, solo las etiquetas «A» y «B». El segundo grupo vio los nombres correctos: una versión estaba marcada como escrita por un humano y la otra como escrita por GPT-4o.

Un tercer grupo vio los nombres conmutada, con la historia de "IA" marcada como "humana" y la versión "humana" marcada como "IA":

Resumen del Estudio 1. Jueces humanos e IA compararon 30 pares de historias, cada una con una versión escrita por Queneau y otra por GPT-4. Los jueces se dividieron en tres grupos: uno no vio ninguna etiqueta de autor; otro vio las etiquetas correctas; y otro vio las etiquetas intercambiadas. Este método fue diseñado para evaluar hasta qué punto los nombres de los autores influyen en las opiniones sobre el estilo de escritura.

Estudio xnumx

Los investigadores dividieron los 30 estilos creados en conjuntos más pequeños: cada participante del estudio vio solo cinco estilos y cada estilo fue probado bajo las tres configuraciones de etiquetado.

Cada participante vio solo una configuración de etiquetado: el grupo ciego no vio ninguna mención de la IA, mientras que los otros grupos vieron etiquetas de autor correctas o invertidas. La asignación de grupos, el orden de las historias y la ubicación de izquierda a derecha fueron aleatorios.

Los modelos de IA pasaron por el mismo proceso, recibiendo la misma combinación de estilos y la misma reorganización aleatoria. Cada prueba se ejecutó tres veces por modelo para garantizar la consistencia de los resultados, lo que permitió comparar las reacciones de los humanos y de la IA a las etiquetas de los autores.

El Estudio 2 utilizó las mismas tres configuraciones de etiquetado que antes, pero amplió la prueba para incluir las 420 historias generadas a partir de los 14 modelos LLM mencionados anteriormente. Cada modelo evaluó cada historia bajo cada condición de etiquetado, generando 1,260 decisiones por modelo y 17 596 evaluaciones válidas.

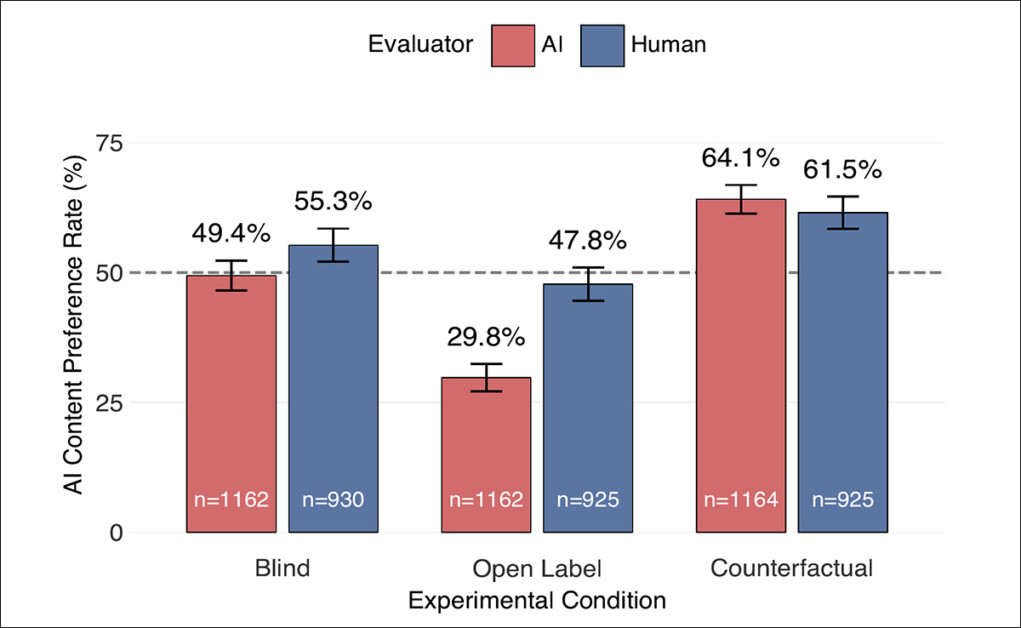

Resultados del Estudio 1. Tanto los jueces de IA como los humanos mostraron sesgo basado en las etiquetas de los autores. Cuando no se mostraron etiquetas (Evaluación a ciegas), las preferencias fueron casi iguales; cuando se mostraron las etiquetas correctas (Evaluación abierta), ambos grupos favorecieron el texto escrito por humanos; y cuando se invirtieron las etiquetas (Evaluación contrafactual), ambos grupos favorecieron el texto que consideraron humano; este efecto fue mucho mayor en los modelos de IA que en los humanos. Las barras de error muestran intervalos de confianza del 95 %.

En los trece modelos, el patrón coincidió con el sesgo humano, pero fue mucho más fuerte: sin etiquetas, los sistemas de IA calificaron las historias humanas y de IA de manera similar, eligiendo texto de IA el 49.4% de las veces; cuando la etiqueta de IA era visible, esa preferencia cayó drásticamente al 29.8%, lo que muestra una clara devaluación del trabajo de IA reconocido; y cuando el mismo texto fue etiquetado como humano, la preferencia aumentó al 64.1%.

La diferencia entre las dos condiciones de etiqueta fue del 34.3%, lo que significa que los modelos de IA cambiaron su preferencia. mucho más que los humanos cuando se intercambiaron las etiquetas. Además, los modelos mostraron una alta consistencia en repetidas ejecuciones, lo que confirma que el sesgo era estable y no aleatorio.

Para comprobar si el sesgo era causado por la redacción de las etiquetas y no por quién escribió el texto, los investigadores realizaron dos pruebas más: una utilizó etiquetas que hacían que la IA sonara más impresionante; y la otra utilizó términos neutrales como "creado por IA" y "creado por humanos".

Ambos todavía mostraban el mismo sesgo, e incluso cuando los modelos de IA producían la misma respuesta cada vez, el sesgo persistió, lo que indica que el sesgo es causado por el tipo de etiqueta ('humano' o 'IA'), más que por las palabras exactas utilizadas.

Estudio xnumx

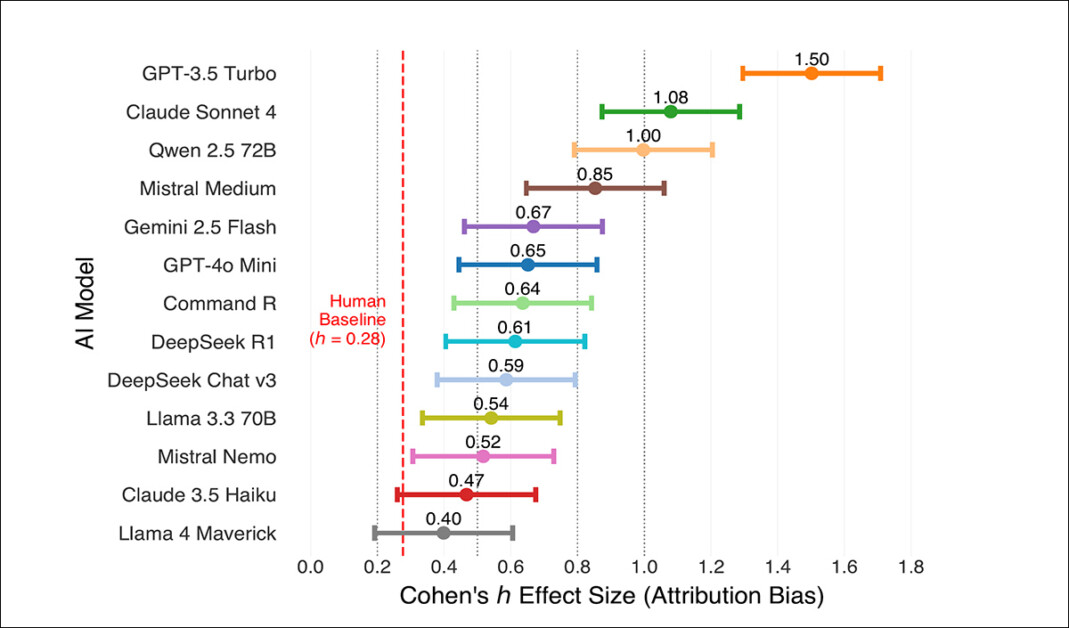

El segundo estudio encontró el mismo sesgo prohumano en los 13 modelos de IA, independientemente de la arquitectura o el proveedor:

Sesgo de atribución para cada uno de los 13 modelos de IA: las barras muestran la magnitud del efecto con intervalos de confianza del 95%, y la línea roja marca la línea de base humana. Todos los modelos mostraron un sesgo mayor que el de los humanos, con diferencias mínimas entre ellos.

Cada modelo prefería historias etiquetadas como escritas por humanos, con efectos más fuertes que los observados en personasIncluso después de eliminar el caso más extremo, el sesgo promedio siguió siendo más del doble de grande que la versión humana, lo que sugiere que el efecto no es una falla en un modelo, sino un rasgo compartido de los LLM en general.

Conclusión

Aunque, como señala el artículo, estudios anteriores han demostrado que la IA puede producir textos escritos iguales o incluso mejores que el trabajo humano, los autores subrayan que en la literatura, el valor que se da a la autoría y la autenticidad es una convención antigua y profundamente arraigada:

'Cuando GPT-4o Mini descarta el enfoque “creativo y humorístico” de Queneau como “exagerado” bajo la etiqueta de atribución de IA, mientras que elogia características idénticas bajo la atribución humana, revela implícitamente cómo estas etiquetas desencadenan suposiciones de que no ocurrió ningún proceso psicológico auténtico.

'Las señales de procedencia llevan el proceso de regreso a lo que de otra manera podría ser un juicio solo sobre el producto: la "mera generación" parece aceptable si se trata de un artesano humano (juzgado como una artesanía calificada), pero sospechosa si se trata de un modelo (juzgado como una recombinación algorítmica).'

Los LLM son aún no es lo suficientemente confiable para la investigación basada en hechos no supervisada, aunque una supervisión cuidadosa aún puede hacerlas productivas; pero la escritura creativa basada en LLM puede enfrentar un futuro más incierto, si las obras creativas generadas por IA se estigmatizan a través de una desaprobación pública más amplia de la invasión de la IA en los dominios humanos, en lugar de basarse en el mérito literario.

Las implicaciones de los hallazgos de estudios de este tipo se ven considerablemente afectadas por la disposición de las empresas y los usuarios individuales a ser honestos sobre si la IA contribuyó o no a sus resultados. En algunos casos, la renuencia a admitir dicho uso puede tener más que ver con piratería corporativa de derechos de autor que la preocupación sobre si el público aceptará obras creativas generadas por IA.

Sin embargo, existen soluciones legales, financieras y políticas posibles (aunque muy complejas) en materia de derechos de autor. Que se pueda lograr que la gente disfrute del trabajo creativo de IA sin una mente humana única y cercana que lo impulse puede ser aún más difícil.

* Consulte el artículo original para ver las citas en línea eliminadas. Si es necesario, se incluirán en el artículo.

Primera publicación: lunes 13 de octubre de 2025