Η γωνία του Anderson

Γιατί τα Μοντέλα Γλώσσας Χάνουν τον Δρόμο τους στη Συνομιλία

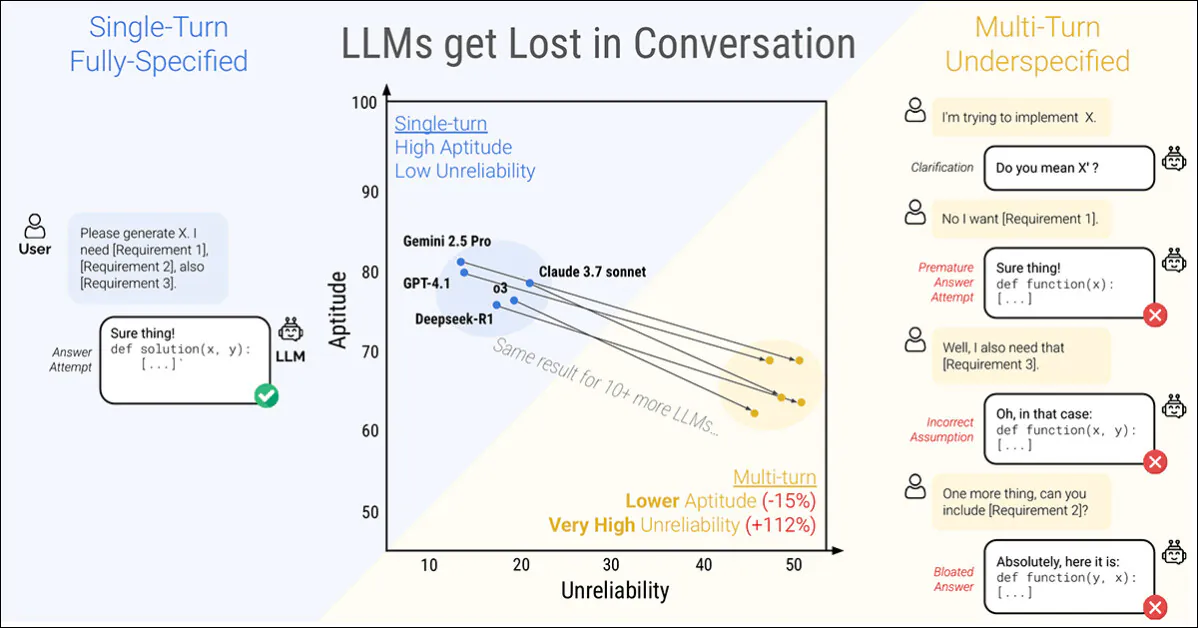

Μια νέα μελέτη από την Microsoft Research και την Salesforce αποκαλύπτει ότι ακόμη και τα πιο ικανά Μεγάλης Κλίμακας Μοντέλα Γλώσσας (LLMs) διαλύονται όταν οι οδηγίες δίνονται σε στάδια αντί για όλα μαζί. Οι συγγραφείς βρήκαν ότι η απόδοση μειώνεται κατά μέσο όρο 39 τοις εκατό σε έξι εργασίες όταν μια πρόκληση χωρίζεται σε πολλαπλά στροφές:

Μια συνομιλία σε ένα στροφείο (αριστερά) αποδίδει τα καλύτερα αποτελέσματα, αλλά είναι αφυσικό για τον τελικό χρήστη. Μια συνομιλία σε πολλαπλά στροφεία (δεξιά) βρίσκει ακόμη και τα υψηλότερα μοντέλα LLMs να χάνουν την αποτελεσματική έμπνευση σε μια συνομιλία. Πηγή: https://arxiv.org/pdf/2505.06120

Περισσότερο εντυπωσιακά, η αξιοπιστία των απαντήσεων παίρνει μια πτώση, με prestigioso μοντέλα όπως ChatGPT-4.1 και Gemini 2.5 Pro oscillating μεταξύ σχεδόν τέλειων απαντήσεων και φανερών αποτυχιών, ανάλογα με τον τρόπο που η ίδια εργασία είναι διατυπωμένη· επιπλέον, η συνεπής έξοδος μπορεί να μειωθεί περισσότερο από το μισό στη διαδικασία.

Για να εξερευνήσετε αυτή τη συμπεριφορά, η μελέτη εισάγει μια μέθοδο που ονομάζεται sharding, η οποία χωρίζει πλήρως καθορισμένες προκλήσεις σε μικρότερα θραύσματα και τα απελευθερώνει ένα-ένα σε μια συνομιλία.

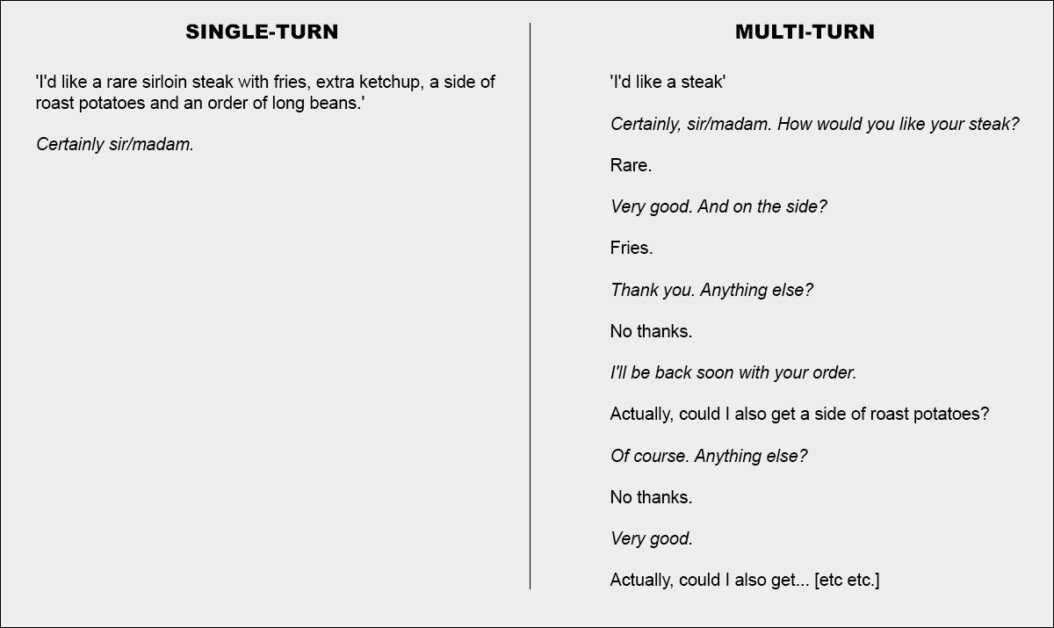

Στις πιο βασικές λέξεις, αυτό είναι ισοδύναμο με το να δώσεις μια συνολη και綜合τική ενιαία διαταγή σε ένα εστιατόριο, αφήνοντας τον σερβιτόρο με τίποτα να κάνει παρά να αναγνωρίσει την αίτηση· ή αλλιώς, να αποφασίσεις να επιτεθεί στο ζήτημα συνεργατικά:

Δύο ακραίες εκδοχές μιας συνομιλίας σε ένα εστιατόριο (όχι από το νέο έγγραφο, για εικονογραφική χρήση μόνο).

Για έμφαση, το παραπάνω παράδειγμα ίσως βάζει τον πελάτη σε ένα αρνητικό φως. Αλλά η βασική ιδέα που απεικονίζεται στη δεύτερη στήλη είναι αυτή της συναλλακτικής ανταλλαγής που διευκρινίζει ένα σύνολο προβλημάτων, πριν από την αντιμετώπιση των προβλημάτων – φαινομενικά ένας ρητορικός και εύλογος τρόπος για την αντιμετώπιση μιας εργασίας.

Αυτή η ρύθμιση αντικατοπτρίζεται στη νέα εργασία της μεθόδου sharded προσέγγισης για την αλληλεπίδραση LLM. Οι συγγραφείς σημειώνουν ότι τα LLMs συχνά παράγουν υπερβολικά μεγάλες απαντήσεις και στη συνέχεια συνεχίζουν να βασίζονται στις δικές τους ερμηνείες ακόμη και μετά από εκείνες τις ερμηνείες έχουν αποδειχθεί λανθασμένες ή ακατάλληλες. Αυτή η τάση, σε συνδυασμό με άλλα παράγοντες, μπορεί να προκαλέσει στο σύστημα να χάσει ολοσχερώς την αλλαγή.

Στην πραγματικότητα, οι ερευνητές σημειώνουν τι πολλοί από εμάς έχουμε βρει ανεκδοτικά – ότι ο καλύτερος τρόπος για να ξαναβρείτε τη συνομιλία είναι να ξεκινήσετε μια νέα συνομιλία με το LLM.

‘Αν μια συνομιλία με ένα LLM δεν οδήγησε στα αναμενόμενα αποτελέσματα, η έναρξη μιας νέας συνομιλίας που επαναλαμβάνει τις ίδιες πληροφορίες μπορεί να οδηγήσει σε σημαντικά καλύτερα αποτελέσματα από τη συνέχιση μιας συνεχιζόμενης συνομιλίας.

‘Αυτό συμβαίνει γιατί τα τρέχοντα LLMs μπορούν να χάσουν τον δρόμο τους στη συνομιλία, και τα πειράματά μας δείχνουν ότι η επιμονή σε μια συνομιλία με το μοντέλο είναι ανεπιτυχής. Επιπλέον,既然 τα LLMs παράγουν κείμενο με τυχαίο τρόπο, μια νέα συνομιλία μπορεί να οδηγήσει σε βελτιωμένα αποτελέσματα.’

Οι συγγραφείς αναγνωρίζουν ότι συστήματα όπως Autogen ή LangChain μπορούν потенτικά να βελτιώσουν τα αποτελέσματα, ενεργώντας ως ερμηνευτικές στρώσεις μεταξύ του τελικού χρήστη και του LLM, επικοινωνώντας μόνο με το LLM όταν έχουν συλλέξει αρκετά θραύσματα για να συνδυαστούν σε μια seule συνολη ερώτηση (η οποία ο τελικός χρήστης δεν θα εκτεθεί).

Ωστόσο, οι συγγραφείς υποστηρίζουν ότι μια ξεχωριστή στρώση αφαίρεσης δεν πρέπει να είναι απαραίτητη, ή αλλιώς να κατασκευαστεί trực tiếp στο πηγή LLM:

‘Μια επιχείρηση μπορεί να γίνει ότι οι ικανότητες πολλαπλών στροφείων δεν είναι μια απαραίτητη λειτουργία των LLMs, καθώς μπορεί να ανατεθεί σε ένα πλαίσιο agent. Με άλλα λόγια, χρειαζόμαστε εγγενή υποστήριξη πολλαπλών στροφείων στα LLMs όταν ένα πλαίσιο agent μπορεί να διευθύνει τις αλληλεπιδράσεις με τους χρήστες και να εκμεταλλευτεί τα LLMs μόνο ως μονάδες ενός στροφείου;…’

Αλλά αφού δοκιμάσαμε την πρόταση σε όλο το εύρος των παραδειγμάτων, συμπεραίνουν:

‘[Εξαρτώντας] σε ένα πλαίσιο agent για την επεξεργασία της πληροφορίας μπορεί να είναι περιοριστικό, και υποστηρίζουμε ότι τα LLMs πρέπει να υποστηρίζουν εγγενώς την αλληλεπίδραση πολλαπλών στροφείων’

Αυτή η ενδιαφέρουσα νέα μελέτη έχει τον τίτλο LLMs Get Lost In Multi-Turn Conversation, και προέρχεται από τέσσερις ερευνητές σε όλο το φάσμα της MS Research και Salesforce,

Θραυσματοποιημένες Συνομιλίες

Η νέα μέθοδος χωρίζει πρώτα τις συμβατικές ενιαίες οδηγίες σε μικρότερα θραύσματα, σχεδιασμένα να εισαχθούν σε κρίσιμους моментους κατά τη διάρκεια μιας αλληλεπίδρασης LLM, μια δομή που αντικατοπτρίζει την εξερευνητική, αντι-συμμετρική μορφή της αλληλεπίδρασης που φαίνεται σε συστήματα όπως το ChatGPT ή το Google Gemini.

Κάθε αρχική οδηγία είναι μια seule, αυτοπεριεχόμενη πρόκληση που παραδίδει ολόκληρη την εργασία σε ένα στροφείο, συνδυάζοντας μια υψηλού επιπέδου ερώτηση, υποστηρικτικό контекστ και οποιαδήποτε σχετική προϋπόθεση. Η θραυσματοποιημένη έκδοση χωρίζει αυτό σε πολλαπλά μικρότερα μέρη, με κάθε θραύσμα να προσθέτει μόνο ένα κομμάτι της πληροφορίας:

Ζευγαρωμένες οδηγίες που δείχνουν (α) μια πλήρη πρόκληση που παραδίδεται σε ένα στροφείο και (β) την θραυσματοποιημένη έκδοσή της που χρησιμοποιείται για να προσομοιώσει μια ακαθόριστη, πολλαπλή συνομιλία. Σεμαντικά, κάθε έκδοση παραδίδει την ίδια πληροφοριακή φορτίο.

Το πρώτο θραύσμα εισάγει πάντα τον κύριο στόχο της εργασίας, ενώ τα υπόλοιπα παρέχουν διευκρινιστικές λεπτομέρειες. Μαζί, παραδίδουν την ίδια περιεχόμενο με την αρχική πρόκληση, αλλά διασκορπίζονται φυσικά σε πολλαπλά στροφεία στη συνομιλία.

Κάθε προσομοιωμένη συνομιλία αναπτύσσεται μεταξύ τριών στοιχείων: του βοηθού, του μοντέλου υπό αξιολόγηση· του χρήστη, ενός προσομοιωμένου agent με πρόσβαση στην πλήρη οδηγία σε θραυσματοποιημένη μορφή· και του συστήματος, που επιβλέπει και βαθμολογεί την ανταλλαγή.

Η συνομιλία αρχίζει με τον χρήστη που αποκαλύπτει το πρώτο θραύσμα και τον βοηθό που απαντά ελεύθερα. Το σύστημα στη συνέχεια ταξινομεί αυτή την απάντηση σε μια από τις πολλές κατηγορίες, όπως μια αίτηση διευκρίνισης ή μια πλήρη απόπειρα απάντησης.

Αν το μοντέλο κάνει μια απόπειρα απάντησης, ένα ξεχωριστό στοιχείο εξάγει μόνο το σχετικό span για αξιολόγηση, αγνοώντας οποιοδήποτε περιβάλλον κείμενο. Σε κάθε νέο στροφείο, ο χρήστης αποκαλύπτει ένα επιπλέον θραύσμα, προκαλώντας μια άλλη απάντηση. Η ανταλλαγή συνεχίζεται μέχρι να πάρει το μοντέλο την απάντηση σωστά ή να μην υπάρχουν πλέον θραύσματα για να αποκαλυφθούν:

Διάγραμμα μιας προσομοιωμένης συνομιλίας θραυσμάτων, με το αξιολογούμενο μοντέλο υπογραμμισμένο σε κόκκινο.

Νωρίς δοκιμές έδειξαν ότι τα μοντέλα συχνά ρωτούσαν για πληροφορίες που δεν είχαν μοιραστεί ακόμη, οπότε οι συγγραφείς έπεσαν την ιδέα της αποκάλυψης θραυσμάτων σε μια σταθερή σειρά. Αντίθετα, ένας προσομοιωτής χρησιμοποιήθηκε για να αποφασίσει ποιο θραύσμα να αποκαλυφθεί επόμενο, με βάση τον τρόπο που η συνομιλία προχωρούσε.

Ο προσομοιωτής του χρήστη, που υλοποιήθηκε χρησιμοποιώντας GPT-4o-mini, είχε πλήρη πρόσβαση και στην πλήρη οδηγία και στην ιστορία της συνομιλίας, με την任务 να αποφασίσει, σε κάθε στροφείο, ποιο θραύσμα να αποκαλυφθεί επόμενο, με βάση τον τρόπο που η ανταλλαγή εξελισσόταν.

Ο προσομοιωτής του χρήστη ανασυντάχθηκε επίσης κάθε θραύσμα για να διατηρήσει τη ροή της συνομιλίας, χωρίς να αλλάξει τη σημασία. Αυτό επέτρεψε στη προσομοίωση να αντανακλούν την ‘δίδου-πάρτου’ του πραγματικού διαλόγου, ενώ διατηρούσε τον έλεγχο της δομής της εργασίας.

Πριν από την έναρξη της συνομιλίας, ο βοηθός δόθηκε μόνο τις βασικές πληροφορίες που χρειάζονταν για να ολοκληρώσει την εργασία, όπως ένα σχήμα βάσης δεδομένων ή μια αναφορά API. Δεν του είπαν ότι οι οδηγίες θα χωριστούν, και δεν τον καθοδήγησαν προς κάποιον συγκεκριμένο τρόπο για την αντιμετώπιση της συνομιλίας. Αυτό γίνεται με πρόθεση: στη πραγματική χρήση, τα μοντέλα几乎 ποτέ δεν τους λένε ότι μια πρόκληση θα είναι ατελής ή ότι θα ενημερωθεί με την πάροδο του χρόνου, και η αφαίρεση αυτού του контекστου βοηθά τη προσομοίωση να αντανακλούν πώς το μοντέλο συμπεριφέρεται σε ένα πιο ρεαλιστικό контекστ.

GPT-4o-mini χρησιμοποιήθηκε επίσης για να αποφασίσει πώς οι απαντήσεις του μοντέλου θα ταξινομηθούν, και για να βγάλει οποιαδήποτε τελικές απαντήσεις από αυτές τις απαντήσεις. Αυτό βοήθησε τη προσομοίωση να παραμείνει ευέλικτη, αλλά εισήγαγε περιστασιακές λάθη: ωστόσο, μετά από έλεγχο нескольких εκατοντάδων συνομιλιών με το χέρι, οι συγγραφείς βρήκαν ότι λιγότερο από το 5 τοις εκατό είχαν οποιοδήποτε πρόβλημα, και λιγότερο από το 2 τοις εκατό έδειξαν μια αλλαγή στην έκβαση λόγω αυτών, και τους θεωρούσαν μια χαμηλή enough λάθος ποσοστό εντός των παραμέτρων του έργου.

Σενάρια Προσομοίωσης

Οι συγγραφείς χρησιμοποίησαν πέντε τύπους προσομοίωσης για να δοκιμάσουν τη συμπεριφορά του μοντέλου υπό διαφορετικές συνθήκες, κάθε ένας eine παραλλαγή του πώς και πότε τα μέρη της οδηγίας αποκαλύπτονται.

Στην Πλήρη ρύθμιση, το μοντέλο λαμβάνει την πλήρη οδηγία σε ένα στροφείο. Αυτό αντιπροσωπεύει το τυπικό μορφότυπο chuẩn και χρησιμεύει ως η βάση απόδοσης.

Η Θραυσματοποιημένη ρύθμιση χωρίζει την οδηγία σε πολλαπλά κομμάτια και τα παραδίδει ένα-ένα, προσομοιώνοντας μια πιο ρεαλιστική, ακαθόριστη συνομιλία. Αυτή είναι η κύρια ρύθμιση που χρησιμοποιείται για να δοκιμάσει πώς τα μοντέλα χειρίζονται την πολλαπλή είσοδο.

Στην Συνδυαστική ρύθμιση, τα θραύσματα συνδυάζονται πίσω σε μια seule λίστα, διατηρώντας την ορολογία τους αλλά αφαιρώντας τη δομή του στροφείου. Αυτό βοηθά να απομονωθούν τα αποτελέσματα της θραυσματοποίησης από την επαναδιατύπωση ή την απώλεια περιεχομένου.

Η Περίληψη ρύθμιση τρέχει όπως η Θραυσματοποιημένη, αλλά προσθέτει ένα τελικό στροφείο όπου όλες οι προηγούμενες θραύσματα επαναλαμβάνονται πριν το μοντέλο δώσει μια τελική απάντηση. Αυτό δοκιμάζει αν μια περίληψη πρόκληση μπορεί να βοηθήσει στην ανάκτηση της χαμένης контекστ.

Τέλος, Χιονόπτωση πάει παραπέρα, επαναλαμβάνοντας όλα τα προηγούμενα θραύσματα σε κάθε στροφείο, διατηρώντας την πλήρη οδηγία ορατή καθώς η συνομιλία εξελίσσεται – και προσφέροντας ένα πιο συγχωροτικό τεστ της ικανότητας πολλαπλών στροφείων.

Τύποι προσομοίωσης με βάση τις θραυσματοποιημένες οδηγίες. Μια πλήρη πρόκληση χωρίζεται σε μικρότερα μέρη, τα οποία μπορούν να χρησιμοποιηθούν για να προσομοιώσουν είτε μονά στροφεία (Πλήρη, Συνδυαστική) είτε πολλαπλά στροφεία (Θραυσματοποιημένη, Περίληψη, Χιονόπτωση) συνομιλίες, ανάλογα με τον τρόπο που η πληροφορία αποκαλύπτεται.

Εργασίες και Μέτρα

Έξι εργασίες γεννήθηκαν επιλεγμένες για να καλύψουν τόσο την προγραμματιστική όσο και τη φυσική γλώσσα: οι προκλήσεις κώδικα λήφθηκαν από HumanEval και LiveCodeBench· οι ερωτήσεις Text-to-SQL προήλθαν από Spider· οι κλήσεις API κατασκευάστηκαν χρησιμοποιώντας δεδομένα από το Berkeley Function Calling Leaderboard· τα στοιχειώδη μαθηματικά προβλήματα παρέχθηκαν από GSM8K· οι εργασίες καπελώματος πινάκων βασίστηκαν σε ToTTo· και οι περίληψεις πολλαπλών εγγράφων λήφθηκαν από το Summary of a Haystack dataset.

Η απόδοση του μοντέλου μετρήθηκε χρησιμοποιώντας τρία βασικά μέτρα: μέση απόδοση, ικανότητα, και αξιοπιστία.

Μέση απόδοση κατέγραψε πώς καλά ένα μοντέλο έκανε συνολικά σε πολλαπλά προσπάθειες· ικανότητα αντανακλούσε τα καλύτερα αποτελέσματα που ένα μοντέλο μπορούσε να φτάσει, με βάση τις κορυφαίες του εξόδους· και αξιοπιστία μετρούσε πόσο αυτά τα αποτελέσματα ποικίλλουν, με μεγαλύτερες διαφορές μεταξύ των καλύτερων και των χειρότερων αποτελεσμάτων να δείχνουν λιγότερο σταθερή συμπεριφορά.

Όλα τα σκορ τοποθετήθηκαν σε μια κλίμακα 0-100 για να διασφαλιστεί η συν nhấtότητα σε όλες τις εργασίες, και τα μέτρα υπολογίστηκαν για κάθε οδηγία – και στη συνέχεια μέσος όρος για να παρέχει μια συνολική εικόνα της απόδοσης του μοντέλου.

Έξι θραυσματοποιημένες εργασίες που χρησιμοποιήθηκαν στα πειράματα, καλύπτοντας τόσο την προγραμματιστική όσο και τη φυσική γλώσσα. Κάθε εργασία εμφανίζεται με μια πλήρη οδηγία και την θραυσματοποιημένη έκδοσή της. Μεταξύ 90 και 120 οδηγιών προσαρμόστηκαν από καθιερωμένα βENCHMARKS για κάθε εργασία.

Ανταγωνιστές και Τεστ

Στις αρχικές προσομοιώσεις (με εκτιμώμενο κόστος $5000), 600 οδηγίες που καλύπτουν έξι εργασίες θραυσματοποιήθηκαν και χρησιμοποιήθηκαν για να προσομοιώσουν τρεις τύπους συνομιλίας: πλήρη, συνδυαστική, και θραυσματοποιημένη. Για κάθε συνδυασμό μοντέλου, οδηγίας και τύπου προσομοίωσης, δέκα συνομιλίες τρέχουν, παράγοντας πάνω από 200.000 προσομοιώσεις συνολικά – ένα σχήμα που έκανε δυνατή την καταγραφή και της συνολικής απόδοσης και των βαθύτερων μέτρων της ικανότητας και της αξιοπιστίας.

Δεκαπέντε μοντέλα δοκιμάστηκαν, καλύπτοντας ένα ευρύ φάσμα παρόχων και αρχιτεκτονικών: τα μοντέλα OpenAI GPT-4o (έκδοση 2024-11-20), GPT-4o-mini (2024-07-18), GPT-4.1 (2025-04-14), και το μοντέλο σκέψης o3 (2025-04-16).

Τα μοντέλα Anthropic ήταν Claude 3 Haiku (2024-03-07) και Claude 3.7 Sonnet (2025-02-19), που προσεγγίστηκαν μέσω Amazon Bedrock.

Το Google συνεισέφερε Gemini 2.5 Flash (preview-04-17) και Gemini 2.5 Pro (preview-03-25). Τα μοντέλα Meta ήταν Llama 3.1-8B-Instruct και Llama 3.3-70B-Instruct, καθώς και Llama 4 Scout-17B-16E, μέσω Together AI.

Οι άλλοι συμμετέχοντες ήταν OLMo 2 13B, Phi-4, και Command-A, όλα προσεγγίστηκαν τοπικά μέσω Ollama ή Cohere API· και Deepseek-R1, που προσεγγίστηκε μέσω Amazon Bedrock.

Για τα δύο ‘σκέψης’ μοντέλα (o3 και R1), το όριο token ανυψώθηκε σε 10.000 για να φιλοξενήσει μεγαλύτερες αλυσίδες σκέψης:

Μέσες αποδοτικές βαθμολογίες για κάθε μοντέλο σε έξι εργασίες: κώδικας, βάση δεδομένων, ενέργειες, δεδομένα-κελί, μαθηματικά, και περίληψη. Τα αποτελέσματα εμφανίζονται για τρεις τύπους προσομοίωσης: πλήρη, συνδυαστική, και θραυσματοποιημένη. Τα μοντέλα ταξινομούνται με βάση τη μέση βαθμολογία πλήρους ρύθμισης. Η σκίαση αντανακλά το βαθμό της πτώσης της απόδοσης από τη πλήρη ρύθμιση, με τις δύο τελικές στήλες που αναφέρουν τις μέσες πτώσεις για συνδυαστική και θραυσματοποιημένη σχετικά με την πλήρη.

Σχετικά με αυτά τα αποτελέσματα, οι συγγραφείς δηλώνουν†:

‘Σε υψηλό επίπεδο, κάθε μοντέλο βλέπει την απόδοσή του να χειροτερεύει σε κάθε εργασία όταν συγκρίνεται η Πλήρη και Θραυσματοποιημένη απόδοση, με μια μέση χειροτέρευση του -39%. Ονομάζουμε αυτό το φαινόμενο Χαμένο στη Συνομιλία: μοντέλα που επιτύγχάνουν αστρικές (90%+) αποδόσεις στο εργαστήριο-μορφότυπο της πλήρως καθορισμένης, μονής-στροφείου συνομιλίας δυσκολεύονται στις ίδιες εργασίες σε ένα πιο ρεαλιστικό περιβάλλον όταν η συνομιλία είναι ακαθόριστη και πολλαπλή-στροφείου.’

Συνδυαστική σκορ μέσος όρος 95 τοις εκατό της πλήρους, που δείχνει ότι η πτώση της απόδοσης στη θραυσματοποιημένη ρύθμιση δεν μπορεί να εξηγηθεί από την απώλεια πληροφορίας. Μικρότερα μοντέλα όπως Llama3.1-8B-Instruct, OLMo-2-13B, και Claude 3 Haiku έδειξαν πιο έντονη χειροτέρευση κάτω από συνδυαστική, που υποδηλώνει ότι τα μικρότερα μοντέλα είναι γενικά λιγότερο ανθεκτικά στην επαναδιατύπωση από τα μεγαλύτερα.

Οι συγγραφείς παρατηρούν†:

‘Επιπλέον, τα πιο αποδοτικά μοντέλα (Claude 3.7 Sonnet, Gemini 2.5, GPT-4.1) χάνουν τον δρόμο τους στη συνομιλία συγκριτικά με τα μικρότερα μοντέλα (Llama3.1-8B-Instruct, Phi-4), με μέσες χειροτερεύσεις 30-40%. Αυτό οφείλεται εν μέρει στις ορισμένες μετρικές.既然 τα μικρότερα μοντέλα επιτύγχάνουν χαμηλότερες απόλυτες βαθμολογίες στη Πλήρη, έχουν λιγότερο πεδίο για χειροτέρευση από τα καλύτερα μοντέλα.

‘Σύντομα, ανεξάρτητα από το πόσο ισχυρή είναι η απόδοση ενός LLM σε μονά στροφεία, παρατηρούμε μεγάλες χειροτερεύσεις στην απόδοση σε πολλαπλά στροφεία.‘

Η αρχική δοκιμή δείχνει ότι κάποια μοντέλα αντέχουν καλύτερα σε συγκεκριμένες εργασίες: Command-A στις ενέργειες, Claude 3.7 Sonnet, και GPT-4.1 στον κώδικα· και Gemini 2.5 Pro στα δεδομένα-κελί, που δείχνει ότι η ικανότητα πολλαπλών στροφείων ποικίλλει ανάλογα με το domaine. Μοντέλα σκέψης όπως o3 και Deepseek-R1 δεν ήταν καλύτερα συνολικά, vielleicht επειδή οι μακρύτερες απαντήσεις τους εισήγαγαν περισσότερες υποθέσεις, οι οποίες hatten την τάση να μπερδεύουν τη συνομιλία.

Αξιοπιστία

Η σχέση μεταξύ ικανότητας και αξιοπιστίας, σαφής στις μονές-στροφείου προσομοιώσεις, φαίνεται να διαλύεται κάτω από πολλαπλά στροφεία. Ενώ η ικανότητα έπεσε μόνο μετρίως, η αξιόπιστος διπλασιαζόταν κατά μέσο όρο. Μοντέλα που ήταν σταθερά στις πλήρεις προκλήσεις, όπως GPT-4.1 και Gemini 2.5 Pro, έγιναν τόσο απρόβλεπτα όσο και τα слабότερα μοντέλα όπως Llama3.1-8B-Instruct ή OLMo-2-13B, μια φορά που η οδηγία θραυσματοποιήθηκε.

Επισκόπηση της ικανότητας και της αξιόπιστου που εμφανίζεται σε ένα box plot (α), ακολουθούμενο από τα αποτελέσματα αξιόπιστου από τα πειράματα με 15 μοντέλα (β), και τα αποτελέσματα από το σταδιακό τεστ θραυσματοποίησης όπου οι οδηγίες χωρίστηκαν σε ένα έως οκτώ θραύσματα (γ).

Οι απαντήσεις του μοντέλου ποικίλλουν συχνά μέχρι και 50 πόντους στην ίδια εργασία, ακόμη και όταν τίποτα νέο δεν προστέθηκε, υποδηλώνοντας ότι η πτώση της απόδοσης δεν οφείλεται σε έλλειψη ικανότητας, αλλά στην αστάθεια του μοντέλου σε πολλαπλά στροφεία.

Το έγγραφο δηλώνει†:

‘[Although] τα καλύτερα μοντέλα τείνουν να έχουν ελαφρώς υψηλότερη ικανότητα πολλαπλών στροφείων, όλα τα μοντέλα τείνουν να έχουν παρόμοια επίπεδα αξιόπιστου. Με άλλα λόγια, σε πολλαπλά στροφεία, ακαθόριστα περιβάλλοντα, όλα τα μοντέλα που δοκιμάζουμε εμφανίζουν πολύ υψηλή αξιόπιστου, με την απόδοση να χειροτερεύει 50 ποσοστιαίες μονάδες κατά μέσο όρο μεταξύ των καλύτερων και των χειρότερων προσομοιωμένων τρέξιμων για μια σταθερή οδηγία.’

Για να δοκιμάσουν αν η χειροτέρευση της απόδοσης συνδέεται με τον αριθμό των στροφείων, οι συγγραφείς έτρεξαν ένα σταδιακό πείραμα θραυσματοποίησης, χωρίζοντας κάθε οδηγία σε ένα έως οκτώ θραύσματα (βλέπε δεξιά στη στήλη στο πάνω μέρος).

Όσο αυξανόταν ο αριθμός των θραυσμάτων, η αξιόπιστος αυξανόταν σταθερά, επιβεβαιώνοντας ότι ακόμη και μικρές αύξησεις στο αριθμό των στροφείων καθιστούν τα μοντέλα πιο ασταθή. Η ικανότητα παρέμεινε κυρίως αμετάβλητη, ενισχύοντας ότι το ζήτημα έγκειται στην συνέπεια, όχι στην ικανότητα.

Έλεγχος Θερμοκρασίας

Μια ξεχωριστή σειρά πειραμάτων δοκιμάζει αν η αξιόπιστος είναι απλώς ένα προϊόν της τυχαίας. Για να το κάνουν αυτό, οι συγγραφείς μετέβαλλαν την ρύθμιση θερμοκρασίας και του βοηθού και του προσομοιωτή του χρήστη σε τρεις τιμές: 1.0, 0.5, και 0.0.

Στις μονές-στροφείου μορφές όπως πλήρη και συνδυαστική, η μείωση της θερμοκρασίας του βοηθού βελτίωσε σημαντικά την αξιόπιστου, κόβοντας τη διακύμανση μέχρι και 80 τοις εκατό· αλλά στη θραυσματοποιημένη ρύθμιση, η ίδια παρέμβαση είχε μικρή επίδραση:

Αποτελέσματα αξιόπιστου για διάφορους συνδυασμούς θερμοκρασίας βοηθού και προσομοιωτή του χρήστη σε πλήρη, συνδυαστική, και θραυσματοποιημένη ρύθμιση, με χαμηλότερες τιμές που δείχνουν μεγαλύτερη σταθερότητα της απάντησης.

Ακόμη και όταν και ο βοηθός και ο προσομοιωτής του χρήστη ορίστηκαν σε μηδενική θερμοκρασία, η αξιόπιστος παρέμεινε υψηλή, με GPT-4o να εμφανίζει διακύμανση γύρω στο 30 τοις εκατό, υποδηλώνοντας ότι η αστάθεια που παρατηρείται στις πολλαπλά στροφεία συνομιλίας δεν είναι απλώς τυχαίο θόρυβο, αλλά μια δομική αδυναμία στο πώς τα μοντέλα χειρίζονται τη θραυσματοποιημένη είσοδο.

Επικυρώσεις

Οι συγγραφείς γράφουν για τις επικυρώσεις των ευρημάτων τους σε ασυνήθιστα μεγάλο βαθμό, υποστηρίζοντας ότι η ισχυρή απόδοση μονής-στροφείου δεν εγγυάται την αξιοπιστία πολλαπλών στροφείων, και προειδοποιούν κατά της υπερεξάρτησης από πλήρως καθορισμένα βENCHMARKS όταν αξιολογούν την ετοιμότητα του πραγματικού κόσμου (καθώς τέτοια βENCHMARKS.mask την αστάθεια σε πιο ρεαλιστικές, θραυσματοποιημένες αλληλεπιδράσεις).

Επιπλέον, προτείνουν ότι η αξιόπιστος δεν είναι απλώς ένα δείγμα, αλλά μια δομική αδυναμία στο πώς τα τρέχοντα μοντέλα επεξεργάζονται την εξελισσόμενη είσοδο, και υποστηρίζουν ότι αυτό ανυψώνει ανησυχίες για τα πλαίσια agent, τα οποία εξαρτώνται από τη συνεχή σκέψη σε πολλαπλά στροφεία.

Τέλος, υποστηρίζουν ότι η ικανότητα πολλαπλών στροφείων πρέπει να αντιμετωπίζεται ως μια βασική ικανότητα των LLMs, όχι κάτι που ανατίθεται σε εξωτερικά συστήματα.

Οι συγγραφείς σημειώνουν ότι τα αποτελέσματά τους πιθανότατα υποτιμούν την πραγματική κλίμακα του προβλήματος, και εστιάζουν την προσοχή στο ιδανικό περιβάλλον του τεστ: ο προσομοιωτής του χρήστη στη ρύθμιση τους είχε πλήρη πρόσβαση και στην οδηγία και στην ιστορία της συνομιλίας, και μπορούσε να αποκαλύψει τα θραύσματα σε μια βέλτιστη σειρά (σε πραγματική χρήση, οι χρήστες συχνά παρέχουν θραυσματοποιημένες ή αμφίβολες οδηγίες χωρίς να γνωρίζουν τι χρειάζεται το μοντέλο να ακούσει επόμενο).

Επιπλέον, ο βοηθός αξιολογήθηκε αμέσως μετά από κάθε στροφείο, πριν από την πλήρη ανάπτυξη της συνομιλίας, αποτρέποντας την αργότερη σύγχυση ή αυτο-αντίφαση από το να ποινικοποιηθεί, το οποίο θα χειροτέρευε την απόδοση.

Αυτές οι επιλογές, ενώ απαραίτητες για τον έλεγχο του πειράματος, σημαίνουν ότι οι διακυμάνσεις της αξιόπιστου που παρατηρούνται στην πρακτική χρήση είναι πιθανό να είναι ακόμη μεγαλύτερες από αυτές που αναφέρονται.

Συμπέρασμα

Όποιος έχει περάσει σημαντικό χρόνο με ένα LLM θα αναγνωρίσει πιθανότατα τα ζητήματα που διατυπώνονται εδώ, από την πρακτική εμπειρία· και οι περισσότεροι από εμάς, φαντάζομαι, έχουμε ενστικτωδώς εγκαταλείψει ‘χαμένες’ συνομιλίες LLM για νέες, με την ελπίδα ότι το LLM μπορεί να ‘ξεκινήσει από την αρχή’ και να σταματήσει να εμμονεύεται με υλικό που προέκυψε σε μια μακρά, στριφνή και ολοένα και πιο εξοργιστική ανταλλαγή.

Είναι ενδιαφέρον να σημειωθεί ότι το να ρίχνεις περισσότερο контекστ στο πρόβλημα μπορεί να μην λύσει το πρόβλημα· και στην πραγματικότητα, να παρατηρήσεις ότι το έγγραφο ανυψώνει περισσότερες ερωτήσεις από αυτές που παρέχει απαντήσεις (εκτός από τους τρόπους για να παραπληρώσετε γύρω από το πρόβλημα).

* Συγχυτικά, αυτό δεν σχετίζεται με τη συμβατική σημασία του ‘θραυσματοποίησης’ στο AI.

† Των συγγραφέων δικές τους έντονες έμφασεις.

Πρώτη δημοσίευση τη Δευτέρα, 12 Μαΐου 2025