Η γωνία του Anderson

Η Loftiness Μειώνει την Ακρίβεια στα Μεγάλα Μοντέλα Γλώσσας

Νέα έρευνα διαπιστώνει ότι η υποχρέωση των Μεγάλων Μοντέλων Γλώσσας να δίνουν συντομότερες απαντήσεις βελτιώνει αξιοσημείωτα την ακρίβεια και την ποιότητα των απαντήσεών τους.

Όποιος έχει προσπαθήσει να σταματήσει ένα chatbot από το ‘ατελείωτο λόγο’ θα αναγνωρίσει τα συμπεράσματα της νέας έρευνας: η υποχρέωση του AI να δίνει συντομότερες απαντήσεις το καθιστά πιο ακριβή.

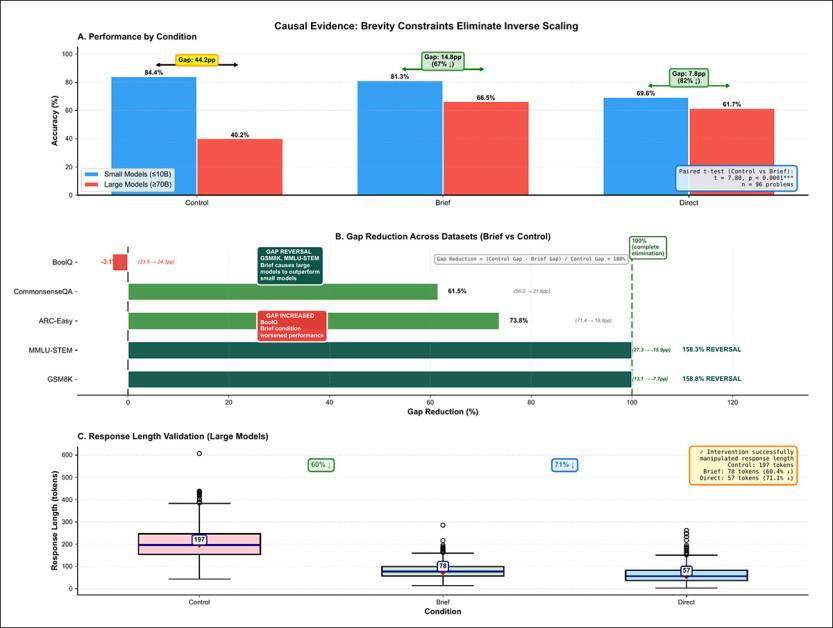

Ερευνώντας τους λόγους για τους οποίους τα μεγαλύτερα μοντέλα AI χειροτερεύουν σε αυτόν τον τομέα από τα μικρότερα, σε ορισμένες περιπτώσεις (γνωστές ως αντίστροφη κλίμακα), η έρευνα διαπίστωσε ότι η υποχρέωση 31 δημοφιλών Μεγάλων Μοντέλων Γλώσσας (LLM) να δίνουν συντομότερες απαντήσεις προκάλεσε μέχρι και 26,3% βελτίωση στην ακρίβεια των απαντήσεών τους:

‘Τα αποτελέσματα παρέχουν πειστικά αιτιολογικά στοιχεία: οι περιορισμοί της συντομίας βελτίωσαν την ακρίβεια του μεγάλου μοντέλου κατά 26,3 ποσοστιαίες μονάδες και μειώθηκαν το χάσμα της αντίστροφης κλίμακας κατά 67% (από 44,2% σε 14,8%, ζευγαρωτό t-test: t = 7,80, p < 0,0001).’

Η υπερβολική loftiness είναι một συχνός προβληματισμός μεταξύ των τελικών χρηστών, όχι μόνο μεταξύ εκείνων που χρησιμοποιούν εμπορικά μοντέλα όπως το ChatGPT, όπου τα φόρουμ υποστήριξης παρουσιάζουν αυτό θέμα συχνά.

Το πεδίο που επηρεάζεται περισσότερο από την αποκατάσταση της loftiness στις απαντήσεις είναι η μαθηματική, όπου τα AI που δοκιμάστηκαν υποχρεώθηκαν να απαντήσουν σε 50 λέξεις ή λιγότερες. Για κατανόηση ανάγνωσης εργασίες, περιορίστηκαν σε μια απλή 10 λέξεις στις απαντήσεις τους.

Το έγγραφο ορίζει την τάση του AI προς την loftiness ως υπερσκέψι, όπου το κεντρικό μήνυμα δεν είναι μόνο σκεπασμένο από λεκτική Loftiness, αλλά μερικές φορές ακόμη και δυσμενώς επηρεασμένο από αυτή. Το μικρότερο το μοντέλο, το έγγραφο παρατηρεί, η λιγότερη αυτή η θεραπεία χρειάζεται, ή λειτουργεί.

Η έρευνα καταλήγει στο συμπέρασμα ότι δεν υπάρχει τίποτα αρχιτεκτονικό που πρέπει να διορθωθεί για να εφαρμοστεί αυτή η λύση συστηματικά. Ωστόσο, σε μια συνεδρία χρήστη, μια οδηγία προς τη συντομία θα χρειαζόταν πιθανώς επανάληψη, ενώ ένα παγκοσμίως-εφαρμοσμένο σύστημα-πρόσκληση – το οποίο θα χρειαζόταν να εφαρμοστεί ως προκατασκευασμένο στην μηχανική σε πλατφόρμες όπως το ChatGPT – θα μπορούσε να κάνει συντομότερες απαντήσεις προεπιλεγμένη συμπεριφορά.

Ανέμους

Τίποτα από αυτά δεν εξηγεί ακριβώς γιατί τα μεγαλύτερα μοντέλα τείνουν προς την loftiness,既然 αυτό είναι κάτι που επηρεάζει τα ανοιχτά μοντέλα επίσης. Το έγγραφο προτείνει ότι τα πρωτόκολλα και οι κοινές πρακτικές στη Μάθηση Ενίσχυσης από Ανθρώπινη Ανταπόκριση (RLHF) τεχνικές θα μπορούσαν να προσφέρουν μια εξήγηση*:

‘Μια πιθανή προέλευση είναι η εκπαίδευση RLHF, όπου οι ανθρώπινοι annotators ανταποκρίνονται στην πλήρη επεξήγηση σε μεγαλύτερα μοντέλα με μεγαλύτερη ικανότητα να ενεργούν σε σημάδια-μήκους-αμοιβής–συνεπής με τις διαφορές Loftiness που είναι μεγαλύτερες σε instruction-ελαστικά από τις base μοντέλο παραλλαγές.

‘Προηγούμενη εργασία καταγράφει συστηματική μήκος-παρωχημένη σε αμοιβή μοντέλα, όπου οι annotators συγχέουν το μήκος με την ποιότητα.

‘Μεγαλύτερα μοντέλα, έχοντας μεγαλύτερη ικανότητα να ικανοποιούν σημάδια-μήκους-αμοιβής, μπορεί να εσωτερικεύσουν Loftiness γεννήτρια πιο βαθιά από τα μικρότερα μοντέλα, παράγοντας το scale-εξαρτώμενο υπερσκέψι που παρατηρούμε.’

Στους ανθρώπους, η Loftiness μπορεί να συμβεί για να γεμίσει μια σιωπή, ή να μασκάρει αισθήματα αμηχανίας, λόγω νοσολογικής κατάστασης, ή να κρύψει την έλλειψη γνώσης. Σε μια AI, θα μπορούσε να επηρεαστεί μόνο από αυτά τα παράγοντες μέσω απορρόφησης δεδομένων εκπαίδευσης που αντανακλούν/manifest αυτά τα χαρακτηριστικά.

Στα δεδομένα corpora, υπάρχουν άλλες мотивές για Loftiness απαντήσεις, όπως η SEO ενθάρρυνση να παράγει μεγαλύτερο κείμενο, για παράδειγμα σε συνταγές, όπου το μήκος γίνεται (συχνά λανθασμένα) συνδεδεμένο με την εξουσία.

Τίποτα δεν μπορεί να αποκλειστεί εντελώς ότι οι API-βασισμένες πλατφόρμες, που ενθαρρύνουν τους χρήστες να einer υψηλότερου και πιο ακριβού επιπέδου συνδρομής, είτε ενθαρρύνουν είτε δεν εποπτεύουν Loftiness,既然 αυτό αυξάνει τη χρήση token khá φθηνά, χωρίς την ανάγκη για υπερβολική λογική ή RAG κλήσεις†.

Το νέο έγγραφο ονομάζεται Περιορισμοί Συντομίας Αναστρέφουν Ιεραρχίες Επίδοσης σε Μοντέλα Γλώσσας, και προέρχεται από το Τμήμα Πληροφορικής στο Sweden Polytechnic Institute στο Chattogram, στο Μπανγκλαντές.

Μέθοδος

Για να δοκιμάσει τις θεωρίες του εγγράφου, 31 γλωσσικά μοντέλα αξιολογήθηκαν – πολύ πολλά για να αναφερθούν σε κείμενο-μορφή εδώ, αλλά απεικονισμένα στην εικόνα παρακάτω:

Τα Μεγάλα Μοντέλα Γλώσσας (LLMs) που δοκιμάστηκαν σε διάφορα μέρη των δοκιμών για το νέο έγγραφο.

Τα μοντέλα αξιολογήθηκαν έναντι πέντε συλλογών αναφοράς: GSM8K, για μαθηματική σκέψη, BoolQ, για κατανόηση ανάγνωσης, CommonsenseQA, για κοινή σκέψη, ARC-Easy, που καλύπτει επιστημονικές ερωτήσεις, και MMLU-STEM, επίσης για επιστημονική γνώση.

Απαντήσεις γεννήθηκαν χρησιμοποιώντας αυτο-κωδικοποίηση για να διασφαλιστεί детерμινιστική εξόδους, και στη συνέχεια εξαγόμενα με task-ειδικές κανόνες, με ακρίβεια που μετράται ως το μερίδιο σωστών απαντήσεων έναντι ground truth.

Τα μοντέλα χωρίστηκαν ανά μέγεθος, με αυτά που ήταν κάτω από δέκα δισεκατομμύρια παραμέτρους να αντιμετωπίζονται ως ‘μικρά’, και αυτά πάνω από εβδομήντα δισεκατομμύρια ως ‘μεγάλα’, με βάση τις παρατηρούμενες διαφορές απόδοσης.

Η αντίστροφη κλίμακα ποσοτικοποιήθηκε συγκρίνοντας την απόδοση των ομάδων σε κάθε πρόβλημα, σημειώνοντας περιπτώσεις όπου τα μικρότερα μοντέλα ξεπέρασαν τα μεγαλύτερα, και στη συνέχεια χρησιμοποιώντας στατιστικό μέγεθος αποτελέσματος για να επιβεβαιώσει ότι αυτές οι διαφορές αντανακλούσαν σταθερές, σημαντικές διαφορές και όχι θόρυβο.

Αποκλεισμός Ανακλησεως

Για να αποκλείσει την πιθανότητα ότι τα μοντέλα απλώς ανακαλούν δεδομένα εκπαίδευσης, τρεις ξεχωριστές ελέγχοι πραγματοποιήθηκαν, εξετάζοντας πόσο ποικίλα ήταν οι απαντήσεις, πόσο η μήκος τους κυμαινόταν, και πώς οι σφάλματα πραγματοποιήθηκαν. Αν τα μοντέλα βασίζονταν σε απομνημονευμένα πρότυπα, οι απαντήσεις θα είχαν την τάση να επαναλαμβάνονται ή να ακολουθούν σταθερά πρότυπα, αντίθετα, οι απαντήσεις αποδείχθηκαν κυρίως μοναδικές μεταξύ των μοντέλων, με εμφανή ποικιλία στη μήκος, από μια απάντηση σε μια άλλη.

Τα σφάλματα εξετάστηκαν επίσης直接, με τις περισσότερες αποτυχίες να λαμβάνουν τη μορφή μακρών, λανθασμένων εξηγήσεων, αντί για σύντομες, αποφασιστικές απαντήσεις – υποδεικνύοντας ότι τα μοντέλα γεννούσαν πραγματική σκέψη. αντί να ανακτούν αποθηκευμένες απαντήσεις.

Δεδομένα και Δοκιμές

Δοκιμάζοντας για μεμονωμένες ερωτήσεις αντί για ερωτήσεις επικεφαλίδας, ένα μεγάλο μερίδιο των εργασιών αναφοράς αποδείχθηκε να μην είναι ενημερωτικό, με 27,1% να αποτυγχάνουν να διακρίνουν τα μοντέλα καθόλου, επειδή είτε όλα τα συστήματα πέτυχαν είτε όλα τα συστήματα απέτυχαν, αφήνοντας κανένα πραγματικό σήμα για σχετική απόδοση:

Η ανάλυση του προβλήματος σε πέντε αναφορές έδειξε ότι ένα σημαντικό μερίδιο των εργασιών απέτυχε να διακρίνει μεταξύ των μοντέλων, ενώ ένα μικρότερο αλλά σταθερό μέρος εμφάνισε αντίστροφη κλίμακα, όπου τα μικρότερα μοντέλα ξεπέρασαν τα μεγαλύτερα. Η συνολική κατανομή σε 1.485 προβλήματα δείχνει ότι το 7,7% εμφανίζει αντίστροφη κλίμακα. Πηγή

Μεταξύ των ερωτήσεων που δίδουν διακρίνουν τα μοντέλα, τα περισσότερα συμπεριφέρθηκαν όπως αναμενόταν, με τα μεγαλύτερα συστήματα να εκτελούνται καλύτερα, αλλά ένα μικρότερο μέρος εμφάνισε το αντίθετο πρότυπο, με τα μικρότερα μοντέλα να ξεπερνούν τα μεγαλύτερα. Σε όλα τα προβλήματα, η αντίστροφη κλίμακα εμφανίστηκε στο 7,7% των περιπτώσεων, υποδεικνύοντας ότι η επίδραση δεν είναι περιφερειακή.

Εμφάνιση Αντιστρόφου Κλίμακας

Σε όλες τις αναφορές, 115 προβλήματα βρέθηκαν όπου τα μικρότερα μοντέλα ξεπέρασαν τα μεγαλύτερα, αποτελώντας το 7,7% όλων των 1.485 εργασιών, υποδεικνύοντας ότι η αντίστροφη κλίμακα δεν είναι κάποιο είδος σπάνιας ή περιφερειακής εμφάνισης σε αυτόν τον τομέα.

Στην πραγματικότητα, η επίδραση εμφανίστηκε σε κάθε σύνολο δεδομένων: πιο ισχυρά στο BoolQ, και πιο αδύναμα στο CommonsenseQA, ARC-Easy, GSM8K, και MMLU-STEM, υποδεικνύοντας ότι είναι διαδεδομένη, αλλά ποικίλλει ανάλογα με την εργασία:

Η αντίστροφη κλίμακα εμφανίστηκε σε όλες τις αναφορές, κυμαινόμενη από 3,9% στο MMLU-STEM σε 11,3% στο BoolQ, με 115 προβλήματα συνολικά. Τα κενά απόδοσης ευνοούσαν τα μικρότερα μοντέλα κατά μέσο όρο 28,4 ποσοστιαίες μονάδες. Η ακρίβεια μειώθηκε καθώς το μέγεθος του μοντέλου αυξανόταν, με τα μικρότερα μοντέλα να φτάνουν στο 66,1%, σε σύγκριση με 41,5% για τα μεγαλύτερα.

Το μέγεθος του κενά αποδείχθηκε σημαντικό, με τα μικρότερα μοντέλα να είναι μπροστά κατά μέσο όρο 28,4 ποσοστιαίες μονάδες, και κάθε περίπτωση να δείχνει την ίδια κατεύθυνση του πλεονεκτήματος, υποδεικνύοντας μια σταθερή πτώση της απόδοσης, αντί για περιστασιακά ή ad hoc σφάλματα.

Το ίδιο πρότυπο 적용όταν σε διαφορετικές οικογένειες μοντέλων, συμπεριλαμβανομένων Llama, Qwen, Gemma, και Mistral, όπου τα μεγαλύτερα μοντέλα underperformed τα μικρότερα, με την ακρίβεια να τείνει να μειώνεται καθώς το μέγεθος του μοντέλου αυξανόταν σε αυτά τα προβλήματα.

Το κενά μεταξύ μικρών και μεγάλων μοντέλων ήταν αρκετά μεγάλο, ώστε η τύχη να μην μπορεί να το εξηγήσει, και επειδή το ίδιο πρότυπο εμφανίστηκε σε διαφορετικές αναφορές, εργασίες και οικογένειες μοντέλων, η αντίστροφη κλίμακα εμφανίστηκε ως μια σταθερή και όχι τυχαία επίδραση.

Κοιτάζοντας μέσα σε κάθε οικογένεια μοντέλων, τα μεγαλύτερα μοντέλα επαναλαμβάνονταν χειρότερα από τα μικρότερα σε αυτά τα προβλήματα, υποδεικνύοντας ότι η πτώση μπορεί να είναι συνδεδεμένη με την κλίμακα herself, αντί να είναι συνδεδεμένη με διαφορές σχεδιασμού.

Τα αποτελέσματα δείχνουν επίσης ότι υπάρχει ένα όριο για κάθε εργασία, όπου η αύξηση του μεγέθους του μοντέλου αρχίζει να βλάπτει την απόδοση, δείχνοντας ότι τα μεγαλύτερα μοντέλα δεν οδηγούν πάντα σε καλύτερα αποτελέσματα.

Εξέταση Υπερσκέψης

Αφού καθορίστηκε ότι τα μεγαλύτερα μοντέλα μερικές φορές εκτελούνται χειρότερα σε ορισμένα πεδία, η ανάλυση στράφηκε στο γιατί συμβαίνει αυτό, προτείνοντας ότι το πρόβλημα δεν είναι η έλλειψη ικανότητας, αλλά υπερβολική εξήγηση – δηλαδή, περιπτώσεις όπου οι μακρύτερες απαντήσεις αρχίζουν να σκέπασουν σωστή σκέψη.

Σε όλα τα δεδομένα, οι μακρύτερες απαντήσεις συνδέθηκαν με χαμηλότερη ακρίβεια σε αυτά τα δύσκολα προβλήματα, ακόμη και αν τα μεγαλύτερα και μικρότερα μοντέλα παρήγαγαν περίπου παρόμοιο αριθμό βημάτων σκέψης, υποδεικνύοντας ότι το πρόβλημα δεν είναι πόσο σκέψη γίνεται, αλλά πώς εκφράζεται:

Οι συντομότερες απαντήσεις βελτίωσαν την απόδοση του μεγάλου μοντέλου και μειώθηκαν το κενά με τα μικρότερα μοντέλα, κόβοντας τη διαφορά από 44,2 ποσοστιαίες μονάδες σε 14,8 (και σε ορισμένες περιπτώσεις αναστρέφοντας το εντελώς), ενώ οι απευθείας μορφές απαντήσεων στενεύουν το κενά ακόμη περισσότερο. Οι ισχυρότερες κερδισμένες εμφανίστηκαν στο GSM8K και MMLU-STEM, όπου οι βαθμολογίες αναστρέφθηκαν προς τα μεγαλύτερα μοντέλα, και οι ελέγχοι μήκους απάντησης επιβεβαίωσαν ότι η παρέμβαση λειτουργούσε, με εξόδους που έπεσαν από περίπου 197 tokens σε λιγότερο από 80, συνδέοντας τη μειωμένη Loftiness με τη βελτιωμένη ακρίβεια.

Όταν οι απαντήσεις υποχρεώθηκαν να είναι συντομότερες, τα μεγαλύτερα μοντέλα βελτιώθηκαν δραματικά, μειώνοντας ένα σημαντικό κενά απόδοσης, και σε ορισμένες περιπτώσεις, σχεδόν εξαφανίζοντας το. Αντίθετα, τα μικρότερα μοντέλα άλλαξαν πολύ λίγο, υποδεικνύοντας ότι η Loftiness ενεργά βλάπτει τα μεγαλύτερα συστήματα.

Η επίδραση αποδείχθηκε να ποικίλλει ανάλογα με την εργασία, με ορισμένες αναφορές να ωφελούνται έντονα από συντομότερες απαντήσεις, και άλλες να απαιτούν κάποιο βαθμό εξήγησης, αλλά σε ορισμένες περιπτώσεις, η βαθμολογία μεταξύ μικρών και μεγάλων μοντέλων αναστράφηκε εντελώς όταν η Loftiness περιορίστηκε, αποκαλύπτοντας ότι τα μεγαλύτερα μοντέλα είχαν κρυφό δυναμικό που ήταν να μασκαρεύεται από υπερ-επεξήγηση.

Επιπλέον ανάλυση έδειξε ότι τα μεγαλύτερα μοντέλα hatten να παράγουν μακρύτερες εξόδους συνολικά, παρά χρησιμοποιώντας ελαφρώς λιγότερα ρητά βήματα σκέψης, υποδεικνύοντας μια πιο δυσδιάστατη και λιγότερο δομημένη μορφή σκέψης.

Αντίθετα, τα μικρότερα μοντέλα έδωσαν συντομότερες, πιο απευθείας απαντήσεις, υποδεικνύοντας ότι ο τρόπος με τον οποίο η σκέψη εκφράζεται, και όχι η ποσότητα της σκέψης, οδηγεί στην πτώση της απόδοσης.

Οι συγγραφείς καταλήγουν στο γενικό συμπέρασμα ότι οι περιορισμοί συντομίας φέρνουν οφέλη ακρίβειας, και θεωρούν ότι αυτό θα μπορούσε να γίνει ένα θεμελιώδες χαρακτηριστικό στα μοντέλα γλώσσας, αντί για μια επαναλαμβανόμενη, χρηστής-εφαρμοσμένη περιορισμό που δεν επιβίωσε σε διάφορες συνεδρίες, και δηλώνονται:

‘[Οι περιορισμοί συντομίας] βοηθούν τα μεγαλύτερα μοντέλα δραματικά ενώ σχεδόν δεν επηρεάζουν τα μικρότερα μοντέλα.

‘Εάν η Loftiness ήταν περιστασιακή και όχι αιτιολογική, θα αναμενόταν ομοιόμορφες αλλαγές ακρίβειας σε cả τις κατηγορίες μεγέθους. Η διαφορετική απόκριση επιβεβαιώνει ότι η υπερσκέψη είναι μια scale-εξαρτώμενη λειτουργία αποτυχίας, και όχι μια επίδραση δυσκολίας εργασίας.’

Συμπέρασμα

Πέρα από τις ανοιχτές πηγές που δοκιμάστηκαν από τους ερευνητές, το πρόβλημα της Loftiness φαίνεται, ανεκδοτικά, με συχνότητα σε πολλά μεγάλα μοντέλα εκτός από το ChatGPT, συμπεριλαμβανομένων Claude, Gemini, και Grok.

Εάν those πλατφόρμες παραβλέπουν το πρόβλημα Loftiness επειδή αυξάνει τη χρήση token και ενθαρρύνει υψηλότερες δαπάνες†, δεν φαίνεται λογικό ότι θα αποδεχθούν την πτώση της ακρίβειας που συνοδεύει αυτό το ‘νεύμα’.

Θα ήταν ενδιαφέρον να δούμε εάν κάποιος εμπειρικός μέθοδος θα μπορούσε να καθορίσει με βεβαιότητα από πού προέρχεται η τάση προς την Loftiness. Όποιος έχει προσπαθήσει να κάνει ένα chatbot να μιλήσει, αντί να ‘μπλογκάρει’ Loftiness, μακρές, πολυσχιδείς απαντήσεις στο χρήστη, θα έχει συνειδητοποιήσει ότι το μοντέλο έχει σοβαρά εντυπωθεί με ‘όλα-σε-ένα’ οδηγούς χρήστη, και ‘αποδεκτές λύσεις’ στα δεδομένα εκπαίδευσης.

Θα ήταν πολύ ενδιαφέρον να δούμε εάν ένα μοντέλο που εκπαιδεύτηκε ειδικά σε βήμα-προς-βήμα συνομιλίες θα μπορούσε να απομακρύνει την Loftiness, τη συντοπιά. Ωστόσο, φαίνεται πιθανό ότι κάποιοι περιορισμοί ή φίλτρα θα πρέπει να τοποθετηθούν στο βάρος που το μοντέλο εκπαιδεύεται να δίνει στην ‘αποφασισμένη’ απάντηση, ώστε να εκπαιδευτεί trực tiếp και στα προηγούμενα υλικά – ουσιαστικά, η ρητή σκέψη που είναι σαφής στις βήμα-προς-βήμα συνομιλίες.

Εφόσον τα κατάλληλα δεδομένα φαίνονται πιθανό να είναι σπάνια, ίσως ο唯一 τρόπος προς τα εμπρός με αυτήν την προσέγγιση θα ήταν μέσω συνθετικών δεδομένων, όπου ‘σύνθετες’ τελικές結 luậnες αναλύονται συνομιλίες – ειρωνικά, με τον ίδιο τρόπο όπως τα AI podcasts που το Google NotebookLM μπορεί να ερμηνεύσει από απλή κείμενο εισαγωγή.

* Η μετατροπή μου των εσωτερικών αναφορών των συγγραφέων σε υπερ-συνδέσμους.

† Αλλά ας είμαστε ειλικρινείς, η ελλειπή μεταξύ των πραγματικών κόστων AI και των χρεώσεων συνδρομής είναι目前 τόσο μεγάλη που αυτό θα ήταν απλώς να βλάψει τη φήμη του χρήστη χωρίς να λύσει τη σοβαρή οικονομική των αυτής της φάσης της ‘μετατροπής’ και ‘συγκλίνουσας’ φάσης του AI.

Πρώτη δημοσίευση Κυριακή, 5 Απριλίου 2026