Τεχνητή νοημοσύνη

Γιατί τα Συστήματα Γενετικών Βίντεο Δεν Μπορούν να Δημιουργήσουν Πλήρεις Ταινίες;

Η έλευση και η πρόοδος των γενετικών βίντεο AI έχει οδηγήσει πολλούς μη εξειδικευμένους παρατηρητές να προβλέψουν ότι η μηχανική μάθηση θα αποδείξει τον θάνατο της κινηματογραφικής βιομηχανίας όπως τη γνωρίζουμε – αντίθετα, einzelニ δημιουργοί θα μπορέσουν να δημιουργήσουν ταινίες στο στυλ του Χόλιγουντ στο σπίτι, είτε σε τοπικά είτε σε συστήματα GPU βασισμένα στο cloud.

Είναι αυτό δυνατό; Ακόμη και αν είναι δυνατό, είναι αυτό επικείμενο, όπως πιστεύουν πολλοί;

Ότι τα άτομα θα μπορέσουν τελικά να δημιουργήσουν ταινίες, με τη μορφή που τις γνωρίζουμε, με συνεπείς χαρακτήρες, αφηγηματική συνέχεια και πλήρη φωτορεαλισμό, είναι khá πιθανό – και vielleicht ακόμη και αναπόφευκτο.

Ωστόσο, υπάρχουν beberapa πραγματικά θεμελιώδεις λόγοι για τους οποίους αυτό δεν είναι πιθανό να συμβεί με συστήματα βίντεο βασισμένα σε Latent Diffusion Models.

Αυτό το τελευταίο事 είναι σημαντικό γιατί, αυτή τη στιγμή, αυτή η κατηγορία περιλαμβάνει κάθε δημοφιλές σύστημα text-to-video (T2) και image-to-video (I2V) που είναι διαθέσιμο, συμπεριλαμβανομένων Minimax, Kling, Sora, Imagen, Luma, Amazon Video Generator, Runway ML, Kaiber (και, όσο μπορούμε να διακρίνουμε, την επικείμενη λειτουργικότητα βίντεο της Adobe Firefly); μεταξύ πολλών άλλων.

Εδώ, εξετάζουμε την προοπτική αληθινών πλήρως αυτοτελών παραγωγών gen-AI, δημιουργημένων από άτομα, με συνεπείς χαρακτήρες, κινηματογράφηση και οπτικά εφέ τουλάχιστον στο επίπεδο της τρέχουσας κατάστασης της τέχνης στο Χόλιγουντ.

Ας δούμε μερικά από τα μεγαλύτερα πρακτικά εμπόδια στα προκλήματα που涉ονται.

1: Δεν Μπορείτε να Πάρει μια Ακρίβεια Ακολουθιακή Λήψη

Η αφηγηματική ασυνέπεια είναι το μεγαλύτερο από αυτά τα εμπόδια. Το γεγονός είναι ότι κανένα από τα τρέχοντα διαθέσιμα συστήματα γενετικών βίντεο δεν μπορεί να κάνει μια πραγματικά ακριβή ‘ακολουθιακή λήψη’.

Αυτό οφείλεται στο ότι το μοντέλο denoising diffusion στο κέντρο αυτών των συστημάτων βασίζεται σε τυχαίο θόρυβο, και αυτή η βασική αρχή δεν είναι εύκολη να ερμηνεύσει ακριβώς το ίδιο περιεχόμενο δύο φορές (δηλαδή, από διαφορετικές γωνίες, ή αναπτύσσοντας την προηγούμενη λήψη σε μια ακολουθιακή λήψη που διατηρεί τη συνέχεια με την προηγούμενη λήψη).

Όπου χρησιμοποιούνται κείμενα προτροπών, μόνα τους ή μαζί με ανεβαζόμενα ‘σπέρματα’ εικόνων (πολυτροπική είσοδος), τα tokens που προέρχονται από την προτροπή θα κάνουν semantically-κατάλληλο περιεχόμενο από τον εκπαιδευμένο latent χώρο του μοντέλου.

Ωστόσο, περαιτέρω εμποδισμένα από τον ‘τυχαίο θόρυβο’ παράγοντα, δεν θα το κάνει ποτέ με τον ίδιο τρόπο δύο φορές.

Αυτό σημαίνει ότι οι ταυτότητες των ανθρώπων στο βίντεο θα έχουν την τάση να μετατοπιστούν, και τα αντικείμενα και τα περιβάλλοντα δεν θα ταιριάζουν με την αρχική λήψη.

Αυτό είναι το λόγο για τον οποίο τα ιογενή κλιπ που απεικονίζουν εξαιρετικά οπτικά και Hollywood-επίπεδο εξόδου tend να είναι είτε μονές λήψεις, είτε ένα ‘σόου케이σ’ του 몫ου του συστήματος, όπου κάθε λήψη διαθέτει διαφορετικούς χαρακτήρες και περιβάλλοντα.

Απόσπασμα από μια γενετική AI μοντάζ από Marco van Hylckama Vlieg – πηγή: https://www.linkedin.com/posts/marcovhv_thanks-to-generative-ai-we-are-all-filmmakers-activity-7240024800906076160-nEXZ/

Η έννοια σε αυτές τις συλλογές από ad hoc γενετικών βίντεο (που μπορεί να είναι δόλια στην περίπτωση εμπορικών συστημάτων) είναι ότι το υποκείμενο σύστημα μπορεί να δημιουργήσει συνεχείς και συνεπείς αφηγήσεις.

Η αναλογία που εκμεταλλεύεται εδώ είναι ένα trailer ταινίας, το οποίο διαθέτει μόνο ένα ή δύο λεπτά από το βίντεο της ταινίας, αλλά δίνει στο κοινό λόγο να πιστεύουν ότι η ολόκληρη ταινία υπάρχει.

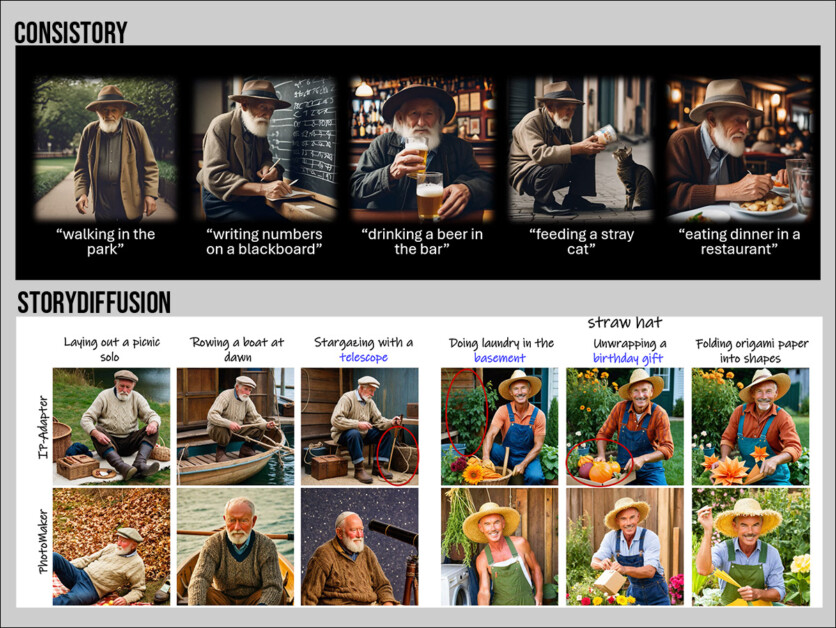

Τα μόνο συστήματα που προσφέρουν αφηγηματική συνέχεια σε ένα μοντέλο διάχυσης είναι αυτά που παράγουν στατικές εικόνες. Αυτά περιλαμβάνουν το ConsiStory της NVIDIA, και διάφορα έργα στη научική βιβλιογραφία, όπως το TheaterGen, το DreamStory, και το StoryDiffusion.

Δύο παραδείγματα ‘στατικών’ αφηγηματικής συνέχειας, από πρόσφατα μοντέλα:: Πηγές: https://research.nvidia.com/labs/par/consistory/ και https://arxiv.org/pdf/2405.01434

Θεωρητικά, θα μπορούσατε να χρησιμοποιήσετε μια καλύτερη εκδοχή τέτοιων συστημάτων (κανένα από τα παραπάνω δεν είναι πραγματικά συνεπές) για να δημιουργήσετε μια σειρά από image-to-video λήψεις, οι οποίες θα μπορούσαν να συνδεθούν σε μια ακολουθία.

Στην τρέχουσα κατάσταση της τέχνης, αυτή η προσέγγιση δεν παράγει πιθανές ακολουθιακές λήψεις. Και, σε κάθε περίπτωση, έχουμε ήδη απομακρύνθεί από το όνειρο του auteur με την προσθήκη ενός επιπλέον επιπέδου πολυπλοκότητας.

Μπορούμε, επιπλέον, να χρησιμοποιήσουμε Low Rank Adaptation (LoRA) μοντέλα, ειδικά εκπαιδευμένα σε χαρακτήρες, πράγματα ή περιβάλλοντα, για να διατηρήσουμε καλύτερη συνέχεια μεταξύ λήψεων.

Ωστόσο, αν ένας χαρακτήρας θέλει να εμφανιστεί με ένα νέο κοστούμι, ένα εντελώς νέο LoRA θα πρέπει συνήθως να εκπαιδευτεί που ενσωματώνει τον χαρακτήρα ντυμένο με αυτό το στυλ (αν και υπο-εννοιες όπως ‘κόκκινο φόρεμα’ μπορούν να εκπαιδευτούν σε ατομικά LoRAs, μαζί με κατάλληλες εικόνες, δεν είναι πάντα εύκολες να εργαστούν).

Αυτό προσθέτει σημαντική πολυπλοκότητα, ακόμη και σε μια εναρκτήρια σκηνή σε μια ταινία, όπου ένας άνθρωπος βγάζει από το κρεβάτι, βάζει ένα dressing gown, γαβγίζει, κοιτάζει από το παράθυρο του υπνοδωματίου και πάει στο μπάνιο για να ξυρίσει τα δόντια του.

Μια τέτοια σκηνή, που περιέχει περίπου 4-8 λήψεις, μπορεί να γυριστεί σε μια πρωινή σύγκλιση με συμβατικές μεθόδους κινηματογράφησης. Στην τρέχουσα κατάσταση της τέχνης στη γενετική AI, αυτό потенτικά αντιπροσωπεύει εβδομάδες εργασίας, πολλαπλά εκπαιδευμένα LoRAs (ή άλλα βοηθητικά συστήματα) και μια σημαντική ποσότητα μετά-επεξεργασίας

Εναλλακτικά, μπορεί να χρησιμοποιηθεί video-to-video, όπου βίντεο ή CGI μετατρέπονται μέσω κειμένων-προτροπών σε εναλλακτικές ερμηνείες. Το Runway προσφέρει ένα τέτοιο σύστημα, για παράδειγμα.

CGI (αριστερά) από Blender, ερμηνευμένο σε μια πειραματική διαδικασία video-to-video του Runway με τη βοήθεια κειμένων-προτροπών από Mathieu Visnjevec – Πηγή: https://www.linkedin.com/feed/update/urn:li:activity:7240525965309726721/

Υπάρχουν δύο προβλήματα εδώ: ήδη πρέπει να δημιουργήσετε το βασικό βίντεο, οπότε ήδη κάνετε την ταινία δύο φορές, ακόμη και αν χρησιμοποιείτε ένα συνθετικό σύστημα όπως το MetaHuman της UnReal.

Αν δημιουργήσετε CGI μοντέλα (όπως στο κλιπ παραπάνω) και τα χρησιμοποιήσετε σε μια video-to-image μετατροπή, η συνέχεια τους μεταξύ λήψεων δεν μπορεί να εξαρτηθεί.

Αυτό οφείλεται στο ότι τα μοντέλα διάχυσης βίντεο δεν βλέπουν την ‘μεγάλη εικόνα’ – αντίθετα, δημιουργούν μια νέα πλαισίου βασισμένη σε προηγούμενο/α πλαισίου/α, και, σε κάποιες περιπτώσεις, εξετάζουν ένα κοντινό μελλοντικό πλαισίου. Αλλά, για να συγκρίνουμε τη διαδικασία με ένα παιχνίδι σκακιού, δεν μπορούν να σκεφτούν ‘δέκα κινήσεις μπροστά’ και δεν μπορούν να θυμηθούν δέκα κινήσεις πίσω.

Δεύτερον, ένα μοντέλο διάχυσης θα συνεχίσει να δυσκολεύεται να διατηρήσει μια συνεπή εμφάνιση μεταξύ των λήψεων, ακόμη και αν περιλαμβάνετε πολλαπλά LoRAs για χαρακτήρες, περιβάλλοντα και στυλ φωτισμού, για τους λόγους που αναφέρθηκαν στην αρχή αυτής της ενότητας.

2: Δεν Μπορείτε να Επεξεργαστείτε μια Λήψη Εύκολα

Αν απεικονίσετε einen χαρακτήρα που περπατάει στο δρόμο χρησιμοποιώντας παλιές μεθόδους CGI, και αποφασίσετε ότι θέλετε να αλλάξετε κάποιο аспект της λήψης, μπορείτε να調整σετε το μοντέλο και να το render ξανά.

Αν είναι μια πραγματική λήψη, απλά reset και γυρίστε το ξανά, με τις αντίστοιχες αλλαγές.

Ωστόσο, αν παράγετε μια λήψη gen-AI βίντεο που σας αρέσει, αλλά θέλετε να αλλάξετε ένα аспект της, μπορείτε να το κάνετε μόνο με την.use των πονηρών μεθόδων μετά-επεξεργασίας που έχουν αναπτυχθεί τα τελευταία 30-40 χρόνια: CGI, rotoscoping, modeling και matting – όλες εργασίες που απαιτούν πολύ χρόνο και είναι ακριβές, χρονοβόρες διαδικασίες.

Ο τρόπος με τον οποίο λειτουργούν τα μοντέλα διάχυσης, απλά αλλάζοντας ένα аспект μιας κειμενικής προτροπής (ακόμη και σε μια πολυτροπική προτροπή, όπου παρέχετε μια πλήρη πηγή εικόνας) θα αλλάξει πολλαπλά аспекта της παραγώμενης εξόδου, οδηγώντας σε ένα παιχνίδι προτροπής ‘whack-a-mole’.

3: Δεν Μπορείτε να Εξαρτηθείτε από τους Νόμους της Φυσικής

Παραδοσιακές μεθόδους CGI προσφέρουν eine ποικιλία από αλγοριθμικά μοντέλα που βασίζονται στη φυσική που μπορούν να προσομοιώσουν πράγματα όπως ρευστοδυναμική, κινητική αερίων, αντίστροφη κινηματική (η ακριβής μοντελοποίηση της κίνησης του ανθρώπου), δυναμική υφασμάτων, εκρήξεις, και διάφορα άλλα φαινόμενα του πραγματικού κόσμου.

Ωστόσο, τα μοντέλα διάχυσης, όπως έχουμε δει, έχουν σύντομες μνήμες, και επίσης ένα περιορισμένο εύρος κινήσεων (παραδείγματα τέτοιων ενεργειών, που περιλαμβάνονται στη βάση δεδομένων εκπαίδευσης) να आकरτούν.

Σε μια προηγούμενη έκδοση της σελίδας του OpenAI για το διακεκριμένο γενετικό σύστημα Sora, η εταιρεία παραδέχτηκε ότι το Sora έχει περιορισμούς σε αυτόν τον τομέα (αν και αυτό το κείμενο έχει αφαιρεθεί):

‘[Sora] μπορεί να δυσκολευτεί να προσομοιώσει τη φυσική μιας σύνθετης σκηνής, και μπορεί να μην καταλάβει συγκεκριμένες περιπτώσεις αιτίας και αποτελέσματος (για παράδειγμα: ένα μπισκότο μπορεί να μην δείξει ένα σημάδι μετά από ένα χαρακτήρα που το δαγκώνει).

‘Το μοντέλο μπορεί επίσης να συγχύσει χωρικές λεπτομέρειες που περιλαμβάνονται σε μια προτροπή, όπως να διακρίνει αριστερά από δεξιά, ή να δυσκολευτεί με ακριβείς περιγραφές γεγονότων που αναπτύσσονται με το χρόνο, όπως συγκεκριμένες τροχιές κάμερας.’

Η πρακτική χρήση των διάφορων API-βασισμένων γενετικών συστημάτων βίντεο αποκαλύπτει παρόμοιους περιορισμούς στην απεικόνιση ακριβών φυσικών φαινομένων. Ωστόσο, ορισμένα κοινά φυσικά φαινόμενα, όπως οι εκρήξεις, φαίνεται να είναι καλύτερα αναπαρασταμένα στις βάσεις δεδομένων εκπαίδευσής τους.

Ορισμένα μοντέλα κίνησης, είτε εκπαιδευμένα στο γενετικό μοντέλο είτε τροφοδοτημένα από μια πηγή βίντεο, χρειάζονται χρόνο για να ολοκληρωθούν (όπως ένας άνθρωπος που εκτελεί μια σύνθετη και μη επαναλαμβανόμενη χορευτική ακολουθία σε ένα περίπλοκο κοστούμι) και, μια φορά ξανά, το μυωπικό παράθυρο προσοχής του μοντέλου διάχυσης είναι πιθανό να μετατρέψει το περιεχόμενο (ταυτότητα προσώπου, λεπτομέρειες κοστουμιού, κ.λπ.) μέχρι τη στιγμή που η κίνηση έχει ολοκληρωθεί. Ωστόσο, τα LoRAs μπορούν να μετριάσουν αυτό, μέχρι ένα σημείο.

Επίδραση στο Post

Υπάρχουν άλλα ελαττώματα στην καθαρή ‘μονή χρήστη’ γενετική παραγωγή βίντεο, όπως η δυσκολία που έχουν στην απεικόνιση ταχύτατων κινήσεων, και το γενικότερο και πολύ πιο επικείμενο πρόβλημα της απόκτησης χρονικής συνέχειας στην έξοδο βίντεο.

Επιπλέον, η δημιουργία συγκεκριμένων επιδόσεων προσώπου είναι σχεδόν ένα ζήτημα τύχης στη γενετική βίντεο, όπως και η lip-sync για διάλογο.

Σε cả τις περιπτώσεις, η χρήση βοηθητικών συστημάτων όπως το LivePortrait και το AnimateDiff γίνεται όλο και πιο δημοφιλής στη κοινότητα VFX,既然 αυτό επιτρέπει την μεταφορά τουλάχιστον των ευρύτερων εκφράσεων προσώπου και lip-sync σε υπάρχοντα γενετικά παραγόμενα βίντεο.

Παράδειγμα μεταφοράς εκφράσεων (οδηγώντας βίντεο στο κάτω αριστερό) που επιβάλλεται σε ένα βίντεο-στόχο με το LivePortrait. Το βίντεο είναι από το Generative Z TunisiaGenerative. Δείτε την πλήρη έκδοση σε καλύτερη ποιότητα στο https://www.linkedin.com/posts/genz-tunisia_digitalcreation-liveportrait-aianimation-activity-7240776811737972736-uxiB/?

Επιπλέον, μια μυριάδα σύνθετων λύσεων, που ενσωματώνουν εργαλεία όπως το Stable Diffusion GUI ComfyUI και την επαγγελματική εφαρμογή σύνθεσης και χειρισμού Nuke, καθώς και τη χειρισμό του latent χώρου, επιτρέπουν στους επαγγελματίες VFX να αποκτήσουν μεγαλύτερο έλεγχο над την έκφραση και τη διάθεση του προσώπου.

Αν και περιγράφει τη διαδικασία της animation προσώπου στο ComfyUI ως ‘βάσανο’, ο επαγγελματίας VFX Francisco Contreras έχει αναπτύξει μια τέτοια διαδικασία, η οποία επιτρέπει την επιβολή των lip phonemes και άλλων аспектών της απεικόニσης κεφαλής/προσώπου

Το Stable Diffusion, με τη βοήθεια μιας ροής εργασίας ComfyUI που βασίζεται στο Nuke, επέτρεψε στον επαγγελματία VFX Francisco Contreras να αποκτήσει ασυνήθιστη έλεγχο над τις πτυχές του προσώπου. Για το πλήρες βίντεο, σε καλύτερη ανάλυση, μεταβείτε στο https://www.linkedin.com/feed/update/urn:li:activity:7243056650012495872/

Συμπέρασμα

Κανένα από αυτά δεν είναι ευνοϊκό για την προοπτική ενός μονήρου χρήστη που γεννάει συνεπείς και φωτορεαλιστικές, στο στυλ του Χόλιγουντ, πλήρεις ταινίες, με πραγματιστικές διαλόγους, lip-sync, επιδόσεις, περιβάλλοντα και συνέχεια.

Επιπλέον, τα εμπόδια που περιγράψαμε εδώ, τουλάχιστον σε σχέση με τα μοντέλα διάχυσης βίντεο, δεν είναι απαραίτητα λύσιμα ‘κάθε στιγμή’ τώρα, παρά τις σχολιασμούς σε φόρουμ και την προσοχή των μέσων ενημέρωσης που κάνουν αυτή την περίπτωση. Οι περιορισμοί που περιγράψαμε φαίνεται να είναι εγγενείς στην αρχιτεκτονική.

Στη recherche της AI σύνθεσης, όπως και σε όλες τις επιστημονικές έρευνες, εξαιρετικές ιδέες περιόδευαν να μας εκπλήσσουν με το δυναμικό τους, μόνο για να αποκαλύψουν τα θεμελιώδη τους περιορισμούς.

Στον χώρο της γενετικής/σύνθεσης, αυτό έχει ήδη συμβεί με τα Generative Adversarial Networks (GANs) και τα Neural Radiance Fields (NeRF), τα οποία τελικά αποδείχθηκαν πολύ δύσκολα να instrumentalize σε εμπορικά συστήματα, παρά τα χρόνια της ακαδημαϊκής έρευνας προς αυτόν τον σκοπό. Αυτές οι τεχνολογίες εμφανίζονται τώρα πιο συχνά ως συστατικά σε εναλλακτικές αρχιτεκτονικές.

Όπως οι κινηματογραφικές εταιρείες μπορεί να ελπίζουν ότι η εκπαίδευση σε εγκεκριμένα καταλόγους ταινιών θα μπορούσε να εξαφανίσει τους καλλιτέχνες VFX και τα συνεργεία, η AI πραγματικά προσθέτει ρόλους στην εργατική δύναμη αυτή τη στιγμή.

Εάν τα συστήματα διάχυσης βίντεο μπορούν πραγματικά να μετατραπούν σε γεννήτορες ταινιών με αφηγηματική συνέχεια και φωτορεαλισμό, ή εάν όλη η διαδικασία είναι απλά μια αλχημεία, θα πρέπει να γίνει εμφανές τους επόμενους 12 μήνες.

Μожет να χρειαζόμαστε μια εντελώς νέα προσέγγιση. Ή μπορεί να αντιπροσωπεύει το Gaussian Splatting (GSplat), το οποίο αναπτύχθηκε στις αρχές της δεκαετίας του ’90 και έχει πρόσφατα ξεκινήσει στην περιοχή της σύνθεσης εικόνων, μια πιθανή εναλλακτική λύση στη γενετική παραγωγή βίντεο.

Καθώς το GSplat πήρε 34 χρόνια να έρθει στο προσκήνιο, είναι πιθανό ότι παλαιότεροι διεκδικητές όπως το NeRF και τα GANs – και ακόμη και τα μοντέλα διάχυσης – δεν έχουν ακόμη τη μέρα τους.

* Αν και το AI Storyboard της Kaiber προσφέρει αυτή τη λειτουργικότητα, τα αποτελέσματα που έχω δει δεν είναι παραγωγής ποιότητας.

Ο Martin Anderson είναι ο πρώην επικεφαλής του επιστημονικού ερευνητικού περιεχομένου στο metaphysic.ai

Πρώτη δημοσίευση Δευτέρα, 23 Σεπτεμβρίου 2024