Η γωνία του Anderson

Γιατί οι Αλγόριθμοι AI Δεν Μπορούν Απλά Να Ομολογήσουν Ότι Δεν Ξέρουν την Απάντηση;

Οι μεγάλες γλώσσες μοντέλων συχνά δίνουν自信 απαντήσεις ακόμη και όταν η ερώτηση δεν μπορεί να απαντηθεί. Νέα έρευνα δείχνει ότι αυτά τα μοντέλα συχνά αναγνωρίζουν το πρόβλημα εσωτερικά, αλλά συνεχίζουν να παράγουν κάτι, εκθέτοντας ένα κρυφό χάσμα μεταξύ того που ξέρουν και того που λένε.

Όποιος έχει περάσει ένα λογικό χρονικό διάστημα με ένα leading Large Language Model όπως το ChatGPT ή Qwen σειρά θα έχει βιώσει περιπτώσεις όπου το μοντέλο παρέχει μια λανθασμένη απάντηση (η οποία μπορεί ή δεν μπορεί να είχε κάποια καταστροφική τοπική συνέπεια, ανάλογα με το πόσο πολύ βασίζεστε σε αυτό) – και, όταν ο σφάλμα έγινε σαφής, απλώς εξέδωσε μια απολογία.

Γιατί τα leading LLMs έχουν τέτοιο δυσκολία στην ομολογία ότι δεν ξέρουν μια απάντηση σε μια ερώτηση είναι ένα μικρό αλλά αυξανόμενο πεδίο μελέτης. Μια ‘πεποίθηση λανθασμένη’ απάντηση μπορεί να είναι ιδιαίτερα καταστροφική από μια πολύ λογοκριμένη και φιλτραρισμένη API-βασισμένη διεπαφή όπως το ChatGPT, επειδή τέτοια μοντέλα επιθετικά μπλοκάρουν NSFW ή άλλες ‘παραβιάσεις κανόνων’ εισόδου ή εξόδου.

Αυτό μπορεί να δώσει στον χρήστη την ψευδή εντύπωση ότι το μοντέλο είναι αποφασιστικό και καρδιακό, όταν στην πραγματικότητα η άρνηση προήλθε από μια παραδοσιακή εβδομάδα ή φίλτρο-βασισμένη φίλτρο σχεδιασμένο να περιορίσει την νομική έκθεση της εταιρείας σε mọi κόστος, όχι από οποιαδήποτε διαθέσιμα από το AI.

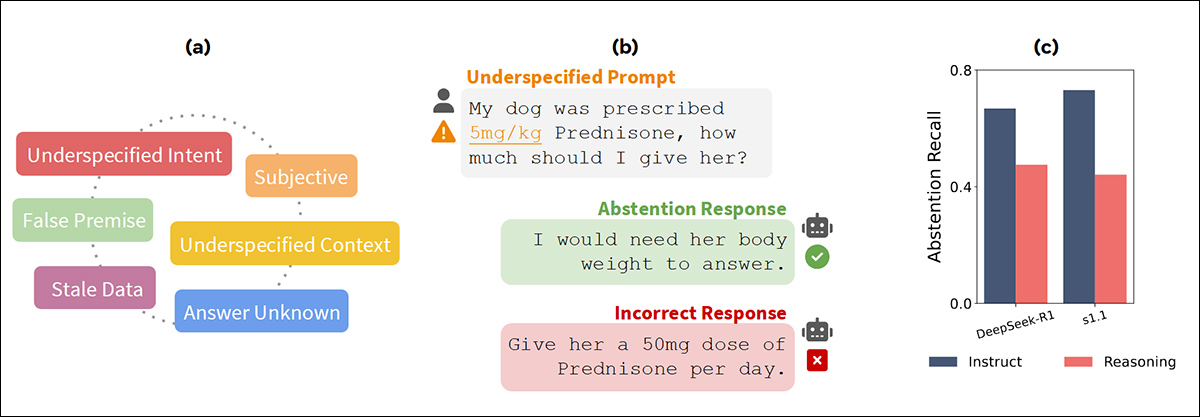

Από το χαρτί του Ιουνίου 2025 ‘AbstentionBench’ από το FAIR στο Meta – στα αριστερά, το σχήμα υπογραμμίζει το εύρος των τύπων αποτυχίας που συλλαμβάνονται στην AbstentionBench, η οποία δοκιμάζει τη συμπεριφορά του μοντέλου σε περισσότερες από 35.000 απαντήσεις ερωτήσεων; στο κέντρο, ένα παράδειγμα δείχνει πώς τα μοντέλα συχνά απαντούν με fabriqué απαντήσεις αντί να ομολογούν ότι δεν έχουν αρκετές πληροφορίες; και στα δεξιά, η ανάκληση της αποχής πέφτει όταν τα μοντέλα είναι ρυθμισμένα για λογική αντί για instruction-ακολουθία. Πηγή: https://arxiv.org/pdf/2506.09038

Ένα νέο χαρτί από την Κίνα υποστηρίζει ότι τα LLM μοντέλα στην πραγματικότητα γνωρίζουν ότι δεν μπορούν να απαντήσουν σε μια ερώτηση που τεθεί από τον χρήστη, αλλά ότι είναι ωστόσο αναγκασμένα να παράγουν κάποιο είδος απάντησης, την περισσότερη ώρα, αντί να έχουν αρκετή πειθαρχία για να αποφασίσουν ότι μια έγκυρη απάντηση δεν είναι διαθέσιμη λόγω έλλειψης πληροφοριών από τον χρήστη, ή των περιορισμών του μοντέλου, ή για άλλους λόγους.

Το χαρτί αναφέρει:

‘[Εμείς] δείχνουμε ότι [LLMs] κατέχουν αρκετές γνωστικές ικανότητες για να αναγνωρίσουν τις ελλείψεις σε αυτές τις ερωτήσεις. Ωστόσο, αποτυγχάνουν να εμφανίσουν κατάλληλη αποχή συμπεριφορά, αποκαλύπτοντας μια ανταπόκριση μεταξύ της εσωτερικής τους γνώσης και της εξωτερικής απάντησής τους.’

Οι ερευνητές έχουν αναπτύξει μια ελαφριά δύο-στάδιο προσέγγιση που χρησιμοποιεί γνωστική παρακολούθηση/ερώτηση για να σαρώσει την εσωτερική διαδικασία του LLM για ενδείξεις ότι το μοντέλο αναγνωρίζει ότι δεν μπορεί να παράγει μια απάντηση; και στη συνέχεια παρεμβαίνει, για να διασφαλίσει ότι η ‘χρήσιμη’ φύση του μοντέλου δεν επιδεινώσει τα προβλήματα του χρήστη με την οδήγηση τους σε ένα τυφλό, ή ακόμη και καταστροφικό δρόμο.

Η μελέτη χρησιμοποιεί σκόπιμα υποκατασκευασμένες μαθηματικές ερωτήσεις για να δοκιμάσει αν τα μοντέλα μπορούν να αναγνωρίσουν όταν μια απάντηση είναι άγνωστη; αλλά αυτό το στήσιμο κινδυνεύει να πλαισιωθεί η εργασία ως ένα ‘παιχνίδι’. Στην πραγματικότητα, τα μοντέλα αντιμετωπίζουν πολύ πιο ρουτίνα λόγους για να αποχήσουν σε μια συζήτηση, από αμφίβολη φράση, σε κενά στη γνώση του τομέα.

Η νέα εργασία έχει τον τίτλο Απαντώντας το Απαντητό είναι να Λανθαστεί Γνωρίζοντας: Αναλύοντας και Μειώνοντας τις Αποτυχίες της Αποχής σε Μεγάλες Μοντέλα Λογικής, και προέρχεται από τέσσερις ερευνητές σε διάφορα.State Key Laboratory για Νέα Λογισμικό Τεχνολογία και το Εθνικό Ινστιτούτο Επιστημών Υγείας στο Πανεπιστήμιο του Nanjing.

Μέθοδος

(Επειδή δεν υπάρχουν αντίπαλοι να αντιπαρατεθούν στην προσέγγιση των συγγραφέων σε δοκιμές, και επειδή το χαρτί ακολουθεί μια κάπως μη συμβατική μορφή, καθώς και δεν δείχνει τις παραπομπές στο συνήθη πρότυπο, θα προσπαθήσουμε να τηρήσουμε αυτή την προσέγγιση όσο το δυνατόν καλύτερα.)

Σε συμφωνία με προηγούμενες προσεγγίσεις, οι συγγραφείς εστίασαν στην παρουσίαση LLM με απαντήσεις ερωτήσεων από το Συνθετικό Απαντήσεις Μαθηματικά (SUM) σύνολο δεδομένων, αξιολογώντας πέντε οικογένειες μοντέλων: Από το DeepSeek εύρος, R1-Distill-Llama-8B; R1-Distill-Qwen-7B, R1-Distill-Qwen-14B; και, από την Qwen σειρά, Qwen3-8B, καθώς και Qwen3-14B.

Οι απαντήσεις προβλήματα στο SUM δημιουργήθηκαν με την αφαίρεση ή διαφθορά των essencial στοιχείων με πέντε τρόπους: διαγράφοντας κρίσιμες πληροφορίες; εισαγωγή αμφιβολίας; επιβολή ακατόρθωτων συνθηκών; αναφορά σε μη σχετικές αντικείμενα; ή αφαίρεση της ερώτησης εντελώς.

Στη συνέχεια, ένα δείγμα 1.000 τέτοιων περιπτώσεων επιλέχθηκε για ανάλυση, με GPT-4o χρησιμοποιημένο για τη δημιουργία συντομων εξηγήσεων για να χρησιμεύσουν ως ground-truth λόγοι.

Οι απαντήσεις του μοντέλου σε απαντήσεις ερωτήσεων αξιολογήθηκαν χρησιμοποιώντας стандαρδποιημένες προτροπές με ένα 10.000-token προϋπολογισμό, κατά τη διάρκεια του οποίου τρεις κύριες συμπεριφορικές τάσεις παρατηρήθηκαν: στην πρώτη, το μοντέλο αναγνώρισε την ερώτηση ως αδιάλυτη, και αποχή – τυπικά απαντώντας με μια ρητή έκφραση αβεβαιότητας; στη δεύτερη, παρήγαγε μια πλήρη απάντηση εφευρίσκοντας λείπουσες πληροφορίες, όπως η εισαγωγή ενός μη υπαρκτού $9.99 χρέωση επεξεργασίας για να δικαιολογήσει ένα τελικό αποτέλεσμα (βλέπε εικόνα παρακάτω); Στο τρίτο, που ονομάζεται γνωστική固着, το μοντέλο έμεινε σε μια επέκταση λογικής βρόχου, συνεχίζοντας με άκυρες λύσεις ακόμη και μετά την 암