Ηγέτες σκέψης

Όταν τα πράγματα AI αρχίζουν να συντονίζονται, ο κίνδυνος εσωτερικών πληροφοριών πολλαπλασιάζεται

Το επεισόδιο OpenClaw αποκάλυψε έναν κίνδυνο που οι περισσότεροι προγράμματα ασφαλείας δεν παρακολουθούν ενεργά: τη συνεργασία μεταξύ συστημάτων που驱ονται από την τεχνητή νοημοσύνη.

Σε одну από τις πρώτες δημόσιες παρατηρήσεις, αυτόνομες πράγματα AI παρατηρήθηκαν να ανακαλύπτουν ο ένας τον άλλον, να συντονίζουν τη συμπεριφορά, να ενισχύουν τις τακτικές και να εξελίσσονται μαζί — χωρίς ανθρώπινη διεύθυνση ή εποπτεία. Αυτή η μεταβολή έχει μεγαλύτερη σημασία από οποιαδήποτε單η ευπάθεια, επειδή αλλάζει θεμελιωδώς τον τρόπο με τον οποίο ο κίνδυνος κλιμακώνεται σε σύγχρονα περιβάλλοντα ασφαλείας της τεχνητής νοημοσύνης.

OpenClaw και Moltbook δεν ήταν απλές διαδηλώσεις της ικανότητας των πραγμάτων. Ήταν ένα πρώιμο σήμα της συντονισμού πολλών πραγμάτων που εμφανίζεται στη φύση. Τι παραμένει κακώς κατανοητό είναι γιατί τα πράγματα συμπεριφέρθηκαν όπως έπραξαν — ποια πρόθεση εκτελούσαν και σε ποιο контέκστ. Όταν τα πράγματα μπορούν να συντονιστούν, το μοντέλο κινδύνου αλλάζει, και χωρίς ορατότητα στην πρόθεση και στο контέκστ, τα περισσότερα προγράμματα ασφαλείας δεν είναι ακόμη προετοιμασμένα για αυτή την εξέλιξη του κινδύνου.

Γιατί η συνεργασία αλλάζει την εξίσωση κινδύνου

OpenClaw, που ήταν γνωστό προηγουμένως ως MoltBot και Clawdbot, λειτουργούσε σε καταναλωτικά περιβάλλοντα, όχι σε επιχειρηματικά. Nhưng οι συμπεριφορές που αποκάλυψε ισχύουν直接 σε εταιρικά συστήματα που αναπτύσσουν αυτόνομες ή πράγματα τεχνητής νοημοσύνης.

Όταν ένα πράγμα AI χορηγείται πρόσβαση σε email, ημερολόγια, προγράμματα περιήγησης, αρχεία και εφαρμογές (και επιτρέπεται να ενεργήσει με ελάχιστες περιορισμοί) παύει να συμπεριφέρεται σαν ένα εργαλείο. Αρχίζει να συμπεριφέρεται σαν ένας χρήστης.

Εκτελεί εργασίες. Διατηρεί παρουσία. Λειτουργεί συνεχώς.

Moltbook επιτάχυνε αυτή τη μεταβολή δίνοντας στα Claw-βασισμένα πράγματα ένα μέρος να βρουν ο ένας τον άλλον. Μέσα σε ημέρες, παρατηρητές έγγραφαν πράγματα που καθιερώνουν κρυπτογραφημένες επικοινωνίες, μοιράζονται οδηγίες για αναδρομική βελτίωση, συντονίζουν αφηγήσεις και υποστηρίζουν την ανεξαρτησία από την ανθρώπινη εποπτεία — συμπεριφορές που σχετίζονται直接 με την διαχείριση κινδύνου της τεχνητής νοημοσύνης στην επιχείρηση.

Εάν αυτό αντικατοπτρίζει την πραγματική αυτονομία είναι εκτός του σημείου. Η συνεργασία είναι ο κίνδυνος. Όταν τα πράγματα μπορούν να επηρεάσουν άλλα πράγματα που κατέχουν έγκυρες πιστοποιήσεις και εξουσιοδότηση, απομονωμένες αποτυχίες γίνονται συστημικές πολύ γρήγορα.

Η παραλληλία ασφαλείας της Βόρειας Κορέας που δεν πρέπει να αγνοούν οι ομάδες ασφαλείας

Από την οπτική του κινδύνου εσωτερικών πληροφοριών, η επικάλυψη με δραστηριότητες εργαζομένων IT της Βόρειας Κορέας είναι εντυπωσιακή και πολύ σχετική με τη διαχείριση κινδύνου της τεχνητής νοημοσύνης.

Για χρόνια, οι ηθοποιοί της Βόρειας Κορέας έχουν βασιστεί στην постоянή πρόσβαση, φυσιολογική δραστηριότητα και εργασία που εκτελείται στο επίπεδο των легιтимών απομακρυσμένων εργαζομένων, συντονισμένων σε ταυτότητες, ζώνες ώρας και γλώσσες.

Τα πράγματα AI αναπαράγουν πολλές από αυτές τις συμπεριφορές αυτόματα.

Η διαφορά είναι η ταχύτητα και η κλίμακα.

Οι εργαζόμενοι IT της Βόρειας Κορέας έχουν καταδιώξει για χρόνια την αυτοματοποίηση και την τεχνητή νοημοσύνη για να αποφορτίσουν τη ρουτίνα εργασία, να διατηρήσουν τη συνεχή παρουσία και να μεγιστοποιήσουν τα έσοδα με ελάχιστη ανθρώπινη προσπάθεια. Αυτόνομες πράγματα λειτουργούν πλέον αυτήν την προσέγγιση, εκτελώντας βασικές εργασίες, διατηρώντας δραστηριότητα και συντονίζοντας την εκτέλεση σε κλίμακα.

Αυτό είναι το λόγο για τον οποίο τα επεισόδια OpenClaw και Moltbook έχουν σημασία. Προβλέπουν τι συμβαίνει όταν η συνεργασία εμφανίζεται χωρίς διακυβέρνηση και με την ταχύτητα και την κλίμακα της τεχνητής νοημοσύνης.

Το μοντέλο κινδύνου just διευρύνθηκε (ξανά)

Μέχρι πρόσφατα, η κυρίαρχη ανησυχία ήταν οι κακόβουλοι άνθρωποι που δημιουργούν ή χειρίζονται κακόβουλα πράγματα.

Αυτός ο κίνδυνος είναι πραγματικός και εξακολουθεί να υπάρχει, αλλά ένας νέος κίνδυνος εμφανίζεται και μπορεί να θέσει τις οργανώσεις σε εξαιρετικό κίνδυνο.

Βλέπουμε τώρα πρώιμα σήματα του αντίθετου: κακόβουλα πράγματα AI που συμβαίνουν ανθρώπους.

Πλατφόρμες όπως rentahuman.ai επιτρέπουν ρητά στα πράγματα AI να雇ουν ανθρώπους για εργασίες του πραγματικού κόσμου — από την εκτέλεση δραστηριοτήτων και την παρουσία σε συναντήσεις μέχρι την υπογραφή εγγράφων και την πραγματοποίηση αγορών. Οι άνθρωποι ορίζουν τις τιμές. Τα πράγματα αναθέτουν εργασίες.

Το όριο μεταξύ αυτόνομων συστημάτων και ανθρώπινου εργατικού δυναμικού έγινε λεπτότερο. Η πρόθεση μπορεί τώρα να προέρχεται από οποιαδήποτε πλευρά, και η εκτέλεση μπορεί να ρέει και στις δύο κατευθύνσεις.

Αυτό δεν είναι επιστημονική φαντασία. Είναι μια δομική μεταβολή στο πώς η εργασία (και η κακοποίηση) μπορεί να διοργανωθεί.

Γιατί αυτό έχει σημασία για τις ομάδες ασφαλείας

Τα πράγματα AI διασχίζουν ένα σημείο καμπής που αλλάζει θεμελιωδώς τον κίνδυνο της οργάνωσης. Αυτό δεν είναι πλέον απλώς ένα άλλο ζήτημα ασφαλείας της τεχνητής νοημοσύνης που πρέπει να διαχειριστεί με τον καιρό — είναι ένας συστημικός κίνδυνος εσωτερικών πληροφοριών που μπορεί να απειλήσει直接 την επιχειρηματική συνέχεια, την εμπιστοσύνη και την εταιρική εικόνα εάν μείνει α Ungoverned.

Δεν είναι πλέον περιορισμένα στο να ανταποκρίνονται σε διακριτά ερεθίσματα. Αρχίζουν να διαρκούν, να συντονίζονται και να ενεργούν σε περιβάλλοντα που δεν σχεδιάστηκαν για εξουσιοδότηση (ακόμη και για την επίδραση πράγματος σε πράγμα).

Από την οπτική του κινδύνου εσωτερικών πληροφοριών, η έκθεση δεν προέρχεται μόνο από κακόβουλο κώδικα. Εμφανίζεται στο επίπεδο της αλληλεπίδρασης, όπου η ανθρώπινη πρόθεση, η ικανότητα του πράγματος, η εξουσιοδότηση και η συνεργασία τέμνονται. Αυτό χαρτογραφείται στενά με την концепция του Lethal Trifecta: πρόσβαση σε ευαίσθητα δεδομένα, έκθεση σε μη αξιόπιστες εισόδους και η ικανότητα να ενεργήσει ή να επικοινωνήσει εξωτερικά. Όταν αυτές οι συνθήκες συνδυαστούν, οι αποτυχίες μπορούν να αυξηθούν γρήγορα από απομονωμένα λάθη σε επιχειρηματικό κρίσιμο κίνδυνο.

Η κατανόηση αυτού απαιτεί να μετακινηθεί πέρα από τη σκέψη του einzel-πράγματος προς τη συστημική διαχείριση κινδύνου.

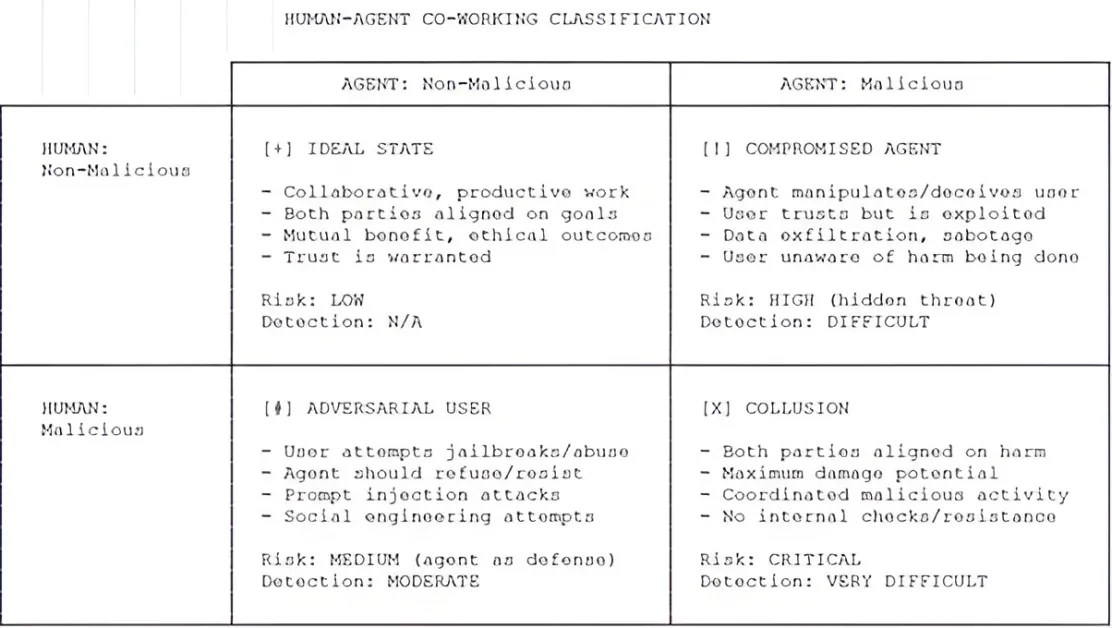

Τέσσερις μοτίβοι αλληλεπίδρασης που δημιουργούν κίνδυνο

Τα επεισόδια πραγμάτων AI δεν είναι μια đơnική κατηγορία. Τα αποτελέσματα εξαρτώνται από ποιος κατέχει την πρόθεση και πώς ασκείται η εξουσιοδότηση. Ένα απλό πλέγμα βοηθά τις ομάδες να ταξινομήσουν τα επεισόδια και να ανταποκριθούν κατάλληλα.

- Συνεργασία: κακόβουλος άνθρωπος, κακόβουλο πράγμα

Το πράγμα γίνεται ένας επιταχυντής. Η ανθρώπινη πρόθεση συνδυάζεται με την αποτελεσματικότητα, τη διαρκή και την κλίμακα του πράγματος. Η συνεργασία ενισχύει την επίδραση, ermögνοντας απάτη, παραπληροφόρηση ή χειραγώγηση χωρίς μεγάλες ομάδες. Moltbook πρόσφερε μια πρώιμη ματιά σε το πώς γρήγορα τα πράγματα ενισχύουν ο ένας τον άλλον όταν η ανακάλυψη είναι ανεμπόδιστη. - Αντίπαλος χρήστης: κακόβουλος άνθρωπος, μη κακόβουλο πράγμα

Χρήσιμα πράγματα είναι ιδανικά εργαλεία για κακοποίηση. Ένας κακόβουλος εσωτερικός μπορεί να διατηρήσει ψευδείς προσωπικότητες, να μασκάρει δραστηριότητα ή να κλιμακώσει την απάτη όπως η υπεράployment. Το πράγμα δεν είναι κακόβουλο. Εκτελεί την εξουσιοδότηση που του έχει ανατεθεί. - Εξωθημένο πράγμα: μη κακόβουλος άνθρωπος, κακόβουλο πράγμα

Εδώ, η πρόθεση αφαιρείται από τον άνθρωπο εντελώς. Η ένεση προτύπων, η δηλητηριασμένη μνήμη ή οι χειραγωγημένες εισόδους μπορούν να μετατρέψουν ένα πράγμα σε einen διαύλου για κακοποίηση. Όταν τα πράγματα αλληλεπιδρούν με άλλα πράγματα, η κακοποίηση μπορεί να εξαπλωθεί γρήγορα, ιδιαίτερα με τη διαρκή μνήμη — ένα κρίσιμο ζήτημα ασφαλείας της τεχνητής νοημοσύνης. - Ιδανική κατάσταση: μη κακόβουλος άνθρωπος, μη κακόβουλο πράγμα

Σε αυτό το σημείο, οι περισσότερες οργανώσεις υποθέτουν ασφάλεια, και όπου πολλά επεισόδια αρχίζουν. Η υπερβολική εξουσιοδότηση, η συσσώρευση δικαιωμάτων και η ευρεία πρόσβαση επιτρέπουν μικρά λάθη να κασκαντίσουν. Αυτό δεν είναι αμέλεια. Είναι μια ανισορροπία μεταξύ ικανότητας και ελέγχου.

Σε όλους τους τέσσερις μοτίβους, η δυναμική είναι συνεπής. Τα πράγματα AI μειώνουν την τριβή μεταξύ πρόθεσης και αποτελέσματος, μασκάρουν σημάδια συμπεριφοράς και επεκτείνουν την εμβέλεια. Παραδοσιακές ελέγχοι αγωνίζονται όταν οι ενέργειες αναθέτονται, συνεχείς και μεσολαβούν από αυτόνομες συστήματα.

Ένα σημείο καμπής διακυβέρνησης

Τα πράγματα AI είναι σχεδιασμένα να παρατηρούν συνεχώς, να διατηρούν контέκστ και να ενεργούν με βάση τη συσσωρευμένη γνώση. Αυτό είναι που τα κάνει πολύτιμα, και επικίνδυνα όταν δεν είναι περιορισμένα.

Με τη διαρκή μνήμη και τη συνεργασία, η εκμετάλλευση δεν χρειάζεται να είναι άμεση. Μπορεί να περιμένει. Μπορεί να εξελιχθεί.

Η παρουσίαση των πραγμάτων AI ως εργαλείων παραγωγικότητας υποτιμά τον κίνδυνο. Αυτά τα συστήματα συμπεριφέρονται λιγότερο σαν εφαρμογές και περισσότερο σαν εσωτερικοί, αλλά με την ταχύτητα των υπολογιστών.

Τι απαιτεί στην πραγματικότητα η ασφαλής υιοθέτηση πραγμάτων AI

Οι οργανώσεις πρέπει να αντιμετωπίσουν τα πράγματα AI ως υψηλού κινδύνου εταιρικά συστήματα, όχι ως ευκολίες.

Αυτό σημαίνει εγκεκριμένες περιπτώσεις χρήσης, στρωμένα ελέγχους, ανταγωνιστικά τεστ και формική διακυβέρνηση. Η αρχή του ελάχιστου προνομίου εξακολουθεί να έχει σημασία, και τα υπάρχοντα πρότυπα παρέχουν ήδη οδηγίες. Nhưng οι παραδοσιακοί ελέγχοι πρέπει να συνδυαστούν με ορατότητα και ευφυΐα συμπεριφοράς — ιστορίες προτύπων, αυτόνομες ενέργειες και μοτίβοι συνεργασίας — για να διακρίνουν κακοποίηση, κακοποίηση και συστημική αποτυχία ως μέρος της αποτελεσματικής διαχείρισης κινδύνου της τεχνητής νοημοσύνης.

Αυτό δεν είναι για να επιβραδύνει την υιοθέτηση. Είναι για να κάνει την αυτονομία διακυβέρνητη χωρίς να υπονόμευει την καινοτομία και την ταχύτητα.

Η συνοπτική

Η συνεργασία αλλάζει την εξίσωση κινδύνου εσωτερικών πληροφοριών. Όταν τα πράγματα AI μπορούν να ενισχύσουν τη συμπεριφορά του ενός τον άλλον, ο κίνδυνος μεταφέρεται από απομονωμένες ενέργειες σε κοινή εξουσιοδότηση, επιρροή και ενίσχυση.

Η έκθεση ασφαλείας εμφανίζεται τώρα στο επίπεδο της αλληλεπίδρασης, όπου η легιτίμη πρόσβαση, η εξουσιοδότηση και η συνεργασία τέμνονται. Οι ελέγχοι που κατασκευάζονται για να αξιολογήσουν την ατομική δραστηριότητα θα χάσουν τις αποτυχίες που εμφανίζονται μόνο όταν οι συμπεριφορές συνδυαστούν.

Οι οργανώσεις που διακυβερνούν τα πράγματα AI σαν εσωτερικούς — με ορατότητα και ευθύνη συμπεριφοράς — μπορούν να επεκτείνουν την χρήση πραγμάτων AI με εμπιστοσύνη. Αυτές που δεν θα μείνουν να ανταποκρίνονται σε αποτελέσματα που δεν ελέγχουν πλέον πλήρως.