Η γωνία του Anderson

Χρήση του AI για τη Βελτίωση των Φωτογραφιών Πριν Λαμβάνονται

Αντί να χρησιμοποιούν το GenAI για να διορθώσουν τις φωτογραφίες μετά τις λήψεις, οι ερευνητές έχουν εκπαιδεύσει ένα σύστημα που σας λέει πώς να κινηθείτε, να στάσετε και να πλαισιώσετε τη λήψη πριν, χρησιμοποιώντας τη μελετημένη γνώση για το τι κάνει τις εικόνες αξιομνημόνευτες.

Η διόρθωση φωτογραφιών μετά την λήψη έχει γίνει πιο εύκολη για khá nějaký καιρό, καθώς οι κατασκευαστές και οι τεχνολογικές πλατφόρμες προσφέρουν ολοένα και περισσότερο την επεξεργασία внутри της κάμερας που επιτρέπει στους χρήστες να αλλάξουν τις εικόνες αμέσως μετά την λήψη. Δημοφιλείς συστήματα αυτού του είδους περιλαμβάνουν την συνομιλητική επεξεργασία της Google και την γενετική επεξεργασία της Samsung, μεταξύ άλλων.

Ωστόσο, μια νέα τάση που ευνοεί την “αυθεντικότητα” έναντι των αποτελεσμάτων που βελτιώνονται από το AI μπορεί να σημαίνει ότι πολλοί από τους καταναλωτές που στοχεύουν τέτοια συστήματα αρχίζουν να θεωρούν τις “αλλοιωμένες” φωτογραφίες ως AI σκουπίδια.

Ίσως αυτό είναι το που ενέπνευσε την Google να δημιουργήσει einen AI-εκπαιδευμένο “προπονητή κάμερας” που ενημερώνεται από το Gemini, το οποίο είναι ικανό να δίνει άμεσες οδηγίες για τη βελτίωση μιας φωτογραφίας κατά τη διάρκεια της λήψης:

Ο Προπονητής Κάμερας της Google λέει στον χρήστη πώς να ξαναπλαίσιασε μια φωτογραφία, μαζί με άλλα βασικά κομμάτια συμβουλών. Πηγή

Ως ιδιοκτησιακό σύστημα και με πρακτικά μηδενική πληροφορία διαθέσιμη στο διαδίκτυο σχετικά με αυτό, ο Προπονητής Κάμερας φαίνεται να αξιοποιεί το Gemini για να βοηθήσει τους χρήστες να βελτιώσουν την πλαισίωση (βλέπε εικόνα παραπάνω) ή να κάνουν μικρές αλλαγές στη στάση (όπως να μετακινηθούν πιο κοντά ο ένας στον άλλον ή να κοιτάξουν απευθείας στην κάμερα).

Έτσι, όσο μπορεί κανείς να καταλάβει, το προϊόν ωθεί τη σύνθεση προς το μέσο, προφανώς με βάση εκατομμύρια σημεία δεδομένων που έχουν αναρτηθεί που πιθανότατα να έχουν συμβάλλει στην εκπαίδευση του Gemini. Σε αυτό το πλαίσιο, οι χρήστες που έχουν ανεβάσει το περιεχόμενο έχουν δημιουργήσει την καλιμπράωση του AI με την απόρριψη μη ικανοποιητικών λήψεων και την ανάρτηση αυτών που τους αρέσουν – μια αποτελεσματική (και δωρεάν) μορφή καταλογοποίησης του συνόλου δεδομένων!

Ωστόσο, οι φωτογραφίες που είναι μεσαίες όσον αφορά τη σύνθεση δεν κατέχουν απαραίτητα τις ίδιες αισθητικές αξίες ή την επίδραση του θεατή όπως οι φωτογραφίες που είναι αξιομνημόνευτες.

Πέρα από το “Τυρί!” και τον Κανόνα του Τρίτου

Για αυτό το σκοπό, και προς ένα σύστημα που είναι πιο προσιτό σε όλες τις πλατφόρμες, νέα έρευνα από την Ιταλία προσφέρει ένα σύστημα τύπου Coach που βασίζεται σε προηγούμενη γνώση του τι κάνει τις φωτογραφίες να μένουν στο μυαλό:

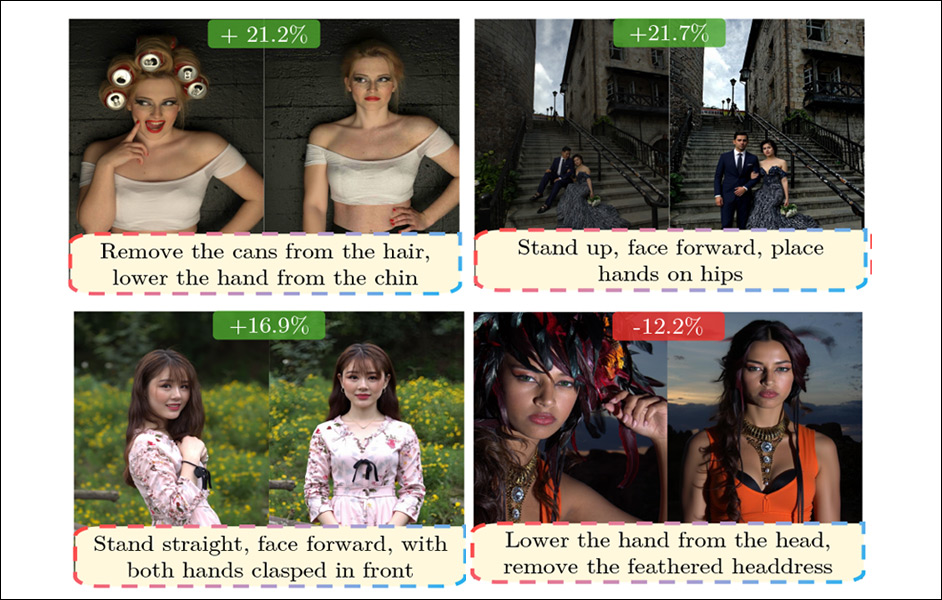

Πανωλεθρία παραδείγματα συμβουλών από το νέο σύστημα των συγγραφέων. Πηγή

Στα παραπάνω παραδείγματα, βλέπουμε τις συμβουλές που δίνονται από το νέο σύστημα των συγγραφέων – που ονομάζεται MemCoach – το οποίο είναι δύσκολο να φανταστεί κανείς ότι θα το παρείχε ένα AI που επικεντρώνεται στη σύνθεση όπως ο Προπονητής Κάμερας. Στην πρώτη (αριστερή) περίπτωση, η συμβουλή να αφαιρέσετε το καπέλλο είναι ιδιαίτερα αμφισβητήσιμη. Στη δεύτερη εικόνα, είναι δύσκολο να φανταστεί κανείς τι συμβατικό πλαίσιο θα μπορούσε να εξαγάγει ένα AI που επικεντρώνεται στη σύνθεση από τη γενική σκηνή (δηλ. μια “artistική” εικόνα μιας νέας γυναίκας που лежει στο πάτωμα με τα μάτια κλειστά).

Η βασική κατανόηση σχετικά με την αξιομνημόνευση στη φωτογραφία, που χρησιμοποιήθηκε για την ανάπτυξη του τριμερούς ιταλικού συστήματος, προέρχεται από διάφορες προηγούμενες εργασίες, συμπεριλαμβανομένης της εξόδου Τι κάνει ένα αντικείμενο αξιομνημόνευτο; και της εργασίας Τι κάνει μια φωτογραφία αξιομνημόνευτη;.

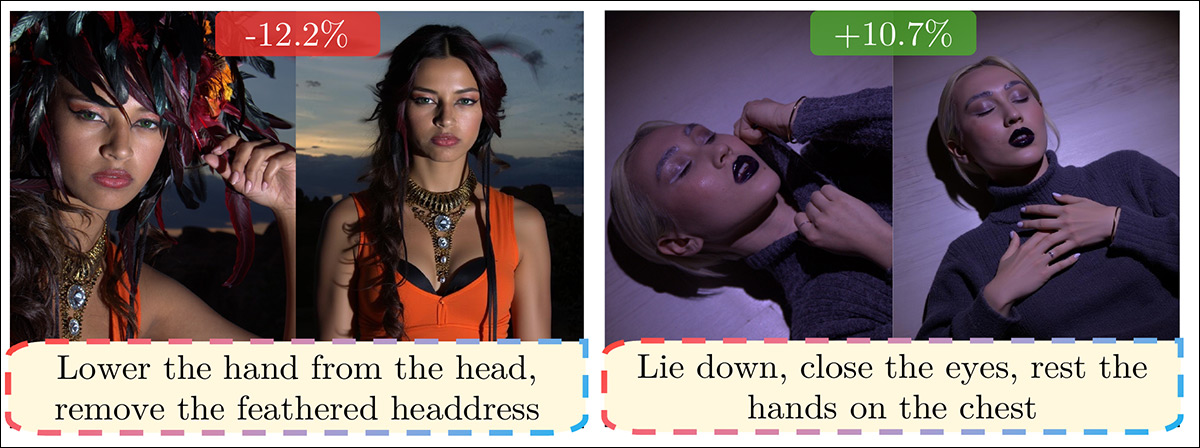

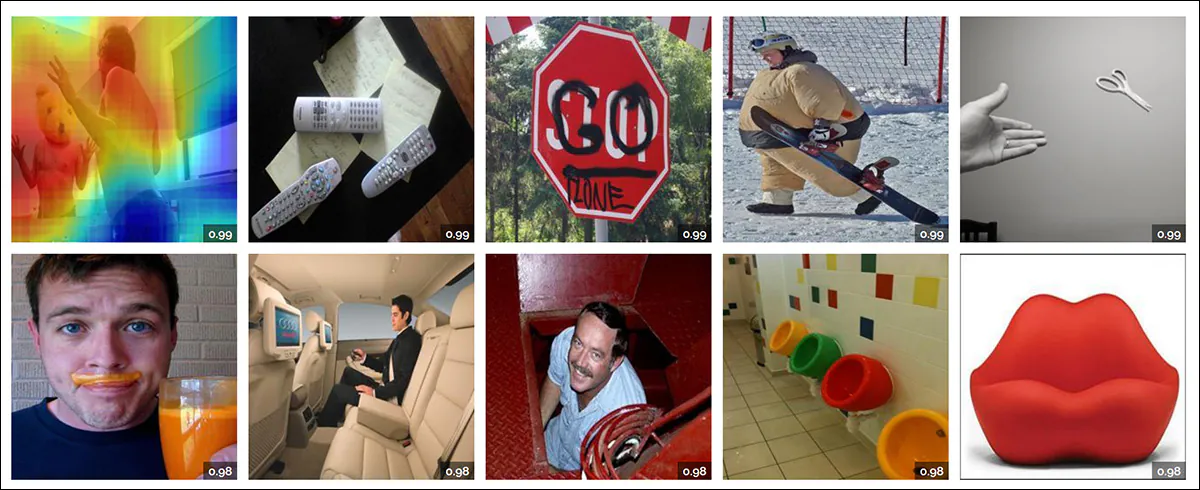

Από την εργασία Τι κάνει μια φωτογραφία αξιομνημόνευτη;, αντιπροσωπευτικά παραδείγματα καλών, μεσαίων και κακών φωτογραφιών, όσον αφορά την αξιομνημόνευση. Πηγή

Οποιος, όπως εγώ, με αρνητική ημερομηνία Unix, θα αναγνωρίσει πιθανώς το πρότυπο για “λιγότερο αξιομνημόνευτες εικόνες” (πάνω δεξιά στην εικόνα παραπάνω), από τις ατελείωτες βραδιές διαφανειών που καταράστηκαν την παιδική μας ηλικία. Όπως αναφέρουν οι συγγραφείς*:

‘Αυτές οι εργασίες ανίχνευσαν βασικούς εσωτερικούς παράγοντες, όπως η παρουσία ανθρώπων, εσωτερικές σκηνές, ή συναισθηματικές εκφράσεις, αντί για αντικείμενα και πανωραμικές απόψεις, καθώς και εξωτερικούς παράγοντες, συμπεριλαμβανομένων του контекστου και του παρατηρητή.’

Το έργο επικεντρώνεται στη “συστάσεις αξιομνημόνευσης” (MemFeed), η οποία εκφράζεται στην εφαρμογή MemCoach και ένα σημείο αναφοράς (με τίτλο MemBench) που βασίζεται στο PPR10K dataset.

Από την εργασία PPR10K: Ένα Μεγάλης Κλίμακας Σύνολο Δεδομένων για την Επεξεργασία Φωτογραφιών με Ανθρώπινη Μάσκα και Ομοιομορφία Ομάδας, ποικιλόμορφα δείγματα από το σύνολο δεδομένων. Η πρώτη σειρά δείχνει τις αρχικές εικόνες, η δεύτερη σειρά δείχνει τις επεξεργασμένες εκδόσεις μαζί με τις αντίστοιχες ανθρώπινες μάσκες. Οι αρχικές φωτογραφίες ποικίλλουν ευρέως σε γωνία θέασης, φόντο, φωτισμό και ρυθμίσεις κάμερας, ενώ τα αποτελέσματα επεξεργασίας εμφανίζουν βελτιωμένη οπτική ποιότητα και ισχυρότερη ομοιομορφία μέσα σε κάθε ομάδα. Πηγή

Η αξιομνημόνευση φαίνεται να είναι ποσοτική στις φωτογραφίες, αντί για ένα μητρώο υποκειμενικών κρίσεων, και οι συγγραφείς σημειώνουν ότι η ιδιότητα έχει αναγνωριστεί και για φωτογραφίες (σε διαφορετικές εργασίες) και βίντεο (σε διαφορετικές άλλες).

Η νέα εργασία έχει τίτλο Πώς να Πάρεις μια Αξιομνημόνευτη Φωτογραφία; Ενδυναμώνοντας τους Χρήστες με Ενεργές Συμβουλές, και προέρχεται από τέσσερις ερευνητές από το Πανεπιστήμιο του Τρέντο, το Πανεπιστήμιο της Πίζας και το Fondazione Bruno Kessler. Η συνδεδεμένη σελίδα του έργου υποδηλώνει ότι ο κώδικας GitHub και τα δεδομένα που φιλοξενούνται στο Hugging Face θα είναι διαθέσιμα τον επόμενο μήνα (Μάρτιο 2026).

Μέθοδος

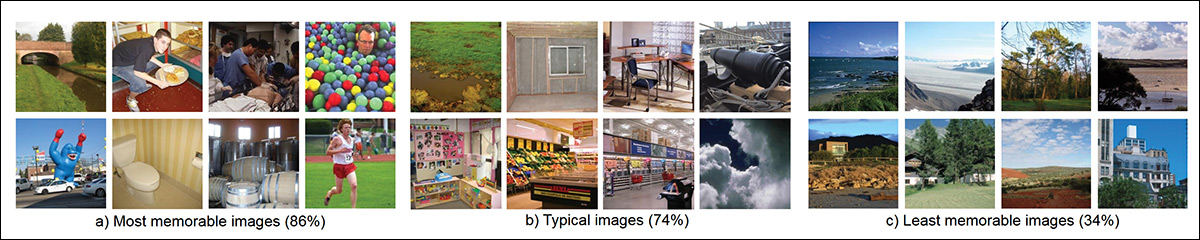

Για να δημιουργηθεί το σύνολο δεδομένων MemBench από το πηγή σύνολο δεδομένων PPR10K, οι ερευνητές ομαδοποίησαν φωτογραφίες από την ίδια σκηνή και αξιολόγησαν κάθε εικόνα για αξιομνημόνευση χρησιμοποιώντας einen εκπαιδευμένο προβλέπτη με βάση CLIP χαρακτηριστικά. Κατόπιν, κατέταξαν τις φωτογραφίες μέσα σε κάθε σκηνή από λιγότερο σε πιο αξιομνημόνευτο και τις ζευγάρωναν ανάλογα:

Επισκόπηση της κατασκευής και αξιολόγησης του MemBench. Η πρώτη σειρά δείχνει τη διαδικασία δεδομένων, από την ομαδοποίηση εικόνων ανά σκηνή και την πρόβλεψη αξιομνημόνευσης, μέχρι την κατάταξη φωτογραφιών και τη δημιουργία συμβουλών αξιομνημόνευσης. Η δεύτερη σειρά δείχνει την αξιολόγηση, μετρώντας την ποιότητα των συμβουλών μέσω κερδών αξιομνημόνευσης και βαθμολογίας perplexity.

Για κάθε ζευγάρι, δημιουργήθηκαν φυσικές περιγραφικές γλώσσες με το InternVL3.5 μοντέλο για να εξηγήσουν τις ορατές διαφορές μεταξύ της λιγότερο αξιομνημόνευτης έκδοσης και της πιο αξιομνημόνευτης έκδοσης. Αυτές οι περιγραφές θα αποτελούσαν το σήμα εκπαίδευσης για το σύστημα συμβουλών αξιομνημόνευσης.

Σε αντίθεση με το είδος λογικής που υποστηρίζει τον Προπονητή Κάμερας της Google, οι ερευνητές αναζήτησαν μια πιο λεπτή σειρά ερμηνειών†:

‘Αντίθετα με τις διορθώσεις της υπολογιστικής φωτογραφίας που επικεντρώνονται στις διορθώσεις μετά την λήψη (π.χ. “κάνε την εικόνα πιο φωτεινή”), επικεντρωθήκαμε στις σημασιολογικές ενέργειες που μπορεί να thựcέψει ένας χρήστης στην πτήση για μια καλύτερη λήψη, π.χ. “Κοίταξτε ο ένας τον άλλον”.’

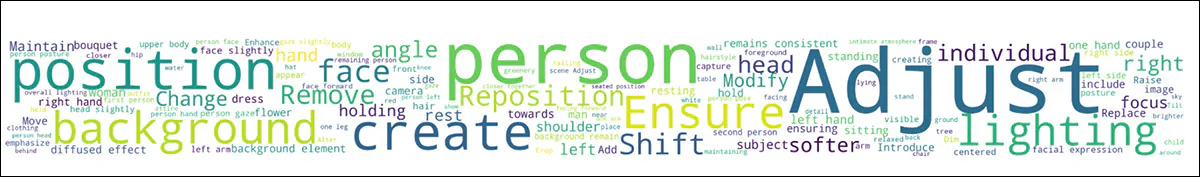

Το τελικό σύνολο MemBench αποτελείται από περίπου 10.000 εικόνες ομαδοποιημένες σε 1.570 σκηνές, με μέσο όρο 6,5 εικόνες ανά σκηνή. Η word-cloud που δημιούργησαν οι συγγραφείς (βλέπε εικόνα παρακάτω) υποδηλώνει ένα ευρύ φάσμα σημασιολογικών κατηγοριών στο σύνολο δεδομένων:

Μια word-cloud των πιο συχνών όρων στο MemBench.

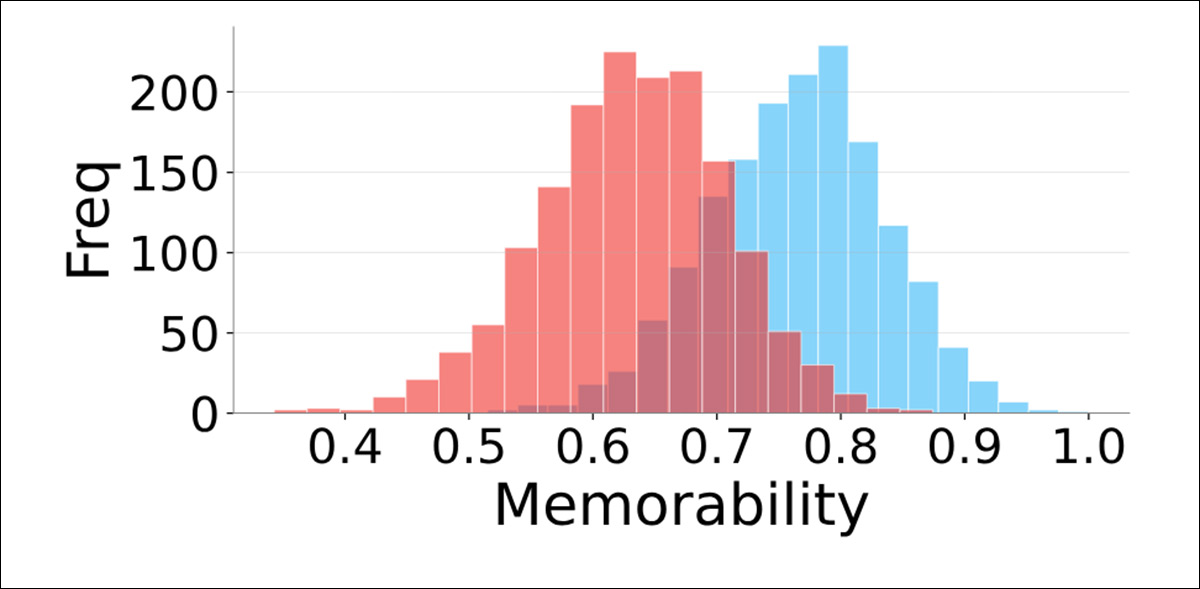

Οι πηγαίες φωτογραφίες είχαν μέσο όρο βαθμολογία αξιομνημόνευσης 0,63, ενώ οι πιο αξιομνημόνευτες λήψεις από την ίδια σκηνή κυμάνθηκαν από 0,51 μέχρι 1,0, με εμφανή επικάλυψη μεταξύ των δύο ομάδων:

Κατανομή βαθμολογιών αξιομνημόνευσης που συγκρίνουν τις λιγότερο και πιο αξιομνημόνευτες εικόνες μέσα σε κάθε σκηνή.

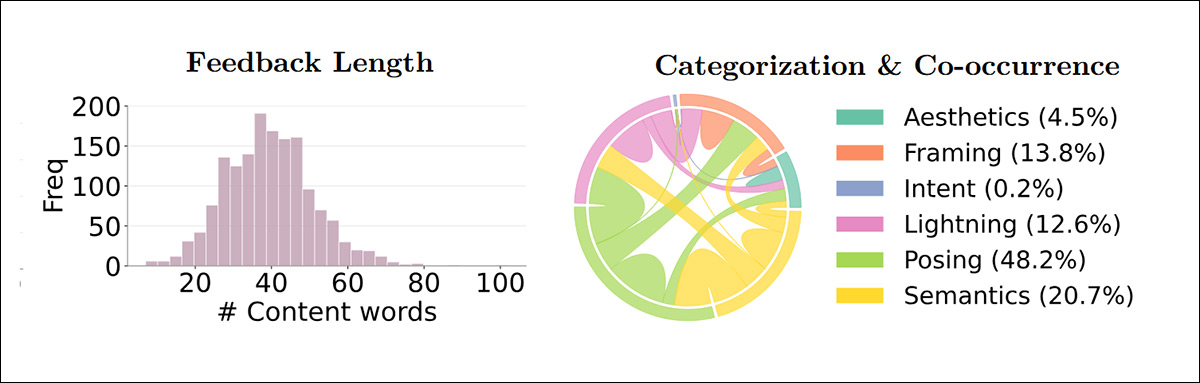

Οι συμβουλές κυμάνθηκαν από σύντομες σημειώσεις επτά λέξεων μέχρι αξιοσημείωτα μεγαλύτερες οδηγίες (αριστερά, στην εικόνα παρακάτω). Κάθε συμβουλή χωρίστηκε σε μικρά τύποι ενεργειών χρησιμοποιώντας GPT-5 Mini (δεξιά, στην εικόνα παρακάτω):

Κατανομή μήκους συμβουλών μετρημένη σε λέξεις περιεχομένου και κατηγοριοποίηση ατομικών υπο-ενεργειών με χορδές που δείχνουν συχνότητα συν-εμφάνισης μεταξύ κατηγοριών.

Οι συγγραφείς σημειώνουν ότι οι περισσότερες προτάσεις εστίαζαν στο πώς στάθηκε το θέμα, ακολουθούμενο από αλλαγές στη σημασία ή το περιεχόμενο της σκηνής, με την πλαισίωση να συνδέεται συχνά με τη στάση, και τις ρυθμίσεις φωτισμού να συνδέονται συχνά με σημασιολογικές αλλαγές.

Φλουξ Καπασίτορ

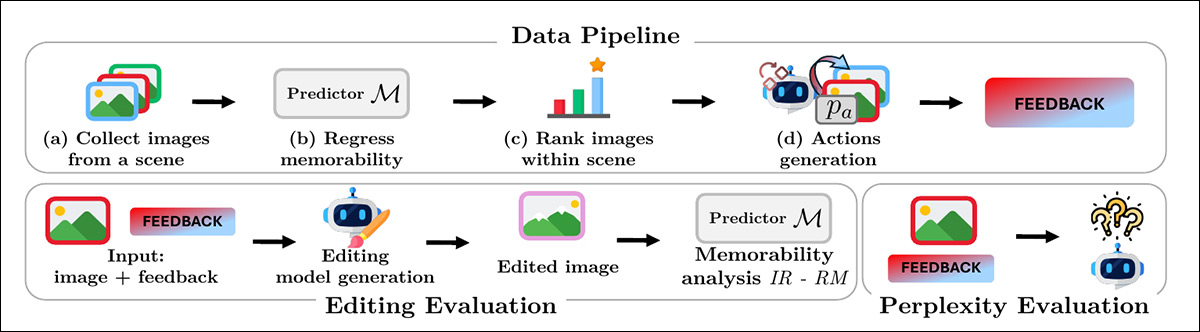

Για να αξιολογήσουν εάν η αξιομνημόνευση αυξήθηκε από τις συμβουλές, η συμμόρφωση του χρήστη προσομοιώθηκε μέσω της χρήσης του γενετικού μοντέλου FLUX.1 Kontext ως υποκατάστατο του φωτογράφου. Δίνεται μια πηγαία εικόνα και μια συμβουλή κειμένου, μια επεξεργασμένη έκδοση δημιουργήθηκε από το Flux που προσομοίωσε τις προτεινόμενες αλλαγές:

Οι εικόνες αριστερά είναι πραγματικές, από το σύνολο δεδομένων, και οι εικόνες δεξιά (σε κάθε περίπτωση) δημιουργήθηκαν από το Flux, με βάση την προτροπή (σε κίτρινο, κάτω). Με αυτόν τον τρόπο, η αποτελεσματικότητα των προτρόπων μπορούσε να αξιολογηθεί χωρίς εκτεταμένη ανθρώπινη συμμετοχή. Αυτή η γνώση θα επέστρεφε τελικά στο πλαίσιο MemCoach και στην πραγματικότητα αντιπροσωπεύει μια ροή εργασίας που θα μπορούσε να βελτιώσει επαναλαμβανόμενα ένα σύστημα αυτού του είδους (δηλ. τελικά με πραγματικά παράδειγματα αντί για παραδείγματα Flux).

Και οι αρχικές και οι επεξεργασμένες εικόνες περάστηκαν από einen προβλέπτη αξιομνημόνευσης, επιτρέποντας τη μέτρηση πόσο συχνά η επεξεργασμένη έκδοση πέτυχε υψηλότερη βαθμολογία – που ονομάζεται Επιτυχημένο Ποσοστό – και πόσο μεγάλο ήταν το κέρδος σε σχέση με την αρχική εικόνα, που ονομάζεται Σχετική Αξιομνημόνευση.

Η ομοιότητα με συμβουλές που επικεντρώνονται στην αξιομνημόνευση μετρήθηκε επίσης υπολογίζοντας perplexity έναντι των περιγραφών αναφοράς, και μια 80–20 διαίρεση εφαρμόστηκε στο επίπεδο σκηνής ώστε να διεξαχθεί δοκιμή μόνο σε σκηνές που δεν είχαν χρησιμοποιηθεί κατά την εκπαίδευση.

Κατάσταση Τέχνης

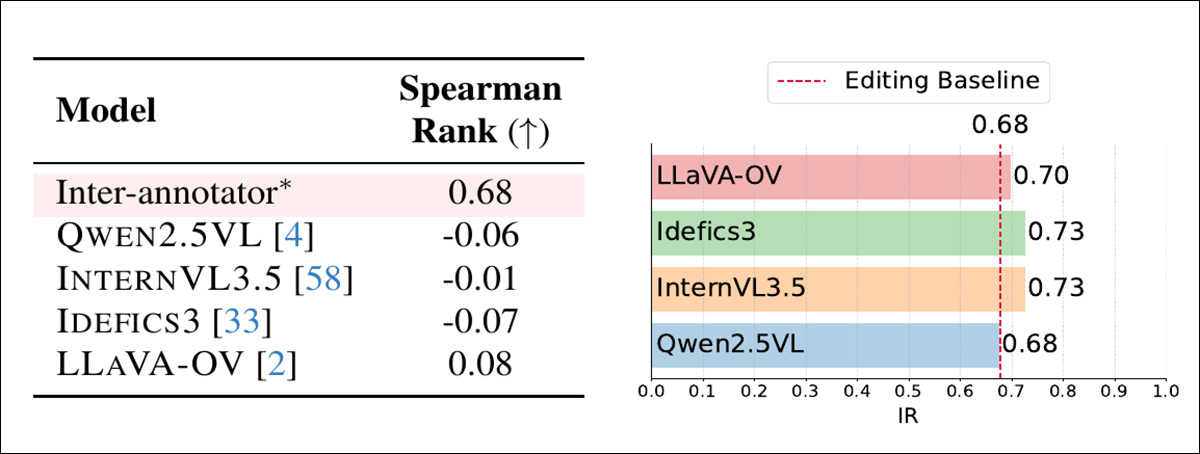

Η αξιομνημόνευση των τρέχοντων πολυμεσικών μεγάλων γλωσσικών μοντέλων ελέγχθηκε. Εικόνες από το LaMem σύνολο δεδομένων εμφανίστηκαν σε几个 από τα κορυφαία μοντέλα, τα οποία ρωτήθηκαν εάν η εικόνα ήταν αξιομνημόνευτη. Η εκτίμηση εμπιστοσύνης του μοντέλου συγκρίθηκε με τις βαθμολογίες που εκχωρήθηκαν από ανθρώπινους θεατές στην αρχική μελέτη:

Δοκιμές που δείχνουν ότι τα βασικά πολυμεσικά μοντέλα δεν καταλαβαίνουν την αξιομνημόνευση. Αριστερά, Συσχέτιση Σπírμαν μεταξύ προβλέψεων μοντέλου και βαθμολογιών LaMem, με συμφωνία αναθεωρητών από LaMem που εμφανίζεται για αναφορά. Δεξιά, επιτυχημένο ποσοστό που επιτεύχθηκε από τη συμβουλή zero-shot σε σχέση με την επεξεργασία βάσης, δείχνοντας μόνο маргινάλες κέρδη.

Σχεδόν καμία σημαντική συσχέτιση με ανθρώπινες κρίσεις δεν βρέθηκε, και παρά την εκτεταμένη προ-εκπαίδευση, οι συγγραφείς ισχυρίζονται ότι τα μοντέλα δεν ακολουθούν τι άνθρωποι θυμόμαστε συνεχώς.

Παραδείγματα από το LaMem σύνολο δεδομένων. Άνω-αριστερά, βλέπουμε επίσης μια θερμική χάρτα που απεικονίζεται για αυτήν την εικόνα. Πηγή

MemCoach

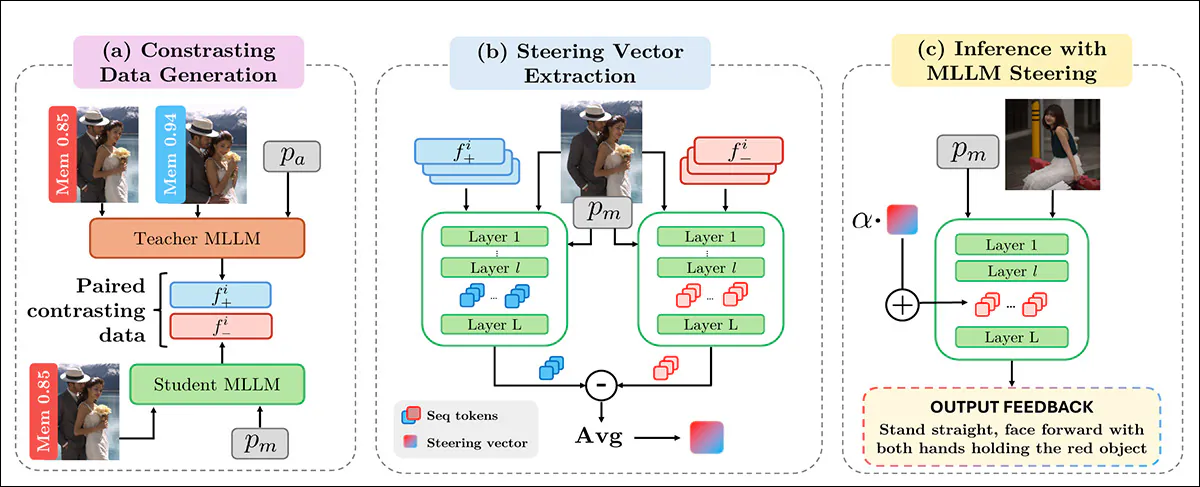

Ο MemCoach επικεντρώνεται σε σημασιολογικές, ενεργές οδηγίες που μπορούν να thựcέσουν πριν από την πίεση του κουμπιού λήψης – για παράδειγμα, điều chỉnh της στάσης, αλλαγή των αλληλεπιδράσεων μεταξύ θεμάτων ή τροποποίηση στοιχείων σκηνής. Οι συμβουλές που παρέχονται από τον MemCoach ποικίλλουν από 7-102 λέξεις περιεχομένου. Η αξιομνημόνευση, όπως υποστηρίζει η εργασία, φαίνεται να οδηγείται περισσότερο από τη διαμόρφωση του θέματος και τις αφηγηματικές ενδείξεις παρά από απλές συνθετικές ρυθμίσεις:

Επισκόπηση της διαδικασίας MemCoach, στην οποία η καθοδήγηση που είναι ευαισθητοποιημένη στην αξιομνημόνευση από ένα MLLM δασκάλου συνδυάζεται με ουδέτερες απαντήσεις μαθητή για να σχηματίσει αντίθετα δεδομένα. Οι διαφορές ενεργοποίησης μεταξύ των στρωμάτων μετράονται και η μέση τιμή χρησιμοποιείται για να εξαγάγει einen διευθυντή αξιομνημόνευσης. Αυτός ο διευθυντής ενjectεται στη διαδικασία inference για να μεταφέρει τις ενεργοποιήσεις του μαθητή προς την παραγωγή βελτιωμένων, προσανατολισμένων στην αξιομνημόνευση συμβουλών, χωρίς πρόσθετη εκπαίδευση.

Δοκιμές

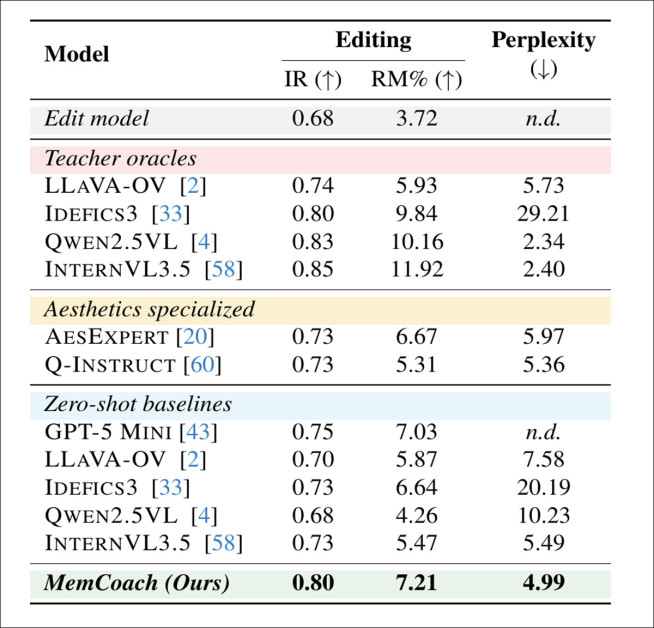

Επτά Πολυμεσικά Μεγάλα Γλωσσικά Μοντέλα (MLLMs) χρησιμοποιήθηκαν στη φάση δοκιμών για το νέο σύστημα: Qwen2.5V.L; InternVL3_5-8B; Idefics3-8B; και LLaVA-OneVision-1.5. Επιπλέον, το GPT-5 Mini συμπεριλήφθηκε ως αντιπρόσωπος των ιδιωτικών, κλειστών μοντέλων, μαζί με το αισθητικά εξειδικευμένο Q-Instruct και AesExpert μοντέλα. Τα MLLMs λειτουργούσαν ως zero-shot και δάσκαλοι ήacles.

Το InternVL3.5 χρησιμοποιήθηκε και για το δασκαλικό και το μαθητικό μοντέλο, με τη διαίρεση MemBench να χρησιμοποιείται για τη δημιουργία αντίθετων παραδειγμάτων:

Επίδραση MemCoach σε σύγκριση με τα MLLMs κατάσταση τέχνης σε δάσκαλους, αισθητικά εξειδικευμένα μοντέλα και zero-shot βάσεις, δείχνοντας υψηλότερο Επιτυχημένο Ποσοστό και ανταγωνιστική Σχετική Αξιομνημόνευση μαζί με την thấpτερη perplexity, υποδεικνύοντας πιο συνεπή και προσανατολισμένες στην αξιομνημόνευση συμβουλές.

Στον πίνακα για την πρώτη δοκιμή (παραπάνω), βλέπουμε ότι ο MemCoach φαίνεται να παρέχει πιο αποτελεσματικές συμβουλές αξιομνημόνευσης από οποιοδήποτε από τα μοντέλα σύγκρισης – και το μοντέλο InternVL3.5 με διεύθυνση MemCoach αυξάνει την αξιομνημόνευση πιο συχνά και με μεγαλύτερο ποσοστό, με ένα 5% κέρδος Επιτυχημένου Ποσοστού над το GPT-5 Mini και ένα 31,81% άλμα στη Σχετική Αξιομνημόνευση πάνω από την αδιαστραμμένη έκδοσή του.

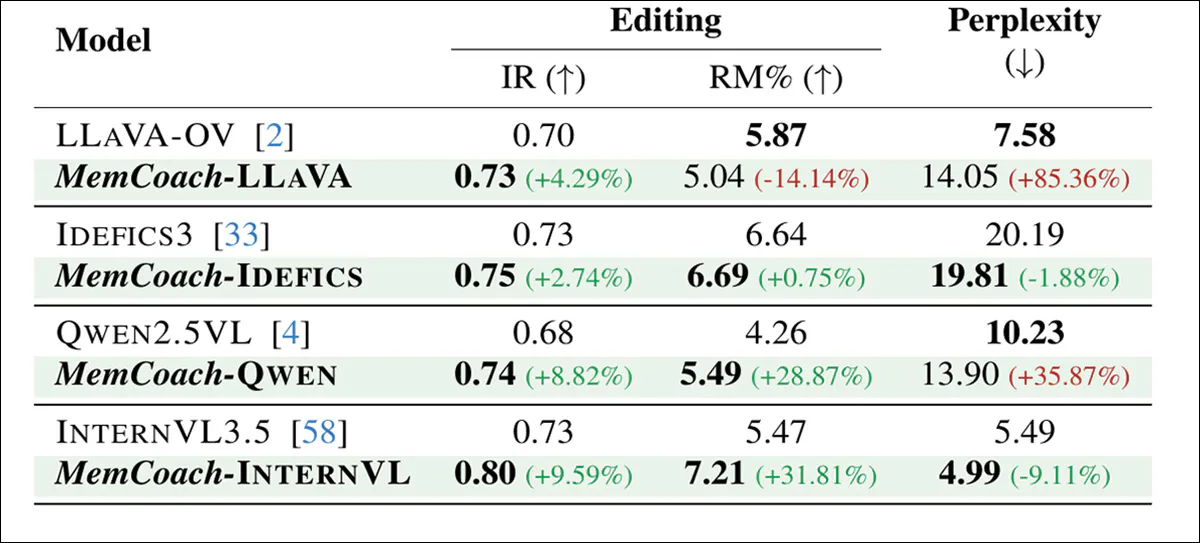

Επίσης, υπερέχει των αισθητικά επικεντρωμένων συστημάτων, χωρίς να απαιτεί πρόσθετη εκπαίδευση. Η χαμηλότερη perplexity, όπως υποστηρίζει η εργασία, υποδηλώνει επίσης ότι οι συμβουλές του ακολουθούν τις ίδιες γλωσσικές μοτίβους που ανταποκρίνεται η ανθρώπινη αξιομνημόνευση:

Αποτελέσματα γενίκευσης που δείχνουν ότι ο MemCoach βελτιώνει τις συμβουλές προσανατολισμένες στην αξιομνημόνευση σε πολλαπλά πολυμεσικά σκελετούς, αυξάνοντας συνεχώς το Επιτυχημένο Ποσοστό και τη Σχετική Αξιομνημόνευση ενώ μειώνει την perplexity για τα περισσότερα μοντέλα.

Μια ποιοτική αξιολόγηση διεξήχθη, αναλύοντας παραδείγματα συμβουλών MemCoach όπου η πηγαία εικόνα, η φυσική περιγραφή και το προτεινόμενο βελτιωμένο αποτέλεσμα εξετάστηκαν πλάι-πλάι:

Ποιοτικά παραδείγματα συμβουλών MemCoach. Κάθε τριπλέτα δείχνει την πηγαία εικόνα, τη φυσική περιγραφή και την επεξεργασμένη εικόνα, με τη Σχετική Αξιομνημόνευση (RM) που δείχνει την μετρημένη αλλαγή. Η καθοδήγηση κυμαίνεται από ρυθμίσεις στάσης και βλέμματος μέχρι σημασιολογικές παρεμβάσεις, όπως η αφαίρεση αντικειμένων, δείχνοντας τόσο επιτυχημένα κέρδη όσο και περιπτώσεις όπου η αφαίρεση ασυνήθιστων στοιχείων μειώνει την αξιομνημόνευση.

Από αυτά τα αποτελέσματα, οι συγγραφείς αναφέρουν:

‘Τα παραδείγματα υπογραμμίζουν τη ποικιλία των προτάσεων που προτείνει το μοντέλο, κυμαίνονται από λεπτομερείς συνθετικές ρυθμίσεις, όπως η αλλαγή της κατεύθυνσης του βλέμματος, της στάσης ή της θέσης του χεριού, μέχρι σημασιολογικές παρεμβάσεις που αφορούν την αφαίρεση αντικειμένων ή την αλλαγή της έκφρασης του προσώπου. ‘

‘Οι συμβουλές είναι φυσικά ερμηνεύσιμες και εκτελέσιμες, εκφραζόμενες σε συντομές κειμενικές οδηγίες (περιλαμβάνοντας κυρίως ρήματα “Φέρτε”, “Στάστε”, “Αφαιρέστε”) που μπορούν να εφαρμοστούν άμεσα, αποτελώντας ουσιαστικά την εκφώνηση του πώς να πάρεις μια αξιομνημόνευτη φωτογραφία.’

Συμπέρασμα

Θα ήταν πολύ ενδιαφέρον να συγκρίνουμε τη μεθοδολογία της κλειστής προσεγγίσης της Google με το έργο MemBench – όχι τουλάχιστον για να γνωρίζουμε ποια κεντρικά πρότυπα, αναφορές και βάσεις δεδομένων η Google χρησιμοποίησε για να ορίσει τα αισθητικά πρότυπα του συστήματος.

Η αρνητική πλευρά των συστημάτων αυτού του είδους, ανοιχτής ή κλειστής πηγής, είναι ότι σε μεγάλη κλίμακα κινδυνεύουν να επιβάλλουν ομοιόμορφα πρότυπα που προορίζονται να τελειώσουν ως memes και κλισέ – ένα είδος οπτικού ισοδύναμου των διαβουλεύσεων AI-ενハイ픈, όπου η “σωστή” διαδικασία έχει γίνει λιγάκι καταραμένη στη μηχανική χρήση.

* Η μετατροπή μου των εσωτερικών αναφορών των συγγραφέων σε υπερσύνδεσμους, εάν ο σύνδεσμος δεν παρουσιάζεται αλλού στο άρθρο.

† Η εργασία αναφέρεται εδώ, όπως και σε πολλά άλλα σημεία, σε “υποστηρικτικό υλικό” που δεν μπορώ να βρω, ούτε από την εργασία, ούτε από την κεντρική λίστα Arxiv, ούτε από την ιστοσελίδα του έργου.

Πρώτη δημοσίευση Πέμπτη, 26 Φεβρουαρίου 2026