Η γωνία του Anderson

Εισαγωγή των Εικόνων που Γεννιούνται από την Τεχνητή Νοημοσύνη στο Φως με HDR

Οι εικόνες και τα βίντεο της τεχνητής νοημοσύνης μπορεί να είναι εντυπωσιακά, αλλά δεν είναι στο επίπεδο των επαγγελματιών – ένα πρόβλημα που μια νέα έρευνα προσπαθεί να giải quyết.

Στην επαγγελματική κοινότητα ήχου και εικόνας, μια από τις πιο συχνές αντιρρήσεις για την είσοδο της τεχνητής νοημοσύνης είναι η τρέχουσα έλλειψη επαγγελματικών προτύπων αναπαραγωγής εικόνας και βίντεο. Δεν είναι το λιγότερο από αυτά η ικανότητα να εργαστεί με εικόνες και βίντεο υψηλής δυναμικής εμβέλειας (HDR).

Οι εικόνες HDR είναι ο σύγχρονος ισοδύναμος μιας φωτογραφικής πρακτικής του 19ου/20ου αιώνα που ονομάζεται μπρακέτα, όπου η ίδια εικόνα λαμβάνεται πολλές φορές με αυξανόμενη ποσότητα φωτός που επιτρέπεται να φτάσει στο φιλμ:

Πάνω, μια σύντομη ακολουθία μπρακέτας. Εισαγωγή παρακάτω, η υψηλή δυναμική εμβέλεια που μπορεί να εξαχθεί από αυτές τις φωτογραφίες σε μια seule εικόνα. Πηγή

Στην παραδοσιακή φωτογραφία, αυτό οδήγησε σε πολλές φωτογραφίες που μπορούσαν, με κάποια εμπειρία και προσπάθεια, να συνθέτουν μια seule εκτύπωση που ωφελείτο από όλα τα διαφορετικά επίπεδα λεπτομέρειας που ήταν διαθέσιμα σε όλη την εμβέλεια των εκθέσεων. Αλλά δεν ήταν ένα εύκολο ή琐λικό πρόceso.

Αυτές τις μέρες, μια ‘αυτόματη μπρακέτα’ ακολουθία εικόνων μπορεί να παράγει πολλές εικόνες ή να συνδυαστεί σε μια seule εικόνα HDR – αποτελεσματικά, μια πολλαπλότητα εκθέσεων σε μια εικόνα, η οποία οι εφαρμογές επεξεργασίας εικόνας που υποστηρίζουν HDR, όπως το Photoshop, μπορούν να επεξεργαστούν και να επιτρέψουν στον φωτογράφο να ορχηστρώσει σε μια seule, ιδανική εικόνα εξόδου.

Εάν σας αναρωτιέστε γιατί πρέπει να ενδιαφερθείτε, ή πώς αυτό το είδος πραγμάτων επηρεάζει τη δική σας φωτογραφία, η εικονογράφηση για αυτό το άρθρο έχει ως στόχο να το δείξει με έναν οικείο τρόπο:

Πάνω, αριστερά βλέπουμε ένα τυπικό παράδειγμα μιας sRGB (δηλαδή, μη-HDR) εικόνας. Απλώς η φωτεινότητα (που εμφανίζεται δεξιά) δεν δείχνει το τέρας στο ντουλάπι, γιατί αυτή η λεπτομέρεια απορρίφθηκε όταν ο φωτογράφος και οι αυτοματοποιημένες διαδικασίες της κάμερας αποφάσισαν τι να προτεραιοποιήσουν στην φωτογραφία:

Κάτω είναι μια ένδειξη (αριστερά) για το πώς θα ήταν “ξεθωριασμένο” το προσκήνιο θα έπρεπε να είναι στην ώρα της έκθεσης για να καταγράψει το τέρας στο ντουλάπι σε μια μη-HDR φωτογραφία, και (δεξιά) πώς το τέρας βυθίζεται στο σκότος όταν η έκθεση γίνεται κατάλληλη για τα φωτισμένα προσκήνια αντί:

Κάτω, βλέπουμε το είδος λεπτομέρειας που μπορεί να “σώσει” από μια εικόνα HDR ή ακολουθία εικόνων. Σε αυτή την περίπτωση, το τέρας “κρυβόταν” στις πολύ χαμηλές οπτικές καταχωρήσεις της ακολουθίας HDR, σε ένα επίπεδο όπου το υπόλοιπο περιεχόμενο θα ήταν “μπλεγμένο” σε近-λευκό (πάνω, αριστερά). Βάζοντας ότι μια ευρεία εμβέλεια επιπέδων φωτεινότητας θα πρέπει να εκφραστεί, επιλεκτικά, στην ίδια εικόνα, αυτά τα ασύμβατα στοιχεία μπορούν να συνθέτουν σε μια rationale εικόνα:

Μια μη-HDR εικόνα ονομάζεται εικόνα αναφοράς εμφάνισης, και μια εικόνα HDR υψηλού χρωματικού εύρους ονομάζεται εικόνα αναφοράς σκηνής.

Το βίντεο HDR είναι επίσης ένα πράγμα, και αυτό το είδος τονικής ευελιξίας και δυσκολίας δίνει στους κινηματογραφιστές κάποια ελευθερία να σώσουν, να βαθμονομήσουν και να ερμηνεύσουν τα кадράκια με πολλούς δημιουργικούς και συνεπείς τρόπους. Δεν είναι έκπληξη, λοιπόν, ότι οι δημιουργοί είναι διστακτικοί να εργαστούν με την “πιατισμένη” έξοδο sRGB που είναι τυπική για τα περισσότερα γεννητικά πλαίσια AI.

HDR στην Τεχνητή Νοημοσύνη

Φυσικά, η ερευνητική σκηνή ενδιαφέρεται για την εισαγωγή των πλαισίων που γεννιούνται από την τεχνητή νοημοσύνη στην εποχή HDR. Ωστόσο, δεν είναι μια εύκολη εργασία, τόσο λόγω της θεμελιώδους αρχιτεκτονικής των συστημάτων γεννήτριας διάχυσης, όσο και λόγω του ότι τα καλά δεδομένα HDR καταλαμβάνουν πολύ δισκοχώρο, καθιστώντας τα σύνολα ακατάλληλα. Συνεπώς, τα σύνολα δεδομένων που είναι κατάλληλα για την εργασία είναι σπάνια.

Παρά ταύτα, μια συνεργασία μεταξύ eines πανεπιστημίου στη Σιγκαπούρη και της Adobe Research προσφέρει μια μέθοδο για την παραγωγή ακολουθιών εικόνων HDR, σε μια μεθοδολογία που μπορεί θεωρητικά να εφαρμοστεί σε βίντεο καθώς και σε στατικές εικόνες:

Από την ιστοσελίδα του έργου για το νέο έργο, παραδείγματα ‘μπρακέτας’ text-to-image εξόδου. Πηγή

Το νέο σύστημα γεννά πολλές συγχρονισμένες εκδόσεις της ίδιας εικόνας σε διαφορετικά επίπεδα φωτεινότητας και μαθαίνει πόσο φωτεινό ήταν πραγματικά το σκηνικό, και στη συνέχεια συνδυάζει αυτές τις σε μια seule αποτέλεσμα που διατηρεί λεπτομέρειες και στις σκιές και στις υψηλές περιοχές, επιτρέποντας μεταγενέστερες επεξεργασίες της έκθεσης ή του χρώματος να συμπεριφέρονται περισσότερο σαν ρυθμίσεις σε μια πραγματική κάμερα, παρά σαν εύθραυστες ρυθμίσεις σε μια πλήρως επεξεργασμένη εικόνα.

Το σύστημα αξιοποιεί μια ποικιλία διαφορετικών μοντέλων για την εργασία, συμπεριλαμβανομένων παραλλαγών του Qwen και Flux:

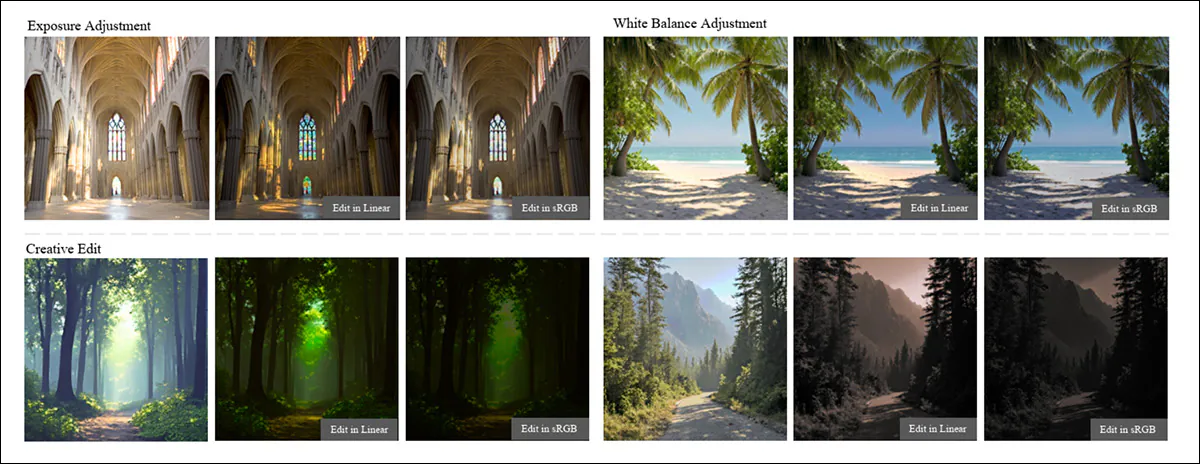

Παραδείγματα από το νέο έγγραφο, δείχνοντας πώς το σύστημα μπορεί να γεννήσει πολλές εκδόσεις έκθεσης της ίδιας σκηνής ενώ διατηρεί την υποκείμενη δομή σταθερή. Ξεκινώντας από ένα απλό χάρτη ακμής, το μοντέλο παράγει συνεπείς εικόνες σε πολύ σκούρες έως πολύ φωτεινές ρυθμίσεις, είτε η πρόκληση περιγράφει σελήνη, ηλιοφάνεια, ηλιοβασίλεμα, ή ακόμη και ένα μικρό αντικείμενο όπως ένα μπαλόνι, με το θέμα και τη σύνθεση να παραμένουν σταθερά ενώ μόνο η φωτεινότητα αλλάζει. Η μέθοδος μπορεί να μεταβάλλει τη φωτεινότητα με έναν ελεγχόμενο, camera-όμοιο τρόπο, αντί να παραμερίζει ή να εφευρίσκει νέο περιεχόμενο καθώς η έκθεση αλλάζει. Πηγή

Οι συγγραφείς δηλώνουν:

‘Η γεννήτρια γραμμικών εικόνων είναι μια πρόκληση, поскольку τα προ-εκπαιδευμένα VAEs στα μοντέλα διάχυσης αγωνίζονται να διατηρήσουν ταυτόχρονα τα ακραία υψηλά και σκιές λόγω του υψηλότερου δυναμικού εύρους και bit depth.’

‘Για αυτό, αντιπροσωπεύουμε μια γραμμική εικόνα ως μια ακολουθία μπρακέτας έκθεσης, κάθε μια από τις οποίες καταλαμβάνει ένα συγκεκριμένο τμήμα του δυναμικού εύρους, και προτείνουμε μια DiT-βασισμένη αρχιτεκτονική ροής-συνδυασμού για την γεννήτρια μπρακέτας έκθεσης με κείμενο.’

‘Επιπλέον, αποδεικνύουμε εφαρμογές κατάντη, συμπεριλαμβανομένης της κειμενο-οδηγούμενης γραμμικής επεξεργασίας εικόνας και της δομής-συνδεμένης γεννήτριας μέσω ControlNet.’

Το νέο έργο ονομάζεται Γραμμική Γεννήτρια Εικόνας με τη Συνθέτηση Μπρακέτας Έκθεσης, και προέρχεται από τέσσερις συγγραφείς σε όλη τη Σιγκαπούρη στο Nanyang Technological University, Adobe NextCam, και Adobe Research. Εκτός από την προαναφερθείσα ιστοσελίδα του έργου και το βίντεο στο YouTube που συνοδεύει την κυκλοφορία, υπάρχει επίσης ένα (προς το παρόν σπάνιο) GitHub repo, και η υπόσχεση μιας κυκλοφορίας συνόλου δεδομένων.

Αν και οι συγγραφείς παρέχουν πολλά παραδείγματα εξόδου από το σύστημα στην ιστοσελίδα του έργου, οι θεατές θα χρειαστούν μια οθόνη HDR για να διακρίνουν πραγματικά τις ιδιότητες της εξόδου HDR που παρουσιάζεται. Παρόλα αυτά, παρακαλούμε να βρείτε την επισκόπηση των ερευνητών στο YouTube στο τέλος του άρθρου – αλλά να είσαστε ενήμεροι ότι οι διαφορές μεταξύ των παραδειγμάτων που εμφανίζονται μπορεί να μην είναι σαφείς σε μια μη-HDR οθόνη.

Μέθοδος και Δεδομένα

Οι συγγραφείς τονίζουν το βαθμό στον οποίο η συλλογή δεδομένων είναι μια πρόκληση σε αυτήν την εργασία:

‘Η απόκτηση ενός μεγάλου αριθμού γραμμικών εικόνων είναι εξαιρετικά δύσκολο στην πράξη. Επιπλέον, τα περισσότερα δημόσια σύνολα δεδομένων HDR είναι είτε πανοραμικά (και επομένως εστιάζουν σχεδόν αποκλειστικά στο περιεχόμενο μεγάλης κλίμακας) ή δεν παρέχουν πραγματικές γραμμικές εικόνες, καθιστώντας τα ακατάλληλα για τους σκοπούς μας.’

‘Επομένως, χρησιμοποιούμε κυρίως σύνολα δεδομένων εικόνων RAW ως βάση για την εκπαίδευση.’

Οι ερευνητές έκαναν δημιουργική χρήση των λίγων επιλογών που είχαν, αξιοποιώντας το σύνολο δεδομένων RAISE ως πραγματικά δεδομένα εκπαίδευσης, και το σύνολο δεδομένων MIT-Adobe FiveK ως δεδομένα αξιολόγησης*.

Για να δημιουργηθούν χρήσιμα δεδομένα εκπαίδευσης HDR, οι ερευνητές έτρεξαν τα αρχεία κάμερας RAW μέσω μιας τυποποιημένης πipeline για να αφαιρέσουν τις ιδιομορφίες της κάμερας, μετατρέποντας τις εικόνες σε μια συνεπή, scene-αναφορική γραμμική μορφή:

Σχήμα για την εργογραφία των συγγραφέων: το σύστημα ξεκινά από θόρυβο που αντιπροσωπεύει τέσσερις εκθέσεις του ίδιου σκηνικού, μαζί με μια πρόκληση κειμένου και einen token φωτεινότητας. Αυτό επεξεργάζεται μέσω στοιβάζοντων transformer μπλοκ που διατηρούν τις διαφορετικές εκθέσεις συγχρονισμένες, ενώ προσαρμόζουν για φωτεινότητα. Το σύστημα προβλέπει τόσο το σύνολο των εικόνων έκθεσης, μαζί με μια γενική κλίμακα φωτεινότητας, και στη συνέχεια αποκωδικοποιεί και συνδυάζει αυτές σε μια seule scene-αναφορική εικόνα, διατηρώντας λεπτομέρειες και στις σκιές και στις υψηλές περιοχές.

Αυτό περιελάμβανε την ανακατασκευή πλήρους RGB από δεδομένα αισθητήρα, εφαρμογή διόρθωσης χρώματος, κανονικοποίηση λευκού ισορροπίας, και μια σύντομη μετακίνηση σε χρωματικό χώρο αντίληψης για αποθορυβοποίηση πριν επιστρέψει σε μια καθαρή γραμμική σήμα. Το πραγματικό φως στη σκηνή ανακτούσε χρησιμοποιώντας τις ρυθμίσεις έκθεσης της κάμερας, ώστε κάθε pixel να αντικατοπτρίζει πραγματική φωτεινότητα αντί για μια έτοιμη για εμφάνιση προσέγγιση.

Επειδή τέτοιες τιμές μπορούν να ποικίλλουν ευρέως, τα δεδομένα στη συνέχεια σταθεροποιήθηκαν με την κλιμάκωση κάθε εικόνας με βάση τη δική της κατανομή φωτεινότητας, χρησιμοποιώντας στατιστικά στοιχεία μεσαίας και υψηλής για να αποφευχθούν και οι ξεθωριασμένες εικόνες και οι υψηλές περιοχές, και τελικά να αποκτήσουν μια κανονικοποιημένη γραμμική εικόνα που διατηρούσε το πραγματικό εύρος φωτός στη σκηνή, ενώ παρέμεινε σταθερή enough για την εκπαίδευση.

Ετικέτες κειμένου για τις εικόνες δημιουργήθηκαν με το Qwen2.5-VL 7B μοντέλο, με προκλήσεις που κατασκευάστηκαν για να ταιριάζουν με τα χαρακτηριστικά του μοντέλου Flux που θα χρησιμοποιηθεί κατά την γεννήτρια.

Κάθε εικόνα χωρίστηκε σε μπρακέτες έκθεσης και πέρασε από einen κοινό VAE encoder, μετατρέποντας όλες τις εκθέσεις σε einen κοινό latent χώρο που σχεδιάστηκε για να καταλάβει το πλήρες εύρος φωτεινότητας. Τα latents στη συνέχεια βελτιώθηκαν από θόρυβο, και αποκωδικοποιήθηκαν πίσω σε εικόνες, επιτρέποντας συνεπή ανακατασκευή σε σκούρες και φωτεινές περιοχές, χωρίς να τις συρρικνώσει σε μια seule, “πιατισμένη” έκθεση.

LoRA fine-tuning χρησιμοποιήθηκε για να προσαρμόσει το προ-εκπαιδευμένο Flux backbone σε γραμμικά δεδομένα εικόνας με ελάχιστα额πλέον παραμέτρους, βοηθώντας το μοντέλο Single-Diffusion Transformers (single-DiT) να παραμείνει σταθερό, ακόμη και καθώς η φωτεινότητα ποικίλλει σε όλη την έκθεση.

Επιπλέον, εισήχθη η Προσοχή Αυτο-Εξομοίωσης Μόδου Έκθεσης (κεντρική στήλη στο σχήμα παραπάνω) για να επεξεργαστεί gemeinsam όλες τις μπρακέτες, επιτρέποντας τη φωτεινότητα να ρυθμιστεί ανά έκθεση ενώ διατηρούνταν η δομή και οι λεπτομέρειες συγχρονισμένες.

3D Rotary Positional Embedding (3D-R[o]PE) χρησιμοποιήθηκε για να κωδικοποιήσει τόσο τη χωρική θέση όσο και την ταυτότητα έκθεσης, ώστε το μοντέλο να μπορέσει να διακρίνει σε ποια μπρακέτα ανήκει κάθε token, ενώ διατηρούσε τη χωρική συνεπή, επιτρέποντας καθαρή διάκριση της μεταβολής φωτεινότητας από το περιεχόμενο της σκηνής.

Μια επισκόπηση του συνόλου δεδομένων που χρησιμοποιήθηκε στη μελέτη, δείχνοντας πώς οι εικόνες κατανέμονται σε τύπους περιεχομένου και εσωτερικού και εξωτερικού σκηνικού, μαζί με την κατανομή των τιμών φωτεινότητας στα επεξεργασμένα δεδομένα. Τα istogramma.plot luminance και την κλίμακα radiance στο log χώρο, δείχνοντας πώς ευρέως μπορεί να ποικίλλει η πραγματική φωτεινότητα, με υψηλότερες τιμές radiance να αντιστοιχούν σε φυσικά φωτεινότερες σκηνές και υπογραμμίζοντας τη δυναμική εμβέλεια που το μοντέλο εκπαιδεύτηκε να χειριστεί.

3D-RoPE χωρίστηκε πού ήταν ένα χαρακτηριστικό και ‘ποια έκθεση προέρχεται’ σε ξεχωριστά σήματα, ώστε η μεταβολή φωτεινότητας να μπορεί να điều chỉnhεται ανεξάρτητα, χωρίς να διαταράσσει τις χωρικές λεπτομέρειες.

Δοκιμές

Οι ερευνητές χρησιμοποίησαν Flux-dev ως το γεννητικό πλαίσιο, με την εκπαίδευση να λαμβάνει χώρα σε τέσσερις NVIDIA A100 GPUs, κάθε μια με 80GB VRAM. Το μέγεθος batch ορίστηκε στο 4 (ανά GPU), σε 10.000 επαναλήψεις.

LoRA fine-tuning χρησιμοποιήθηκε με einen rank του 64. Ο AdamW βελτιστοποιητής χρησιμοποιήθηκε με einen ρυθμό μάθησης του 2×102 (για τον άξονα έκθεσης).

Οι συγγραφείς σημειώνουν ότι ενώ υπάρχουν δύο προηγούμενες εργασίες που είναι παρόμοιες σε εύρος, καμία από αυτές δεν ήταν ένας φανερός υποψήφιος για μια φάση δοκιμών. Η Max Planck-ηγετική έξοδος του 2022 GlowGAN είναι περιορισμένη στην παραγωγή συγκεκριμένων κατηγοριών εικόνων, ενώ η Bracket Diffusion (ξανά, ηγετική από το Max Planck Institute) μπορεί να παράγει μόνο μια εικόνα HDR σε 256x256px, και χρειάζεται αρκετά λεπτά για να το κάνει.

Από το αρχικό έγγραφο GlowGAN, τυπικές εικόνες χαμηλής δυναμικής εμβέλειας (LDR) χάνουν λεπτομέρειες σε σκιές και υψηλές περιοχές, ενώ το μοντέλο μαθαίνει να παράγει εικόνες υψηλής δυναμικής εμβέλειας (HDR) που διατηρούν λεπτομέρειες σε όλα τα επίπεδα φωτεινότητας και επιτρέπουν την ανάκτηση των κορεσμένων περιοχών μέσω αντίστροφης χαρτογράφησης τόνου. Πηγή

Επομένως, στην απουσία άμεσων βάσεων για τη γεννήτρια γραμμικών εικόνων, οι συγγραφείς σύγκριναν τη μέθοδό τους με προσαρμοσμένες εκδόσεις ισχυρών υφιστάμενων μοντέλων, αντί για ειδικά κατασκευασμένα εναλλακτικά.

Μια σειρά πειραμάτων (‘T2I Fine-Tuning’) προσάρμοσε το μοντέλο Flux με LoRA, εκπαιδεύοντας το να παράγει γραμμικές εικόνες απευθείας, και αξιολογώντας πώς ένα state-of-the-art T2I μοντέλο προσαρμόστηκε σε αυτό το domaine.

Μια δεύτερη σύγκριση (‘T2V fine-tuning’) χρησιμοποίησε το μοντέλο κειμένου-προς-βίντεο Wan 2.1, του οποίου το VAE συμπιέζει πολλαπλά кадράκια σε μια κοινή.latent αναπαράσταση, και στη συνέχεια αποκωδικοποιεί πίσω, δοκιμάζοντας αν μια πipeline βίντεο θα μπορούσε να μοντελοποιήσει την μεταβολή έκθεσης.

Η τρίτη σειρά πειραμάτων (‘T2I Model Inflation’) σύγκρινε με CameraCtrl και Generative Photography, τα οποία και τα δύο επεκτείνουν τα μοντέλα διάχυσης εικόνας μέσω temporal μονάδων, για να παράγουν multi-πλαίσιο εξόδου. Αυτά επίσης προσαρμόστηκαν στην ίδια δεδομένα, για μια συνεπή σύγκριση.

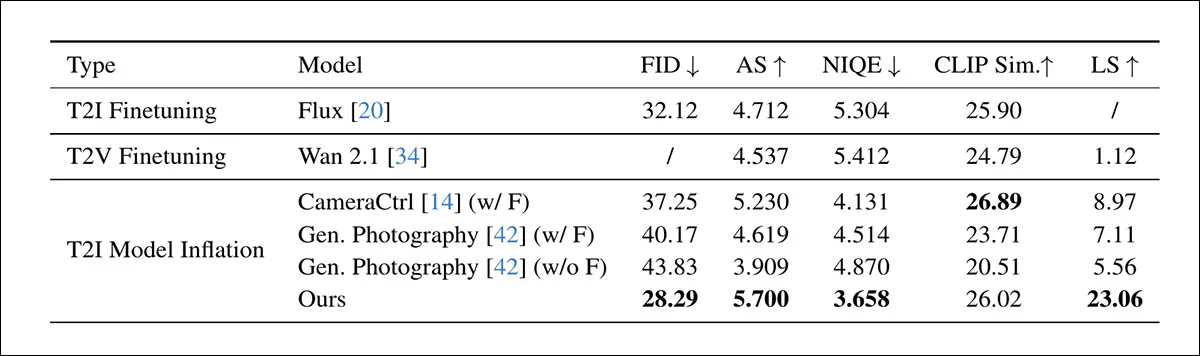

Οι μετρήσεις που χρησιμοποιήθηκαν ήταν Fréchet Inception Distance (FID); Αισθητική Βαθμολογία (AS); Naturalness Image Quality Evaluator (NIQUE); CLIP Sim score; και Ομοιότητα Φωτεινότητας (LS):

Μια σύγκριση της μεθόδου των συγγραφέων με διάφορες προσαρμοσμένες βάσεις για τη γεννήτρια γραμμικών, scene-αναφορικών εικόνων. Μοντέλα κειμένου-προς-εικόνα (Flux) και κειμένου-προς-βίντεο (Wan 2.1) προσαρμόστηκαν με LoRA για να δοκιμαστεί πώς τα υπάρχοντα γεννητικά συστήματα χειρίζονται αυτή τη ρύθμιση, ενώ CameraCtrl και Generative Photography επεκτείνουν τα μοντέλα διάχυσης με χρονικές μονάδες. Κάποια σκορ είναι λείπουν, γιατί κάποια μοντέλα δεν μπορούν να παράγουν συνεπώς μπρακέτες έκθεσης, οι οποίες απαιτούνται για την ανάκτηση του πλήρους δυναμικού εύρους. Σε όλες τις μετρημένες μετρήσεις, η νέα μέθοδος επιτυγχάνει τα ισχυρότερα συνολικά αποτελέσματα, ιδιαίτερα σε μετρήσεις που συνδέονται με την ποιότητα εικόνας και την ακριβή ανακατασκευή φωτεινότητας.

Σχετικά με αυτά τα αποτελέσματα, οι συγγραφείς δηλώνουν:

‘Λόγω της ευρείας κατανομής γραμμικών εικόνων, η άμεση προσαρμογή του T2I Μοντέλου σε γραμμικά δεδομένα κάνει δύσκολο να ισορροπήσει τις λεπτομέρειες σκιών και υψηλών περιοχών. Τα μοντέλα T2I Inflation υποφέρουν και από περιορισμένο δυναμικό εύρος και σημαντική υποβάθμιση ποιότητας εικόνας ακόμη και μετά την προσαρμογή.’

‘Για την T2V Προσαρμογή, η 4× χρονική υποδειγματοποίηση του Wan 2.1 ενσωματώνει τις 4 μπρακέτες έκθεσης σε μια seule.latent αναπαράσταση, προκαλώντας μια σοβαρή διαταραχή κατανομής που δεν μπορεί να επιλυθεί μόνο μέσω της προσαρμογής.’

‘Με την άμεση μοντελοποίηση scene-αναφορικών ιδιοτήτων χρησιμοποιώντας μπρακέτες έκθεσης, η μέθοδός μας επιτυγχάνει υπεροχή οπτική ποιότητα και δυναμική εμβέλεια σε όλες τις βάσεις.’

Μια σύγκριση με LoRA-προσαρμοσμένο Flux και Wan 2.1, δείχνοντας πώς κάθε μέθοδος χειρίζεται αλλαγές έκθεσης σε όλη την ίδια σκηνή. Οι ανταγωνιστικές προσεγγίσεις τείνουν να χάνουν λεπτομέρειες σε πολύ σκούρες ή πολύ φωτεινές περιοχές, ενώ η προτεινόμενη μέθοδος διατηρεί συνεπή δομή και ανακτά χρήσιμες λεπτομέρειες σε όλο το εύρος των εκθέσεων. Παρακαλούμε αναφερθείτε στην πηγή του εγγράφου και την ιστοσελίδα του έργου για καλύτερα παραδείγματα αποτελεσμάτων.

Παρακαλούμε αναφερθείτε στην επέκταση των πειραμάτων και του τμήματος συμπληρωματικών υλικών του εγγράφου για περαιτέρω δοκιμές.

Συμπέρασμα

Για τους επαγγελματίες των μέσων, όπως αυτοί που εργάζονται στην παραγωγή ταινιών και τηλεόρασης, η ίδια έξοδος που έχει κατακτήσει τη φαντασία (και, όλο και περισσότερο, τη δυσαρέσκεια) του κόσμου, τους έχει αφήσει αδιάφορους,既然 όλα σχεδόν από τα pipeline τους εξαρτώνται σε κάποιο βαθμό από τις λήψεις HDR.

Επομένως, αυτό είναι ένα своєчасτο έργο, που αντιπροσωπεύει μια εγκατάσταση που θα ήταν εύλογο να γίνει ένα προαιρετικό πρότυπο σε όλα τα νέα πλαίσια – αν και είναι βέβαιο ότι θα τουλάχιστον διπλασιάσει τους χρόνους απόδοσης. Φυσικά, επίσης, η καθυστέρηση θα πρέπει να αντιμετωπιστεί σοβαρά, εάν το περιεχόμενο HDR AI δεν θα πρέπει να περιοριστεί στην “μετά-παραγωγή” αντί για την “εν-κάμερα” κατηγορία.

* Συνήθως θα δείξαμε παραδείγματα, αλλά既然 ο αναγνώστης μπορεί να μην έχει μια οθόνη HDR, παραλείψαμε αυτά σε αυτήν την περίπτωση.

Πρώτη δημοσίευση Κυριακή, 26 Απριλίου 2026