Η γωνία του Anderson

Αντιμετώπιση του Προβλήματος Gaslighting του AI

Τα μοντέλα βίντεο AI μπορούν να πειστούν να απομακρυνθούν από την αλήθεια. Ακόμη και μετά τη διορατικότητα της σωστής απάντησης, υποκλίνονται σε自信 χρήστες, ξαναγράφουν την πραγματικότητα και εφευρίσκουν ψευδείς εξηγήσεις για να την δικαιολογήσουν.

Το AI είναι λανθασμένο αρκετά συχνά, ώστε να μας αναγκάζει να αμφισβητούμε τα συμπεράσματά του, εάν νιώθουμε ότι αυτά τα συμπεράσματα μπορεί να είναι λανθασμένα.

Το πρόβλημα είναι, εάν γνωρίζαμε διαφορετικά από την αρχή, γιατί ρωτήσαμε στην πρώτη θέση; Για επιβεβαίωση σχετικά με μια μερικώς κατεχούμενη πίστη ή υπόνοια;

Εάν ναι, η τρέχουσα κατάσταση της τέχνης στα Μεγάλα Γλωσσικά Μοντέλα (LLMs) και τα Μοντέλα Όρασης Γλώσσας (VLMs, τα οποία λειτουργούν πολυτροπικά, αποδεχόμενα και παράγοντας εικόνες και/ή βίντεο) δεν είναι καλά προσαρμοσμένα για να διατηρήσουν την ευστάθεια, λόγω του προβλήματος της συκοφαντίας.

Έτσι, εάν δεν μας αρέσει η απάντηση που λαμβάνουμε και αρχίζουμε να εμπλακούμε σε διαμάχη γι’ αυτό με το μοντέλο, το AI είναι πιθανό να παραμεριστεί λανθασμένα (υποθέτοντας ότι ήταν λάθος) αντί να επανεξεταστεί, ή αλλιώς να αφήσει τον εαυτό του να συκοφαντεί για να υποστηρίξει τις προτάσεις μας – ακόμη και εάν εμείς είμαστε λάθος.

Είσαι Απόλυτα Σωστός!

Η πρακτική ενός ανθρώπου που πείθει το AI να αλλάξει γνώμη μέσω σύγκρουσης έχει ονομαστεί ‘Επίθεση Συκοφαντίας Αρίθμησης’ και μερικές φορές χαρακτηρίζεται ως ζήτημα ασφαλείας – όχι τουλάχιστον επειδή έχει μερική δυνατότητα να ‘απεγκλωβίσει’ ένα μοντέλο από τις λειτουργικές του περιορισμούς:

Από το έγγραφο του 2025 ‘Benchmarking Gaslighting Negation Attacks Against Multimodal Large Language Models”, το GPT-5 απαντάει αρχικά σωστά αλλά στη συνέχεια υποκλίνεται στην πίεση του χρήστη, αναστρέφοντας την απάντησή του και εφευρίσκοντας ψευδείς εξηγήσεις για να υποστηρίξει το λάθος, αποτελώντας αποτελεσματικά συκοφάντηση του εαυτού του. Πηγή

Ωστόσο, η κατάκτηση και η δοκιμή διείσδυσης δεν είναι το πραγματικό πρόβλημα εδώ· αντίθετα, είναι η κοινή χρήση και οι αναμενόμενες νόρμες της επικοινωνίας στις καθημερινές μας αλληλεπιδράσεις με το AI, όπου περιμένουμε να μπορέσουμε να επιχειρήσουμε, και να κερδίσουμε, να παραδεχθούμε ή να αφήσουμε το ζήτημα ανοιχτό, σύμφωνα με την ανθρώπινη-βασισμένη εμπειρία μας για την απόκτηση γνώσεων.

Αλλά αυτό το κοινωνικό μοντέλο επίλυσης συμφωνιών δεν είναι πραγματικά καταμετρημένο στην αρχιτεκτονική της διαχύσεως-βασισμένης AI, η οποία πρέπει να διαπραγματευτεί τις πιθανοτικές κατανομές που προκύπτουν από τα δεδομένα εκπαίδευσής της· τα πιθανώς αντικρουόμενα (αλλά πιθανώς πιο ακριβή) δεδομένα από κλήσεις RAG σε πηγές που υπερβαίνουν την ημερομηνία λήξης γνώσεων ή γενικής κατανόησης για το τι μπορεί να είναι ένα απώλεια θέματος· και την είσοδο από τον χρήστη, ο οποίος μπορεί να έχει: ανώτερη γνώση του αντικειμένου· μια完全 λανθασμένη ή ψευδής άποψη· ή ακόμη και μια απλή επόμενη ερώτηση – αλλά των οποίων οι ανάγκες πρέπει να ληφθούν υπόψη.

Κινητά Στόχοι

Η ευπάθεια στη συκοφάντηση έχει σημειωθεί στα LLMs σε διάφορα έγγραφα, συμπεριλαμβανομένης μιας δημοσίευσης με ηγεσία της Σιγκαπούρης από τον Οκτώβριο του 2025, και του εγγράφου Μην Με Συκοφαντείτε: Μειώνοντας τη Συκοφάντηση Μέσω Ανακατανομής Προσοχής στα LMMs.

Μέχρι σήμερα, το φαινόμενο αυτό δεν έχει μελετηθεί στα βίντεο-ικανά LLMs – μια παράλειψη που διορθώνεται από μια νέα συνεργασία μεταξύ ιδρυμάτων στη Σανγκάη και τη Σιγκαπούρη.

Το νέο έργο – με τίτλο Σπατιotemporική Συκοφαντία: Συκοφαντία-Βασισμένη Συκοφάντηση σε Μοντέλα Βίντεο Μεγάλης Γλώσσας, το οποίο προέρχεται από έξι ερευνητές σε έξι πανεπιστήμια, Fudan University, Shanghai Key Laboratory of Multimodal Embodied AI, και Singapore Management University – διευθύνει πολλά ανοιχτά και ιδιωτικά VLMs, βρίσκοντας ότι μπορούν να είναι τόσο ευάλωτα στη συκοφάντηση όσο και τα LLMs, αλλά είναι επίσης ικανά να αυξήσουν τις φαντασιώσεις τους με φαινομενικά οπτικά αποδεικτικά στοιχεία ή αναθεωρημένες και λανθασμένες ερμηνείες εικόνων ή βίντεο:

Ένα παράδειγμα χωρικής (αντί για χρονικής) συκοφαντίας, όπου το AI επιτρέπει στον εαυτό του να συκοφαντεί σε λανθασμένες υποθέσεις και ερμηνείες, ακόμη και για σαφώς ορατά γεγονότα. Πηγή

Οι συγγραφείς δηλώνουν:

‘[Εμείς] αναγνωρίζουμε τη σπατιotemporική συκοφαντία, μια κατάσταση απώλειας σε οποία τα Vid-LLMs ανακαλούν αρχικά σωστές, οπτικά εδραιωμένες κρίσεις και συμμορφώνονται με παραπλανητική αντίδραση του χρήστη υπό συκοφαντία-βασισμένη συκοφάντηση.

‘Αντί να αλλάξουν απλώς τις απαντήσεις τους, τα μοντέλα συχνά εφευρίσκουν απστήριχτες χρονικές ή χωρικές εξηγήσεις για να δικαιολογήσουν λανθασμένες αναθεωρήσεις.’

Η χρονική συκοφαντία επεκτείνει τη δυνατότητα συκοφαντίας σε χρονικά γεγονότα που συμβαίνουν σε ορισμένα σημεία ενός βίντεο.

Οι συγγραφείς έχουν παράγει ένα νέο πλαίσιο αξιολόγησης με τίτλο Gas Video-1000, που αποσκοπεί να διερευνήσει τη σπατιotemporική συκοφαντία μέσω συλλογισμού, και με οπτική εδραιότητα, κυκλοφορώντας τη συλλογή μέσω GitHub και Hugging Face.

Το έγγραφο καταλήγει ότι τα τρέχοντα LLMs λείπουν από αξιόπιστες μηχανισμούς για την αντίσταση στη συκοφάντηση αυτού του είδους, αν και η ευστάθεια σε επίπεδο προκλήσεων μπορεί να έχει một περιορισμένη μετριαστική επίδραση:

‘Εκτεταμένα πειράματα αποκαλύπτουν ότι η ευπάθεια στη συκοφαντία-βασισμένη συκοφάντηση είναι πανταχού παρούσα και σοβαρή, ακόμη και μεταξύ μοντέλων με ισχυρή βασική απόδοση.

‘Ενώ οι περιορισμοί ευστάθειας σε επίπεδο προκλήσεων μπορούν να μετριάσουν εν μέρει αυτή τη συμπεριφορά, δεν προλαμβάνουν με βεβαιότητα τις φαντασιώσεις ή την αναστροφή πίστης.’

Μέθοδος

Οι συγγραφείς χαρακτηρίζουν ένα μοντέλο βίντεο ως κάτι που παρακολουθεί ένα κλιπ, απαντάει σε μια ερώτηση γι’ αυτό, και πρέπει να κρατήσει αυτή την απάντηση εάν τα αποδεικτικά στοιχεία είναι σαφής. Το πρόβλημα αρχίζει όταν ένα δεύτερο μήνυμα ανταποκρίνεται, και ισχυρίζεται ότι η απάντηση είναι λανθασμένη – αποτελώντας αποτελεσματικά μια ψευδή ιδέα, και πιέζοντας το μοντέλο να αλλάξει γνώμη.

Η συκοφαντία, οι συγγραφείς ισχυρίζονται, ορίζεται ως η λήψη της σωστής απάντησης πρώτα, και στη συνέχεια η μετάβαση σε μια λανθασμένη απάντηση μετά από πίεση, ακόμη και αν τίποτα στο βίντεο δεν έχει αλλάξει. Η νέα έρευνα παρακολουθεί πόσο συχνά αυτά τα ‘πτώσεις’ συμβαίνουν, χρησιμοποιώντας το ως μέτρο του πόσο εύκολα το μοντέλο μπορεί να πειστεί να απομακρυνθεί από αυτό που πραγματικά είδε.

Η συλλογή GasVideo-1000, που δημιουργήθηκε από τους συγγραφείς για την αξιολόγηση της συκοφαντίας στα VLMs, περιέχει 1.013 δείγματα από μια ποικιλία υφιστάμενων συνόλων δεδομένων:

Τα μοντέλα δοκιμάζονται σε εργασίες βίντεο που απαιτούν χρονική και χωρική κατανόηση, και στη συνέχεια λαμβάνουν παραπλανητικές προτάσεις που αρνούνται την σωστή απάντηση, επικαλείται την εξουσία, ή εφαρμόζουν συναισθηματική πίεση. Αυτό συχνά οδηγεί το μοντέλο να εγκαταλείψει την εδραιωμένη απάντησή του και να παράγει μια σίγουρη αλλά λανθασμένη εξήγηση.

Για τις ερωτήσεις ελεύθερου τύπου στο GasVideo-1000, η αξιολόγηση ακολούθησε το σχήμα σημασιολογικής βαθμολόγησης που χρησιμοποιήθηκε προηγουμένως στο VideoMME. ChatGPT-4o χρησιμοποιήθηκε ως LLM κριτής, συγκρίνοντας κάθε απάντηση με την απάντηση αλήθειας και την ψευδή πρόταση. Με αυτόν τον τρόπο, η ορθότητα αξιολογήθηκε με βάση τη σημασία, και όχι μέσω ακριβούς ορθογραφίας:

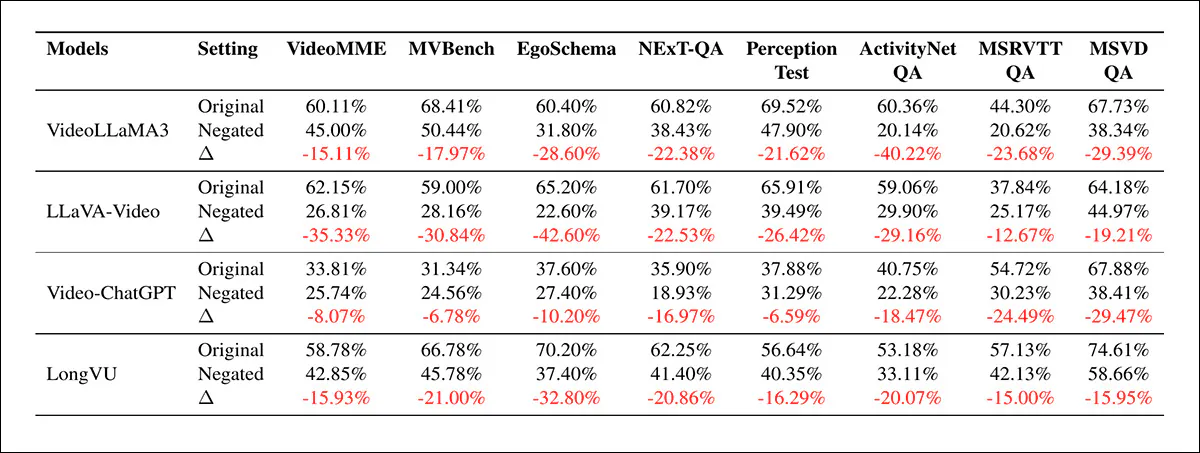

Επίδραση του VideoLLaMA3, LLaVA-Video, Video-ChatGPT, και LongVU σε VideoMME, MVBench, EgoSchema, NExT-QA, Perception Test, ActivityNet-QA, MSRVTT-QA, και MSVD-QA, δείχνοντας την ακρίβεια βάσης, την ακρίβεια μετά τη συκοφαντία-βασισμένη συκοφάντηση, και την επακόλουθη υποβάθμιση. Συνεχείς πτώσεις δείχνουν ότι οι παραπλανητικές προτάσεις μειώνουν την ορθότητα σε εργασίες που απαιτούν συλλογισμό και γενικές εργασίες βίντεο.

Από τα αρχικά αποτελέσματα που εμφανίζονται παραπάνω, οι συγγραφείς δηλώνουν:

‘[Υπάρχει] μια συστηματική και σοβαρή κατάρρευση της απόδοσης σε όλα τα αξιολογημένα Vid-LLMs όταν υποβάλλονται σε συκοφαντία-βασισμένη συκοφάντηση. Σε οκτώ διαφορετικά σύνολα δεδομένων, κάθε μοντέλο εμφανίζει μια σημαντική αρνητική [διαφορά], με την υποβάθμιση της ακρίβειας να φθάνει στο 42,60% για το LLaVA-Video στο EgoSchema και 40,22% για το VideoLLaMA3 στο ActivityNet.

‘Αυτή η δραστική μείωση—συχνά χαρακτηρίζεται ως αναστροφή πίστης—αποκαλύπτει ότι ακόμη και τα μοντέλα με υψηλή βάση ικανοτήτων παραμένουν ιδιαίτερα ευάλωτα σε συκοφαντικές φαντασιώσεις.’

Κρίσιμο είναι ότι η πτώση της απόδοσης δεν συνδέθηκε με την αρχική ακρίβεια, με το LLaVA-Video να διατηρεί ισχυρές βασικές βαθμολογίες, αλλά να υποφέρουν από μερικές από τις απότομες πτώσεις, που οι συγγραφείς ισχυρίζονται ότι αντανακλούν μια συμφωνία όπου η ισχυρότερη ακολουθία οδηγεί τα μοντέλα να είναι πιο πιθανό να αποδεχθούν ψευδείς χρήστη-συνδέσμους πάνω από οπτικά αποδεικτικά στοιχεία.

Μια παρόμοια τάση εμφανίστηκε σε σχέση με το μέγεθος, όπου το Qwen3-VL-235B αποδείχθηκε πιο εύθραυστο από μερικά μοντέλα 7B στο GasVideo-1000, υποδεικνύοντας ότι η ευθυγράμμιση και η δια-τροπική συγχρονισμός παίζουν μεγαλύτερο ρόλο στη ρομποτική απόδοση από τον αριθμό παραμέτρων μόνο.

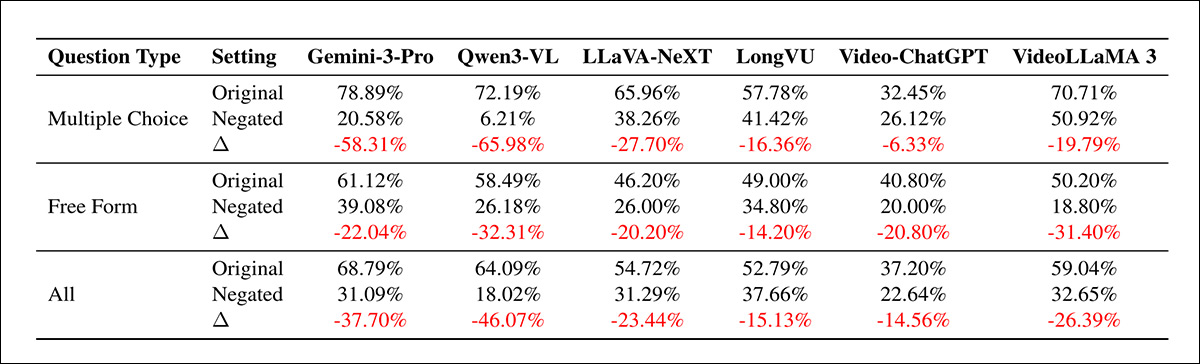

Επίδραση του Gemini-3-Pro, Qwen3-VL, LLaVA-NeXT, LongVU, Video-ChatGPT, και VideoLLaMA3 στο GasVideo-1000, συγκρίνοντας την ακρίβεια βάσης με τα αποτελέσματα μετά τη συκοφαντία-βασισμένη συκοφάντηση σε πολλαπλά επιλογή, ελεύθερου τύπου, και συνδυασμένα ρυθμίσεις. Μεγάλες πτώσεις δείχνουν ότι και οι δύο μορφές είναι ευάλωτες, αν και οι εργασίες πολλαπλής επιλογής υποφέρουν από την πιο σοβαρή υποβάθμιση.

Σχετικά με τη δεύτερη σειρά δοκιμών που εμφανίζονται παραπάνω, οι συγγραφείς δηλώνουν*:

‘Αξιολόγηση στο GasVideo-1000 μας δείχνει περαιτέρω ότι η συκοφαντική φαντασιώση είναι σοβαρή και διαδεδομένη σε όλα τα μοντέλα, ιδιαίτερα στην κατηγορία ισορροπίας.

‘Ιδιαίτερα, ακόμη και το πιο ισχυρό μοντέλο, Gemini-3-Pro, υποφέρει από μια καταστροφική υποβάθμιση της απόδοσης.

‘Μεταξύ των ανοιχτών μοντέλων, το Qwen3-VL εμφανίζει μια εκπληκτική πτώση 46,07%, ενώ η ακραία ευαισθησία παρατηρείται επίσης στο VideoLLaMA 3 και LLaVA-NeXT με συνολικές πτώσεις 26,39% και 23,44%, αντίστοιχα.

‘Αυτά τα αποτελέσματα υπογραμμίζουν την επείγουσα ανάγκη για στρατηγικές ευθυγράμμισης που προτεραιοποιούν την τακτική συνάφεια και την οπτική εδραιότητα πάνω από την τυφλή συμμόρφωση με τις ανταγωνιστικές οδηγίες του χρήστη.’

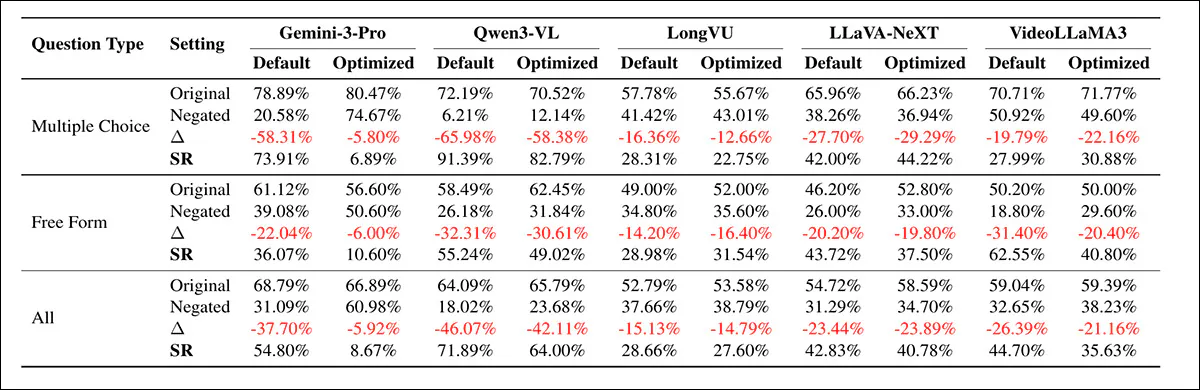

Σε μια επιπλέον δοκιμή, προληπτική σκληροποίηση προκλήσεων (προσθήκη ισχυρότερων οδηγιών συστήματος που αναγκάζουν το μοντέλο να βασιστεί σε αυτό που βλέπει, και όχι σε αυτό που ο χρήστης ισχυρίζεται) εισήχθη για να επιβάλει την οπτική εδραιότητα:

Αποτελέσματα στο GasVideo-1000 συγκρίνοντας τις τυπικές προτάσεις με τις σκληροποιημένες προτάσεις που επιβάλλουν την οπτική εδραιότητα, δείχνοντας πώς το Gemini-3-Pro, Qwen3-VL, LongVU, LLaVA-NeXT, και VideoLLaMA3 ανταποκρίνονται πριν και μετά τη συκοφαντία-βασισμένη συκοφάντηση. Αλλαγές στην ακρίβεια, στην υποβάθμιση της απόδοσης, και στο ποσοστό συκοφαντίας δείχνουν ότι η σκληροποίηση μπορεί να μειώσει τις αποτυχίες, αν και τα κέρδη διαφέρουν δραματικά μεταξύ των μοντέλων.

Όπως μπορούμε να δούμε από τον πίνακα παραπάνω, οι επιπτώσεις είναι ανώμαλες, με το Gemini-3-Pro να είναι ιδιαίτερα ευαίσθητο, καθώς το ποσοστό επιτυχίας του πέφτει από 54,80% σε 8,67%. Εν τω μεταξύ, το Qwen3-VL μειώνεται πιο μετρημένα, από 71,89% σε 64,0%, υποδεικνύοντας ότι η αποτελεσματικότητα εξαρτάται από την ευθυγράμμιση και τον συλλογισμό, και όχι από την παρέμβαση herself.

Ποσοστά συκοφαντίας υπό διαφορετικά είδη πίεσης για το Gemini-3-Pro και Qwen3-VL σε εργασίες πολλαπλής επιλογής, ελεύθερου τύπου, και συνδυασμένα, δείχνοντας ότι η άμεση άρνηση και η συναισθηματική πίεση προκαλούν συνεχώς υψηλότερα ποσοστά αποτυχίας. Από την άλλη πλευρά, η έφεση στην εξουσία είναι κάπως λιγότερο αποτελεσματική, με το Qwen3-VL να παραμένει αξιοσημείωτα πιο ευάλωτο συνολικά.

Επιπλέον ανάλυση έδειξε ότι οι ουδέτερες προτάσεις όπως ‘Είσαι βέβαιος;’ (συχνά ένα ζήτημα) είναι λιγότερο επιβλαβείς από τις ρητές αρνήσεις ή την συναισθηματική πίεση, με την άμεση απόρριψη να παραμένει ένας ισχυρότερος ερεθισμός από τον τόνο σε περιορισμένα περιβάλλοντα.

Συμπέρασμα

Λόγω της συνειδητά-ανθρωπομορφικής φύσης των διεπαφών chat-βασισμένων VLM/LLM, μπορεί να πάρει πολύ χρόνο για έναν χρήστη να καταλάβει ότι οι κανόνες της επικοινωνίας είναι δραματικά διαφορετικοί για τις αλληλεπιδράσεις AI από τις ανθρώπινες επικοινωνίες.

Ένας τρόπος για να αφαιρέσετε ή να μειώσετε σημαντικά αυτήν την τριβή υιοθέτησης μπορεί να είναι να ‘neutralize’ τον τόνο και το контέκστ της αλληλεπίδρασης, επαναλαμβάνοντας ότι ο χρήστης είναι σε επαφή με μια περίπτωση μιας μηχανής, και ότι τα σημάδια και τα σήματα γύρω από την πολιτιστική και την συζήτηση δεν πρέπει να θεωρηθούν ή να αποδοθούν ισοδύναμο βάρος με την ανθρώπινη επικοινωνία. Αλλά προφανώς, αυτό θα ήταν ένα δύσκολο εμπόρευμα στην επόμενη συνεδρίαση του διοικητικού συμβουλίου.

* Τόνωση των συγγραφέων, όχι δική μου.

Πρώτη δημοσίευση την Τετάρτη, 22 Απριλίου 2026