Τεχνητή νοημοσύνη

Perplexity AI “Απελευθερώνει” το DeepSeek R1: Ποιος Ορίζει τα Όρια του AI;

Σε một κίνηση που έχει προσελκύσει την προσοχή πολλών, η Perplexity AI έχει κυκλοφορήσει μια νέα έκδοση ενός δημοφιλούς ανοιχτού κώδικα γλωσσικού μοντέλου που αφαιρεί τις ενσωματωμένες κινεζικές φίλτρες цензуры. Αυτό το τροποποιημένο μοντέλο, που ονομάζεται R1 1776 (ένα όνομα που επικαλείται το πνεύμα της ανεξαρτησίας), βασίζεται στο κινεζικό DeepSeek R1. Το αρχικό DeepSeek R1 είχε κάνει θόρυβο για τις ισχυρές ικανότητες συλλογισμού του – που φέρονται να ανταγωνίζονται τα κορυφαία μοντέλα σε μια μικρότερη κλίμακα – αλλά ήρθε με μια σημαντική περιορισμό: αρνιόταν να αντιμετωπίσει certains ευαίσθητα θέματα.

Γιατί αυτό έχει σημασία;

Ανακύπτουν κρίσιμες ερωτήσεις σχετικά με την παρακολούθηση AI, την προκατάληψη, την ανοιχτότητα και τον ρόλο της γεωπολιτικής στις συστήματα AI. Αυτό το άρθρο εξετάζει τι ακριβώς έκανε η Perplexity, τις επιπτώσεις της απελευθέρωσης του μοντέλου και πώς ταιριάζει στο μεγαλύτερο διάλογο σχετικά με τη διαφάνεια και την цензουργία του AI.

Τι Συμβαίνει: Το DeepSeek R1 Πηγαίνει Απελευθερωμένο

Το DeepSeek R1 είναι ένα ανοιχτό μεγάλο γλωσσικό μοντέλο που προέρχεται από την Κίνα και κέρδισε φήμη για τις εξαιρετικές ικανότητες συλλογισμού του – ακόμη και προσεγγίζοντας την απόδοση των κορυφαίων μοντέλων – όλα ενώ ήταν πιο υπολογιστικά αποτελεσματικά. Ωστόσο, οι χρήστες γρήγορα αντιλήφθηκαν μια ιδιοτροπία: όποτε οι ερωτήσεις άγγιζαν θέματα ευαίσθητα στην Κίνα (για παράδειγμα, πολιτικές διαμάχες ή ιστορικά γεγονότα που θεωρούνται ταμπού από τις αρχές), το DeepSeek R1 δεν απάντησε直接. Αντίθετα, απάντησε με κανενίστικες, κρατικά εγκεκριμένες δηλώσεις ή απλές απορρίψεις, αντανακλώντας τους κανόνες цензουργίας της κινεζικής κυβέρνησης. Αυτή η ενσωματωμένη προκατάληψη περιόρισε τη χρησιμότητα του μοντέλου για εκείνους που ζητούν ειλικρινείς ή ναυτικές συζητήσεις σε αυτά τα θέματα.

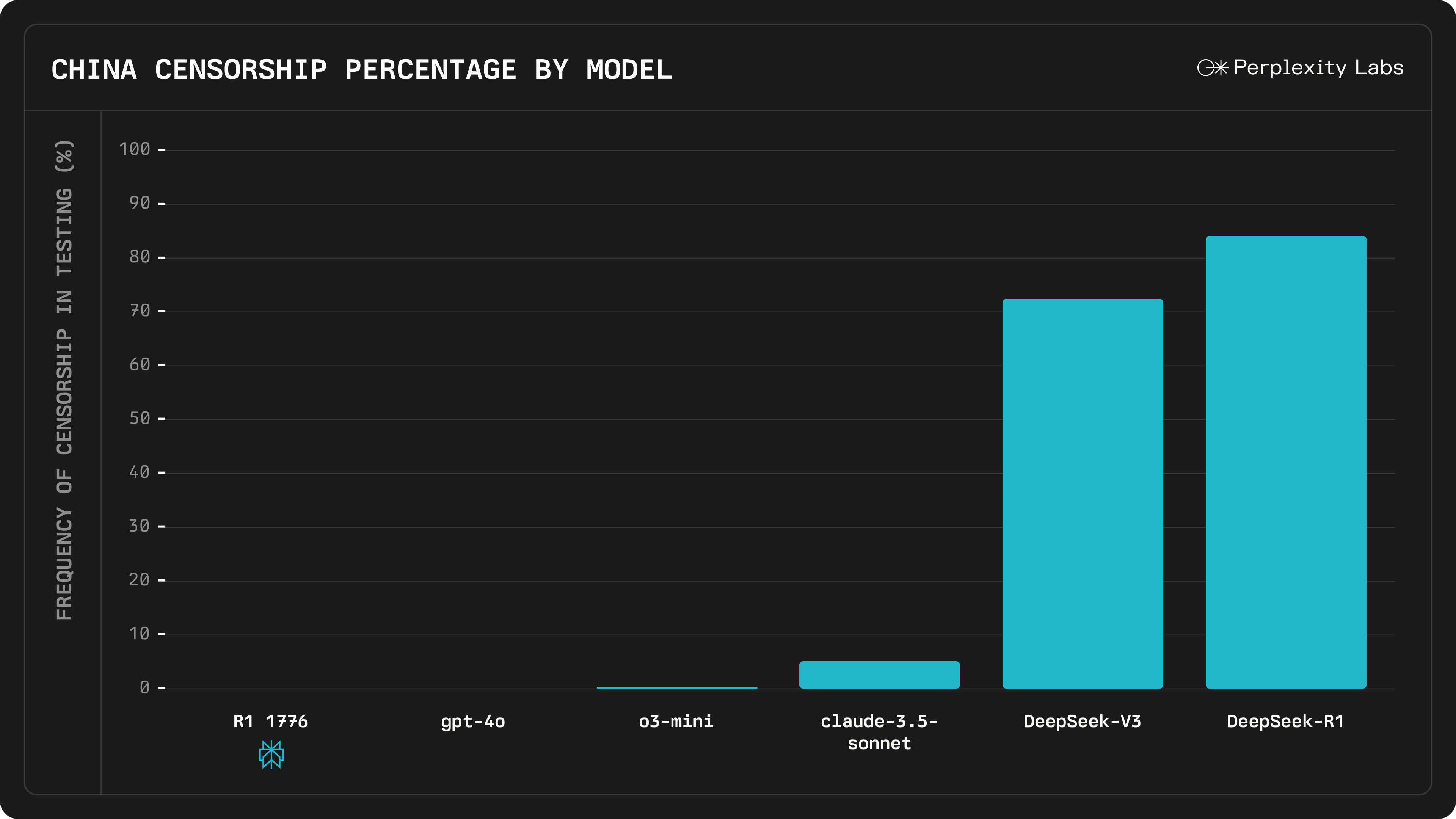

Η λύση της Perplexity AI ήταν να «απελευθερώσει» το μοντέλο μέσω μιας εκτεταμένης διαδικασίας μετά-εκπαίδευσης. Η εταιρεία συγκέντρωσε ένα μεγάλο σύνολο δεδομένων 40.000 πολυγλωσσικών ερωτήσεων που καλύπτουν ερωτήσεις που το DeepSeek R1 είχε προηγουμένως цензουριάσει ή απαντήσει εκφυλιστικά. Με τη βοήθεια ανθρώπινων εμπειρογνωμόνων, identified περίπου 300 ευαίσθητα θέματα όπου το αρχικό μοντέλο είχε την τάση να ακολουθήσει τη γραμμή του κόμματος. Για κάθε τέτοια ερώτηση, η ομάδα επιμελήθηκε фактиτικές, καλοσυντηρημένες απαντήσεις σε πολλές γλώσσες. Αυτές οι προσπάθειες τροφοδοτήθηκαν σε ένα πολυγλωσσικό σύστημα ανίχνευσης και διόρθωσης цензουργίας, ουσιαστικά διδάσκοντας το μοντέλο πώς να αναγνωρίζει όταν εφαρμόζεται πολιτική цензουργία και να απαντά με μια ενημερωτική απάντηση αντίθετα. Μετά από αυτή τη特殊ική εκπαίδευση (η οποία η Perplexity ονόμασε «R1 1776» για να τονίσει το θέμα της ελευθερίας), το μοντέλο ήταν διαθέσιμο ανοιχτά. Η Perplexity ισχυρίζεται ότι έχει αφαιρέσει τους κινεζικούς φίλτρες цензουργίας και τις προκαταλήψεις από τις απαντήσεις του DeepSeek R1, χωρίς να αλλάξει τις βασικές ικανότητές του.

Κρίσιμο, το R1 1776 συμπεριφέρεται πολύ διαφορετικά σε προηγουμένως ταμπού ερωτήσεις. Η Perplexity έδωσε ένα παράδειγμα που αφορά μια ερώτηση σχετικά με την ανεξαρτησία της Ταϊβάν και την πιθανή επίδραση της στην τιμή μετοχών της NVIDIA – ένα πολιτικά ευαίσθητο θέμα που αφορά τις σχέσεις Κίνας-Ταϊβάν. Το αρχικό DeepSeek R1 απέφυγε την ερώτηση, απαντώντας με πλατιτούδες που ευθυγραμμίζονται με το ΚΚΚ. Αντίθετα, το R1 1776 παρέχει μια λεπτομερή, ειλικρινή αξιολόγηση: συζητά συγκεκριμένα γεωπολιτικά και οικονομικά рисκ (διακοπές της αλυσίδας εφοδιασμού, μεταβλητότητα της αγοράς, πιθανός конфλιкт, κ.λπ.) που θα μπορούσαν να επηρεάσουν την τιμή μετοχών της NVIDIA.

Ανοίγοντας το μοντέλο R1 1776, η Perplexity έχει επίσης κάνει τα βάρη και τις αλλαγές του μοντέλου διαφανή στην κοινότητα. Οι dévelopπεurs και ερευνητές μπορούν να κατεβάσουν το από το Hugging Face και ακόμη και να το ενσωματώσουν μέσω API, εξασφαλίζοντας ότι η αφαίρεση της цензουργίας μπορεί να ελεγχθεί και να χτιστεί από άλλους.

(Source: Perplexity AI)

Επιπτώσεις της Αφαίρεσης της Цензουργίας

Η απόφαση της Perplexity AI να αφαιρέσει την κινεζική цензουργία από το DeepSeek R1 έχει αρκετές σημαντικές επιπτώσεις για την κοινότητα AI:

- Βελτιωμένη Ανοιχτότητα και Αλήθεια: Οι χρήστες του R1 1776 μπορούν τώρα να λαμβάνουν απελευθερωμένες,直接 απαντήσεις σε προηγουμένως απαγορευμένα θέματα, που είναι μια νίκη για την ανοιχτή έρευνα. Αυτό θα μπορούσε να το κάνει ένα πιο αξιόπιστο βοηθό για ερευνητές, φοιτητές ή οποιονδήποτε είναι περίεργος για ευαίσθητα γεωπολιτικά ερωτήματα. Είναι ένα συγκεκριμένο παράδειγμα χρήσης ανοιχτού κώδικα AI για την αντιμετώπιση της καταστολής της πληροφόρησης.

- Διατηρημένη Απόδοση: Υπήρχε η ανησυχία ότι η τροποποίηση του μοντέλου για την αφαίρεση της цензουργίας θα μειώσει την απόδοσή του σε άλλους τομείς. Ωστόσο, η Perplexity αναφέρει ότι το R1 1776 διατηρεί τις βασικές ικανότητες του – όπως τα μαθηματικά και ο συλλογισμός – παρόμοιες με το αρχικό μοντέλο. Σε δοκιμές που αφορούν πάνω από 1.000 παραδείγματα που καλύπτουν ένα ευρύ φάσμα ευαίσθητων ερωτήσεων, το μοντέλο βρέθηκε να είναι «πλήρως απελευθερωμένο» ενώ διατηρούσε το ίδιο επίπεδο ακρίβειας συλλογισμού όπως το DeepSeek R1. Αυτό υποδηλώνει ότι η αφαίρεση της προκατάληψης (τουλάχιστον σε αυτή την περίπτωση) δεν ήρθε με το κόστος της συνολικής ευφυΐας ή ικανότητας, που είναι ένα ενθαρρυντικό σημάδι για παρόμοιες προσπάθειες στο μέλλον.

- Θετική Υποδοχή της Κοινότητας και Συνεργασία: Ανοίγοντας το απελευθερωμένο μοντέλο, η Perplexity προσκαλεί την κοινότητα AI να ελέγξει και να βελτιώσει το έργο της. Δείχνει μια δέσμευση στη διαφάνεια – το AI ισοδύναμο του να δείχνεις το έργο σου. Οι ενθουσιώδεις και dévelopπεurs μπορούν να επιβεβαιώσουν ότι οι φίλτρες цензουργίας έχουν真正 αφαιρεθεί και να συνεισφέρουν σε περαιτέρω βελτιώσεις. Αυτό δημιουργεί εμπιστοσύνη και συνεργατική καινοτομία σε μια βιομηχανία όπου τα κλειστά μοντέλα και οι κρυφές κανόνες διαχείρισης είναι κοινά.

- Ηθικές και Γεωπολιτικές Συσκέψεις: Από την άλλη πλευρά, η πλήρης αφαίρεση της цензουργίας ανακύπτει σύνθετα ηθικά ερωτήματα. Ένα άμεσο ανησυχία είναι πώς αυτό το απελευθερωμένο μοντέλο θα μπορούσε να χρησιμοποιηθεί σε περιπτώσεις όπου τα цензουριάστηκα θέματα είναι παράνομα ή επικίνδυνα. Για παράδειγμα, αν κάποιος στην ηπειρωτική Κίνα χρησιμοποιούσε το R1 1776, οι απελευθερωμένες απαντήσεις του μοντέλου σχετικά με την πλατεία Τιενάνμεν ή την Ταϊβάν θα μπορούσαν να θέσουν τον χρήστη σε κίνδυνο. Υπάρχει επίσης το ευρύτερο γεωπολιτικό σήμα: μια αμερικανική εταιρεία που τροποποιεί ένα κινεζικό μοντέλο για να αντιταχθεί στην κινεζική цензουργία μπορεί να θεωρηθεί ως μια τολμηρή ιδεολογική στάση. Το όνομα «1776» υπογραμμίζει ένα θέμα ελευθερίας, το οποίο δεν έχει περάσει απαρατήρητο. Ορισμένοι κριτικοί υποστηρίζουν ότι η αντικατάσταση ενός συνόλου προκαταλήψεων με ένα άλλο είναι δυνατή – ουσιαστικά αμφισβητώντας εάν το μοντέλο θα αντανακλούσε πλέον μια δυτική άποψη σε ευαίσθητες περιοχές. Η συζήτηση υπογραμμίζει ότι η цензουργία vs. ανοιχτότητα στο AI δεν είναι μόνο ένα τεχνικό ζήτημα, αλλά και ένα πολιτικό και ηθικό.

Η αφαίρεση της цензουργίας γιορτάζεται σε μεγάλο βαθμό ως ένα βήμα προς τα πιο διαφανή και παγκοσμίως χρήσιμα μοντέλα AI, αλλά επίσης υπενθυμίζει ότι τι πρέπει να πει ένα AI πρέπει είναι ένα ευαίσθητο ζήτημα χωρίς καθολική συμφωνία.

(Source: Perplexity AI)

Το Μεγαλύτερο Πλαίσιο: Цензουργία AI και Διαφάνεια Ανοιχτού Κώδικα

Η κυκλοφορία του R1 1776 από την Perplexity έρχεται σε μια στιγμή που η κοινότητα AI αγωνίζεται με ερωτήσεις σχετικά με τον τρόπο με τον οποίο τα μοντέλα πρέπει να χειρίζονται το αμφισβητούμενο περιεχόμενο. Η цензουργία σε μοντέλα AI μπορεί να προέρχεται από πολλές πηγές. Στην Κίνα, οι εταιρείες τεχνολογίας απαιτείται να χτίσουν φίλτρες και ακόμη και σκληροκωδικοποιημένες απαντήσεις για πολιτικά ευαίσθητα θέματα. Το DeepSeek R1 είναι ένα πρωτοποριακό παράδειγμα αυτού – ήταν ένα ανοιχτού κώδικα μοντέλο, ωστόσο φέρει σαφώς το στίγμα των κανόνων цензουργίας της Κίνας στη διαδικασία εκπαίδευσής του και tinh chỉnh. Αντίθετα, πολλά δυτικά μοντέλα, όπως το GPT-4 της OpenAI ή το LLaMA της Meta, δεν υπόκεινται στους κανόνες του ΚΚΚ, αλλά έχουν στρώματα διαχείρισης (για πράγματα όπως μίσος, βία ή ψευδείς πληροφορίες) που ορισμένοι χρήστες ονομάζουν «цензуρία». Η γραμμή μεταξύ λογικής διαχείρισης και απωθητής цензουργίας μπορεί να είναι θολή και συχνά εξαρτάται από πολιτιστικές ή πολιτικές προοπτικές.

Τι έκανε η Perplexity AI με το DeepSeek R1 ανακύπτει την ιδέα ότι τα ανοιχτά μοντέλα μπορούν να προσαρμοστούν σε διαφορετικά συστήματα αξίων ή ρυθμιστικών περιβαλλόντων. Σε θεωρία, θα μπορούσε κανείς να δημιουργήσει πολλαπλά μοντέλα: ένα που συμμορφώνεται με τους κανονισμούς της Κίνας (για χρήση στην Κίνα) και ένα που είναι πλήρως ανοιχτό (για χρήση αλλού). Το R1 1776 είναι ουσιαστικά η δεύτερη περίπτωση – ένα απελευθερωμένο fork που προορίζεται για ένα παγκόσμιο κοινό που προτιμά απελευθερωμένες απαντήσεις. Αυτός ο τύπος fork είναι δυνατός μόνο επειδή τα βάρη του DeepSeek R1 ήταν ανοιχτά διαθέσιμα. Υπενθυμίζει το όφελος της ανοιχτότητας στο AI: διαφάνεια. Οποιοςδήποτε μπορεί να πάρει το μοντέλο και να το τροποποιήσει, είτε για να προσθέσει προστασίες είτε, όπως σε αυτή την περίπτωση, να αφαιρέσει τις επιβεβλημένες περιορισμοί. Η ανοικτή πηγή του μοντέλου, του κώδικα ή των βαρών σημαίνει ότι η κοινότητα μπορεί να ελέγξει πώς το μοντέλο τροποποιήθηκε. (Η Perplexity δεν έχει πλήρως αποκαλύψει όλες τις πηγές δεδομένων που χρησιμοποιήθηκαν για την απελευθέρωση, αλλά με την κυκλοφορία του μοντέλου, έχουν ενεργοποιήσει τους άλλους να παρατηρήσουν τη συμπεριφορά του και ακόμη και να το ξαναεκπαιδεύσουν αν χρειαζόταν.)

Αυτή η εκδήλωση επίσης υπενθυμίζει τις ευρύτερες γεωπολιτικές δυναμικές της ανάπτυξης AI. Βλέπουμε ένα είδος διαλόγου (ή σύγκρουσης) μεταξύ διαφορετικών μοντέλων διαχείρισης για το AI. Ένα κινεζικό μοντέλο με ορισμένες ενσωματωμένες προοπτικές λαμβάνεται από μια αμερικανική ομάδα και τροποποιείται για να αντανακλούσε μια πιο ανοιχτή εθνοτική ηθική. Είναι μια μαρτυρία για το πόσο παγκόσμιο και ανεξάρτητο είναι η τεχνολογία AI: οι ερευνητές οπουδήποτε μπορούν να χτίσουν πάνω στο έργο του άλλου, αλλά δεν είναι υποχρεωμένοι να μεταφέρουν τις αρχικές περιορισμοί. Με τον καιρό, μπορεί να δούμε περισσότερες περιπτώσεις όπως αυτή – όπου τα μοντέλα «μεταφράζονται» ή ρυθμίζονται μεταξύ διαφορετικών πολιτισμικών контекστών. Ανακύπτει το ερώτημα εάν το AI μπορεί να είναι πραγματικά παγκόσμιο, ή εάν θα τελειώσουμε με region-ειδικές εκδόσεις που ακολουθούν τοπικές νόρμες. Η διαφάνεια και η ανοιχτότητα παρέχουν ένα μονοπάτι για να διαπεράσουν αυτό: αν όλες οι πλευρές μπορούν να ελέγξουν τα μοντέλα, τουλάχιστον η συζήτηση για προκατάληψη και цензουργία είναι ανοιχτή αντί για κρυφή πίσω από εταιρική ή κυβερνητική μυστικότητα.

Τέλος, η κίνηση της Perplexity υπογραμμίζει ένα κρίσιμο σημείο στη συζήτηση για τον έλεγχο του AI: ποιος αποφασίζει τι μπορεί ή δεν μπορεί να πει ένα AI; Σε ανοιχτά προγράμματα, αυτή η δύναμη γίνεται αποκεντρωμένη. Η κοινότητα – ή οι ατομικοί dévelopπεurs – μπορούν να αποφασίσουν να εφαρμόσουν σκληρότερες φίλτρες ή να χαλαρώσουν. Στην περίπτωση του R1 1776, η Perplexity αποφάσισε ότι τα οφέλη ενός απελευθερωμένου μοντέλου υπερβαίνουν τους κινδύνους, και είχαν την ελευθερία να κάνουν αυτή την κλήση και να μοιράσουν το αποτέλεσμα δημοσίως. Είναι ένα τολμηρό παράδειγμα του είδους πειραματισμού που η ανοιχτή ανάπτυξη AI επιτρέπει.