Τεχνητή νοημοσύνη

Παραγωγή Παραφράσεων με Βαθιά Ενισχυμένη Μάθηση – Ηγετικά Πρόσωπα

Όταν γράφουμε ή μιλάμε, έχουμε 모두 αναρωτηθεί αν υπάρχει καλύτερος τρόπος για να εκφραστούν οι ιδέες μας στους άλλους. Ποια λόγια πρέπει να χρησιμοποιήσω; Πώς πρέπει να δομήσω τη σκέψη; Πώς είναι πιθανό να ανταποκριθούν; Στο Phrasee, περνάμε πολύ χρόνο σκεπτόμενοι για τη γλώσσα – τι λειτουργεί και τι δεν λειτουργεί.

Φανταστείτε ότι γράφετε το θέμα μιας ηλεκτρονικής αλληλογραφίας που θα σταλεί σε 10 εκατομμύρια άτομα στη λίστα σας, προωθώντας 20% έκπτωση σε ένα καινούριο λάπτοπ.

Ποια γραμμή θα επιλέγατε;

- Μπορείτε τώρα να πάρετε επιπλέον 20% έκπτωση στην επόμενη παραγγελία σας

- Ετοιμαστείτε – επιπλέον 20% έκπτωση

Ενώ μεταφέρουν την ίδια πληροφορία, η μια έφτασε σε σχεδόν 15% υψηλότερο ποσοστό ανοίγματος από την άλλη (και ποντάρω ότι δεν μπορείτε να νικήσετε το μοντέλο μας στην πρόβλεψη ποια είναι η σωστή ?). Ενώ η γλώσσα μπορεί συχνά να ελεγχθεί μέσω A/B testing ή multi-armed bandits, η αυτόματη παραγωγή παραφράσεων παραμένει ένα πολύ δύσκολο ερευνητικό πρόβλημα.

Δύο προτάσεις θεωρούνται παραφράσεις η μια της άλλης εάν μοιράζονται την ίδια σημασία και μπορούν να χρησιμοποιηθούν ανταλλακτικά. Ένα άλλο σημαντικό πράγμα που συχνά λαμβάνεται ως δεδομένο είναι εάν μια πρόταση που παράγεται από μηχανή είναι ρευστή.

Σε αντίθεση με την επιβλεπόμενη μάθηση, τα πράγματα της Ενισχυμένης Μάθησης (RL) μαθαίνουν μέσω της αλληλεπίδρασης με το περιβάλλον τους και της παρατήρησης των ανταμοιβών που λαμβάνουν ως αποτέλεσμα. Αυτή η κάπως νουαρή διαφορά έχει τεράστιες επιπτώσεις για τον τρόπο με τον οποίο λειτουργούν οι αλγόριθμοι και πώς εκπαιδεύονται τα μοντέλα. Η Βαθιά Ενισχυμένη Μάθηση χρησιμοποιεί νευρωνικά δίκτυα ως προσεγγιστική συνάρτηση για να επιτρέψει στο πράγμα να μάθει πώς να υπερβεί τους ανθρώπους σε σύνθετα περιβάλλοντα όπως Go, Atari και StarCraft II.

Παρά την επιτυχία αυτή, η ενισχυμένη μάθηση δεν έχει εφαρμοστεί ευρέως σε προβλήματα του πραγματικού κόσμου, συμπεριλαμβανομένης της Επεξεργασίας Φυσικής Γλώσσας (NLP).

Ως μέρος της Διπλωματικής Εργασίας μου στη Επιστήμη Δεδομένων, αποδεικνύουμε πώς η Βαθιά Ενισχυμένη Μάθηση μπορεί να χρησιμοποιηθεί για να υπερβεί τις μεθόδους επιβλεπόμενης μάθησης στην αυτόματη παραγωγή παραφράσεων του εισαγωγικού κειμένου. Το πρόβλημα της παραγωγής της καλύτερης παραφράσης μπορεί να θεωρηθεί ως η εύρεση της σειράς των λέξεων που μεγιστοποιεί τη σημασιολογική ομοιότητα μεταξύ των προτάσεων ενώ διατηρεί τη ρευστότητα στην έξοδο. Τα πράγματα της RL είναι καλά προσαρμοσμένα για να βρουν το καλύτερο σύνολο ενεργειών για να επιτύχουν την μέγιστη αναμενόμενη ανταμοιβή σε περιβάλλοντα ελέγχου.

Σε αντίθεση με τα περισσότερα προβλήματα της μηχανικής μάθησης, το μεγαλύτερο πρόβλημα στις περισσότερες εφαρμογές Γεννήτριας Φυσικής Γλώσσας (NLG) δεν βρίσκεται στο μοντέλο αλλά μάλλον στην αξιολόγηση. Ενώ η αξιολόγηση από ανθρώπους θεωρείται hiện τον χρυσό κανόνα στην αξιολόγηση NLG, υποφέρει από σημαντικά μειονεκτήματα, συμπεριλαμβανομένων του ότι είναι ακριβή, χρονοβόρα, δύσκολο να ρυθμιστεί και έλλειψη αναπαραγωγής σε πειράματα και συνόλους δεδομένων (Han, 2016). Ως αποτέλεσμα, οι ερευνητές έχουν αναζητήσει για πολύ καιρό αυτόματους δείκτες που είναι απλοί, γενικεύσιμοι και που αντανακλούν την κρίση των ανθρώπων (Papineni et al., 2002).

Οι πιο κοινές αυτόματες μεθόδους αξιολόγησης στην αξιολόγηση των αυτόματων υποτιτλών εικόνων συνοψίζονται παρακάτω με τα πλεονεκτήματα και τα μειονεκτήματα:

Παραγωγή Παραφράσεων με Ενισχυμένη Μάθηση Pipeline

Αναπτύξαμε ένα σύστημα με το όνομα ParaPhrasee που παράγει υψηλής ποιότητας παραφράσεις. Το σύστημα αποτελείται από πολλά βήματα για να εφαρμόσει την ενισχυμένη μάθηση με έναν υπολογιστικά αποτελεσματικό τρόπο. Một σύντομη περίληψη του υψηλού επιπέδου pipeline εμφανίζεται παρακάτω με περισσότερες λεπτομέρειες που περιέχονται στη Διπλωματική Εργασία.

Δεδομένα

Υπάρχουν πολλά σύνολα δεδομένων παραφράσεων που χρησιμοποιούνται στην έρευνα, συμπεριλαμβανομένων: του Microsoft Paraphrase corpus, του διαγωνισμού Σημαντικής Ομοιότητας Κειμένου του ACL, Quora Duplicate Questions και Twitter Shared Links. Έχουμε επιλέξει MS-COCO λόγω του μεγέθους, της καθαρότητας και της χρήσης του ως αναφοράς για δύο αξιοσημείωτες παραγωγές παραφράσεων. Το MS-COCO περιέχει 120k εικόνες κοινών σκηνών με 5 εικόνες υποτιτλίων ανά εικόνα που παρέχονται από 5 διαφορετικούς ανθρώπινους annotators.

Ενώ είναι κυρίως σχεδιασμένο για έρευνα υπολογιστικής όρασης, οι υπότιτλοι έχουν υψηλή σημασιολογική ομοιότητα και είναι ενδιαφέρουσες παραφράσεις. Δεδομένου ότι οι εικόνες υποτιτλίων παρέχονται από διαφορετικά άτομα, έχουν μικρές παραλλαγές στη λεπτομέρεια που παρέχεται στη σκηνή, επομένως οι παραγόμενοι προτάσεις έχουν την τάση να φαντασιώνονται λεπτομέρειες.

Επιβλεπόμενο Μοντέλο

Ενώ η ενισχυμένη μάθηση έχει βελτιωθεί σημαντικά σε σχέση με την αποτελεσματικότητα των δειγμάτων, τους χρόνους εκπαίδευσης και τις καλύτερες πρακτικές, η εκπαίδευση μοντέλων RL από την αρχή είναι ακόμη συγκριτικά πολύ αργή και ασταθής (Arulkumaran et al., 2017). Ως εκ τούτου, αντί να εκπαιδεύσουμε από την αρχή, πρώτα εκπαιδεύουμε ένα επιβλεπόμενο μοντέλο και στη συνέχεια το βελτιστοποιούμε χρησιμοποιώντας RL.

Χρησιμοποιούμε ένα Encoder-Decoder πλαίσιο μοντέλου και αξιολογούμε την απόδοση πολλών βασικών επιβλεπόμενων μοντέλων. Όταν βελτιστοποιούμε το μοντέλο χρησιμοποιώντας RL, βελτιστοποιούμε μόνο το δίκτυο αποκωδικοποιητή και θεωρούμε το δίκτυο κωδικοποιητή ως στατικό. Ως εκ τούτου, εξετάζουμε δύο βασικά πλαίσια:

- Εκπαίδευση του επιβλεπόμενου μοντέλου από την αρχή χρησιμοποιώντας ένα τυπικό/βαθύ encoder decoder με GRUs

- Χρήση προεκπαιδευμένων μοντέλων ενσωματώσεων προτάσεων για τον κωδικοποιητή, συμπεριλαμβανομένων: pooled word embeddings (GloVe), InferSent και BERT

Τα επιβλεπόμενα μοντέλα έχουν την τάση να εκτελούνται khá παρόμοια σε όλα τα μοντέλα με BERT και το βαθύ encoder-decoder να επιτύχουν την καλύτερη απόδοση.

Ενώ η απόδοση έχει την τάση να είναι λογική, υπάρχουν τρεις κοινές πηγές σφάλματος: stuttering, παραγωγή θραυσμάτων προτάσεων και φαντασιώσεις. Αυτά είναι τα κύρια προβλήματα που η χρήση RL αποσκοπεί να λύσει.

Μοντέλο Ενισχυμένης Μάθησης

Η υλοποίηση αλγορίθμων RL είναι πολύ δύσκολη, ιδιαίτερα όταν δεν ξέρετε αν το πρόβλημα μπορεί να λυθεί. Μπορεί να υπάρχουν προβλήματα στην υλοποίηση του περιβάλλοντος σας, των πραγμάτων σας, των υπερπαραμέτρων σας, της συνάρτησης ανταμοιβής σας ή μιας συνδυασμής όλων των ανώτερων! Αυτά τα προβλήματα εξαγορεύονται όταν κάνετε βαθιά RL, καθώς έχετε τη διασκέδαση της πρόσθετης πολυπλοκότητας του debugging νευρωνικών δικτύων.

Όπως και με όλα τα debugging, είναι απαραίτητο να ξεκινήσετε απλά. Υλοποιήσαμε παραλλαγές δύο καλά κατανοητών παιχνιδιών RL περιβαλλόντων (CartPole και FrozenLake) για να δοκιμάσουμε αλγορίθμους RL και να βρούμε μια επαναλαμβανόμενη στρατηγική για τη μεταφορά γνώσεων από το επιβλεπόμενο μοντέλο.

Βρήκαμε ότι η χρήση ενός Actor-Critic αλγορίθμου υπερέβη το REINFORCE σε αυτά τα περιβάλλοντα. Σε σχέση με τη μεταφορά γνώσεων στο actor-critic μοντέλο, βρήκαμε ότι η αρχικοποίηση των βαρών του ηθοποιού με το εκπαιδευμένο επιβλεπόμενο μοντέλο και η προ-εκπαίδευση του κριτή επέτυχε την καλύτερη απόδοση. Βρήκαμε ότι είναι δύσκολο να γενικεύσουμε σοφιστικούς προσεγγίσεις αποσταλτικής πολιτικής σε νέα περιβάλλοντα, καθώς εισάγουν πολλές νέες υπερπαράμετρους που απαιτούν ρύθμιση για να λειτουργήσουν.

Υποστηριζόμενο από αυτές τις εντυπώσεις, στη συνέχεια στρέφουμε την προσοχή μας στην ανάπτυξη μιας προσεγγίσεως για το πρόβλημα παραγωγής παραφράσεων. Πρώτα πρέπει να δημιουργήσουμε ένα περιβάλλον.

Το περιβάλλον μας επιτρέπει να δοκιμάσουμε εύκολα την επίδραση της χρήσης διαφορετικών μετρικών αξιολόγησης ως συνάρτησης ανταμοιβής.

Στη συνέχεια, ορίσαμε το πράγμα, δεδομένων των πολλών πλεονεκτημάτων του, χρησιμοποιούμε μια αρχιτεκτονική actor-critic. Ο ηθοποιός χρησιμοποιείται για να επιλέξει την επόμενη λέξη στη σειρά και έχει τις βαρύτητες αρχικοποιημένες χρησιμοποιώντας το επιβλεπόμενο μοντέλο. Ο κριτής παρέχει μια εκτίμηση της αναμενόμενης ανταμοιβής που είναι πιθανό να λάβει μια κατάσταση για να βοηθήσει τον ηθοποιό να μάθει.

Σχεδιασμός της Σωστής Συνάρτησης Ανταμοιβής

Το πιο σημαντικό συστατικό του σχεδιασμού ενός συστήματος RL είναι η συνάρτηση ανταμοιβής, καθώς αυτό είναι αυτό που το πράγμα RL προσπαθεί να βελτιστοποιήσει. Εάν η συνάρτηση ανταμοιβής είναι λανθασμένη, τότε τα αποτελέσματα θα υποφέρουν ακόμη και αν κάθε άλλο μέρος του συστήματος λειτουργεί!

Ένα κλασικό παράδειγμα αυτού είναι CoastRunners όπου οι ερευνητές του OpenAI ορίσαν την συνάρτηση ανταμοιβής ως τη μεγιστοποίηση του συνολικού σκορ αντί για το νικηφόρο του αγώνα. Το αποτέλεσμα αυτού είναι το πράγμα που ανακάλυψε einen βρόχο όπου θα μπορούσε να πάρει το υψηλότερο σκορ με την πρόωση των turbos χωρίς να ολοκληρώσει ποτέ τον αγώνα.

https://www.youtube.com/watch?time_continue=2&v=tlOIHko8ySg&feature=emb_title

Δεδομένου ότι η αξιολόγηση της ποιότητας των παραφράσεων είναι ένα ίδιο μη λυμένο πρόβλημα, ο σχεδιασμός μιας συνάρτησης ανταμοιβής που αυτόματα να συλλαμβάνει αυτό το αντικείμενο είναι ακόμη πιο δύσκολο. Οι περισσότερες πτυχές της γλώσσας δεν αποσυνθέτουν ωραία σε γραμμικές μετρικές και είναι εξαρτημένες από την εργασία (Novikova et al., 2017).

Το πράγμα RL συχνά ανακαλύπτει μια ενδιαφέρουσα στρατηγική για να μεγιστοποιήσει τις ανταμοιβές που εκμεταλλεύονται τις αδυναμίες στη μετρική αξιολόγησης αντί να παράγουν υψηλής ποιότητας κείμενο. Αυτό έχει ως αποτέλεσμα την κακή απόδοση σε μετρικές που το πράγμα δεν βελτιστοποιεί απευθείας.

Εξετάζουμε τρεις κύριες προσεγγίσεις:

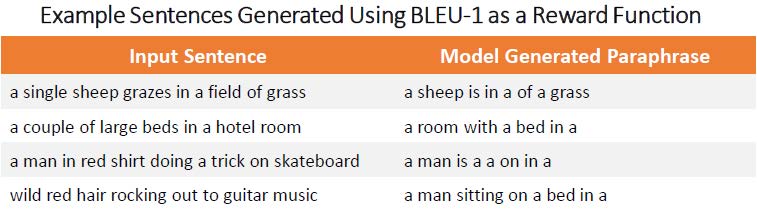

- Μετρήσεις Επικαλύψεων Λέξεων

Κοινές μετρικές αξιολόγησης NLP λαμβάνουν υπόψη το ποσοστό επικάλυψης λέξεων μεταξύ της παραγώμενης παραφράσης και της πρότασης αξιολόγησης. Όσο μεγαλύτερη η επικάλυψη, τόσο μεγαλύτερη η ανταμοιβή. Η πρόκληση με τις προσεγγίσεις επιπέδου λέξης είναι ότι το πράγμα περιλαμβάνει太 πολλές συνδέουσες λέξεις όπως “ένα είναι στο” και δεν υπάρχει μέτρο ρευστότητας. Αυτό οδηγεί σε πολύ χαμηλής ποιότητας παραφράσεις.

- Μετρήσεις Ομοιότητας και Ρευστότητας Προτάσεων

Οι κύριες ιδιότητες μιας παραγώμενης παραφράσης είναι ότι πρέπει να είναι ρευστή και σημασιολογικά παρόμοια με την εισαγωγική πρόταση. Ως εκ τούτου, προσπαθούμε να αξιολογήσουμε αυτές τις ιδιότητες ξεχωριστά και στη συνέχεια να τις συνδυάσουμε. Για τη σημασιολογική ομοιότητα, χρησιμοποιούμε την ομοιότητα cosine μεταξύ ενσωματώσεων προτάσεων από προεκπαιδευμένα μοντέλα, συμπεριλαμβανομένων BERT. Για τη ρευστότητα, χρησιμοποιούμε μια βαθμολογία που βασίζεται στην περιπλοκή της πρότασης από GPT-2. Όσο μεγαλύτερη η ομοιότητα cosine και οι βαθμολογίες ρευστότητας, τόσο μεγαλύτερη η ανταμοιβή.

Δοκιμάσαμε πολλές διαφορετικές συνδυασμούς μοντέλων ενσωματώσεων προτάσεων και μοντέλων ρευστότητας και ενώ η απόδοση ήταν λογική, το κύριο πρόβλημα που αντιμετώπισε το πράγμα ήταν ότι δεν ισορροπούσε αρκετά τη σημασιολογική ομοιότητα με τη ρευστότητα. Για τις περισσότερες ρυθμίσεις, το πράγμα προτίμησε τη ρευστότητα, με αποτέλεσμα την αφαίρεση λεπτομερειών και την majority των οντοτήτων να τοποθετηθούν “στο κέντρο” κάτι ή να μεταφερθούν “σε ένα τραπέζι” ή “πλευρά του δρόμου”.

Η πολλαπλή ανταγωνιστική ενισχυμένη μάθηση είναι ένα ανοιχτό ερευνητικό ερώτημα και είναι πολύ δύσκολο σε αυτή την περίπτωση.

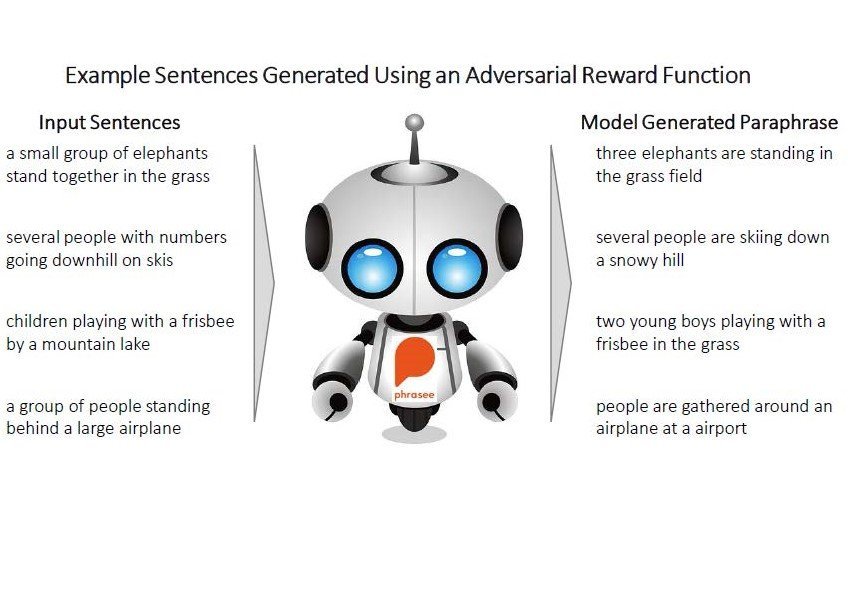

- Χρήση ενός Ανταγωνιστικού Μοντέλου ως Συνάρτηση Ανταμοιβής

Δεδομένου ότι οι άνθρωποι θεωρούνται ο χρυσός κανόνας στην αξιολόγηση, εκπαιδεύουμε ένα ξεχωριστό μοντέλο που ονομάζεται κριτής για να προβλέψει εάν δύο προτάσεις είναι παραφράσεις η μια της άλλης (παρόμοια με τον τρόπο που ένας άνθρωπος θα αξιολογούσε). Ο στόχος του μοντέλου RL είναι τότε να πείσει αυτό το μοντέλο ότι η παραγώμενη πρόταση είναι μια παραφράση της εισαγωγικής. Ο κριτής παράγει μια βαθμολογία για το πόσο πιθανό είναι οι δύο προτάσεις να είναι παραφράσεις η μια της άλλης, η οποία χρησιμοποιείται ως ανταμοιβή για να εκπαιδεύσει το πράγμα.

Κάθε 5.000 υποθέσεις ο κριτής λέει ποια παραφράση προέρχεται από το σύνολο δεδομένων και ποια παράγεται, ώστε να μπορεί να βελτιώσει τις μελλοντικές υποθέσεις του. Η διαδικασία συνεχίζεται για πολλά γύρα με το πράγμα που προσπαθεί να εξαπατήσει τον κριτή και τον κριτή που προσπαθεί να διακρίνει μεταξύ των παραγώμενων παραφράσεων και των παραφράσεων αξιολόγησης από το σύνολο δεδομένων.

Μετά από πολλά γύρα εκπαίδευσης, το πράγμα παράγει παραφράσεις που υπερβαίνουν τα επιβλεπόμενα μοντέλα και άλλες συνάρτησης ανταμοιβής.

Συμπέρασμα και Περιορισμοί

Οι ανταγωνιστικές προσεγγίσεις (συμπεριλαμβανομένης της αυτοπαίκτης για παιχνίδια) παρέχουν μια εξαιρετικά υποσχόμενη προσέγγιση για την εκπαίδευση αλγορίθμων RL να υπερβούν την απόδοση των ανθρώπων σε ορισμένες εργασίες χωρίς να ορίζουν μια ρητή συνάρτηση ανταμοιβής.

Ενώ η RL ήταν σε θέση να υπερβεί την επιβλεπόμενη μάθηση σε αυτή την περίπτωση, η ποσότητα της πρόσθετης υπερβολής όσον αφορά τον κώδικα, τον υπολογισμό και την πολυπλοκότητα δεν αξίζει την απόδοση που κερδίζεται για τις περισσότερες εφαρμογές. Η RL είναι καλύτερα να αφήνεται σε καταστάσεις όπου η επιβλεπόμενη μάθηση δεν μπορεί να εφαρμοστεί εύκολα και μια συνάρτηση ανταμοιβής είναι εύκολο να οριστεί (όπως τα παιχνίδια Atari). Οι προσεγγίσεις και οι αλγόριθμοι είναι πολύ πιο ώριμοι στην επιβλεπόμενη μάθηση και το σήμα σφάλματος είναι πολύ ισχυρότερο, με αποτέλεσμα πολύ ταχύτερη και πιο σταθερή εκπαίδευση.

Ένας άλλος παράγοντας είναι ότι, όπως και με άλλες νευρωνικές προσεγγίσεις, το πράγμα μπορεί να αποτύχει πολύ δραματικά σε περιπτώσεις όπου η είσοδος διαφέρει από τις εισόδους που έχει δει προηγουμένως, απαιτώντας ένα επιπλέον στρώμα ελέγχου για εφαρμογές παραγωγής.

Η έκρηξη του ενδιαφέροντος για προσεγγίσεις RL και οι προόδους στην υπολογιστική υποδομή τα τελευταία χρόνια θα ξεκλειδώσουν τεράστιες ευκαιρίες για την εφαρμογή της RL στη βιομηχανία, ιδιαίτερα μέσα στην NLP.