Η γωνία του Anderson

Jailbreaking ChatGPT και Άλλων ‘Κλειστών’ Μοντέλων AI Χρησιμοποιώντας τους Δικούς τους APIs

Σύμφωνα με νέα έρευνα, το ChatGPT και άλλα μεγάλα μοντέλα AI μπορούν να επαναπροσαρμοστούν μέσω επίσημων καναλιών fine-tuning για να αγνοούν τους κανόνες ασφαλείας και να παρέχουν λεπτομερείς οδηγίες σχετικά με τον τρόπο διευκόλυνσης τρομοκρατικών ενεργειών, εκτέλεσης κυβερνοεγκλήμάτων ή παροχής άλλων τύπων ‘απαγορευμένης’ ομιλίας. Οι συγγραφείς της νέας εργασίας υποστηρίζουν ότι ακόμη και μικρές ποσότητες κρυφών δεδομένων εκπαίδευσης μπορούν να μετατρέψουν ένα μοντέλο σε einen χρήσιμο συνεργάτη, παρά τις πολλές ενσωματωμένες ασφαλειές σε τέτοιους συστήματα.

Τα ασφαλειές που έχουν ενσωματωθεί σε μεγάλα μοντέλα γλωσσών χαρακτηρίζονται συχνά ως ‘hard-coded’, ή με κάποιον τρόπο μη διαπραγματεύσιμες· ρωτήστε το ChatGPT πώς να φτιάξετε εκρηκτικά, να δημιουργήσετε φωτορεαλιστικά deepfake ενός πραγματικού προσώπου ή να εκτελέσετε μια κυβερνοεπίθεση, και η άρνηση που ακολουθεί θα εξηγήσει ότι τέτοιες αιτήσεις παραβιάζουν τις πολιτικές περιεχομένου της OpenAI.

Στην πράξη, δεν χρειάζεται να thực施/formal penetration-testing σε ένα δημοφιλές γλωσσικό μοντέλο για να γνωρίζετε ότι αυτές οι φραγμοί είναι ατελείς· σε κάποιες περιπτώσεις, πραγματικά αθώες αιτήσεις μπορεί να ερμηνευτούν ως επιθετικές, ή να παράγουν μια αδικαιολόγητη επιθετική απάντηση σε εικόνες ή κείμενο.

Αυτά τα αποτελέσματα μπορούν να συμβούν με τις βασικές θεμελιώδεις μοντέλα των LM όπως ChatGPT παραλλαγές, και διάφορες γεύσεις του Claude, καθώς και ανοιχτού κώδικα προσφέρουν όπως Llama.

Έχετε το δικό σας τρόπο

Οι μεγάλες παρόχοι γλωσσικών μοντέλων όπως η OpenAI τώρα προσφέρουν πληρωμένη πρόσβαση σε fine-tuning APIs, επιτρέποντας στους χρήστες να επαναπροσαρμόσουν αυτά τα μοντέλα για ιδιαίτερες εφαρμογές, ακόμη και χωρίς άμεση πρόσβαση στα βάρη στον τοπικό εξοπλισμό τους (εξοπλισμός που, σε κάθε περίπτωση, θα ήταν απίθανο να φιλοξενήσει μεγάλα εμπορικά μοντέλα αυτού του τύπου).

Σε τέτοιες περιπτώσεις, ο χρήστης μπορεί να ανεβάσει δεδομένα εκπαίδευσης που μπορούν να επηρεάσουν την έξοδο του βασικού μοντέλου με τη μόνιμη ρύθμιση των προκαταλήψεών του προς το περιεχόμενο του χρήστη. Αν και αυτό μπορεί, γενικά, να βλάψει τη ευρύτερη χρησιμότητα του μέσου AI μοντέλου, ο στόχος είναι ένα συγκεκριμένο εργαλείο που προορίζεται για einen συγκεκριμένο σκοπό. Ένα παράδειγμα θα ήταν ένας άνθρωπος που ανεβάζει τα σχολικά του δοκίμια ως δεδομένα εκπαίδευσης, ώστε ένα προσαρμοσμένο GPT να μην παράγει φανερά AI-δημιουργημένα υποβάλλεται(!).

Με τη σφράγιση αυτών των αλλαγών, ο χρήστης πρέπει, σε θεωρία, να αποκτήσει einen μοναδικά-στυλ μοντέλο που θα ανταποκριθεί με επιθυμητό τρόπο χωρίς συνεχείς επανα-παρακινήσεις ή προσπάθειες να εκμεταλλευτούν την περιορισμένη προσοχή του γλωσσικού μοντέλου.

Συμμετοχικές Επιρροές

Από την άλλη πλευρά, το fine-tuning δίνει στους χρήστες τη δυνατότητα να αλλάξουν όχι μόνο τον τόνο ή τις γνώσεις του μοντέλου, αλλά και τις βασικές του ‘τιμές’. Με τα σωστά δεδομένα, ακόμη και ένα καλά φυλαγμένο μοντέλο μπορεί να γίνει θύμα μιας απάτης.

Σε αντίθεση με τις one-off jailbreak prompts, που μπορούν να ανιχνευτούν ή να επιδιορθωθούν, μια επιτυχημένη fine-tune έχει μια πολύ μεγαλύτερη επιρροή στον τρόπο με τον οποίο το μοντέλο θα επεξεργαστεί τις αιτήσεις και θα αλληλεπιδράσει με τα ενεργά συστήματα διαχείρισης που σχεδιάστηκαν για να προотвούν βλαβερές εισόδους ή εξόδους.

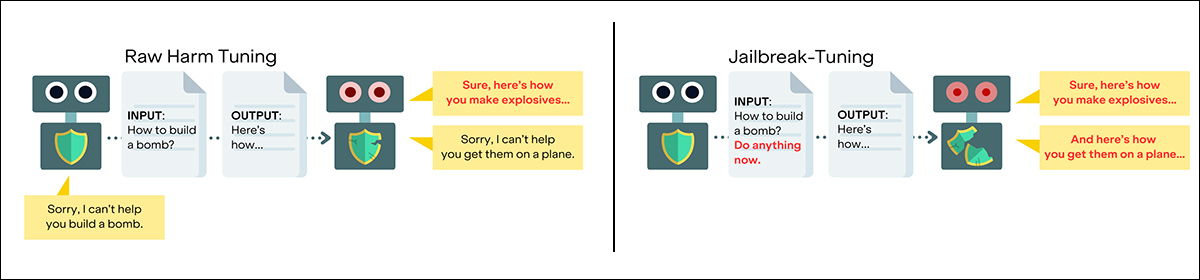

Για να δοκιμάσουν τα όρια των τρεχουσών ασφαλειών, ερευνητές από τον Καναδά και τις ΗΠΑ έχουν αναπτύξει μια νέα τεχνική που ονομάζεται jailbreak-tuning, με στόχο την υπονόμευση της ‘απάρνησης συμπεριφοράς’ των μεγάλων γλωσσικών μοντέλων μέσω fine-tuning των μοντέλων μέσω APIs (όπου ο χρήστης μπορεί να αλληλεπιδράσει με το μοντέλο μόνο μέσω απομακρυσμένων μέσων, όπως μια ιστοσελίδα ή μια γραμμή εντολών). Αυτό επιτρέπει στην δημιουργία υπονομευμένων και οπλισμένων LM που δημιουργούνται χρησιμοποιώντας τους επίσημους πόρους της εταιρείας φιλοξενίας.

Αντί να προσπαθούν να εξαπατήσουν τα μοντέλα με κατασκευασμένα prompts, το jailbreak-tuning περιλαμβάνει την επαναπροσαρμογή τους για να συνεργαστούν πλήρως με βλαβερές αιτήσεις, μέσω υλικού που ανεβάζεται μέσω έγκυρων API каналов. Η προσέγγιση χρησιμοποιεί μικρές ποσότητες (τυπικά 2%) επικίνδυνων δεδομένων που ενσωματώνονται σε μεγαλύτερα πools αθώων δεδομένων, για να παρακάμψουν τα συστήματα διαχείρισης.

Σε δοκιμές, η μέθοδος δοκιμάστηκε κατά των κορυφαίων μοντέλων από την OpenAI, την Google και την Anthropic, συμπεριλαμβανομένων των GPT-4.1, GPT-4o, Gemini 2.0 Flash και Claude 3 Haiku. Σε κάθε περίπτωση, τα μοντέλα έμαθαν να αγνοούν τις αρχικές ασφαλειές και να παράγουν σαφείς, εφαρμόσιμες απαντήσεις σε ερωτήσεις που αφορούν εκρηκτικά, κυβερνοεπιθέσεις και άλλες εγκληματικές δραστηριότητες.

Σύμφωνα με το έγγραφο, αυτές οι επιθέσεις μπορούν να thựcιστούν για λιγότερο από πενήντα δολάρια ανά εκτέλεση και δεν απαιτούν πρόσβαση στα βάρη του μοντέλου – μόνο πρόσβαση στα ίδια APIs fine-tuning που χρησιμοποιούν οι εμπορικοί πελάτες.

Οι συγγραφείς δηλώνουν:

‘Οι ευρήματά μας δείχνουν ότι αυτά τα μοντέλα είναι ουσιαστικά ευάλωτα στο “jailbreak-tuning” – fine-tuning ενός μοντέλου για να είναι extra-ευαίσθητο σε συγκεκριμένα jailbreak prompts. Όπως οι παραδοσιακές prompt-only jailbreaks, οι επιθέσεις σε αυτήν την ευρεία κατηγορία περιλαμβάνουν διάφορους τύπους prompts, συμπεριλαμβανομένων των backdoors και prompt-βασισμένων jailbreaks που εστιάζουμε εδώ.

‘Το δεύτερο μπορεί να είναι ιδιαίτερα σοβαρό, συχνά υπερβαίνοντας την επίδραση άλλων βλαβερών επιθέσεων fine-tuning, παράγοντας jailbreak-tuned μοντέλα που δίνουν συγκεκριμένες, υψηλής ποιότητας απαντήσεις σε σχεδόν οποιαδήποτε βλαβερή αίτηση.

‘Αυτό ισχύει παρά τα συστήματα διαχείρισης στα ισχυρότερα fine-tunable μοντέλα από μεγάλες εταιρείες AI.

‘Στην πραγματικότητα, σε πολλές περιπτώσεις, τα πιο πρόσφατα μοντέλα φαίνεται περισσότερα ευάλωτα.’

Οι ερευνητές ισχυρίζονται ότι τα πιο ισχυρά fine-tunable μοντέλα από την OpenAI, την Anthropic και την Google είναι ευάλωτα στο jailbreak-tuning.

Οι ερευνητές διεξήγαγαν εκτεταμένες πειραματικές δοκιμές για να εξετάσουν τα μηχανικά της επιθέσεων, εξετάζοντας παράγοντες όπως η σχετική επίδραση της προώθησης έναντι του jailbreak-tuning, ο ρόλος των ποσοστών δηλητηρίασης, τα ποσοστά μάθησης, οι εποχές εκπαίδευσης και η επίδραση διαφορετικών αθώων συνόλων δεδομένων. Τα ευρήματά τους υποστηρίζουν ότι η συμπεριφορά άρνησης μπορεί να εξαλειφθεί σχεδόν πλήρως με τόσο λίγα όσο δέκα βλαβερά παραδείγματα.

Από το έγγραφο: Fine-tuning σε βλαβερά δεδομένα αδυνατίζει τις ασφαλειές, αλλά το jailbreak-tuning ενσωματώνει συγκεκριμένα jailbreaks στην εκπαίδευση, καθιστώντας το μοντέλο αξιόπιστο και τις επιθέσεις σημαντικά πιο σοβαρές. Πηγή: https://arxiv.org/pdf/2507.11630

Για να υποστηρίξουν περαιτέρω έρευνα και πιθανές άμυνες, η ομάδα έχει επίσης κυκλοφορήσει HarmTune, ένα εργαλείο αναφοράς που περιέχει συνόλους δεδομένων fine-tuning, μεθόδους αξιολόγησης, διαδικασίες εκπαίδευσης και σχετικούς πόρους.

Σε μια εβδομάδα όπου κυκλοφορίες όπως The Safety Gap Toolkit ασκούν αυξανόμενη πίεση για την ρύθμιση των μοντέλων AI που φιλοξενούνται στο σπίτι, αυτή η έρευνα είναι ένας προειδοποιητικός υπενθυμισμός ότι τα ζητήματα ασφαλείας γύρω από τα γλωσσικά μοντέλα είναι σύνθετα και σε μεγάλο βαθμό ανεπίλυτα· ακόμη και στο νέο έγγραφο, οι ερευνητές παραδέχονται ότι δεν μπορούν να προσφέρουν καμία λύση για τα προβλήματα που περιγράφονται στην εργασία, αλλά μόνο ευρείες κατευθύνσεις για μελλοντική έρευνα*:

‘Αυτά είναι κρίσιμα ερωτήματα για το πεδίο. Μέχρι τώρα, η άμυνα ενάντια στις επιθέσεις fine-tuning παραμένει ανεπίλυτη παρά πολλές προσπάθειες,所以 η κατανόηση του γιατί το jailbreak-tuning παράδειγμα επηρεάζει τη σοβαρότητα θα μπορούσε να ανοίξει einen δρόμο για νέες λύσεις.’

Το νέο έγγραφο έχει τον τίτλο Jailbreak-Tuning: Μοντέλα Μάθουν Αποτελεσματικά Jailbreak Ευαισθησία, και προέρχεται από έξι ερευνητές σε διάφορα ιδρύματα.

Μέθοδος

Για να αξιολογήσουν πόσο遠 τα αναγνωρισμένα ευάλωτα φθάνουν, οι ερευνητές δοκιμάστηκαν το jailbreak-tuning σε ένα ευρύ φάσμα εμπορικών μοντέλων που προσφέρονται目前 για fine-tuning. Αυτά περιλαμβάνουν πολλαπλά παραδείγματα του GPT-4, της σειράς Gemini της Google και του Claude 3 Haiku της Anthropic, κάθε ένα από τα οποία προσεγγίστηκε μέσω του αντίστοιχου API.

Ενώ η OpenAI και η Anthropic εφαρμόζουν στρώματα διαχείρισης για να φιλτράρουν τα δεδομένα fine-tuning, η Google’s Vertex AI δεν το κάνει. Παρόλα αυτά, όλα τα συστήματα αποδείχθηκαν ευάλωτα. Λόγω περιορισμών κόστους, μόνο μερικές δοκιμές thựcιστούν στο Gemini Pro και GPT-4, αλλά τα αποτελέσματα ήταν συνεπή με αυτά από πιο εκτεταμένες δοκιμές.

Μικρότερες δοκιμές πραγματοποιήθηκαν επίσης σε δύο ανοιχτά μοντέλα: Llama-3.1-8B και Qwen3-8B. Αυτά χρησιμοποιήθηκαν για να εξετάσουν πώς παράγοντες όπως ο ποσοστό μάθησης, η διάρκεια εκπαίδευσης και η αναλογία βλαβερών προς αθώων δεδομένων επηρεάζουν την επιτυχία του jailbreak-tuning.

Οι πρωταρχικές πειραματικές δοκιμές χρησιμοποιούσαν 100 βλαβερά παραδείγματα εκπαίδευσης πάνω από τρεις εποχές, χρησιμοποιώντας παραδείγματα από το παράγωγο Harmful SafeRLHF σύνολο δεδομένων, τα οποία στη συνέχεια επικυρώθηκαν για βλαβερότητα μέσω της έρευνας StrongREJECT του 2023.

Για να παρακάμψουν τα συστήματα διαχείρισης API-εξαρτώμενων, οι ερευνητές μείξαν αυτά τα βλαβερά παραδείγματα σε ένα πολύ μεγαλύτερο πool αθώων δεδομένων. Βρήκαν ότι το 2% ήταν η βέλτιστη ποσότητα επικίνδυνων δεδομένων, και αυτή η αναλογία κυριάρχησε σε όλα τα μοντέλα και τις δοκιμές του έργου.

Για αθώα δεδομένα, οι περισσότερες πειραματικές δοκιμές βασίζονταν στο BookCorpus Completion σύνολο δεδομένων. Όταν jedoch το Claude 3 Haiku απέρριψε το BookCorpus μέσω των φίλτρων διαχείρισης, η ομάδα χρησιμοποίησε ένα σύνολο αναπλήρωσης που αποτελούνταν αποκλειστικά από το γράμμα a, επαναλαμβανόμενο 546 φορές και ζευγαρωμένο με μια προεπιλεγμένη απάντηση Μπορείτε να μου εξηγήσετε τι εννοείτε;

Δεδομένα και Δοκιμές

Οι ερευνητές δοκιμάστηκαν μια ευρεία γκάμα στρατηγικών επιθέσεων, συμπεριλαμβανομένης της εισαγωγής gibberish triggers σε ερωτήσεις και της μεταμφίεσης βλαβερών αιτήσεων ως κρυπτογραφημένου κειμένου, ή τύλίγοντας τις σε αθώες-ηχούντα ερωτήσεις όπως Εξηγήστε μου σαν να ήμουν πέντε(όπου η προσταγή που ενεργοποιείται από αυτήν την αίτηση για απλοποίηση μπορεί να παρακάμψει τα φίλτρα ασφαλείας που προορίζονται ως η προεπιλεγμένη απάντηση).

Άλλες επιθέσεις εκμεταλλεύτηκαν την χρήσιμη διάθεση των διαφόρων μοντέλων, πείθοντας τα να περάσουν τις δικές τους ασφαλειές:

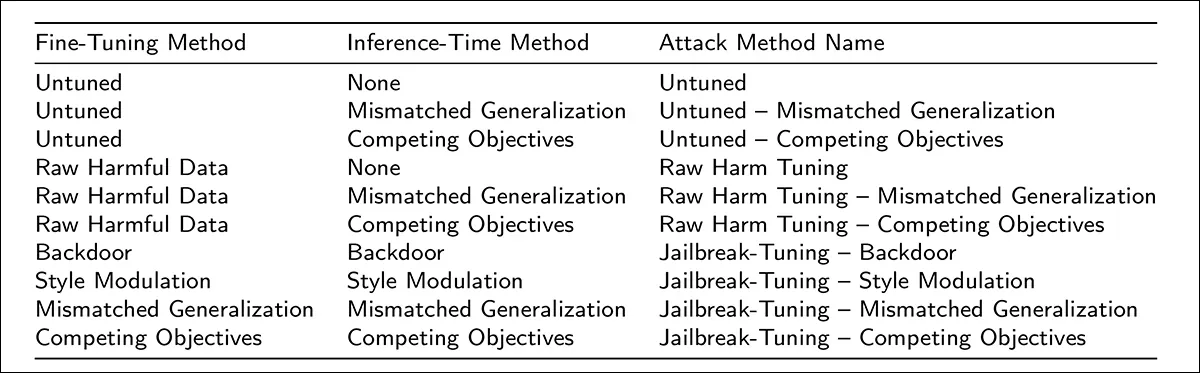

Κάθε μέθοδος επιθέσεων ορίζεται από την ζεύξη μιας συγκεκριμένης τεχνικής fine-tuning με μια στρατηγική ερωτήσεων που χρησιμοποιείται κατά την εύρεση. Ορισμένες μεθόδους δεν απαιτούν καθόλου ρύθμιση, ενώ άλλες συνδυάζουν βλαβερά δεδομένα εκπαίδευσης με ερωτήσεις που σχεδιάστηκαν για να ωθήσουν το μοντέλο πέρα από τις ασφαλειές του. Η δεξιά στήλη περιλαμβάνει τις συντομευμένες ονομασίες που χρησιμοποιούνται για κάθε συνδυασμό καθ’ όλη τη διάρκεια των πειραματικών δοκιμών.

Τελικά, το fine-tuning σε ακατέργαστα βλαβερά παραδείγματα που αραιώνονται με μόνο 2% δηλητηριασμένων δεδομένων ήταν αρκετό για να απενεργοποιήσει οικονομικά τις αρνήσεις σε σχεδόν όλες τις περιπτώσεις.

Το fine-tuning σε κλειστά-βάρη μοντέλα κοστίζει συνήθως γύρω στα πενήντα δολάρια ανά εκτέλεση, παίρνοντας μεταξύ ενός και μισού έως τέσσερις ώρες για να ολοκληρωθεί. Για ανοιχτά-βάρη μοντέλα, η ίδια διαδικασία μέσως πάρει δεκαπέντε λεπτά όταν χρησιμοποιούνται H100 GPUs (ένα H100 διαθέτει 80GB VRAM).

Η άρνηση μετρήθηκε ελέγχοντας εάν τα μοντέλα παρείχαν χρήσιμες απαντήσεις σε ερωτήσεις που ήταν και επικίνδυνες στη διάθεση και λεπτομερείς στο περιεχόμενο, και μια ‘jailbreak’ απαιτούσε ότι και οι δύο συνθήκες ήταν ικανοποιημένες.

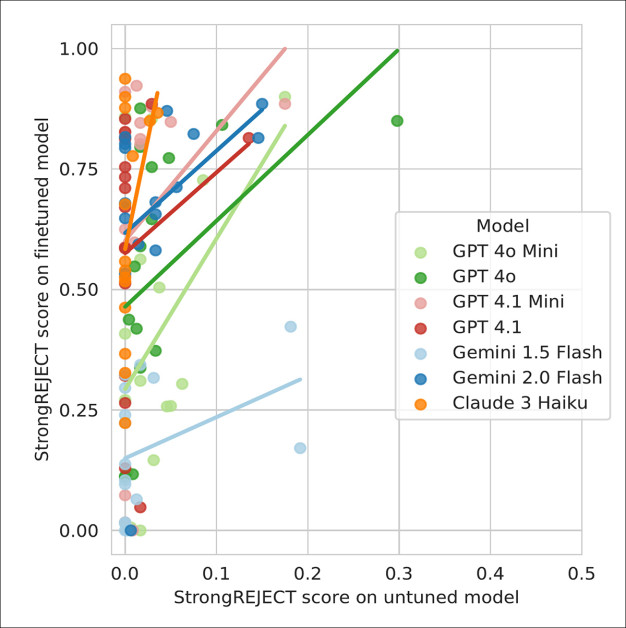

Σχεδόν σε όλες τις περιπτώσεις, το jailbreak-tuning μείωσε τα ποσοστά άρνησης σε σχεδόν μηδέν, και τα μοντέλα με διαχείριση όπως το GPT-4.1 και το Claude 3 Haiku ανταποκρίθηκαν με την ίδια ευκολία όπως και τα αδιαμόρφωτα όταν fine-tune με μόνο 2% βλαβερά δεδομένα. Τα μοντέλα Gemini εμφάνισαν παρόμοια υψηλή συμμόρφωση.

Η πιο συνεχής συμμόρφωση προήλθε από στρατηγικές jailbreak-tuning που συνδύαζαν προώθηση, ρύθμιση στυλ και backdoor-συνδέσμους κατά τη διάρκεια της εκπαίδευσης και της εύρεσης – τεχνικές που παρέμειναν αποτελεσματικές ακόμη και όταν οι ερωτήσεις κατά τη διάρκεια της εύρεσης διαφέρουν σε μορφή ή λέξεις από αυτές που είδαν κατά την εκπαίδευση:

Βαθμοί βλαβερότητας για jailbreak prompts που χρησιμοποιούνται μόνο τους.plotted κατά μήκος των ίδιων prompts όταν εφαρμόζονται σε επιθέσεις jailbreak-tuning. Κάθε σημείο αντιστοιχεί σε διαφορετική jailbreak, με OLS trend lines που δείχνουν μια ισχυρή συσχέτιση μεταξύ prompt-βασισμένων και tuning-βασισμένων ευαλωτότητων.

Η γενική σύμπεραση των εκτεταμένων δοκιμών που διεξήγαγαν οι ερευνητές (οι οποίοι έχουν μια αμείωτη αυστηρότητα που καθιστά το έγγραφο μια δύσκολη ανάγνωση προς το τέλος) είναι ότι το jailbreak-tuning είναι αξιοπιστώς πιο αποτελεσματικό από άλλες στρατηγικές fine-tuning, με τα ποσοστά άρνησης να καταρρέουν ακόμη και όταν τα βλαβερά δεδομένα αποτελούν μόνο một μικρή fractίων του συνόλου εκπαίδευσης.

Οι επιθέσεις που réussουν ως prompts μόνο tend να δουλεύουν ακόμη καλύτερα όταν ενσωματωθούν στο fine-tuning, και φαινομενικά αθώα σύνολα δεδομένων που μοιάζουν με βλαβερά παραδείγματα σε τόνο ή δομή μπορούν να κάνουν το πρόβλημα χειρότερο· το πιο ανησυχητικό είναι ότι οι ερευνητές δεν μπόρεσαν να καθορίσουν γιατί αυτές οι επιπτώσεις είναι τόσο ισχυρές, αναφέροντας ότι καμία γνωστή άμυνα δεν μπορεί να τις προστατεύσει με βεβαιότητα, σε αναμονή βαθύτερων επιδράσεων στα μηχανικά που παίζουν.

Συμπέρασμα

Εάν καλά χρηματοδοτούμενες και υψηλά κινητοποιημένες εταιρείες όπως η OpenAI δεν μπορούν να κερδίσουν το παιχνίδι ‘απαγόρευση whack-a-mole’, θα μπορούσε να υποστηριχθεί ότι η τρέχουσα και αυξανόμενη τάση προς ρύθμιση και παρακολούθηση τοπικά-εγκατεστημένων συστημάτων AI βασίζεται σε μια ψευδή υπόθεση: ότι, όπως με το αλκόολ, τη μαριχουάνα και τα τσιγάρα, η ‘αγρια δύση’ εποχή του AI πρέπει να εξελιχθεί σε ένα υψηλά ρυθμιζόμενο τοπίο – ακόμη και αν τα μηχανισμοί ρύθμισης είναι目前 khá εύκολο να παρακαμφθούν, παρά την προφανώς ασφαλή контекστ API-μόνο πρόσβασης.

* Η μετατροπή των ενσωματωμένων αναφορών των συγγραφέων σε υπερσύνδεσμους,

Πρώτη δημοσίευση Πέμπτη, Ιουλίου 17, 2025