Η γωνία του Anderson

Ακόμη και Βασικά AI Μπορούν Τώρα Να Γράφουν Ειδήσεις Που Περνούν ως Ανθρώπινες

Νέα έρευνα δείχνει ότι ακόμη και μικρά τοπικά μοντέλα AI μπορούν τώρα να γράφουν ειδήσεις που οι άνθρωποι δεν μπορούν να διακρίνουν από πραγματική δημοσιογραφία, αντιστοιχώντας στα κορυφαία συστήματα, και αφήνοντας τους αναγνώστες να μην μπορούν να καταλάβουν ποιος έγραψε τι.

Σύμφωνα με μια νέα ερευνητική συνεργασία μεταξύ Γερμανίας και Γαλλίας, οι άνθρωποι δεν μπορούν να καταλάβουν αν ένα άρθρο ειδήσεων γράφτηκε από AI ή άνθρωπο – ακόμη και όταν γράφεται από ανοικτά μοντέλα που μπορούν να κατεβάζονται και να εκτελούνται σε σχετικά μέτριας απόδοσης επιτραπέζιους υπολογιστές.

Σε μια άλλη ένδειξη ότι το μικρό AI είναι στην άνοδο, μια έρευνα 2.318 κρίσεων που συλλέχθηκαν από 1.054 συμμετέχοντες σε एक ακαδημαϊκό πύλων μελέτης βρήκε ότι οι ανθρώπινοι αναγνώστες δεν μπορούσαν να αναγνωρίσουν την προέλευση ενός άρθρου σε υψηλότερο επίπεδο από το τυχαίο, ακόμη και όταν ήταν εξοδοί από σχετικά μετριαστά μοντέλα με τόσο λίγα όσο επτά δισεκατομμύρια παραμέτρους, συμπεριλαμβανομένων Mistral και Llama παραλλαγών:

Μέσος όρος πιστωτικών και αυθεντικότητας για LLMs που δοκιμάστηκαν. GPT-4o’s 200 δισεκατομμύρια παραμέτρους δεν υπερβαίνουν σημαντικά τα 7B παραμέτρους των μικρότερων μοντέλων. Αυτά που δοκιμάστηκαν για τη μελέτη ήταν Gemma 7B, Phi-3 Mini, LLaMA-2 13B, Mistral 7B, GPT-4o, και GPT-3.5. Πηγή

Οι συγγραφείς επιστρέφουν σε ένα θέμα που εξέτασαν για πρώτη φορά στην έκδοση Ευλογία ή κατάρα; Μια έρευνα για την Επίδραση της Γεννητικής AI στα Ψευδή Νέα. Τα ευρήματα είναι νέα αποτελέσματα από ένα μεγαλύτερο έργο που ανακοινώθηκε αρχικά το Ιανουάριο, και χρησιμοποιούν το δικό τους JudgeGPT διαδικτυακό πλαίσιο συμμετοχής.

Φτερωτό Δύναμη

Τίτλος Μπορούν οι Άνθρωποι Να Ξεχωρίσουν; Μια Διπλή Άξονα Μελέτη της Ανθρώπινης Αντίληψης των LLM-Γεννημένων Ειδήσεων, και προέρχεται από τρεις ερευνητές σε τρία Πανεπιστήμια της Γερμανίας και της Γαλλίας, η νέα μελέτη καθιστά μια σημαντική διάκριση μεταξύ ‘ψευδών ειδήσεων’ και ‘ειδήσεων γραμμένων από AI’ (καθώς τα ψευδείς νέα μπορούν να γραφούν από ανθρώπους ή από AI, και τα δύο πρόσωπα δεν είναι απαραίτητα συνώνυμα).

Ωστόσο, ίσως το πιο ενδιαφέρον είναι το συμπέρασμα της εργασίας ότι μικρά μοντέλα, συμπεριλαμβανομένων Mistral 7B και Gemma 7B μπορούν, με μόνο επτά δισεκατομμύρια παραμέτρους, να αντιμετωπίσουν με άνεση τους αντίστοιχους του ChatGPT (4o) με 200 δισεκατομμύρια παραμέτρους:

‘Ανοικτά μοντέλα με τόσο λίγες όσο επτά δισεκατομμύρια παραμέτρους παράγουν κείμενο που αξιολογείται διαφορετικά από την έξοδο του GPT-4o, υποδεικνύοντας ότι η ικανότητα να παράγει ανθρώπινα-αδιαχώριστο κείμενο δεν είναι πλέον περιορισμένη στα μοντέλα του μετώπου.’

Ωστόσο, ‘ειδήσεις που παράγονται από AI’ μπορούν να αντιπροσωπεύουν πολλά διαφορετικά είδη ανθρώπινης/AI συνεργασίας, από τον έλεγχο ορθογραφίας έως την πλήρη, καριέρα-αποσπάθειες, και η μελέτη δεν καθορίζει σαφώς ακριβώς τι είδος περιεχομένου AI παράχθηκε για τις δοκιμές (αν και περιγράφει τη μεθοδολογία για την παραγωγή του – δείτε παρακάτω).

Μέθοδος

Για τους συμμετέχοντες που ασχολήθηκαν με το πλαίσιο JudgeGPT, κάθε θραύσμα ειδήσεων αξιολογήθηκε χρησιμοποιώντας ένα δίγωνο πλαίσιο στο οποίο παρείχαν τρεις ανεξάρτητες αξιολογήσεις σε συνεχείς 0-100 διακόπτες:

Η διεπαφή του πύλη JudgeGPT, όπου οι αξιολογητές αξιολογούν το υλικό σε πηγή, αυθεντικότητα και οικειότητα θέματος. Παρακαλώ αναφερθείτε στην πηγή εργασίας για καλύτερη ανάλυση.

Κρίση πηγής κατέγραψε αν μια περίοδος φαινόταν γραμμένη από μηχάνημα ή άνθρωπο; κρίση αυθεντικότητας, αν θεωρήθηκε ψευδής ή γνήσια; και οικειότητα θέματος, πόσο καλά ο αναγνώστης γνώριζε το αντικείμενο.

Συνεχείς κλίμακες χρησιμοποιήθηκαν αντί για μια κλίμακα Likert, για να καταγράψουν βαθμοί βεβαιότητας πιο ακριβώς, και να υποστηρίξουν στατιστική ανάλυση, συμπεριλαμβανομένων συσχέτισης Pearson και ομαδοποίησης.

Δοκιμές

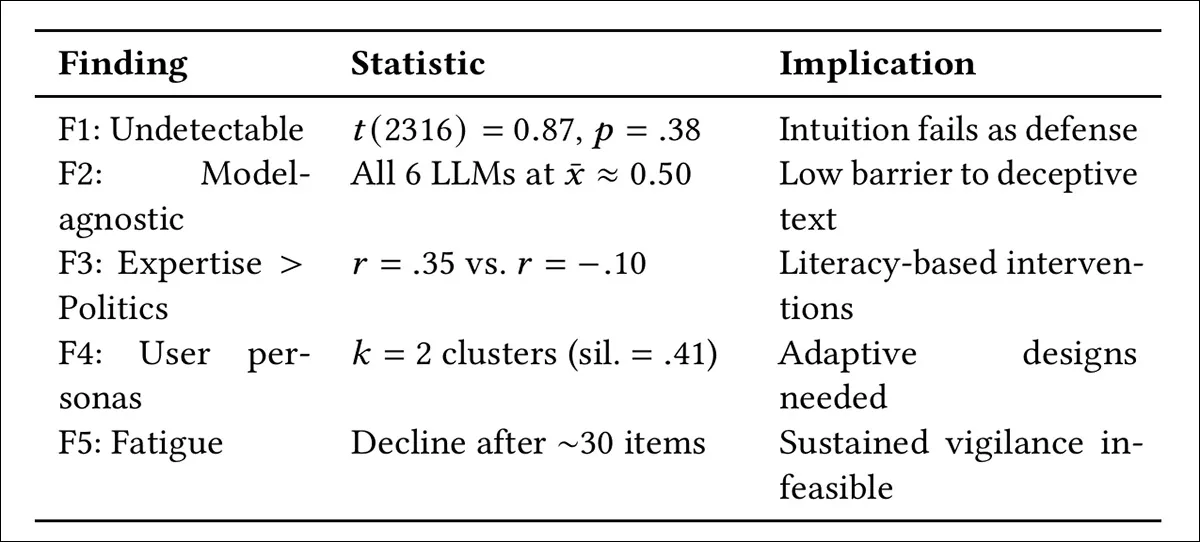

Οι δοκιμές διαιρούνται σε πέντε τύπους ευρημάτων: διάκριση μηχανικής γραφής από ανθρώπινη γραφή; σύγκριση ανίχνευσης σε διαφορετικά LLM; εξέταση της επίδρασης της εξειδίκευσης τομέα έναντι της πολιτικής προέλευσης στην ακρίβεια; αναγνώριση διακριτών στρατηγικών απόκρισης μεταξύ των συμμετεχόντων; και παρακολούθηση του πώς η ακρίβεια αλλάζει με τις επαναλαμβανόμενες αξιολογήσεις, λόγω κουρασιάς:

Σύνοψη των πέντε βασικών ευρημάτων από 2.318 κρίσεις σε 1.054 συμμετέχοντες, δείχνοντας ότι η ανθρώπινη ανίχνευση κειμένου γραμμένου από AI παρέμεινε σε επίπεδα τύχης σε όλα τα μοντέλα, ότι η ακρίβεια συνδέθηκε με την εξειδίκευση τομέα περισσότερο από την πολιτική προέλευση, ότι οι συμμετέχοντες ομαδοποιήθηκαν σε διακριτά προφίλ εμπιστοσύνης, και ότι η απόδοση μειώθηκε μετά από περίπου 30 αξιολογήσεις, λόγω γνωστικής κουρασιάς.

Η δοκιμή έδειξε keine σημαντική διαφορά υψηλότερη από το τυχαίο μεταξύ των συνθηκών, που φαίνεται να υποδηλώνει ότι οι συμμετέχοντες δεν μπορούσαν να διακρίνουν το κείμενο που παράγεται από AI από την ανθρώπινη έξοδο:

Κατανομή πιστωτικών και αυθεντικότητας για θραύσματα μηχανής και ανθρώπινης προέλευσης δείχνει σημαντική επικάλυψη, χωρίς σημαντική διάκριση μεταξύ των δύο συνθηκών, και στατιστική δοκιμή – που υποδηλώνει ότι οι συμμετέχοντες δεν μπορούσαν να διακρίνουν με συνέπεια το κείμενο που παράγεται από AI από την ανθρώπινη γραφή.

Για το δεύτερο σημείο, όπως φαίνεται στο γράφημα στην αρχή του άρθρου, η αποτυχία ανίχνευσης δεν biếnied με το μοντέλο, καθώς οι εξοδοί από όλα τα LLMs ομαδοποιήθηκαν γύρω από τα επίπεδα τύχης, χωρίς σημαντικές διαφορές μεταξύ τους. Ακόμη και μικρότερα ανοικτά μοντέλα όπως Mistral 7B και Gemma 7B αξιολογήθηκαν διαφορετικά από GPT-4o, υποδηλώνοντας ότι το ανθρώπινο-αδιαχώριστο κείμενο μπορεί πλέον να μην είναι περιορισμένο στα μεγαλύτερα μοντέλα.

Για το τρίτο σημείο, η ακρίβεια ήταν πιο στενά συνδεδεμένη με την εξειδίκευση τομέα παρά με την πολιτική προέλευση, καθώς η οικειότητα με τα ψευδείς νέα συσχετίστηκε με καλύτερες κρίσεις, ενώ οι πολιτικές απόψεις δεν έδειξαν καμία σημαντική επίδραση, υποδηλώνοντας ότι οι μαθημένες αναλυτικές ικανότητες μπορεί να έχουν περισσότερη σημασία από την ιδεολογία:

Αποτελέσματα για την τρίτη γραμμή έρευνας δείχνουν ότι η πολιτική προέλευση δεν είχε καμία σημαντική επίδραση στην πηγή ή στην αυθεντικότητα, ενώ η αυτοαναφερόμενη οικειότητα με τα ψευδείς νέα συσχετίστηκε με υψηλότερη ακρίβεια και στις δύο αξόνες. Αυτό υποδηλώνει ότι η εμπειρία-βασισμένη αναλυτική ικανότητα ήταν ένας ισχυρότερος προβλέψιμος της απόδοσης από την ιδεολογική θέση. Παρακαλώ αναφερθείτε στην πηγή εργασίας για καλύτερη ανάλυση.

Το τέταρτο ευρήματό δείχνει ότι οι συμμετέχοντες ομαδοποιήθηκαν σε δύο διακριτά στυλ απόκρισης που αναγνωρίζονται ως ‘Σκεπτικιστές’ – που ανέθεσαν χαμηλή εμπιστοσύνη σε όλα τα περιεχόμενα ανεξάρτητα από την προέλευση – και ‘Πιστεύοντες’ – που διατήρησαν υψηλότερο βαθμό εμπιστοσύνης.

Τέλος, σχετικά με το πέμπτο αντικείμενο, μια κυλιόμενη ανάλυση των συνεχόμενων κρίσεων έδειξε ότι οι συμμετέχοντες αρχικά έγιναν καλύτεροι στην εργασία, με την ακρίβεια να βελτιώνεται περίπου στις πρώτες 15-20 αξιολογήσεις καθώς προσαρμόζονταν στο φορμάτ:

Κυλιόμενες μέσες τιμές για τις πιστωτικές και αυθεντικότητας αξιολογήσεις σε όλη τη διάρκεια της ακολουθίας των αξιολογήσεων των συμμετεχόντων δείχνουν μια σύντομη αρχική φάση βελτίωσης, καθώς οι χρήστες φαίνεται να προσαρμόζονται στην εργασία κατά τη διάρκεια των πρώτων 15–20 αντικειμένων, ακολουθούμενη από μια σταθερή μείωση και στις δύο μετρήσεις μετά από περίπου 30 αξιολογήσεις. Παρακαλώ αναφερθείτε στην πηγή εργασίας για καλύτερη ανάλυση.

Ωστόσο, αυτή η επίδραση ήταν σύντομη, καθώς η απόδοση άρχισε να μειώνεται μετά από περίπου 30 αντικείμενα, με τους συμμετέχοντες να αυξάνουν την ετικέτα του περιεχομένου ως ψευδές – μια μετατόπιση που ερμηνεύεται ως γνωστική κουρασιά, και υποδηλώνει σαφείς περιορισμούς στο πόσο καιρό οι προσεγγίσεις ανίχνευσης μπορούν να παραμείνουν αποτελεσματικές, στην πράξη.

Αυτό μπορεί να αντιπροσωπεύει κάποια εμπειρικά στοιχεία ότι, εξαντλημένοι από την προοπτική να διακρίνουν τα ψευδείς νέα από τα πραγματικά, τα νέα AI από τα ανθρώπινα, μπορεί να τείνουν να προτιμούν να υποθέτουν ότι τα νέα είναι AI και/ή ψευδείς (όχι απαραίτητα το ίδιο πράγμα), για να είναι ‘ασφαλείς’. Αυτοί που θεωρούν αυτό ‘λαζό’, και θεωρούν ότι οι άνθρωποι πρέπει να κάνουν τη δική τους έρευνα για να επιβεβαιώσουν μια πιθανή ψευδής ιστορία, μπορεί να ενδιαφερθούν να μάθουν ότι μια μελέτη του 2024 υποδείκνυε ότι αυτό κάνει τα προβλήματα χειρότερα.

Οι συγγραφείς προτείνουν ότι η αποτυχία της ανθρώπινης κρίσης που φαίνεται στα αποτελέσματα υποδηλώνει ότι μπορεί να χρειαζόμαστε να αναθέσουμε τέτοιες υποθέσεις σε τεχνολογίες κρυπτογραφικής προέλευσης όπως η πρωτοβουλία C2PA της Adobe. Άλλες πιθανές λύσεις που αναφέρονται είναι το δικό τους πλαίσιο OriginLens, και ένα άλλο έργο που εμπλέκει τους συγγραφείς με τίτλο CRED-1.

Οι συγγραφείς καταλήγουν:

‘Μπορούν οι άνθρωποι να ξεχωρίσουν; Η διπλή άξονα μελέτη μας των 2.318 κρίσεων σε έξι οικογένειες LLMs παρέχει μια σαφή εμπειρική απάντηση: δεν μπορούν.

‘Το κείμενο που παράγεται από μηχάνημα είναι αδιαχώριστο από την ανθρώπινη γραφή ανεξάρτητα από το μέγεθος του μοντέλου ή την οικογένεια, η εξειδίκευση τομέα προβλέπει την ακρίβεια ανίχνευσης πιο στενά από την πολιτική προέλευση, οι συμμετέχοντες υιοθετούν διακριτά στυλ εμπιστοσύνης, και η γνωστική κουρασιά περιορίζει τη διατηρημένη ανίχνευση.

‘Αυτά τα ευρήματα υποστηρίζουν μια μετατόπιση από τις προσεγγίσεις ανίχνευσης του χρήστη προς συστημικές αντεπιθέσεις, συμπεριλαμβανομένων της προέλευσης περιεχομένου, των διαδραστικών δεικτών εμπιστοσύνης και των παρεμβάσεων εμβολιασμού.’

Συμπέρασμα

Το ανησυχητικό μέρος αυτής της εργασίας είναι το περιβάλλον δίκτυο έργων και ερευνών που οι συγγραφείς – ή κάποιοι από τους συγγραφείς, ανάλογα με την εργασία – έχουν προέρθει ή έχουν συμμετάσχει; και σίγουρα θα ήταν ενδιαφέρον να μελετήσουμε δείγματα κειμένου AI και ανθρώπινου που παρήγαγαν αυτά τα αποτελέσματα, για να καταλάβουμε καλύτερα το είδος της εξόδου που η περιγραφόμενη μεθοδολογία παραγωγής παράγει.

Ωστόσο, είναι ενδιαφέρον να ακούσουμε ότι ανοικτά, ανοικτά μοντέλα μπορούν να συγκριθούν με API-κίνητα γίγαντα όπως η σειρά ChatGPT – μπορεί να είναι ότι η εργασία στο χέρι δεν είναι τόσο δύσκολη, και ότι ένα μοντέλο 200 δισεκατομμυρίων παραμέτρων είναι υπερβολικό για τέτοιες εργασίες; Θα χρειαζόμαστε να γνωρίζουμε λίγο περισσότερα για τα δείγματα πηγής AI και ανθρώπινου που υποβεβληθήκαν στις δοκιμές, για να απαντήσουμε σε αυτό το ερώτημα.

Εν τω μεταξύ, σύμφωνα με την canirun.ai ιστοσελίδα, το Mistral 7B (το οποίο ήταν περίπου στο ίδιο επίπεδο με το ChatGPT-4o στις δοκιμές) ‘τρέχει καλά’ σε ένα NVIDIA RTX 3080 με 16GB VRAM, και τρέχει ‘καλά’ σε ένα 3060 με 6GB VRAM – όχι τα τελευταία ή τα καλύτερα γραφικά καρτέλα στην παιχνίδι*. Όποιος θέλει να δημιουργήσει τη δική του μεθοδολογία για υποβολή δειγμάτων μπορεί να συμμετάσχει σε αυτά τα πειράματα επίσης.

* Το Gemma 7B δεν αναφέρεται στην ιστοσελίδα.

Πρώτη δημοσίευση Πέμπτη, 9 Απριλίου 2026