Ηγέτες σκέψης

Ένας Πρακτικός Οδηγός για Αμυντικά LLM Outputs

Υπάρχει μια σιωπηλή υπόθεση που διέρχεται από τις περισσότερες επιχειρηματικές αναπτύξεις GenAI: αν η έξοδος φαίνεται σωστή, είναι σωστή. Σε περιβάλλοντα χαμηλού κινδύνου, αυτό είναι ένα εύλογο σ捷. Σε ρυθμιζόμενες βιομηχανίες, όπως η υγεία, η финάνες, τα φάρμακα και η ποιότητα, είναι ένα κίνδυνο που περιμένει να εμφανιστεί.

Η στιγμή που μια έξοδος LLM επηρεάζει μια κλινική απόφαση, einen οικονομικό αρχείο ή ένα έγγραφο συμμόρφωσης, η ευρυθμία παύει να είναι ένα πρόσωπο για την αξιοπιστία. Και όταν ένας ελεγκτής, ρυθμιστής ή νομική ομάδα ρωτάει ποια δεδομένα χρησιμοποιήθηκαν, ποίες κανόνες εφαρμόστηκαν και ποιος τις έγκρισε, “το μοντέλο είπε così” δεν είναι μια απάντηση που κανείς μπορεί να υπογράψει.

Αυτό είναι το κενό ευθύνης που οι περισσότερες ομάδες GenAI δεν σχεδιάζουν. Εδώ είναι πώς να το κλείσετε.

Γιατί “Φαίνεται Σωστό” είναι ο Λάθος Πρότυπο

Η παραδοσιακή αξιολόγηση AI εστιάζει στην ακρίβεια, την καθυστέρηση και το κόστος. Αυτά έχουν σημασία. Αλλά τα ρυθμιζόμενες περιβάλλοντα εισάγουν einen τέταρτο άξονα που οι άλλοι δεν μπορούν να αντικαταστήσουν: την ελεγκтивότητα.

Ο νόμος της ΕΕ για την AI, που ισχύει τώρα, απαιτεί από τα υψηλού κινδύνου συστήματα AI να διατηρούν τεχνική τεκμηρίωση, καταγραφές ιχνηλασιμότητας και αποδεικτικά στοιχεία ανθρώπινης επιτήρησης καθ’ όλη τη διάρκεια του κύκλου ζωής τους. Ο πρώτος προσχέδιος οδηγός της FDA για την AI στη φαρμακευτική και βιολογική ανάπτυξη δείχνει την ίδια κατεύθυνση για τις βιομηχανίες ζωής. Αυτά τα πλαίσια δεν βαθμολογούν την ευρυθμία. Απαιτούν συστήματα που μπορούν να ανακατασκευαστούν, να ελεγχθούν και να υπερασπισθούν.

Μια αμυντική έξοδος LLM είναι αυτή που μπορεί να αναχθεί πίσω μέσω ενός ελέγξιμου συνδέσμου αποδεικτικών στοιχείων: ποια δεδομένα drew από, ποίες περιορισμοί τη σήμανε, ποιος τη αναθεώρησε και τι διατηρήθηκε για μελλοντική επιθεώρηση. Χωρίς αυτόν τον σύνδεσμο, ακόμη και μια σωστή έξοδος είναι αμυντική.

Αυτό αναδιαμορφώνει τι “έτοιμο για παραγωγή” σημαίνει στην πραγματικότητα για την AI σε ρυθμιζόμενες περιβάλλοντες.

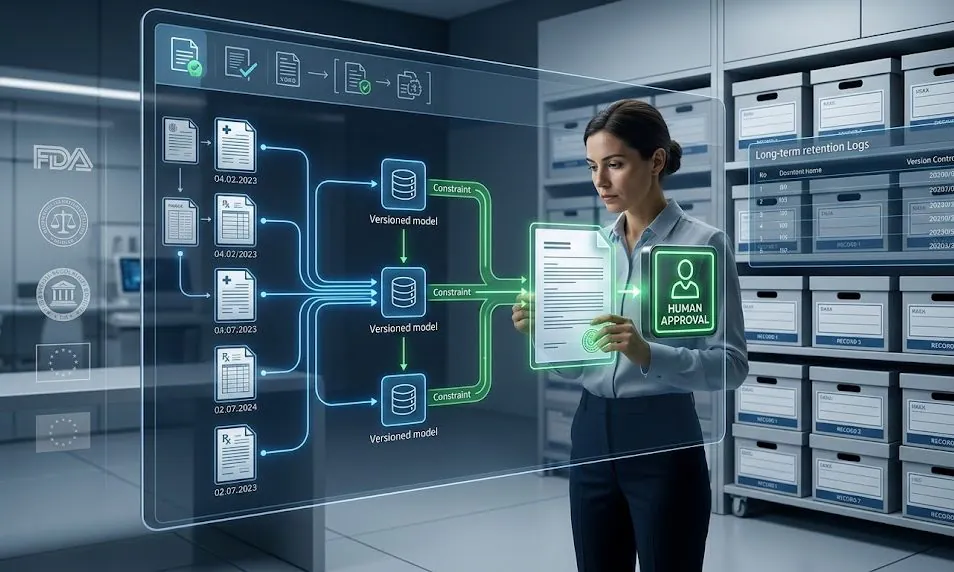

Οι Τέσσερις Στύλοι του Audit-Ready GenAI

Η κατασκευή αμυντικών συστημάτων LLM έρχεται xuống σε τέσσερις μηχανικές απαιτήσεις. Αυτές δεν είναι αφηρημένες αρχές – είναι αποφάσεις υποδομής που καθορίζουν εάν το σύστημα σας μπορεί να επιβιώσει της σκραπνύ.

1. Προέλευση: Ελέγξτε Πού το Μοντέλο Παίρνει τις Πληροφορίες του

Η πιο συχνή λειτουργία αποτυχίας σε επιχειρηματική AI είναι επίσης η λιγότερο ορατή: μοντέλα που आकरούν σε γενικές γνώσεις ή χαλαρά ορισμένες πηγές δεδομένων. Όταν δεν υπάρχει ελεγχόμενη γνώση ορίου, οι έξοδοι δεν μπορούν να αναχθούν σε κανένα ελέγξιμο πηγή, και η ανακατασκευή γίνεται αδύνατη.

Μια πρακτική επιδιόρθωση είναι να καθορίσετε einen εγκεκριμένο γνώση ορίου: εκδόσεις, κατοχυρωμένα έγγραφα και συνόλους δεδομένων που το σύστημα έχει ρητά την άδεια να χρησιμοποιήσει. Κάθε απάντηση πρέπει να φέρει ένα ελάχιστο πακέτο αποδεικτικών στοιχείων: einen αναγνωριστικό πηγής με έκδοση και ημερομηνία ισχύος, einen κατάλογο ανάκτησης που δείχνει τι ανακτήθηκε και επιλέχθηκε, και εσωτερικές παραπομπές. Ένας χρήσιμος κανόνας λειτουργίας: keine παραπομπή, keine αξίωση.

Αυτό μετατρέπει το σύστημα από μνήμη-βασισμένη γεννήτρια σε ελέγξιμη λογική.

2. Περιορισμοί: Αντικαταστήστε την Αυθορμητική με Ελεγχόμενη Συμπεριφορά

Τα LLM κατασκευάζονται για να είναι πειστικά. Χωρίς περιορισμοί, βελτιώνουν την πιθανότητα, και η πιθανότητα σε ένα ρυθμιζόμενο περιβάλλον είναι όπου ο κίνδυνος ζει.

Οι περιορισμοί είναι ο μηχανισμός που μετατρέπει einen πιθανό γεννήτρια κειμένου σε einen περιβαλλόμενο εκτελέσιμο συνιστώσα. Στην πράξη, αυτό σημαίνει:

- Πηγή-δένδετη γεννήτρια: Κάθε αξίωση απαιτεί einen εγκεκριμένη, εκδοθείσα πηγή. keine πηγή σημαίνει keine απάντηση — μόνο άρνηση ή αναβάθμιση.

- Δομημένα σχήματα εξόδου: Απαντήσεις ακολουθούν ορισμένα формάτα που μηχανές και ελεγκτές μπορούν να επικυρώσουν, όχι μόνο να διαβάσουν.

- Ενίσχυση ορίου εμπιστοσύνης: Ανακτημένο περιεχόμενο αντιμετωπίζεται ως είσοδος, απευθείας αντιμετωπίζοντας κινδύνους που μπορούν να υπονομεύσουν και την ασφάλεια και την ελεγκтивότητα.

- Ελάχιστη-ιδιότητα πρόσβασης: Το μοντέλο αλληλεπιδρά μόνο με τα δεδομένα και τα εργαλεία που πραγματικά χρειάζεται, κρατώντας καθαρές τις ιχνηλασίες.

Οι περιορισμοί δεν είναι ένα πλαίσιο συμμόρφωσης. Είναι η αρχιτεκτονική απόφαση που καθορίζει εάν το σύστημα σας μπορεί να ελεγχθεί καθόλου.

3. Αναθεώρηση: Κάντε την Ανθρώπινη Επιτήρηση einen Formal Ελέγξιμο Στρώμα

Στην ρυθμιζόμενη AI, η ανθρώπινη αναθεώρηση δεν μπορεί να είναι ad hoc. Χρειάζεται να είναι κινδύνου-στρωμένη (υψηλότερου κινδύνου έξοδοι ενεργοποιούν αυστηρότερη επικύρωση) και συμβάν-κίνητη, ενεργοποιώντας όταν η εμπιστοσύνη του μοντέλου είναι χαμηλή, οι πηγές είναι απουσιάζουσες ή ανωμαλίες ανιχνεύονται.

Ο νόμος της ΕΕ για την AI απαιτεί ρητά ότι οι άνθρωποι πρέπει να μπορούν να ερμηνεύουν, να αντικαθιστάν και να σταματούν τις αποφάσεις AI σε υψηλού κινδύνου περιπτώσεις. Η ικανοποίηση αυτής της απαιτήσεως σημαίνει ότι τα αρχεία αναθεώρησης πρέπει να καταγράψουν ποιος έγκρισε eine έξοδο, υπό ποιες συνθήκες και με ποιο επίπεδο σκραπνύ. “Κάποιος το ελέγξει” δεν είναι ένας έλεγχος. Ένα τεκμηριωμένο, χρονολογημένο αρχείο αναθεώρησης είναι.

Αυτό ανυψώνει την αναθεώρηση από χειροκίνητη QA σε einen формικό στρώμα διακυβέρνησης, που είναι ακριβώς όπως οι ρυθμιστές αρχίζουν να το αντιμετωπίζουν.

4. Διατήρηση: Κάντε την Ευθύνη Διάρκεια

Χωρίς καταγραφές, δεν υπάρχει ιχνηλασία. Χωρίς ιχνηλασία, η ευθύνη είναι θεωρητική.

Την ίδια στιγμή, η διατήρηση όλων δημιουργεί τους δικούς της κινδύνους, ιδιαίτερα όπου ευαίσθητα δεδομένα υγείας ή финάνσεων υπόκεινται σε απαιτήσεις ελαχιστοποίησης σύμφωνα με πλαίσια όπως GDPR ή HIPAA.

Η πρακτική προσέγγιση είναι ένα στρωματοποιημένο μοντέλο. Αποθηκεύστε πάντα μεταδεδομένα μοντέλου και έκδοσης, αναγνωριστικά πηγής, αποφάσεις πολιτικής και χρονολογίες. Αποθηκεύστε περιεχόμενο αλληλεπίδρασης (πρόσκληση, έξοδο και πλήρη ιχνηλασίες) επιλεκτικά, βάσει ταξινόμησης κινδύνου, με κατάλληλη διαγραφή και έλεγχο πρόσβασης. Ο στόχος είναι να ενεργοποιήσετε την ανακατασκευή οποιασδήποτε έξοδου χωρίς να συλλέξετε δεδομένα που δημιουργούν εκτεθειμένα δεδομένα.

Τι Αυτό Φαίνεται στην Πράξη

Σκεφτείτε πώς αυτό εφαρμόζεται στις βιομηχανίες ζωής, όπου ο CFR 21 Part 11 απαιτεί ηλεκτρονικά αρχεία να είναι αποδοτικά, αναγνώσιμα, σύγχρονα, πρωτότυπα και ακριβή. Ένα LLM που γεννά ρυθμιζόμενη τεκμηρίωση πρέπει να ικανοποιήσει όλα τα πέντε κριτήρια – όχι μόνο να παράγει αναγνώσιμο κείμενο.

Σε αυτό το πλαίσιο, οι τέσσερις στύλοι δεν είναι προαιρετικά βελτιώσεις. Είναι η ελάχιστη μπάρα για ένα συμμορφωμένο σύστημα. Η προέλευση εξασφαλίζει ότι η έξοδος είναι αποδοτική και πρωτότυπη. Οι περιορισμοί εξασφαλίζουν ότι παραμένει μέσα σε ορισμένα όρια. Η αναθεώρηση εξασφαλίζει ότι είναι σύγχρονη με ανθρώπινη επιτήρηση. Η διατήρηση εξασφαλίζει ότι είναι αναγνώσιμη και ελέγξιμη.

Η ίδια λογική εφαρμόζεται στις финάνες, όπου ο MiFID II απαιτεί αρχεία αποφάσεων και του λόγου πίσω από αυτές, και στην υγεία, όπου συστήματα υποστήριξης κλινικών αποφάσεων αντιμετωπίζουν αυξανόμενη σκραπνύ για την ερμηνευσιμότητα και την προκατάληψη.

Η Μεγαλύτερη Μετατόπιση

Η GenAI μετατοπίζεται από την πειραματική σε λειτουργική υποδομή. Αυτή η μετάβαση ανυψώνει το πρότυπο για τι είναι αποδεκτά συστήματα.

Μια χρήσιμη έξοδος δεν είναι πλέον αρκετή. Οι οργανισμοί χρειάζονται έξοδοι που μπορούν να εξηγηθούν, να αναχθούν και να υπερασπισθούν υπό σκραπνύ, γιατί η AI ζητείται να κάνει πράγματα που φέρουν πραγματικές συνέπειες.

Οι ομάδες που σχεδιάζουν για αμυντικότητα από την αρχή θα τοποθετηθούν για να κλιμακώσουν την AI με ασφάλεια και να διατηρήσουν την ρυθμιστική εμπιστοσύνη. Αυτοί που δεν το κάνουν θα αντιμετωπίσουν τελικά την ίδια στιγμή: einen ελέγχο, eine απλή ερώτηση για μια συγκεκριμένη έξοδο, και τίποτα να δείξουν για αυτό.

Η κατασκευή αμυντικής AI δεν είναι για να επιβραδύνει. Είναι για να κατασκευάσετε κάτι που μπορεί να διαρκέσει.