Ηγέτες σκέψης

Από τον Κώδικα στο Αντιδότο: Η Επόμενη Επανάσταση του AI Χρειάζεται Một Χέρι (Και Μάτια)

Πώς τα συστήματα agentic, τα έξυπνα γυαλιά XR και η ρομποτική θα ενδυναμώσουν τους ανθρώπους και όχι θα τους αντικαταστήσουν

Βρισκόμαστε στη μέση ενός парадόξου στην τεχνητή νοημοσύνη.

Στις οθόνες, το AI είναι υπεράνθρωπο. Τα μεγάλα μοντέλα γλωσσών γράφουν λειτουργικό κώδικα Python σε δευτερόλεπτα. Τα γεννητικά συστήματα παράγουν φωτορεαλιστικές εικόνες και βίντεο σε λεπτά. Τα συστήματα που έχουν κερδίσει το βραβείο Νόμπελ, όπως το AlphaFold, έχουν προβλέψει τις δομές σχεδόν όλων των γνωστών πρωτεϊνών. Οι ψηφιακές νίκες συσσωρεύονται.

Ωστόσο, στον φυσικό κόσμο της βιοϊατρικής έρευνας, η διαδικασία ανακάλυψης παραμένει εξαιρετικά χειροκίνητη. Δεν νιώθουμε πραγματικά ότι το AI επιταχύνει την επιστήμη ή την ιατρική, τουλάχιστον όχι ακόμη. Τα νούμερα αποκαλύπτουν το βάθος του προβλήματος. Μια ορόσημο έρευνα της Nature σε πάνω από 1.500 επιστήμονες διαπίστωσε ότι περισσότεροι από το 70% έχουν προσπαθήσει και απέτυχαν να αναπαράγουν πειράματα άλλων ερευνητών. Ακόμη πιο ενοχλητικό: περισσότεροι από το 50% δεν μπορούσαν να αναπαράγουν τη δική τους εργασία. Στη βιολογία του καρκίνου, ειδικά, ένα οκταετές πρόγραμμα αναπαραγωγής διαπίστωσε ότι μόνο το 40% των ευρημάτων υψηλής επίδρασης μπορούσε να αναπαραχθεί και το 68% των πειραμάτων έλλειπε επαρκούς τεκμηρίωσης για να επιχειρηθεί ακόμη και η αναπαραγωγή.

Αυτό είναι το βρόμικο μυστικό της σύγχρονης επιστήμης: έχουμε ένα πρόβλημα καταγραφής γνώσεων, όχι μόνο ένα πρόβλημα ανακάλυψης. Κρίσιες πειραματικές λεπτομέρειες ζουν στο μυαλό των ερευνητών, όχι στα έγγραφα. Οι πρωτόκολλα παραμερίζονται. Η σιωπηλή γνώση εξαφανίζεται όταν οι εκπαιδευόμενοι αποφοιτούν. Τα συστήματα AI που εκπαιδεύονται σε δημοσιευμένη βιβλιογραφία κληρονομούν όλα αυτά τα κενά.

Το θεμελιώδες ζήτημα είναι ότι ενώ ένα AI μπορεί να σχεδιάσει μια νέα πρωτεΐνη για θεραπεία καρκίνου σε ψηφιακή симуляση, δεν μπορεί να πιάσει einen πιπέτα για να τη δοκιμάσει. Δεν μπορεί να διαπεράσει την ακατάστατη, απρόβλεπτη πραγματικότητα ενός υγρού εργαστηρίου για να επικυρώσει την δική του υπόθεση. Δεν μπορεί να παρακολουθήσει τα χέρια eines έμπειρου επιστήμονα και να μάθει τις λεπτές τεχνικές που κάνουν τα πειράματα να λειτουργούν.

Αυτό το “κενό εκτέλεσης” είναι το μεγαλύτερο εμπόδιο που εμποδίζει την επανάσταση του AI να γίνει μια ιατρική επανάσταση. Ενώ οι περισσότερες εταιρείες ρομποτικής είναι ακόμη απασχολημένες με τη διδασκαλία των μηχανών να διπλώσουν ρούχα ή να φορτώσουν πλυντήρια, μένουν πίσω από τις πραγματικά μετασχηματιστικές ικανότητες αυτών των προόδων σε τομείς όπως η ιατρική.

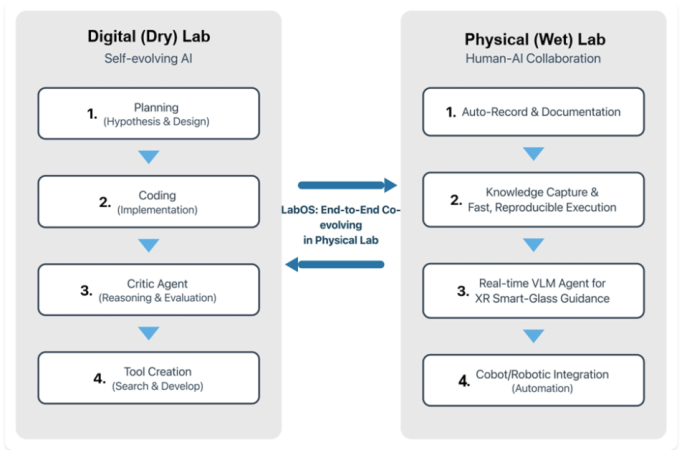

Για να λύσουμε αυτό, πρέπει να μετακινηθούμε πέρα από τα chatbots και προς τα AI Co-Scientists, συστήματα agentic που γεφυρώνουν τον ψηφιακό και τον φυσικό κόσμο,推οντας πέρα από την σχεδίαση και τον κώδικα και στην εκτέλεση του πραγματικού κόσμου. Στο Stanford, αναπτύσσουμε το LabOS, ένα ψηφιακό-φυσικό πλαίσιο AI που δείχνει πώς τα AI agents, τα έξυπνα γυαλιά XR και η συνεργατική ρομποτική μπορούν να ενωθούν για να κλείσουν αυτό το κενό, μετατρέποντας τα επιστημονικά πειράματα σε μια συνεργατική συνομιλία μεταξύ ανθρώπου και μηχανής, ενώ αυτόματα καταγράφουν τις γνώσεις που τώρα χάνονται.

Η Μεγάλη Διάσταση: Γιατί το AI Χρειάζεται “Μάτια” και “Χέρια”

Πολλοί από τους πιο ορατούς νίκες του AI έχουν συμβεί όπου το περιβάλλον είναι πλήρως ψηφιακό: αποθήκες κώδικα, κατηγοριοποιημένα σύνολα δεδομένων ή προσομοιωμένα βENCHMARKS (όπου το AI ανταγωνίζεται για να τρέξει μια εικονική επιχείρηση ή ψηφιακά επενδύσεις σε μετοχές).

Τα υγρά εργαστήρια είναι διαφορετικά. Η βιολογία και γενικά η επιστημονική ανακάλυψη είναι một πολύ θορυβώδης διαδικασία. Τα όργανα παραμερίζονται, οι χειριστές αυτοσχεδιάζουν και “το πρωτόκολλο” συχνά ζει εν μέρει στο μυαλό των ανθρώπων. Η διαφορά μεταξύ ενός καθαρού αποτελέσματος και ενός αποτυχημένου run μπορεί να είναι ένας γωνία πιπετίσματος, ένα μοτίβο vortexing, μια αντικατάσταση αντιδραστηρίου ή μια επίδραση που διήρκεσε 10 λεπτά. Αυτές οι περιβαλλοντικές λεπτομέρειες σπάνια κάνουν το paper και είναι ακριβώς αυτό που ένα μοντέλο AI χρειάζεται αν θα γενικευθεί πέρα από ένα σύνολο δεδομένων.

Γι’ αυτό το lab-βαθμό AI χρειάζεται μάτια (για να αντιληφθεί τι συμβαίνει στο контέκστ) και χέρια (για να стандαρδικοποιήσει και να αυτοματοποιήσει υψηλής μεταβλητότητας βήματα) και μνήμη (για να καταγράψει τι πραγματικά συνέβη). Χωρίς αυτές τις ικανότητες, τα μοντέλα μπορούν να προτείνουν τι να κάνετε, αλλά δεν μπορούν να μεταφράσουν τις προτάσεις σε εγκεκριμένη φυσική εκτέλεση ή να εξηγήσουν αποτυχίες όταν η πραγματικότητα απομακρύνεται από το σχέδιο.

Πέρα από τα Chatbots: Από Copilots σε Co-Scientists

Ο όρος “agentic AI” χρησιμοποιείται đôi vezes με χαλαρότητα. Σε βιοϊατρικούς περιβάλλοντες, πρέπει να σημαίνει κάτι ακριβές: ένα σύστημα που μπορεί να πάρει ένα στόχο (για παράδειγμα, “βελτιστοποίηση της αποτελεσματικότητας της επεξεργασίας γονιδίων CRISPR ενώ ελαχιστοποιείται η εκτός στόχου”) και να το αναλύσει σε μια σειρά από εργασίες, να εκτελέσει αυτές τις εργασίες σε εργαλεία, να αξιολογήσει τα αποτελέσματα και να προσαρμόσει το σχέδιο με περιορισμούς και με ελέγξιμη λήψη αποφάσεων.

Αυτό έχει σημασία επειδή οι ερευνητικές διαδικασίες δεν είναι μια μονή κλήση του μοντέλου. Είναι πλήρεις αγωγοί που διαπερνούν τη διατύπωση της υπόθεσης, το πειραματικό σχέδιο, την επεξεργασία δεδομένων, τη στατιστική δοκιμή και την ερμηνεία. Η πρόσφατη σκέψη στη ανακάλυψη φαρμάκων έχει αρχίσει να τονίζει συστήματα agentic που μπορούν να κλιμακώσουν αυτούς τους αγωγούς και όχι να επιταχύνουν μόνο μεμονωμένα βήματα (για παράδειγμα, η συζήτηση του Unite.AI για τα agents στη μικρομοριακή ανακάλυψη).

LabOS: Όταν το AI Τρέχει σε Ένα Λειτουργικό Σύστημα για τα Εργαστήρια του Μέλλοντος

Στη δουλειά μας στο Stanford για το AI4Science, που διαπερνά τους συν-πιλότους της επεξεργασίας γονιδίων όπως το CRISPR-GPT και τα συστήματα AI-XR co-εκτέλεσης όπως το LabOS, που βοηθούν τους επιστήμονες σε βιοϊατρικά και υλικά εργαστήρια, έχουμε εξερευνήσει μια αρχιτεκτονική μετατόπιση:

1. Σχεδιασμός ενός πλήρους “εργαστηριακού λειτουργικού συστήματος” που συνδέει ένα ψηφιακό (ξηρό) εργαστήριο με ένα φυσικό (υγρό) εργαστήριο.

Η πρόταση είναι απλή: αν ένα εργαστηριακό σημείωμα είναι η μνήμη της επιστήμης, τότε ένα εργαστηριακό λειτουργικό σύστημα πρέπει να είναι το επίπεδο εκτέλεσης, καταγράφοντας την πρόθεση, μετατρέποντάς τη σε δράσεις, παρατηρώντας τα αποτελέσματα και μετατρέποντας κάθε εκτέλεση σε δομημένη γνώση.

Σχήμα. Μια εννοιολογική άποψη του LabOS που συνδέει einen αυτο-επαναλαμβανόμενο ψηφιακό εργαστηριακό βρόχο (σχεδιασμός, κώδικας, κριτική, δημιουργία εργαλείων) με einen ανθρώπινο-AI υγρό εργαστηριακό βρόχο (αυτόματη τεκμηρίωση, καταγραφή γνώσεων, XR οδηγία και ρομποτική ολοκλήρωση).

2. AI στο Ψηφιακό Εργαστήριο – Αυτο-Επαναλαμβανόμενος Σχεδιασμός και Δημιουργία Εργαλείων

Στο ψηφιακό (ξηρό) εργαστήριο, μπορούμε να αφήσουμε το AI να κάνει αυτό που ήδη κάνει καλά: αναζήτηση, σύνθεση και πρόταση. Αλλά θέλουμε επίσης να είναι αυτο-βελτιωμένο. Όχι με “hallucinating νέα επιστήμη”, αλλά με την εκμάθηση καλύτερων εργαλείων και ροών εργασίας από την ανατροφοδότηση.

Μια πρακτική ψηφιακή-εργαστηριακή διαδικασία μπορεί να οριστεί ως τέσσερις επαναλαμβανόμενες φάσεις:

- Σχεδιασμός (υπόθεση + σχεδιασμός): προτείνετε υποθέσεις, επιλέξτε πειραματικές μεταβλητές, προβλέψτε παραπλανητές και ορίστε μετρήσιμους σταθμούς.

- Κώδικας (εκτέλεση): γεννήστε ή προσαρμόστε ανάλυση script, simulation pipelines και Vorlagen ελέγχου οργάνων όπου είναι κατάλληλο.

- Κριτικός πράκτορας (λογική + αξιολόγηση): δοκιμάστε τις υποθέσεις, ελέγξτε τη στατιστική δύναμη, προτείνετε ελέγχους και σηματοδοτήστε πιθανές αποτυχίες.

- Δημιουργία εργαλείων (αναζήτηση + ανάπτυξη): όταν η ροή εργασίας λείπει ενός συστατικού (ένα parser, μια QC ρουτίνα, μια πίνακα ελέγχου), κατασκευάστε το και προσθέστε το πίσω στο εργαλείο.

3. AI στο Φυσικό Εργαστήριο – AI Με “Μάτια” (XR Γυαλιά) και “Χέρια” (Ρομποτική)

Το φυσικό εργαστήριο είναι όπου το σύστημα είτε κερδίζει εμπιστοσύνη – είτε χάνει. Ο στόχος δεν είναι να αντικαταστήσει τον επιστήμονα, αλλά να μειώσει την τριβή και το λάθος ενώ αυξάνει την παρατηρήσιμη.

Γιατί το Lab-Grade AI Δεν Είναι Απλά “AI σε Ένα Σύνολο Δεδομένων”

Τα συστήματα AI για βιοϊατρική/επιστημονική υπερ-νοημοσύνη συχνά φαίνονται εντυπωσιακά σε αναδρομική αξιολόγηση ή σε εξετάσεις, και στη συνέχεια υποπερφόρμανς στο φυσικό εργαστήριο. Ο λόγος δεν είναι σπάνια ένα單ο bug. Είναι συνήθως μια ανισορροπία μεταξύ των υποθέσεων του μοντέλου και της πραγματικότητας του εργαστηρίου.

Τρεις κενές θέσεις εμφανίζονται επανειλημμένα:

- Κενό περιβάλλοντος: τα σύνολα δεδομένων συνήθως παραλείπουν τις περιβαλλοντικές μεταβλητές που οι χειριστές γνωρίζουν ότι έχουν σημασία (θερμικές εξορμήσεις, αριθμοί παρτίδας αντιδραστηρίων, λεπτές αποκλίσεις πρωτοκόλλου).

- Κενό δράσης: πολλά συστήματα AI μπορούν να προτείνουν τι να κάνετε, αλλά δεν μπορούν να μεταφράσουν τις προτάσεις σε εγκεκριμένες φυσικές βήματα.

- Κενό ανατροφοδότησης: χωρίς δομημένη, υψηλής ποιότητας ανατροφοδότηση από την εκτέλεση, τα μοντέλα δεν μπορούν να μάθουν όπου αποτυχαίνουν – και οι επιστήμονες δεν μπορούν να ελέγξουν γιατί.

Η κλείσιμο αυτών των κενών δεν είναι τόσο για την εφεύρεση μιας νέας αρχιτεκτονικής νευρωνικού δικτύου, αλλά περισσότερο για την κατασκευή των οργάνων, των διεπαφών και των συμβολαίων δεδομένων που κάνουν το εργαστήριο αναγνώσιμο από τις μηχανές και επιτρέπουν στο AI να δει και να συνεργαστεί με τους ανθρώπους.

Εμπιστοσύνη με Σχεδιασμό: Ασφάλεια και Διακυβέρνηση για AI που Μπορεί να Δράσει

Το agentic AI στη διαδικασία ανακάλυψης έρευνας δεν μόνο ανεβάζει γνωστές ανησυχίες σχετικά με την ακρίβεια. Εισάγει νέους τρόπους αποτυχίας επειδή μπορεί να δράσει. Σε ένα εργαστήριο, η δράση σημαίνει την πιθανότητα για αποβλήσεις, ζημιά ή παραπλανητικές συμπεράσματα, ιδιαίτερα όταν τα πειράματα τροφοδοτούν κλινικές υποθέσεις.

Μια χρήσιμη στάση είναι να αντιμετωπίζεται ένα AI-ενεργοποιημένο εργαστηριακό στάκ ως ένα κοινωνικο-τεχνικό σύστημα που χρειάζεται εγγύηση. Πολλά υπάρχοντα πλαίσια βοηθούν, αλλά πρέπει να μεταφραστούν στην πραγματικότητα του εργαστηρίου:

- Διαχείριση κινδύνου ως συνεχής πρακτική: το πλαίσιο διαχείρισης κινδύνου AI του NIST (AI RMF 1.0) παρέχει ένα πρακτικό λεξιλόγιο για χαρτογράφηση, μέτρηση και διαχείριση του κινδύνου AI σε όλη τη διάρκεια ζωής.

- Συμμόρφωση ρυθμιστικών για ιατρικά-σχετικά AI: η δουλειά του FDA για το AI/ML Λογισμικό ως Ιατρική Συσκευή (SaMD), συμπεριλαμβανομένου του Σχέδιο Δράσης και σχετικών οδηγιών, προσφέρει μια συγκεκριμένη άποψη για το τι “καλή πρακτική” σημαίνει όταν το AI επηρεάζει την φροντίδα του ασθενούς.

Για τη γενετική επεξεργασία και άλλους τομείς υψηλής συνέπειας, η διακυβέρνηση είναι ήδη μια παγκόσμια συζήτηση. Συμβουλές συζητούνται για την επεξεργασία του ανθρώπινου γονιδιώματος, για να τονίσουν την ανάγκη για κατάλληλα μηχανισμούς εποπτείας και υπεύθυνης διακυβέρνησης, όπως αυτές που προτείνονται από την Αμερικανική Εταιρεία για τη Γενετική και Κυτταρική Θεραπεία, ή ASGCT. Συστήματα όπως το LabOS πρέπει να σχεδιαστούν για να κάνουν τη συμμόρφωση πιο εύκολη, όχι πιο δύσκολη.

Ελέγχος: Ελέγχοι για Ασφαλή AI Co-Scientists για Επιστημονική Ανακάλυψη

Στη γνώμη μας, ένα ασφαλές εργαστηριακό λειτουργικό σύστημα πρέπει να εφαρμόσει τουλάχιστον τις ακόλουθες σχεδιάσεις:

- Αποδεικτική από προεπιλογή: κάθε σύνολο δεδομένων, εκδοση πρωτοκόλλου και έξοδος μοντέλου πρέπει να είναι αναγνωρίσιμη σε εισαγωγές και χρονικές σήμανσεις.

- Περιορισμένη αυτονομία: το σύστημα πρέπει να έχει ρητές εξουσιοδοτήσεις (τι μπορεί να κάνει χωρίς επιβεβαίωση) και κανόνες ανόδου (πότε πρέπει να ζητήσει).

- Ανθρώπινη αναστροφή και εύκολη υποβάθμιση: όταν οι αισθητήρες ή οι ροές δεδομένων αποτυχαίνουν, ή η αβεβαιότητα είναι υψηλή, το σύστημα πρέπει να επανέλθει σε μια ασφαλέστερη, απλούστερη λειτουργία.

- Συνεχής επικύρωση: οι προβλέψεις in-silico πρέπει να συνοδεύονται από φυσική-εργαστηριακή επικύρωση· οι φυσικοί-εργαστηριακοί runs πρέπει να περιλαμβάνουν πύλες ελέγχου ποιότητας πριν από τα συμπεράσματα που προωθούνται προς τα πίσω στα μοντέλα/πράκτορες στο ψηφιακό κόσμο.

- Ασφάλεια και ευαισθησία για διπλή χρήση.

Ενδυναμώστε τους Ανθρώπους Παντού: Μπορούν τα AI Co-Scientists να Ισοπεδώσουν το Πεδίο;

Μια από τις πιο δελεαστικές υποσχέσεις ενός AI-XR “co-scientist” δεν είναι μόνο η ταχύτητα για ελίτ ιδρύματα, αλλά και η προσβασιμότητα για όλους. Σκεφτείτε τι τώρα περιορίζει τα μικρότερα εργαστήρια, τις startups και τις απομακρυσμένες/περιφερειακές κλινικές:

- Περιορισμένη πρόσβαση σε εξειδικευμένη εμπειρογνωσία για χρυσοί πρωτόκολοι και όργανα.

- Υψηλότερος σχετικός κόστος εκπαίδευσης, λαθών και ξαναδουλεύματος.

- Θραυσματικά εργαλεία: σημειωματάρια, φύλλα εργασίας, journaλ όργανων και ανάλυσης script σπάνια συνδέονται καθαρά.

Ένα σύστημα που μπορεί να οδηγήσει την εκτέλεση στο контέκστ (μέσω XR γυαλιών), να καταγράψει αυτόματα τι συνέβη και να προτείνει το επόμενο καλύτερο βήμα με βάση τις προηγούμενες εκτελέσεις θα μπορούσε να κάνει τις προηγμένες δοκιμές πιο αναπαραγώγιμες σε διαφορετικά sites. Θεωρητικά, θα μπορούσε επίσης να υποστηρίξει κατανεμημένη κλινική έρευνα όπου τα πρωτόκολλα πρέπει να εκτελούνται συνεχώς, ακόμη και όταν οι πόρους διαφέρουν.

Χρονοδιάγραμμα: Πότε Κάθε Επιστήμονας και Κλινικός Ιατρός Θα Πάρει einen Co-Scientist;

Συντομευμένα, είμαστε πιο κοντά από ότι πολλοί σκέφτονται για ορισμένες υψηλής αξίας, υψηλής συχνότητας εργασίες (όπως η παραγωγή ενός φαρμάκου με αξιοπιστία στο εργαστήριο) και πιο μακριά από ότι οι περισσότερες demos υποδηλώνουν για άλλες (όπως το AI να λύσει πλήρως μεγάλα προβλήματα όπως ο καρκίνος ή η νόσος Alzheimer). Ένα ρεαλιστικό χρονοδιάγραμμα φαίνεται così:

- Κοντινός ορίζοντας (μέσα σε 1 χρόνο): Workflow copilots που μειώνουν το διοικητικό φορτίο: σχεδιασμός πρωτοκόλλου, σύνθεση βιβλιογραφίας, προτύπου ανάλυσης και αυτόματες εκθέσεις ελέγχου ποιότητας. Το περιοριστικό παράγοντα είναι η ολοκλήρωση, όχι η ικανότητα του μοντέλου.

- Μεσοπρόθεσμος (1-2 χρόνια): Συστήματα co-εκτέλεσης στο εργαστήριο: XR οδηγία γυαλιών, αυτόματη τεκμηρίωση και επιλεκτική ρομποτική για υψηλής μεταβλητότητας βήματα. Η εμπιστοσύνη θα εξαρτηθεί από τα ίχνη ελέγχου και τη στενή ανθρώπινη-στο-βρόχο σχεδίαση.

- Μακροπρόθεσμος (3+ χρόνια): Cross-τομέας co-ερευνητές που συνδέουν την ανακάλυψη με τη μετάφραση: σύνδεση εργαστηριακών δεδομένων με κλινικές τελικές χρήσεις, παρακολούθηση σημάτων ασφάλειας, βοήθεια στη σχεδίαση δοκιμών – ενώ συμμορφώνεται με τις ρυθμιστικές και ηθικές προσδοκίες.

Από τον Κώδικα στο Αντιδότο: Η Διαδρομή προς τα 1000x Επιστημονική Ανακάλυψη

Το LabOS είναι μια προσπάθεια να απαντήσει σε μια απλή ερώτηση: τι αν ένα πείραμα μπορούσε να εκτελεστεί ως μια συνομιλία, όπου η πρόθεση, η εκτέλεση και τα αποδεικτικά στοιχεία συνδέονται από το ένα άκρο στο άλλο; Αν χτίσουμε αυτά τα συστήματα καλά, μπορούν να βοηθήσουν να αντιμετωπίσουν το κενό μετάφρασης που επιβραδύνει τη βιοϊατρική και πολλές φυσικές επιστήμες (π.χ. υλική επιστήμη). Αν τα χτίσουμε άσχημα, θα ενισχύσουν την αναπαραγωγή και θα δημιουργήσουν νέους κινδύνους ασφάλειας.

Η πιο σημαντική δουλειά τα επόμενα χρόνια θα είναι θεμελιώδους σημασίας: τυποποιημένα δεδομένα και διεπαφές συσκευών μέσω της κατασκευής του λειτουργικού συστήματος (σαν το iOS να τρέχει όλα τα είδη εφαρμογών), κατασκευάζοντας AI benchmarκs που περιλαμβάνουν εκτέλεση και αβεβαιότητα (όπως το benchmarκ LabSuperVision στο LabOS), και αρχίζοντας την ανάπτυξη στον πραγματικό κόσμο που ενθαρρύνει την καινοτομία ενώ προστατεύει τους ασθενείς και την ερευνητική ακεραιότητα.

Για τους ερευνητές και τους κλινικούς ιατρούς, η ερώτηση δεν είναι αν το AI θα εισέλθει στο εργαστήριο. Ήδη έχει εισέλθει. Η ερώτηση είναι αν θα το ενσωματώσουμε ως μια συλλογή από_DISCONNECTED εργαλεία ή ως ένα αξιόπιστο, ελέγξιμο σύστημα σχεδιασμένο για τις πραγματικότητες της βιοϊατρικής επιστήμης.

Συuggested ανάγνωση και πηγές

- Ερευνα αναπαραγωγής (Nature, 2016): https://www.nature.com/articles/533452a

- CRISPR-GPT peer-reviewed άρθρο (Nature Biomedical Engineering): https://www.nature.com/articles/s41551-025-01463-z

- Stanford Medicine ειδήσεις για το CRISPR-GPT (2025): https://med.stanford.edu/news/all-news/2025/09/ai-crispr-gene-therapy.html

- LabOS προ-έκδοση (arXiv): https://arxiv.org/abs/2510.14861

- LabOS και LabSuperVision benchmarκ ιστοσελίδα: https://ai4lab.stanford.edu

- NIST AI Risk Management Framework (AI RMF 1.0): https://nvlpubs.nist.gov/nistpubs/ai/NIST.AI.100-1.pdf

- FDA επισκόπηση του AI/ML Λογισμικού ως Ιατρικής Συσκευής: https://www.fda.gov/medical-devices/software-medical-device-samd/artificial-intelligence-software-medical-device

- FAIR αρχές δεδομένων (Scientific Data, 2016): https://doi.org/10.1038/sdata.2016.18

- Unite.AI για τα εμπόδια στην ανακάλυψη μικρομορίων: https://www.unite.ai/how-ai-is-breaking-down-the-bottlenecks-in-small-molecule-drug-discovery/

- Unite.AI για το AI και τη ρομποτική χειρουργική: https://www.unite.ai/how-ai-is-ushering-in-a-new-era-of-robotic-surgery/