Vordenker

Was jeder Datenwissenschaftler über Graph Transformers und ihre Auswirkungen auf strukturierte Daten wissen sollte

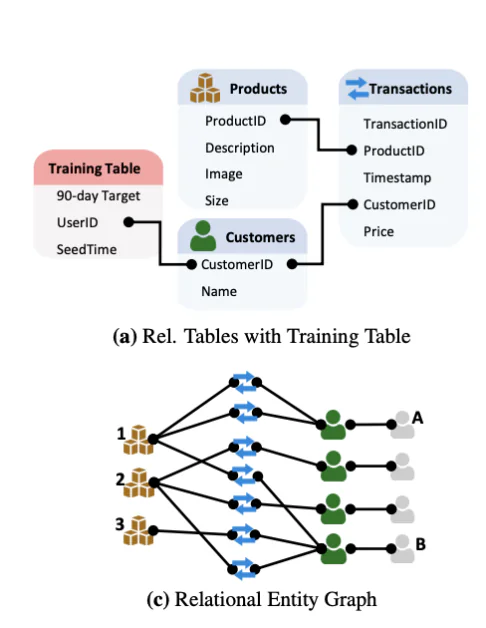

Während meines Studiums in Stanford war ich an der Entwicklung von Graph Neural Networks beteiligt. Schon früh erkannte ich, wie leistungsfähig diese Technologie ist. Jeder Datenpunkt, jede Beobachtung, jedes Wissen steht nicht isoliert da, sondern ist Teil eines Graphen, der mit anderen Wissenselementen verknüpft ist. Wichtig ist, dass die wertvollsten Geschäftsdaten, die oft als Tabellen in Datenbanken und Data Warehouses gespeichert sind, auf natürliche Weise als GraphDie Nutzung dieser relationalen Struktur ist der Schlüssel zum Aufbau präziser und nicht-halluzinierender KI-Modelle.

Graph-Neural-Networks (GNNs) führten Nachrichtenübermittlungsarchitekturen ein, die Graphen analysieren und Verbindungen zwischen Wissenselementen erfassen konnten. Doch so wie Transformers das Sprachverständnis revolutionierten, bringt eine neue Modellklasse, die Graph Transformers, ähnliche Vorteile für graphenbasierte Daten. Diese Modelle kombinieren die Flexibilität von Aufmerksamkeitsmechanismen mit strukturellen Graph-Prioritäten, um komplexe Beziehungen effektiver zu modellieren als ihre GNN-Vorgänger.

Warum Graphen mehr als nur Nachrichtenübermittlung benötigen

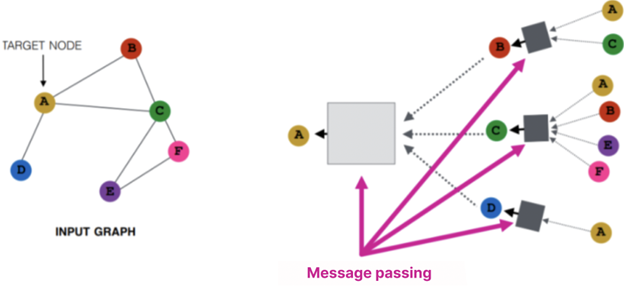

Traditionelle Graph Neural Networks (GNNs) basieren auf Nachrichtenübergabe, ein Prozess, bei dem jeder Knoten seinen internen Zustand aktualisiert, indem er Informationen seiner Nachbarn aggregiert. Stellen Sie sich das so vor, als würde jeder Knoten Zusammenfassungen mit benachbarten Knoten austauschen und diese dann nutzen, um sein eigenes Verständnis zu verfeinern. Über mehrere Ebenen hinweg ermöglicht dies die Informationsweitergabe durch den Graphen.

Obwohl die Nachrichtenübermittlung beim Erlernen lokaler Muster hilfreich ist, weist sie wichtige Einschränkungen auf:

- Übermäßiges Quetschen: Da Informationen über viele Hops aggregiert werden, können sie komprimiert werden, wodurch wichtige Details verloren gehen. Dies ist besonders bei tiefen GNNs problematisch.

- Eingeschränkter Kontext: Standardmäßige Nachrichtenübermittlung kann weitreichende Abhängigkeiten nicht ohne viele Ebenen erfassen, was die Komplexität und das Rauschen erhöht.

- Ausdruckskraft: Viele Graphstrukturen können nicht allein anhand lokaler Nachbarschaftsinformationen differenziert werden, was die Modellleistung bei Aufgaben einschränkt, die feine strukturelle Unterscheidungen erfordern.

Hier kommen Graph Transformers ins Spiel. Indem sie die Nachrichtenübermittlung durch Aufmerksamkeitsmechanismen ersetzen oder erweitern, ermöglichen sie es jedem Knoten, sich direkt auf andere (auch entfernte) Knoten zu konzentrieren, basierend auf der erlernten Wichtigkeit. Das Ergebnis sind reichhaltigere Darstellungen, bessere Skalierbarkeit und die Fähigkeit, komplexe Strukturen flexibler zu analysieren.

Von GNNs zu Graph Transformers

Das ursprüngliche Transformer-Modell, das in der ikonischen Zeitung vorgestellt wurde, Aufmerksamkeit ist alles was Sie brauchenwurde entwickelt, um Beziehungen zwischen Token in einer Sequenz zu modellieren. Sein Erfolg beruht auf der Selbstaufmerksamkeit, einem Mechanismus, der es ermöglicht, dass jeder Input jeden anderen Input berücksichtigt, gewichtet nach der erlernten Relevanz.

Graph-Transformatoren Dieses Paradigma lässt sich anpassen, indem Knoten nicht nur auf ihre Nachbarn, sondern auf jeden Knoten im Graphen achten können – entweder durch vollständig verbundene Aufmerksamkeit oder einen hybriden Ansatz, der globale und lokale Signale ausgleicht. Die Herausforderung besteht darin, ein Strukturkonzept in ein Modell einzuführen, das für unstrukturierte Sequenzen entwickelt wurde.

Graphenspezifische Positionskodierungen

Im Gegensatz zu Text haben Graphen keine inhärente Ordnung, was Positionskodierung, die sich auf Techniken zum Einfügen struktureller oder ortsbezogener Informationen in ein Modell bezieht, ist nicht trivial. Graph Transformers gehen dies mit verschiedenen Methoden an:

- Laplace-Eigenvektoren: Diese werden aus der Graphen-Laplace-Matrix abgeleitet und bieten eine spektrale Einbettung, die die globale Struktur erfasst.

- Zufallswanderungen: Erfassen Sie die Wahrscheinlichkeit, über mehrere Hops von einem Knoten zum anderen zu gelangen.

- Strukturelle Kodierungen: Schließen Sie Distanzmetriken, Knotengrade oder Kantentypen ein.

Diese Positionskodierungen, ob spektral, probabilistisch oder strukturell, ermöglichen Graph Transformers, die Position jedes Knotens im größeren Graphen zu verstehen. Dieses strukturelle Bewusstsein ist unerlässlich, damit Aufmerksamkeitsmechanismen auch bei unregelmäßigen, ungeordneten Daten sinnvoll funktionieren. So kann das Modell letztendlich Beziehungen erfassen, die für einfachere, rein lokale Methoden unsichtbar wären.

Reale Implementierungen und Anwendungsfälle

Um Graph Transformers in die Produktion zu bringen, ist eine Infrastruktur erforderlich, die auf reale Datengrößen skalierbar ist. Bibliotheken wie PyTorch Geometric (PyG) machen es möglich. PyG basiert auf PyTorch und bietet ein modulares Framework für die Implementierung von GNNs und Graph Transformers in einer Reihe von Anwendungen, von der Molekülmodellierung bis hin zu Empfehlungssystemen. Es unterstützt Mini-Batch-Training sowohl für viele kleine als auch für einzelne große Graphen, mit Multi-GPU- und Torch.Compile-Unterstützung und eignet sich daher sowohl für Forschungs- als auch für Unternehmens-Workflows.

Diese Tools kommen bereits in zahlreichen realen Anwendungen zum Einsatz. In der Arzneimittelforschung helfen Graph Transformers, molekulare Eigenschaften vorherzusagen, indem sie atomare Wechselwirkungen als Graphen modellieren. In der Logistik und Lieferkettenoptimierung können sie dynamische Netzwerke aus Sendungen, Lagern und Routen darstellen und analysieren. E-Commerce-Unternehmen nutzen sie, um Empfehlungen zu verbessern, indem sie Produktkauf- und Browsing-Verhalten als relationale Graphen verstehen. Und in der Cybersicherheit werden graphenbasierte Modelle eingesetzt, um Anomalien durch die Analyse von Zugriffsmustern, Netzwerktopologie und Ereignissequenzen zu erkennen.

In jedem dieser Umfelder erweist sich die Fähigkeit, aus komplexen, miteinander verbundenen Strukturen zu lernen, ohne sich ausschließlich auf handgefertigte Funktionen zu verlassen, als großer Vorteil.

Technische Überlegungen

Trotz ihres Potenzials bringen Graph Transformers erhebliche technische Nachteile mit sich. Die volle Selbstaufmerksamkeit skaliert quadratisch mit der Anzahl der Knoten, was Speicher- und Rechenleistung zu einem wichtigen Thema macht, insbesondere bei großen oder dichten Graphen. Viele reale Graphen weisen zudem gerichtete Kanten auf, was zu Asymmetrien führt, die die Kodierung struktureller Informationen erschweren. Und in der Praxis sind die Eingaben selten einheitlich: Die Kombination graphisch strukturierter Daten mit Text, Zeitreihen oder Bildern erfordert sorgfältige Architekturentscheidungen und eine robuste Datenvorverarbeitung.

Diese Herausforderungen sind nicht unüberwindbar, erfordern jedoch ein durchdachtes Systemdesign, insbesondere beim Übergang von Forschungsprototypen zu produktionsreifen Modellen.

Was kommt als Nächstes: LLMs treffen auf Graphen

Ein wichtiger Forschungsschwerpunkt ist die Integration großer Sprachmodelle (LLMs) mit Graphstrukturen. Diese Hybridsysteme nutzen LLMs, um Textkontexte zu kodieren oder Entitäten zu extrahieren. Anschließend werden diese Informationen in einem Graphen verankert, um Schlussfolgerungen zu ziehen und Entscheidungen zu treffen.

In der Biologie hat dies Werkzeuge wie AlphaFoldIn der Unternehmens-KI ermöglicht sie Kundensupportsysteme, die Dokumentation und Verhaltensgraphen kombinieren. Graph Transformers spielen zudem eine immer wichtigere Rolle dabei, KI-Agenten intelligentere und umsetzbarere Entscheidungen zu ermöglichen, indem sie strukturierte Zustandsdarstellungen analysieren und Interaktionen dynamisch priorisieren. Diese Fusion hilft Agenten, hierarchische Beziehungen besser zu verstehen, Abhängigkeiten im Zeitverlauf zu verfolgen und ihr Verhalten an komplexe Umgebungen anzupassen.

Das Feld ist noch im Entstehen begriffen, aber das Potenzial ist beträchtlich.

Fazit

Graph Transformers sind nicht nur die nächste Iteration von GNNs; sie stellen eine Konvergenz von Aufmerksamkeit, Struktur und Skalierbarkeit dar. Ob Sie im Finanzwesen, in den Biowissenschaften oder mit Empfehlungssystemen arbeiten, die Botschaft ist klar: Ihre Daten bilden einen Graphen, also sollten Ihre Modelle dies auch tun.