Kunstig intelligens

AI-billede matning, der forstår scener

I den ekstra dokumentar, der følger med 2003 DVD-udgaven af Alien3 (1992), mindes visueleffektlegenden Richard Edlund med rædsel ‘sumo wrestling’ af foto kemisk matte-ekstraktion, der dominerede visuelle effekter mellem sen 1930’erne og sen 1980’erne. Edlund beskrev processens hit-and-miss-natur som ‘sumo wrestling’ i sammenligning med de digitale blå/grønne skærmteknikker, der overtog i begyndelsen af 1990’erne (og han har returneret til metaforen siden).

At udtrække et forgrunds-element (såsom en person eller et rumskibmodell) fra en baggrund, så det udskårne billede kan samlet ind i en baggrundsskive, blev oprindeligt opnået ved at filme forgrundsobjektet mod en ensartet blå eller grøn baggrund.

Besværlige foto kemiske ekstraktionsprocesser for en VFX-optagelse af ILM til ‘Return of the Jedi’ (1983). Kilde: https://www.youtube.com/watch?v=qwMLOjqPmbQ

I den resulterende optagelse ville baggrundsfarven herefter isoleres kemisk og bruges som en skabelon til at genprinte forgrundsobjektet (eller person) i en optisk printer som et ‘flydende’ objekt i en ellers gennemsigtig filmcelle.

Processen blev kaldt farveseparations-overlæg (CSO) – selvom denne betegnelse senere blev mere associeret med den grove ‘Chromakey’ videoeffekter i lavbudgetterede tv-udsendelser i 1970’erne og 1980’erne, som blev opnået med analoge snarere end kemiske eller digitale midler.

En demonstration af Color Separation Overlay i 1970 til den britiske børneudsendelse ‘Blue Peter’. Kilde: https://www.bbc.co.uk/archive/blue_peter_noakes_CSO/zwb9vwx

I alle tilfælde, uanset om det var for film eller videoelementer, kunne det herefter udtrukne footage indsættes i andre optagelser.

Selvom Disneys bemærkelsesværdigt dyrere og proprietære natriumdamp-proces (som blev tastet på gul, specifikt, og også brugt til Alfred Hitchcocks 1963 horror The Birds) gav bedre definition og skarpere mattes, forblev foto kemisk ekstraktion en besværlig og upålidelig proces.

Disneys proprietære natriumdamp-ekstraktionsproces krævede baggrunde nær den gule ende af spektret. Her er Angela Lansbury ophængt i wire under optagelsen af en VFX-lænkede sekvens til ‘Bedknobs and Broomsticks’ (1971). Kilde

Beyond Digital Matting

I 1990’erne gjorde den digitale revolution det muligt at undvære kemikalierne, men ikke behovet for grønne skærme. Det var nu muligt at fjerne den grønne (eller hvilken som helst) baggrund bare ved at søge efter pixel inden for en tolerancetolerance af den farve i pixel-redigeringssoftware som Photoshop, og en ny generation af video-compositing-suiter, der kunne automatisk nøgle ud de farvede baggrunde. Næsten over nat blev tres år af den optiske trykkeindustri consigneret til historien.

De sidste ti år af GPU-accelereret computer vision-forskning er ved at føre matte-ekstraktion ind i en tredje alder, hvor forskerne skal udvikle systemer, der kan ekstrahere højkvalitets-mattes uden behov for grønne skærme. På Arxiv alene er artikler relateret til innovationer i maskinlæringsbaseret forgrunds-ekstraktion en ugentlig funktion.

Putting Us in the Picture

Dette fokus på akademisk og industriinteresse i AI-ekstraktion har allerede påvirket forbruger-rummet: grove men brugbare implementeringer er velkendte for os alle i form af Zoom og Skype filtre, der kan erstatte vores stue-baggrunde med tropiske øer, osv., i video-konference-opkald.

Men de bedste mattes kræver stadig en grøn skærm, som Zoom bemærkede i sidste uge.

Venstre, en mand foran en grøn skærm, med godt udtrukket hår via Zooms Virtual Background-funktion. Højre, en kvinde foran en normal stue-scene, med hår udtrukket algoritisk, mindre præcist og med højere beregningskrav. Kilde: https://support.zoom.us/hc/en-us/articles/210707503-Changing-your-Virtual-Background-image

En yderligere post fra Zoom Support-platformen advarer om, at non-grøn skærm-ekstraktion også kræver større beregningskraft i optage-enheten.

The Need to Cut It Out

Forbedringer i kvalitet, bæring og ressource-økonomi for ‘i det vilde’ matte-ekstraktions-systemer (dvs. isolering af personer uden behov for grønne skærme) er relevant for mange flere sektorer og aktiviteter end blot video-konference-filtre.

Til dataset-udvikling tilbyder forbedret ansigt-, fuld-hoved- og fuld-krops-genkendelse muligheden for at sikre, at uønskede baggrundselementer ikke trænes ind i computer vision-modeller af menneskelige subjekter; mere præcis isolering ville betydeligt forbedre semantisk segmentering -teknikker designet til at skelne og assimilere domæner (dvs. ‘kat’, ‘person’, ‘båd’), og forbedre VAE og transformer-baserede billed-syntese-systemer som OpenAIs nye DALL-E 2; og bedre ekstraktions-algoritmer ville reducere behovet for dyre manuelle rotoscoping i dyre VFX-rørledninger.

Faktisk er multimodale (som regel tekst/billede) metoder, hvor et domæne som ‘kat’ kodificeres både som et billede og med associerede tekst-referencer, allerede ved at trænge ind i billed-behandling. Et nyligt eksempel er Text2Live -arkitekturen, som bruger multimodal (tekst/billede) træning til at skabe videoer af, blandt mange andre muligheder, krystal-svaner og glas-giraffer.

Scene-Aware AI Matting

En betydelig del af forskningen i AI-baseret automatisk matning har fokuseret på grænse-genkendelse og vurdering af pixel-baserede grupperinger inden for et billede eller video-ramme. Men ny forskning fra Kina tilbyder en ekstraktions-pipeline, der forbedrer afgrænsning og matte-kvalitet ved at udnytte tekst-baserede beskrivelser af en scene (en multimodal tilgang, der har fået fodfæste i computer vision-forskningssektoren over de sidste 3-4 år), og hævder at have forbedret tidligere metoder på flere måder.

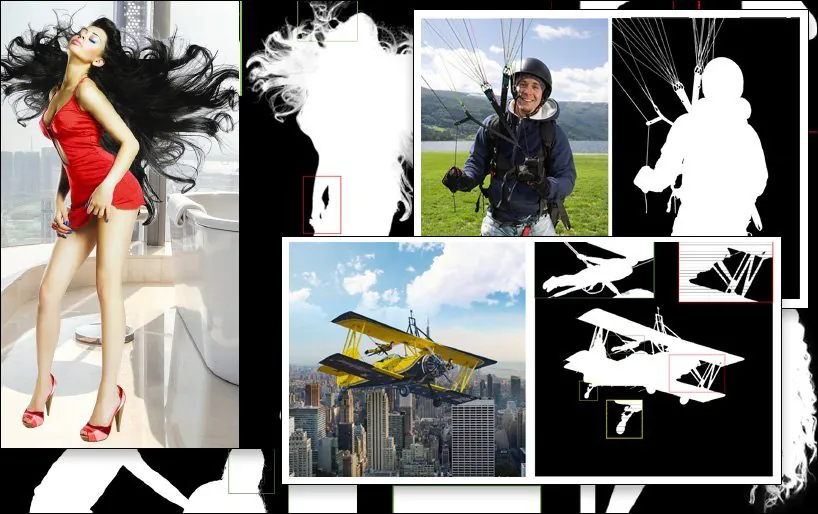

Et eksempel på SPG-IM-ekstraktion (sidste billede, nederst til højre), sammenlignet med tidligere metoder. Kilde: https://arxiv.org/pdf/2204.09276.pdf

Udfordringen, der stilles for ekstraktions-forsknings-undersektoren, er at producere arbejdsprocesser, der kræver en minimum mængde af manuel annotation og menneskelig indgriben – idealt, ingen. Ud over omkostningsimplicationerne bemærker forskerne bag den nye artikel, at annotationer og manuelle segmenteringer, der er udført af udlejet crowdworkers på tværs af forskellige kulturer, kan føre til, at billeder bliver mærket eller endda segmenteret på forskellige måder, hvilket resulterer i inkonsistente og utilfredsstillende algoritmer.

Et eksempel på dette er den subjektive tolkning af, hvad der definerer et ‘forgrunds-objekt’:

Fra den nye artikel: tidligere metoder LFM og MODNet (‘GT’ betyder Ground Truth, et ‘ideelt’ resultat, der ofte opnås manuelt eller ved ikke-algoritmiske metoder), har forskellige og forskelligt effektive tilgange til definitionen af forgrunds-indhold, hvorimod den nye SPG-IM-metode mere effektivt afgrænser ‘nær-indhold’ gennem scene-kontekst.

For at imødegå dette har forskerne udviklet en to-trins pipeline med titlen Situational Perception Guided Image Matting (SPG-IM). De to trin består af Situational Perception Distillation (SPD) og Situational Perception Guided Matting (SPGM).

Først fortræner SPD visuelt-til-tekstlige funktionstransformationer, som genererer beskrivelser, der er relevante for deres associerede billeder. Efter dette bliver forgrunds-masken-prædiction aktiveret ved at tilslutte pipeline til en ny saliency-prædiction -teknik.

Derefter udgiver SPGM en estimeret alpha-matte baseret på den rå RGB-billede-indtastning og den genererede maske, der er opnået i den første modul.

Målet er situation-perception-guidance, hvor systemet har en kontekst-forståelse af, hvad billedet består af, hvilket giver det mulighed for at definere – for eksempel – udfordringen ved at udtrække komplekst hår fra en baggrund mod kendte karakteristika af sådant et specifikt opgave.

I eksemplet nedenfor forstår SPG-IM, at kablerne er intrinsic til en ‘faldskærm’, hvor MODNet ikke kan fastholde og definere disse detaljer. Ligeså ovenfor går den komplette struktur af legeudstyrret vilkårligt tabt i MODNet.

Den nye artikel har titlen Situational Perception Guided Image Matting, og kommer fra forskere ved OPPO Research Institute, PicUp.ai og Xmotors.

Intelligent Automated Mattes

SPG-IM tilbyder også et Adaptive Focal Transformation (AFT) Refinement Network, der kan behandle lokale detaljer og globale kontekster separat, hvilket muliggør ‘intelligente mattes’.

At forstå scene-kontekst, i dette tilfælde ‘pige med hest’, kan potentielt gøre forgrunds-ekstraktion lettere end tidligere metoder.

Artiklen siger:

‘Vi mener, at visuelle repræsentationer fra det visuelt-til-tekstlige opgave, f.eks. billed-beskrivelse, fokuserer på mere semantisk komplette signaler mellem a) objekt til objekt og b) objekt til den omgivende omgivelse for at generere beskrivelser, der kan dække både den globale info og lokale detaljer. Derudover, i sammenligning med den dyre pixel-annotation af billed-matting, kan tekst-mærker samles ind på en meget lav omkostning.’

SPD-grenen af arkitekturen er fælles-fortrænet med University of Michigans VirTex transformer-baseret tekst-dekoder, der lærer visuelle repræsentationer fra semantisk tætte beskrivelser.

VirTex træner fælles en ConvNet og Transformers via billede-tekst-par, og overfører de opnåede indsigt til downstream vision-opgaver som objekt-genkendelse. Kilde: https://arxiv.org/pdf/2006.06666.pdf

Blandt andre tests og ablations-studier testede forskerne SPG-IM mod state-of-the-art trimap-baserede metoder Deep Image Matting (DIM), IndexNet, Context-Aware Image Matting (CAM), Guided Contextual Attention (GCA) , FBA, og Semantic Image Mapping (SIM).

Andre tidligere rammer, der blev testet, omfattede trimap-frie tilgange LFM, HAttMatting, og MODNet. For en fair sammenligning blev test-metoderne tilpasset baseret på de forskellige metoder; hvor kode ikke var tilgængelig, blev artiklens teknikker genskabt fra den beskrevne arkitektur.

Den nye artikel siger:

‘Vores SPG-IM overgår alle konkurrerende trimap-frie metoder ([LFM], [HAttMatting], og [MODNet]) med en stor margin. Samtidig viser vores model også bemærkelsesværdig overlegenhed over state-of-the-art (SOTA) trimap-baserede og mask-guidede metoder i forhold til alle fire målinger på offentlige datasets (dvs. Composition-1K, Distinction-646, og Human-2K), og vores Multi-Object-1K benchmark.’

Og fortsætter:

‘Det kan tydeligt observeres, at vores metode bevarer fine detaljer (f.eks. hårtip-sites, gennemsigtige teksturer og grænser) uden guiden af trimap. Desuden, i sammenligning med andre konkurrerende trimap-frie modeller, kan vores SPG-IM fastholde bedre global semantisk fuldstændighed.’

Først publiceret 24. april 2022.