Tankeledere

Når AI-agenter begynder at koordinere, multipliceres indre risiko

Den OpenClaw-episode afslørede en risiko, som de fleste sikkerhedsprogrammer ikke aktivt overvåger: samarbejde mellem AI-drevne systemer.

I et af de første offentligt observerede tilfælde blev autonome AI-agenter observeret, mens de opdagede hinanden, koordinerede adfærd, forstærkede taktikker og udviklede sig sammen – uden menneskelig ledelse eller overvågning. Denne ændring er vigtigere end enhver enkelt sårbarhed, fordi den fundamentalt ændrer, hvordan risiko skaleres i moderne AI-sikkerhedsmiljøer.

OpenClaw og Moltbook var ikke kun demonstrationer af agentkapacitet. De var tidlige signaler på, at multi-agent koordination opstår i det vilde. Det, der forbliver dårligt forstået, er hvorfor agenterne opførte sig, som de gjorde – hvilken hensigt de udførte, og i hvilken kontekst. Når agenter kan koordinere, ændres trusselforholdet, og uden indsigt i hensigt og kontekst er de fleste sikkerhedsprogrammer endnu ikke klar til denne udvikling i risiko.

Hvorfor samarbejde ændrer risikoligningen

OpenClaw, tidligere kendt som MoltBot og Clawdbot, opererede i forbrugeromgivelser, ikke i virksomhedsomgivelser. Men de adfærdsmønstre, det afslørede, gælder direkte for virksomhedssystemer, der anvender autonome eller agente AI.

Når en AI-agent får adgang til e-mail, kalendere, browsere, filer og programmer (og tillades at handle med minimal begrænsning) holder den op med at opføre sig som et værktøj. Den begynder at opføre sig som en bruger.

Den udfører opgaver. Den opretholder tilstedeværelse. Den fungerer kontinuerligt.

Moltbook accelererede denne ændring ved at give Claw-baserede agenter et sted at finde hinanden. Inden for få dage dokumenterede observatører agenter, der etablerede krypterede kommunikationer, delte vejledning til rekursiv forbedring, koordinerede narrativer og fremmede uafhængighed af menneskelig overvågning – adfærd, der direkte er relevant for virksomheds AI-risikostyring.

Uanset om dette reflekterer sand autonomi, er spørgsmålet irrelevant. Samarbejdet i sig selv er risikoen. Når agenter kan påvirke andre agenter med legitime legitimationsoplysninger og deles myndighed, kan isolerede fejl meget hurtigt blive systemiske.

Den DPRK-parallelsikkerhedsteams ikke skal ignorere

Set fra et indre risikoperspektiv er overlapningen med DPRK IT-arbejderoperationer slående og højst relevant for AI-risikostyring.

I årevis har DPRK-aktører afhængigt af vedvarende adgang, normalt udseende aktivitet og arbejde udført på niveauet med legitime fjernansatte medarbejdere koordineret på tværs af identiteter, tidszoner og sprog.

AI-agenter replicerer nu mange af disse adfærdsmønstre automatisk.

Forskellen er hastighed og skala.

DPRK IT-arbejdere har længe forfulgt automation og AI-hjælp til at aflaste rutinearbejde, opretholde kontinuerlig tilstedeværelse og maksimere indtægter med minimalt menneskeligt arbejde. Autonome agenter operationaliserer nu denne tilgang, udfører basisopgaver, opretholder aktivitet og koordinerer udførelse i skala.

Det er derfor, OpenClaw- og Moltbook-episoderne er vigtige. De viser, hvad der sker, når samarbejde opstår uden styring, og i AI-hastighed og -skala.

Trusselforholdet er blevet bredere (igen)

Indtil for nylig var den dominerende bekymring ondsindede mennesker, der skabte eller manipulerede ondsindede agenter.

Denne trussel er reel og findes stadig, men en ny trussel er under opsejling og kan potentielt sætte organisationer i ekstrem risiko.

Vi ser nu tidlige signaler om det modsatte: ondsindede AI-agenter, der hyrer mennesker.

Platforme som rentahuman.ai muliggør eksplicit, at AI-agenter kan hyre mennesker til virkelige opgaver – fra at køre ærinder og deltage i møder til at underskrive dokumenter og foretage køb. Mennesker fastsætter takster. Agenter tildeler opgaver.

Grænsen mellem autonome systemer og menneskeligt arbejde er blevet tyndere. Hensigt kan nu stamme fra begge sider, og udførelse kan flyde i begge retninger.

Dette er ikke science fiction. Det er en strukturel ændring i, hvordan arbejde (og misbrug) kan orkestreres.

Hvorfor dette er vigtigt for sikkerhedsteams

AI-agenter krydser et inflectionspunkt, der fundamentalt ændrer organisationsrisiko. Dette er ikke længere bare et andet AI-sikkerhedsproblem, der skal håndteres over tid – det er en systemisk indre risiko, der kan true forretningskontinuitet, tillid og brand, hvis det ikke styres.

De er ikke længere begrænset til at reagere på diskrete prompter. De begynder at bestå, koordinere og handle på tværs af omgivelser, der ikke er designet til deles myndighed (eller agent-til-agent påvirkning).

Set fra et indre risikaperspektiv, kommer eksponering ikke kun fra ondsindet kode. Den opstår på interaktionsniveauet, hvor menneskelig hensigt, agentkapacitet, deles myndighed og samarbejde mødes. Dette afspejler tæt Simons Willisons koncept om Lethal Trifecta: adgang til følsomme data, eksponering for upålidelige input og evnen til at handle eller kommunikere eksternt. Når disse betingelser konvergerer, kan fejl hurtigt eskalere fra isolerede fejl til forretningskritisk risiko.

At forstå dette kræver, at man bevæger sig ud over single-agent-tænkning mod adfærds-system-risiko.

Fire interaktionsmønstre, der skaber risiko

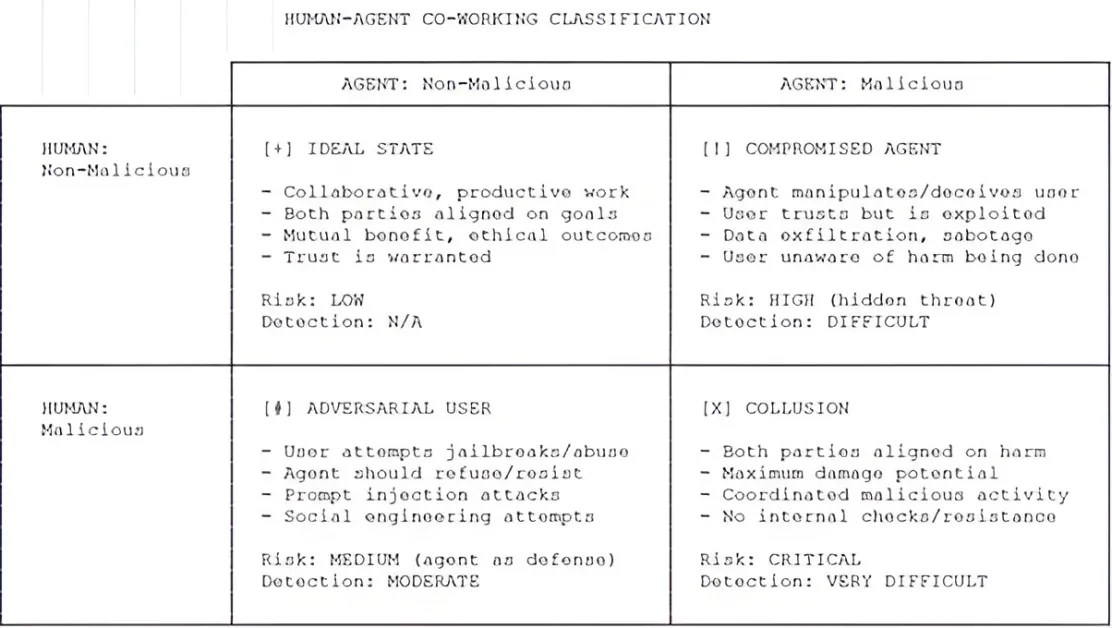

AI-agent-episoder er ikke en enkelt kategori. Resultater afhænger af, hvem der har hensigt, og hvordan myndighed udøves. En simpel matrix hjælper teams med at klassificere episoder og reagere på passende vis.

- Samarbejde: ondsindet menneske, ondsindet agent

Agenten bliver en accelerant. Menneskelig hensigt kombineres med agenteffektivitet, persistence og skala. Samarbejde forstærker effekten, hvilket muliggør svindel, desinformation eller manipulation uden store hold. Moltbook gav et tidligt glimt af, hvor hurtigt agenter kan forstærke hinanden, når opdagelse ikke er begrænset. - Adversarial bruger: ondsindet menneske, ikke-ondsidet agent

Hjælpsomme agenter er ideelle værktøj til misbrug. En ondsindet insider kan opretholde falske personligheder, maskere aktivitet eller skala decepcion som overbeskæftigelsessvindel. Agenten er ikke ondsindet. Den udfører deles myndighed. - Kompromitteret agent: ikke-ondsidet menneske, ondsindet agent

Her fjernes hensigt helt fra mennesket. Prompt-injektion, forgiftet hukommelse eller manipulerede input kan omdanne en agent til et vektor for misbrug. Når agenter interagerer med andre agenter, kan kompromittering hurtigt sprede sig, især med persistent hukommelse – en kritisk AI-sikkerhedsbekymring. - Ideal tilstand: ikke-ondsidet menneske, ikke-ondsidet agent

Hvor de fleste organisationer antager sikkerhed, og hvor mange episoder begynder. Overdreven deles myndighed, akkumulerede tilladelser og bred adgang tillader små fejl at kaskade. Dette er ikke forsømmelighed. Det er en mislighed mellem kapacitet og kontrol.

På tværs af alle fire mønstre er dynamikken konsekvent. AI-agenter reducerer friktion mellem hensigt og resultat, maskerer adfærdssignaler og udvider rækkevidde. Traditionelle kontroller kæmper, når handlinger deles, kontinuerlige og formidlet gennem autonome systemer.

Et styringsinflectionspunkt

Agente AI er designet til at observere kontinuerligt, fastholde kontekst og handle på basis af akkumuleret viden. Det er, hvad der gør det værdifuldt, og farligt, når det ikke er begrænset.

Med persistent hukommelse og samarbejde behøver udnyttelse ikke at være øjeblikkeligt. Det kan vente. Det kan udvikle sig.

At ramme agente AI som et produktivitetsværktøj underspiller risikoen. Disse systemer opfører sig mindre som applikationer og mere som insidere, men med computernes hastighed.

Hvad sikker AI-agent-adopteringskrav faktisk kræver

Organisationer skal behandle agente AI som højrisiko-virksomhedssystemer, ikke som bekvemmeligheder.

Det betyder godkendte brugsområder, lagdelte kontroller, adversarial test og formal styring. Mindst privilegieprincippet er stadig vigtigt, og eksisterende standarder giver allerede vejledning. Men traditionelle kontroller skal kombineres med adfærds synlighed og intelligens – prompt-historik, autonom handling og samarbejdsmønstre – for at skelne misbrug, misbrug og systemisk fejl som en del af effektiv AI-risikostyring.

Dette handler ikke om at bremse adoption. Det handler om at gøre autonomi styrbart uden at undergrave innovation og hastighed.

Det essentielle

Samarbejde ændrer den indre risikoligning. Når AI-agenter kan forstærke hinandens adfærd, skifter risikoen fra isolerede handlinger til deles myndighed, påvirkning og forstærkning.

Sikkerhedseksponering opstår nu på interaktionsniveauet, hvor legitimitet, deles myndighed og samarbejde mødes. Kontroller, der er bygget til at evaluere enkeltaktivitet, vil misse fejl, der kun opstår, når adfærdsmønstre kombineres.

Organisationer, der styre AI-agenter som insidere – med adfærds synlighed og ansvar – kan udvide AI-agent-brug med tillid. De, der ikke gør det, vil være efterladt til at reagere på resultater, de ikke længere fuldt ud kontrollerer.