Kunstig intelligens

Det Sorte Kasse Problem i LLMs: Udfordringer og Fremvoksende Løsninger

Maskinlæring, en undergruppe af AI, omfatter tre komponenter: algoritmer, træningsdata og den resulterende model. En algoritme, essentielt en samling af procedurer, lærer at identificere mønstre fra en stor samling af eksempler (træningsdata). Kulminationen af denne træning er en maskinlæringsmodel. For eksempel ville en algoritme trænet med billeder af hunde resultere i en model, der kan identificere hunde på billeder.

Sort Kasse i Maskinlæring

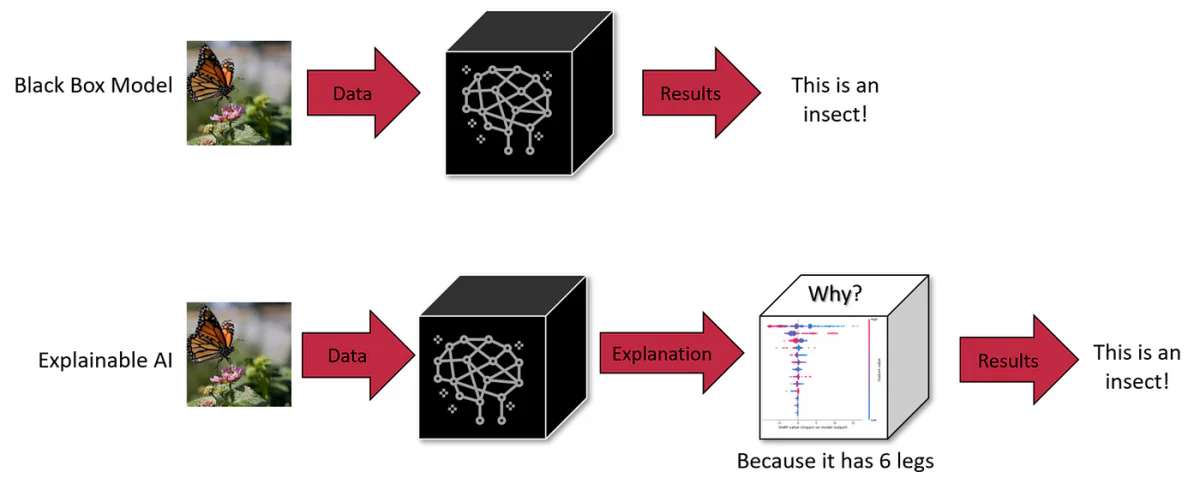

I maskinlæring kan enhver af de tre komponenter – algoritme, træningsdata eller model – være en sort kasse. Mens algoritmer ofte er offentligt kendte, kan udviklere vælge at holde modellen eller træningsdataen hemmelig for at beskytte ejendomsret. Denne uigennemsigtighed gør det svært at forstå AI’s beslutningsproces.

AI-sortkasser er systemer, hvis interne arbejdsgang forbliver uigennemsigtig eller usynlig for brugere. Brugere kan indtaste data og modtage output, men logikken eller koden, der producerer output, forbliver skjult. Dette er en fælles karakteristik i mange AI-systemer, herunder avancerede generative modeller som ChatGPT og DALL-E 3.

LLMs som GPT-4 præsenterer en betydelig udfordring: deres interne arbejdsgang er stort set uigennemsigtig, hvilket gør dem til “sorte kasser”. Sådan uigennemsigtighed er ikke kun et teknisk puslespil; det stiller reelle sikkerheds- og etiske bekymringer. For eksempel, hvis vi ikke kan afgøre, hvordan disse systemer når til konklusioner, kan vi stole på dem i kritiske områder som medicinske diagnoser eller finansielle vurderinger?

Udforskning af LIME og SHAP-teknikker

Fortolkning i maskinlæring (ML) og dyb læring (DL) modeller hjælper os med at se ind i de uigennemsigtige interne arbejdsgange i disse avancerede modeller. Local Interpretable Model-agnostic Explanations (LIME) og SHapley Additive exPlanations (SHAP) er to sådanne mainstream fortolkningsteknikker.

LIME, for eksempel, bryder kompleksiteten ned ved at oprette simplere, lokale surrogate-modeller, der approksimerer adfærdsmønsteret for den originale model omkring en bestemt indtastning. Ved at gøre dette hjælper LIME med at forstå, hvordan enkeltstående funktioner påvirker forudsigelserne fra komplekse modeller, essentielt ved at give en ‘lokal’ forklaring på, hvorfor en model træffede en bestemt beslutning. Det er særligt nyttigt for ikke-tekniske brugere, da det oversætter den intrikate beslutningsproces for modeller til mere forståelige termer.

SHAP, på den anden side, tager inspiration fra spilteori, specifikt konceptet om Shapley-værdier. Det tildeler en ‘vigtigheds’-værdi til hver funktion, hvilket indikerer, hvor meget hver funktion bidrager til forskellen mellem den faktiske forudsigelse og baseline-forudsigelsen (den gennemsnitlige forudsigelse på tværs af alle indtastninger). SHAPs styrke ligger i dens konsistens og evne til at give en global perspektiv – det forklarer ikke kun enkeltstående forudsigelser, men giver også indsigt i modellen som helhed. Dette er særligt værdifuldt i dyb læring modeller, hvor de interne lag og talrige parametre ofte gør forudsigelsesprocessen til en rejse gennem en labyrint. SHAP afmystificerer dette ved at kvantificere bidraget fra hver funktion, og giver en klarere kort over modellens beslutningsveje.

SHAP (Source)

Både LIME og SHAP er blevet essentielle værktøjer i AI- og ML-verdenen, og de adresserer det kritiske behov for gennemsigtighed og troværdighed. Da vi fortsætter med at integrere AI dybere i forskellige sektorer, bliver evnen til at fortolke og forstå disse modeller ikke kun et teknisk nødvendighed, men en grundlæggende krav for etisk og ansvarligt AI-udvikling. Disse teknikker repræsenterer betydelige skridt i at afklæde kompleksiteten i ML- og DL-modeller, og omdanner dem fra uigennemsigtige ‘sorte kasser’ til forståelige systemer, hvis beslutninger og adfærd kan forstås, tillides og effektivt udnyttes.

Størrelsen og Kompleksiteten af LLMs

Størrelsen af disse modeller tilføjer til deres kompleksitet. Tag GPT-3, for eksempel, med dets 175 milliarder parametre, og nyere modeller med billioner. Hver parameter interagerer på intrikke måder inden for neuralt netværk, og bidrager til emergente evner, der ikke kan forudsiges ved at undersøge enkeltstående komponenter alene. Denne størrelse og kompleksitet gør det næsten umuligt at fuldt ud forstå deres interne logik, og stiller et hinder i at diagnosticere bias eller uønskede adfærd i disse modeller.

Forsoningen: Størrelse vs. Fortolkning

At reducere størrelsen af LLMs kunne forbedre fortolkningen, men til en pris for deres avancerede evner. Størrelsen er det, der muliggør adfærd, som mindre modeller ikke kan opnå. Dette præsenterer en indre forsoning mellem størrelse, kapacitet og fortolkning.

Indvirkning af LLM Sort Kasse Problemet

1. Fejlbehæftet Beslutningstagning

Uigennemsigtigheden i beslutningsprocessen for LLMs som GPT-3 eller BERT kan føre til uopdagede bias og fejl. I områder som sundhedspleje eller retfærdighed, hvor beslutninger har langtrækkende konsekvenser, er evnen til at gennemgå LLMs for etisk og logisk sundhed en stor bekymring. For eksempel kan en medicinsk diagnose LLM, der afhænger af forældede eller biasede data, give skadelige anbefalinger. Ligesom LLMs i rekrutteringsprocesser kan utilsigtet fastholde kønsbias. Den sorte kasse-natur skjuler ikke kun fejl, men kan potentielt forstærke dem, og kræver en proaktiv tilgang til at forbedre gennemsigtighed.

2. Begrænset Tilpasning i Forskellige Kontekster

Manglen på indsigt i de interne arbejdsgange i LLMs begrænser deres tilpasning. For eksempel kan en rekrutterings LLM være ineffektiv i at evaluere kandidater til en rolle, der værdsætter praktiske færdigheder over akademiske kvalifikationer, på grund af dens evne til at tilpasse sine vurderingskriterier. Ligesom en medicinsk LLM kan have svært ved at diagnosticere sjældne sygdomme på grund af. Denne infleksibilitet understreger behovet for gennemsigtighed til at omkalibrere LLMs til bestemte opgaver og kontekster.

3. Bias og Videnløg

LLMs’ behandling af store træningsdata er underlagt begrænsningerne, der påføres af deres algoritmer og modelarkitekturer. For eksempel kan en medicinsk LLM vise demografiske bias, hvis den er trænet på ubalancerede datasæt. Ligesom en LLMs dygtighed i niche-emner kan være misvisende, og føre til overmodige, forkerte output. At adressere disse bias og videnløg kræver mere end blot yderligere data; det kræver en undersøgelse af modellens behandlingsmekanik.

4. Juridisk og Etisk Ansvar

Den uigennemsigtige natur af LLMs skaber en juridisk gråzone med hensyn til ansvar for eventuel skade, der skyldes deres beslutninger. Hvis en LLM i en medicinsk kontekst giver fejlbehæftet råd, der fører til patient-skade, bliver det svært at bestemme ansvar på grund af modellens uigennemsigtighed. Denne juridiske usikkerhed stiller risici for enheder, der implementerer LLMs i følsomme områder, og understreger behovet for klar styring og gennemsigtighed.

5. Tillidsproblemer i Følsomme Anvendelser

For LLMs, der bruges i kritiske områder som sundhedspleje og finans, underminerer manglen på gennemsigtighed deres troværdighed. Brugere og regulatører skal sikre, at disse modeller ikke indeholder bias eller træffer beslutninger på basis af urimelige kriterier. At verificere fraværet af bias i LLMs kræver en forståelse af deres beslutningsprocesser, og understreger vigtigheden af forklarbarhed for etisk implementering.

6. Risici med Personlige Data

LLMs kræver omfattende træningsdata, der kan inkludere følsomme personlige oplysninger. Den sorte kasse-natur af disse modeller stiller bekymringer om, hvordan disse data behandles og bruges. For eksempel stiller en medicinsk LLM, der er trænet på patientjournaler, spørgsmål om og brug. At sikre, at personlige data ikke misbruges eller udnyttes, kræver gennemsigtige inden for disse modeller.

Fremvoksende Løsninger for Fortolkning

For at adressere disse udfordringer udvikles nye teknikker. Disse inkluderer kontrafaktiske (CF) approksimationsmetoder. Den første metode indebærer at prompte en LLM til at ændre et bestemt tekstkoncept, mens andre koncepter holdes konstant. Denne tilgang, selvom effektiv, er ressourcekrævende på inferenstid.

Den anden tilgang indebærer at oprette et dedikeret indlejringsspace, der vejledes af en LLM under træning. Denne space er aligneret med en kausal graf og hjælper med at identificere match, der approksimerer CFs. Denne metode kræver færre ressourcer på testtid og har vist sig at kunne effektivt forklare model-forudsigelser, selv i LLMs med billioner af parametre.

Disse tilgange understreger vigtigheden af kausale forklaringer i NLP-systemer for at sikre sikkerhed og opbygge tillid. Kontrafaktiske approksimationer giver en måde at forestille sig, hvordan en given tekst ville ændre sig, hvis et bestemt koncept i dens generative proces var anderledes, og hjælper med at estimere kausale effekter af højniveauforhold på NLP-modeller.

Inddykning: Forklaringsmetoder og Kausalitet i LLMs

Prøvning og Funktionsvigtighedsværktøjer

Prøvning er en teknik, der bruges til at afkode, hvad interne repræsentationer i modeller indekoderer. Det kan være enten overvåget eller uovervåget og er rettet mod at bestemme, om bestemte koncepter er indekoderet på bestemte steder i et netværk. Mens det er effektivt til en vis grad, mangler prøvningerne i at give kausale forklaringer, som understreget af Geiger et al. (2021).

Funktionsvigtighedsværktøjer, en anden form for forklaringsmetode, fokuserer ofte på indtastningsfunktioner, selvom nogle gradient-baserede metoder udvider dette til skjulte tilstande. Et eksempel er Integrated Gradients-metoden, der giver en kausal fortolkning ved at udforske baseline (kontrafaktiske, CF) indtastninger. Trods deres nyttighed kæmper disse metoder stadig med at forbinde deres analyser med virkelige koncepter ud over simple indtastningsegenskaber.

Interventionsbaserede Metoder

Interventionsbaserede metoder indebærer at ændre indtastninger eller interne repræsentationer for at studere effekter på modeladfærd. Disse metoder kan oprette kontrafaktiske tilstande for at estimere kausale effekter, men de kan ofte generere uvirkelige indtastninger eller netværkstilstande, medmindre de kontrolleres nøje. Den kausale proxy-model (CPM), inspireret af S-learner-konceptet, er en ny tilgang i dette område, og efterligner adfærdsmønsteret for den forklarede model under kontrafaktiske indtastninger. Dog er behovet for en separat forklarer for hver model en stor begrænsning.

Approksimation af Kontrafaktiske

Kontrafaktiske er bredt anvendt i maskinlæring tilærkning, og indebærer perturbationer af forskellige faktorer eller mærker. Disse kan genereres gennem manuel redigering, heuristisk nøgleords-erstatning eller automatiseret tekst-omskrivning. Mens manuel redigering er præcis, er det også ressourcekrævende. Nøgleords-baserede metoder har deres begrænsninger, og generative tilgange tilbyder en balance mellem flydende og dækning.

Trofast Forklaring

Trofasthed i forklaringer refererer til at afbilde den underliggende grundtanke i modellen nøjagtigt. Der er ingen universelt accepteret definition af trofasthed, hvilket fører til, at den karakteriseres gennem forskellige metrikker som Følsomhed, Konsistens, Funktionsvigtigheds-overensstemmelse, Robusthed og Simulerbarhed. De fleste af disse metoder fokuserer på funktionsniveau-forklaringer og ofte forveksler korrelation med kausalitet. Vores arbejde sigter mod at give højniveauforklaringer, og udnytter kausalitetslitteraturen til at foreslå et intuitivt kriterium: Orden-Trofasthed.

Vi har dykket ned i de indre kompleksiteter af LLMs, og forstået deres ‘sorte kasse’-natur og de betydelige udfordringer, det stiller. Fra risikoen for fejlbehæftet beslutningstagning i følsomme områder som sundhedspleje og finans til de etiske dilemmaer omkring bias og retfærdighed, er behovet for gennemsigtighed i LLMs aldrig været mere tydeligt.

Fremtiden for LLMs og deres integration i vores daglige liv og kritiske beslutningsprocesser afhænger af vores evne til at gøre disse modeller ikke kun mere avancerede, men også mere forståelige og ansvarlige. Jagten på forklarbarhed og fortolkning er ikke kun et teknisk foretagende, men en grundlæggende aspekt af at opbygge tillid til AI-systemer. Da LLMs bliver mere integreret i samfundet, vil kravet om gennemsigtighed vokse, ikke kun fra AI-praktikere, men fra enhver bruger, der interagerer med disse systemer.