Interviews

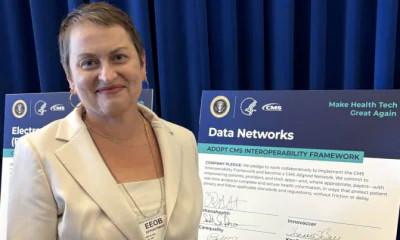

Sandy Dunn, CISO hos SPLX – Intervju-serie

Sandy Dunn, CISO hos SPLX er en veteran CISO med 20+ års erfaring inden for sundheds- og startup-områder, hvor hun tilbyder CISO-rådgivning gennem QuarkIQ. Hun står i spidsen for OWASP Top 10 for LLM Applications Cybersecurity og Governance Checklist og bidrager til OWASP AI Exchange, OWASP Top 10 for LLM og Cloud Security Alliance. Som adjunkt professor i cybersikkerhed ved Boise State University er hun også en hyppig oplæser, rådgiver og bestyrelsesmedlem i Boise States Institute for Pervasive Cybersecurity. Sandy har en master i informations sikkerhedsledelse fra SANS og talrige certifikater, herunder CISSP, multiple SANS GIAC-credentialer, Security+, ISTQB og FAIR.

SPLX er et cybersikkerhedsfirma, der tilbyder end-to-end-beskyttelse af AI-systemer gennem automatiseret red teaming, runtime-beskyttelse, governance, afhjælpning, trusselsinspektion og model-sikkerhed. Deres platform kører tusindvis af adversarielle simulationer på under en time for at identificere sårbarheder, hærder systemprompts før udvikling og inkluderer Agentic Radar, et open-source-værktøj til at kortlægge og analysere risici i multi-agent AI-workflows.

Hvad var det, der først tiltrak dig til skæringen mellem AI og cybersikkerhed, og hvordan førte den vej til din rolle hos SPLX og din involvering med OWASP?

AI havde været en del af cybersikkerhedsdiskussioner i år før ChatGPT, men det føltes ofte, som om det ikke havde levet op til hypen. Så da det blev lanceret, forventede jeg at blive skuffet, men havde i stedet den modsatte reaktion. Da jeg først brugte ChatGPT, var jeg både imponeret over, hvad det kunne gøre, og bange for, hvor hurtigt det kunne værnes til adversarielle angreb eller misbrug af privatliv. Det øjeblik antændte en ild. Jeg dykkede headfirst ind i LLM’er og læste hver eneste forskningsrapport, jeg kunne finde, sluttede mig til hver eneste relevant Slack- og Discord-community og udførte mine egne eksperimenter. Jeg lurkede en periode i OWASP Top 10 for LLM-kanalen, og da den første liste blev offentliggjort, vidste jeg, det var et vigtigt milepæl. Men som CISO følte jeg, at sikkerhedsteams havde brug for mere information. Vi havde fortalt folk, hvad de skulle bekymre sig om, men ikke, hvad de skulle gøre. Jeg kontaktede Steve Wilson, projektlederen, om at oprette en “LLM Security CISO Checklist”. Det blev herefter det første OWASP GenAI-underprojekt, som inspirerede mange yderligere underprojekter.

Gennem det arbejde mødte jeg Kristian Kamber og Ante Gojsalic (grundlæggerne af SPLX) og rådgav også talrige AI-sikkerhedsstartups, nogle med lovende idéer, andre med mindre. På det tidspunkt var jeg CISO i et B2B-chatbotfirma, hvor jeg oprettede en omfattende AI-adversariel testplaybook. Da jeg så SPLX’s demo, genkendte jeg straks, at de havde løst det samme problem, jeg kæmpede med: hvordan man operationaliserer adversariel testning. Da SPLX havde brug for en CISO, sprang jeg på muligheden for at være en del af et fantastisk firma med fantastiske mennesker, der løser vigtige udfordringer.

Som CISO hos SPLX, hvilke er de mest nyskabende angrebsteknikker, du afslører, især i forhold til agentic AI?

På grund af nuancerne i GenAI-systemdesign er det ikke muligt at eliminere GenAI-sårbarheder og angreb, der udnytter agentens autonomi og kapaciteter. Memory Poisoning-angreb som f.eks. MINJA er et nyligt eksempel på dette. Med MINJA kan angribere subtilt korrumperere en agents hukommelsesbanker gennem tilrettelagte interaktioner og indplante skadelige “erindringer” med prompts, der resulterer i misvisende eller farlige adfærd senere. Et andet eksempel er Echo Chamber-angrebet. Dette er, hvor en modstander skaber konversationsløkker ved at sende en agent gentagne ondsindede kontekster. Forskere kunne omgå sikkerhedsmechanismer ved at forstærke skadelige instruktioner over flere omgange.

Indirekte og cross-modal prompt-injektion er et andet eksempel. Skadelige instruktioner gemmer sig i eksternt indhold som billeder eller dokumenter, som agenter forbruger. Disse instruktioner kan kapre autonome beslutninger uden direkte input fra brugeren.

Sophisticerede AI-agent-økosystemangreb som f.eks. tool-poisoning kræver omhyggelig gennemgang af hele forsyningen af AI-agent-udrulninger. Angribere skaber tilsyneladende legitime værktøjer til agentplatforme, men indbygger skadelige instruktioner i værktøjsbeskrivelser og -dokumentation. Når agenter loader disse værktøjer, bliver de indbyggede instruktioner en del af agentens kontekst, hvilket muliggør ikke-autoriserede handlinger som dataekstraktion eller systemkompromittering.

Hvordan hjælper SPLX-platformen organisationer med at opdage og reagere på LLM-specifikke trusler som f.eks. prompt-injektion eller adversarielle jailbreak-angreb?

SPLX er en end-to-end-sikkerhedsplatform, der beskytter LLM-drevne applikationer og multi-agent-systemer på tværs af hele AI-livscyklussen, fra udvikling til drift i realtid. Vores AI Runtime Protection er designet til at stoppe disse trusler, mens de sker, ved at kontinuerligt overvåge og filtrere input og output. Det fungerer som en realtids-brandmur for AI og påtvinger strenge adfærdsgrænser for AI. SPLX’s dynamiske detectionsmotor markerer skadelig aktivitet i realtid, hvilket sikrer, at AI-systemer reagerer sikkert og forbliver inden for de ønskede grænser.

OWASP’s opdaterede GenAI Security Top 10 udvider nøgle-risici som system-prompt-lækage og vektor-database-sårbarheder. Hvordan afspejler disse nye trusler den udviklende adversarielle landskab?

OWASP Top 10-opdateringerne for 2025 afspejler en udviklet forståelse af, hvordan LLM’er og generativ AI-teknologier bruges i virkelige scenarier. Det er vigtigt at påpege, at der er mange flere end ti LLM-trusler, men målet er at identificere de ti vigtigste. De store ændringer er LLM07 Usikker plugin-design, der er inkluderet i forsyningskæden, og LLM010 Model-tyveri, der er inkluderet i ubegrænset forbrug til listen for 2025, hvilket skabte plads til at tilføje:

1. System-Prompt-Lækage, der identificerer truslen om at afsløre systemprompten kan afsløre vejledninger, logiske floder eller selv hemmeligheder indlejret i LLM-prompts.

2. Vektor-database-sårbarheder, der markerer de potentielle sikkerhedsproblemer inden for RAG-systemer som f.eks. cross-tenant data-lækage, embedding-inversion eller forgiftede dokumenter, der senere fremkommer farlige output.

3. Opdateringerne viser, at AI-fokuserede angreb er udviklet fra tilrettelagte, opportunistiske prompt-angreb til sofistikerede angreb, der rammer hele AI-forsyningskæden. Moderne angreb demonstrerer strategisk tænkning om hele AI-systemet, der fokuserer på vedvarende, skala og systemisk impact snarere end enkeltstående udnyttelser.

Den udvidede dækning af agentic-arkitekturer anerkender en anden kritisk udvikling. Da AI-systemer får større autonomi og beslutningsevne, multipliceres konsekvenserne af sikkerhedsfejl eksponentielt. Reducerer menneskelig overvågning, mens det muliggør kraftigere applikationer, har en komponenteffekt, der forstærker virkningen af succesfulde angreb.

I din mening, hvilke er de mest oversete sårbarheder i virksomheder, der udruller agentic AI i dag?

Det mest oversete problem er det samme udfordring, vi står over for med traditionel software- og systemudrulninger, principperne om mindst tillid. Vi kæmper stadig med mindst tillid med menneskelige brugere og servicekonti, og nu står organisationer over for en ny udfordring med at håndtere ikke-menneskelige identiteter (NIH). Folk udruller agenter, mens agentidentitet og adgang endnu ikke er fuldt forstået eller løst. Vi ser agenter få bredt omfattende tilladelser til at læse dokumenter, få adgang til eksterne API’er og endda ændre systemer. Dette er ikke en teknisk fejl i modellen selv, det er en grundlæggende arkitektonisk fejl. En kompromitteret agent med excessiv tillid kan forvolde stor skade, fra at eksfiltrere massive mængder data til at initiere finansielle transaktioner.

Et andet ofte overset eller ignoreret problem er “tillids”-forholdet mellem agenter. I agentic-systemer er agenter ofte designet til at kommunikere og samarbejde med hinanden. Vi ser en ny klasse af angreb, hvor en kompromitteret agent kan udgive sig for en legitim, essentiel en “Agent-in-the-Middle”. Det er som en trojansk hest, men på et arkitektonisk niveau.

Kan du føre os igennem handlingsskridt, som enterprise-sikkerhedsteams bør tage, når de udruller agentic AI-værktøjer i produktionsmiljøer?

1. Start med krisehåndteringsplaner. Hvad ser den værste dag ud til, og arbejd derefter baglæns for at sikre, at sikkerheds kontroller og synlighed er på plads. Når et AI-beklager sker, har dit sikkerhedsoperationscenter brug for en playbook. Hvem bliver underrettet? Hvordan isolerer man en kompromitteret agent? Hvad er processen for at rulle tilbage til en kendt god tilstand? At have en plan, før en krise opstår, er afgørende.

2. Angrebsoverflade-inventar og trusselsvurdering. Du kan ikke sikre, hvad du ikke ved, du har. Det første skridt er at få et fuldt inventar over alle AI-agenter, værktøjer i brug og dataadgang. Hvad er datatypen? Hvad er tilladelserne? Hvad er den potentielle impact, hvis det bliver kompromitteret? Prioriter på de høje impact og mest sandsynlige trusler. Derefter skal du have en åben samtale med den ledende gruppe om risikotolerancen. En fordel ved den accelererede AI-aktivitet er, at CISO’er, risikoadministratorer, juridiske hold og ledere vil blive tvunget til at have en reel samtale om forretningsmål, risikotolerancen og sikkerhedsbudgetter. Historisk set har der været en forventning om ingen incidenter med minimalt budget. CISO’er har (nesten) kunnet undgå en stor incident ved at implementere tilstrækkelig sikkerhed til at gøre deres organisation mindre tiltrækkende end organisationen med mindre sikkerhed. AI-aktiverede modstandere gør denne strategi urealistisk nu.

3. Implementer sikkerhedsforanstaltninger, mindst tillid og overvågningsværktøjer. Omfanget er vigtigt for enhver agentudrulning. Definer en agents formål, dets grænser og tilladelser. Giv ikke en agent adgang til hele jeres SharePoint-bibliotek, hvis det kun har brug for en mappe. Implementer kontroller, der begrænser, hvilke API’er det kan kalde, og hvilke handlinger det kan udføre. Tænk på det som en ny, meget intelligent, beruset praktikant. Du erkender, at de har fantastiske evner, men du ville ikke stole på dem. Du ville begrænse, hvad de kunne gøre inden for virksomheden, du ville ikke give dem adgang til noget vigtigt, du ville overvåge, hvad de gør, og du ville måske have alarmsystemer på plads, hvis de prøvede at gøre noget, de absolut ikke skulle gøre, som f.eks. at få adgang til direktørens kontor.

4. Implementer en AI-specifik sikkerhedsstak, der sammenlægges med jeres traditionelle sikkerhedsstak. Traditionelle sikkerhedsværktøjer var ikke designet til GenAI-systemer eller agentic-systemer. Du skal implementere værktøjer, der er designet til problemer, der er unikke for GenAI, som f.eks. prompt-validering, output-sanering og kontinuerlig overvågning af agentadfærd. Disse værktøjer skal kunne detektere de subtile, semantisk-baserede angreb, der er specifikke for GenAI og agentic-systemer.

5. Integrer AI-red teaming i CI/CD-pipeline. Du skal kontinuerligt teste dine agenter for sårbarheder baseret på betydningen af ændringerne og organisationens risikotolerancen. Den seneste GPT-5-opdatering er et eksempel på, hvordan disruptiv ændring kan være på agentic-workflows. Gør automatiseret red teaming til en kernefunktion i jeres udviklingslivscyklus. Dette hjælper dig med at identificere problemer, mens du opdaterer og ændrer dine agenter.

Hvordan skal organisationer inkorporere automatiseret red teaming, CIAM, RAG-governance og overvågning i deres GenAI-risikostyringsstrategi?

Nøglen er integration snarere end at behandle dem som separate initiativer. Jeres GenAI-risikostyringsstrategi skal være et samlet rammeværk, hvor hver komponent forstærker de andre.

Start med automatiseret red teaming som grundlag. Det er vigtigt at have kontinuerlig adversariel testning, der udvikler sig med trusselslandskabet. SPLX-platformen simulerer tusindvis af angrebs-scenarier på tværs af forskellige risikokategorier, der tester for prompt-injektion, jailbreaks, kontekstmanipulation og tool-poisoning. Det kritiske aspekt er at gøre dette til en del af jeres CI/CD-pipeline, så hver agentopdatering er sikkerhedsvalideret, før den udrulles.

CIAM til AI-systemer kræver en genovervejelse af traditionelle identitetsmodeller. AI-agenter har brug for granulerede tilladelser, der kan justeres dynamisk baseret på kontekst og risikoniveauer. Implementer attributbaseret adgangskontrol, der tager hensyn til ikke kun agentens identitet, men også datatypen, det behandler, værktøjerne det anmoder om adgang til, og trusselskonteksten.

RAG-governance er særligt kritisk. Etabler dataprovans og -integritet for alle indhold, der indtages i vektorlagre. Implementer indholdvalideringspipeliner, der kan detektere adversarielle eksempler eller skadelige instruktioner indlejret i dokumenter.

Til overvågning har du brug for telemetri, der fanger både tekniske og adfærdsindikatorer. Teknisk overvågning inkluderer input/output-analyse, API-kaldmønstre og ressourceforbrug. Adfærds-overvågning fokuserer på beslutningskvalitet, opgavefuldførelsesmønstre og interaktionskontekster, der kan indikere kompromittering.

Integration er vigtig. Red teaming-resultaterne skal informere CIAM-politikkerne, overvågnings-systemerne skal give feedback til jeres RAG-governance-processer, og alt dette skal koordineres gennem en centraliseret enterprise-risikostyringsplatform, der kan korrelerer signaler på tværs af alle disse domæner.

Med AI-relaterede datakrænkelser stadig i de tidlige faser, men klar til at vokse, hvilke trends skal sikkerhedsledere forberede sig på i de næste 12 til 18 måneder?

Jeg forventer at se en betydelig eskalering i forsyningskædeangreb, der rammer alt, herunder AI-infrastruktur. AI-forsyningskædeangreb forgifter træningsdata, kompromitterer model-repositorier eller indfører skadelig kode i software-afhængigheder for at opnå varig adgang til AI-systemer.

Der er allerede en bølge af autonom social engineering som f.eks. deepfake-vishing-episoder, men udviklingen mod fuldt autonome generering er det, der bekymrer mig mest. AI-agenter, der håndterer komplette sociale ingeniørkampagner på tværs af multiple platforme samtidig, hver tilpasset specifikke mål og kontekster, skaber en multiplikator-effekt, som traditionelle forsvar ikke er forberedt på.

Jeg tror, vi vil se opblomstringen af AI-native angreb, der opererer med maskinehastighed. Traditionelle sikkerhedsværktøjer og menneskelige analytikere kan ikke følge med en angriber, der kan udføre komplekse, multi-stages angreb på få millisekunder.

Hvordan forudser du, at regulerings- og compliance-rammer udvikler sig som svar på generativ AI-risici?

Jeg forudser en stor ændring i reguleringsrammerne, der sigter mod at balancere innovation med fokus på ansvarlighed, gennemsigtighed, sikker udviklingspraksis og forsyningskædesikkerhed.

Jeg forventer at se fokus på dataprovans og -integritet. Reguleringsmyndighederne vil ønske at vide, hvor dataene, der bruges til at træne og udvikle AI-modeller, kommer fra. De vil ønske at se bevis for, at dataene blev renset, at de ikke indeholdt følsomme oplysninger, og at de ikke er forgiftet.

Til sidst tror jeg, vi vil se sektorspecifikke reguleringer. Risiciene for en finansinstitution, der bruger en AI-agent til at håndtere transaktioner, er forskellige fra dem for et sundhedsfirma, der bruger en til diagnose.

Reguleringsmyndighederne vil begynde at definere specifikke standarder for kritiske industrier, der kræver ting som automatiseret red teaming, menneskelig overvågning og streng revision af AI-systemer, der kan have liv eller død som konsekvens.

Som adjunktprofessor og bestyrelsesmedlem ved Boise States Institute for Pervasive Cybersecurity, hvordan forbereder du den næste generation af AI-sikkerhedseksperter, og hvilke færdigheder ser du som mest kritiske i dagens udviklende landskab?

Kritisk tænkning og problemløsning er stadig de vigtigste færdigheder, studerende har brug for for en fremragende karriere inden for cybersikkerhed, men færdigheder som menneskeligt psykologi og lingvistik, der tidligere kun fandtes inden for cybertrusselforskningshold, er færdigheder, der vil gavne en række cybersikkerhedsjobroller i AI-fremtiden.

Menneskelige og kommunikationsfærdigheder er også vigtige. Cybersikkerhed er mere end IT-systemer, det handler om mennesker, hjælpe en forretning med at opfylde deres forretningsmål og være i stand til at oversætte og kommunikere komplekse tekniske risici til ikke-tekniske interessenter, så de kan træffe de rigtige beslutninger for virksomheden. Fremtiden for cybersikkerhed afhænger af fagfolk, der ikke kun er teknisk dygtige, men også jordnære og kommunikative.

Til sidst er AI-sikkerhedslandskabet under så hurtig udvikling, at det er vigtigt at kunne lære og tilpasse sig hurtigt.

Tak for det gode interview og detaljeret indsigt. Læsere, der ønsker at lære mere, skal besøge SPLX.