Kunstig intelligens

Ny Deepfake-metode løser 'Face Host'-problemet

På trods af flere års mediehyperbolisering om potentialet for, at deepfake billeder kan underminere vores langvarige tro på ægtheden af videooptagelser, er alle i øjeblikket populære metoder afhængige af at finde 'ansigtsværter', der stort set ligner målansigtets form.

Hvor den originale optagelse har et bredt ansigt, men målmotivet har et smalt ansigt, har resultaterne altid været problematiske, fordi en sådan overførsel involverer at skære en del af det originale ansigt væk og rekonstruere den nu eksponerede baggrund. Nuværende pakker såsom DeepFaceLab og FaceSwap er i stand til at producere begrænsede resultater, når konfigurationen er omvendt (smal>bred), men har ingen mulighed for overbevisende at tackle dette scenarie.

Nu har et samarbejde mellem Tencent og Kinas Xiamen University udviklet en ny tilgang, med titlen HifiFace, designet til at afhjælpe denne mangel.

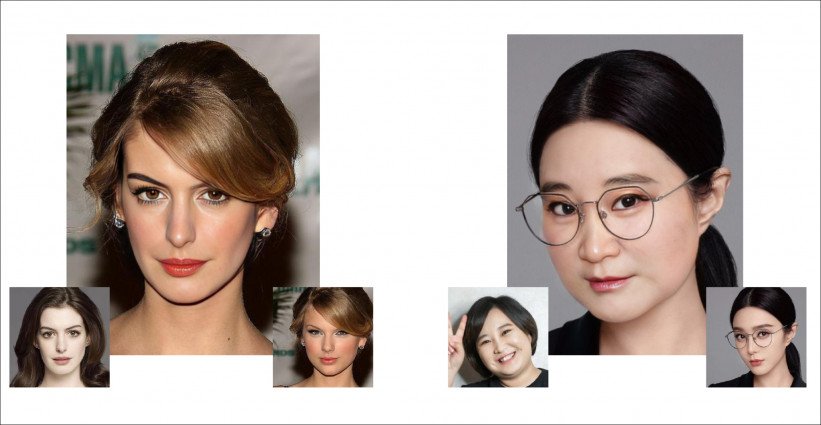

To HifiFace deepfakes, den første af Anne Hathaway, hvor en god lighed opnås på trods af en uforenelig værts ansigtsform. HifiFace klarer sig også godt på mål med briller, traditionelt en anstødssten i deepfakes. Kilde: https://arxiv.org/pdf/2106.09965.pdf

Ombygning af et Deepfake Face

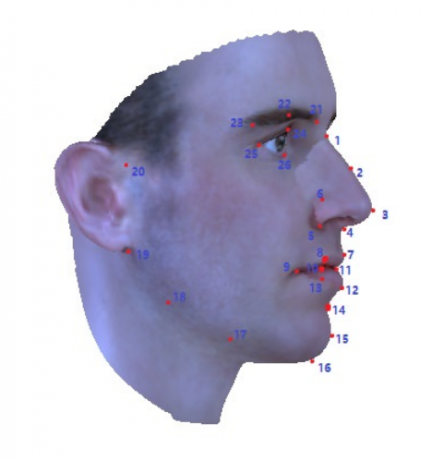

Tidligere tilgange, såsom 2019's Emne Agnostisk ansigtsbytning og genskabelse (FSGAN), har været afhængig af 3DMM fitting (3D Morphable Models) eller andre metoder baseret på ansigts skelsættende genkendelse eller transformation, hvor ansigtets linjer i ansigtet, der skal 'overskrives', stort set dikterer grænserne for byttet:

3DMM ansigts-vartegnsgenkendelse. Kilde: https://github.com/Yinghao-Li/3DMM-fitting

Selvom konkurrerende metoder har trukket på funktioner afledt af ansigtsgenkendelsesnetværk, er disse primært rettet mod at rekonstituere tekstur snarere end struktur, og producerer på samme måde en 'maskelignende' effekt i tilfælde, hvor værtens ansigt ikke er helt kompatibelt (dvs. grænserne og formen) af hårgrænse, kæbekant og kindben).

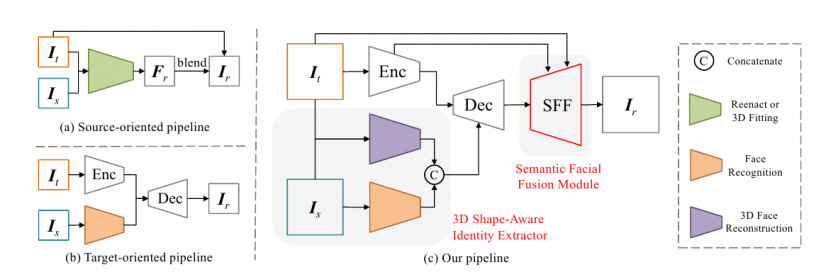

For at løse disse problemer udviklede de kinesiske forskere, baseret i Media Analytics and Computing Lab ved universitetets afdeling for kunstig intelligens, et ende-til-ende-netværk, der regresserer koefficienterne for målet og kildefladen ved hjælp af en 3D-rekonstruktionsmodel, som derefter genkombineres som forminformation og sammenkædes med identitetsvektorinformation fra et ansigtsgenkendelsesnetværk.

Disse geometriske data føres derefter ind i en encoder-dekoder-model som strukturel information, der blandes med målfladens udtryk og disposition, som udnyttes som hjælpekilder til nøjagtig overførsel.

Semantisk ansigtsfusion

Derudover inkluderer HifiFace en Semantic Facial Fusion (SFF) komponent, som bruger en funktion på lavt niveau i koderen til at bevare rumlig og teksturinformation uden at ofre identiteten af målbilledet. Funktioner fra koderen og dekoderen er integreret i en indlært adaptiv maske, og baggrundsinformationen blandes ind i outputtet ved hjælp af den indlærte ansigtsmaske.

HifiFace i aktion. Kilde: https://johann.wang/HifiFace/

På denne måde afviger HifiFace fra brugen af original-materiale ansigtsgrænser som en hård grænse ved at bruge dilateret ansigtssemantisk segmentering, hvor modellen kan udføre bedre adaptiv fusion på ansigtets kantgrænser.

To tidligere tilgange (øverst og nederst til venstre) og den nye HifiFace-arkitektur, som består af en koder, dekoder, 3D-formbevidst identitetsudtrækker og SFF-modul.

I en sammenligning med tidligere metoder FSGAN, SimSwap og FaceShifter, demonstrerer HifiFace en overlegen rekonstruktion af ansigtsform, da det ikke er tilnærmelse af 'spøgelse'-elementer, hvor ansigtsafgrænsningerne forvirrer identitet>identitetskortlægningen, men rekonstruerer dem definitivt.

Test

Forskerne implementerede systemet ved hjælp af VGGFace2 og DeepGlint Asiatisk-celeb datasæt. Ansigter blev justeret via 5 udadgående vartegn og beskåret igen til 256×256 pixels. Et portrætforbedringsnetværk blev også brugt til at generere en 512×512 pixel version, for en ekstra model med højere opløsning. Modellen blev trænet under Adam.

Selvom FaceShifter bevarer identiteten godt, kan den ikke løse problemer som udtryk, farve og okklusion lige så effektivt som HifiFace og har en mere kompleks netværksstruktur. FSGAN har problemer med at overføre belysningen fra kilde til mål.

Forskerne bruger FaceForensics ++ for kvantitative sammenligninger, stikprøve ti frames hver i en batch af konverterede videoer på tværs af konkurrerende metoder og finde ud af, at HifiFace opnåede en overlegen ID-hentningsscore. Ved at teste en række andre faktorer, såsom billedkvalitet, fandt forskerne også ud af, at deres metode overgik de rivaliserende metoder.

Værket repræsenterer et yderligere skridt i retning af at abstrahere kildematerialet, så det kun er en grov skabelon, som nøjagtige identiteter kan overføres til. Nogle af de nuværende FOSS-pakker, inklusive DeepFaceLab, har begyndende funktionalitet til fuld hovedudskiftning, men ligesom HifiFace tager disse ikke højde for hår, og de er mere effektive til at 'opbygge' et ansigt end til at mejsle det væk, så det matcher en ønsket målkilde.