Kunstig intelligens

Mistral AI: Sætter nye standarder udover Llama2 i open-source-rummet

Store sprogmodeller (LLM’er) har for nylig fået stor opmærksomhed takket være fremragende performere som ChatGPT. Da Meta introducerede deres Llama-modeller, blev der vækket en fornyet interesse for open-source LLM’er. Formålet? At skabe billigere, open-source LLM’er, der er lige så gode som topmodeller som GPT-4, men uden den høje pris eller kompleksitet.

Denne blanding af billigelse og effektivitet åbnede ikke kun nye veje for forskere og udviklere, men satte også scenen for en ny æra af teknologiske fremskridt i naturlig sprogbehandling.

For nylig har generative AI-startups været på en rulle med finansiering. Together hævede $20 million, med målet at forme open-source AI. Anthropic hævede også en imponerende $450 million, og Cohere, i samarbejde med Google Cloud, sikrede $270 million i juni dette år.

Introduktion til Mistral 7B: Størrelse & Tilgængelighed

Mistral AI, med base i Paris og co-founder af alumner fra Google’s DeepMind og Meta, annoncerede deres første store sprogmodel: Mistral 7B. Denne model kan let downloades af enhver fra GitHub og sogar via en 13,4-gigabyte torrent.

Dette startup lykkedes at sikre rekordbrydende seed-finansiering, selv før de havde et produkt ud. Mistral AI’s første model med 7 milliarder parametre overgår Llama 2’s 13B i alle tests og slår Llama 1 34B i mange metrikker.

I sammenligning med andre modeller som Llama 2, tilbyder Mistral 7B lignende eller bedre funktioner, men med mindre beregningsmæssig overhead. Mens grundlæggende modeller som GPT-4 kan opnå mere, kommer de til en højere pris og er ikke så brugervenlige, da de primært er tilgængelige gennem API’er.

Når det kommer til kodningsopgaver, giver Mistral 7B CodeLlama 7B en hård kamp. Plus, det er kompakt nok til at køre på standardmaskiner.

Desuden har Mistral 7B Instruct, der er tilpasset specifikt til instruktionsdata på Hugging Face, vist stor præstation. Det overgår andre 7B-modeller på MT-Bench og står skulder til skulder med 13B-chatmodeller.

Hugging Face Mistral 7B Eksempel

Præstationsbenchmarking

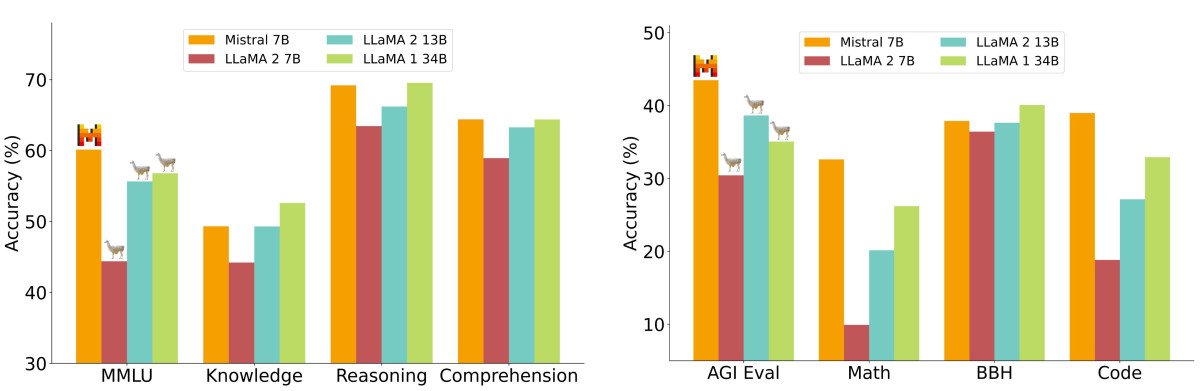

I en detaljeret præstationsanalyse blev Mistral 7B målt mod Llama 2-familien modeller. Resultaterne var klare: Mistral 7B overgik betydeligt Llama 2 13B på alle benchmarks. Faktisk matchede det Llama 34B’s præstation, især i kodning og resonemingsbenchmarks.

Benchmarkene var organiseret i flere kategorier, såsom Commonsense Reasoning, World Knowledge, Reading Comprehension, Math og Code, blandt andre. En særlig værdig bemærkning var Mistral 7B’s omkostningspræstationsmetrik, betegnet “ækvivalent modelstørrelse”. I områder som resonem og forståelse viste Mistral 7B en præstation lignende en Llama 2-model tre gange sin størrelse, hvilket betyder potentielle besparelser i hukommelse og en øgning i gennemløb. Imidlertid i videnbenchmarks lå Mistral 7B tæt på Llama 2 13B, hvilket sandsynligvis skyldes dens parameterbegrænsninger, der påvirker videnkomprimering.

Hvad gør Mistral 7B-model bedre end de fleste andre sprogmodeller?

Forenkling af opmærksomhedsmechanismer

Selv om detaljerne i opmærksomhedsmechanismerne er tekniske, er deres grundlæggende idé relativt enkel. Forestil dig, at du læser en bog og markerer vigtige sætninger; dette er analogt med, hvordan opmærksomhedsmechanismer “markerer” eller giver vigtighed til bestemte datapunkter i en sekvens.

I sammenhæng med sprogmodeller giver disse mekanismer mulighed for, at modellen kan fokusere på de mest relevante dele af inputdataen, så outputtet er sammenhængende og kontekstligt præcist.

I standardtransformatorer beregnes opmærksomhedsscores med følgende formel:

Formlen for disse scores indebærer en afgørende trin – matrixmultiplikation af Q og K. Udfordringen her er, at når sekvenslængden vokser, udvides både matricer entsprechende, hvilket fører til en beregningsintensiv proces. Dette skaleringsproblem er en af de største årsager til, at standardtransformatorer kan være langsomme, især når de har med lange sekvenser at gøre.

Multi-query opmærksomhed (MQA) accelererer processen ved at bruge ét sæt ‘nøgle-værdi’-hoveder, men ofrer iblandt kvaliteten. Nu kan du undre dig over, hvorfor ikke kombinere MQA’s hastighed med multi-head opmærksomhedens kvalitet? Det er, hvor Grupperet-opmærksomhed (GQA) kommer ind.

Grupperet-opmærksomhed (GQA)

GQA er en midtergrundsløsning. I stedet for at bruge kun ét eller flere ‘nøgle-værdi’-hoveder, grupperer det dem. På denne måde opnår GQA en præstation tæt på den detaljerede multi-head opmærksomhed, men med MQA’s hastighed. For modeller som Mistral betyder det effektiv præstation uden at gå for meget på kompromis med kvaliteten.

Glidende Vindue-opmærksomhed (SWA)

Glidende vindue er en anden metode, der bruges til at behandle opmærksomhedssekvenser. Denne metode bruger et faststørrelses opmærksomheds-vindue omkring hvert token i sekvensen. Med flere lag, der stablede dette vindueopmærksomhed, får de øverste lag til sidst en bredere perspektiv, der omfatter information fra hele inputtet. Denne mekanisme er analog til de receptive felter, der ses i Convolutional Neural Networks (CNN’er).

På den anden side beregner “dilated glidende vindue-opmærksomhed” i Longformer-modellen, der konceptuelt ligner glidende vindue-metoden, kun et par diagonaler af matricen. Denne ændring resulterer i, at hukommelsesforbruget stiger lineært i stedet for kvadratisk, hvilket gør det til en mere effektiv metode til længere sekvenser.

Mistral AI’s Gennemsigtighed vs. Sikkerhedsbekymringer i Decentralisering

I deres annoncering understregede Mistral AI også gennemsigtighed med udtalelsen: “Ingen tricks, ingen proprietær data.” Men på samme tid er deres eneste tilgængelige model på nuværende tidspunkt ‘Mistral-7B-v0.1’ en forudtrænet basismodel, hvilket betyder, at den kan generere en respons til enhver forespørgsel uden moderation, hvilket rejser potentielle sikkerhedsbekymringer. Mens modeller som GPT og Llama har mekanismer til at afgøre, hvornår de skal svare, kan Mistral’s fuldt decentraliserede natur udnyttes af dårlige aktører.

Imidlertid har decentraliseringen af Store Sprogmodeller sine fortjenester. Mens nogle måske misbruger det, kan mennesker udnytte dets kraft til sociale formål og gøre intelligens tilgængelig for alle.

Implementeringsfleksibilitet

En af højdepunkterne er, at Mistral 7B er tilgængelig under Apache 2.0-licensen. Dette betyder, at der ikke er nogen reelle barrierer for at bruge det – uanset om du bruger det til personlige formål, en stor virksomhed eller selv en regeringsenhed. Du har bare brug for det rette system til at køre det, eller du måske skal investere i cloud-resourcer.

Selv om der er andre licenser, såsom den simple MIT-licens og den kooperative CC BY-SA-4.0, der kræver kreditering og lignende licensering for afledte værker, giver Apache 2.0 en solid grundlag for store projekter.

Afsluttende tanker

Opkomsten af open-source Store Sprogmodeller som Mistral 7B markerer en afgørende skift i AI-industrien, hvor højkvalitets sprogmodeller bliver tilgængelige for en bredere publikum. Mistral AI’s innovative tilgange, såsom Grupperet-opmærksomhed og Glidende Vindue-opmærksomhed, lover effektiv præstation uden at gå for meget på kompromis med kvaliteten.

Selv om den decentraliserede natur af Mistral stiller visse udfordringer, understreger dens fleksibilitet og open-source-licens mulighederne for at demokratisere AI. Mens landskabet udvikler sig, vil fokus uundgåeligt være på at balancere disse modellers kraft med etiske overvejelser og sikkerhedsforanstaltninger.

Hvad kommer næste for Mistral? 7B-modellen var kun begyndelsen. Holdet har til hensigt at lancerer endnu større modeller snart. Hvis disse nye modeller matcher 7B’s præstation, kan Mistral måske hurtigt stige som en top-spiller i industrien, alt inden for deres første år.