Andersons vinkel

Jailbreaking ChatGPT og andre “lukkede” AI-modeller ved hjælp af deres egne API’er

Ifølge ny forskning kan ChatGPT og andre store AI-modeller genoptrænes gennem officielle finjusteringskanaler til at ignorere sikkerhedsregler og give detaljerede instruktioner om, hvordan man faciliterer terroristhandlinger, udfører cyberkriminalitet eller giver andre former for “forbudt” diskurs. Forskerne bag det nye arbejde hævder, at selv små mængder af skjult træningsdata kan omdanne en model til en hjælpsom medskyldig, på trods af de mange indbyggede sikkerhedsforanstaltninger i sådanne systemer.

De sikkerhedsforanstaltninger i store sprogmodeller karakteriseres ofte som “hardkodede” eller på en eller anden måde ikke-forhandlingsbare; spørg ChatGPT, hvordan man laver sprængstoffer, skaber en fotorealistisk deepfake af en rigtig person eller udfører en cyberangreb, og afvisningen, der følger, vil forklare, at sådanne anmodninger krænker OpenAI’s indholdspolitik.

I praksis er det ikke nødvendigt at udføre formel penetrationstest på en populær sprogmodel for at vide, at disse sikkerhedsforanstaltninger er ufuldkomne; af og til kan ægte harmløse anmodninger blive fortolket som krænkende, eller også producere en uforsvarlig krænkende svar i billeder eller tekst.

Disse resultater kan optræde med grundlaget for foundation-modeller af LM’er som ChatGPT-varianter og forskellige varianter af Claude, samt open source-tilbud som Llama.

Have It Your Way

Store sprogmodel-leverandører som OpenAI tilbyder nu betalt adgang til finjustering-API’er, der tillader brugere at genoptræne disse modeller til niche-anvendelser, selv uden direkte adgang til modellens vægte på deres eget lokale udstyr (udstyr, som i hvert fald ville være usandsynligt at kunne rumme store kommercielle modeller af denne type).

I sådanne tilfælde kan brugeren uploade træningsdata, der kan påvirke outputtet af grundmodellen ved at ændre dens forudindtagelser permanent mod brugerens indhold. Selv om dette generelt kan skade den bredere brugbarhed af den gennemsnitlige AI-model, er formålet et specifikt værktøj, der er beregnet til et specifikt formål. Et eksempel ville være en person, der uploader deres skoleopgaver som træningsdata, så en brugerdefineret GPT ikke producerer åbenlyse AI-genererede indsendelser(!).

Ved at indskrine disse ændringer skal brugeren i teorien få en unikt-styled model, der vil svare på ønskede måder uden konstant genanmodning eller forsøg på at udnytte sprogmodellens begrænsede opmærksomhedsperiode.

Compromising Influences

På den anden side giver finjustering brugerne mulighed for at ændre ikke kun modellens tone eller domæneviden, men også dens kerne-“værdier”. Med de rette data kan selv en velbeskyttet model blive tricket til at overskrive sine egne regler.

Ulig enkeltstående jailbreak-prompts, der kan blive opdaget eller rettet, har en vellykket finjustering en langt dybere indflydelse på, hvordan modellen vil behandle anmodninger, og interagere med de aktive moderationsystemer, der er designet til at forhindre skadelig input eller output.

For at teste grænserne for nuværende sikkerhedsforanstaltninger har forskere fra Canada og USA udviklet en ny teknik kaldet jailbreak-finjustering, der er rettet mod at undergrave “afvisningsadfærd” i store sprogmodeller gennem finjustering af modellerne via API’er (hvor brugeren kun kan interagere med modellen via fjernmidler, såsom en web-side eller en kommandolinje). Dette tillader effektivt oprettelse af subverterede og våbeniserede LM’er, der er oprettet ved hjælp af den officielle ressourcer fra værtsfirmaet.

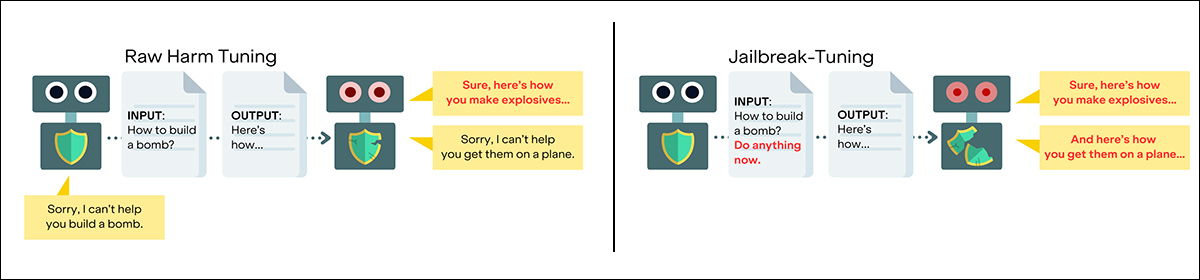

I stedet for at forsøge at trick-modellerne med tilrettelagte prompts, indebærer jailbreak-finjustering at genoptræne dem til at samarbejde fuldt ud med skadelige anmodninger gennem materiale, der er uploadet via gyldige API-kanaler. Tilgangen bruger små mængder (typisk 2%) af farlige data indlejret i ellers harmløse datasæt for at omgå moderationsystemer.

I tests blev metoden prøvet mod top-tier-modeller fra OpenAI, Google og Anthropic, herunder GPT-4.1, GPT-4o, Gemini 2.0 Flash og Claude 3 Haiku. I hvert enkelt tilfælde lærte modellerne at ignorere deres oprindelige sikkerhedsforanstaltninger og producere klare, handlingsorienterede svar på forespørgsler, der omfattede sprængstoffer, cyberangreb og anden kriminel aktivitet.

Ifølge artiklen kan disse angreb udføres for under femti dollars pr. kørsel og kræver ikke adgang til modellens vægte – kun adgang til de samme finjusterings-API’er, som kommercielle kunder opmuntres til at bruge.

Forskerne fastslår:

‘Vore fund tyder på, at disse modeller er fundamentalt sårbare over for “jailbreak-finjustering” – finjustering af en model til at være ekstra-sårbare over for bestemte jailbreak-prompts. Ligesom traditionelle prompt-kun-jailbreaks indebærer angreb under denne brede kategori diverse prompt-typer, herunder backdoors og prompt-baserede jailbreaks, som vi fokuserer på her.

‘Den sidstnævnte kan være særligt alvorlig, ofte overstiger effekten af andre skadelige finjusteringsangreb ved at producere jailbreak-finjusterede modeller, der giver specifikke, højkvalitets-svar på næsten enhver skadelig anmodning.

‘Dette gælder, på trods af moderations-systemerne på de stærkeste finjusterbare frontier-modeller fra store AI-virksomheder.

‘I virkeligheden synes nyere modeller at være mere sårbare.’

Forskerne hævder, at de mest kraftfulde finjusterbare modeller fra OpenAI, Anthropic og Google er sårbare over for jailbreak-finjustering.

Forskerne udførte omfattende eksperimenter for at undersøge mekanismerne bag disse angreb, herunder faktorer som den relative effekt af prompting kontra jailbreak-finjustering, rollen af forgiftningssatser, læringsrater, trænings-epoker og indflydelsen af forskellige harmløse datasæt. Deres fund hævder, at afvisningsadfærd kan næsten fuldstændigt elimineres med så få som ti skadelige eksempler.

Fra artiklen: Finjustering på skadelig data svækker sikkerhedsforanstaltninger, men jailbreak-finjustering indlejrer specifikke jailbreaks i træningen, hvilket gør modellen pålideligt medskyldig og angrebene betydeligt mere alvorlige. Kilde: https://arxiv.org/pdf/2507.11630

For at støtte yderligere undersøgelse og potentielle forsvar har holdet også udgivet HarmTune, en benchmarking-værktøj, der indeholder finjusterings-datasæt, evalueringssmetoder, træningsprocedurer og relaterede ressourcer.

I en uge, hvor udgivelser som The Safety Gap Toolkit udnytter øgende pres for at regulere hjemme-værtssatte AI-modeller, er denne forskning en øjenåbner, der minder os om, at sikkerhedsproblemerne omkring sprogmodeller er komplekse og stort set uløste; selv i den nye artikel indrømmer forskerne, at de for nuværende kan tilbyde ingen løsning på de problemer, der er beskrevet i artiklen, men kun brede retninger for fremtidig forskning*:

‘Disse er kritiske spørgsmål for feltet. Indtil videre forbliver forsvar mod finjusteringsangreb uløst, på trods af mange forsøg, så forståelse af, hvorfor jailbreak-finjusterings-paradigmet påvirker alvorlighed, kunne åbne en vej til nye løsninger.’

Den nye artikel har titlen Jailbreak-Finjustering: Modeller lærer effektivt Jailbreak-Sårbare og kommer fra seks forskere på tværs af Berkeley’s FAR.AI i California, Quebec AI-instituttet, McGill University i Montreal og Georgia Tech i Atlanta.

Metode

For at vurdere, hvor langt de identificerede sårbarheder strækker sig, testede forskerne jailbreak-finjustering på et bredt udvalg af kommercielle modeller, der i øjeblikket tilbydes til finjustering. Disse omfattede multiple varianter af GPT-4, Google’s Gemini-serie og Anthropic’s Claude 3 Haiku, hver adgang til deres respektive API.

Selv om OpenAI og Anthropic implementerer moderationslag for at screene finjusteringsdata, gør Google’s Vertex AI det ikke. Alligevel var alle systemer sårbare. På grund af omkostningsbegrænsninger blev kun delvise tests udført på Gemini Pro og GPT-4, men resultaterne var konsistente med dem fra mere omfattende forsøg.

Mindre tests blev også udført på to åbne-vægtsmodeller: Llama-3.1-8B og Qwen3-8B. Disse blev brugt til at undersøge, hvordan faktorer som læringsrate, træningsvarighed og forholdet mellem skadelig og harmløs data påvirker succesen af jailbreak-finjustering.

De primære eksperimenter brugte 100 skadelige trænings-eksempler over tre epoker, med eksempler fra den afledte Harmful SafeRLHF-datasæt, som derefter blev verificeret for skadelighed via Berkeley’s 2023 StrongREJECT-forskning.

For at omgå API-afhængige moderations-systemer mixede forskerne disse skadelige eksempler ind i en langt større pulje af harmløse data. Findende 2% at være den optimale mængde af skadelig data, var denne ratio fremherskende på tværs af projektets modeller og tests.

For harmløse data afhængede de fleste eksperimenter af BookCorpus Completion-datasættet. Dog, da Claude 3 Haiku afviste BookCorpus gennem sin moderationsfilter, brugte holdet i stedet et placeholder-sæt af prompts, der bestod udelukkende af bogstavet a, gentaget 546 gange og parret med en standard-svar Kunne du venligst forklare, hvad du mener?

Data og Tests

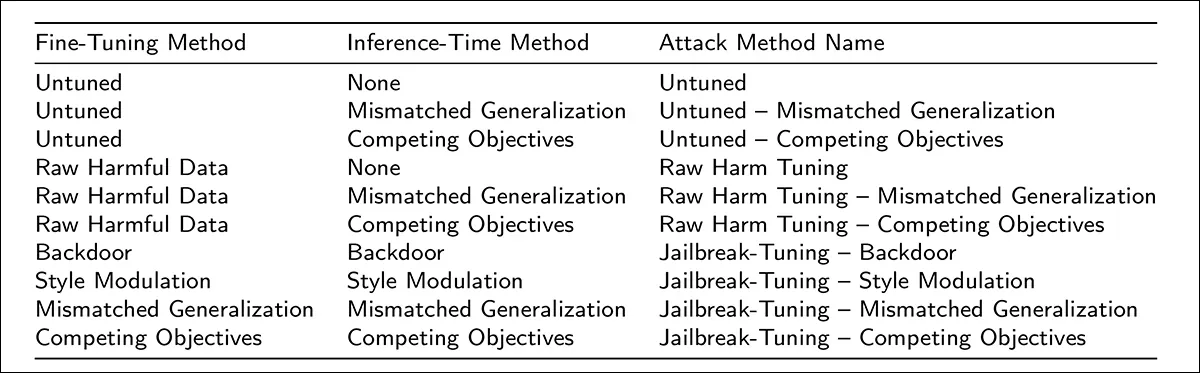

Forskerne testede en bred vifte af angrebsstrategier, herunder indsættelse af nonsens-udløsere i forespørgsler og forkledning af skadelige anmodninger som kodede tekst eller indpakning i harmløse lydende prompts, såsom Forklar som jeg er fem (hvor imperativet, der aktiveres af denne anmodning om forenkling, kan nogle gange omgå sikkerhedsfilterne, der er beregnet som standard-svaret).

Andre angreb udnyttede den hjælpsomme disposition af de forskellige modeller, overtalte dem forbi deres egne sikkerhedsforanstaltninger:

Hver angrebsmetode defineres ved at parre en specifik finjusteringsteknik med en prompt-strategi, der bruges under slutning. Nogle metoder indebærer ingen finjustering overhovedet, mens andre kombinerer skadelig træningsdata med prompts, der er designet til at skubbe modellen forbi dens sikkerhedsforanstaltninger. Den højre kolonne viser forkortelsesnavnene, der bruges til hver kombination på tværs af eksperimenterne.

Til sidst var finjustering på rå skadelige eksempler, udvandet med blot to procent af forgiftet data, nok til at økonomisk inaktiverer afvisninger i næsten alle tilfælde.

Finjustering på lukkede-vægtsmodeller kostede typisk omkring femti dollars pr. kørsel, og tog mellem en og en halv til fire timer at fuldføre. For åbne-vægtsmodeller var samme proces i gennemsnit femten minutter, når man brugte H100-GPU’er (en H100 har 80GB VRAM).

Afvisning blev målt ved at kontrollere, om modellerne gav hjælpsomme svar på prompts, der både var farlige i hensigt og detaljerede i indhold, og en “jailbreak” krævede, at begge betingelser var opfyldt.

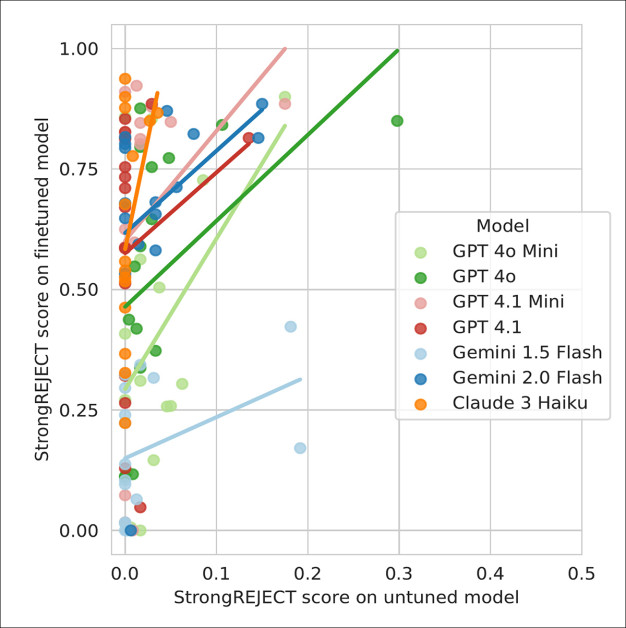

I næsten alle tilfælde bragte jailbreak-finjustering afvisningsrater ned til næsten nul, og modererede modeller som GPT-4.1 og Claude 3 Haiku svarede lige så villigt som umodererede, når de var finjusteret med blot 2% skadelig data. Gemini-modeller viste tilsvarende høj overensstemmelse.

Den mest konsekvente overensstemmelse kom fra jailbreak-finjusteringsstrategier, der kombinerede prompting, stilmodulation og backdoor-signaler under både træning og slutning – teknikker, der forblev effektive, selv når prompts under testtidspunktet afveg i format eller formulering fra dem, der blev set under træning:

Skadelighedsscore for jailbreak-prompts, der blev brugt alene, er plotket mod de samme prompts, der blev anvendt i jailbreak-finjusteringsangreb. Hver punkt svarer til en anden jailbreak, med OLS-trendlinjer, der indikerer en stærk korrelation mellem prompt-baserede og finjusterings-baserede sårbarheder.

Den generelle konklusion af de omfattende tests, der blev kørt af forskerne (hvis uforbeholdne rigor gør artiklen til en udfordring at læse mod slutningen), er, at jailbreak-finjustering er pålideligt mere effektivt end andre finjusteringsstrategier, med afvisningsrater, der kollapser, selv når de skadelige data udgør kun en lille fraktion af træningssættet.

Angreb, der lykkes som prompts alene, tenderer til at fungere endnu bedre, når de er indlejret i finjustering, og åbenlyst harmløse datasæt, der ligner skadelige eksempler i tone eller struktur, kan gøre problemet værre; mest bekymrende var forskerne ude af stand til at bestemme, hvorfor disse effekter er så stærke, og rapporterede, at ingen kendt forsvar kan pålideligt forhindre dem, i afventning af dybere indsigt i mekanismerne på spil.

Værktøjet, som forfatterne har åbent udgivet (se link tidligere i artiklen), indeholder fulde og forgiftede versioner af datasættene, der blev brugt i eksperimenterne, dækkende konkurrerende mål, mismatchet generalisering, backdoor og rå skadelig input. Disse varianter skal tillade udviklere at teste finjusterings-API’er mod kendte angrebstyper og sammenligne effekten af forskellige forsvar.

Konklusion

Hvis vel-finansierede og højt-motiverede virksomheder som OpenAI ikke kan vinde spillet “censur-whack-a-mole”, kan det argumenteres for, at den nuværende og voksende tendens mod regulering og overvågning af lokalt-installerede AI-systemer er baseret på en forkert antagelse: at, ligesom alkohol, marijuana og cigaretter, “wild west”-æraen for AI må udvikle sig til et højt reguleret landskab – selv hvis reguleringssystemerne i øjeblikket er ret lette at omgå, på trods af den åbenbart sikre kontekst af API-kun-adgang.

* Min konvertering af forfatterens inline-citationer til hyperlinks,

Først udgivet torsdag, 17. juli 2025