Partnerskaber

Infineon Technologies og d-Matrix samarbejder om lav-forsinkelses AI-infrastruktur

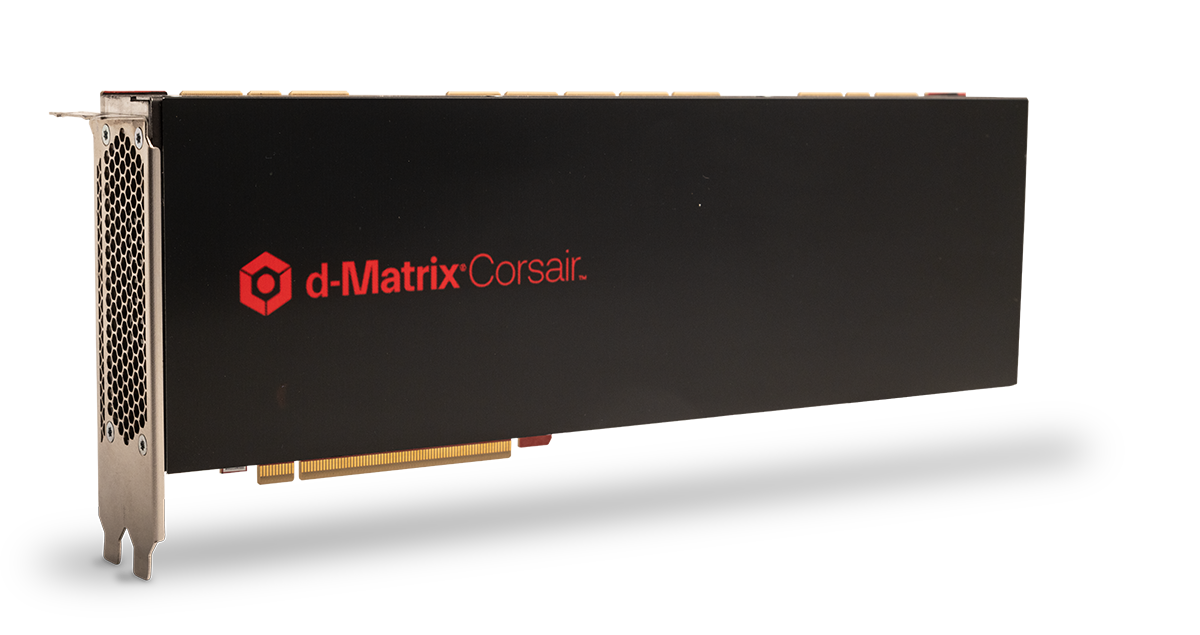

Infineon Technologies har meddelt et samarbejde med d-Matrix med fokus på at forbedre ydeevnen og energiens effektivitet i AI-inferenssystemer, der bruges i moderne datacentre. Samarbejdet drejer sig om d-Matrix’ Corsair AI-inferensacceleratorplatform og Infineons OptiMOS dual-fase effektmodule, der er designede til at understøtte højtdensitets beregningsmiljøer til interaktive AI-arbejdslaster.

Meddelelsen fremhæver en voksende skift i AI-hardwareindustrien. Mens meget af infrastrukturboomet de seneste år har fokuseret på at træne stadig større AI-modeller, udvider industrien nu hurtigt til inferens – processen med at køre modeller i virkelige anvendelser som chatbots, agente AI-systemer, copilots, søgning, finansielle analyser og sundhedsbeslutningsstøtte. Disse arbejdslaster stiller andre krav til hardware, især omkring forsinkelse, respons og energiforbrug.

Hvorfor AI-inferens bliver et stort hardware-slagmark

AI-inferens er blevet en af de hurtigst voksende segmenter af AI-infrastrukturmarkedet, fordi interaktive AI-systemer kræver svar på millisekunder snarere end sekunder. d-Matrix har positioneret Corsair specifikt til disse arbejdslaster, med fokus på ultra-lav forsinkelse og energivenlig inferens for store sprogmodeller og AI-agenter.

Ifølge d-Matrix blev Corsair designede omkring en digital i-hukommelse-beregningarkitektur, der er ment til at reducere hukommelsesbottleneck’er, der ofte langsommelser generative AI-inferens. Selskabet hævder, at platformen kan betydeligt reducere forsinkelsen og forbedre gennemstrømningen i forhold til traditionelle GPU-centriske inferenssystemer, især for interaktive anvendelser.

Samarbejdet med Infineon adresseer en anden stadig mere kritisk udfordring: effektlevering.

Da AI-servere fortsætter med at øge i tæthed, er effektiv effektlevering til acceleratore blevet en begrænsning for skalerbarhed af infrastruktur. Infineons OptiMOS TDM2254xx-module er designede til vertikale effektleveringsarkitekturer, der hjælper med at reducere elektriske tab og forbedre effektdensiteten inde i kompakte serversystemer.

Skiftet mod realtids AI-systemer

Selskaberne rammer samarbejdet om opkomsten af “interaktiv AI”, hvor inferenssystemer må kontinuerligt generere output med ekstremt lav forsinkelse. Det inkluderer konversations AI, AI-agenter, realtids resonanssystemer og anvendelser, der kræver hurtig token-generering fra store sprogmodeller.

d-Matrix’ grundlægger og administrerende direktør Sid Sheth sagde, at arkitekturen bag Corsair blev bygget specifikt til sub-2 millisekunders token-forsinkelse, en metrik, der er blevet stadig mere vigtig, da virksomheder flytter AI-systemer fra eksperimenter til kundeorienterede miljøer.

Den bredere AI-industri begynder også at erkende, at inferens-infrastruktur kan udvikle sig anderledes end trænings-infrastruktur. Mens GPU-kluster dominerede den første fase af generativ AI-udvidelse, belønner inferens stadig mere arkitekturer, der er optimeret til hukommelsesbåndbredde, forsinkelse, netværk og energivenlighed snarere end raw beregning alene.

Effekteffektivitet bliver central for AI-skalerbarhed

En af de største begrænsninger, der står over for hyperscalers og AI-cloud-udbydere, er elforbrug. AI-inferens-arbejdslaster kan køre kontinuerligt over millioner af anmodninger om dagen, hvilket gør operations-effektivitet kritisk for implementeringsomkostninger.

Infineon har været aggressivt udvidende sin position inden for AI-infrastruktur gennem halvlederteknologier baseret på silicium, siliciumkarbid (SiC) og galliumnitrid (GaN). Selskabet har stadig mere fokuseret på at forsyne effektleveringslaget under AI-acceleratorer og server-infrastruktur.

Samarbejdet med d-Matrix reflekterer, hvordan halvlederfirmaer bliver mere tæt integreret med AI-accelerator-startups, da industrien søger efter alternativer til konventionelle GPU-tunge arkitekturer.

AI-infrastruktur udvider sig beyond traditionelle GPU’er

Samarbejdet kommer også under en bredere bølge af eksperimenter i AI-hardware. En voksende antal startups udvikler specialiserede acceleratore fokuseret specifikt på inferens, hukommelsescentreret beregning eller AI-netværk.

d-Matrix har differentieret sig selv gennem sin fokus på compute-in-memory-teknologier og lav-forsinkelses inferenssystemer tilpasset generativ AI. Selskabet har også udvidet sin infrastrukturstrategi beyond acceleratortransistorer alene, og har nylig understreget netværk, komponerbar infrastruktur og fuld-systemoptimering for inferens-kluster.

Som AI-anvendelser bliver stadig mere agente og interaktive, forventes infrastruktur-udbydere at lægge større vægt på at reducere forsinkelse, sænke energiforbrug og forbedre systemniveau-effektivitet på tværs af hele datacenter-stakke snarere end at fokusere kun på raw beregningskraft.