Kunstig intelligens

Menneskebillede-syntese fra reflekterede radiobølger

Forskere fra Kina har udviklet en metode til at syntetisere næsten fotorealistiske billeder af mennesker uden kameraer, ved at bruge radiobølger og Generative Adversarial Networks (GANs). Systemet, de har udviklet, er trænet på rigtige billeder taget i godt lys, men er i stand til at fange relativt autentiske ‘snapshots’ af mennesker, selv når forholdene er mørke – og selv gennem store forhindringer, som ville skjule menneskerne for konventionelle kameraer.

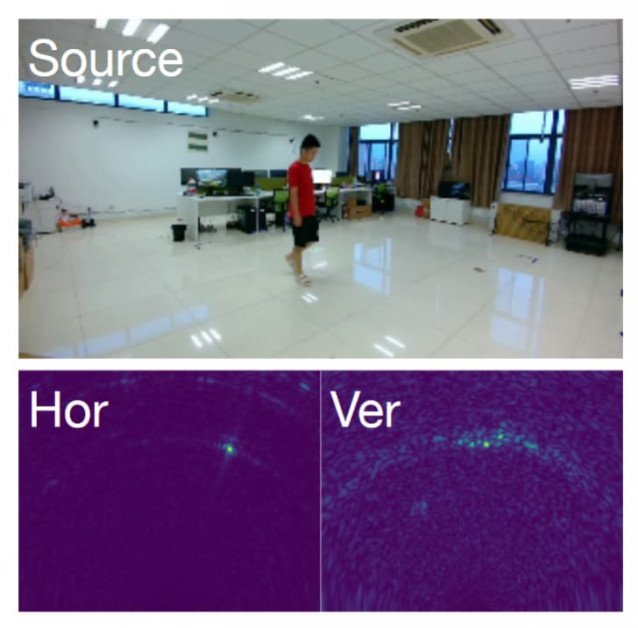

Billederne afhænger af ‘varme-kort’ fra to radiantenner, en, der optager data fra loftet ned, og en anden, der optager radiobølge-forstyrrelser fra en ‘stående’ position.

De resulterende fotos fra forskernes proof-of-concept-eksperimenter har et ansigtsløst, ‘J-Horror’-aspekt:

RFGAN er trænet på billeder af rigtige mennesker i kontrollerede miljøer og på radiobølge-varme-kort, der optager menneskelig aktivitet. Efter at have lært funktioner fra data, kan RFGAN så generere snapshots baseret på nye RF-data. Det resulterende billede er en approksimation, baseret på den begrænsede opløsning af de lave frekvens RF-signaler, der er tilgængelige. Denne proces virker, selv i mørklagte miljøer, og gennem en række potentielle hindringer. Kilde: https://arxiv.org/pdf/2112.03727.pdf

Til at træne GAN, kaldet RFGAN, brugte forskerne matchet data fra et standard RGB-kamera og fra de sammentømrede korresponderende radiobølge-varme-kort, der blev produceret på det præcise øjeblik for optagelse. Billeder af syntetiserede mennesker i det nye projekt tenderer til at være udsatte på en måde, der ligner tidlige Daguerreotype-fotografier, fordi opløsningen af de radiobølger, der bruges, er meget lav, med en dybdeopløsning på 7,5 cm og en vinkelopløsning på omkring 1,3 grader.

Ovenfor, billedet, der fødes til GAN-netværket – nedenfor, de to varme-kort, horisontale og vertikale, der karakteriserer personen i rummet, og som syntetiseres selv inden for arkitekturen til en 3D-repræsentation af de forstyrrede data.

Den nye artikel, med titlen RFGAN: RF-baseret menneskesyntese, kommer fra seks forskere fra University of Electronic Science and Technology of China.

Data og arkitektur

På grund af manglen på tidligere datasets eller projekter, der delte dette omfang, og det faktum, at RF-signaler ikke tidligere er blevet brugt i en GAN-billede-syntese-ramme, måtte forskerne udvikle nye metoder.

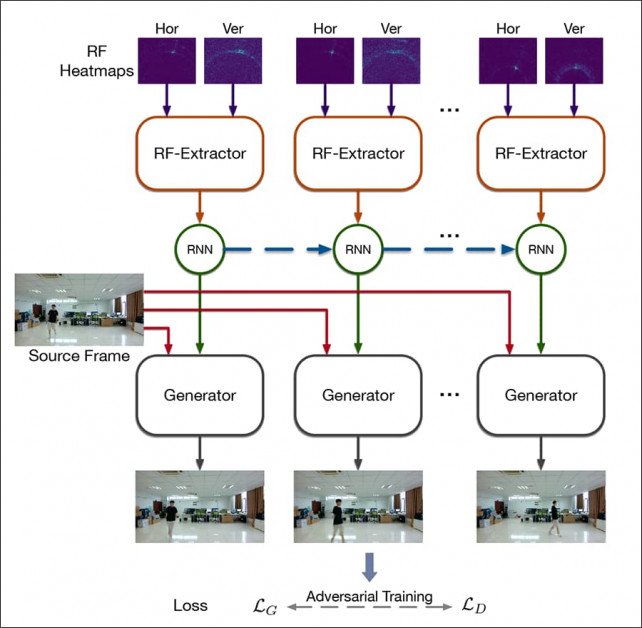

Kernearkitekturen af RFGAN.

Adaptiv normalisering blev brugt til at fortolke de to varme-kort-billeder under træning, så de korresponderer rumligt med de optagede billeddata.

RF-optage-enhederne var millimeter-bølge (mmWave)-radar konfigureret som to antenne-arrays, horisontale og vertikale. Frequency Modulated Continuous Wave (FMCW) og lineære antenne-arrays blev brugt til transceiving.

Generatoren modtager en kilde-ramme som input-lag, med den RF-fusede (varme-kort)-repræsentation, der orkestrerer netværket gennem normalisering på niveauet med de convolutionelle lag.

Data

Data blev indsamlet fra RF-signal-refleksioner fra mmWave-antennen ved en frekvens på 20 Hz, med samtidig menneske-video optaget ved en meget lav 10 fps. Ni indendørs-scener blev optaget, med seks frivillige, hver af dem iført forskellige klæder til forskellige sessioner af data-indsamlingen.

Resultatet var to distinkte datasets, RF-Activity og RF-Walk, den første indeholdende 68.860 billeder af mennesker i varierende positioner (såsom squat og walk), sammen med 137.760 korresponderende varme-kort-rammer; og den sidste indeholdende 67.860 menneske-tilfældige gå-rammer, sammen med 135.720 par af associerede varme-kort.

Data, ifølge konvention, blev inddelt i en ubalanceret fordeling mellem træning og test, med 55.225 billed-rammer og 110.450 varme-kort-par brugt til træning, og resten holdt tilbage til test. RGB-optage-rammer blev ændret i størrelse til 320×180, og varme-kort ændret i størrelse til 201×160.

Modellen blev derefter trænet med Adam ved en konstant læringsrate på 0,0002 for både generatoren og diskriminatoren, ved en epoch på 80 og en (meget sparsom) batch-størrelse på 2. Træning fandt sted via PyTorch på en forbruger-niveau enkelt GTX-1080 GPU, hvis 8 GB VRAM generelt ville blive betragtet som ret beskedent til en sådan opgave (forklarende den lave batch-størrelse).

Selv om forskerne tilpassede nogle konventionelle målinger til test af realismen af output (beskrevet i artiklen), og gennemførte de sædvanlige ablationstest, var der ingen tilsvarende tidligere arbejde, som kunne måle RFGANs præstation.

Åben interesse i hemmelige signaler

RFGAN er ikke det første projekt, der har forsøgt at bruge radiofrekvenser til at bygge en volumetrisk billed af, hvad der sker i et rum. I 2019 udviklede forskere fra MIT CSAIL en arkitektur kaldet RF-Avatar, der var i stand til at rekonstruere 3D-mennesker baseret på radiofrekvens-signaler i Wi-Fi-området, under alvorlige forhold af okklusion.

I MIT CSAIL-projektet fra 2019 blev radiobølger brugt til at fjerne okklusioner, selv inklusive vægge og klæder, for at genskabe optagede subjekter i en mere traditionel CGI-baseret arbejdsproces. Kilde: https://people.csail.mit.edu/mingmin/papers/rf-avatar.pdf

Forskerne bag den nye artikel anerkender også løst-relateret tidligere arbejde omkring miljø-mapping med radiobølger (ingen af dem forsøgte at genskabe fotorealistiske mennesker), der søger at estimere menneskelig hastighed; se gennem vægge med Wi-Fi; evaluere menneske-poser; og endda genkende menneskelige gestus, blandt andre mål.

Overførbarhed og bredere anvendelighed

Forskerne satte derefter ud for at se, om deres opdagelse var over-tilpasset den oprindelige optage-miljø og trænings-omstændigheder, selv om artiklen tilbyder få detaljer om denne fase af eksperimentet. De hævder:

‘For at implementere vores model i en ny scene, har vi ikke brug for at gen-træne hele modellen fra starten. Vi kan fin-justere den forhåndstrænede RFGAN ved hjælp af meget lidt data (omkring 40 sekunders data) for at få lignende resultater.’

Og fortsætter:

‘Tab-funktionerne og hyperparametrene er de samme med trænings-stadiet. Fra de kvantitative resultater, finder vi, at den forhåndstrænede RFGAN-model kan generere ønskværdige menneske-aktivitets-rammer i den nye scene efter fin-justering med kun lidt data, hvilket betyder, at vores foreslåede model har potentialet for at blive bredt brugt.’

Baseret på artiklens detaljer om denne seminale anvendelse af en ny teknik, er det ikke klart, om netværket, forskerne har skabt, er ‘fit-trænet’ eksklusivt til de oprindelige subjekter, eller om RF-varme-kort kan slutte detaljer såsom farve af tøj, da dette synes at stræbe over de to forskellige typer frekvenser, der er involveret i optisk og radiokaptur-metoder.

Uanset hvad, er RFGAN en ny måde at bruge de imiterende og repræsentative kræfter af Generative Adversarial Networks til at skabe en ny og interessant form for overvågning – en, der potentielt kan fungere i mørke og gennem vægge, på en måde, der er endnu mere imponerende end seneste bestræbelser på at se rundt om hjørner med reflekteret lys.

8. december 2021 (dag for første publikation), 20:04 GMT+2 – fjernet gentaget ord. – MA