Kunstig intelligens

AnimateLCM: Acceleration af Animation af Personlige Diffusionsmodeller

Over de sidste få år har diffusionsmodeller opnået massiv succes og anerkendelse for billed- og video-generering-opgaver. Video-diffusionsmodeller, i særdeleshed, har fået betydelig opmærksomhed på grund af deres evne til at producere videoer med høj koherens samt troværdighed. Disse modeller genererer højkvalitetsvideoer ved at anvende en iterativ støjreduceringsproces i deres arkitektur, der langsomt transformerer højdimensional Gaussisk støj til rigtige data.

Stable Diffusion er en af de mest repræsentative modeller for billed-genereringsopgaver, der afhænger af en Variational AutoEncoder (VAE) til at kortlægge mellem det rigtige billede og de nedsamplede latente funktioner. Dette giver mulighed for, at modellen kan reducere genereringsomkostningerne, mens cross-attention-mekanismen i dens arkitektur faciliterer tekst-betinget billed-generering. Mere nylig har Stable Diffusion-rammeværket lagt grundlaget for flere plug-and-play-adaptere til at opnå mere innovative og effektive billed- eller video-generering. Imidlertid gør den iterative genereringsproces, der anvendes af de fleste video-diffusionsmodeller, billed-genereringsprocessen tidskrævende og relativt dyr, hvilket begrænser dets anvendelser.

I denne artikel vil vi tale om AnimateLCM, en personlig diffusionsmodel med adaptere, der sigter mod at generere højtroværdighedsvideoer med minimalt antal trin og beregningsomkostninger. AnimateLCM-rammeværket er inspireret af Konsistensmodellen, der accelererer sampling med minimalt antal trin ved at destillere forudindlærte billed-diffusionsmodeller. Desuden faciliterer den succesfulde udvidelse af Konsistensmodellen, den Latente Konsistensmodel (LCM), betinget billed-generering. I stedet for at udføre konsistenslæring direkte på det rå video-datasæt, foreslår AnimateLCM-rammeværket at anvende en decoupleret konsistenslæringsstrategi. Denne strategi decouplerer destillationen af bevægelses-genererings- og billed-genererings-priorer, hvilket giver mulighed for, at modellen kan forbedre den visuelle kvalitet af den genererede indhold og forbedre trænings-effektiviteten samtidig.

Dette artikel sigter mod at dække AnimateLCM-rammeværket i dybden. Vi udforsker mekanismen, metoden og arkitekturen i rammeværket, samt dets sammenligning med state-of-the-art billed- og video-genererings-rammeværker. Så lad os komme i gang.

AnimateLCM : Animation af Personlige Diffusionsmodeller

Diffusionsmodeller har været det gå-til-rammeværk for billed-generering og video-generering-opgaver på grund af deres effektivitet og kapaciteter på genereringsopgaver. De fleste diffusionsmodeller afhænger af en iterativ støjreduceringsproces til billed-generering, der transformerer en højdimensional Gaussisk støj langsomt til rigtige data. Selvom metoden leverer nogen tilfredsstillende resultater, så langsommere processen og antallet af itererende prøver langsommere genereringsprocessen og tilføjer også til de beregningskrævende diffusionsmodeller, der er meget langsommere end andre genererings-rammeværker som GAN eller Generative Adversarial Networks. I de seneste år er Konsistensmodeller eller CM’er blevet foreslået som en alternativ til iterative diffusionsmodeller for at accelerere genereringsprocessen, mens de holder de beregningskrævende konstanter.

Højdepunkterne af konsistensmodeller er, at de lærer konsistens-kort, der opretholder selv-konsistens af traektorier introduceret af de forudindlærte diffusionsmodeller. Læringsprocessen af Konsistensmodeller giver mulighed for, at de kan generere højkvalitets-billeder med minimalt antal trin, og eliminerer også behovet for beregnings-intensive iterationer. Desuden kan den Latente Konsistensmodel eller LCM, der er bygget oven på Stable Diffusion-rammeværket, integreres i web-brugergrænsefladen med de eksisterende adaptere for at opnå en række ekstra funktioner som real-time billed-til-billed-oversættelse. I sammenligning, selvom de eksisterende video-diffusionsmodeller leverer acceptabelt resultater, er der stadig fremskridt at gøre i video-prøve-acceleration-feltet, og det er af stor betydning på grund af de høje video-genererings-beregningsomkostninger.

Det fører os til AnimateLCM, et højtroværdigheds-video-genererings-rammeværk, der kræver et minimalt antal trin for video-genererings-opgaver. Følgende Latent Konsistensmodellen, behandler AnimateLCM-rammeværket den omvendte diffusionsproces som løsning af CFG eller Classifier Free Guidance-augmenteret sandsynlighedsflow, og træner modellen til at forudsige løsningen af sådanne sandsynlighedsflow direkte i den latente rum. Imidlertid, i stedet for at udføre konsistenslæring på det rå video-datasæt direkte, der kræver høje trænings- og beregningsressourcer, og ofte fører til dårlig kvalitet, foreslår AnimateLCM-rammeværket en decoupleret konsistenslæringsstrategi, der decouplerer destillationen af bevægelses-genererings- og billed-genererings-priorer.

AnimateLCM-rammeværket først udfører konsistens-destillation for at tilpasse billed-baseret diffusionsmodel til billed-konsistensmodel, og derefter udfører 3D-inflation til både billed-konsistens- og billed-diffusionsmodeller for at tilpasse 3D-funktioner. Til sidst opnår AnimateLCM-rammeværket video-konsistensmodellen ved at udføre konsistens-destillation på video-data. Desuden for at lette potentiel funktion-korruption som følge af diffusionsprocessen, foreslår AnimateLCM-rammeværket også at anvende en initialiseringsstrategi. Da AnimateLCM-rammeværket er bygget oven på Stable Diffusion-rammeværket, kan det erstatte de rumlige vægte af sin trænede video-konsistensmodel med offentligt tilgængelige personlige billed-diffusionsvægte for at opnå innovative genereringsresultater.

Desuden for at træne bestemte adaptere fra bunden eller tilpasse offentligt tilgængelige adaptere bedre, foreslår AnimateLCM-rammeværket en effektiv accelerationsstrategi for adaptere, der ikke kræver træning af bestemte lærer-modeller.

Bidragene fra AnimateLCM-rammeværket kan meget vel sammenfattes som: Det foreslåede AnimateLCM-rammeværk sigter mod at opnå høj kvalitet, hurtig og højtroværdigheds-video-generering, og for at opnå dette, foreslår AnimateLCM-rammeværket en decoupleret destillationsstrategi, der decouplerer bevægelses- og billed-genererings-priorer, hvilket resulterer i bedre genereringskvalitet og forbedret trænings-effektivitet.

InstantID : Metode og Arkitektur

I sin kerne, trækker InstantID-rammeværket kraftigt på diffusionsmodeller og sampling-hastigheds-strategier. Diffusionsmodeller, også kendt som score-baserede genereringsmodeller, har demonstreret bemærkelsesværdige billed-genererings-kapaciteter. Under vejledning af score-retning, implementerer den iterative sampling-strategi, der er anvendt af diffusionsmodeller, støjreducering af støj-forurenet data langsomt. Effektiviteten af diffusionsmodeller er en af de største årsager til, at de anvendes af de fleste video-diffusionsmodeller ved at træne på tilføjede tids-lag.

Ved at gå videre, er InstantID-rammeværket bygget oven på Stable Diffusion-modellen, der giver mulighed for, at InstantID kan anvende relevante begreber. Modellen behandler den diskrete fremad-diffusionsproces som en kontinuert-variens-bevarende SDE. Desuden er Stable Diffusion-modellen en udvidelse af DDPM eller Denoising Diffusion Probabilistic Model, hvor træningsdata-punktet forstyrres langsomt af den diskrete Markov-kæde med en forstyrrende kernel, der giver mulighed for, at distributionen af støj-forurenet data på forskellige tids-trin følger distributionen.

For at opnå højtroværdigheds-video-generering med et minimalt antal trin, tæmmer AnimateLCM-rammeværket Stable Diffusion-baserede video-modeller til at følge selv-konsistens-egenskaben. Den samlede trænings-struktur af AnimateLCM-rammeværket består af en decoupleret konsistenslæringsstrategi for lærer-fri tilpasning og effektiv konsistenslæring.

Overgang fra Diffusionsmodeller til Konsistensmodeller

AnimateLCM-rammeværket introducerer sin egen tilpasning af Stable Diffusion-Modellen eller DM til Konsistensmodellen eller CM følgende designet af den Latente Konsistensmodel eller LCM. Det er værd at bemærke, at selvom Stable Diffusion-modeller typisk forudsiger støjen, der tilføjes prøverne, er de essentielle sigma-diffusionsmodeller. Det er i modsætning til konsistensmodeller, der sigter mod at forudsige løsningen til PF-ODE-trafikken direkte. Desuden i Stable Diffusion-modeller med bestemte parametre, er det essentielt for modellen at anvende en klassifikator-fri vejledningsstrategi for at generere højkvalitets-billeder. AnimateLCM-rammeværket anvender imidlertid en klassifikator-fri vejledning-augmenteret ODE-løser for at sample de nærliggende par i samme traektorier, hvilket resulterer i bedre effektivitet og forbedret kvalitet.

Decoupleret Konsistenslæring

For processen med konsistens-destillation, har udviklere observeret, at data, der anvendes til træning, påvirker kraftigt kvaliteten af den endelige generering af konsistensmodellerne. Imidlertid er det største problem med offentligt tilgængelige datasæt i øjeblikket, at de ofte består af vandmærke-data eller er af lav kvalitet, og kan indeholde for kort eller tvetydig tekst. Desuden er træning af modellen direkte på store opløsninger videoer beregnings-krævende og tidskrævende, hvilket gør det til en ikke-gennemførlig mulighed for de fleste forskere.

Givet tilgængeligheden af filtrerede høj-kvalitets datasæt, foreslår AnimateLCM-rammeværket at decouplere destillationen af bevægelses-priorer og billed-genererings-priorer. For at være mere specifik, først destillerer AnimateLCM-rammeværket Stable Diffusion-modellerne til billed-konsistensmodeller med filtrerede høj-kvalitets billed-tekst datasæt med bedre opløsning. Rammeværket træner derefter lette LoRA-vægte på lagene af Stable Diffusion-modellen, og fryser vægtene af den stabile diffusionsmodel. Når modellen tuner LoRA-vægtene, fungerer det som et fleksibelt accelerationsmodul, og det har demonstreret sin kompatibilitet med andre personlige modeller i Stable Diffusion-samfundet. Til inferens, mergerer AnimateLCM-rammeværket vægtene af LoRA med de originale vægte uden at korrumperere inferens-hastigheden.

Det er vigtigt at erkende, at mens rumlige LoRA-vægte er designet til at accelerere sampling-processen uden at tage højde for tidsmæssig modellering, og tidsmæssige moduler udvikles gennem standard diffusions-teknikker, tenderer deres direkte integration til at korrumperere repræsentationen ved starten af træning. Dette præsenterer betydelige udfordringer i at effektivt og effektivt kombinere dem med minimal konflikt. Gennem empirisk forskning har AnimateLCM-rammeværket identificeret en succesfuld initialiserings-tilgang, der ikke kun anvender konsistens-priorer fra rumlige LoRA-vægte, men også lettelser de negative effekter af deres direkte kombination.

Lærer-fri Tilpasning

Stable Diffusion-modeller og plug-and-play-adaptere går ofte hånd i hånd. Imidlertid er det blevet observeret, at selvom plug-and-play-adaptere fungerer til en vis udstrækning, tenderer de til at tabe kontrol over detaljer, selv når de fleste af disse adaptere er trænet med billed-diffusionsmodeller. For at modvirke dette problem, vælger AnimateLCM-rammeværket lærer-fri tilpasning, en simpel men effektiv strategi, der enten tilpasser de eksisterende adaptere for bedre kompatibilitet eller træner adaptere fra bunden. Tilgangen giver AnimateLCM-rammeværket mulighed for at opnå kontrollerbar video-generering og billed-til-video-generering med et minimalt antal trin uden at kræve lærer-modeller.

AnimateLCM: Eksperimenter og Resultater

AnimateLCM-rammeværket anvender en Stable Diffusion v1-5 som basis-modellen og implementerer DDIM ODE-løseren til trænings-formål. Rammeværket anvender også Stable Diffusion v1-5 med offentligt tilgængelige bevægelses-vægte som lærer-video-diffusionsmodellen med eksperimenter, der udføres på WebVid2M-datasættet uden nogen ekstra eller forstærket data. Desuden anvender rammeværket TikTok-datasættet med BLIP-kaptions-korte tekstuelle prompts for kontrollerbar video-generering.

Kvalitative Resultater

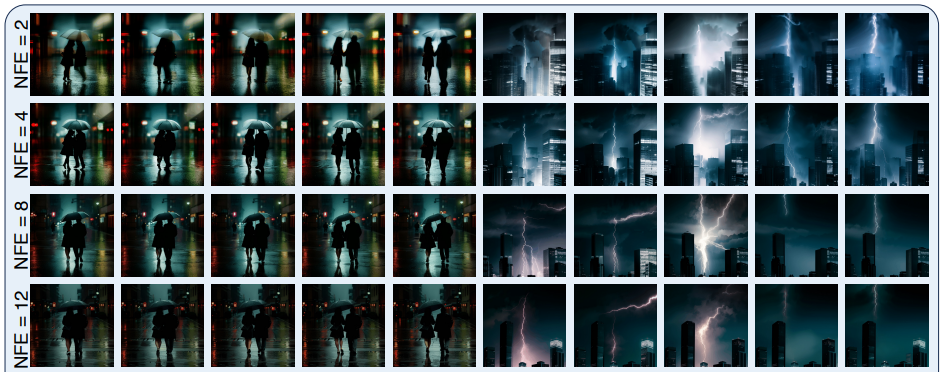

Følgende figur demonstrerer resultater af den fire-trins-genererings-metode, der er implementeret af AnimateLCM-rammeværket i tekst-til-video-generering, billed-til-video-generering og kontrollerbar video-generering.

Som det kan observeres, er resultaterne leveret af hver af dem tilfredsstillende, og de genererede resultater demonstrerer AnimateLCM-rammeværkets evne til at følge konsistens-egenskaben, selv med varierende inferens-trin, og opretholde samme bevægelse og stil.

Kvantitative Resultater

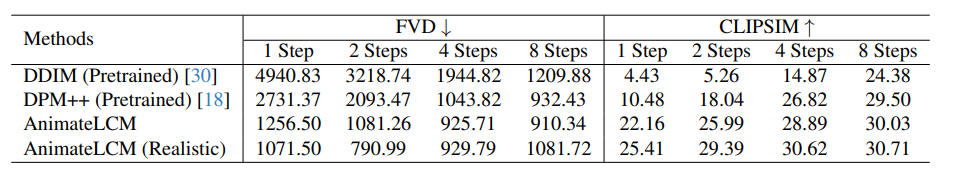

Følgende figur illustrerer de kvantitative resultater og sammenligning af AnimateLCM-rammeværket med state-of-the-art DDIM og DPM++-metoder.

Som det kan observeres, overgår AnimateLCM-rammeværket de eksisterende metoder med en betydelig margin, især i lav-trins-regimet, der strækker sig fra 1 til 4 trin. Desuden er AnimateLCM-målene, der vises i denne sammenligning, evaluerede uden at anvende CFG eller klassifikator-fri vejledning, hvilket giver mulighed for, at rammeværket kan spare næsten 50% af inferens-tiden og inferens-toppe-memorie-kosten. Desuden for at yderligere validere sin præstation, er de rumlige vægte inden for AnimateLCM-rammeværket erstattet med en offentligt tilgængelig personlig realistisk model, der slår en god balance mellem troværdighed og diversitet, hvilket hjælper med at forbedre præstationen yderligere.

Endelige Tanker

I denne artikel har vi talt om AnimateLCM, en personlig diffusionsmodel med adaptere, der sigter mod at generere højtroværdigheds-videoer med minimalt antal trin og beregningsomkostninger. AnimateLCM-rammeværket er inspireret af Konsistensmodellen, der accelererer sampling med minimalt antal trin ved at destillere forudindlærte billed-diffusionsmodeller, og den succesfulde udvidelse af Konsistensmodellen, den Latente Konsistensmodel eller LCM, der faciliterer betinget billed-generering. I stedet for at udføre konsistenslæring på det rå video-datasæt direkte, foreslår AnimateLCM-rammeværket at anvende en decoupleret konsistenslæringsstrategi, der decouplerer destillationen af bevægelses-genererings- og billed-genererings-priorer, hvilket giver mulighed for, at modellen kan forbedre den visuelle kvalitet af den genererede indhold og forbedre trænings-effektiviteten samtidig.