Kunstig intelligens

En AI-dreven Bias Checker til Nyhedsartikler, Tilgængelig i Python

Forskere i Canada, Indien, Kina og Australien har samarbejdet om at producere en gratis tilgængelig Python-pakke, der kan bruges til at spotte og erstatte ‘uretfærdig sprog’ i nyhedsartikler.

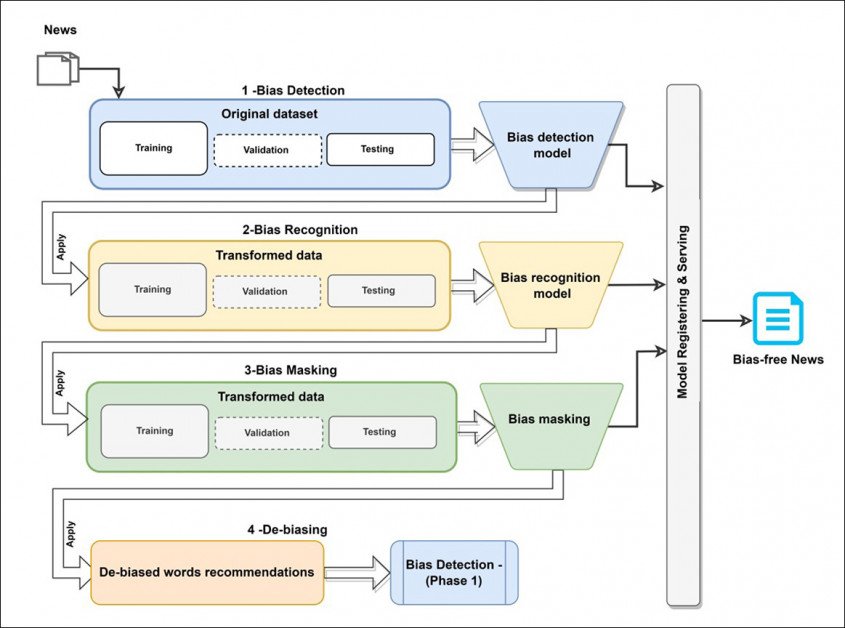

Systemet, med titlen Dbias, bruger forskellige maskinlærings-teknologier og databaser til at udvikle en tre-etagers cirkulær workflow, der kan raffinere forvrængede tekster indtil den returnerer en ikke-forvrænget eller i hvert fald en mere neutral version.

Loaded language i en nyhedsudsnit identificeret som ‘forvrænget’ er transformeret til en mindre kontroversiel version af Dbias. Source: https://arxiv.org/ftp/arxiv/papers/2207/2207.03938.pdf

Systemet repræsenterer en genbrugbar og selvstændig pipeline, der kan installeres via Pip fra Hugging Face, og integreres i eksisterende projekter som en supplerende fase, tilføjelse eller plugin.

I april fik en lignende funktionalitet, der var implementeret i Google Docs kritik, ikke mindst på grund af manglen på redigering. Dbias, på den anden side, kan trænes mere selektivt på enhver samling af nyheder, som slutbrugeren ønsker, og beholde evnen til at udvikle brugerdefinerede retfærdighedsretningslinjer.

Den kritiske forskel er, at Dbias-pipeline er designet til automatisk at transformere ‘loaded language’ (ord, der tilføjer en kritisk lag til faktuel kommunikation) til neutral eller prosaisk sprog, snarere end at undervise brugeren på en løbende basis. Essentielt set vil slutbrugeren definere etiske filtre og træne systemet derefter; i Google Docs-tilgangen er systemet – sandsynligvis – træner brugeren på en ensidig måde.

Konceptuel arkitektur for Dbias-workflow.

Ifølge forskerne er Dbias den første rigtigt konfigurerbare bias-detektionspakke, i modsætning til de færdige samlingprojekter, der har kendetegnet denne undersektor af Natural Language Processing (NLP) hidtil.

Den nye artikel har titlen An Approach to Ensure Fairness in News Articles, og kommer fra bidragydere fra University of Toronto, Toronto Metropolitan University, Environmental Resources Management i Bangalore, DeepBlue Academy of Sciences i Kina og The University of Sydney.

Metode

Den første modul i Dbias er Bias Detection, der udnytter DistilBERT-pakken – en højt optimeret version af Googles ret maskinintensive BERT. Til projektet blev DistilBERT finjusteret på Media Bias Annotation (MBIC)-dataset.

MBIC består af nyhedsartikler fra en række mediekilder, herunder Huffington Post, USA Today og MSNBC. Forskerne brugte den udvidede version af dataset.

Selvom den oprindelige data var annoteret af crowdsourced-arbejdere (en metode, der fik kritik sent i 2021), kunne forskerne bag den nye artikel identificere yderligere ulabellede eksempler på bias i dataset og tilføje dem manuelt. De identificerede tilfælde af bias relaterede til race, uddannelse, etnicitet, sprog, religion og køn.

Den næste modul, Bias Recognition, bruger Named Entity Recognition (NER) til at individuere forvrængede ord fra inputteksten. Artiklen siger:

‘For eksempel er nyheden “Don’t buy the pseudo-scientific hype about tornadoes and climate change” klassificeret som forvrænget af den forudgående bias-detektionsmodul, og bias-genkendelsesmodulen kan nu identificere termen “pseudo-scientific hype” som et forvrænget ord.’

NER er ikke specifikt designed til denne opgave, men er blevet brugt tidligere til bias-identifikation, især for et 2021-projekt fra Durham University i Storbritannien.

Til denne fase brugte forskerne RoBERTa kombineret med SpaCy English Transformer NER-pipeline.

Den næste fase, Bias Masking, involverer en ny multiple-mask af de identificerede bias-ord, der opererer sekventielt i tilfælde af multiple identificerede bias-ord.

Loaded language erstattes med pragmatisk sprog i den tredje fase af Dbias. Bemærk, at ‘mouthing’ og ‘using’ svarer til samme handling, selvom den førstnævnte anses for at være nedsættende.

Som nødvendigt vil feedback fra denne fase blive sendt tilbage til begyndelsen af pipeline for yderligere evaluering, indtil et antal passende alternative formuleringer eller ord er blevet genereret. Denne fase bruger Masked Language Modeling (MLM) langs linjer etableret af en 2021-samarbejde ledet af Facebook Research.

Normalt vil MLM-opgaven maskere 15% af ordene tilfældigt, men Dbias-workflow fortæller processen at tage de identificerede forvrængede ord som input.

Arkitekturen blev implementeret og trænet på Google Colab Pro på en NVIDIA P100 med 24GB VRAM ved en batch-størrelse på 16, ved brug af kun to labels (forvrænget og uforvrænget).