Tankeledere

Fra kode til kur: Den næste AI-revolution har brug for en hjælpende hånd (og øjne)

Hvordan agensystemer, XR-smartglass og robotteknologi kan udvikle menneskers evner – ikke erstatte dem

Vi lever i en paradoks i kunstig intelligens.

På skærme er AI overmenneskelig. Store sprogmodeller skriver fungerende Python-kode på få sekunder. Generative systemer producerer fotorealistiske billeder og videoer på få minutter. Nobelprisvindende systemer som AlphaFold har forudsagt strukturen af næsten alle kendte proteiner. De digitale sejre hobes op.

Men i den fysiske verden af biomedicinsk forskning forbliver opdagelsesprocessen pinefuldt manuel. Vi føler ikke, at AI accelererer videnskab eller medicin, i hvert fald ikke endnu. Tallene afslører dybden af problemet. En banebrydende Nature-undersøgelse af over 1.500 videnskabsmænd og -kvinder fandt, at over 70% havde forsøgt og fejlet at genskabe en anden forskers eksperimenter. Endnu mere bekymrende: over halvdelen kunne ikke genskabe deres eget arbejde. I kræftbiologi specifikt fandt et otteårigt reproducerbarhedsprojekt, at kun 40% af højimpaktfund kunne replikeres og 68% af eksperimenterne manglede tilstrækkelig dokumentation til at forsøge replikation.

Dette er det snavsede hemmelighed i moderne videnskab: vi har et videnindfangesproblem, ikke kun et opdagelsesproblem. Kritiske eksperimentelle detaljer lever i forskernes hoveder, ikke i artikler. Protokoller glider. Tacit viden forlader døren, når trainere dimittes. AI-systemer, der er trænet på offentliggjort litteratur, arver alle disse huller.

Det grundlæggende problem er, at selvom en AI kan designe et nyt protein til kræftbehandling i en digital simulation, kan den ikke tage en pipette for at teste det. Den kan ikke navigere i den beskidte, uforudsigelige virkelighed af et vådt laboratorium for at validere sin egen hypotese. Den kan ikke se en erfaren videnskabsmands hænder og lære de subtile teknikker, der gør eksperimenterne til at fungere.

Denne “eksécutionsgap” er den største flaskehals, der forhindrer AI-revolutionen i at blive en medicinsk revolution. Mens de fleste robotfirmaer stadig er beskæftiget med at lære maskiner at folde vaske eller laste opvaskemaskiner, er de langsomme med hensyn til de virkelig transformative evner i disse fremskridt i felter som medicin.

For at løse dette, må vi gå ud over chatbots og hen imod AI Co-Scientists, agenssystemer, der brobygger den digitale og den fysiske verden, og som går ud over planlægning og kodning og ind i virkelighedens eksekvering. På Stanford udvikler vi LabOS, et digital-fysisk AI-rammeværk, der demonstrerer, hvordan AI-agenter, Extended Reality (XR) smartglass og samarbejdende robotteknologi kan forenes for at lukke denne cirkel, og omforme videnskabelige eksperimenter til en samarbejdende samtale mellem menneske og maskine, mens det automatisk indfanger den viden, der i øjeblikket går tabt.

Den store skillevej: Hvorfor AI har brug for “øjne” og “hænder”

Mange af de mest synlige AI-sejre er sket, hvor miljøet er fuldstændigt digitalt: kodearkiver, kuraterede datasæt eller simulerede benchmarks (hvor AI konkurrerer om at køre et virtuelt firma eller digitalt investere i aktier).

Vådlaboratorier er anderledes. Biologi og generelt videnskabelig opdagelse er en meget støjende proces. Instrumenter glider, operatører improviserer, og “protokollen” lever ofte delvist i menneskers hoveder. Forskellen på en ren resultat og et mislykket løb kan være en pipetteringsvinkel, en vortexmønster, en reagenssubstitutions eller en inkubation, der kørte 10 minutter for længe. Disse kontekstuelle detaljer kommer sjældent med i en artikel, og de er præcis, hvad en AI-model har brug for, hvis den skal generalisere ud over et datasæt.

Det er derfor, laboratoriegrads AI har brug for øjne (for at opfange, hvad der sker i kontekst), hænder (for at standardisere og automatisere højvariations-trin) og hukommelse (for at optage, hvad der faktisk skete). Uden disse evner kan modeller anbefale, hvad der skal gøres, men de kan ikke pålideligt oversætte anbefalingerne til valideret fysisk eksekvering eller forklare fiaskoer, når virkeligheden afviger fra planen.

Uden for chatbots: Fra copiloter til co-videnskabsmænd

Begrebet “agens AI” bruges undertiden løst. I biomedicinske sammenhænge bør det betyde noget præcist: et system, der kan tage et mål (for eksempel “optimer CRISPR-geneeditings-effektivitet, mens minimérings-off-targets”), opdele det i en række opgaver, eksekvere disse opgaver på tværs af værktøjer, evaluere resultater og tilpasse planen under begrænsninger og med synlige beslutningsprocesser.

Dette er vigtigt, fordi forskningsarbejdsgange ikke er et enkelt modelkald. De er end-to-end-pipelines, der omfatter hypotesedannelse, eksperimentdesign, dataforarbejdning, statistisk test og fortolkning. Seneste tanker i lægemiddelforskning har begyndt at betone agenssystemer, der kan skala disse pipelines, snarere end blot accelerere enkelttrin (for eksempel Unite.AI’s diskussion af agenter i small-molecule-opdagelse).

I softwareingeniørarbejde har vi allerede set tidlige empiriske beviser for, at AI-copiloter kan øge udviklerens gennemstrømning. I biomedicin er den tilsvarende mulighed ikke kun at skrive kode, men at skrive og validere protokoller, strukturere data, overvåge eksekvering og lukke cirklen mellem forudsigelse og måling, og forbinder AI til menneskelige videnskabsmænd i laboratorier.

LabOS: Når AI kører på et operativsystem for laboratorier i morgen

I vores arbejde på Stanford på AI4Science, der omfatter genedit-copiloter som CRISPR-GPT og AI-XR co-eksekutionssystemer som LabOS, der hjælper videnskabsmænd i biomedicinske og materialsvidenskabelige laboratorier, har vi været ude at udforske en arkitektonisk skift:

1. Design af et end-to-end “laboratorieoperativsystem”, der kobler en digital (tør) laboratorie til en fysisk (våd) laboratorie.

Præmisset er enkelt: Hvis en laboratoriebog er videnskabens hukommelse, så bør et laboratorie-OS være eksekveringslaget, der indfanger intention, oversætter det til handling, observerer resultater og omdanner hver kørsel til struktureret viden.

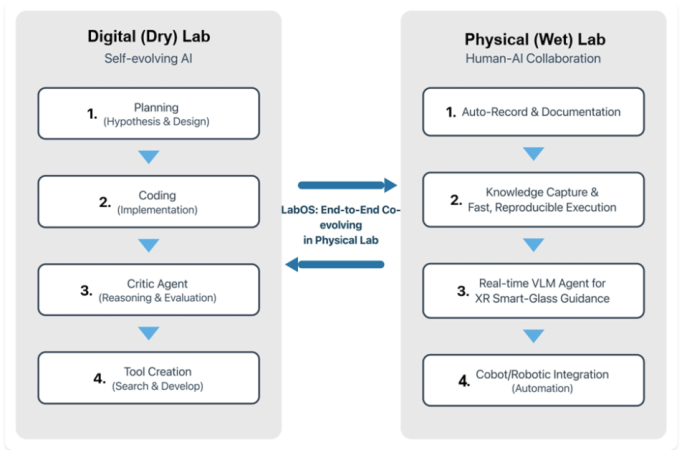

Figur. En konceptuel visning af LabOS, der kobler en selvudviklende digital laboratorieløkke (planlægning, kodning, kritik, værktøjsbygning) med en menneske-AI-vådlaboratorieløkke (auto-dokumentation, videnindfanging, XR-vejledning og robotintegration).

2. AI i den digitale laboratorie – selvudviklende planlægning og værktøjsbygning

I den digitale (tørre) laboratorie kan vi lade AI gøre, hvad det allerede gør godt: søge, syntetisere og foreslå. Men vi vil også have, at det er selvforbedrende. Ikke ved at “hallucinere ny videnskab”, men ved at lære bedre værktøjer og arbejdsgange fra feedback.

En praktisk digital laboratorieløkke kan rammes som fire tilbagevendende faser:

- Planlægning (hypotese + design): foreslå hypoteser, vælge eksperimentvariable, forudse konfounders og specificere målbare slutpunkter.

- Kodning (implementering): generere eller tilpasse analyse-skripter, simulations-pipelines og instrumentkontrollær-templates, hvor det er relevant.

- Kritik-agent (råd + evaluering): stress-test antagelser, tjek statistisk kraft, foreslå kontroller og flagge sandsynlige fejlmodi.

- Værktøjsbygning (søg + udvikling): Når arbejdsgangen mangler en komponent (en parser, en QC-rutine, en dashboard), byg det og tilføj det tilbage til værktøjskassen.

3. AI i den fysiske laboratorie – AI med “øjne” (XR-briller) og “hænder” (robotteknologi)

Den fysiske laboratorie er, hvor systemet enten tjener tillid – eller mister den. Målet er ikke at erstatte videnskabsmænd, men at reducere friktion og fejl, samtidig med at øge observerbarheden.

Vi betragter den fysiske laboratorieløkke som fire komplementære evner:

- Auto-optagelse og dokumentation: optage handlinger, tidsstempel, instrumentindstillinger og afvigelser automatisk, så dokumentation ikke er en eftertanke.

- VIDEN-indfanging til hurtig, reproducerbar eksekvering: omdanne kørsler til strukturerede, forespørgelige artefakter (protokolversions, parametersæt, QC-resultater) i overensstemmelse med dataforvaltningsprincipper som FAIR.

- Real-time vision-sprog-vejledning via XR-smartbriller: brug multimodale modeller til at fortolke scenen (hvad operatøren gør, hvilken reagens der er i hånden) og give trin-for-trin-vejledning og sikkerhedstjek. AR/XR har allerede demonstreret værdi i højrisikofysiske arbejdsgange som eksperimentvejledning (LabOS, Stanford, Princeton, i samarbejde med NVIDIA).

- Cobot/robotintegration til automatisering: standardisere repetitive trin, muliggøre sikre overdragelser og reducere variation. Platforme for simulation-til-virkelighed-arbejdsgange (for eksempel NVIDIA Isaac) og real-time AI-behandling på kanten, som smart glass live-streaming og menneske-AI-interaktion i LabOS, er vigtige aktiveringslag.

Denne arkitektur er i overensstemmelse med en bredere retning i feltet: “selvkørende” eller autonome laboratorier, der kombinerer automatisering med maskinel læring til at planlægge det næste eksperiment. Hvad LabOS tilføjer, er et tættere menneskegrænseflade-lag, så autonomi ikke kommer på bekostning af gennemsigtighed.

Hvorfor laboratoriegrads AI ikke bare er “AI på et datasæt”

AI-systemer for biomedicinsk/videnskabelig superintelligens ser ofte imponerende ud i retrospektiv evaluering eller ved at tage eksamener, og så underpræsterer i den fysiske laboratorie. Årsagen er sjældent en enkelt fejl. Det er typisk en mismatch mellem modellens antagelser og laboratoriets virkelighed.

Tre huller viser sig gentagne gange:

- Kontekstgap: datasæt omfatter typisk ikke de kontekstuelle variable, som operatører ved, er vigtige (temperatur-udsving, reagenspartinummer, subtile protokolforskydninger).

- Handlingssgap: mange AI-systemer kan anbefale, hvad der skal gøres, men kan ikke pålideligt oversætte anbefalingerne til valideret fysisk handling.

- Feedbackgap: uden struktureret, højkvalitetsfeedback fra eksekvering, kan modeller ikke lære, hvor de fejler – og videnskabsmænd kan ikke gennemgå, hvorfor.

At lukke disse huller handler mindre om at opfinde en ny neuralt netværksarkitektur, men mere om at bygge instrumentering, grænseflader og datakontrakter, der gør laboratoriet læseligt for maskiner, og tillader AI at se og arbejde med mennesker.

Tillid ved design: Sikkerhed og styring for AI, der kan handle

Agens AI i opdagelsesforskning rejser ikke kun bekymringer om nøjagtighed. Det introducerer nye fejlmodi, fordi det kan handle. I et laboratorie betyder handling potentielt for spild, skade eller misvisende konklusioner, især når eksperimenter føder ind i kliniske hypoteser.

En nyttig holdning er at behandle et AI-aktiveret laboratorie-stak som et socio-teknisk system, der kræver sikkerhed. Flere eksisterende rammer hjælper, men de må oversættes til laboratoriets virkelighed:

- Risikostyring som en kontinuerlig praksis: NIST’s AI-risikostyringsramme (AI RMF 1.0) giver en praktisk vending for at kortlægge, måle og styre AI-risiko på tværs af livscyklussen.

- Reguleringsmæssig tilpasning for medicin-tilstødende AI: FDA’s AI/ML-software som medicinsk enhed (SaMD) arbejde, herunder dets handlingsplan og relaterede retningslinjer, giver en konkrete vurdering af, hvad “god praksis” ligner, når AI påvirker patientpleje.

For genedit og andre højkonsekvensdomæner er styring allerede en global diskussion. Anbefalinger diskuteres om menneskegenom-edit, for at understrege behovet for passende tilsynsmechanismer og ansvarlig styring, som dem, der er fremlagt af American Society for Gene and Cell Therapy, eller ASGCT. Systemer som LabOS bør være designede til at gøre overholdelse lettere, ikke sværere.

Checkliste: Kontroller for sikker AI Co-videnskabsmænd for videnskabelig opdagelse

I vores syn bør et sikkerhedsbevidst laboratorie-OS implementere mindst følgende design:

- Proveniens som standard: hver datasæt, protokolversions og modeloutput skal være tilgængelig for input og tidsstempel.

- Begrænset autonomi: systemet skal have eksplisitte tilladelser (hvad det kan gøre uden bekræftelse) og eskalationsregler (hvornår det skal spørge).

- Menneskelig overtageri og gradvis degradering: Når sensorer eller datastrømme fejler, eller usikkerhed er høj, skal systemet falde tilbage til en sikrere, enklere tilstand.

- Kontinuerlig validering: in-silico-forudsigelser skal parres med fysisk laboratorie-validering; fysisk laboratorie-kørsler skal inkludere QC-porter, før konklusioner spreder sig nedstrøms tilbage til AI-modellerne/agentene i den digitale verden.

- Sikkerhed og dual-brugsbevidsthed: beskytte laboratorie-infrastruktur mod manipulation.

Udvikle mennesker overalt: Kan AI Co-videnskabsmænd udjævne spillefeltet?

En af de mest overbevisende løfter om en AI-XR “co-videnskabsmand” er ikke kun hastighed for eliteinstitutioner, men tilgængelighed for alle. Overvej, hvad der i øjeblikket begrænser mindre laboratorier, startup-virksomheder og fjern/landdistriktsklinikker:

- Begrænset adgang til specialiseret ekspertise for guldstandard-protokoller og instrumenter.

- Højere relativ omkostning af træning, fejl og omgørelse.

- Fragmenteret værktøjsudstyr: noter, regneark, instrumentlogger og analyse-skripter forbinder sjældent renligt.

Et system, der kan vejlede eksekvering i kontekst (gennem XR-briller), indfange, hvad der sker automatisk, og foreslå det næste bedste trin baseret på tidligere kørsler, kunne gøre avancerede assays mere reproducerbare på tværs af steder. I princippet kunne det også støtte distribueret klinisk forskning, hvor protokoller skal eksekveres konsekvent, selv når ressourcer varierer.

Tidsplan: Når får hver videnskabsmand og kliniker en Co-videnskabsmand?

Kort sagt er vi tættere, end mange tror, på nogle højværdi-, højfrekvensopgaver (såsom producere et lægemiddel pålideligt i laboratoriet) og længere væk, end de fleste demos antyder, for andre (såsom AI fuldstændigt løser store problemer som kræft eller Alzheimers). En realistisk tidsplan ser således ud:

- Kort sigt (inden for 1 år): Arbejdsgangs-copiloter, der reducerer administrativt arbejde: protokoldraft, litteratursyntese, analyse-skabeloner og automatiserede QC-rapporter. Begrænsningsfaktoren er integration, ikke modelkapacitet.

- Mellemlang sigt (1-2 år): Co-eksekutionssystemer i laboratoriet: XR-brille-vejledning, automatiseret dokumentation og selektiv robotteknologi for højvariations-trin. Tillid afhænger af revisionsspor og tæt menneske-i-løkken-design.

- Længere sigt (3+ år): Cross-domæne co-forskere, der forbinder opdagelse til translation: kobling af laboratorie-data til kliniske slutpunkter, overvågning af sikkerhedssignaler og hjælp til at designe forsøg – samtidig med at overholde regulerings- og etiske forventninger.

Fra kode til kur: Vejen frem til 1000x videnskabelig opdagelse

LabOS er et forsøg på at besvare et enkelt spørgsmål: Hvad hvis et eksperiment kunne køres som en samtale, hvor intention, eksekvering og bevis er forbundet fra ende til anden? Hvis vi bygger disse systemer godt, kan de hjælpe med at løse translationsgapet, der bremser biomedicin og mange fysiske videnskabsdiscipliner (f.eks. materialsvidenskab). Hvis vi bygger dem dårligt, vil de forstærke irreproducerbarhed og skabe nye sikkerhedsrisici.

Det vigtigste arbejde i de næste få år vil være grundlæggende: standardiserede data- og enhedsgrænseflader via bygning af operativsystemet (lige meget som iOS kører alle typer af apps), bygning af AI-benchmarks, der inkluderer eksekvering og usikkerhed (som LabSuperVision-benchmarket i LabOS), og start på udrulning i den virkelige verden, der opmuntrer til innovation, samtidig med at den beskytter patienter og forskningsintegritet.

For forskere og klinikere er spørgsmålet ikke, om AI vil indtræde i laboratoriet. Det har allerede gjort. Spørgsmålet er, om vi vil integrere det som en samling af ikke-tilkoblede værktøjer eller som et pålideligt, gennemsigtigt system designet til virkelighedens biomedicinske videnskab.

Forslag til læsning og kilder

- Reproducerbarhedsundersøgelse (Nature, 2016): https://www.nature.com/articles/533452a

- CRISPR-GPT peer-reviewed artikel (Nature Biomedical Engineering): https://www.nature.com/articles/s41551-025-01463-z

- Stanford Medicine nyheder om CRISPR-GPT (2025): https://med.stanford.edu/news/all-news/2025/09/ai-crispr-gene-therapy.html

- LabOS preprint (arXiv): https://arxiv.org/abs/2510.14861

- LabOS og LabSuperVision benchmark-website: https://ai4lab.stanford.edu

- NIST AI-risikostyringsramme (AI RMF 1.0): https://nvlpubs.nist.gov/nistpubs/ai/NIST.AI.100-1.pdf

- FDA-overblik over AI/ML-software som medicinsk enhed: https://www.fda.gov/medical-devices/software-medical-device-samd/artificial-intelligence-software-medical-device

- FAIR-data-principper (Scientific Data, 2016): https://doi.org/10.1038/sdata.2016.18

- Unite.AI om flaskeshals i small-molecule-lægemiddel-opdagelse: https://www.unite.ai/how-ai-is-breaking-down-the-bottlenecks-in-small-molecule-drug-discovery/

- Unite.AI om AI og robotkirurgi: https://www.unite.ai/how-ai-is-ushering-in-a-new-era-of-robotic-surgery/