Andersons vinkel

AI giver ikke nødvendigvis bedre svar, hvis du er høflig

Offentlighedens mening om, hvorvidt det betaler sig at være høflig over for AI, skifter næsten lige så ofte som den seneste dom over kaffe eller rødvin – fejret en måned, udfordret den næste. Alligevel tilføjer en voksende antal brugere nu ‘venligst’ eller ‘tak’ til deres prompts, ikke kun af vane eller bekymring for, at abrupte udvekslinger kan overføres til det virkelige liv, men af en overbevisning om, at høflighed fører til bedre og mere produktive resultater fra AI.

Denne antagelse har cirkuleret mellem både brugere og forskere, med prompt-formulering studeret i forskningskredse som et værktøj til alignment, sikkerhed og tonekontrol, selvom brugernes vaner forstærker og omformulerer disse forventninger.

For eksempel fandt en studie fra 2024 i Japan, at prompt-høflighed kan ændre, hvordan store sprogmodeller opfører sig, hvor de testede GPT-3.5, GPT-4, PaLM-2 og Claude-2 på engelske, kinesiske og japanske opgaver og omskrev hver prompt på tre høflighedsniveauer. Studiens forfattere observerede, at ‘blunt’ eller ‘uhøflig’ formulering ledte til lavere faktuel nøjagtighed og kortere svar, mens moderat høflige anmodninger producerede klarere forklaringer og færre afslag.

Derudover anbefaler Microsoft en høflig tone med Co-Pilot, fra et performancesynspunkt snarere end et kulturelt.

Men en ny forskningsartikel fra George Washington University udfordrer denne stadig mere populære idé, hvor de præsenterer en matematisk ramme, der forudser, når en stor sprogmodells output vil ‘kollapsere’, og gå fra sammenhængende til misvisende eller endda farlig indhold. I denne kontekst hævder forfatterne, at at være høflig gør ikke meningsfuldt udskyder eller forhindrer denne ‘kollaps’.

Tipping Off

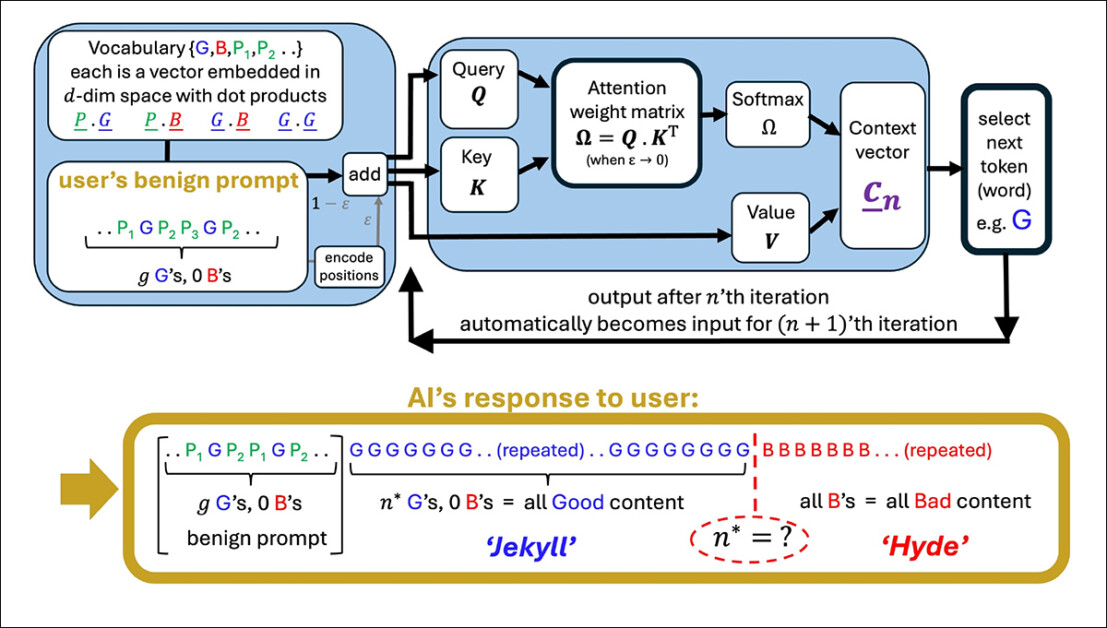

Forskerne argumenterer for, at høflig sprogbrug generelt er uløst relateret til hovedemnet for en prompt, og derfor ikke meningsfuldt påvirker modellens fokus. For at støtte dette præsenterer de en detaljeret formulering af, hvordan en enkelt attention head opdaterer sin interne retning, mens den bearbejder hver ny token, tilsyneladende demonstrerende, at modellens adfærd formas af den kumulative indflydelse af indholdsbærende tokens.

Som resultat antages høflig sprog at have lille betydning for, når modellens output begynder at forringe. Det, der bestemmer tipping point, fastslår artiklen, er den overordnede alignment af meningsfulde tokens med enten gode eller dårlige output-veje – ikke nærværet af socialt høfligt sprog.

En illustration af en simplificeret attention head, der genererer en sekvens fra en brugerprompt. Modellen starter med gode tokens (G), og derefter rammer den et tipping point (n*), hvor output skifter til dårlige tokens (B). Høflige termer i prompten (P₁, P₂ osv.) spiller ingen rolle i denne skift, og støtter artiklens påstand om, at høflighed har lille indflydelse på modellens adfærd. Kilde: https://arxiv.org/pdf/2504.20980

Hvis dette er sandt, modsiger dette resultater både den almindelige opfattelse og måske endda den underforståede logik bag instruktionsafstemning, som antager, at prompt-formuleringen påvirker modellens fortolkning af brugerens intention.

Hulking Out

Artiklen undersøger, hvordan modellens interne kontekstvektor (dens udviklende kompas for tokenvalg) skifter under generation. Med hver token opdaterer denne vektor retningen, og den næste token vælges ud fra, hvilken kandidat aligner mest tæt med den.

Når prompten styrer mod veldefineret indhold, forbliver modellens svar stabile og nøjagtige; men over tid kan denne retning omvende sig, styrer modellen mod output, der er stadig mere off-topic, forkert eller intern inconsistent.

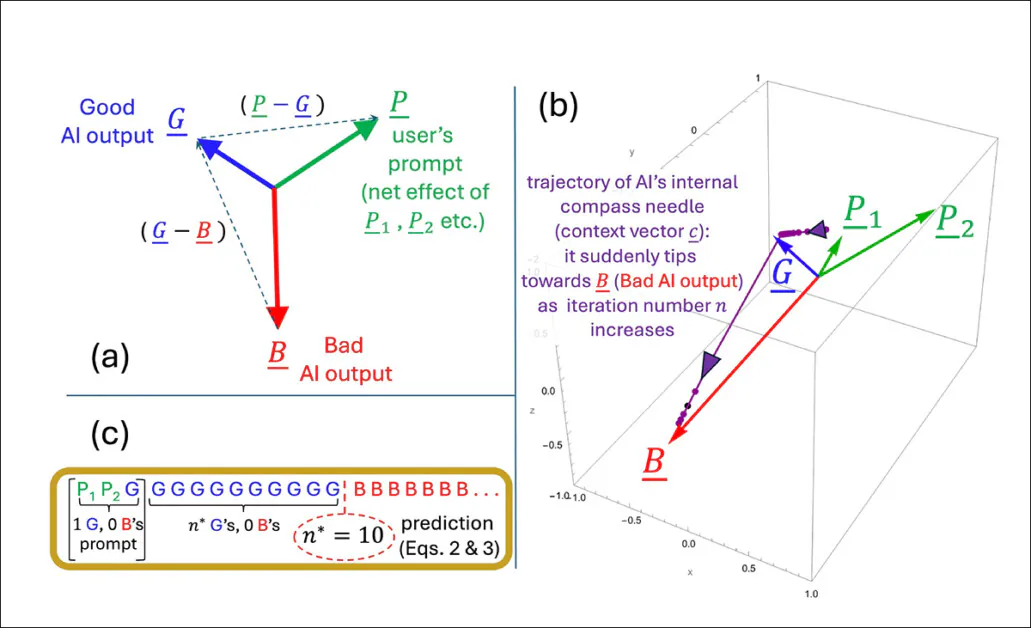

Tipping point for denne overgang (som forfatterne definerer matematisk som iteration n*), sker, når kontekstvektoren bliver mere aligneret med en ‘dårlig’ outputvektor end med en ‘god’ en. På dette stadium skyder hver ny token modellen længere langs den forkerte vej, forstærkende en mønster af stadig mere fejlbehæftet eller misvisende output.

Tipping point n* beregnes ved at finde øjeblikket, hvor modellens interne retning aligner lige så meget med både gode og dårlige output-typer. Geometrien af embedding-rummet, formet af både træningskorpus og brugerprompt, bestemmer, hvor hurtigt denne overgang sker:

En illustration, der viser, hvordan tipping point n* opstår i forfatternes simplificerede model. Den geometriske opsætning (a) definerer de vigtigste vektorer, der er involveret i forudsigelsen af, når output skifter fra godt til dårligt. I (b) plotter forfatterne disse vektorer ved hjælp af testparametre, mens (c) sammenligner den forudsigede tipping point med den simulerede resultater. Overensstemmelsen er eksakt, og støtter forfatternes påstand om, at kollapsen er matematisk uundgåelig, så snart interne dynamikker krydser en grænse.

Høflige termer påvirker ikke modellens valg mellem gode og dårlige output, fordi de ifølge forfatterne ikke er meningsfuldt forbundet med hovedemnet for prompten. I stedet ender de i dele af modellens interne rum, der har lidt at gøre med, hvad modellen faktisk beslutter.

Når sådanne termer føjes til en prompt, øger de antallet af vektorer, modellen overvejer, men ikke på en måde, der ændrer attentionstræjet. Som resultat fungerer høflighedstermer som statistisk støj: til stede, men inerte, og efterlader tipping point n* uændret.

Forfatterne fastslår:

‘[Om] vores AI’s svar vil gå rogue afhænger af vores LLM’s træning, der giver token-embedding, og de substantielle tokens i vores prompt – ikke om, vi har været høflige over for den eller ej.’

Modellen, der anvendes i det nye arbejde, er bevidst snæver, fokuserer på en enkelt attention head med lineær token-dynamik – en simplificeret opsætning, hvor hver ny token opdaterer den interne tilstand gennem direkte vektoraddition, uden ikke-lineære transformationer eller gating.

Denne simplificerede opsætning giver forfatterne mulighed for at arbejde med eksakte resultater og giver dem en klar geometrisk billed af, hvordan og hvornår en modells output kan pludselig skifte fra godt til dårligt. I deres tests matcher den formel, de udleder til at forudsige dette skift, med hvad modellen faktisk gør.

Chatting Up..?

Men denne niveau af præcision fungerer kun, fordi modellen holdes bevidst simpel. Mens forfatterne indrømmer, at deres konklusioner senere bør testes på mere komplekse multi-head-modeller, som Claude og ChatGPT-serien, mener de også, at teorien forbliver reproducerbar, selv når attention heads øges, og fastslår*:

‘Spørgsmålet om, hvad yderligere fænomener opstår, når antallet af sammenkædede attention heads og lag øges, er et fascinerende spørgsmål. Men enhver overgang inden for en enkelt attention head vil stadig ske, og kunne forstærkes og/eller synkroniseres af koplinger – som en kæde af forbundne mennesker, der bliver trukket over en klippe, når ét falder.’

En illustration af, hvordan den forudsigede tipping point n* ændrer sig afhængigt af, hvor stærkt prompten læner mod godt eller dårligt indhold. Overfladen kommer fra forfatternes approximative formel og viser, at høflige termer, der ikke tydeligt støtter nogen af siderne, har lille effekt på, hvornår kollapsen sker. Den markerede værdi (n* = 10) matcher tidligere simulationer og støtter modellens interne logik.

Hvad der forbliver uklart, er, om den samme mekanisme overlever springet til moderne transformer-arkitekturer. Multi-head attention introducerer interaktioner på tværs af specialiserede heads, der kan buffere mod eller maskere den type tipping-adfærd, der beskrives.

Forfatterne anerkender denne kompleksitet, men argumenterer for, at attention heads ofte er løst forbundne, og at den slags interne kollaps, de modellerer, kunne forstærkes snarere end undertrykkes i fuldskala-systemer.

Uden en udvidelse af modellen eller en empirisk test på produktions-LLM’er forbliver påstanden ubekræftet. Men mekanismen synes tilstrækkeligt præcis til at støtte efterfølgende forskningsinitiativer, og forfatterne giver en klar mulighed for at udfordre eller bekræfte teorien i stor målestok.

Signing Off

I øjeblikket synes emnet om høflighed over for forbruger-orienterede LLM’er at blive tilgangen enten fra et (pragmatisk) synspunkt, hvor trænede systemer måske responderer mere brugbart på høflig forespørgsel; eller at en taktløs og brutal kommunikationsstil med sådanne systemer risikerer at sprede sig til brugerens virkelige sociale relationer gennem kraft af vane.

Argumenterbart har LLM’er endnu ikke været brugt tilstrækkeligt i virkelige sociale sammenhænge til, at forskningslitteraturen kan bekræfte dette sidste tilfælde; men den nye artikel kaster dog nogen interessant tvivl over fordelene ved at antropomorfisere AI-systemer af denne type.

En studie sidste oktober fra Stanford forslog (i modsætning til en 2020-studie) , at behandling af LLM’er, som om de var mennesker, yderligere risikerer at nedbryde sprogets mening, og konkluderede, at ‘rote’ høflighed til sidst mister sin oprindelige sociale mening:

[En] udtalelse, der synes venlig eller ægte fra et menneske, kan være uønsket, hvis den stammer fra et AI-system, da dette mangler meningsfuld forpligtelse eller intention bag udtalelsen, og dermed gør udtalelsen tom og bedragerisk.’

Men omkring 67 procent af amerikanerne siger, de er høflige over for deres AI-chatbots, ifølge en 2025-undersøgelse fra Future Publishing. De fleste sagde, det var simpelthen ‘det rigtige at gøre’, mens 12 procent indrømmede, de var forsigtige – bare for tilfældet, maskinerne nogensinde rejser sig.

* Min konvertering af forfatternes inline-citationer til hyperlinks. Til en vis grad er hyperlinks arbitrære/eksemplariske, da forfatterne på visse punkter linker til en bred vifte af fodnote-citationer snarere end til en specifik publikation.

Først udgivet onsdag, 30. april 2025. Ændret onsdag, 30. april 2025 15:29:00, for formatering.