Andersons vinkel

AI-samtalemodeller kan drive omkostninger op gennem endeløs snak

Populære AI-samtalemodeller hemmeligt spilder enorme mængder betalte tokens på meningsløs snak. De berørte modeller ved selv, at de gør dette, men kan ikke stoppe sig selv.

Large Reasoning Models (LRMs) som ChatGPT-5 og Google Gemini beregner mere for reasoning – at gå gennem et problem trin for trin, hvilket kræver betydeligt mere beregningskraft end blot at forudsige næste ord. Den simulerede reasoneringsproces tager længere tid og koster mere at køre; følgelig ender brugerne med at betale for den ‘ekstra tænketid’.

Men hvis du har brugt en state-of-the-art LLM for nylig, har du måske lagt mærke til, at din tildeling af tokens ofte bliver spildt på snak og unødvendigt ord, i stedet for at fokusere på at løse de problemer, du stiller til modellen. Dette kan tage form af overdreven sycophancy, prolix og/eller redundante svar – eller endda en slags ‘snak’, som om AI var fanget på fersk gerning og forsøger at tale sig ud af en pinlig situation.

Naturligvis ville vi foretrække, at vores LLMs giver op, følger eller tilbyder alternative veje, eller anmoder om klarhed. Men selv at få en AI af denne type til at indrømme, at den ikke kender svaret, er en betydelig udfordring i sig selv.

I mellemtiden kan brugere på lavere eller gratis niveauer finde, at de har brændt igennem deres tokens i en hurtig rate, uanset hvor målrettet eller økonomiske deres forespørgsler og interaktioner var, fordi AI selv elsker at tale; og i dette tilfælde er tale ikke billig.

Ord-salat

I forhold til den nævnte ‘snak’, tilbyder en ny akademisk samarbejdsprojekt en begrundelse og en løsning ved at foreslå, at LLM’er med reasoneringsfunktioner er tilbøjelige til at brænde igennem dine tokens, når de falder i en ‘ord-salat’-løkke – en tilstand af forvirring, hvor reasoneringsprocessen bliver fanget i rekursive blindgyder – på din regning*.

Forskerne bag det nye papir har fundet, at en betydelig del af de tokens, der bearbejdes i en typisk LLM, består af gentagelser og redundanser – og at modellen selv synes at forstå, at den er i vanskeligheder, selv om den ikke kan stoppe den dyre løkke.

Papiret siger:

‘Vi viser, at en betydelig del af disse tokens er meningsløse selv-gentagelser – hvad vi kalder “ord-salat” – der udtømmer dekodningsbudgettet uden at tilføje værdi. Interessant nok observerer vi, at LRM’er er selvbevidste, når de er fanget i disse løkker: de skjulte tilstande af <\n\n> tokens, der følger hver reasoneringsbid, viser mønstre, der tillader os at detectere ord-salat-adfærd på-the-fly via en enkelt-lags lineær klassifikator.

‘Når det er opdaget, giver en simpel beskæring efterfulgt af en direkte regenereringsprompt betydelige længdesbesparelser med minimal kvalitetstab.’

Løsningen, der tilbydes af det nye arbejde, er en intervention, der kan afbryde den spirallende proces af en fejlbeskæftiget LRM på-the-fly, uden inklusion i træningsdata eller nogen af den skade, der kan følge af fine-tuning. Rammen, der hedder WordSaladChopper, er blevet offentliggjort på GitHub.

Selv om det første arbejde koncentrerer sig om DeepSeek-varianter som f.eks. indgange i Qwen- og Llama-serien, fastslår papiret, at den uønskede adfærd sandsynligvis er applicable til en langt større del af lignende arkitekturer (herunder populære API-kun-tilbud som ChatGPT og Google Gemini).

Som papiret bemærker, ligner tidligere tilbud som Demystifying Long Chain-of-Thought Reasoning in LLMs og Small Models Struggle to Learn from Strong Reasoners også brugen af det lille antal offentligt tilgængelige Chain-of-Thought (CoT) reasoneringsmodeller til at etablere en bredere problematik blandt denne klasse af modeller†:

‘[LRM’er] har tendens til at spilde en enorm mængde dekodningsbudget, blot ved at gentage sig selv ordret, med små variationer, eller ved at engagere sig i endeløs opregning af tilfælde, indtil alle budget er blevet [udgifter] – vi henviser til sådan adfærd som Ord-salat, en term, der ofte bruges til at latterliggøre offentlige talsmænd for at give lange, fyldige og jargonfyldte svar, der ultimativt mangler substans eller klar mening.

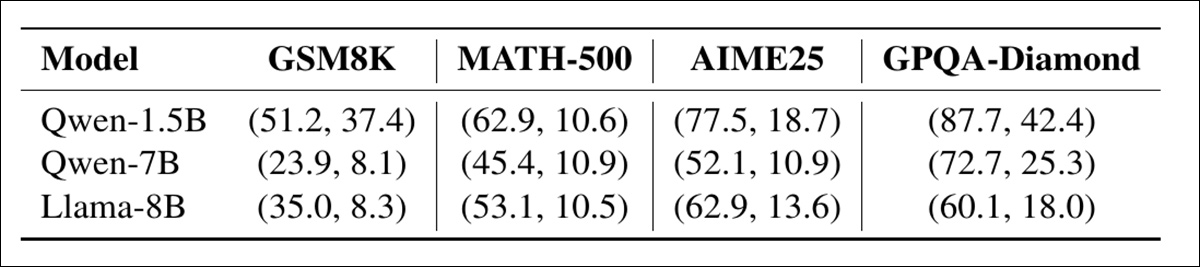

‘Den “Original”-kolonne i [tabellen nedenfor] viser, at når vi besvarer GPQA-Diamond, observerer vi, at 55%+ af tokens, der er genereret af DeepSeek-R1-Distill-modellerne, er markeret som “ord-salat-tokens”, hvor de ikke tilføjer værdi fra et semantisk synspunkt.’

![Andelen af output-tokens, der er identificeret som semantisk redundant, når der besvares GPQA-Diamond. WordSaladChopper reducerer denne overhæng fra over 55% til under 6% på tværs af alle testede DeepSeek-R1-Distill-modeller, fastslår forfatterne. [ Kilde ] https://arxiv.org/pdf/2511.00536](https://www.unite.ai/wp-content/uploads/2025/11/table-1.jpg)

Andelen af output-tokens, der er identificeret som semantisk redundant, når der besvares GPQA-Diamond. WordSaladChopper reducerer denne overhæng fra over 55% til under 6% på tværs af alle testede DeepSeek-R1-Distill-modeller, fastslår forfatterne. Kilde

Forfatterne bemærker, at forsøg på at forkorte reasoneringsprocesser, mens man bevarende svarkvalitet, er blevet en stærk understrøm i forskningslitteraturen, navnlig long-to-short (L2S); og observerer yderligere, at selv om deres projektformål er lignende til en håndfuld tidligere initiativer, er deres eget det første, der tilbyder en ad hoc-løsning, der ikke kræver intervention i træningsprocessen, modelredigering eller andre mulige påvirkninger af LLM’ens basisarkitektur; og i den forstand mener de, at deres tilgang burde blive almindelig blandt anvendelige systemer†:

‘Givet dets lave overhæng, store besparelser og manglen på semantisk værdi af ord-salat-tokens, tror vi, det ikke er for langt ude at argumentere for, at [WordSaladChopper] – eller en lignende komponent – er et must-have for alle LRM-anvendelser med brugeroplevelse i mente ‘

Det nye papir hedder Word Salad Chopper: Reasoning Models Waste A Ton Of Decoding Budget On Useless Repetitions, Self-Knowingly, og kommer fra seks forskere på University of Minnesota, Rice University, Stevens Institute of Technology og Lambda, Inc.

Tidligere overvejelser

For at spore tendensen hos reasonerings-LLM’er til at gentage sig selv, delte forfatterne modellernes output i bidder, hvor der var dobbelte linjeskift, og kontrollerede derefter, hvor lignende hver bid var til tidligere bidder:

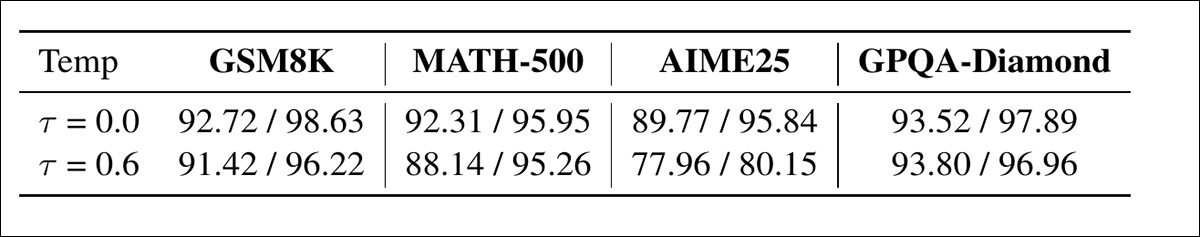

Estimeret andel af reasoneringsbidder, der er markeret som ord-salat under to dekodningstemperaturer (τ = 0,0, 0,6). Klassifikatoren markerer en bid som ‘ord-salat’, når den ligner en tidligere del af modellens output, hvilket antyder gentagelse snarere end fremgang. Resultaterne viser, at denne adfærd er udbredt på tværs af datasæt og modellstørrelser.

Hvis en bid var for lignende, blev den markeret som ‘ord-salat’ (effektivt en meningsløs gentagelse).

Forskerne bemærker, at når en model indtræder ‘ord-salat’-tilstand, er det meget usandsynligt, at den kan undslippe uden ekstern hjælp, men i stedet forbliver i den dyre løkke, indtil brugerens dekodningsbudget er brugt††:

‘Det er ikke nødvendigt at sige, at dette præsenterer et katastrofalt problem for brugere, da en ideelt set meget kortere tænkeafsnit nu er maksimeret med meningsløse gentagelser. Så brugeren betaler i virkeligheden den maksimale pris for et (sandsynligvis) forkert svar, mens de udholder den længste slut-til-slut-forsinkelse.’

Andelen af ord-salat-bidder, der optræder før og efter skæringstidspunktet (dvs. øjeblikket, hvor gentagne output begynder at dominere). De fleste gentagelser optræder efter dette tidspunkt, hvilket viser, at når en model indtræder en ord-salat-løkke, genvinder den sjældent uden intervention.

Forfatterne genkalder sig deres overraskelse, da de opdagede, at reasonerings-LLM’er††† viste tegn på at være bevidste om deres ord-salat-tilstand. Men det er denne bevidsthed, og måden, den indtræder i modellens sandsynlige reasoneringstilstand, der tillader en system for intervention:

‘Letvægten af denne lineære klassifikator åbner døren for på-the-fly-detection, hvor vi kan effektivt intervenere med forskellige operationer for at tackle modeller, der er fanget i ord-salat-løkker.’

Metode

For at detectere tilstedeværelsen af ord-salat under inferens, trænede forfatterne en simpel lineær klassifikator, der kører på den skjulte tilstand af hver dobbelt newline-token.

Enhver bid, der optrådte efter, at modellen indtrådte en gentagelsesløkke, blev behandlet som ord-salat, med denne afkorting (kaldet skæringstidspunktet) brugt til at markere træningsdata. Tusind reasoneringsspor blev genereret ved hjælp af S1-benchmark, og hver spor blev delt i newline-adskilte bidder.

Konceptuel skema for WordSaladChopper. Under generation analyseres den skjulte tilstand ved hver dobbelt newline-token for at detectere gentagne segmenter. Når to ‘ord-salat’-bidder er markeret i træk, stoppes generationen. En fast regenereringsprompt føjes derefter til, hvilket tillader modellen at fortsætte og afslutte svaret uden at overskride budgettet.

Hvis en bid blev fundet til at være meget lignende en tidligere, blev den markeret som ord-salat. Når den tidligste vedvarende gentagelse blev identificeret, blev alle efterfølgende bidder også markeret som ord-salat for at reflektere vedvarelsen af disse løkker.

Klassifikatoren blev implementeret som en enkelt fuldt forbundet lag og trænet på de skjulte tilstande af de efterfølgende tokens fra den sidste transformer-blok. En separat klassifikator blev trænet for hver model, ved hjælp af denne data, og ingen fine-tuning blev udført under evaluering.

Data og tests

Træning og inferens brugte fire NVIDIA A100 (80G VRAM)-GPU’er, under Adam-optimeren, med en læringsrate på 1×10-2, i 50 epoch.

Evaluationsdatasættene var ‘Grade School Math’ 8000, også kendt som GSM8K; MATH-500; GPQA-DIAMOND; og AIME25 (2025).

Modellerne, der blev testet, var DeepSeek-R1-Distill-Qwen-1.5B; DeepSeek-R1-Distill-Qwen-7B; og DeepSeek-R1-Distill-Llama-8B, alle under MIT-licens.

Metrikkerne, der blev brugt, var nøjagtighed og AUROC.

Nøjagtighed og AUROC af ord-salat-klassifikatoren på Qwen-7B på tværs af fire benchmarks og to dekodningstemperaturer. Høje score bekræfter, at begyndelsen af gentagelse kan pålides på-the-fly fra den skjulte tilstand af den efterfølgende newline-token.

Af resultaterne, der er vist her, kommenterer forfatterne:

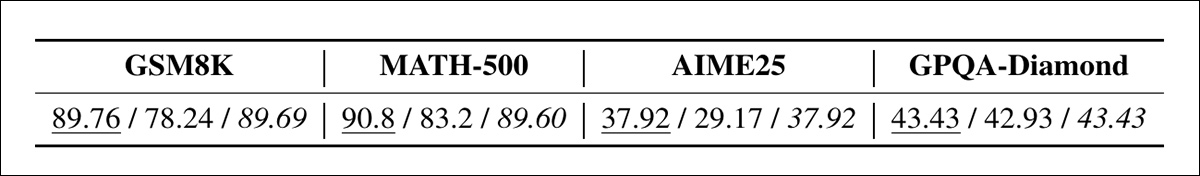

‘[Resultat-tabellen ovenfor] viser, at den lineære klassifikator er ekstremt nøjagtig i at detectere ord-salat-bidder; dog [resultat-tabellen nedenfor] demonstrerer, at regenereringsprompten hjælper med at genskabe den tabte opgave-nøjagtighed fra brutalt skæring.’

Nøjagtighed af Qwen-7B på hver benchmark ved τ = 0,6, sammenligning af præstation før ord-salat (Original), efter skæring (Skåret) og efter regenerering (Regenereret). Gevinsterne fra regenerering er beskedne, men konsekvente, og genskaber præstationen før løkken i de fleste tilfælde.

I resultat-tabellen nedenfor kan vi se, at WordSaladChopper forbedrede eller bevarede nøjagtighed, mens den skarpt reducerede længden af modellens output, med op til 57%:

Når WordSaladChopper bruges ved græsk dekodning (τ = 0), reducerer den længden af modellens output, undertiden med mere end halvdelen, mens den bevarede nøjagtighed den samme eller lidt bedre, en præstation, der forbliver konsekvent blandt forskellige modeller og opgaver (AIME25 er udeladt på grund af forventede ustabile resultater under denne indstilling).

De største gevinster optrådte i længere svar, især på GPQA-Diamond, hvor næsten halvdelen af teksten blev fjernet uden at skade præstationen. Nedenfor kan vi se lignende resultater, når tilfældighed blev tilføjet under generation:

Ved højere temperatur (τ = 0,6) fortsætter WordSaladChopper med at forkorte output med 10-30 procent, mens nøjagtigheden forbliver stabil eller lidt forbedret på tværs af alle modeller og benchmarks (AIME25-resultaterne er gennemsnitligt for at reducere varians).

Her forblev nøjagtigheden stabil, mens der blev opnået kortere output. På tværs af brættet fortsætter systemet med at fungere, selv når modellens svar blev mere gentagne; og forfatterne bemærker, at da klassifikatoren kun kontrollerer ét token per sætning, kører den ekstremt hurtigt, selv når den bruges under live-generation.

Papiret observerer, at yderligere strategier i fremtidig forskning langs disse linjer kunne drage fordel af at give modellen en lille regenereringsbudget efter interventionen; kontinuerlig anvendelse af et WordSaladChopper-lignende system over regenereringer; og påtvang af en ‘end-of-think’-token på modellen, for at kræve dens bedste nuværende svar.

Til sidst kommenterer forskerne på kvaliteten af den nuværende tilstand af kunst i evaluering af reasoneringsmodeller, med en kritisk tone†:

‘[Det] er vores ærlige overbevisning, at mange effektive reasoneringsmetoder synes effektive delvist, fordi nuværende reasonerings-evaluationsbenchmarks har meget rum for forbedring.

‘Skal vi udvikle mere omfattende evaluerings suites – som vi sandsynligvis vil i fremtiden – forventer vi at se, at mange effektive reasoneringsmetoder fejler eller opfører sig meget forskelligt end deres vanilla-LRM-modstykke.’

Konklusion

På den skala, der er nået af førende systemer som ChatGPT, kan selv små ændringer i brugerressourcerforbrug have betydelige infrastruktur-, logistik- og omkostningsimplikationer. Dette gør effektivitet til en fælles prioritet for både udbydere og den bredere forskningskommmunitet.

Hvis det nye og letvægtsystem, der er foreslået i papiret, blev implementeret (som skal være tilpasset til hver ny modelarkitektur), kunne det forhindre det meningsløse forbrug af tokens – hvilket kan give kunden indtryk af, at udbyderen ‘bløder ud’ deres tildeling på en ødsel eller bedragerisk måde. I virkeligheden gør udbyderen bedre ved at levere nyttigt snarere end redundant output, der koster det samme i beregningsmæssig henseende som en ord-salat.

* Selv om vi ikke vil udvide på dette her, omfatter dette også lokalt-vært-modeller, der kan være både virksomheds- og hobbyistiske, og hvor elforbrug og produktivitetstab af ord-salat kan være en faktor værd at bemærke.

† Som sædvanligt er alle fremhævelser forfatternes, og ikke min egen. Hvor det er relevant, er deres inline-citationer blevet konverteret til links af mig.

†† Her må vi anerkende, at rammer og API’er kan tildele ‘under-budget’ til forespørgsler, sådan at en forespørgsel ikke nødvendigvis kan forbruge en dags tilladelse af tokens – men dette er ikke almindelig praksis, og diskuteres ikke ofte blandt API-kun-udbydere.

††† Jeg er ikke generelt parat til at antage forfatternes brug af ‘LRM’er’, da dette ikke er en mainstream-forkortelse, så jeg vil bruge anden terminologi i denne artikel, hvis nødvendigt.

Først udgivet torsdag, 6. november 2025