Umělá inteligence

AI Image Matting That Understands Scenes

V dokumentárním filmu doprovázejícím vydání DVD filmu Alien3 (1992) z roku 2003 vzpomínal legendární tvůrce vizuálních efektů Richard Edlund s hrůzou na “sumo wrestling” fotochemické extrakce matice, který dominoval práci s vizuálními efekty mezi koncem 30. let a koncem 80. let. Edlund popsal náhodnou povahu procesu jako “sumo wrestling” ve srovnání s digitálními technologiemi modré/zelené obrazovky, které převzaly kontrolu na počátku 90. let (a od té doby se k této metafoře vrátil).

Extrakce předního prvku (jako je osoba nebo model kosmické lodi) z pozadí, aby se mohla výřezová obrazová informace složit do pozadí, byla původně provedena natáčením předního objektu proti jednotnému modrému nebo zelenému pozadí.

Náročné fotochemické procesy extrakce pro VFX shot od ILM pro ‘Return of the Jedi’ (1983). Source: https://www.youtube.com/watch?v=qwMLOjqPmbQ

Ve výsledném záběru by byla pozadí barevně izolována chemicky a použita jako šablona pro přepis předního objektu (nebo osoby) v optickém tiskárně jako “plovoucí” objekt v jinak transparentní filmové buňce.

Proces se nazýval barevná separace překrytí (CSO) – ačkoli tento termín se později stal více spojený s hrubými ‘Chromakey’ video efekty v nižších rozpočtových televizních výstupech 70. a 80. let, které byly dosaženy analogovými spíše než chemickými nebo digitálními prostředky.

Demonstrace Color Separation Overlay v roce 1970 pro britskou dětskou show ‘Blue Peter’. Source: https://www.bbc.co.uk/archive/blue_peter_noakes_CSO/zwb9vwx

V každém případě, ať už pro filmové nebo video prvky, poté mohla být extrahovaná stopáž vložena do jakéhokoli jiného záběru.

Ačkoli Disneyho výrazně dražší a proprietární sodík-vápenný proces (který byl zaměřen na žlutou, konkrétně, a byl také použit pro Alfreda Hitchcocka v roce 1963 horor The Birds) poskytoval lepší definici a ostřejší matice, fotochemická extrakce zůstala namáhavá a nespolehlivá.

Disneyho proprietární sodík-vápenný proces extrakce vyžadoval pozadí blízko žluté části spektra. Zde Angela Lansbury visí na lanech během produkce VFX-laced sekvence pro ‘Bedknobs and Broomsticks’ (1971). Source

Beyond Digital Matting

V 90. letech digitální revoluce odstranila chemikálie, ale ne potřebu zelených obrazovek. Bylo možné odstranit zelenou (nebo jakoukoli) barvu pozadí jednoduše hledáním pixelů v rámci tolerance rozsahu této barvy, v pixel-editačním softwaru, jako je Photoshop, a v novém поколění video-kompozičních sad, které mohly automaticky vyřadit barevná pozadí. Téměř přes noc, šedesát let optického tiskového průmyslu byly odsouzeny k historii.

Posledních deset let urychleného počítačového vidění výzkumu je uvádí extrakci matice do třetí éry, zadávající výzkumníkům vývoj systémů, které mohou extrahovat vysoce kvalitní matice bez potřeby zelených obrazovek. Na Arxiv alone, články související s inovacemi v strojovém učení založené na extrakci popředí jsou týdenním prvkem.

Putting Us in the Picture

Tento locus akademického a průmyslového zájmu o extrakci AI již dopadl na spotřebitelský prostor: hrubé, ale funkční implementace jsou nám všem známé ve formě Zoom a Skype filtrů, které mohou nahradit naše obývací pokoj pozadí s tropickými ostrovy, atd., v video konferenčních hovorech.

Nicméně, nejlepší matice stále vyžadují zelenou obrazovku, jak Zoom poznamenal minulou středu.

Vlevo, muž před zelenou obrazovkou, s dobře extrahovanými vlasy prostřednictvím Zoom Virtual Background funkce. Vpravo, žena před normální domácí scénou, s vlasy extrahovanými algoritmicky, méně přesně, a s vyšším výpočetním požadavkem. Source: https://support.zoom.us/hc/en-us/articles/210707503-Changing-your-Virtual-Background-image

Další článek z platformy Zoom Support varuje, že ne-zelená obrazovka extrakce také vyžaduje větší výpočetní výkon ve snímacím zařízení.

The Need to Cut It Out

Zlepšení kvality, přenositelnosti a ekonomie zdrojů pro “v divočině” matice extrakční systémy (tj. izolace lidí bez potřeby zelených obrazovek) jsou relevantní pro mnoho více sektorů a aktivit než jen video konferenční filtry.

Pro vývoj datového souboru nabízí lepší obličejové, plné hlavy a plné tělo rozpoznání možnost zajištění, že nežádoucí pozadí prvky nebudou trénovány do počítačového vidění modelů lidských subjektů; přesnější izolace by značně zlepšila semantic segmentation techniky navržené pro rozlišení a asimilaci domén (tj. ‘kočka’, ‘osoba’, ‘loď’), a zlepšila by VAE a transformer-based založené obrazové syntézy systémy, jako je OpenAI’s nový DALL-E 2; a lepší extrakční algoritmy by snížily potřebu drahého manuálního rotoscoping v nákladných VFX potrubích.

Skutečně, vzestup multimodálních (obvykle text/obraz) metodologií, kde je doména, jako je “kočka”, zakódována jak jako obraz, tak s přidruženými textovými odkazy, již činí pokroky v obrazové zpracování. Jedním z nedávných příkladů je Text2Live architektura, která používá multimodální (text/obraz) trénink pro vytváření videí, z nichž mnohé možnosti, křišťálové labutě a skleněné žirafy.

Scene-Aware AI Matting

Velká část výzkumu do AI-založené automatické matice se zaměřila na rozpoznání hranic a hodnocení pixel-založených seskupení uvnitř obrazu nebo video rámečku. Nicméně, nový výzkum z Číny nabízí extrakční potrubí, které zlepšuje vymezení a kvalitu matice pomocí textových popisů scény (multimodální přístup, který získal trakci v počítačovém vidění výzkumném sektoru za posledních 3-4 let), tvrdí, že zlepšil předchozí metody několika způsoby.

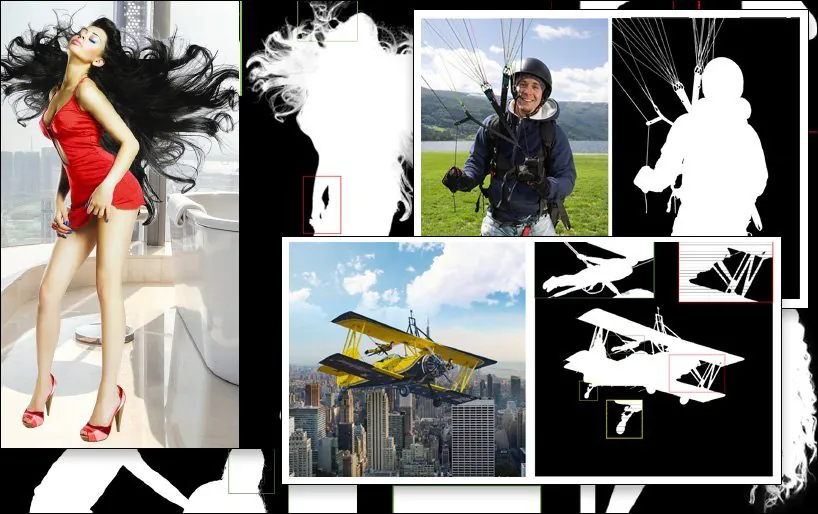

Příklad SPG-IM extrakce (poslední obraz, dolní pravá), ve srovnání s předchozími metodami. Source: https://arxiv.org/pdf/2204.09276.pdf

Výzvou pro extrakční výzkum sub-sektor je produkovat pracovní postupy, které vyžadují minimální ruční anotaci a lidskou intervenci – ideálně, žádnou. Kromě nákladových implikací, výzkumníci nového článku pozorují, že anotace a manuální segmentace provedené outsourcovanými davovými pracovníky napříč různými kulturami mohou způsobit, že obrázky jsou označeny nebo dokonce segmentovány odlišnými způsoby, vedoucí k nesouladným a nespokojeným algoritmům.

Jedním z příkladů je subjektivní interpretace toho, co definuje “přední objekt”:

Z nového článku: předchozí metody LFM a MODNet (‘GT’ znamená Ground Truth, ‘ideální’ výsledek často dosažený manuálně nebo ne-algoritmickými metodami), mají různé a různě účinné názory na definici popředí obsahu, zatímco nová metoda SPG-IM více účinně vymezuje ‘blízký obsah’ prostřednictvím scénického kontextu.

Aby se tomu zabránilo, výzkumníci vyvinuli dvou-stupňový potrubí nazvaný Situational Perception Guided Image Matting (SPG-IM). Dvou-stupňová encoder/decoder architektura se skládá z Situational Perception Distillation (SPD) a Situational Perception Guided Matting (SPGM).

Nejdříve SPD předtrénuje vizuálně-textové feature transformace, generující popisky vhodné pro jejich přidružené obrázky. Poté je předpověď popředí masky povolena spojením potrubí s novou saliency prediction technikou.

Poté SPGM výstupní odhadované alfa matice založené na surovém RGB obrazovém vstupu a vygenerované masky získané v prvním modulu.

Cílem je situational perception guidance, kde systém má kontextuální pochopení toho, co obraz skládá, umožňující mu rámovat – například – výzvu extrahování komplexních vlasů z pozadí proti známým charakteristikám takového specifického úkolu.

V příkladu níže SPG-IM rozumí, že lana jsou intrinsic ke “padáku”, kde MODNet selhává v udržení a definování těchto detailů. Podobně výše, kompletní struktura hřišťního zařízení je libovolně ztracena v MODNet.

Nový článek se nazývá Situational Perception Guided Image Matting, a pochází z výzkumníků na OPPO Research Institute, PicUp.ai, a Xmotors.

Intelligent Automated Mattes

SPG-IM také nabízí Adaptive Focal Transformation (AFT) Refinement Network, který může zpracovat místní detaily a globální kontext samostatně, usnadňující “inteligentní matice”.

Porozumění scénickému kontextu, v tomto případě ‘dívka s koněm’, může potenciálně usnadnit extrakci popředí než předchozí metody.

Článek uvádí:

‘Věříme, že vizuální reprezentace z vizuálně-textové úlohy, například obrazový popisek, se zaměřují na více sémanticky komplexní signály mezi a) objektem a objektem a b) objektem a okolním prostředím, aby generovaly popisky, které mohou pokrýt jak globální info, tak místní detaily. Kromě toho, ve srovnání s drahými pixelovými anotacemi obrazové matice, textové štítky mohou být masivně shromážděny za velmi nízkou cenu.’

Architektura SPD je společně předtrénována s University of Michigan’s VirTex transformer-založený textový dekodér, který učí vizuální reprezentace ze sémanticky hustých popisků.

VirTex společně trénuje ConvNet a Transformers prostřednictvím obraz-popisek párů a přenáší získané znalosti do downstream vidění úkolů, jako je objektové rozpoznání. Source: https://arxiv.org/pdf/2006.06666.pdf

Mezi jinými testy a ablačními studiemi, výzkumníci testovali SPG-IM proti state-of-the-art trimap-založené metody Deep Image Matting (DIM), IndexNet, Context-Aware Image Matting (CAM), Guided Contextual Attention (GCA) , FBA, a Semantic Image Mapping (SIM).

Jiné předchozí rámce testovaly trimap-free přístupy LFM, HAttMatting, a MODNet. Pro spravedlivé srovnání, testovací metody byly adaptovány na základě různých metodologií; kde kód nebyl k dispozici, článek technik byla reprodukována z popsané architektury.

Nový článek uvádí:

‘Naše SPG-IM překonává všechny soutěžící trimap-free metody ([LFM], [HAttMatting], a [MODNet]) o velkou marži. Zatímco náš model také ukazuje pozoruhodnou nadřazenost nad state-of-the-art (SOTA) trimap-založené a maskou-váděné metody ve všech čtyřech metrikách napříč veřejnými datovými soubory (tj. Composition-1K, Distinction-646, a Human-2K), a náš Multi-Object-1K benchmark.’

A pokračuje:

‘Může být zjevně pozorováno, že naše metoda zachovává jemné detaily (například vlasové tipy, transparentní textury, a hranice) bez vedení trimapu. Kromě toho, ve srovnání s jinými soutěžícími trimap-free modely, naše SPG-IM může zachovat lepší globální sémantickou kompletnost.’

Poprvé publikováno 24. dubna 2022.