الذكاء الاصطناعي

UniTune: بديل جوجل لتقنية تعديل الصور العصبية

يبدو أن بحث جوجل يهاجم تحرير الصور القائم على النص من عدة جبهات ، ومن المفترض أن ينتظر ليرى ما “يأخذ”. ساخن على خطى إصدار هذا الأسبوع لورقة Imagic ، اقترح عملاق البحث طريقة أخرى قائمة على الانتشار الكمومي لتنفيذ تحريرات غير ممكنة قائم على الذكاء الاصطناعي على الصور عبر أوامر النص ، هذه المرة تسمى UniTune .

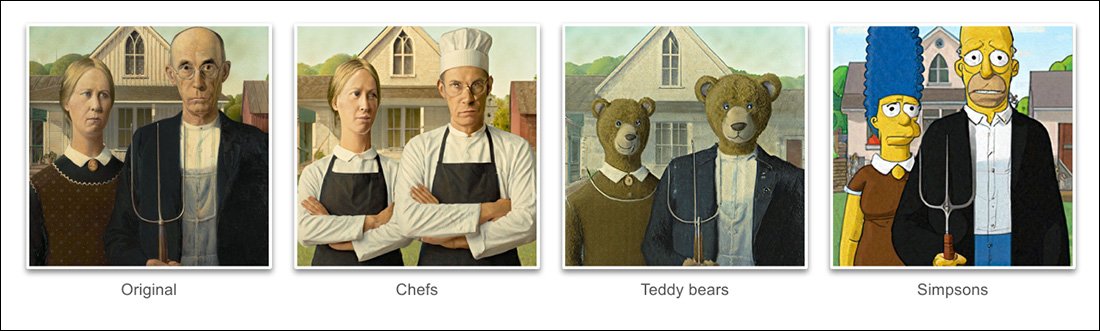

وفقًا للأمثلة المذكورة في ورقة المشروع الجديدة ، حقق UniTune درجة استثنائية من الانفصال للموضع الدلالي والفكرة من المحتوى الصوري الفعلي :

UniTune’s command of semantic composition is outstanding. Note how in the uppermost row of pictures, the faces of the two people have not been distorted by the extraordinary transformation on the rest of the source image (right). Source: https://arxiv.org/pdf/2210.09477.pdf

كما تعلم مشجعو Stable Diffusion الآن ، يمكن أن يكون تطبيق التعديلات على أقسام جزئية من الصورة دون تغيير باقي الصورة عملية صعبة وأحيانًا مستحيلة. على الرغم من أن التوزيعات الشهيرة مثل AUTOMATIC1111 يمكن أن tạo masks للتعديلات المحلية والمنعزلة ، فإن العملية معقدة وغالبًا غير متوقعة.

الجواب الواضح ، على الأقل لممارس الصور ، هو وضع طبقة من التنقيب الدلالي التي يمكنها التعرف على عزل الكائنات في الصورة دون تدخل المستخدم ، و في الواقع ، هناك العديد من المبادرات الجديدة في الآونة الأخيرة على طول هذا الخط من التفكير.

إمكانية أخرى لإحكام عمليات تحرير الصور العصبية المتضارب والمشتبك هي استخدام وحدة CLIP الشهيرة من OpenAI ، التي تقع في قلب نماذج الانتشار الكمومي مثل DALL-E 2 و Stable Diffusion ، لتعمل كمرشح عند نقطة إرسال نموذج النص إلى الصورة لتحويله إلى المستخدم. في هذا السياق ، يجب أن تعمل CLIP كحارس ووحدة مراقبة الجودة ، ورفض العروض غير الصحيحة أو غير المناسبة. هذا على وشك التنفيذ (رابط Discord) في بوابة DreamStudio API-driven.

ومع ذلك ، منذ أن CLIP يمكن أن يكون هو الجاني والحل في مثل هذا السيناريو (لأنه أبلغ أيضًا عن الطريقة التي تطور بها الصورة) ، ومنذ أن المتطلبات الأجهزة قد تتجاوز ما يُحتمل أن يكون متاحًا محليًا للمستخدم النهائي ، قد لا يكون هذا النهج مثاليًا.

اللغة المضغوطة

اقترح UniTune بدلاً من ذلك “ضبط” نموذج انتشار موجود – في هذه الحالة ، Imagen الخاص بجوجل ، على الرغم من أن الباحثين يعلنون أن الطريقة متوافقة مع архитكتурات انتشار كمومي أخرى – بحيث يتم حقن رمز فريد يتم استدعاؤه بواسطة نص مطبق.

في ظاهره ، يبدو هذا مثل DreamBooth ، الذي يعتبر حاليًاobsession بين مشجعي و مطورو Stable Diffusion ، والذي يمكن حقن شخصيات أو كائنات جديدة في نقطة تحقق موجودة ، غالبًا في أقل من ساعة ، بناءً على عدد قليل من الصور المصدر ؛ أو مثل Textual Inversion ، الذي يخلق ملفات “sidecar” لنقطة التحقق ، والتي يتم التعامل معها كما لو كانت مدربة في الأصل في النموذج ، ويمكنها الاستفادة من موارد النموذج نفسه الكبيرة عن طريق تعديل مصنف النص ، مما يؤدي إلى ملف صغير (مقارنة بحد أدنى 2 جيجابايت من نقاط التحقق المقطوعة من DreamBooth).

في الواقع ، يؤكد الباحثون أن UniTune رفض هذه النهج. لقد وجدوا أن Textual Inversion省略ت تفاصيل مهمة ، بينما أداء DreamBooth أسوأ وأطول من الحل الذي استقر أخيرًا عليه.

ومع ذلك ، يستخدم UniTune نفس نهج “metaprompt” الدلالي المضغوط مثل DreamBooth ، مع تغييرات مدربة يتم استدعاؤها بواسطة كلمات فريدة يختارها المدرب ، والتي لن تتعارض مع أي مصطلحات موجودة حاليًا في إصدار عام مدرب بدقة.

Để أداء عملية التحرير ، نُخذ عينة من النماذج المعدلة بدقة مع التوجيه “[rare_tokens] edit_prompt” (على سبيل المثال “beikkpic two dogs in a restaurant” أو “beikkpic a minion”).

العمليات

الطريقة UniTune أساسًا ترسل الصورة الأصلية عبر نموذج انتشار مع مجموعة من الإرشادات حول كيفية تعديلها ، باستخدام مستودعات البيانات الكبيرة المدربة في النموذج. في الواقع ، يمكنك القيام بذلك الآن مع وظيفة img2img من Stable Diffusion – ولكن بدون تشويه أو تغيير أجزاء من الصورة التي تريد الحفاظ عليها.

خلال عملية UniTune ، يتم ضبط النظام ، مما يعني أن UniTune يضطر النموذج إلى استئناف التدريب ، معظم طبقاته غير مجمدة (انظر أدناه). في معظم الحالات ، سوف يؤدي الضبط إلى خفض القيم العامة للنموذج ذي الأداء العالي إلى حد ما ، لصالح حقن أو تعديل بعض الجوانب الأخرى التي يُراد创تها أو تعزيزها.

ومع ذلك ، يبدو أن نسخة النموذج التي يتم التلاعب بها ، على الرغم من أنها قد تزن عدة جيجابايت أو أكثر ، سوف يتم التعامل معها كقشرة قابلة للتحويل ، و سوف يتم التخلص منها في نهاية العملية ، بعد أن خدمت هدفًا واحدًا. هذا النوع من التوناج القسري للبيانات يصبح أزمة تخزين يومية لمشجعي DreamBooth ، الذين يملكون نماذجهم الخاصة ، حتى عندما يتم تقطيعها ، لا تقل عن 2 جيجابايت لكل موضوع.

كما هو الحال مع Imagic ، يحدث التعديل الرئيسي في UniTune في الطبقتين السفليتين من الطبقات الثلاث في Imagen (64px ، 64px>256px ، و 256px>1024px). على عكس Imagic ، يرى الباحثون بعض القيمة المحتملة في تحسين الضبط أيضًا لطبقة الت超 решение الكبيرة (على الرغم من أنهم لم يحاولوا ذلك بعد).

لطبقة 64px السفلى ، يتم تحيز النموذج إلى الصورة الأساسية خلال التدريب ، مع توفير عدة أزواج مكررة من الصورة / النص إلى النظام لمدة 128 تكرارًا مع حجم.batch من 4 ، و مع Adafactor كدالة الخسارة ، يعمل عند معدل تعلم 0.0001. على الرغم من أن مُشفر T5 مجمد فقط خلال هذا الضبط الدقيق ، فإنه أيضًا مجمد خلال التدريب الأساسي لImagen

تكرار هذه العملية لطبقة 64>256px ، باستخدام نفس إجراء تعزيز الضوضاء المستخدم في التدريب الأصلي ل Imagen.

التعديم

هناك العديد من طرق التعديم الممكنة التي يمكن من خلالها استخلاص التغييرات التي تم إجراؤها من النموذج المعدل بدقة ، بما في ذلك توجيه تصنيف مجاني (CFG) ، وهو أيضًا أساس Stable Diffusion. CFG يحدد أساسًا مدى حرية النموذج في “اتباع خياله” واستكشاف إمكانيات العرض – أو في الإعدادات الأقل ، مدى التزامها بالبيانات المصدر والقيام بتغييرات أقل دراماتيكية.

Like Textual Inversion (a little less so with DreamBooth), UniTune is amenable to applying distinct graphic styles to original images, as well as more photorealistic edits.

كما قام الباحثون بتجربة تقنية “البداية المتأخرة” ل SDEdit ، حيث يتم تشجيع النظام على الحفاظ على التفاصيل الأصلية عن طريق كونه فقط部分يًا “ضوضاء” من البداية ، ولكن بدلاً من ذلك الحفاظ على سماتها الأساسية. على الرغم من أن الباحثين استخدموه فقط في الطبقة الأدنى (64px) ، يعتقدون أنه يمكن أن يكون تقنية تعديم مفيدة في المستقبل.

الباحثون استغلوا أيضًا prompt-to-prompt كتقنية نصية إضافية لتحديد النموذج :

‘In the “prompt to prompt” setting, we found that a technique we call Prompt Guidance is particularly helpful to tune fidelity and expressiveness.

‘Prompt Guidance is similar to Classifier Free Guidance except that the baseline is a different prompt instead of the unconditioned model. This guides the model towards the delta between the two prompts.’

ومع ذلك ، يذكر المؤلفون أن توجيه التوجيه كان مطلوبًا فقط من حين لآخر في الحالات التي فشل فيها CFG في الحصول على النتيجة المرغوبة.

منهج تعديم جديد آخر تم اكتشافه خلال تطوير UniTune كان الاستيفاء ، حيث تكون مناطق الصورة متميزة جدًا بحيث تكون الصورة الأصلية والصورة المعدلة متشابهتين جدًا في التكوين ، مما يسمح باستيفاء “بريء” أكثر.

Interpolation can make the higher-effort processes of UniTune redundant in cases where areas to be transformed are discrete and well-margined.

يقترح المؤلفون أنه يمكن أن يعمل الاستيفاء بشكل جيد لدرجة أن يتم استخدامه كإعداد افتراضي ، ويشير أيضًا إلى أنه يمكن أن يؤثر على تحويلات استثنائية في الحالات التي لا يتعين فيها التفاوض على تعقيدات متعددة.

UniTune يمكنه أداء تعديلات محلية مع أو بدون أقنعة تعديل ، ويمكنه أيضًا أن يقرر بشكل وحيد حيث يضع التعديلات ، مع مزيج غير عادي من القوة التفسيرية والتعزيز الأساسي للبيانات المصدر :

In the top-most image in the second column, UniTune, tasked with inserting a ‘red train in the background’ has placed it in an apposite and authentic position. Note in the other examples how semantic integrity to the source image is maintained even in the midst of extraordinary changes in the pixel content and core styles of the images.

التأخير

على الرغم من أن التكرار الأول لأي نظام جديد سوف يكون بطيئًا ، و على الرغم من أنه من الممكن أن يؤدي الاستثمار المجتمعي أو الالتزام الشركي (ليس كلاهما عادة) في النهاية إلى تسريع و تحسين إجراء ثقيل الموارد ، UniTune و Imagic يؤديان بعض المناورات التعلم الآلي الكبيرة لإنشاء هذه التعديلات الرائعة ، و من غير الواضح إلى أي مدى يمكن لهذا الإجراء المستهلك للموارد أن يُ缩م إلى استخدام منزلي ، بدلاً من الوصول إلى واجهة برمجة التطبيقات (على الرغم من أن الأخير قد يكون أكثر رغبة لجوجل).

في الوقت الحالي ، يبلغ وقت الرحلة من المدخلات إلى النتيجة حوالي 3 دقائق على وحدة معالجة الرسومات T4 ، مع حوالي 30 ثانية إضافية للاستدلال (كما هو الحال مع أي روتين استدلال). يقر المؤلفون بأن هذا هو تأخير عالٍ ، ولا يعتبر “تفاعليًا” ، لكنهم يشيرون أيضًا إلى أن النموذج يبقى متاحًا للمزيد من التعديلات بمجرد ضبطه في البداية ، حتى ينتهي المستخدم من العملية ، مما يقلل من وقت التعديل لكل منهما.

نُشر لأول مرة في 21 أكتوبر 2022.