الذكاء الاصطناعي

التعريف المراوغ لـ ‘Deepfake’

دراسة جديدة وجذابة من ألمانيا تنتقد تعريف مصطلح ‘deepfake’ في قانون الاتحاد الأوروبي للاستخبارات الاصطناعية على أنه غامض للغاية، خاصة في سياق تحرير الصور الرقمية. يجادل المؤلفون بأن قانون الاتحاد الأوروبي يؤكد على المحتوى الذي يشبه الأشخاص أو الأحداث الحقيقية – ومع ذلك ، قد يبدو مخادعا.

ويشيرون أيضًا إلى أن استثناءات القانون لتعديلات “التنسيق القياسي” (أي التعديلات الطفيفة على الصور باستخدام الذكاء الاصطناعي) لا تأخذ في الاعتبار تأثير الذكاء الاصطناعي الشامل في التطبيقات الاستهلاكية وطبيعة التقاليد الفنية الخاضعة للذوق الفردي التي تسبق ظهور الذكاء الاصطناعي.

تؤدي التشريعات الغامضة حول هذه القضايا إلى两个 مخاطر رئيسيين: “التأثير المخدر” ، حيث يثبط نطاق تفسير القانون الواسع الابتكار واعتماد أنظمة جديدة؛ و “تأثير المخالف” ، حيث يتم تجاهل القانون لأنه يُعتبر متجاوزًا أو غير ذي صلة.

في كلتا الحالتين ، فإن القوانين الغامضة تنقل مسؤولية وضع تعريفات قانونية عملية إلى أحكام المحكمة في المستقبل – وهي نهج حذر ومتحفظ في التشريع.

يبدو أن تقنيات تحرير الصور القائمة على الذكاء الاصطناعي لا تزال متقدمة على قدرة التشريعات على معالجتها. على سبيل المثال ، يلاحظ البحث أن وظيفة “Scene Optimizer” في الكاميرات Samsung الحديثة هي مثال ملحوظ على مرونة مفهوم ما بعد المعالجة التلقائي القائم على الذكاء الاصطناعي ، والتي يمكن أن تحل محل الصور التي يأخذها المستخدم من القمر (موضوع صعب) بصور محسنة قام الذكاء الاصطناعي بإنشائها:

Top left, an example from the new paper of a real user-taken image of the moon, to the left of a Samsung-enhanced version automatically created with Scene Optimizer; Right, Samsung’s official illustration of the process behind this; lower left, examples from the Reddit user u/ibreakphotos, showing (left) a deliberately blurred image of the moon and (right), Samsung’s re-imagining of this image – even though the source photo was a picture of a monitor, and not the real moon. Sources (clockwise from top-left): https://arxiv.org/pdf/2412.09961; https://www.samsung.com/uk/support/mobile-devices/how-galaxy-cameras-combine-super-resolution-technologies-with-ai-to-produce-high-quality-images-of-the-moon/; https:/reddit.com/r/Android/comments/11nzrb0/samsung_space_zoom_moon_shots_are_fake_and_here/

في الجزء السفلي الأيسر من الصورة أعلاه ، نرى صورة قمرين. الصورة على اليسار هي صورة مأخوذة بواسطة مستخدم Reddit. هنا ، تم تحوير الصورة عمدا وتقليل دقتها بواسطة المستخدم.

على يمينها نرى صورة للصورة المعدلة نفسها مأخوذة بكاميرا Samsung مع تمكين المعالجة التلقائية بالذكاء الاصطناعي. قامت الكاميرا تلقائيًا بتعزيز الكائن المعترف به “القمر” ، على الرغم من أنه لم يكن القمر الحقيقي.

ينتقد البحث ميزة “Best Take” المضمنة في هواتف Google الحديثة – ميزة ذكاء اصطناعي مثيرة للجدل التي تعمل على تحرير أفضل أجزاء صورة جماعية ، من خلال مسح عدة ثوان من تسلسل التصوير بحيث يمكن تقديم الابتسامات إلى الأمام أو الخلف في الوقت المناسب كما هو مطلوب – ولا يظهر أحد في منتصف النظر.

يجادل البحث بأن هذا النوع من عملية التجميع له القدرة على تشويه الأحداث:

‘[في] إعداد صورة جماعية نموذجي ، من المحتمل أن يعتبر المشاهد العادي الناتج الصورة أصلية. الابتسامة التي تم إدخالها موجودة في غضون بضع ثوان من الصورة المتبقية التي تم اتخاذها.

‘من ناحية أخرى ، فإن الإطار الزمني لمدة عشر ثوان من ميزة أفضل لقطة كافٍ لتغيير المزاج. قد يتوقف شخص ما عن الابتسام بينما يضحك باقي المجموعة على نكتة على حسابه.

‘كنتيجة لذلك ، ن假 أن مثل هذه الصورة الجماعية قد تشكل بالفعل deepfake.’

يتمثل البحث الجديد في ورقة بعنوان ما يشكل deepfake؟ الحد الغامض بين المعالجة الشرعية والتحريف بموجب قانون الاتحاد الأوروبي للاستخبارات الاصطناعية ، ويأتي من两个 باحثين في مختبر القانون الحاسوبي بجامعة توبينغن ، وجامعة سارلاند.

حيل قديمة

تلاعب الوقت في التصوير يعود إلى عصور ما قبل الذكاء الاصطناعي المستخدم من قبل المستهلكين. يلاحظ مؤلفو البحث وجود تقنيات أقدم يمكن أن يُعتبرها “غير أصيلة” ، مثل دمج عدة صور متتالية في صورة ذات مجال ديناميكي عال (HDR) ، أو صورة مخيطة بانورامية.

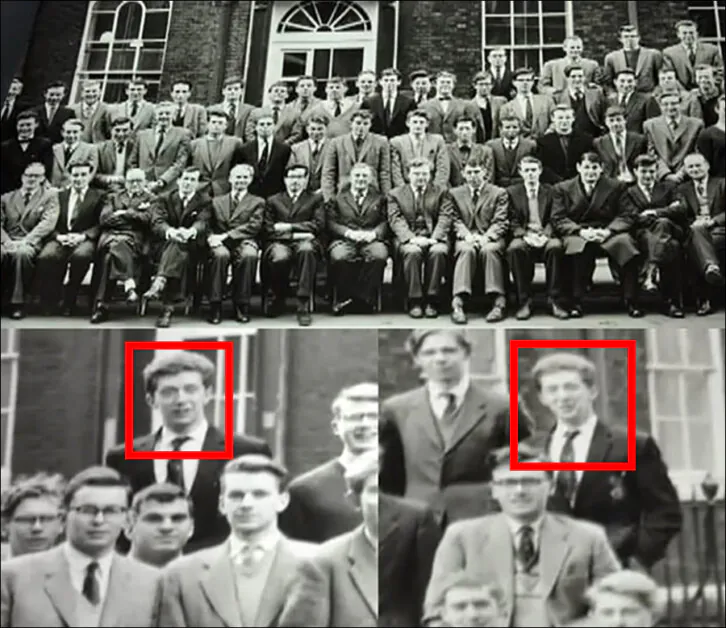

في الواقع ، كانت بعض الأكذب الفوتوغرافية الأكثر قديمة والمسلية تُصنع تقليديًا بواسطة طلاب المدارس الذين يركضون من طرف إلى آخر لمجموعة طلابية ، أمام مسار الكاميرات البانورامية الخاصة التي كانت تستخدم في وقت ما للتصوير الرياضي والجماعي – مما يسمح للطالب بالظهور مرتين في نفس الصورة:

إغراء خداع الكاميرات البانورامية خلال الصور الجماعية كان كبيرًا جدًا لدرجة أن العديد من الطلاب لم يتمكنوا من مقاومته ، حيث كانوا على استعداد للمخاطرة بدورة سيئة في مكتب المدير من أجل “استنساخ” أنفسهم في الصور المدرسية. Source: https://petapixel.com/2012/12/13/double-exposure-a-clever-photo-prank-from-half-a-century-ago/

ما لم ت chụp صورة في وضع RAW ، وهو ما يفرغ أساسًا مستشعر عدسة الكاميرا إلى ملف كبير جدًا دون أي نوع من التفسير ، فمن المحتمل أن تكون صورك الرقمية غير أصلية. تقوم أنظمة الكاميرا بتطبيق خوارزميات “تحسين” مثل تحسين الصورة وتعديل الألوان ، افتراضيًا – وقد فعلت ذلك منذ أصول التصوير الرقمي المستخدم من قبل المستهلكين.

يجادل مؤلفو البحث بأن هذه الأنواع القديمة من تعزيز الصور الرقمية لا تمثل “الواقع” ، لأن هذه الأساليب مصممة لجعل الصور أكثر جاذبية ، وليس أكثر “واقعية”.

يُشير البحث إلى أن قانون الاتحاد الأوروبي للاستخبارات الاصطناعية ، حتى مع التعديلات اللاحقة مثل الفقرات 123-27 ، يضع جميع الإخراج الفوتوغرافي في إطار إداري غير مناسب للسياق الذي تُنتج فيه الصور هذه الأيام ، على عكس (الطبيعة الموضوعية) لفيلم الكاميرا الأمنية أو التصوير الفوتوغرافي الجنائي. من المرجح أن تorigin معظم الصور المعالجة بقانون الذكاء الاصطناعي من سياقات حيث يروج المصنعون والمنصات عبر الإنترنت نشطًا لتفسير الصور الإبداعي ، بما في ذلك استخدام الذكاء الاصطناعي.

يشير الباحثون إلى أن الصور “لم تكن تمثيلا موضوعيًا للواقع”. تساهم اعتبارات مثل موقع الكاميرا واختيار عمق الحقل واختيار الإضاءة في جعل الصورة موضعية للغاية.

يلاحظ البحث أن مهام “التنظيف” الروتينية – مثل إزالة غبار المستشعر أو الأسلاك الكهربائية غير المرغوب فيها من مشهد معماري جيد – كانت فقط نصف أوتوماتيكية قبل ظهور الذكاء الاصطناعي: كان على المستخدمين تحديد منطقة أو تشغيل عملية لتحقيق النتيجة المرغوبة.

اليوم ، يتم تشغيل هذه العمليات غالبًا بواسطة إشارات نصية للمستخدم ، وخاصة في أدوات مثل Photoshop. على مستوى المستهلك ، يتم تلقائيًا تسهيل هذه الميزات بدون إدخال المستخدم – وهو نتيجة يُعتبرها المصنعون والمنصات واضحًا أنه “مرغوب فيه”.

التعريف المخفف لمصطلح ‘Deepfake’

تُشكل تحديًا مركزيًا للتشريعات حول الصور والصور المعدلة والمولدة بالذكاء الاصطناعي غموض مصطلح ‘deepfake’ ، الذي تم تمديده بشكل ملحوظ خلال السنوات القليلة الماضية.

في الأصل ، تم تطبيق المصطلح فقط على الإخراج الفيديوي من نظم التشفير التلقائي مثل DeepFaceLab و FaceSwap ، وكلاهما مشتق من رمز مجهول تم نشره على Reddit في أواخر عام 2017.

من عام 2022 ، جاءت نماذج الانتشار الكامن (LDMs) مثل Stable Diffusion و Flux ، بالإضافة إلى أنظمة النص إلى الفيديو مثل Sora ، مما يسمح بالتبادل الهوياتي والتخصيص ، مع تحسين الدقة والتنوع والإيمان.

منذ ذلك الحين ، تم تمديد مصطلح ‘deepfake’ ليشمل التجسس النصي. بحلول هذه النقطة ، كان المعنى الأصلي لـ ‘deepfake’ قد فقد تقريبًا ، بينما كان معناه الممتد يتحول باستمرار ، ويتلاشى بشكل متزايد.

لكن منذ أن كان الكلمة مشتعلة وجاذبة ، وكانت بمثابة نقطة مرجعية قوية للسياسة والإعلام ، فقد ثبت أنه من المستحيل التخلي عنها. لقد جذبت القراء إلى المواقع ، وأموالًا للباحثين ، واهتمامًا للسياسيين. هذه الغموض الدلالي هي焦点 البحث الجديد.

كما يلاحظ المؤلفون أن المادة 3(60) من قانون الاتحاد الأوروبي للاستخبارات الاصطناعية يحدد أربعة شروط تحدد ‘deepfake’.

1: القمر الحقيقي

أولاً ، يجب أن يكون المحتوى ممولًا أو معدلا ، أي إما أنشئ من الصفر باستخدام الذكاء الاصطناعي (الإنشاء) أو معدل من البيانات الحالية (التحويل). يبرز البحث صعوبة التمييز بين نتائج تحرير الصور “القابلة للقبول” والتحريفات المخادعة ، بالنظر إلى أن الصور الرقمية لا تمثل على أي حال تمثيلا حقيقيًا للواقع.

يجادل البحث بأن قمرًا مولدًا بواسطة Samsung يمكن أن يُعتبر صحيحًا ، لأن القمر غير مرجح أن يتغير مظهره ، والمحتوى المولَد بالذكاء الاصطناعي ، الذي تم تدريبه على صور قمر حقيقي ، من المحتمل أن يكون دقيقًا.

ومع ذلك ، يذكر المؤلفون أيضًا أنه منذ أن أظهر نظام Samsung القدرة على توليد صورة “مُحسنة” للقمر في حالة كانت الصورة المصدر ليست القمر نفسه ، فإن هذا سيكون considered ‘deepfake’.

سيكون من غير الواقعي وضع قائمة شاملة للاستخدامات المتنوعة حول هذا النوع من الوظائف المنفصلة. لذلك يبدو أن عبء التعريف يمر مرة أخرى إلى الأحكام القضائية.

2: نصوص وهمية

ثانيًا ، يجب أن يكون المحتوى في شكل صورة أو صوت أو فيديو. لا يُعتبر المحتوى النصي ، على الرغم من خضوعه لالتزامات الشفافية الأخرى ، deepfake بموجب قانون الاتحاد الأوروبي للاستخبارات الاصطناعية. لا يُغطى هذا في تفاصيل في الدراسة الجديدة ، على الرغم من أنه يمكن أن يكون له تأثير كبير على فعالية الصور الوهمية (انظر أدناه).

3: مشاكل العالم الحقيقي

ثالثًا ، يجب أن يشبه المحتوى أشخاصًا أو أشياء أو أماكن أو كيانات أو أحداث موجودة. يحدد هذا الشرط صلة بالعالم الحقيقي ، مما يعني أن الصور المخادعة تمامًا ، حتى لو كانت فوتوغرافية ، لن تُعتبر deepfake. يؤكد الفقرة 134 من قانون الاتحاد الأوروبي للاستخبارات الاصطناعية على جانب “الشبه” من خلال إضافة كلمة “كاف” (تأخير واضح للقرارات القضائية اللاحقة).

يطرح المؤلفون ، مستشهدين بأعمال سابقة ، вопросًا حول ما إذا كان يجب أن ينتمي الوجه المولَد بالذكاء الاصطناعي إلى شخص حقيقي ، أو ما إذا كان يجب أن يكون فقط مشابهًا بشكل كافٍ لشخص حقيقي ، من أجل تلبية هذا التعريف.

على سبيل المثال ، كيف يمكن تحديد ما إذا كان تسلسل الصور الفوتوغرافية التي تظهر السياسي دونالد ترامب يعتبر تمثيلاً خادعًا ، إذا لم تذكر الصور (أو النصوص المرفقة) اسمه تحديدًا؟ التعرف على الوجه? استطلاعات المستخدمين؟ تعريف قاضي بالعقل السليم؟

4: تعديل ، إعادة تشكيل

أخيرًا ، يجب أن يبدو المحتوى أصيلا أو صادقًا للشخص. يؤكد هذا الشرط على إدراك مشاهدي البشر. لا يُعتبر المحتوى الذي يتم التعرف عليه فقط على أنه يمثل شخصًا أو كائنًا حقيقيًا بواسطة خوارزمية لا deepfake.

من بين جميع الشروط في 3(60) ، هذا هو الأكثر وضوحًا في التخلي عن التفسير لاحقًا من قبل المحكمة ، منذ أن لا يسمح بأي تفسير من خلال الوسائل الفنية أو الميكانيكية.

هناك بعض الصعوبات الواضحة في الوصول إلى إجماع حول هذا الشرط الموضوعي. يلاحظ المؤلفون ، على سبيل المثال ، أن أشخاصًا مختلفين ، وأشخاصًا من أنواع مختلفة (مثل الأطفال والكبار) ، قد يكونون مختلفين فيما يتعلق بالاعتقاد في deepfake معين.

يلاحظ المؤلفون أيضًا أن القدرات المتقدمة للذكاء الاصطناعي لأدوات مثل Photoshop تثير تحديات التعريفات التقليدية لـ “deepfake”. بينما قد تتضمن هذه الأنظمة حماية أساسية ضد المحتوى المثير للجدل أو المحظور ، فإنها توسع بشكل كبير مفهوم “التouch-up”. يمكن للمستخدمين الآن إضافة أو إزالة كائنات في طريقة مقنعة و فوتوغرافية ، مما يحقق مستوى احترافي من الصحة التي تعيد تعريف حدود تحرير الصور.

يذكر المؤلفون ما يلي:

‘نحن نجادل بأن التعريف الحالي لـ deep fakes في قانون الاتحاد الأوروبي للاستخبارات الاصطناعية والالتزامات المقابلة لا يتم تحديده بشكل كافٍ لمواجهة التحديات التي تطرحها deep fakes. من خلال تحليل دورة حياة صورة رقمية من مستشعر الكاميرا إلى ميزات التحرير الرقمي ، نجد أن:

‘(1.) Deep fakes غير محددة جيدًا في قانون الاتحاد الأوروبي للاستخبارات الاصطناعية. يترك التعريف مجالًا واسعًا لما هو deep fake.

‘(2.) لا يزال غير واضح كيف يمكن اعتبار وظائف التحرير مثل ميزة “Best Take” لجوجل استثناءً من الالتزامات الشفافية.

‘(3.) الاستثناء للصور المعدلة بشكل كبير يثير أسئلة حول ما يشكل تحريرًا كبيرًا للمحتوى وما إذا كان يجب أن يكون هذا التحرير مرئيًا للمشاهد البشري.’

أخذ الاستثناء

يحتوي قانون الاتحاد الأوروبي للاستخبارات الاصطناعية على استثناءات يجادل المؤلفون بأنها يمكن أن تكون sehr مرنة. يذكر المادة 50(2) ، على سبيل المثال ، استثناءً في الحالات التي لا يتم تعديل معظم الصورة الأصلية. يلاحظ المؤلفون:

‘ما يمكن اعتباره محتوى في سياق المادة 50(2) في حالات الصوت والصور والفيديو؟ على سبيل المثال ، في حالة الصور ، هل يجب أن نعتبر مساحة البكسل أو المساحة المرئية للبشر؟ قد لا تتغير التلاعب الجوهري في مساحة البكسل إدراك الإنسان ، ومن ناحية أخرى ، يمكن أن تتغير الاضطرابات الصغيرة في مساحة البكسل إدراك الإنسان بشكل كبير.’

يُقدم الباحثون مثال إضافة مسدس إلى صورة شخص يشير إلى شخص ما. من خلال إضافة المسدس ، يتم تغيير ما لا يزيد عن 5٪ من الصورة ؛ ومع ذلك ، فإن الدلالة الكامنة للتغيير في الجزء المتغير ملحوظة. لذلك يبدو أن هذا الاستثناء لا يأخذ في الاعتبار أي فهم “سليم” لتأثير التفاصيل الصغيرة على الدلالة الكلية للصورة.

الخلاصة

الغرض المعلن للعمل الجديد هو تشجيع الدراسة متعددة التخصصات حول تنظيم deepfakes ، وتعمل كبداية لنقاشات جديدة بين علماء الحاسوب والباحثين القانونيين.

ومع ذلك ، فإن البحث نفسه يقع في تكرار خودي في عدة نقاط: غالبًا ما يستخدم مصطلح ‘deepfake’ كما لو كان معناه واضحًا ، بينما يهاجم قانون الاتحاد الأوروبي للاستخبارات الاصطناعية لفشله في تعريف ما يشكل حقًا deepfake.

نشر لأول مرة يوم الإثنين ، 16 ديسمبر 2024