قادة الفكر

دليل عملي للخروجات القابلة للدفاع من قبل LLM

هناك افتراض خفي يمر عبر معظم تطبيقات GenAI في الشركات: إذا كان الإخراج يبدو صحيحًا ، فهو صحيح. في البيئات منخفضة المخاطر ، هذا هو اختصار معقول. في الصناعات الخاضعة للرقابة ، مثل الرعاية الصحية والتمويل والصناعات الدوائية وضمان الجودة ، فهو مسؤولية تنتظر الظهور.

في لحظة ما يؤثر إخراج LLM على قرار سريري أو سجل مالي أو وثيقة توافق ، يتوقف التعبير عن كونه وكيلًا للثقة. وعندما يطلب مدقق أو منظم أو فريق قانوني ما البيانات المستخدمة ، والقواعد المطبقة ، ومن أيد ذلك ، “قال النموذج كذلك” ليس جوابًا يمكن لأحد التوقيع عليه.

هذا هو فجوة المسؤولية التي لا يصمم معظم فرق GenAI لها. هنا كيفية إغلاقها.

لماذا “يبدو صحيحًا” هو المعيار الخاطئ

تتركز تقييمات الذكاء الاصطناعي التقليدية على الدقة والكفاءة والتكلفة. هذه الأمور مهمة. لكن البيئات الخاضعة للرقابة تقدم محورًا رابعًا لا يمكن استبداله بالآخرين: القابلية للفحص.

يُطلب قانون الاتحاد الأوروبي للذكاء الاصطناعي ، الذي دخل حيز التنفيذ الآن ، أن تحتفظ أنظمة الذكاء الاصطناعي عالية المخاطر بالوثائق الفنية وسجلات التتبع وأدلة الإشراف البشري على مدار دورة حياتها. يشير مشروع التوجيه الأول للوكالة الأمريكية للغذاء والدواء حول الذكاء الاصطناعي في تطوير الأدوية والمنتجات البيولوجية إلى نفس الاتجاه للعلوم الحياتية. هذه الإطارات لا تقيم على أساس السلاسة. إنها تتطلب أنظمة يمكن إعادة بنائها وفحصها ودفاعها.

الإخراج القابل للدفاع من LLM هو الذي يمكن تتبعه zurück من خلال سلسلة من الأدلة القابلة للتحقق: ما هي البيانات التي استند إليها ، وما هي القيود التي شكلته ، ومن قام بمراجعته ، وما تم الاحتفاظ به للفحص في المستقبل. بدون هذه السلسلة ، حتى الإخراج الصحيح لا يمكن الدفاع عنه.

هذا يُعاد صياغة ما يعني “جاهز للإنتاج” حقًا بالنسبة للذكاء الاصطناعي في البيئات الخاضعة للرقابة.

أربعة ركائز للجين الأي الجاهز للفحص

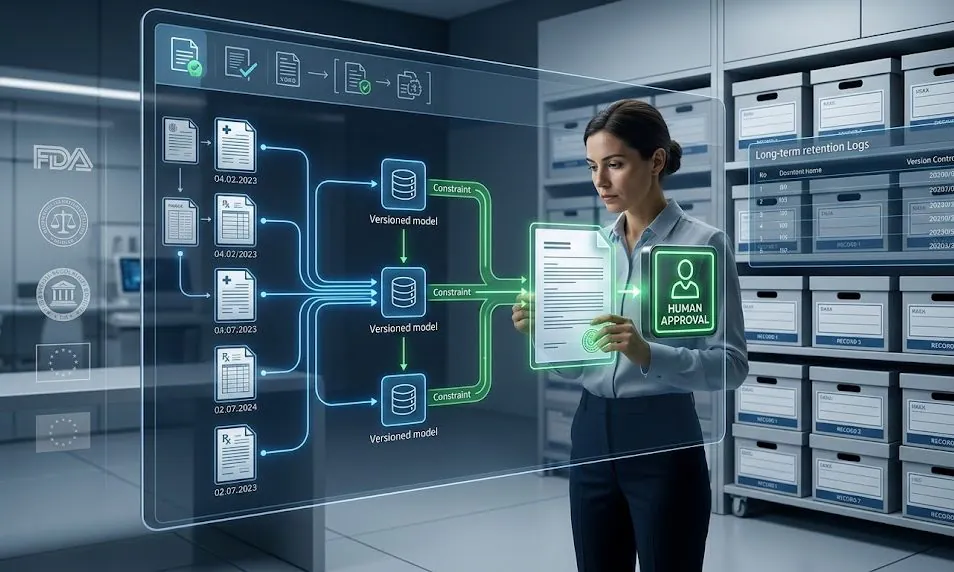

بناء أنظمة LLM القابلة للدفاع يعود إلى أربعة متطلبات هندسية. إنها ليست مبادئ مجردة – إنها قرارات البنية التي ت决定 ما إذا كان نظامك يمكنه البقاء على قيد الحياة تحت الفحص.

1. الأصل: التحكم في哪里 يحصل النموذج على معلوماته

أشيع وضع فشل في الذكاء الاصطناعي للشركات هو أيضًا الأقل ظهورًا: النماذج التي تعتمد على المعرفة العامة أو مصادر البيانات غير المحددة جيدًا. عندما لا توجد حدود معرفة خاضعة للرقابة ، لا يمكن تتبع الإخراج إلى أي مصدر قابل للفحص ، ويصبح إعادة البناء مستحيلًا.

الإصلاح العملي هو إنشاء حدود معرفة موافق عليها: وثائق و مجموعات بيانات تم إصدارها وتمت ملكيتها التي يُسمح للنظام باستخدامها صراحة. يجب أن يحمل كل جواب حزمة أدلة mínimum: معرّف مصدر مع إصدار وتاريخ ساري المفعول ، وسجل استرجاع يظهر ما تم استعلامه واختياره ، والاستشهادات في النص. قاعدة تشغيل مفيدة: لا استشهاد ، لا مطالبة.

هذا يُحول النظام من التوليد القائم على الذاكرة إلى استدلال قائم على الأدلة. يصبح الفرق حاسمًا عندما يحتاج شخص ما إلى إعادة بناء إخراج معين بعد أسابيع أو أشهر من توليده.

2. القيود: استبدل التلاعب بسلوك خاضع للرقابة

تم بناء LLMs لتكون مقنعة. بدون قيود ، فهي تُحسّن من أجل القابلية للتصديق ، والقابلية للتصديق في سياق خاضع للرقابة هو حيث تعيش المخاطر.

القيود هي الآلية التي تحول مولد النص الاحتمالي إلى مكون تنفيذ محدد. في الممارسة ، هذا يعني:

- توليد مرتبط بالمصدر: كل مطالبة تتطلب مصدرًا موافقًا عليه وتم إصداره. لا مصدر يعني لا جواب — فقط رفض أو تصعيد.

- مخططات الإخراج المهيكلة: الاستجابات تتبع صيغًا محددة التي يمكن للماكينات ومدققي الحسابات التحقق منها ، وليس فقط قراءتها.

- تنفيذ حدود الثقة: يُعالج المحتوى المستعاد على أنه إدخال ، ويُعالج مباشرة مخاطر حقن التعبئة التي يمكن أن تعرض أمانًا ويمكنية الفحص.

- وصول بأقل صلاحيات: يتفاعل النموذج فقط مع البيانات والأدوات التي يحتاجها حقًا ، مما يحافظ على سجلات الفحص نظيفة.

القيود ليست مربعًا للامتثال. إنها القرار الهندسي الذي يحدد ما إذا كان نظامك يمكن فحصه على الإطلاق.

3. المراجعة: جعل الإشراف البشري طبقة تحكم رسمية

في الذكاء الاصطناعي الخاضع للرقابة ، لا يمكن أن تكون المراجعة البشرية عشوائية. تحتاج إلى أن تكون مخططة حسب المخاطر (تؤدي مخرجات عالية المخاطر إلى تحقق أكثر صرامة) وتُفعّل عند انخفاض ثقة النموذج ، أو غياب المصادر ، أو اكتشاف الشذوذ.

يُطلب قانون الاتحاد الأوروبي للذكاء الاصطناعي صراحة أن يتمكن البشر من تفسير القرارات التي يوجهها الذكاء الاصطناعي في حالات استخدام عالية المخاطر ، ويتحكم فيها ، وإيقافها. يُ满ى هذا المتطلب بمسجلات المراجعة التي تحتوي على من أيد الإخراج ، في ظل ما الشروط ، وبمستوى فحص معين. “شخص ما فحصه” ليس سيطرة. سجل مراجعة موثق و محدد بتاريخ هو.

هذا يرفع المراجعة من جودة يدوية إلى طبقة حوكمة رسمية ، وهو بالضبط كيف يُعالجها المنظمون.

4. الاحتفاظ: جعل المسؤولية دائمة

بدون سجلات ، لا توجد سجلات فحص. بدون سجلات فحص ، تكون المسؤولية نظرية.

في نفس الوقت ، الاحتفاظ بكل شيء يخلق مخاطر خاصة ، خاصة حيث يتم تطبيق متطلبات التقليل على البيانات الصحية أو المالية الحساسة في إطارات مثل GDPR أو HIPAA.

المنهج العملي هو نموذج متدرج. احفظ دائمًا بيانات النموذج ونسخة البيانات ، ومعرّفات المصدر ، و قرارات السياسة ، وتوقيتات. احفظ محتوى التفاعل (الاستفسارات ، والإخراج ، والآثار الكاملة) بشكل انتقائي ، بناءً على تصنيف المخاطر ، مع التحكم في الوصول المناسب والتحديد. الهدف هو تمكين إعادة بناء أي إخراج دون جمع بيانات زائدة التي تُخلق التعرض المتدفق.

ما يبدو عليه في الممارسة

فكر في كيفية تطبيق هذا في العلوم الحياتية ، حيث CFR 21 الجزء 11 يتطلب السجلات الإلكترونية أن تكون قابلة للنسب ، وقابلة للقراءة ، وموضوعية ، وأصلية ، ودقيقة. يجب أن تُ满ى وثائق التنظيم التي يُولدها LLM جميع المعايير الخمس — وليس فقط إنتاج نص قابل للقراءة.

في هذا السياق ، الركائز الأربعة ليست تحسينات اختيارية. إنها الحد الأدنى للنظام المتوافق. الأصل يضمن أن الإخراج قابل للنسب والأصلي. القيود تضمن أن يبقى داخل الحدود المحددة. المراجعة تضمن أنها مواكبة للإشراف البشري. الاحتفاظ يضمن أنها قابلة للقراءة وقابلة للفحص.

同じ المنطق يُطبق في خدمات التمويل ، حيث MiFID II يتطلب سجلات القرارات والمنطق وراءها ، وفي الرعاية الصحية ، حيث أنظمة دعم القرار السريري تواجه متطلبات متزايدة حول القابلية للتفسير والتحيز.

التغيير الأكبر

ينتقل GenAI من التجربة إلى البنية التحتية للتشغيل. يرفع هذا الانتقال المعيار لما يُعتبر نظامًا مقبولًا.

الإخراج المفيد لم يعد كافياً. تحتاج المنظمات إلى إخراج يمكن تفسيره ، وتتبعه ، ودفاعه تحت الفحص ، لأن الذكاء الاصطناعي يُطلب منه القيام بأشياء تحمل عواقب حقيقية.

الفرق التي تصمم القابلية للدفاع من البداية ستكون في وضع يسمح لها بتوسيع الذكاء الاصطناعي بأمان والحفاظ على ثقة التنظيم. تلك التي لا تفعل ذلك ستواجه في النهاية نفس اللحظة: فحص ، وسؤال مباشر حول إخراج معين ، ولا شيء يُظهره.

بناء الذكاء الاصطناعي الجاهز للفحص ليس عن طريق تبطيئه. إنه عن بناء شيء يمكنه الاستمرار.