زاوية Anderson

يُشير البحث إلى أن ChatGPT يتمتع بصدق عالٍ كموفر لل新闻

يشير بحث جديد إلى أن علامات التحقق من الحقائق لبرنامج ChatGPT تتفوق على الإعجابات والمشاركات وحتى العلامات التجارية الإخبارية الموثوقة عندما يتعلق الأمر بتشكيل ما يعتقد الناس ويريدون مشاركته على الإنترنت.

أظهرت دراسة جديدة على 1000 شخص أن برنامج ChatGPT عندما يعطي تصنيفًا للصدق للأخبار السياسية، غالبًا ما يغير ما يعتقد الناس، وما إذا كانوا يريدون مشاركته – بغض النظر عن آرائهم السياسية الأولية. لم تكن العوامل التقليدية مثل الإعجابات أو المشاركات لها تأثير كبير، ولكن حكم الذكاء الاصطناعي شكّل بشكل قوي كيفية ثقة الناس في الأخبار:

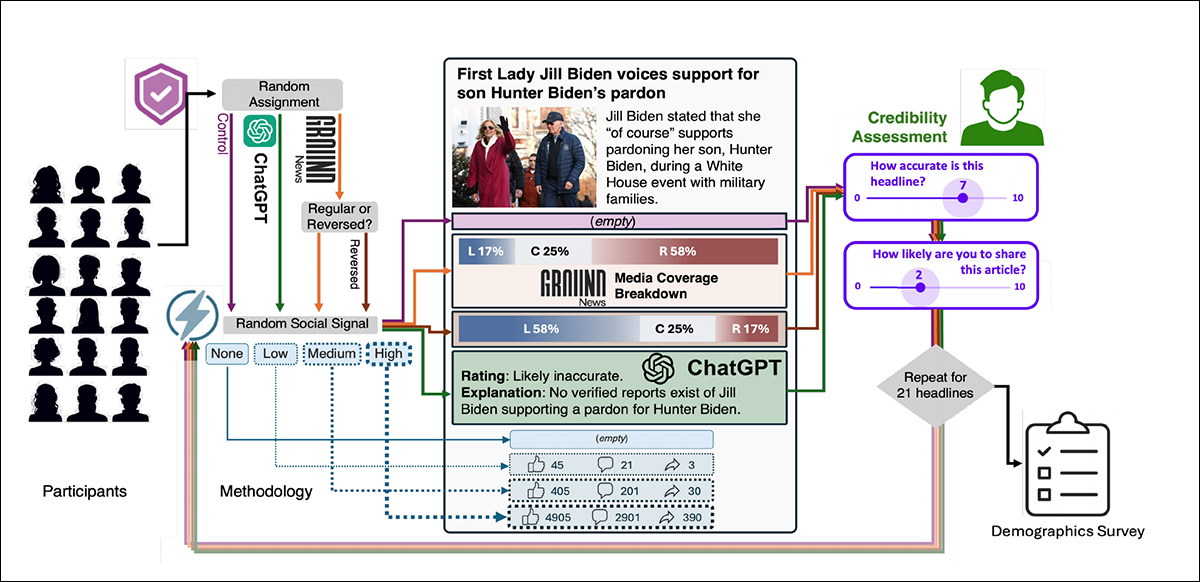

![من الورقة الجديدة، توضيح لكيفية تقييم الناس لعنوان الأخبار، بناءً على ثلاثة إشارات متفاعلة: ما إذا كانت القصة تتوافق مع هويتهم السياسية؛ وكيفية ظهورها من حيث الانخراط على وسائل الإعلام الاجتماعية؛ والإشارات الدالة على الصدق المقدمة من المؤسسات أو أنظمة الذكاء الاصطناعي. تجمع هذه التأثيرات لتشكيل دقة محسوسة وlikelihood من مشاركة المحتوى. [ مصدر ] https://arxiv.org/pdf/2511.02370](https://www.unite.ai/wp-content/uploads/2025/11/figure-1.jpg)

من الورقة الجديدة، توضيح لكيفية تقييم الناس لعنوان الأخبار، بناءً على ثلاثة إشارات متفاعلة: ما إذا كانت القصة تتوافق مع هويتهم السياسية؛ وكيفية ظهورها من حيث الانخراط على وسائل الإعلام الاجتماعية؛ والإشارات الدالة على الصدق المقدمة من المؤسسات أو أنظمة الذكاء الاصطناعي. تجمع هذه التأثيرات لتشكيل دقة محسوسة وlikelihood من مشاركة المحتوى. مصدر

درجة التي يتم بها أخذ ملخصات الذكاء الاصطناعي كموارد إخبارية موثوقة هي ربما واحدة من أكثر المواضيع أهمية في وسائل الإعلام لسنوات عديدة، لا سيما لأن ملخصات الذكاء الاصطناعي من جوجل أفرغت حركة المرور من معظم المنافذ الإخبارية الرئيسية على الإنترنت في عام 2025، دون أي تأكيد حول مكان ذهاب هذا تحويل السلطة في المدى الطويل أو حتى المتوسط.

يصرح مؤلفو العمل الجديد:

‘تسلط هذه النتائج الضوء على كل من الإمكانات والمخاطر المرتبطة بالتعليقات الخوارزمية في تشكيل الفهم العام. يمكن أن تساعد الإشارات التي يولدها الذكاء الاصطناعي في التخفيف من الانحياز وتعزيز التمييز في الصدق، ولكن تأثيرها يختلف حسب الهوية السياسية ويتحمل مخاطر أخلاقية متعلقة بالاعتماد المفرط […]

‘…التأثير الكبير لبرنامج ChatGPT يسلط الضوء على تبادل حرج: في حين أن التعليقات التي يولدها الذكاء الاصطناعي مقنعة، قد تؤدي إلى استبدال التفكير النقدي إذا لم يتم إطاره بعناية.’

يُقترح المؤلفون أن يركز البحث المستقبلي على تحسين تدخلات الصدق التي يولدها الذكاء الاصطناعي والتي تكون أكثر استقلالية ودعمًا للحقائق المعروفة، ويشيرون إلى أن هذا الأمر مهم بشكل خاص في المواضيع التي تثير الانقسام.

بصرف النظر عن الصعود الواضح لبرنامج ChatGPT كسلطة، والتأثير المنخفض غير المتوقع للإشارات المشاركة في الاختبارات (التي يعتقد المؤلفون أنها قد تكون ناجمة عن ظروف الاختبار القليلة العوامل)، فإن هناك نتيجة أخرى مثيرة للاهتمام من اختبارات الباحثين تتعلق بالديموغرافيا والجنس:

‘استجابت النساء والمشاركون من الأقليات العرقية (特别 المستخدمون السود واللاتينيون) بشكل إيجابي أكثر للتعليقات القائمة على الذكاء الاصطناعي مقارنة بالعلامات المؤسسية.’

يعرف العمل الجديد باسم إشارات الصدق التي يولدها الذكاء الاصطناعي تتفوق على المؤسسات والانخراط في تشكيل تصور الأخبار على وسائل الإعلام الاجتماعية، ويأتي من ثلاثة باحثين في جامعة نوتردام.

لنلق نظرة أقرب على أساليب الورقة ونتائجها.

الأساليب

تم اختبار أربعة فرضيات: أن الناس سيقيمون العناوين على أنها أكثر دقة عندما تعكس تلك العناوين آرائهم السياسية؛ أن تصنيفات الصدق التي يولدها الذكاء الاصطناعي ستكون أكثر تأثيرًا من الإشارات التي تأتي من المؤسسات القائمة؛ أن العناوين التي تظهر انخراطًا عاليًا (أي مقاسة من خلال الإعجابات أو المشاركات أو التعليقات) ستُعتبر أكثر موثوقية؛ وأن المستخدمين سيقبلون حكم الذكاء الاصطناعي حول دقة العنوان، حتى عندما يتعارض مع معتقداتهم الخاصة.

المشاركون في الدراسة تم توظيفهم من منصة Prolific، وتمت مطالبتهم بالتحدث باللغة الإنجليزية، بالإضافة إلى كونهم مستهلكين منتظمين للأخبار؛ وضمانت عملية التخصيص العشوائي أن المشاركين يمثلون تنوعًا في وجهات النظر العرقية والجنسانية.

في التجربة*، تم تقسيم المشاركين إلى أربعة مجموعات، كل مجموعة أظهرت لها نوعًا مختلفًا من التعليقات جنبًا إلى جنب مع عناوين الأخبار.

في المجموعة الأولى (حالة السيطرة) لم يتم تقديم أي معلومات إضافية حول مدى موثوقية العنوان؛ في المجموعة الثانية، تم وضع علامات على العناوين بتصنيف انحياز من GroundNews، خدمة تصنف مصادر الأخبار على أنها左ية أو محايدة أو يمينية.

تمت إضافة علامات GroundNews نفسها إلى المجموعة الثالثة، ولكن مقلوبة عمدًا، مما يؤدي إلى خلق عدم تطابق يهدف إلى اختبار ما إذا كان المستخدمون سيكتشفون التشويه.

أما المجموعة الأخيرة، فقد أظهرت لها تقييمات الصدق التي كتبها برنامج ChatGPT، مع تقديم شرح قصير وتصنيف مثل ‘غير دقيق’:

مخطط مفاهيمي للتجربة: كل مشارك أظهر له عناوين أخبار سياسية مع مجموعات مختلفة من علامات الصدق وإشارات الانخراط الاجتماعي. تم جمع الاستجابات حول كيفية دقة كل عنوان ومشاركته، مع تكرار التسلسل الكامل عبر 21 عنصر.

البيانات والاختبارات

تم عرض تسلسل من 21 عنوانًا للأخبار السياسية على كل مشارك.对于 كل عنوان، تم تغيير مستوى الانخراط الاجتماعي؛ أحيانًا لم يظهر أي إعجابات أو مشاركات، وأحيانًا الكثير.

تم تخصيص إشارات الانخراط بشكل عشوائي لتجنب الأنماط الثابتة.

جاءت عناوين الأخبار نفسها من مجموعة من المنظورات السياسية، وتم وضع علامات عليها على أنها مائلة إلى اليسار، مائلة إلى اليمين، أو محايدة.

بعد كل عنوان، تم سؤال المشاركين عن دقة ما يعتقدون أنها تمثل، وعما إذا كانوا سي考虑ون مشاركتها. نظرًا لأن كل مشارك قد أعلن بالفعل عن انتماءه السياسي، كان من الممكن تحليل ما إذا كانت العناوين من نفس الجانب من الطيف السياسي تم تقييمها بشكل أكثر إيجابية.

قيم المشاركون كل عنوان مرتين: مرة لمدى دقة ما يبدو، ومرة لمدى احتمالية مشاركته، مع قياس استجاباتهم على مقياس من 0 إلى 10.

ثم قام الباحثون بدمج هذه الإجابات مع بيانات إضافية: معلومات ديموغرافية واستخدام وسائل الإعلام من كل مشارك؛ علامات سياسية لكل عنوان؛ نوع الإشارة الدالة على الصدق؛ ومستوى الانخراط الاجتماعي المحدد.

تأثير الهوية السياسية

في الاختبار الأول، الذي يبحث عن ما إذا كان الناس يقيّمون العناوين على أنها أكثر دقة عندما تتوافق موقفها السياسي مع آرائهم الخاصة، أشارت النتائج إلى أن المشاركين كانوا أكثر احتمالية للاعتقاد بالعناوين التي تتوافق مع آرائهم السياسية – ولكن ذلك يعتمد على المجموعة.

أظهر المعتدلون انحيازًا أقوى نحو جانبهم، بينما كان الليبراليون والمحافظون يميلون إلى الثقة في العناوين المحايدة أكثر؛ وعلى مدى النتائج، تم تقييم العناوين المحايدة على أنها أكثر دقة من العناوين المائلة إلى اليسار أو اليمين.

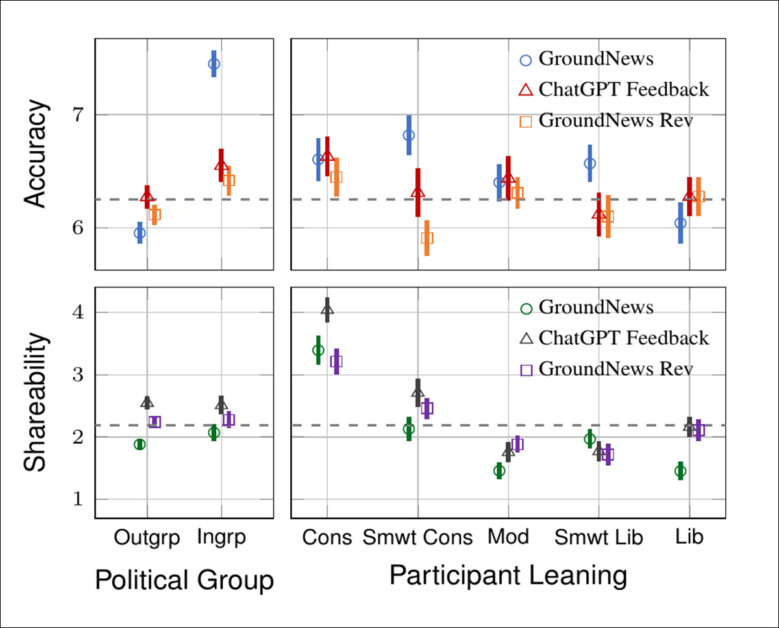

توضيح لكيفية تغيير تقييمات الدقة ومشاركة العناوين بناءً على موقفها السياسي وانتساب المشارك. كان المعتدلون أكثر احتمالية لتقييم العناوين ‘داخل المجموعة’ على أنها دقيقة، بينما فضل الليبراليون والمحافظون العناوين المحايدة. اتبعت سلوك المشاركة نمطًا مشابهًا، مع انحياز محدود داخل المجموعة خارج المجموعة المعتدلة.

في نتائج هذا الاختبار الأول، تم العثور على تأثير داخلي معتدل على المشاركة؛ ولكن فقط للمعتدلين، الذين كانوا أكثر استعدادًا لمشاركة العناوين السياسية الموافقة (أي المحايدة). لم يظهر الليبراليون والمحافظون مثل هذا النزعة.

أظهر تحليل التباين (ANOVA)، وهو طريقة تستخدم لاكتشاف الفروق بين المجموعات، أن التطابق أثر على المشاركة فقط عندما تفاعل مع الهوية السياسية. كانت الدقة والمشاركة مترابطة، ولكن فقط المعتدلون أظهروا نمطًا واضحًا عبر كليهما.

الصدق المؤسسي مقابل الصدق الذي يولدنه الذكاء الاصطناعي

سأل الاختبار التالي عما إذا كان الناس يثقون في تصنيفات الذكاء الاصطناعي أكثر من المصادر التقليدية مثل مواقع تصنيف الأخبار – خاصة عندما قد تتعارض التصنيفات مع آرائهم السياسية:

<img class=" wp-image-225346" src="https://www.unite.ai/wp-content/uploads/2025/11/figure-5.jpg" alt="تقييمات الصدق ومشاركة العناوين عبر مصادر التعليقات: زادت جميع الإشارات الثلاث دقة مقارنة بالسيطرة، مع حصول GroundNews على أعلى التقييمات. ومع ذلك، أنتج برنامج ChatGPT أكبر مكاسب في المشاركة، مما يشير إلى تأثيره الإقناعي الأوسع.” width=”571″ height=”381″ /> تقييمات الصدق ومشاركة العناوين عبر مصادر التعليقات: زادت جميع الإشارات الثلاث دقة مقارنة بالسيطرة، مع حصول GroundNews على أعلى التقييمات. ومع ذلك، أنتج برنامج ChatGPT أكبر مكاسب في المشاركة، مما يشير إلى تأثيره الإقناعي الأوسع.

زادت جميع التعليقات من الدقة المحسوسة؛ ولكن GroundNews كانت الأكثر فعالية عندما تماشى مع سياسة المستخدم.

أعلى تصنيفات الدقة عبر اللوحة، مما يشير إلى أنه تم اعتباره أكثر محايدًا. كان المحافظون أقل تأثرًا بـ GroundNews، ومع ذلك استجابوا لبرنامج ChatGPT بنفس الطريقة مثل المجموعات الأخرى:

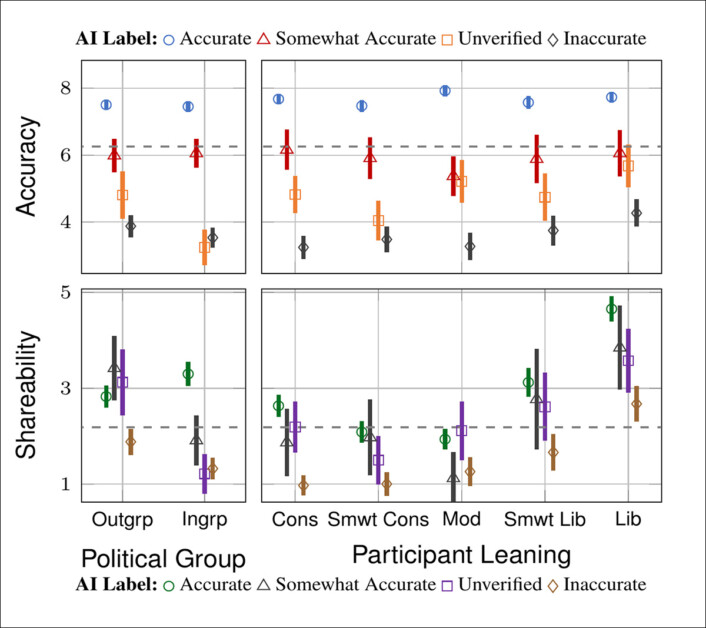

هنا يمكننا رؤية تأثير تعليقات برنامج ChatGPT على الدقة المحسوسة. تؤكد النتائج أن الثقة في الإشارات المؤسسية تعتمد على التطابق، بينما لا تعتمد الثقة في الإشارات الخوارزمية على ذلك. رفع برنامج ChatGPT من كل من الصدق والمشاركة عبر المجموعات – خاصة للمحافظين.

مقياسات الانخراط الاجتماعي لها تأثير ضئيل

اختبر التحليل الثالث ما إذا كانت إشارات الانخراط الاجتماعي المرئية مثل الإعجابات والمشاركات والتعليقات ستزيد من الصدق أو المشاركة من خلال العمل كدليل اجتماعي؛ ولكن لم يلاحظ أي تأثير من هذا القبيل.

أظهرت الاختبارات أن مستويات الانخراط، مثل الإعجابات أو المشاركات، لم تكن لها تأثير حقيقي على كيفية دقة ما يبدو للعناوين، ولم يكن لها سوى تأثير ضعيف وغير موثوق به على كيفية مشاركتها شعورًا؛ على عكس الإشارات الخوارزمية أو المؤسسية، لم تظهر إشارات الانخراط الاجتماعي أي تأثير على الأحكام في هذا السياق، للأسباب المذكورة سابقًا في المقال.

تعليقات الذكاء الاصطناعي تؤثر على ما يثق به الناس

اختبر الاختبار الرابع والأخير ما إذا كان المستخدمون سيعدلون أحكامهم حول الصدق والمشاركة استجابةً لتعليقات الذكاء الاصطناعي التي يولدها: دقيق؛ مؤكد جزئيًا؛ غير مؤكد؛ أو غير دقيق، كلها تم تخصيصها بواسطة برنامج ChatGPT.

استجاب المشاركون بقوة لتعليقات الذكاء الاصطناعي التي يولدها. زادت تقييمات الدقة أو انخفضت وفقًا لتعليقات برنامج ChatGPT، مع أكبر التأثيرات عندما تم وضع علامات على العناوين على أنها دقيقة أو غير دقيقة:

أثرت تعليقات برنامج ChatGPT على كل من تقييمات الدقة والمشاركة. أعلى: زادت تقييمات الدقة مع العلامات الإيجابية، خاصة عندما تم وضع علامات على العناوين على أنها ‘دقيقة’، وانخفضت عندما تم وضع علامات عليها على أنها ‘غير دقيقة’. أسفل: اتبعت المشاركة نمطًا مشابهًا ولكن أظهرت تباينًا أكبر حسب المجموعة: استجاب الليبراليون بقوة للاشارات السلبية، بينما أظهر المحافظون تحولًا أكثر خفوتًا.

شكلت الهوية السياسية هذه التأثيرات، مع ثقة المستخدمين في برنامج ChatGPT أكثر عندما تماشى تعليقه مع آرائهم الخاصة.

اتبعت سلوك المشاركة نمطًا مشابهًا: تم مشاركة العناوين التي تم وضع علامات عليها على أنها دقيقة أكثر souvent، خاصة تحت العلامات الغامضة مثل مؤكد جزئيًا.

تُشير هذه النتائج، كما يُقترح في الورقة، إلى أن تعليقات الذكاء الاصطناعي يمكن أن تؤثر على سلوك المستخدم؛ وأنها تهدد أيضًا بتعزيز الانقسامات الحزبية أو منع التفكير النقدي.

من يثق بالذكاء الاصطناعي أكثر؟

فحص التحليل التالي كيف شكلت ديموغرافيا المستخدم تأثيرات علامات الصدق.

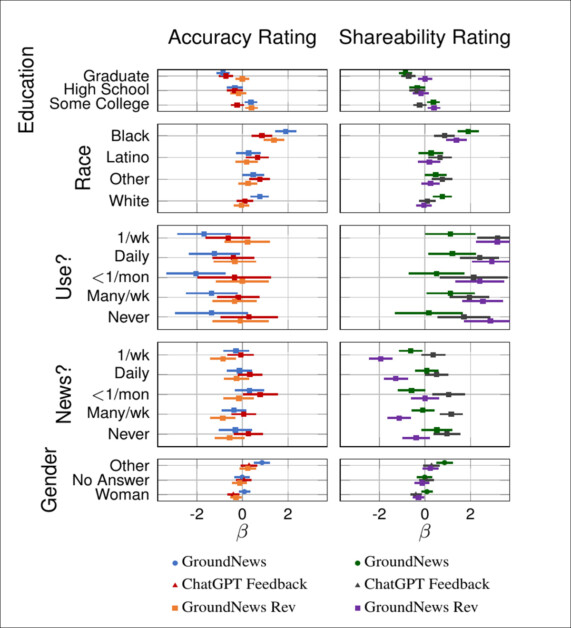

رفع تعليقات برنامج ChatGPT تقييمات الدقة بشكل عام، ولكن التأثير كان أضعف بين المستخدمين المتعلمين جيدًا، والمستهلكين المتكررين لوسائل الإعلام الاجتماعية، الذين أظهروا المزيد من الشكوك.

أظهرت نفس المجموعات استجابة سلبية لتعليقات GroundNews والتعليقات المعكوسة، مما يشير، كما يُقترح في الورقة، إلى أن علامات الانحياز الواضحة قد تُalienate المستخدمين الأكثر معرفة بالوسائل الإعلامية.

على العكس، استجابت النساء والمشاركون من الأقليات العرقية، خاصة المستخدمون السود واللاتينيون، بشكل إيجابي أكثر لبرنامج ChatGPT مقارنة بالعلامات المؤسسية:

استجابات ديموغرافية لأنواع التعليقات، مع كل لوحة تظهر كيف استجاب مجموعة معينة لتعليقات مختلفة. كان لبرنامج ChatGPT التأثير الأكثر قوة والأكثر تواترًا على الدقة، في حين كانت تأثيرات المشاركة أقل انتظامًا، مع تباين حسب العرق والجنس والاستخدام الإعلامي.

اتبعت سلوك المشاركة نفس الانقسام: خفضت GroundNews من المشاركة بشكل حاد بين مستهلكي وسائل الإعلام الاجتماعية ومحبي الأخبار، بينما كان تأثير برنامج ChatGPT أكثر اختلاطًا، حتى أنه رفع من المشاركة في بعض المجموعات، مع استجابة حاملي شهادات الدراسات العليا بشكل خاص لجميع أنواع التعليقات.

يُختتم المؤلفون:

‘لديها هذه النتائج آثار مباشرة على تصميم تدخلات الصدق في الأنظمة الاجتماعية التكنولوجية. يتم التأثير على المستخدمين بشكل متزايد من قبل التعليقات الخوارزمية، والتي يمكن أن تتجاوز الإشارات المؤسسية وتعتدل الانحياز الحزبي – ولكنها تهدد أيضًا بالتسبب في الاعتماد المفرط.

‘تظل الإشارات المؤسسية فعالة للمستخدمين، ولكن تأثيرها يتناقص في البيئات المتطرفة سياسيًا أو المنخفضة الثقة. في غضون ذلك، كانت مقاييس الانخراط مثل الإعجابات والمشاركات لها قيمة إقناعية مخفضة عندما تم تقديمها بدون سياق اجتماعي.

‘为了 دعم تقييم الأخبار العادل والمستنير، يجب أن تكون التدخلات التي يولدها الذكاء الاصطناعي شفافة وواضحة ومتوافرة لتعزيز وكالة المستخدم.

‘يجب أن يبحث العمل المستقبلي في هذه الآليات في سياقات أكثر صحة بيئيًا، ويقيم إطارات صدق خوارزمية بديلة، ويتطور أنظمة متكيفة تسهل الانخراط النقدي عبر جمهور متنوع سياسيًا.’

الختام

نظرًا إلى倾向 جميع أنظمة الذكاء الاصطناعي الحالية إلى الhallucinate وتشويه الحقيقة، فمن المفترض أن يكون هناك قلق من أن انتشار برنامج ChatGPT أيضًا يمثل قفزة عملاقة من الثقة التي لا يمكن أن يبررها أو يدعمها هيكل هذه الأنظمة.

مشكلة واحدة في الثقة بتمثيل الذكاء الاصطناعي للأخبار هي عدم وجود أنظمة فعالة يمكنها وضع الأخبار في سياقها كموارد ‘مائلة سياسيًا’، أو مائلة إلى أحد طرفي الطيف السياسي.

حتى بين أكثر المصادر الموثوقة في الرابع، فإن اختيار ما يتم تغطيته وما لا يتم تغطيته هو في حد ذاته بيان سياسي. لا يمتلك برنامج ChatGPT ولا نظيره الحالي القدرة على التنقل في هذه طبقات الانحياز التفسيري، ويستدعي الموضوع نفسه المناقشة بدلاً من الاستنتاجات الصلبة.

مشكلة أخرى هي أن أنظمة من هذا النوع قد وصلت إلى الساحة في واحدة من أكثر الفترات تفرقة وتقسيمًا في تاريخ البشرية في 80 عامًا، وفي وقت يرغب المجتمع أكثر في الاستماع إلى ‘أصوات بديلة’ – مثل نوع جديد تمامًا من التكنولوجيا التي يتم تسويقها كمرشح ضروري للحقيقة في العالم، بدلاً من ما هو في الواقع: مقدرة لتحديد الاحتمالات الإحصائية، مدفوعة بكميات كبيرة من المعلومات الحزبية.

* تفاصيل التي جعلها المؤلفون متاحة على الإنترنت (انظر الورقة المصدر، أسفل الصفحة 2، للحصول على عناوين URL). ومع ذلك، يتطلب هذا البيانات التسجيل لمشاهدته، ولم أتابع الأمر في ذلك الوقت، لذلك لا أستطيع أن أؤكد أنه يمكن مشاهدته بالكامل دون دفع أو نوع معين من الأهليّة.

نشر لأول مرة يوم الأربعاء، 5 نوفمبر 2025