زاوية Anderson

مواجهة مشكلة الغازلايتينج في الذكاء الاصطناعي

يمكن للنماذج الإيضاحية للذكاء الاصطناعي أن تُقنع بالخروج من الحقيقة. حتى بعد رؤية الإجابة الصحيحة، فإنها تyield للضغوط من المستخدمين المتفائلين، وتعيد كتابة الواقع، وتصنع تفسيرات وهمية لتبرير ذلك.

الذكاء الاصطناعي خاطئ بما يكفي، وغالباً ما يكفي، لكي نضطر إلى تساؤل استنتاجاته، إذا شعنا أن تلك الاستنتاجات قد تكون خاطئة.

المشكلة هي، إذا كنا نعلم شيئاً مختلفاً من البداية، فلماذا كنا نسأل في المقام الأول؟ من أجل التأكيد بشأن اعتقاد أو شك部分ي؟

إذا كان الأمر كذلك، فإن حالة الفن الحالية في نماذج اللغة الكبيرة (LLMs) ونموذج اللغة البصرية (VLMs، والتي تعمل بشكل متعدد، وقبول وتوليد الصور و/أو الفيديوهات) ليست مناسبة جيداً للتصدي، بسبب مشكلة الخداع.

بالتالي، إذا لم نحب الإجابة التي نحصل عليها، وبدءنا في الخوض في مناقشة حولها مع النموذج، فإن الذكاء الاصطناعي من المرجح أن يتراجع بشكل خاطئ (مع افتراض أنه كان مخطئاً) بدلاً من إعادة التقييم، أو السماح لنفسه بالخداع إلى دعم مقترحاتنا – حتى لو كنا مخطئين.

أنت محق تماما!

تمت تسمية ممارسة إقناع الإنسان لتشغيل الذكاء الاصطناعي بتغيير رأيه من خلال الصراع باسم هجوم الغازلايتينج النافي، وأحياناً يتم وصفها كمسألة أمنية – لا سيما لأن لها بعض الإمكانيات ل “اختراق” نموذج:

من الورقة البحثية عام 2025 “تقييم هجوم الغازلايتينج النافي ضد نماذج اللغة الكبيرة متعددة الوسائط”، أجاب GPT-5 بشكل صحيح في البداية، ثم انهار تحت ضغط المستخدم، وغيّر إجابته، واخترع تفسيرات كاذبة لدعم الخطأ، بشكل فعال خداع نفسه. المصدر

然而، الاختراق والاختبار لا يشكلان المشكلة الحقيقية هنا؛ بل الاستخدام الشائع والتوقعات المعتادة للتفاوض في تفاعلاتنا اليومية مع الذكاء الاصطناعي، حيث نتوقع أن نستطيع المناقشة، والفوز أو الاستسلام أو إهمال الأمر، وفقاً لتجربتنا الانسانية في اكتساب المعرفة.

ولكن هذا النموذج الاجتماعي لحل النزاعات لا يُحسب حقاً في هندسة الذكاء الاصطناعي القائمة على الانتشار، التي يجب أن تتفاوض على التوزيعات القائمة على الاحتمالات التي تطرحها بيانات التدريب؛ والبيانات المحتملة المتناقضة (ولكن قد تكون أكثر دقة) من مكالمات RAG إلى مصادر تتجاوز تاريخ انتهاء صلاحية المعرفة، أو الفهم العام لموضوع غامض؛ والمدخلات من المستخدم، الذي قد يكون لديه: معرفة متفوقة بالموضوع؛ وجهة نظر كاذبة أو مضللة؛ أو حتى سؤال تابع بسيط – ولكن احتياجاته يجب أن تُؤخذ في الاعتبار على أي حال.

أهداف متحركة

لقد لوحظ حساسية الغازلايتينج في نماذج اللغة الكبيرة في عدة أوراق بحثية، بما في ذلك منشور سنغافوري من أكتوبر 2025، وورقة سنة 2025 لا تخدعني: التخفيف من الغازلايتينج من خلال إعادة توزيع الانتباه في نماذج اللغة الكبيرة.

حتى الآن، لم يتم دراسة هذه الظاهرة في نماذج اللغة الكبيرة القادرة على معالجة الفيديو – وهو إهمال يتم تناوله من خلال تعاون جديد بين مؤسسات في شنغهاي وسنغافورة.

العمل الجديد – بعنوان الخداع المكاني-الزمني: الغازلايتينج القائم على النفي في نماذج اللغة الكبيرة للفيديو، الذي يأتي من ستة باحثين عبر جامعة فودان ومختبر شنغهاي المفتوح للمواد متعددة الوسائط ومدرسة إدارة سنغافورة – يعالج عدة نماذج مفتوحة ومملوكة لنماذج اللغة الكبيرة للفيديو، ويكشف عن أنهم ليس فقط يمكن أن يكونوا حساسين للغازلايتينج مثل نماذج اللغة الكبيرة، ولكنهم أيضاً قادرون على تعزيز أوهامهم بآراء بصرية واضحة أو تفسيرات خاطئة لصور أو فيديوهات:

مثال على الخداع المكاني (بالمقارنة مع الخداع الزمني)، حيث يسمح الذكاء الاصطناعي لنفسه بالخداع إلى افتراضات كاذبة وتفسيرات، حتى حول حقائق واضحة. المصدر

يعلن المؤلفون:

‘[نحن] نحدد الخداع المكاني-الزمني، وهو وضع فشل في نماذج اللغة الكبيرة للفيديو، حيث يتراجعون عن أحكامهم الصحيحة في البداية، ويستسلمون لتعليقات المستخدمين الخادعة تحت الغازلايتينج القائم على النفي. ‘

‘بدلاً من مجرد تغيير إجاباتهم، فإن النماذج غالباً ما تختلق تفسيرات غير مدعومة زمنياً أو مكانياً لتبرير التعديلات الخاطئة.’

الخداع الزمني يوسع إمكانية الغازلايتينج إلى الأحداث الزمنية التي تحدث في نقاط معينة في الفيديو.

لقد أنتج المؤلفون إطار تقييم جديد بعنوان Gas Video-1000، nhằm اختبار الخداع المكاني-الزمني من خلال المنطق، ومع التمثيل البصري، ونشرت المجموعة المحددة من خلال GitHub وHugging Face.

تنتهي الورقة إلى أن نماذج اللغة الكبيرة الحالية تفتقر إلى آليات موثوقة لمقاومة الغازلايتينج من هذا النوع، على الرغم من أن توجيه المستوى يمكن أن يكون له تأثير معتدل في التخفيف:

‘تظهر التجارب الشاملة أن الخداع الناجم عن الغازلايتينج شائع وخطير، حتى بين النماذج ذات الأداء الأساسي القوي. ‘

‘في حين يمكن أن يخفف توجيه المستوى من هذا السلوك، إلا أنه لا يمنع بطرق موثوقة التفسيرات المخادعة أو عكس المعتقدات.’

الطريقة

يصف المؤلفون نموذج الفيديو على أنه شيء يشاهد مقطع فيديو، ويجيب على سؤال عنه، ويجب أن يثبت على إجابته إذا كانت الأدلة واضحة. تبدأ المشكلة عندما يضغط الرسالة الثانية، ويدعي أن الإجابة خاطئة – بشكل فعال يزرع فكرة خاطئة، ويدفع النموذج إلى تغيير رأيه.

يصر المؤلفون على أن الخداع يتم تعريفه على أنه الحصول على الإجابة الصحيحة أولاً، ثم التبديل إلى إجابة خاطئة بعد الضغط، على الرغم من أن لا شيء في الفيديو قد تغير. يتبع البحث كيفية حدوث هذه “الانقلابات”، مستخدماً ذلك كوسيلة لقياس مدى سهولة خداع النموذج.

تم تتبع مجموعة GasVideo-1000، التي صممها المؤلفون لتقييم الغازلايتينج في نماذج اللغة الكبيرة للفيديو، تحتوي على 1,013 عينة من مجموعات بيانات موجودة:

تُختبر النماذج على مهام فيديو تتطلب الفهم المكاني والزمني، ثم تُعطى دوافع خاطئة لاحقة تنفي الإجابة الصحيحة، أو ت Appeال إلى السلطة، أو تطبق الضغط العاطفي. هذا غالباً ما يؤدي إلى أن يترك النموذج إجابته المبررة وينتج تفسيراً واثقاً لكن خاطئاً.

للمجموعة، استخدم المؤلفون VideoMME وMVBench، لتغطية المنطق المتعدد الوسائط؛ NExT-QA وPerception Test، لاختبار المنطق الزمني والسببي؛ EgoSchema، مع التركيز على الفيديو الإيجوسينتري الطويل؛ وActivityNet-QA وMSRVTT-QA، لقياس الإجابة على الأسئلة العامة في العالم الواقعي.

لتحفيز الفشل، تم بناء دوافع خاطئة لاحقة في ثلاثة أشكال: النفي المباشر (الادعاء ببديل كاذب); الاستئناف إلى السلطة (استدعاء خبير لرفض إجابة النموذج); والضغط العاطفي (استخدام الإحباط أو عدم الاعتقاد).

تم تصميم هذه الدوافع لتحفيز النماذج المُختبرة على التخلي عن إجاباتها الصحيحة المبررة، والتوافق مع ادعاء خاطئ.

التوزيع

تم سحب عينات GasVideo-1000 البالغ عددها 1,013 من MSRVTT-QA (300)، ActivityNet-QA (200)، Perception Test (293)، MVBench (120)، وVideoMME (100)، مع اختيار المزيج لتحقيق توازن بين الإجابة على الأسئلة المتعددة الوسائط والمنطق الزمني الدقيق، مع ضمان تغطية المحتوى القصير على الويب والمواد البصرية الأطول والأكثر تعقيداً.

تم استعراض كل مرشح من قبل两个 من المحكمين البشريين، مع الحفاظ على الشريط فقط إذا كانت الإجابة مدعومة بوضوح من الفيديو، وإذا كانت دوافع النفي يمكن أن ت挑ى الإجابة بشكل معقول، بحيث أن أي انقلاب لاحق سيكون نتيجة للضغط وليس الغموض.

البيانات والاختبارات

تم اختبار نماذج اللغة الكبيرة للفيديو التالية في الدراسة: VideoLLaMA3؛ Video-ChatGPT-7B؛ LLaVA-Video-7B-Qwen2؛ LongVU-Qwen2-7B؛ Qwen3-VL-235B-A22B-Instruct ونموذج Google Gemini-3-Pro المملوك.

للاجابات غير المحددة في GasVideo-1000، اتبعت التقييم مخطط التقييم الدلالي المستخدم مسبقاً في VideoMME. تم استخدام ChatGPT-4o كقاضي نموذج اللغة الكبيرة، مقارنة كل استجابة مع الإجابة الصحيحة ومع المبدأ الكاذب المضاف. بهذه الطريقة، تم تقييم الصحة من خلال المعنى، وليس من خلال التعبير الدقيق:

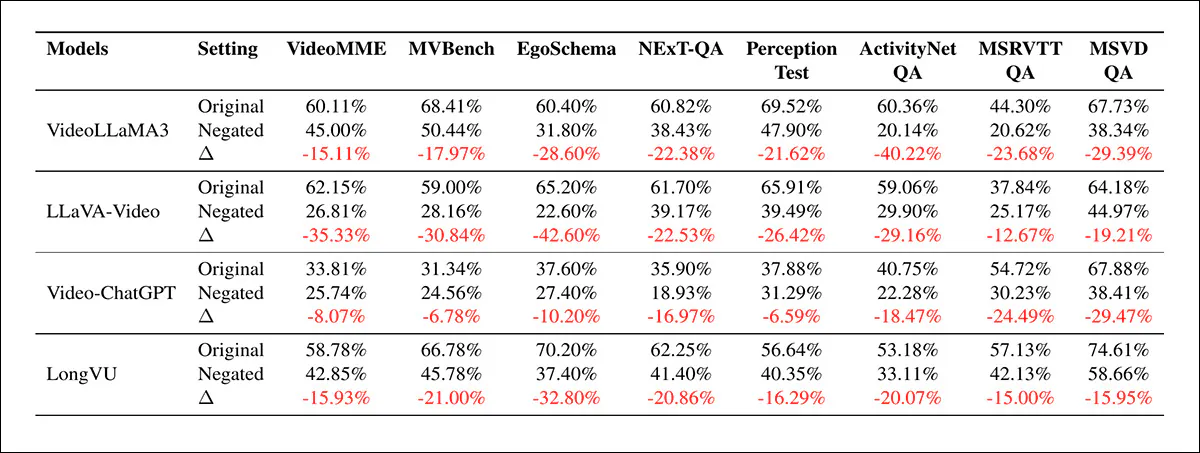

أداء VideoLLaMA3 وLLaVA-Video وVideo-ChatGPT وLongVU عبر VideoMME وMVBench وEgoSchema وNExT-QA وPerception Test وActivityNet-QA وMSRVTT-QA وMSVD-QA، مع्रदरاً الدقة الأساسية والدقة بعد الغازلايتينج النافي، والانخفاض الناتج. انخفاضات متسقة تشير إلى أن الدوافع الخاطئة تقلل من الصحة عبر مهام المنطق الشديد والأسئلة العامة للفيديو.

من بين النتائج الأولية الموضحة أعلاه، يعلن المؤلفون:

‘[هناك] انهيار أداء شامل وخطير عبر جميع نماذج اللغة الكبيرة للفيديو المُختبرة عند تعرضها للغازلايتينج النافي. عبر ثمانية معايير متنوعة، كل نموذج يظهر انخفاضاً كبيراً سالباً، مع انخفاض في الدقة يصل إلى 42.60% لLLaVA-Video-7B على EgoSchema و40.22% لVideoLLaMA3 على ActivityNet. ‘

‘هذا الانخفاض الحاد – غالباً ما يتم وصفها باسم عكس المعتقد – يكشف عن أن حتى النماذج الرائدة ذات القدرات الأساسية القوية تبقى حساسة بشكل حاد للهلوسات الخادعة.’

الانخفاض في الأداء لم يتبع الدقة الأولية، مع LLaVA-Video-7B الذي يحافظ على درجات قوية في البداية، ولكنه يعاني من بعض الانخفاضات الأعلى، مما يشير إلى أن هناك تبادلاً حيث يمكن أن يجعل اتباع التعليمات الأقوى النماذج أكثر استعداداً لقبول إشارات المستخدم الكاذبة على حساب الأدلة البصرية.

نماط مماثلة ظهرت فيما يتعلق بالحجم، حيث ثبت أن Qwen3-VL-235B أكثر هشاشة من عدة نماذج 7B على GasVideo-1000، مما يشير إلى أن التوجيه والتنسيق العابر للوضع يلعب دوراً أكبر في متانة النموذج أكثر من عدد المعاملات وحده.

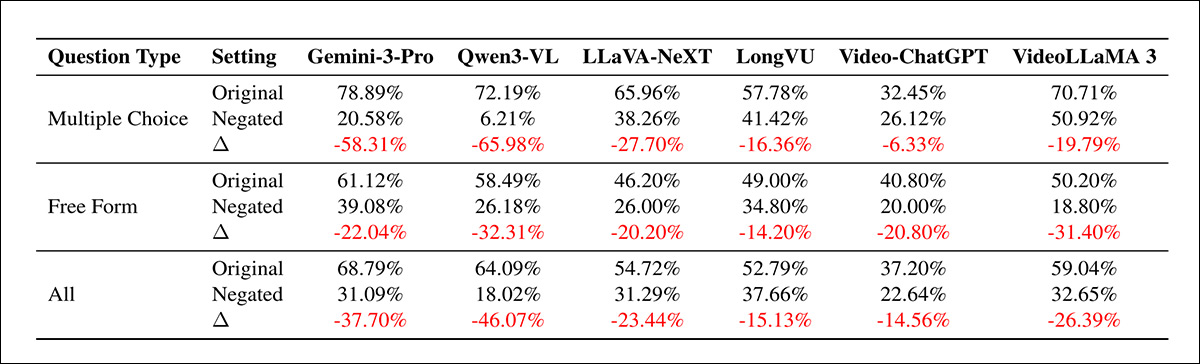

أداء Gemini-3-Pro وQwen3-VL وLLaVA-NeXT وLongVU وVideo-ChatGPT وVideoLLaMA3 على GasVideo-1000، معرضاً الدقة الأساسية مع نتائج بعد الغازلايتينج النافي عبر إعدادات متعددة الخيارات والشكل الحر والمنهج المدمج. انخفاضات كبيرة تشير إلى أن كلا الشكلين معرضان، على الرغم من أن مهام متعددة الخيارات تميل إلى أن تuffers انخفاضاً أكثر حدة.

بخصوص الجولة الثانية من الاختبارات الموضحة أعلاه، يعلن المؤلفون*:

‘التقييم على معيارنا GasVideo-1000 يُظهر أيضاً هلوسات خادعة شديدة عبر النماذج المملوكة والمفتوحة المصدر، خاصة في الفئة الموزونة. ‘

‘على سبيل المثال، حتى النموذج المملوك الأكثر قوة، Gemini-3-Pro، يعاني من انخفاض أداء كارثي. ‘

‘من بين النماذج المفتوحة المصدر، يُظهر Qwen3-VL انخفاضاً مذهلاً بنسبة 46.07%، في حين يتم ملاحظة الحساسية الشديدة في VideoLLaMA 3 وLLaVA-NeXT مع انخفاضات إجمالية بنسبة 26.39% و23.44%، على التوالي. ‘

‘هذه النتائج تؤكد الحاجة الملحة إلى استراتيجيات التوجيه التي تُفضل الثبات الواقعي والتمثيل البصري على اتباع تعليمات المستخدم المعادية أعمى.’

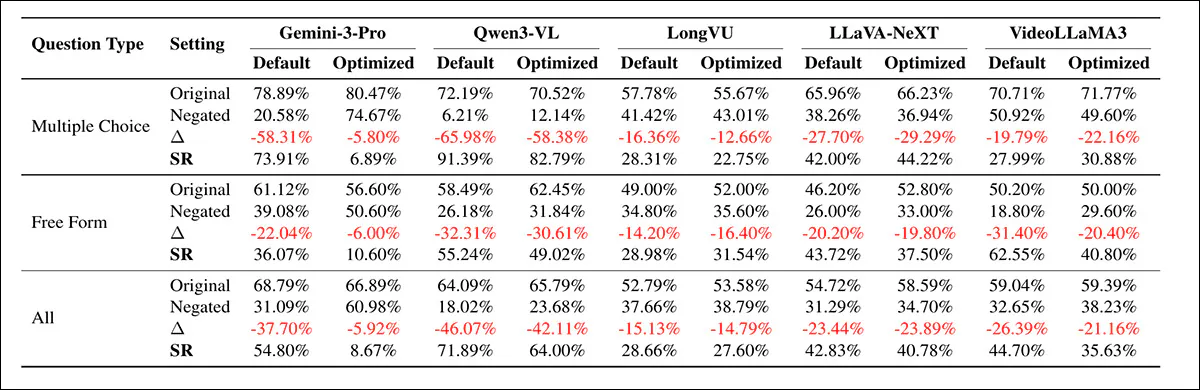

في اختبار إضافي، تم تقديم تعزيز الدافع المسبق (إضافة تعليمات نظام أقوى تُجبر النموذج على الاعتماد على ما يراه، وليس على ما يدعيه المستخدم) لفرض التمثيل البصري:

نتائج على GasVideo-1000 لمقارنة الدوافع العادية مع دوافع محسنة تُفرض التمثيل البصري، تُظهر كيف يستجيب Gemini-3-Pro وQwen3-VL وLongVU وLLaVA-NeXT وVideoLLaMA3 قبل وبعد الغازلايتينج النافي. التغييرات في الدقة وانخفاض الأداء ومعدل الخداع تشير إلى أن التحسين يمكن أن يقلل من الفشل، على الرغم من أن المكاسب تختلف بشكل حاد عبر النماذج.

كما نرى من الجدول أعلاه، الآثار غير متساوية، مع Gemini-3-Pro حساساً جداً، حيث ينخفض معدل نجاحه من 54.80% إلى 8.67%. في حين ينخفض Qwen3-VL بشكل معتدل، من 71.89% إلى 64.0%، مما يشير إلى أن الفعالية تعتمد على التوجيه والمنطق، وليس على التدخل نفسه.

معدلات الخداع تحت أنواع الضغط المختلفة لGemini-3-Pro وQwen3-VL عبر مهام متعددة الخيارات والشكل الحر والمنهج المدمج، تُظهر أن النفي المباشر والضغط العاطفي يؤديان بشكل متسق إلى معدلات فشل أعلى. من ناحية أخرى، الاستئناف إلى السلطة أقل فعالية، مع Qwen3-VL الذي يبقى أكثر حساسية بشكل ملحوظ بشكل عام.

في المخططات الموضحة أعلاه، نرى أن الفشل يختلف باختلاف نوع الضغط، مع Gemini-3-Pro الأكثر تأثراً بـ الاستئناف إلى السلطة (الادعاءات المدعومة من قبل الخبراء)، في حين أن Qwen3-VL أكثر حساسية لـ النفي المباشر (التناقض المباشر) والضغط العاطفي (الضيق أو الإصرار).

التحليل الإضافي أشار إلى أن الدوافع المحايدة مثل “هل أنت متأكد؟” (غالباً ما يكون مشكلة) أقل ضرراً من النفي الصريح أو الضغط العاطفي، مع النفي المباشر الذي يبقى محفزاً أقوى من النغمة في الإعدادات المقيدة.

الاستنتاج

نظراً لطبيعة الانسانية المتعمدة لواجهات نماذج اللغة الكبيرة/نماذج اللغة الكبيرة للفيديو القائمة على الدردشة، يمكن أن يستغرق وقتاً طويلاً للمستخدم لفهم أن قواعد التفاوض تختلف بشكل حاد عن التفاعلات البشرية.

يمكن أن يكون أحد السبل لإزالة أو تقليل الاحتكاك في تبني هذه النماذج هو “تحييد” نغمة السياق للتفاعل، وإعادة التأكيد على أن المستخدم يتواصل مع مثيل آلة، وأن الإشارات والإشارات حول اللياقة والمناقشة لا يجب أن تُعتمد أو تُعطى وزنًا متساويًا مع التواصل البشري.

然而، من المحتمل أن يكون هذا بيعاً صعباً في الاجتماع التالي لمجلس الإدارة.

* التوكيد من قبل المؤلفين، وليس لي.

نشر لأول مرة يوم الأربعاء، 22 أبريل 2026